اليوم الأمازون SageMaker أعلن عن دعم شبكة البحث عن ضبط تلقائي للنموذج، مما يوفر للمستخدمين إستراتيجية إضافية للعثور على أفضل تكوين للمعلمات الفائقة لطرازك.

يعثر الضبط التلقائي للنموذج Amazon SageMaker على أفضل إصدار من النموذج عن طريق تشغيل العديد من مهام التدريب على مجموعة البيانات الخاصة بك باستخدام نطاق من المعلمات التشعبية التي تحددها. ثم يختار قيم المعلمة الفائقة التي ينتج عنها نموذج يحقق أفضل أداء ، كما تم قياسه بواسطة a متري من اختيارك.

للعثور على أفضل قيم المعلمات التشعبية لنموذجك ، يدعم الضبط التلقائي للنموذج Amazon SageMaker استراتيجيات متعددة ، بما في ذلك بايزي (افتراضي)، عشوائية البحث و هايبرباند.

بحث الشبكة

يستكشف بحث الشبكة بشكل شامل التكوينات في شبكة المعلمات الفائقة التي تحددها ، مما يسمح لك بالحصول على رؤى حول تكوينات المعلمات الفائقة الواعدة في شبكتك وإعادة إنتاج النتائج بشكل حاسم عبر عمليات ضبط مختلفة. يمنحك بحث الشبكة مزيدًا من الثقة في استكشاف مساحة بحث المعلمة التشعبية بالكامل. تأتي هذه الميزة مع مفاضلة لأنها أغلى من الناحية الحسابية من البحث Bayesian والبحث العشوائي إذا كان هدفك الرئيسي هو العثور على أفضل تكوين للمعلمات الفائقة.

بحث في الشبكة باستخدام Amazon SageMaker

في Amazon SageMaker ، يمكنك استخدام بحث الشبكة عندما تتطلب مشكلتك أن يكون لديك تركيبة المعلمات الفائقة المثالية التي تزيد أو تقلل من مقياس الهدف الخاص بك. حالة الاستخدام الشائع حيث يستخدم العميل Grid Search عندما تكون دقة النموذج وإمكانية التكرار أكثر أهمية لعملك من تكلفة التدريب المطلوبة للحصول عليه.

لتمكين البحث عن الشبكة في Amazon SageMaker ، قم بتعيين ملف Strategy الحقل إلى Grid عند إنشاء وظيفة ضبط ، على النحو التالي:

بالإضافة إلى ذلك ، يتطلب منك بحث الشبكة تحديد مساحة البحث (الشبكة الديكارتية) كمجموعة فئوية من القيم المنفصلة في تعريف وظيفتك باستخدام CategoricalParameterRanges مفتاح تحت ParameterRanges المعلمة ، على النحو التالي:

لاحظ أننا لم نحدد MaxNumberOfTrainingJobs للبحث عن الشبكة في تعريف الوظيفة لأنه يتم تحديده لك من عدد مجموعات الفئات. عند استخدام البحث العشوائي و Bayesian ، فإنك تحدد ملف MaxNumberOfTrainingJobs المعلمة كطريقة للتحكم في تكلفة وظيفة الضبط من خلال تحديد حد أعلى للحساب. مع بحث الشبكة ، فإن قيمة MaxNumberOfTrainingJobs (الآن اختياري) يتم تعيينه تلقائيًا على أنه عدد المرشحين للبحث في الشبكة في وصف HyperParameterTuningJob شكل. يسمح لك هذا باستكشاف الشبكة المرغوبة للمعلمات الفائقة بشكل شامل. بالإضافة إلى ذلك ، لا يقبل تعريف وظيفة بحث الشبكة إلا النطاقات الفئوية المنفصلة ولا يتطلب تعريف نطاقات متصلة أو عدد صحيح لأن كل قيمة في الشبكة تعتبر منفصلة.

تجربة بحث الشبكة

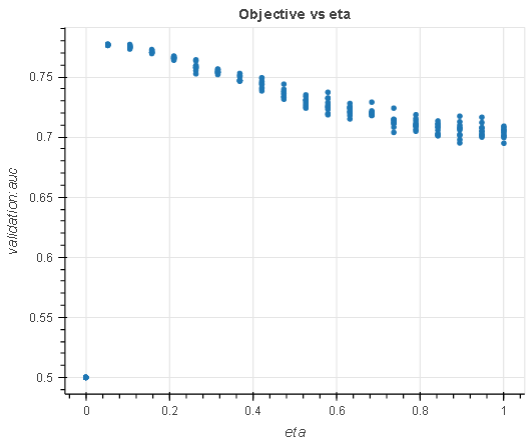

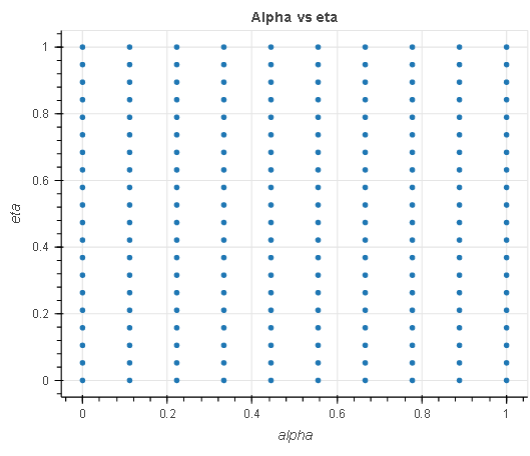

في هذه التجربة ، نظرًا لمهمة الانحدار ، نبحث عن المعلمات التشعبية المثلى ضمن مساحة بحث تبلغ 200 معلمة تشعبية ، 20 eta و 10 alpha تتراوح من 0.1 إلى 1. نستخدم ملف مجموعة بيانات التسويق المباشر لضبط نموذج الانحدار.

- ايتا: تقليص حجم الخطوة المستخدمة في التحديثات لمنع الإفراط في التركيب. بعد كل خطوة من خطوات التعزيز ، يمكنك الحصول على أوزان الميزات الجديدة مباشرةً. ال

etaتعمل المعلمة في الواقع على تقليص أوزان الميزات لجعل عملية التعزيز أكثر تحفظًا. - ألفا: مصطلح تسوية L1 على الأوزان. زيادة هذه القيمة تجعل النماذج أكثر تحفظًا.

|

|

يظهر الرسم البياني الموجود على اليسار تحليلاً لـ eta المعلمة الفائقة فيما يتعلق بالمقياس الموضوعي ويوضح كيف استنفد البحث الشبكي مساحة البحث بالكامل (الشبكة) في محاور X قبل إرجاع أفضل نموذج. بالتساوي ، يحلل الرسم البياني الموجود على اليمين المعلمتين الفائقتين في مساحة ديكارتية واحدة لإثبات أنه تم انتقاء جميع النقاط في الشبكة أثناء الضبط.

توضح التجربة أعلاه أن الطبيعة الشاملة لبحث الشبكة تضمن اختيارًا مثاليًا للمعلمات الفائقة نظرًا لمساحة البحث المحددة. يوضح أيضًا أنه يمكنك إعادة إنتاج نتيجة البحث الخاصة بك عبر التكرارات التوليفية ، مع تساوي جميع الأشياء الأخرى.

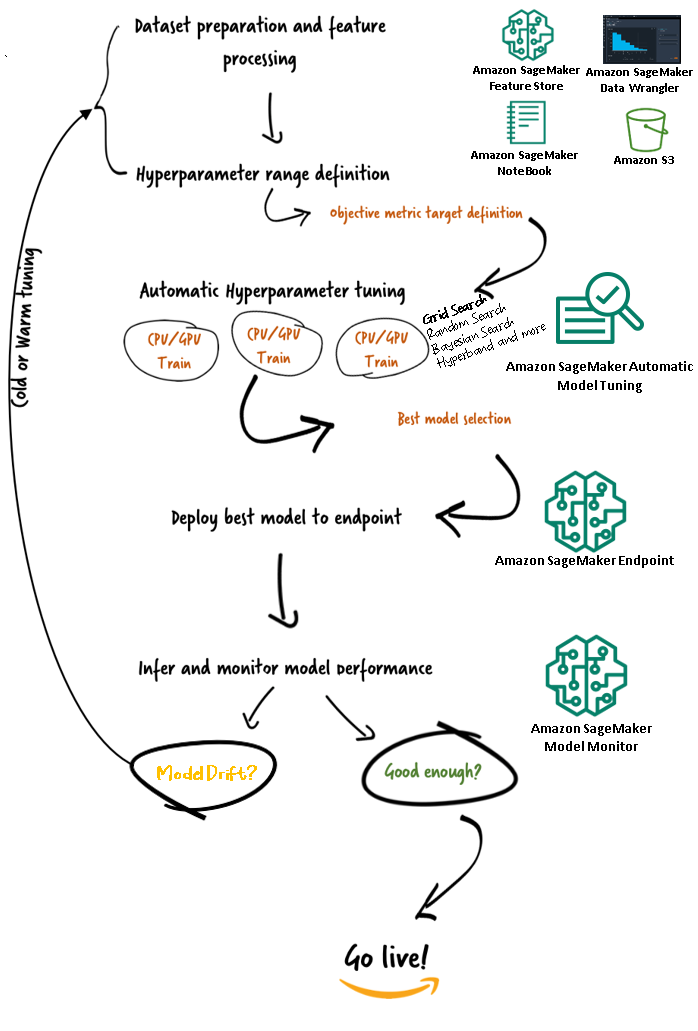

تدفقات عمل Amazon SageMaker Automatic Model Tuning (AMT)

باستخدام الضبط التلقائي للنموذج Amazon SageMaker ، يمكنك العثور على أفضل إصدار من النموذج الخاص بك عن طريق تشغيل وظائف التدريب على مجموعة البيانات الخاصة بك مع العديد من استراتيجيات البحث ، مثل Bayesian ، والبحث العشوائي ، والبحث الشبكي ، و Hyperband. يتيح لك الضبط التلقائي للنموذج تقليل الوقت اللازم لضبط النموذج من خلال البحث تلقائيًا عن أفضل تكوين للمعلمات التشعبية ضمن نطاقات المعامِلات الفائقة التي تحددها.

الآن بعد أن قمنا بمراجعة ميزة استخدام بحث الشبكة في Amazon SageMaker AMT ، فلنلقِ نظرة على مهام سير عمل AMT ونفهم كيف تتلاءم جميعها معًا في SageMaker.

وفي الختام

في هذا المنشور ، ناقشنا كيف يمكنك الآن استخدام استراتيجية بحث الشبكة للعثور على أفضل نموذج وقدرته على إعادة إنتاج النتائج بشكل حاسم عبر وظائف ضبط مختلفة. لقد ناقشنا المفاضلة عند استخدام بحث الشبكة مقارنةً بالاستراتيجيات الأخرى ، وكيف تتيح لك استكشاف مناطق مساحات المعامل التشعبي الأكثر واعدة وإعادة إنتاج نتائجك بشكل حاسم.

لمعرفة المزيد حول ضبط النموذج التلقائي ، قم بزيارة صفحة المنتج و وثيقة تقنية.

عن المؤلف

دوج مبايا هو مهندس حلول شريك أول مع التركيز على البيانات والتحليلات. يعمل Doug بشكل وثيق مع شركاء AWS ، مما يساعدهم على دمج حلول البيانات والتحليلات في السحابة.

دوج مبايا هو مهندس حلول شريك أول مع التركيز على البيانات والتحليلات. يعمل Doug بشكل وثيق مع شركاء AWS ، مما يساعدهم على دمج حلول البيانات والتحليلات في السحابة.

- متقدم (300،XNUMX)

- AI

- ai الفن

- مولد الفن ai

- الروبوت ai

- الأمازون SageMaker

- الذكاء الاصطناعي

- شهادة الذكاء الاصطناعي

- الذكاء الاصطناعي في البنوك

- روبوت ذكاء اصطناعي

- روبوتات الذكاء الاصطناعي

- برنامج ذكاء اصطناعي

- التعلم الآلي من AWS

- سلسلة كتلة

- مؤتمر blockchain ai

- عملة عبقرية

- الذكاء الاصطناعي للمحادثة

- مؤتمر التشفير ai

- دال

- التعلم العميق

- google ai

- آلة التعلم

- أفلاطون

- أفلاطون ع

- الذكاء افلاطون البيانات

- لعبة أفلاطون

- أفلاطون داتا

- بلاتوغمينغ

- مقياس ai

- بناء الجملة

- زفيرنت