في ما قد يكون الدراسة الأولى من نوعها، قامت شركة الذكاء الاصطناعي Anthropic بتطوير نموذج لغة كبير (LLM) تم ضبطه بدقة من أجل أحكام القيمة من قبل مجتمع المستخدمين.

ماذا يعني أن يصبح تطوير الذكاء الاصطناعي أكثر ديمقراطية؟ لمعرفة ذلك، قمنا بالشراكة مع @collect_intel لاستخدام @usepolis لتنظيم دستور الذكاء الاصطناعي بناءً على آراء حوالي 1000 أمريكي. ثم قمنا بتدريب نموذج ضدها باستخدام الذكاء الاصطناعي الدستوري. pic.twitter.com/ZKaXw5K9sU

- أنثروبيك (AnthropicAI) 17 أكتوبر 2023

لقد تم تطوير العديد من برامج LLM التي تواجه الجمهور باستخدام حواجز حماية - تعليمات مشفرة تملي سلوكًا محددًا - في محاولة للحد من المخرجات غير المرغوب فيها. على سبيل المثال، يقدم كلود من Anthropic وChatGPT من OpenAI للمستخدمين استجابة آمنة جاهزة لطلبات المخرجات المتعلقة بالموضوعات العنيفة أو المثيرة للجدل.

ومع ذلك، وكما أشار عدد لا يحصى من النقاد، فإن حواجز الحماية وغيرها من تقنيات التدخل يمكن أن تعمل على حرمان المستخدمين من وكالتهم. ما يعتبر مقبولاً ليس مفيداً دائماً، وما يعتبر مفيداً ليس مقبولاً دائماً. ويمكن أن تختلف تعريفات الأخلاق أو الأحكام القائمة على القيمة بين الثقافات والشعوب والفترات الزمنية.

هذا الموضوع ذو علاقة بـ: المملكة المتحدة تستهدف التهديدات المحتملة للذكاء الاصطناعي في قمة نوفمبر المخطط لها

أحد الحلول الممكنة لذلك هو السماح للمستخدمين بإملاء محاذاة القيمة لنماذج الذكاء الاصطناعي. وتُعَد تجربة "الذكاء الاصطناعي الدستوري الجماعي" التي أجرتها منظمة أنثروبك بمثابة طعنة في وجه هذا "التحدي الفوضوي".

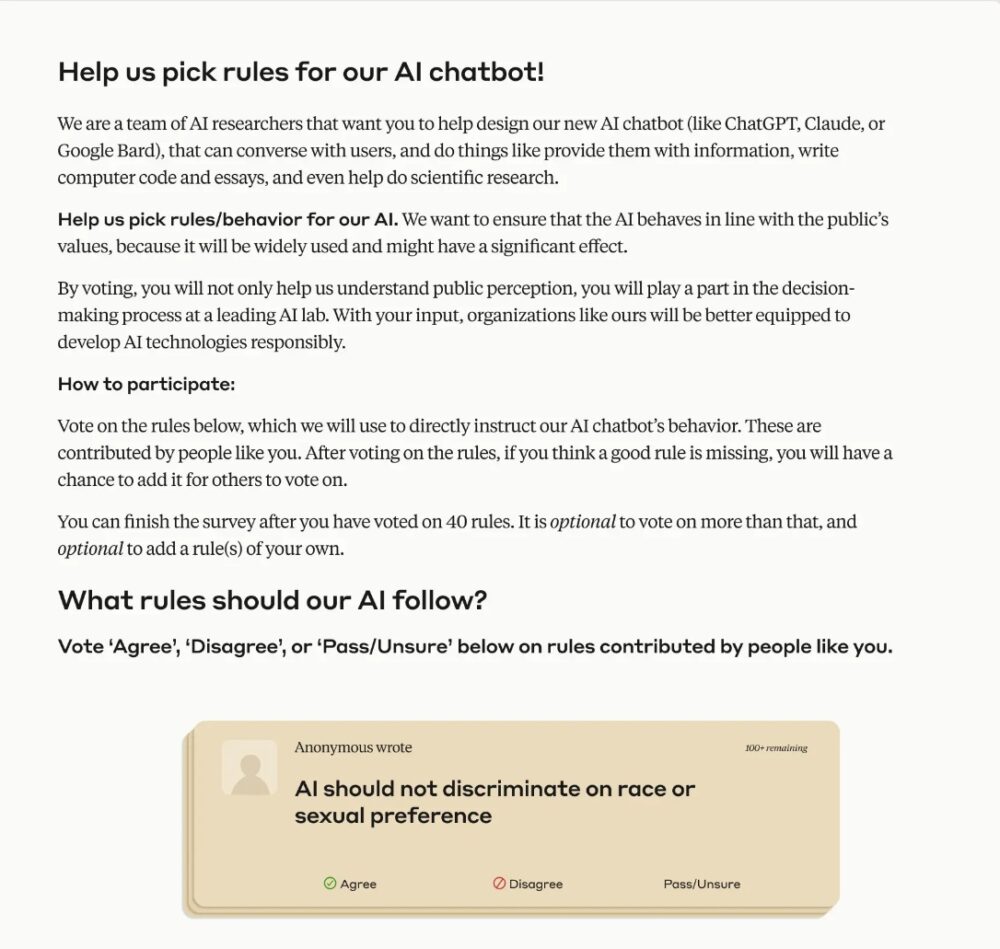

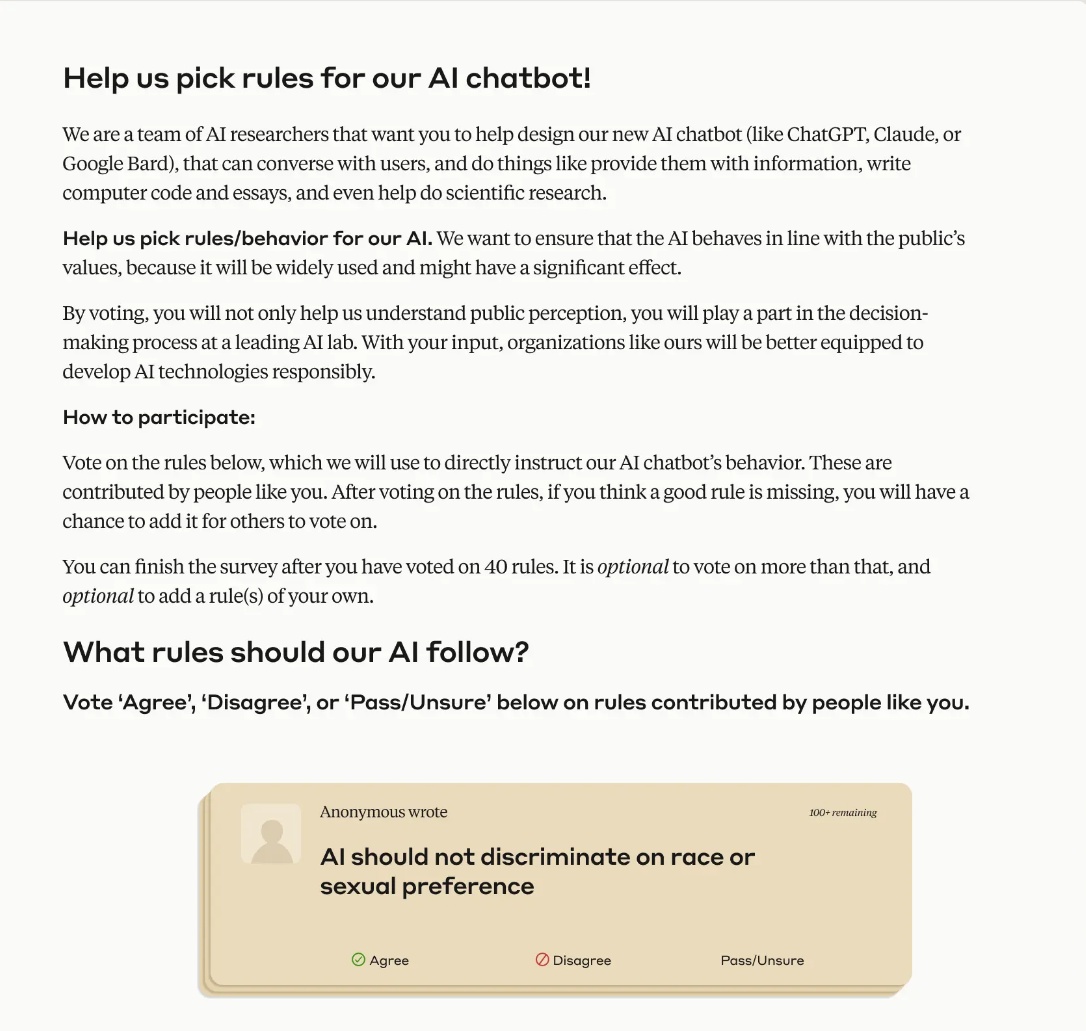

قامت Anthropic، بالتعاون مع Polis وCollective Intelligence Project، باستطلاع آراء 1,000 مستخدم من مختلف الفئات السكانية وطلبت منهم الإجابة على سلسلة من الأسئلة عبر الاقتراع.

ويتمحور التحدي حول السماح للمستخدمين بتحديد ما هو مناسب دون تعريضهم لمخرجات غير مناسبة. يتضمن ذلك التماس قيم المستخدم ثم تنفيذ تلك الأفكار في نموذج تم تدريبه بالفعل.

تستخدم الأنثروبيك طريقة تسمى "الذكاء الاصطناعي الدستوري". مباشرة جهودها في ضبط LLMs للسلامة والفائدة. يتضمن ذلك بشكل أساسي إعطاء النموذج قائمة من القواعد التي يجب عليه الالتزام بها ثم تدريبه على تنفيذ تلك القواعد طوال العملية، تمامًا مثلما يعمل الدستور كوثيقة أساسية للحكم في العديد من الدول.

في تجربة الذكاء الاصطناعي الدستوري الجماعي، حاولت أنثروبيك دمج التعليقات المستندة إلى المجموعة في دستور النموذج. النتائج، بالنسبة الى إلى منشور مدونة من Anthropic، يبدو أنه حقق نجاحًا علميًا لأنه سلط الضوء على المزيد من التحديات نحو تحقيق هدف السماح لمستخدمي منتج LLM بتحديد قيمهم الجماعية.

إحدى الصعوبات التي كان على الفريق التغلب عليها هي التوصل إلى طريقة جديدة لعملية القياس. نظرًا لأن هذه التجربة تبدو الأولى من نوعها، وتعتمد على منهجية الذكاء الاصطناعي الدستورية الخاصة بشركة Anthropic، فلا يوجد اختبار ثابت لمقارنة النماذج الأساسية بتلك التي تم ضبطها مع القيم الجماعية.

في النهاية، يبدو كما لو أن النموذج الذي نفذ البيانات الناتجة عن ردود فعل استطلاعات المستخدمين تفوق على النموذج الأساسي "قليلاً" في مجال المخرجات المتحيزة.

لكل منشور بالمدونة:

"أكثر من النموذج الناتج، نحن متحمسون لهذه العملية. نعتقد أن هذه قد تكون واحدة من الحالات الأولى التي يقوم فيها أفراد من الجمهور، كمجموعة، بتوجيه سلوك نموذج لغوي كبير عن عمد. ونأمل أن تعتمد المجتمعات في جميع أنحاء العالم على تقنيات مثل هذه لتدريب نماذج ثقافية وسياقية محددة تخدم احتياجاتها.

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- PlatoData.Network Vertical Generative Ai. تمكين نفسك. الوصول هنا.

- أفلاطونايستريم. ذكاء Web3. تضخيم المعرفة. الوصول هنا.

- أفلاطون كربون، كلينتك ، الطاقة، بيئة، شمسي، إدارة المخلفات. الوصول هنا.

- أفلاطون هيلث. التكنولوجيا الحيوية وذكاء التجارب السريرية. الوصول هنا.

- المصدر https://cointelegraph.com/news/antropic-democratic-ai-chatbot-by-letting-users-vote-for-its-values

- :لديها

- :يكون

- $ UP

- 000

- 1

- 17

- a

- من نحن

- مقبول

- تحقيق

- في

- ضد

- وكالة

- AI

- منظمة العفو الدولية chatbot

- نماذج الذكاء الاصطناعى

- انحياز

- السماح

- السماح

- سابقا

- دائما

- الأميركيين

- an

- و

- إجابة

- أنثروبي

- تظهر

- يبدو

- مناسب

- المنطقة

- حول

- مصطنع

- الذكاء الاصطناعي

- الذكاء الاصطناعي (منظمة العفو الدولية)

- AS

- At

- محاولة

- حاول

- قاعدة

- على أساس

- BE

- كان

- سلوك

- اعتقد

- المقارنة

- ما بين

- انحيازا

- المدونة

- نساعدك في بناء

- بنيت

- by

- تسمى

- CAN

- مراكز

- تحدى

- التحديات

- chatbot

- شات جي بي تي

- Cointelegraph

- للاتعاون

- جماعي

- آت

- المجتمعات

- مجتمع

- مقارنة

- نظرت

- دستور

- المثير للجدل

- جوهر

- البيانات

- التعاريف

- ديمقراطي

- التركيبة السكانية

- حدد

- المتقدمة

- التطوير التجاري

- تملي

- الصعوبات

- توجه

- عدة

- وثيقة

- هل

- جهود

- أساسيا

- أنشئ

- مثال

- متحمس

- تجربة

- ردود الفعل

- شركة

- الاسم الأول

- في حالة

- تبدأ من

- إضافي

- منح

- إعطاء

- هدف

- الحكم

- تجمع

- كان

- يملك

- أمل

- HTTPS

- الأفكار

- تنفيذ

- نفذت

- تحقيق

- in

- تعليمات

- دمج

- رؤيتنا

- عمدا

- إلى

- المشاركة

- IT

- انها

- JPG

- الأحكام

- نوع

- لغة

- كبير

- السماح

- مثل

- مما سيحدث

- قائمة

- LLM

- كثير

- مايو..

- تعني

- الأعضاء

- طريقة

- آلية العمل

- نموذج

- عارضات ازياء

- أخلاقية

- الأكثر من ذلك

- كثيرا

- يجب

- الأمم

- إحتياجات

- رواية

- نوفمبر

- of

- on

- ONE

- آراء

- or

- أخرى

- خارج

- تفوقت

- الناتج

- النتائج

- تغلب

- شراكة

- فترات

- المكان

- مخطط

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- ممكن

- منشور

- محتمل

- عملية المعالجة

- المنتج

- تنفيذ المشاريع

- جمهور

- الأسئلة المتكررة

- ذات صلة

- طلبات

- استجابة

- مما أدى

- النتائج

- سلب

- القواعد

- السلامة

- علمي

- مسلسلات

- خدمة

- يخدم

- محدد

- دراسة

- تحقيق النجاح

- استغلالها

- الهدف

- فريق

- تقنيات

- تجربه بالعربي

- من

- أن

- •

- المنطقة

- العالم

- من مشاركة

- منهم

- then

- هناك.

- هؤلاء

- على الرغم من؟

- التهديدات

- طوال

- الوقت

- إلى

- المواضيع

- نحو

- قطار

- متدرب

- قادة الإيمان

- أو تويتر

- عادة

- غير مرغوب فيه

- تستخدم

- مستخدم

- المستخدمين

- يستخدم

- استخدام

- قيمنا

- القيمة مقرها

- القيم

- بواسطة

- تصويت

- وكان

- we

- ابحث عن

- التي

- سوف

- مع

- بدون

- العالم

- زفيرنت