مع انتقال المزيد من المؤسسات إلى التعلم الآلي (ML) للحصول على رؤى أعمق ، هناك عائقان رئيسيان يواجهانهما وهما وضع العلامات وإدارة دورة الحياة. التوسيم هو تحديد البيانات وإضافة الملصقات لتوفير سياق بحيث يمكن لنموذج ML التعلم منه. قد تشير الملصقات إلى عبارة في ملف صوتي أو سيارة في صورة فوتوغرافية أو عضو في التصوير بالرنين المغناطيسي. يعد تصنيف البيانات ضروريًا لتمكين نماذج ML من العمل ضد البيانات. تتعلق إدارة دورة الحياة بعملية إعداد تجربة تعلم الآلة وتوثيق مجموعة البيانات والمكتبة والإصدار والنموذج المستخدم للحصول على النتائج. قد يقوم الفريق بإجراء مئات التجارب قبل الاستقرار على نهج واحد. قد يكون الرجوع إلى الوراء وإعادة إنشاء هذا النهج أمرًا صعبًا بدون تسجيل عناصر تلك التجربة.

تبدأ العديد من الأمثلة والبرامج التعليمية في تعلم الآلة بمجموعة بيانات تتضمن قيمة مستهدفة. ومع ذلك ، لا تحتوي بيانات العالم الحقيقي دائمًا على مثل هذه القيمة المستهدفة. على سبيل المثال ، في تحليل المشاعر ، يمكن للشخص عادةً إصدار حكم بشأن ما إذا كانت المراجعة إيجابية أم سلبية أم مختلطة. لكن المراجعات تتكون من مجموعة نصية ليس لها قيمة حكم مرتبطة بها. من أجل إنشاء ملف التعلم تحت إشراف لحل هذه المشكلة ، فإن مجموعة البيانات ذات العلامات عالية الجودة ضرورية. الحقيقة الأمازون SageMaker الأرض هي خدمة توسيم بيانات مُدارة بالكامل تجعل من السهل إنشاء مجموعات بيانات تدريب عالية الدقة لـ ML.

بالنسبة للمؤسسات التي تستخدم Databricks كنظام أساسي للبيانات والتحليلات على AWS لأداء مهام الاستخراج والتحويل والتحميل (ETL) ، غالبًا ما يكون الهدف النهائي هو تدريب نموذج التعلم الخاضع للإشراف. في هذا المنشور ، نوضح كيف تتكامل Databricks مع Ground Truth و الأمازون SageMaker لتسمية البيانات وتوزيع النموذج.

حل نظرة عامة

Ground Truth هي خدمة تصنيف بيانات مُدارة بالكامل تجعل من السهل إنشاء مجموعات بيانات تدريب عالية الدقة لـ ML. من خلال وحدة التحكم في Ground Truth ، يمكننا إنشاء تدفقات عمل مخصصة أو مضمنة لتسمية البيانات في دقائق. تدعم مهام سير العمل مجموعة متنوعة من حالات الاستخدام ، بما في ذلك السحب ثلاثية الأبعاد ، والفيديو ، والصور ، والنص. بالإضافة إلى ذلك ، تقدم Ground Truth تسمية البيانات تلقائيًا ، والتي تستخدم نموذج ML لتسمية بياناتنا.

نقوم بتدريب نموذجنا على مجموعة بيانات تقييمات عملاء أمازون المتاحة للجمهور. على مستوى عالٍ ، الخطوات كالتالي:

- استخرج مجموعة بيانات أولية ليتم تصنيفها ونقلها إلى خدمة تخزين أمازون البسيطة (أمازون S3).

- قم بإجراء عملية وضع العلامات عن طريق إنشاء وظيفة تسمية في SageMaker.

- بناء وتدريب نموذج بسيط للمتعلم الخطي Scikit-Learn لتصنيف شعور نص المراجعة على منصة Databricks باستخدام عينة مفكرة.

- استعمل MLflow المكونات لإنشاء وتنفيذ MLOps وحفظ القطع الأثرية للنموذج.

- انشر النموذج كنقطة نهاية SageMaker باستخدام امتداد مكتبة MLflow SageMaker للاستدلال في الوقت الفعلي.

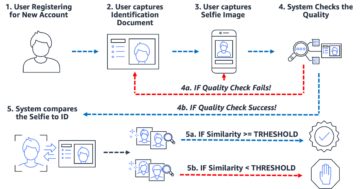

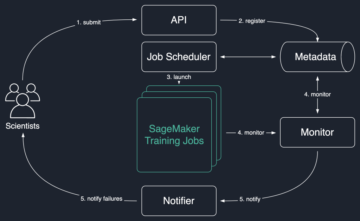

يوضح الرسم البياني التالي وضع العلامات ورحلة ML باستخدام Ground Truth و MLflow.

قم بإنشاء وظيفة وضع العلامات في SageMaker

من مجموعة بيانات Amazon Customer Reviews ، نستخرج أجزاء النص فقط ، لأننا نبني نموذجًا لتحليل المشاعر. بمجرد الاستخراج ، نضع النص في دلو S3 ثم نقوم بإنشاء وظيفة تسمية الحقيقة الأرضية عبر وحدة تحكم SageMaker.

على إنشاء وظيفة وضع العلامات الصفحة ، املأ جميع الحقول المطلوبة. كجزء من الخطوة في هذه الصفحة ، تتيح لك Ground Truth إنشاء ملف بيان الوظيفة. تستخدم Ground Truth ملف بيان الإدخال لتحديد عدد الملفات أو الكائنات في وظيفة وضع العلامات بحيث يتم إنشاء العدد الصحيح من المهام وإرسالها إلى الأشخاص (أو الجهاز). يتم حفظ الملف تلقائيًا في حاوية S3. الخطوة التالية هي تحديد فئة المهمة واختيار المهمة. في حالة الاستخدام هذه ، نختار نص كفئة مهمة ، و تصنيف النص بتسمية واحدة لتحديد المهمة ، مما يعني أن نص المراجعة سيكون له رأي واحد: إيجابي أو سلبي أو محايد.

أخيرًا ، نكتب تعليمات بسيطة ولكنها موجزة للمُلصقات حول كيفية تسمية البيانات النصية. يتم عرض الإرشادات في أداة وضع العلامات ويمكنك بشكل اختياري مراجعة عرض التعليق التوضيحي في هذا الوقت. أخيرًا ، نقوم بتقديم الوظيفة ومراقبة التقدم على وحدة التحكم.

أثناء تقدم وظيفة وضع العلامات ، يمكننا أيضًا إلقاء نظرة على البيانات المصنفة في ملف الناتج التبويب. يمكننا مراقبة كل نص وتسمية مراجعة ، وما إذا تم تنفيذ المهمة بواسطة إنسان أو آلة. يمكننا تحديد 100٪ من وظائف وضع العلامات ليتم إجراؤها بواسطة البشر أو اختيار التعليقات التوضيحية على الآلة ، مما يسرع المهمة ويقلل من تكاليف العمالة.

عند اكتمال المهمة ، يحتوي ملخص وظيفة التصنيف على روابط لبيان الإخراج ومجموعة البيانات المصنفة. يمكننا أيضًا الانتقال إلى Amazon S3 وتنزيل كلاهما من مجلد S3 bucket.

في الخطوات التالية ، نستخدم دفتر Databricks ، MLflow، ومجموعات البيانات المصنفة بواسطة Ground Truth لبناء ملف Scikit تعلم نموذج.

قم بتنزيل مجموعة بيانات مصنفة من Amazon S3

نبدأ بتنزيل مجموعة البيانات المصنفة من Amazon S3. يتم حفظ البيان بتنسيق JSON ونقوم بتحميله في Spark DataFrame في Databricks. لتدريب نموذج تحليل المشاعر ، نحتاج فقط إلى نص المراجعة والمشاعر التي تم شرحها بواسطة وظيفة وضع العلامات على الحقيقة الأرضية. نستخدم select () لاستخراج هاتين الميزتين. ثم نقوم بتحويل مجموعة البيانات من PySpark DataFrame إلى Pandas DataFrame ، لأن خوارزمية Scikit-Learn تتطلب تنسيق Pandas DataFrame.

بعد ذلك ، نستخدم Scikit-Learn CountVectorizer لتحويل نص المراجعة إلى متجه كبير الحجم عن طريق تعيين ngram_range أقصى قيمة تصل إلى 2. CountVectorizer يحول النص إلى مصفوفة من عدد الرموز. ثم نستخدم TfidfTransformer لتحويل متجه bigram إلى تنسيق مصطلح تردد معكوس التردد (TF-IDF).

قارنا درجات الدقة للتدريب الذي تم إجراؤه باستخدام ناقل Bigram مقابل Bigram باستخدام TF-IDF. TF-IDF هو مقياس إحصائي يقيم مدى صلة كلمة ما بوثيقة في مجموعة من الوثائق. نظرًا لأن نص المراجعة يميل إلى أن يكون قصيرًا نسبيًا ، يمكننا ملاحظة كيفية تأثير TF-IDF على أداء النموذج التنبئي.

قم بإعداد تجربة MLflow

تم تطوير MLflow بواسطة Databricks وهو الآن مشروع مفتوح المصدر. يدير MLflow دورة حياة ML ، بحيث يمكنك تتبع التجارب وإعادة إنشائها ونشرها بسهولة.

لإعداد تجارب MLflow ، نستخدم mlflow.sklearn.autolog() لتمكين التسجيل التلقائي للمعلمات الفائقة والمقاييس وعناصر النموذج في أي وقت estimator.fit(), estimator.fit_predict(), و estimator.fit_transform() وتسمى. بدلاً من ذلك ، يمكنك القيام بذلك يدويًا عن طريق الاتصال mlflow.log_param() و mlflow.log_metric().

نحن نلائم مجموعة البيانات المحولة مع مصنف خطي مع تعلم النسب المتدرج العشوائي (SGD). باستخدام SGD ، يقدر تدرج الخسارة عينة واحدة في كل مرة ويتم تحديث النموذج على طول الطريق مع جدول متناقص للقوة.

يتم تمرير مجموعتي البيانات التي أعددناها مسبقًا إلى ملف train_and_show_scores() وظيفة للتدريب. بعد التدريب ، نحتاج إلى تسجيل نموذج وحفظ القطع الأثرية الخاصة به. نحن نستخدم mlflow.sklearn.log_model() للقيام بذلك.

قبل النشر ، ننظر إلى نتائج التجربة ونختار تجربتين (واحدة للبيجرام والأخرى للبيجرام مع TF-IDF) للمقارنة. في حالة الاستخدام الخاصة بنا ، كان أداء النموذج الثاني الذي تم تدريبه باستخدام bigram TF-IDF أفضل قليلاً ، لذلك اخترنا هذا النموذج لنشره. بعد تسجيل النموذج ، نقوم بنشر النموذج ، وتغيير مرحلة النموذج إلى الإنتاج. يمكننا تحقيق ذلك على واجهة مستخدم MLflow ، أو في الكود باستخدام transition_model_version_stage().

انشر النموذج واختبره كنقطة نهاية SageMaker

قبل نشر النموذج المدرب ، نحتاج إلى بناء حاوية Docker لاستضافة النموذج في SageMaker. نقوم بذلك عن طريق تشغيل أمر MLflow بسيط يبني الحاوية ويدفعها إلى سجل الأمازون المرنة للحاويات (Amazon ECR) في حساب AWS الخاص بنا.

يمكننا الآن العثور على URI للصورة على وحدة تحكم Amazon ECR. نقوم بتمرير صورة URI كملف image_url المعلمة والاستخدام DEPLOYMENT_MODE_CREATE لمعلمة الوضع إذا كان هذا نشرًا جديدًا. إذا كنت تقوم بتحديث نقطة نهاية موجودة بإصدار جديد ، فاستخدم DEPLOYMENT_MODE_REPLACE.

لاختبار نقطة نهاية SageMaker ، نقوم بإنشاء وظيفة تأخذ اسم نقطة النهاية وبيانات الإدخال كمعلمات لها.

وفي الختام

في هذا المنشور ، أوضحنا لك كيفية استخدام Ground Truth لتسمية مجموعة بيانات أولية ، واستخدام البيانات المصنفة لتدريب مصنف خطي بسيط باستخدام Scikit-Learn. في هذا المثال ، نستخدم MLflow لتتبع المعلمات الفائقة والمقاييس ، وتسجيل نموذج درجة الإنتاج ، ونشر النموذج المدرب على SageMaker كنقطة نهاية. جنبًا إلى جنب مع Databricks لمعالجة البيانات ، يمكنك أتمتة حالة الاستخدام بأكملها ، لذلك عند تقديم بيانات جديدة ، يمكن تصنيفها ومعالجتها في النموذج. من خلال أتمتة خطوط الأنابيب والنماذج هذه ، يمكن لفرق علوم البيانات التركيز على حالات الاستخدام الجديدة والكشف عن المزيد من الرؤى بدلاً من قضاء وقتهم في إدارة تحديثات البيانات على أساس يومي.

للبدء ، تحقق من استخدم Amazon SageMaker Ground Truth لتسمية البيانات والتسجيل للحصول على نسخة تجريبية مجانية لمدة 14 يومًا من Databricks على AWS. لمعرفة المزيد حول كيفية تكامل Databricks مع SageMaker ، بالإضافة إلى خدمات AWS الأخرى مثل غراء AWS و الأمازون الأحمر، زيارة Databricks على AWS.

بالإضافة إلى ذلك ، تحقق من الموارد التالية المستخدمة في هذا المنشور:

استخدم ما يلي مفكرة للبدء.

حول المؤلف

رومي أولسن هو مهندس حلول في برنامج شركاء AWS. وهي متخصصة في حلول التعلم الآلي والتعلم بدون خادم في دورها الحالي ، ولديها خلفية في تقنيات معالجة اللغة الطبيعية. تقضي معظم أوقات فراغها مع ابنتها في استكشاف طبيعة شمال غرب المحيط الهادئ.

رومي أولسن هو مهندس حلول في برنامج شركاء AWS. وهي متخصصة في حلول التعلم الآلي والتعلم بدون خادم في دورها الحالي ، ولديها خلفية في تقنيات معالجة اللغة الطبيعية. تقضي معظم أوقات فراغها مع ابنتها في استكشاف طبيعة شمال غرب المحيط الهادئ.

Igor Alekseev هو مهندس حلول شريك في AWS في البيانات والتحليلات. يعمل Igor مع شركاء استراتيجيين لمساعدتهم على بناء بنى معقدة ومحسّنة لـ AWS. قبل انضمامه إلى AWS ، كمهندس بيانات / حلول ، قام بتنفيذ العديد من المشاريع في البيانات الضخمة ، بما في ذلك العديد من بحيرات البيانات في نظام Hadoop البيئي. كمهندس بيانات ، شارك في تطبيق AI / ML لاكتشاف الاحتيال وأتمتة المكاتب. كانت مشاريع إيغور في مجموعة متنوعة من الصناعات بما في ذلك الاتصالات والتمويل والسلامة العامة والتصنيع والرعاية الصحية. في وقت سابق ، عمل إيغور كمهندس / قائد تقني كامل.

Igor Alekseev هو مهندس حلول شريك في AWS في البيانات والتحليلات. يعمل Igor مع شركاء استراتيجيين لمساعدتهم على بناء بنى معقدة ومحسّنة لـ AWS. قبل انضمامه إلى AWS ، كمهندس بيانات / حلول ، قام بتنفيذ العديد من المشاريع في البيانات الضخمة ، بما في ذلك العديد من بحيرات البيانات في نظام Hadoop البيئي. كمهندس بيانات ، شارك في تطبيق AI / ML لاكتشاف الاحتيال وأتمتة المكاتب. كانت مشاريع إيغور في مجموعة متنوعة من الصناعات بما في ذلك الاتصالات والتمويل والسلامة العامة والتصنيع والرعاية الصحية. في وقت سابق ، عمل إيغور كمهندس / قائد تقني كامل.

نصير احمد هو مهندس حلول كبير في Databricks يدعم أعمال AWS الخاصة به. نصير متخصص في تخزين البيانات ، وذكاء الأعمال ، وتطوير التطبيقات ، والحاويات ، وبدون خادم ، وبنى التعلم الآلي على AWS. حصل على جائزة 2021 SME لهذا العام في Databricks وهو من عشاق العملات المشفرة.

نصير احمد هو مهندس حلول كبير في Databricks يدعم أعمال AWS الخاصة به. نصير متخصص في تخزين البيانات ، وذكاء الأعمال ، وتطوير التطبيقات ، والحاويات ، وبدون خادم ، وبنى التعلم الآلي على AWS. حصل على جائزة 2021 SME لهذا العام في Databricks وهو من عشاق العملات المشفرة.

- كوينسمارت. أفضل بورصة للبيتكوين والعملات المشفرة في أوروبا.

- بلاتوبلوكشين. Web3 Metaverse Intelligence. تضخيم المعرفة. دخول مجاني.

- كريبتوهوك. الرادار. تجربة مجانية.

- المصدر: https://aws.amazon.com/blogs/machine-learning/build-an-mlops-sentiment-analysis-pipeline-using-amazon-sagemaker-ground-truth-and-databricks-mlflow/

- "

- 100

- 2021

- 3d

- من نحن

- حسابي

- دقيق

- إضافة

- خوارزمية

- الكل

- أمازون

- تحليل

- تحليلات

- التطبيق

- تطوير التطبيق

- تطبيق

- نهج

- سمعي

- السيارات

- أتمتة

- متاح

- AWS

- خلفية

- أساس

- البيانات الكبيرة

- نساعدك في بناء

- ابني

- يبني

- مدمج

- الأعمال

- ذكاء الأعمال

- سيارة

- الحالات

- الفئة

- اختار

- تصنيف

- الكود

- مجموعة شتاء XNUMX

- مجال الاتصالات

- مجمع

- كنسولات

- وعاء

- يحتوي

- التكاليف

- خلق

- خلق

- التشفير

- حالياًّ

- على

- البيانات

- علم البيانات

- أعمق

- نشر

- نشر

- نشر

- كشف

- المتقدمة

- التطوير التجاري

- صعبة

- توزيع

- عامل في حوض السفن

- وثائق

- لا

- قيادة

- بسهولة

- النظام الإيكولوجي

- تمكين

- نقطة النهاية

- مهندس

- أساسي

- مقدر

- مثال

- تجربة

- المميزات

- مجال

- أخيرا

- تمويل

- تناسب

- تركز

- متابعيك

- شكل

- احتيال

- مجانًا

- بالإضافة إلى

- وظيفة

- توليد

- هدف

- الذهاب

- الرعاية الصحية

- مرتفع

- جدا

- كيفية

- كيفية

- HTTPS

- الانسان

- البشر

- مئات

- هوية

- تحديد

- صورة

- نفذت

- بما فيه

- الصناعات

- إدخال

- رؤى

- رؤيتنا

- المشاركة

- IT

- وظيفة

- المشــاريــع

- القفل

- وصفها

- ملصقات

- عمل

- لغة

- قيادة

- تعلم

- تعلم

- مستوى

- المكتبة

- وصلات

- تحميل

- آلة

- آلة التعلم

- صنع

- يصنع

- تمكن

- إدارة

- إدارة

- يدويا

- تصنيع

- مصفوفة

- قياس

- المقاييس

- مختلط

- ML

- نموذج

- عارضات ازياء

- مراقبة

- الأكثر من ذلك

- أكثر

- خطوة

- طبيعي

- الطبيعة

- مفكرة

- عدد

- عروض

- طلب

- المنظمات

- أخرى

- سلمي

- الشريكة

- شركاء

- أداء

- شخص

- المنصة

- البوينت

- إيجابي

- المشكلة

- عملية المعالجة

- الإنتــاج

- البرنامج

- مشروع ناجح

- تزود

- جمهور

- نشر

- الخام

- في الوقت الحقيقي

- تسجيل

- تسجيل جديد

- مسجل

- ذات الصلة

- مطلوب

- الموارد

- النتائج

- مراجعة

- التقييمات

- يجري

- تشغيل

- السلامة

- علوم

- عاطفة

- Serverless

- الخدمة

- خدمات

- طقم

- ضبط

- قصير

- الاشارات

- So

- حل

- الحلول

- حل

- تتخصص

- الإنفاق

- كومة

- المسرح

- بداية

- بدأت

- إحصائي

- تخزين

- إستراتيجي

- الدعم

- دعم

- الهدف

- المهام

- فريق

- التكنولوجيا

- تجربه بالعربي

- عبر

- الوقت

- رمز

- أداة

- مسار

- قادة الإيمان

- تحول

- محاكمة

- الدروس

- ui

- نهائي

- كشف

- آخر التحديثات

- تستخدم

- عادة

- قيمنا

- تشكيلة

- فيديو

- المزيد

- سواء

- بدون

- للعمل

- عمل

- أعمال

- عام