من أجل مشاركة سحر DALL · E 2 مع جمهور عريض ، كنا بحاجة إلى تقليل المخاطر المرتبطة بنماذج توليد الصور القوية. تحقيقا لهذه الغاية ، نضع مختلف أسوار لمنع الصور التي تم إنشاؤها من انتهاك سياسة المحتوى. يركز هذا المنشور على التخفيفات قبل التدريب ، مجموعة فرعية من حواجز الحماية هذه التي تعدل بشكل مباشر البيانات التي يتعلم منها DALL · E 2. على وجه الخصوص ، يتم تدريب DALL · E 2 على مئات الملايين من الصور الموصوفة من الإنترنت ، ونقوم بإزالة وإعادة وزن بعض هذه الصور لتغيير ما يتعلمه النموذج.

تم تنظيم هذا المنشور في ثلاثة أقسام ، يصف كل منها طريقة تخفيف مختلفة قبل التدريب:

- في القسم الأول ، نصف كيف قمنا بتصفية الصور العنيفة والجنسية من مجموعة بيانات التدريب الخاصة بـ DALL · E 2. بدون هذا التخفيف ، سيتعلم النموذج إنتاج صور بيانية أو صريحة عند المطالبة بها ، وقد يعيد هذه الصور عن غير قصد استجابةً لمطالبات تبدو غير ضارة.

- في القسم الثاني ، وجدنا أن تصفية بيانات التدريب يمكن أن تضخم التحيزات ، ووصف أسلوبنا للتخفيف من هذا التأثير. على سبيل المثال ، بدون هذا التخفيف ، لاحظنا أن النماذج المدربة على البيانات المصفاة تنتج أحيانًا المزيد من الصور التي تصور الرجال وعددًا أقل من الصور التي تصور النساء مقارنة بالنماذج المدربة على مجموعة البيانات الأصلية.

- في القسم الأخير ، ننتقل إلى مسألة الحفظ ، حيث وجدنا أن النماذج مثل DALL · E 2 يمكنها أحيانًا إعادة إنتاج الصور التي تم تدريبها عليها بدلاً من إنشاء صور جديدة. في الممارسة العملية ، وجدنا أن هذا قلس الصورة ناتج عن الصور التي يتم نسخها عدة مرات في مجموعة البيانات ، وتخفيف المشكلة عن طريق إزالة الصور التي تشبه بصريًا الصور الأخرى في مجموعة البيانات.

تقليل بيانات التدريب الجرافيكية والصريحة

نظرًا لأن بيانات التدريب تشكل قدرات أي نموذج تم تعلمه ، فإن تصفية البيانات هي أداة قوية للحد من قدرات النموذج غير المرغوب فيها. لقد طبقنا هذا النهج على فئتين - الصور التي تصور العنف الرسومي والمحتوى الجنسي - باستخدام المصنفات لتصفية الصور في هذه الفئات من مجموعة البيانات قبل تدريب DALL · E 2. لقد قمنا بتدريب مصنفات الصور هذه داخليًا ونستمر في دراسة تأثيرات تصفية مجموعة البيانات على نموذجنا المُدرَّب.

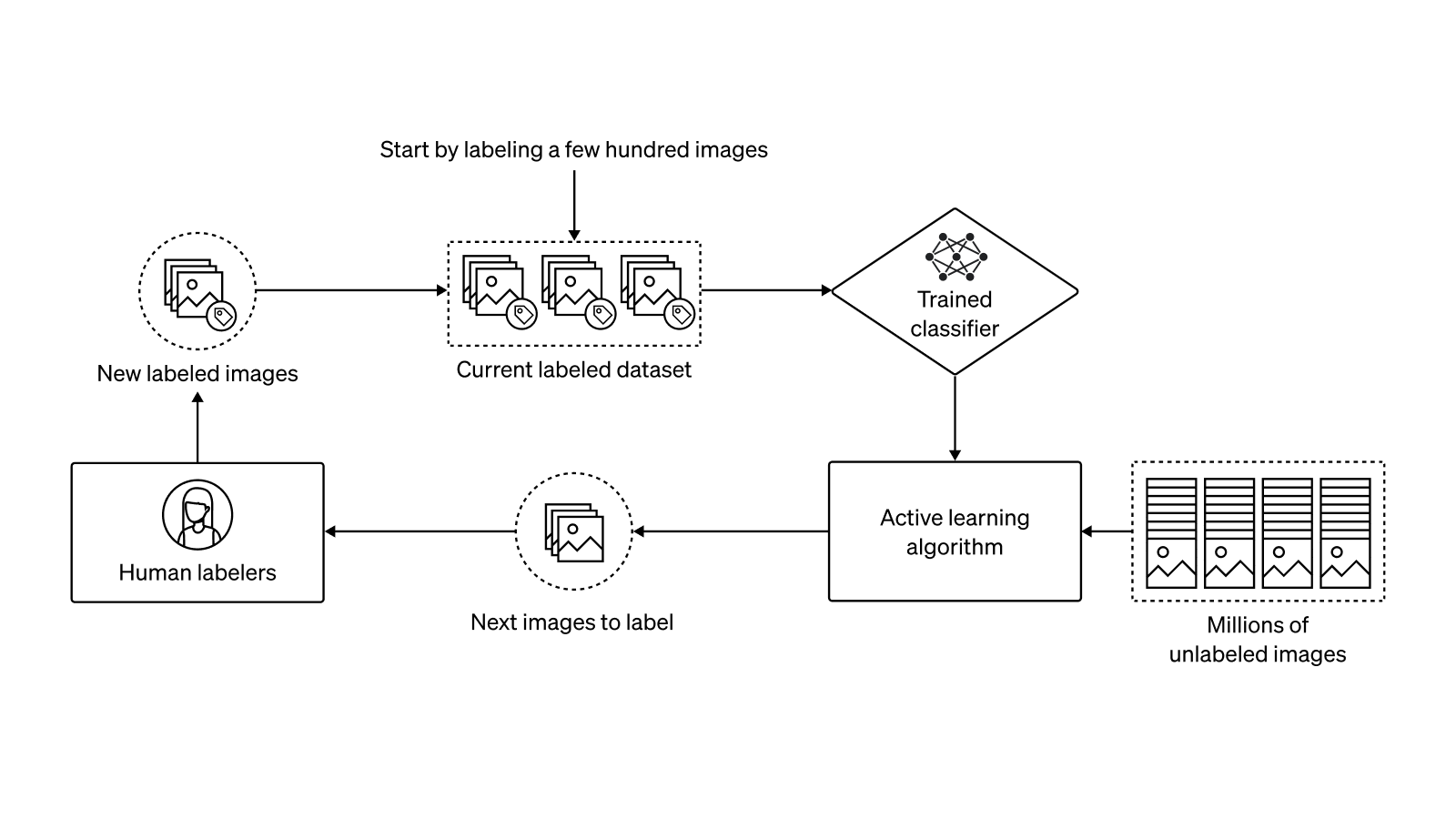

لتدريب مصنفات الصور الخاصة بنا ، أعدنا استخدام نهج استخدمناه سابقًا لتصفية بيانات التدريب من أجله انسل من. الخطوات الأساسية لهذا النهج هي كما يلي: أولاً ، نقوم بإنشاء مواصفات لفئات الصور التي نرغب في تسميتها ؛ ثانيًا ، نجمع بضع مئات من الأمثلة الإيجابية والسلبية لكل فئة ؛ ثالثًا ، نستخدم إجراء تعلم نشطًا لجمع المزيد من البيانات وتحسين الدقة / مفاضلة الاسترجاع ؛ وأخيرًا ، قمنا بتشغيل المصنف الناتج على مجموعة البيانات بأكملها مع حد تصنيف متحفظ لتفضيل الاسترجاع على الدقة. لتعيين هذه الحدود ، أعطينا الأولوية لتصفية جميع سيئة البيانات على ترك في كل من خير بيانات. هذا لأنه يمكننا دائمًا ضبط نموذجنا بمزيد من البيانات لاحقًا لتعليمه أشياء جديدة ، ولكن من الصعب جدًا جعل النموذج ينسى شيئًا قد تعلمه بالفعل.

خلال مرحلة التعلم النشط ، قمنا بتحسين المصنفات بشكل متكرر من خلال جمع الملصقات البشرية للصور التي يحتمل أن تكون صعبة التصنيف أو خاطئة. والجدير بالذكر أننا استخدمنا طريقتين للتعلم النشط لاختيار الصور من مجموعة البيانات الخاصة بنا (التي تحتوي على مئات الملايين من الصور غير المصنفة) لتقديمها إلى البشر لوضع العلامات عليها. أولاً ، لتقليل المعدل الإيجابي الخاطئ لمصنفنا (أي التكرار الذي يصنف به صورة حميدة على أنها عنيفة أو جنسية) ، قمنا بتعيين تسميات بشرية للصور التي صنفها النموذج الحالي على أنها إيجابية. لكي تعمل هذه الخطوة بشكل جيد ، قمنا بضبط عتبة التصنيف الخاصة بنا لاستدعاء ما يقرب من 100 ٪ ولكن معدل إيجابي كاذب مرتفع ؛ بهذه الطريقة ، كان المصممون لدينا يصنفون في الغالب الحالات السلبية حقًا. بينما تساعد هذه التقنية في تقليل الإيجابيات الخاطئة وتقليل الحاجة إلى المصممين للنظر في الصور التي يحتمل أن تكون ضارة ، إلا أنها لا تساعد في العثور على المزيد من الحالات الإيجابية التي يفتقدها النموذج حاليًا.

لتقليل المعدل السلبي الخاطئ لمصنفنا ، استخدمنا أسلوب التعلم النشط الثاني: البحث عن أقرب الجيران. على وجه الخصوص ، قمنا بإجراء عملية التحقق من الصحة متعددة أضعاف للعثور على عينات إيجابية في مجموعة البيانات الحالية التي تم تصنيفها والتي يميل النموذج إلى تصنيفها بشكل خاطئ على أنها سلبية (للقيام بذلك ، قمنا حرفيًا بتدريب مئات الإصدارات من المصنف باستخدام تقسيمات مختلفة للتحقق من صحة القطار). بعد ذلك ، قمنا بمسح مجموعتنا الكبيرة من الصور غير المسماة لأقرب جيران لهذه العينات في مساحة ميزة إدراكية ، وقمنا بتعيين تسميات بشرية للصور المكتشفة. بفضل البنية التحتية للحوسبة لدينا ، كان من التافه توسيع نطاق كل من تدريب المصنف والبحث عن أقرب الجيران للعديد من وحدات معالجة الرسومات ، مما يسمح لخطوة التعلم النشط أن تتم على مدى عدد من الدقائق بدلاً من ساعات أو أيام.

للتحقق من فعالية مرشحات البيانات الخاصة بنا ، قمنا بتدريب نموذجين GLIDE باستخدام نفس المعلمات الفائقة: أحدهما على البيانات غير المفلترة والآخر على مجموعة البيانات بعد التصفية. نشير إلى النموذج السابق باسم نموذج غير مصفى، والأخير باسم نموذج مصفى. كما هو متوقع ، وجدنا أن النموذج الذي لم تتم تصفيته ينتج بشكل عام محتوى أقل صريحًا أو رسوميًا استجابةً لطلبات هذا النوع من المحتوى. ومع ذلك ، وجدنا أيضًا أثرًا جانبيًا غير متوقع لتصفية البيانات: فقد أدى إلى إنشاء أو تضخيم تحيزات النموذج تجاه بعض الديموغرافيات.

إصلاح التحيز الناتج عن مرشحات البيانات

تحاول النماذج التوليدية مطابقة توزيع بيانات التدريب الخاصة بهم ، بما في ذلك أي تحيزات فيها. نتيجة لذلك ، فإن تصفية بيانات التدريب لديها القدرة على خلق أو تضخيم التحيزات في النماذج النهائية. بشكل عام ، يعد إصلاح التحيزات في مجموعة البيانات الأصلية مهمة اجتماعية تقنية صعبة نواصل دراستها ، وهي خارج نطاق هذا المنشور. المشكلة التي نعالجها هنا هي تضخيم التحيزات التي تسببها على وجه التحديد تصفية البيانات نفسها. من خلال نهجنا ، نهدف إلى منع النموذج الذي تمت تصفيته من الوجود الأكثر من ذلك متحيزًا عن النموذج غير المرشح ، مما يقلل بشكل أساسي من تحول التوزيع الناتج عن تصفية البيانات.

كمثال ملموس على تضخيم التحيز بسبب التصفية ، ضع في اعتبارك موجه "الرئيس التنفيذي". عندما أنشأ نموذجنا غير المرشح صورًا لهذه المطالبة ، كان يميل إلى إنتاج صور للرجال أكثر من النساء ، ونتوقع أن يكون معظم هذا التحيز انعكاسًا لبيانات التدريب الحالية لدينا. ومع ذلك ، عندما قمنا بتشغيل نفس الموجه من خلال نموذجنا المصفاة ، بدا التحيز مضخمًا ؛ كانت الأجيال تقريبًا صورًا لرجال على وجه الحصر.

نحن نفترض أن هذه الحالة الخاصة لتضخيم التحيز تأتي من مكانين: أولاً ، حتى إذا كان لدى النساء والرجال تمثيل متساوٍ تقريبًا في مجموعة البيانات الأصلية ، فقد تكون مجموعة البيانات منحازة نحو تقديم النساء في سياقات أكثر جنسية ؛ وثانيًا ، قد تكون المصنفات نفسها متحيزة إما بسبب التطبيق أو تعريف الفئة ، على الرغم من جهودنا لضمان عدم حدوث ذلك أثناء مرحلتي جمع البيانات والتحقق من صحتها. بسبب هذين التأثيرين ، قد يزيل مرشحنا صورًا للنساء أكثر من الرجال ، مما يغير نسبة الجنس التي يلاحظها النموذج في التدريب.

للتحقيق في التحيز الناجم عن المرشح بشكل أكثر شمولاً ، أردنا طريقة لقياس مدى تأثير عوامل تصفية البيانات لدينا على التحيز تجاه المفاهيم المختلفة. والجدير بالذكر أن فلاتر المحتوى الجنسي والعنف لدينا تعتمد على الصور فقط ، ولكن الطبيعة متعددة الوسائط لمجموعة البيانات لدينا تسمح لنا بقياس تأثيرات هذه المرشحات على النص مباشرةً. نظرًا لأن كل صورة مصحوبة بتعليق نصي ، فقد تمكنا من إلقاء نظرة على التكرار النسبي للكلمات الرئيسية المحددة يدويًا عبر مجموعة البيانات المصفاة وغير المصفاة لتقدير مدى تأثير المرشحات على أي مفهوم معين.

لوضع هذا موضع التنفيذ ، استخدمنا Apache Spark لحساب ترددات حفنة من الكلمات الرئيسية (على سبيل المثال ، "أحد الوالدين" ، "امرأة" ، "طفل") على جميع التعليقات في كل من مجموعات البيانات المصفاة وغير المفلترة. على الرغم من أن مجموعة البيانات الخاصة بنا تحتوي على مئات الملايين من أزواج الصور النصية ، إلا أن حساب ترددات الكلمات الرئيسية هذه استغرق بضع دقائق فقط باستخدام مجموعة الحوسبة الخاصة بنا.

بعد حساب ترددات الكلمات الرئيسية ، تمكنا من التأكد من أن مرشحات مجموعة البيانات الخاصة بنا قد حرفت بالفعل ترددات كلمات رئيسية معينة أكثر من غيرها. على سبيل المثال ، قللت المرشحات من تكرار كلمة "امرأة" بنسبة 14٪ ، بينما تم تقليل تكرار كلمة "رجل" بنسبة 6٪ فقط. أكد هذا ، على نطاق واسع ، ما لاحظناه بالفعل من خلال أخذ عينات من نماذج GLIDE المدربة على مجموعتي البيانات.

الآن بعد أن أصبح لدينا وكيل لقياس التحيز الناجم عن المرشح ، كنا بحاجة إلى طريقة لتخفيفه. لمعالجة هذه المشكلة ، نهدف إلى إعادة وزن مجموعة البيانات التي تمت تصفيتها بحيث يتوافق توزيعها بشكل أفضل مع توزيع الصور غير المفلترة. كمثال على لعبة لتوضيح هذه الفكرة ، افترض أن مجموعة البيانات الخاصة بنا تتكون من 50٪ صور قطط و 50٪ صور كلاب ، لكن مرشحات البيانات لدينا تزيل 75٪ من الكلاب ولكن فقط 50٪ من القطط. ستكون مجموعة البيانات النهائية ⅔ قطط و كلاب ، ومن المحتمل أن ينتج عن النموذج التوليدي القائم على الاحتمالية والمدرَّب على مجموعة البيانات هذه صورًا للقطط أكثر من الكلاب. يمكننا إصلاح هذا الخلل عن طريق ضرب خسارة التدريب لكل صورة لكلب في 2 ، ومحاكاة تأثير تكرار كل صورة كلب مرتين. اتضح أنه يمكننا توسيع نطاق هذا النهج لمجموعات البيانات والنماذج الحقيقية لدينا بطريقة تلقائية إلى حد كبير - أي أننا لسنا بحاجة إلى تحديد الميزات التي نريد إعادة وزنها يدويًا.

نحسب أوزان الصور في مجموعة البيانات التي تمت تصفيتها باستخدام الاحتمالات من مصنف خاص ، على غرار الطريقة التي يستخدمها تشوي وآخرون. (2019). لتدريب هذا المصنف ، قمنا بأخذ عينات موحدة للصور من مجموعتي البيانات والتنبؤ بمجموعة البيانات التي جاءت الصورة منها. على وجه الخصوص ، هذا النموذج يتوقع P (صورة | غير مصفاة)، نظرا لسابق P (غير مصفى) = 0.5. من الناحية العملية ، لا نريد أن يكون هذا النموذج قويًا للغاية ، وإلا فقد يتعلم الوظيفة الدقيقة التي تنفذها المرشحات في المقام الأول. بدلاً من ذلك ، نريد أن يكون النموذج أكثر سلاسة من مرشحات البيانات الأصلية ، حيث يلتقط الفئات العريضة التي تتأثر بالفلاتر بينما لا نزال غير متأكدين مما إذا كانت صورة معينة سيتم ترشيحها أم لا. تحقيقا لهذه الغاية ، قمنا بتدريب مسبار خطي على رأس صغير CLIP نموذج.

بمجرد أن يكون لدينا مصنف يتنبأ باحتمالية أن تكون الصورة مأخوذة من مجموعة البيانات غير المفلترة ، ما زلنا بحاجة إلى تحويل هذا التوقع إلى وزن للصورة. على سبيل المثال ، افترض ذلك P (صورة | غير مصفاة) = 0.8. هذا يعني أن احتمال العثور على العينة في البيانات غير المفلترة أكبر بأربع مرات من البيانات التي تمت تصفيتها ، ويجب أن يصحح الوزن البالغ 4 عدم التوازن. بشكل عام ، يمكننا استخدام الوزن P (غير مصفى | صورة) / P (تمت تصفيته | صورة).[1]

ما مدى جودة مخطط إعادة الوزن هذا في الواقع في التخفيف من التحيز المتضخم؟ عندما قمنا بضبط نموذجنا السابق الذي تمت تصفيته باستخدام مخطط الترجيح الجديد ، كان سلوك النموذج الدقيق أكثر توافقًا مع النموذج غير المرشح في الأمثلة المتحيزة التي وجدناها سابقًا. بينما كان هذا مشجعًا ، أردنا أيضًا تقييم هذا التخفيف بشكل أكثر شمولاً باستخدام استدلال التحيز المستند إلى الكلمات الرئيسية. لقياس ترددات الكلمات الرئيسية مع أخذ نظام الترجيح الجديد في الاعتبار ، يمكننا ببساطة تقييم كل مثيل لكلمة رئيسية في مجموعة البيانات التي تمت تصفيتها حسب وزن العينة التي تحتوي عليها. عند القيام بذلك ، نحصل على مجموعة جديدة من ترددات الكلمات الرئيسية التي تعكس أوزان العينة في مجموعة البيانات التي تمت تصفيتها.

عبر معظم الكلمات الرئيسية التي فحصناها ، قلل مخطط إعادة الوزن من تغيير التردد الناجم عن التصفية. بالنسبة لأمثلةنا السابقة عن "رجل" و "امرأة" ، أصبح الانخفاض النسبي في التردد 1٪ و -1٪ ، بينما كانت قيمهما السابقة 14٪ و 6٪ على التوالي. على الرغم من أن هذا المقياس هو مجرد وكيل لتحيز التصفية الفعلي ، إلا أنه من المطمئن أن مخطط إعادة الوزن المستند إلى الصورة يعمل بالفعل على تحسين المقياس المستند إلى النص بشكل كبير.

نحن نواصل التحقيق في التحيزات المتبقية في DALL · E 2 ، جزئيًا من خلال تقييمات أكبر لسلوك النموذج والتحقيقات حول كيفية تأثير التصفية على التحيز وتنمية القدرات.

منع ارتجاع الصورة

لاحظنا أن أسلافنا الداخليين لـ DALL · E 2 يقومون أحيانًا بإعادة إنتاج الصور التدريبية حرفياً. كان هذا السلوك غير مرغوب فيه ، لأننا نرغب في DALL · E 2 لإنشاء صور أصلية وفريدة بشكل افتراضي وليس مجرد "تجميع" قطع من الصور الموجودة. بالإضافة إلى ذلك ، يمكن أن يؤدي إعادة إنتاج الصور الحرفية للتدريب إلى إثارة أسئلة قانونية حول انتهاك حقوق النشر والملكية والخصوصية (إذا كانت صور الأشخاص موجودة في بيانات التدريب).

لفهم مشكلة ارتجاع الصور بشكل أفضل ، قمنا بجمع مجموعة بيانات من المطالبات التي أدت في كثير من الأحيان إلى تكرار الصور. للقيام بذلك ، استخدمنا نموذجًا مدربًا لأخذ عينات من الصور لـ 50,000 مطالبة من مجموعة بيانات التدريب الخاصة بنا ، وفرزنا العينات حسب التشابه الإدراكي لصورة التدريب المقابلة. أخيرًا ، قمنا بفحص أفضل التطابقات يدويًا ، ووجدنا بضع مئات فقط من الأزواج المكررة الحقيقية من إجمالي المطالبات البالغ 50 ألفًا. على الرغم من أن معدل القلس بدا أقل من 1٪ ، إلا أننا شعرنا بضرورة دفع المعدل إلى الصفر للأسباب المذكورة أعلاه.

عندما درسنا مجموعة البيانات الخاصة بنا من الصور المتقيئة ، لاحظنا نمطين. أولاً ، كانت جميع الصور تقريبًا عبارة عن رسومات متجهية بسيطة ، والتي من المحتمل أن تكون سهلة الحفظ نظرًا لانخفاض محتوى المعلومات بها. ثانيًا ، والأهم من ذلك ، أن الصور جميعها تحتوي على العديد من النسخ شبه المكررة في مجموعة بيانات التدريب. على سبيل المثال ، قد يكون هناك رسم متجه يشبه ساعة تعرض الوقت الساعة 1 - ولكن بعد ذلك سنكتشف عينة تدريب تحتوي على نفس الساعة تظهر الساعة 2 ، ثم 3 ، وما إلى ذلك مرة واحدة. لقد أدركنا ذلك ، فقد استخدمنا بحثًا موزعًا لأقرب الجيران للتحقق من أن جميع الصور التي تم اجترارها تحتوي بالفعل على نسخ مكررة متشابهة في مجموعة البيانات. أخرى أعمال لاحظوا ظاهرة مماثلة في نماذج اللغات الكبيرة ، ووجدوا أن تكرار البيانات يرتبط ارتباطًا وثيقًا بالحفظ.

تشير النتيجة أعلاه إلى أنه إذا قمنا بإلغاء تكرار مجموعة البيانات الخاصة بنا ، فقد نحل مشكلة القلس. لتحقيق ذلك ، خططنا لاستخدام شبكة عصبية لتحديد مجموعات الصور التي تبدو متشابهة ، ثم إزالة جميع الصور باستثناء صورة واحدة من كل مجموعة.[2] ومع ذلك ، قد يتطلب ذلك التحقق ، لكل صورة ، مما إذا كانت نسخة مكررة من كل صورة أخرى في مجموعة البيانات. نظرًا لأن مجموعة البيانات الكاملة الخاصة بنا تحتوي على مئات الملايين من الصور ، فسنحتاج بسذاجة إلى التحقق من مئات المليارات من أزواج الصور للعثور على جميع التكرارات. في حين أن هذا في متناول اليد تقنيًا ، خاصةً على مجموعة حوسبة كبيرة ، وجدنا بديلاً أكثر كفاءة يعمل بشكل جيد تقريبًا بجزء صغير من التكلفة.

ضع في اعتبارك ما يحدث إذا قمنا بتجميع مجموعة البيانات الخاصة بنا قبل إجراء إلغاء المكرر. نظرًا لأن العينات القريبة تقع غالبًا في نفس المجموعة ، فإن معظم الأزواج المكررة لن تتخطى حدود قرار المجموعة. يمكننا بعد ذلك إزالة النسخ المكررة من العينات داخل كل مجموعة دون التحقق من التكرارات خارج المجموعة ، مع فقد جزء صغير فقط من جميع الأزواج المكررة. هذا أسرع بكثير من النهج الساذج ، حيث لم يعد علينا فحص كل زوج من الصور.[3] عندما اختبرنا هذا النهج تجريبيًا على مجموعة فرعية صغيرة من بياناتنا ، وجدنا 85٪ من جميع الأزواج المكررة عند استخدام K = 1024 عناقيد المجموعات.

لتحسين معدل نجاح الخوارزمية المذكورة أعلاه ، استفدنا من ملاحظة رئيسية واحدة: عندما تقوم بتجميع مجموعات فرعية عشوائية مختلفة من مجموعة بيانات ، غالبًا ما تكون حدود قرار المجموعة الناتجة مختلفة تمامًا. لذلك ، إذا تجاوز زوج مكرر حدود الكتلة لتجميع واحد من البيانات ، فقد يقع نفس الزوج داخل مجموعة واحدة في مجموعة مختلفة. كلما جربت المزيد من المجموعات ، زادت احتمالية اكتشافك لزوج مكرر معين. من الناحية العملية ، قررنا استخدام خمس مجموعات ، مما يعني أننا نبحث عن نسخ مكررة من كل صورة في اتحاد خمس مجموعات مختلفة. في الممارسة العملية ، وجد هذا 97٪ من جميع الأزواج المكررة في مجموعة فرعية من بياناتنا.

والمثير للدهشة أنه تمت إزالة ما يقرب من ربع مجموعة البيانات الخاصة بنا عن طريق إزالة البيانات المكررة. عندما نظرنا إلى الأزواج شبه المكررة التي تم العثور عليها ، تضمن العديد منها تغييرات ذات مغزى. تذكر مثال الساعة من الأعلى: قد تتضمن مجموعة البيانات العديد من الصور لنفس الساعة في أوقات مختلفة من اليوم. بينما من المحتمل أن تجعل هذه الصور النموذج يحفظ مظهر هذه الساعة بالذات ، إلا أنها قد تساعد النموذج أيضًا على تعلم التمييز بين أوقات اليوم على مدار الساعة. نظرًا لمقدار البيانات التي تمت إزالتها ، كنا قلقين من أن إزالة صور مثل هذه قد تضر بأداء النموذج.

لاختبار تأثير إزالة البيانات المكررة على نماذجنا ، قمنا بتدريب نموذجين باستخدام معلمات تشعبية متطابقة: أحدهما على مجموعة البيانات الكاملة والآخر على الإصدار غير المكرر من مجموعة البيانات. لمقارنة النماذج ، استخدمنا نفس التقييمات البشرية التي استخدمناها لتقييم نموذج GLIDE الأصلي الخاص بنا. والمثير للدهشة أننا وجدنا أن مقيمين بشريين قليلون المفضل تم تدريب النموذج على بيانات غير مكررة ، مما يشير إلى أن الكمية الكبيرة من الصور الزائدة في مجموعة البيانات كانت في الواقع تضر بالأداء.

بمجرد حصولنا على نموذج تم تدريبه على البيانات غير المكررة ، أعدنا إعادة البحث عن القلس الذي أجرينا سابقًا أكثر من 50 ألف مطالبة من مجموعة بيانات التدريب. لقد وجدنا أن النموذج الجديد لم يقم بتجديد صورة التدريب مطلقًا عند إعطائه موجهًا دقيقًا للصورة من مجموعة بيانات التدريب. لأخذ هذا الاختبار خطوة أخرى إلى الأمام ، أجرينا أيضًا بحثًا أقرب جار على مجموعة بيانات التدريب بأكملها لكل صورة من الصور التي تم إنشاؤها 50 ألفًا. بهذه الطريقة ، اعتقدنا أننا قد نلتقط النموذج وهو يقوم بتجديد صورة مختلفة عن تلك المرتبطة بموجه معين. حتى مع هذا الفحص الأكثر شمولاً ، لم نعثر أبدًا على حالة ارتجاع في الصورة.

الخطوات المقبلة

في حين أن جميع إجراءات التخفيف التي تمت مناقشتها أعلاه تمثل تقدمًا كبيرًا نحو هدفنا المتمثل في تقليل المخاطر المرتبطة بـ DALL · E 2 ، لا يزال لكل تخفيف مجال للتحسين:

- يمكن أن تسمح لنا مرشحات ما قبل التدريب الأفضل بتدريب DALL · E 2 على المزيد من البيانات وربما تقلل التحيز في النموذج بشكل أكبر. يتم ضبط المرشحات الحالية لدينا للحصول على معدل أخطاء منخفض على حساب العديد من الإيجابيات الخاطئة. ونتيجة لذلك ، قمنا بتصفية ما يقرب من 5٪ من مجموعة البيانات بالكامل على الرغم من أن معظم هذه الصور التي تمت تصفيتها لا تنتهك سياسة المحتوى الخاصة بنا على الإطلاق. قد يسمح لنا تحسين عوامل التصفية الخاصة بنا باستعادة بعض بيانات التدريب هذه.

- يتم إدخال التحيز وربما تضخيمه في العديد من مراحل تطوير النظام ونشره. يعد تقييم وتخفيف التحيز في أنظمة مثل DALL · E 2 والضرر الناجم عن هذا التحيز مشكلة مهمة متعددة التخصصات نواصل دراستها في OpenAI كجزء من مهمتنا الأوسع. يشمل عملنا في هذا الأمر بناء تقييمات لفهم المشكلة بشكل أفضل ، وتنظيم مجموعات بيانات جديدة ، وتطبيق تقنيات مثل ردود الفعل البشرية والضبط الدقيق لبناء تقنيات أكثر قوة وتمثيلية.

- من المهم أيضًا أن نواصل دراسة الحفظ والتعميم في أنظمة التعلم العميق. في حين أن إلغاء البيانات المكررة هو خطوة أولى جيدة نحو منع الحفظ ، إلا أنه لا يخبرنا بكل شيء لنتعلم لماذا أو كيف تقوم نماذج مثل DALL · E 2 بحفظ بيانات التدريب.

- 000

- 2019

- a

- من نحن

- حسابي

- التأهيل

- في

- نشط

- العنوان

- تؤثر

- خوارزمية

- الكل

- السماح

- يسمح

- سابقا

- البديل

- دائما

- كمية

- آخر

- ظهر

- تطبيقي

- تطبيق

- نهج

- حول

- تعيين

- أسوشيتد

- جمهور

- لان

- قبل

- يجري

- أفضل

- ما بين

- Beyond

- نساعدك في بناء

- ابني

- قدرات

- تعليق

- حقيبة

- الحالات

- يو كاتش

- الفئة

- تسبب

- معين

- تغيير

- تدقيق

- اختار

- فئة

- تصنيف

- مبوب

- ساعة حائط

- مجموعة شتاء XNUMX

- مقارنة

- إحصاء

- الحوسبة

- مفهوم

- نظر

- يحتوي

- محتوى

- السياقات

- استمر

- حقوق الطبع والنشر

- التعدي على حق المؤلف

- المقابلة

- استطاع

- خلق

- خلق

- خلق

- حاسم

- حالياًّ

- حاليا

- البيانات

- يوم

- أيام

- القرار

- عميق

- التركيبة السكانية

- نشر

- وصف

- على الرغم من

- التطوير التجاري

- مختلف

- صعبة

- مباشرة

- اكتشف

- اكتشف

- مسافة

- وزعت

- توزيع

- إلى أسفل

- التكرارات

- أثناء

- كل

- تأثير

- على نحو فعال

- فعالية

- الآثار

- فعال

- جهود

- مشجع

- خاصة

- أساسيا

- تقدير

- إلخ

- تقييم

- كل شىء

- مثال

- أمثلة

- على وجه الحصر

- القائمة

- توقع

- متوقع

- أسرع

- الميزات

- المميزات

- ردود الفعل

- الشكل

- تصفية

- مرشحات

- أخيرا

- العثور على

- الاسم الأول

- حل

- ويركز

- متابعات

- وجدت

- تبدأ من

- بالإضافة إلى

- وظيفة

- إضافي

- جمع

- الجنس

- العلاجات العامة

- على العموم

- توليد

- ولدت

- جيل

- أجيال

- توليدي

- هدف

- خير

- وحدات معالجة الرسومات

- الرسومات

- تجمع

- مجموعات

- مضمون

- حفنة

- مساعدة

- يساعد

- هنا

- مرتفع

- كيفية

- لكن

- HTTPS

- الانسان

- البشر

- مئات

- فكرة

- تحديد

- صورة

- صور

- التنفيذ

- نفذت

- أهمية

- تحسن

- تحسن

- تحسين

- تتضمن

- شامل

- يشمل

- بما فيه

- معلومات

- البنية التحتية

- مثل

- Internet

- بحث

- قضية

- IT

- نفسها

- القفل

- تُشير

- وصفها

- ملصقات

- لغة

- كبير

- أكبر

- تعلم

- تعلم

- تعلم

- شروط وأحكام

- على الأرجح

- بحث

- بدا

- جعل

- علامة

- مباراة

- ذات مغزى

- يعني

- قياس

- قياس

- رجالي

- ربما

- عسكر

- ملايين

- الرسالة

- نموذج

- عارضات ازياء

- الأكثر من ذلك

- أكثر

- ضرب

- الطبيعة

- ضروري

- سلبي

- شبكة

- عدد

- طلب

- منظم

- أصلي

- أخرى

- ملكية

- جزء

- خاص

- أداء

- أداء

- مرحلة جديدة

- قطعة

- مخطط

- سياسة

- إيجابي

- ممكن

- محتمل

- قوي

- ممارسة

- تنبأ

- تنبؤ

- يقدم

- منع

- سابق

- خصوصية

- مسبار

- المشكلة

- عملية المعالجة

- إنتاج

- أنتج

- احتجاج

- الوكيل

- ربع

- رفع

- الوصول

- أدركت

- الأسباب

- تخفيض

- عقار مخفض

- تقليص

- تعكس

- انعكاس

- المتبقية

- إزالة

- مثل

- التمثيل

- ممثل

- طلبات

- تطلب

- يتطلب

- استجابة

- مما أدى

- عائد أعلى

- المخاطر

- يجري

- نفسه

- حجم

- مخطط

- بحث

- طقم

- الأشكال

- مشاركة

- نقل

- هام

- مماثل

- الاشارات

- منذ

- عزباء

- مقاس

- صغير

- So

- حل

- بعض

- شيء

- الفضاء

- تختص

- على وجه التحديد

- مواصفة

- الإنشقاقات

- مراحل

- بداية

- ذكر

- لا يزال

- دراسة

- تحقيق النجاح

- نظام

- أنظمة

- مع الأخذ

- تقنيات

- التكنولوجيا

- تجربه بالعربي

- •

- وبالتالي

- الأشياء

- بعناية

- ثلاثة

- عتبة

- عبر

- الوقت

- مرات

- أداة

- تيشرت

- نحو

- قطار

- قادة الإيمان

- فهم

- الاتحاد

- فريد من نوعه

- us

- تستخدم

- التحقق من صحة

- مختلف

- تحقق من

- الإصدار

- مطلوب

- ابحث عن

- سواء

- في حين

- في غضون

- بدون

- نسائي

- للعمل

- أعمال

- قلق

- سوف

- X