عندما يفكر معظم الناس في استخدام التعلم الآلي (ML) مع البيانات الصوتية ، فإن حالة الاستخدام التي تتبادر إلى الذهن عادةً هي نسخ، المعروف أيضًا باسم تحويل الكلام إلى نص. ومع ذلك ، هناك تطبيقات مفيدة أخرى ، بما في ذلك استخدام ML لاكتشاف الأصوات.

يسمى استخدام البرنامج لاكتشاف الصوت كشف حدث صوتي، ولها عدد من التطبيقات. على سبيل المثال ، لنفترض أنك تريد مراقبة الأصوات من أرض مصنع صاخبة ، والاستماع إلى جرس إنذار يشير إلى وجود مشكلة في الجهاز. في بيئة الرعاية الصحية ، يمكنك استخدام اكتشاف الأحداث الصوتية للاستماع بشكل سلبي للأصوات الصادرة عن المريض والتي تشير إلى مشكلة صحية حادة. تعد أعباء عمل الوسائط مناسبة جدًا لهذه التقنية ، على سبيل المثال لاكتشاف وقت إطلاق صافرة الحكم في مقطع فيديو رياضي. وبالطبع ، يمكنك استخدام هذه التقنية في مجموعة متنوعة من أعباء عمل المراقبة ، مثل الاستماع إلى طلقة نارية أو صوت حادث سيارة من ميكروفون مثبت فوق أحد شوارع المدينة.

يصف هذا المنشور كيفية اكتشاف الأصوات في ملف صوتي حتى إذا كانت هناك أصوات خلفية كبيرة تحدث في نفس الوقت. والأكثر من ذلك ، ربما بشكل مفاجئ ، أننا نستخدم تقنيات قائمة على رؤية الكمبيوتر للقيام بالكشف ، باستخدام الأمازون إعادة الاعتراف.

استخدام البيانات الصوتية مع التعلم الآلي

تتمثل الخطوة الأولى في اكتشاف الأحداث الصوتية في فهم كيفية تمثيل البيانات الصوتية. لأغراض هذا المنشور ، نتعامل فقط مع الصوت المسجل ، على الرغم من أن هذه التقنيات تعمل مع دفق الصوت.

عادةً ما يتم تخزين الصوت المسجل كسلسلة من عينات الصوت ، والتي تقيس شدة الموجات الصوتية التي تصطدم بالميكروفون أثناء التسجيل بمرور الوقت. هناك مجموعة متنوعة من التنسيقات التي يمكن تخزين هذه العينات بها ، ولكن الأسلوب الشائع هو تخزين 10,000 أو 20,000 أو حتى 40,000 عينة في الثانية ، مع كون كل عينة عددًا صحيحًا من 0-65535 (XNUMX بايت). نظرًا لأن كل عينة تقيس فقط شدة الموجات الصوتية في لحظة معينة ، فإن البيانات الصوتية بشكل عام ليست مفيدة لعمليات ML لأنها لا تحتوي على أي ميزات مفيدة في حالتها الأولية.

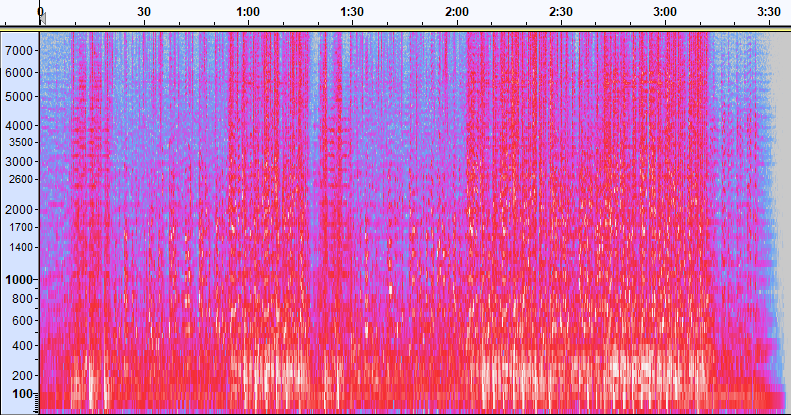

لجعل هذه البيانات مفيدة ، يتم تحويل عينة الصوت إلى صورة تسمى ملف مطياف، وهو تمثيل للبيانات الصوتية التي توضح شدة نطاقات التردد المختلفة بمرور الوقت. الصورة التالية تظهر مثالا.

يمثل المحور X لهذه الصورة الوقت ، مما يعني أن الحافة اليسرى للصورة هي بداية الصوت ، والحافة اليمنى للصورة هي النهاية. يمثل كل عمود من البيانات داخل الصورة نطاقات تردد مختلفة (يشار إليها بواسطة المقياس الموجود على الجانب الأيسر من الصورة) ، ويمثل اللون في كل نقطة شدة هذا التردد في تلك اللحظة الزمنية.

يمكن تغيير المقياس الرأسي للطيف إلى تمثيلات أخرى. على سبيل المثال ، يعني القياس الخطي أن المحور Y مقسم بالتساوي على الترددات ، ويستخدم القياس اللوغاريتمي مقياسًا لوغاريتميًا ، وما إلى ذلك. تكمن مشكلة استخدام هذه التمثيلات في أن الترددات في ملف صوتي عادة ما تكون غير موزعة بالتساوي ، لذا فإن معظم المعلومات التي قد نهتم بها ينتهي بها المطاف في التجمع بالقرب من أسفل الصورة (الترددات المنخفضة).

لحل هذه المشكلة ، تعد صورتنا النموذجية مثالاً على ملف مخطط ميل الطيفي، والذي تم قياسه لتقريب كيفية إدراك البشر للصوت. لاحظ مؤشرات التردد على طول الجانب الأيسر من الصورة - فهي تعطي فكرة عن كيفية توزيعها عموديًا ، ومن الواضح أنها مقياس غير خطي.

بالإضافة إلى ذلك ، يمكننا تعديل قياس الشدة بالتردد بمرور الوقت لتحسين الميزات المختلفة للصوت الذي يتم قياسه. كما هو الحال مع مقياس المحور Y الذي يتم تنفيذه بواسطة مخطط ميل الطيفي ، يركز البعض الآخر على ميزات مثل شدة 12 فئة نغمة مميزة تُستخدم لدراسة الموسيقى (الصفاء). تؤكد فئة أخرى على الميزات الأفقية (التوافقية) أو الميزات الرأسية (الإيقاعية). يجب أن يحدد نوع الصوت الذي يتم اكتشافه نوع المخطط الطيفي المستخدم لنظام الكشف.

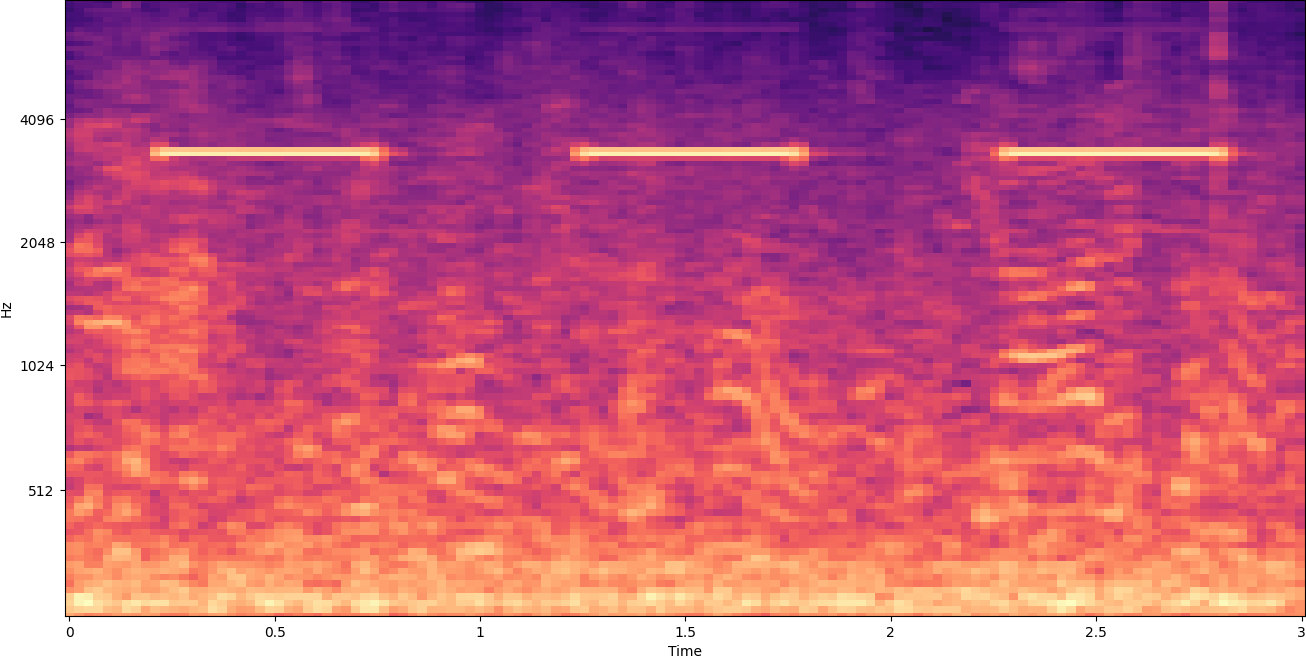

يمثل المخطط الطيفي المثال السابق مقطعًا موسيقيًا تزيد مدته قليلاً عن دقيقتين. يكشف التكبير عن مزيد من التفاصيل ، كما هو موضح في الصورة التالية.

توضح الأرقام الموجودة أعلى الصورة عدد الثواني من بداية الملف الصوتي. يمكنك أن ترى بوضوح سلسلة من الأصوات يبدو أنها تتكرر أكثر من أربع مرات في الثانية ، والتي تشير إليها الألوان الزاهية بالقرب من أسفل الصورة.

كما ترى ، تعد هذه إحدى فوائد تحويل الصوت إلى مخطط طيفي - غالبًا ما تكون الأصوات المميزة مرئية بسهولة بالعين المجردة ، وحتى إذا لم تكن كذلك ، فيمكن في كثير من الأحيان اكتشافها باستخدام خوارزميات اكتشاف كائن رؤية الكمبيوتر. في الواقع ، هذه هي بالضبط العملية التي نتبعها لاكتشاف الأصوات.

البحث عن أصوات منفصلة في مخطط طيفي

اعتمادًا على طول الملف الصوتي الذي نبحث عنه ، يعد العثور على صوت منفصل يستمر لثانية أو ثانيتين تحديًا. ارجع إلى أول مخطط طيفي شاركناه — لأننا نشاهد بيانات كاملة تبلغ 3:30 دقيقة ، فإن التفاصيل التي لا تدوم سوى ثانية واحدة أو نحو ذلك غير مرئية. لقد قمنا بتكبير الصورة بشكل كبير لنرى الإيقاع الذي يظهر في الصورة الثانية. من الواضح أنه مع ملفات الصوت الأكبر حجمًا (وبالتالي مخططات طيفية أكبر بكثير) ، فإننا نواجه مشكلات بسرعة ما لم نستخدم نهجًا مختلفًا. هذا النهج يسمى النوافذ.

يشير Windowing إلى استخدام نافذة منزلقة تتحرك عبر مخطط الطيف بأكمله ، وتعزل بضع ثوانٍ (أو أقل) في كل مرة. من خلال عزل أجزاء من الصورة الإجمالية بشكل متكرر ، نحصل على صور أصغر يمكن البحث عنها للكشف عن وجود الصوت. نظرًا لأن كل نافذة يمكن أن ينتج عنها جزء فقط من الصورة التي نبحث عنها (كما في حالة البحث عن صوت لا يبدأ تمامًا في بداية النافذة) ، غالبًا ما يتم تنفيذ النوافذ مع تداخل النوافذ التالية. على سبيل المثال ، تبدأ النافذة الأولى عند 0:00 وتمتد لثانيتين ، ثم تبدأ النافذة الثانية عند 2:0 وتمتد لثانيتين ، وتبدأ النافذة الثالثة عند 01:2 وتمتد لثانيتين ، وهكذا.

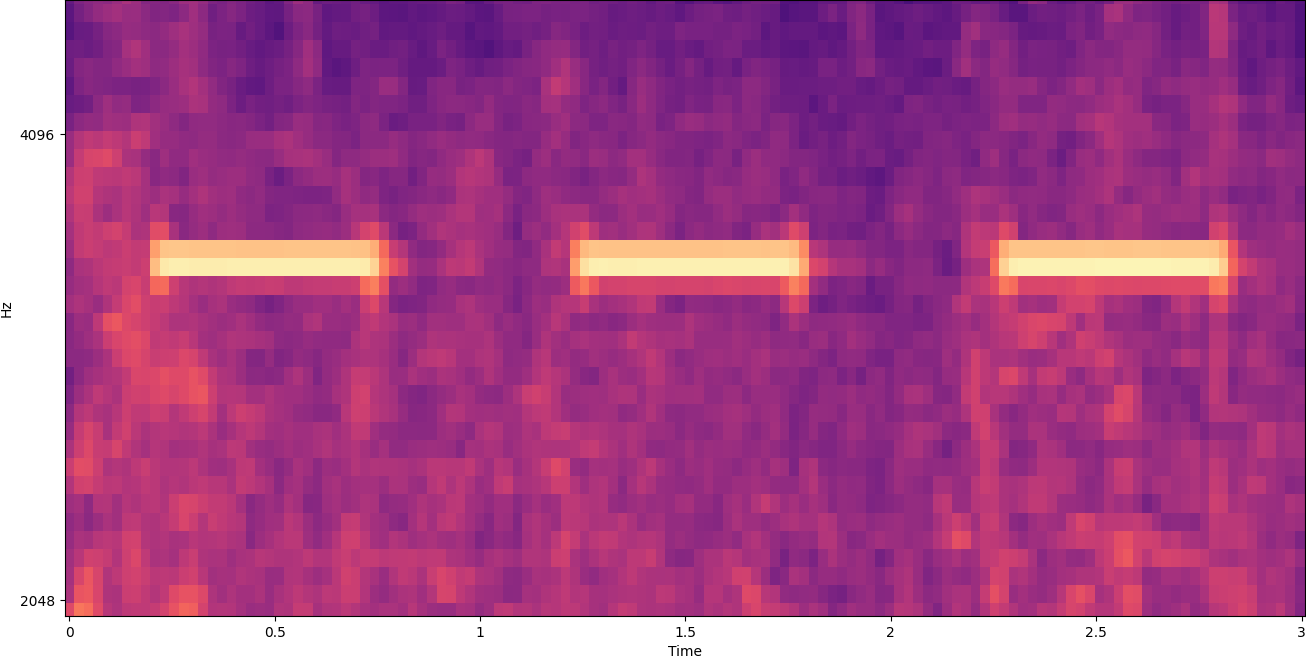

يؤدي وضع النوافذ إلى تقسيم صورة المخطط الطيفي أفقيًا. يمكننا تحسين فعالية عملية الكشف عن طريق عزل نطاقات تردد معينة عن طريق اقتصاص أو البحث فقط عن أجزاء رأسية معينة من الصورة. على سبيل المثال ، إذا كنت تعلم أن جرس الإنذار الذي تريد اكتشافه يُنشئ أصواتًا تتراوح من تردد معين إلى آخر ، فيمكنك تعديل النافذة الحالية للنظر فقط في نطاقات التردد هذه. هذا يقلل بشكل كبير من كمية البيانات التي يجب معالجتها ، ويؤدي إلى بحث أسرع بكثير. كما أنه يحسن الدقة ، لأنه يزيل المطابقات الإيجابية الخاطئة المحتملة التي تحدث في نطاقات التردد خارج النطاق المطلوب. الصور التالية تقارن محور ص كامل (يسار) بمحور ص محدود (يمين).

الآن بعد أن عرفنا كيفية التكرار عبر مخطط طيفي باستخدام نهج النافذة والتصفية لنطاقات تردد معينة ، فإن الخطوة التالية هي إجراء البحث الفعلي عن الصوت. لذلك نستخدم تسميات Amazon Rekognition المخصصة. تعتمد ميزة Rekognition Custom Labels على الإمكانات الحالية لـ Amazon Rekognition ، والتي تم تدريبها بالفعل على عشرات الملايين من الصور عبر العديد من الفئات. بدلاً من آلاف الصور ، تحتاج ببساطة إلى تحميل مجموعة صغيرة من صور التدريب (عادةً بضع مئات من الصور ، ولكن يجب الوصول إلى حجم مجموعة بيانات التدريب الأمثل بناءً على حالة الاستخدام المحددة لتجنب نقص التدريب أو الإفراط في تدريب النموذج ) الخاصة بحالة الاستخدام الخاصة بك عبر وحدة التحكم Rekognition Custom Labels.

إذا تم تصنيف صورك بالفعل ، يمكن الوصول إلى تدريب Amazon Rekognition ببضع نقرات فقط. بدلاً من ذلك ، يمكنك تسمية الصور مباشرةً داخل واجهة ملصقات Amazon Rekognition أو استخدامها الحقيقة الأمازون SageMaker الأرض لتصنيفها لك. عندما يبدأ Amazon Rekognition التدريب من مجموعة الصور الخاصة بك ، فإنه ينتج نموذج تحليل صورة مخصصًا لك في غضون ساعات قليلة. خلف الكواليس ، تقوم Rekognition Custom Labels تلقائيًا بتحميل وفحص بيانات التدريب ، وتختار خوارزميات ML الصحيحة ، وتدرب نموذجًا ، وتوفر مقاييس أداء النموذج. يمكنك بعد ذلك استخدام النموذج المخصص الخاص بك عبر ملف واجهة برمجة تطبيقات التسميات المخصصة للتعرف ودمجه في تطبيقاتك.

تجميع بيانات التدريب وتدريب نموذج Rekognition Custom Labels

في مجلة GitHub repo المرتبط بهذا المنشور، ستجد رمزًا يوضح كيفية الاستماع إلى صوت انذار الدخان ، بغض النظر عن ضوضاء الخلفية. في هذه الحالة ، يعد نموذج Rekognition Custom Labels الخاص بنا نموذج تصنيف ثنائي ، مما يعني أن النتائج إما "تم اكتشاف صوت إنذار الدخان" أو "لم يتم اكتشاف صوت إنذار الدخان."

لإنشاء نموذج مخصص ، نحتاج إلى بيانات التدريب. تتكون بيانات التدريب هذه من نوعين رئيسيين: الأصوات البيئية ، والأصوات التي ترغب في اكتشافها (مثل انطفاء إنذار الدخان).

يجب أن تمثل البيانات البيئية مجموعة متنوعة من المشاهد الصوتية النموذجية للبيئة التي تريد اكتشاف الصوت فيها. على سبيل المثال ، إذا كنت ترغب في اكتشاف صوت إنذار الدخان في بيئة المصنع ، فابدأ بالأصوات المسجلة في بيئة المصنع تلك. مجموعة متنوعة من المواقف (بدون صوت إنذار الدخان بالطبع).

يجب عزل الأصوات التي تريد اكتشافها إن أمكن ، مما يعني أن التسجيلات يجب أن تكون الصوت نفسه فقط بدون أي أصوات خلفية بيئية. على سبيل المثال ، هذا صوت انذار دخان.

بعد جمع هذه الأصوات ، يوضح الكود الموجود في GitHub repo كيفية دمج الأصوات البيئية مع أصوات إنذار الدخان بطرق مختلفة (ثم تحويلها إلى مخططات طيفية) من أجل إنشاء عدد من الصور التي تمثل الأصوات البيئية مع وبدون أصوات إنذار الدخان متراكبة عليها. الصورة التالية هي مثال لبعض الأصوات البيئية مع صوت إنذار الدخان (الأشرطة الأفقية الساطعة) مضاف فوقها.

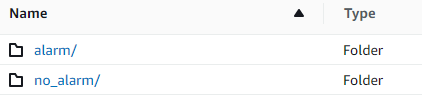

يتم تخزين بيانات التدريب والاختبار في ملف خدمة تخزين أمازون البسيطة (Amazon S3) دلو. تعتبر بنية الدليل التالية نقطة انطلاق جيدة لتنظيم البيانات داخل الحاوية.

يسمح لك نموذج التعليمات البرمجية في GitHub repo باختيار عدد صور التدريب المراد إنشاؤها. لا تتطلب Rekognition Custom Labels عددًا كبيرًا من صور التدريب. يجب أن تكون مجموعة التدريب من 200-500 صورة كافية.

يتطلب إنشاء مشروع Rekognition Custom Labels تحديد URIs للمجلد S3 الذي يحتوي على بيانات التدريب وبيانات الاختبار (اختياريًا). عند تحديد مصادر البيانات لوظيفة التدريب ، يكون أحد الخيارات وضع العلامات التلقائي، كما هو موضح في الصورة التالية.

يعني استخدام هذا الخيار أن Amazon Rekognition يستخدم أسماء المجلدات كأسماء تسمية. بالنسبة لحالة استخدام الكشف عن إنذار الدخان ، تبدو بنية المجلد داخل القطار ومجلدات الاختبار مثل لقطة الشاشة التالية.

تذهب صور بيانات التدريب إلى تلك المجلدات ، مع وجود مخططات طيفية تحتوي على صوت إنذار الدخان الموجود في مجلد التنبيه ، والبرامج الطيفية التي لا تحتوي على صوت إنذار الدخان في no_alarm مجلد. تستخدم Amazon Rekognition تلك الأسماء كأسماء فئة الإخراج لنموذج الملصقات المخصصة.

يستغرق تدريب نموذج الملصق المخصص عادةً من 30 إلى 90 دقيقة. في نهاية هذا التدريب ، يجب أن تبدأ النموذج المدرب حتى يصبح متاحًا للاستخدام.

بنية شاملة لاكتشاف الصوت

بعد إنشاء نموذجنا ، فإن الخطوة التالية هي إعداد خط أنابيب للاستدلال ، حتى نتمكن من استخدام النموذج لاكتشاف ما إذا كان صوت إنذار الدخان موجودًا في ملف صوتي. للقيام بذلك ، يجب تحويل صوت الإدخال إلى مخطط طيفي ثم يتم وضعه في إطارات وتصفيته حسب التردد ، كما حدث في عملية التدريب. يتم إعطاء كل نافذة في المخطط الطيفي للنموذج ، والذي يقوم بإرجاع تصنيف يشير إلى ما إذا كان إنذار الدخان قد انطلق أم لا.

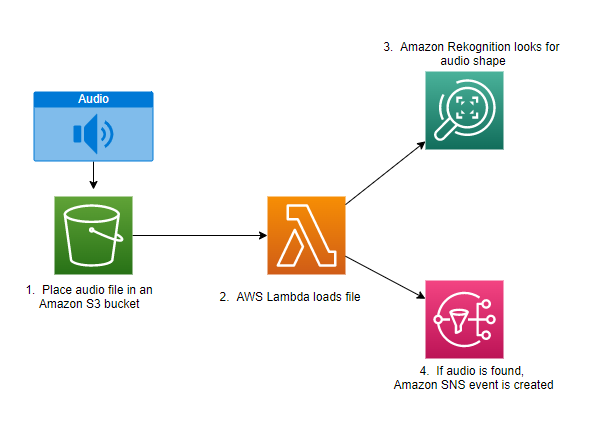

يُظهر الرسم البياني التالي نموذجًا معماريًا ينفذ خط أنابيب الاستدلال هذا.

تنتظر هذه البنية حتى يتم وضع ملف صوتي في حاوية S3 ، مما يؤدي بعد ذلك إلى ظهور ملف AWS لامدا الوظيفة المراد استدعاؤها. Lambda هي خدمة حوسبة بدون خادم تعتمد على الأحداث وتتيح لك تشغيل التعليمات البرمجية لأي نوع من التطبيقات أو الخدمات الخلفية دون توفير أو إدارة الخوادم. يمكنك تشغيل وظيفة Lambda من أكثر من 200 خدمة وبرنامج AWS كخدمة (SaaS) ، ودفع مقابل ما تستخدمه فقط.

تتلقى وظيفة Lambda اسم الحاوية واسم المفتاح (أو اسم الملف) لملف الصوت. يتم تنزيل الملف من Amazon S3 إلى ذاكرة الوظيفة ، والتي تحوله بعد ذلك إلى مخطط طيفي وتنفذ النوافذ وترشيح التردد. يتم بعد ذلك إرسال كل جزء مُجهز بنوافذ من المخطط الطيفي إلى Amazon Rekognition ، والذي يستخدم نموذج Amazon Custom Labels الذي تم تدريبه مسبقًا للكشف عن الصوت. إذا تم العثور على هذا الصوت ، فإن وظيفة Lambda تشير إلى ذلك باستخدام ملف خدمة إعلام أمازون البسيطة (Amazon SNS). تقدم Amazon SNS نهج عام / فرعي حيث يمكن إرسال الإشعارات إليه خدمة Amazon Simple Queue Service قوائم انتظار (Amazon SQS) ووظائف Lambda ونقاط نهاية HTTPS وعناوين البريد الإلكتروني ودفع الهاتف المحمول والمزيد.

وفي الختام

يمكنك استخدام التعلم الآلي مع البيانات الصوتية لتحديد وقت حدوث أصوات معينة ، حتى عند حدوث أصوات أخرى في نفس الوقت. يتطلب القيام بذلك تحويل الصوت إلى صورة مخطط طيفي ، ثم توجيه الصوت إلى أجزاء مختلفة من هذا المخطط الطيفي عن طريق النوافذ والتصفية حسب نطاق التردد. تجعل Rekognition Custom Labels من السهل تدريب نموذج مخصص لاكتشاف الصوت.

يمكنك استخدام جيثب ريبو يحتوي على رمز المثال لهذا المنشور كنقطة انطلاق لتجاربك الخاصة. لمزيد من المعلومات حول اكتشاف الأحداث الصوتية ، يرجى الرجوع إلى كشف حدث الصوت: برنامج تعليمي.

عن المؤلفين

جريج سومرفيل هو مهندس أول للنماذج الأولية في فريق AWS للنماذج الأولية والهندسة السحابية ، حيث يساعد عملاء AWS على تنفيذ حلول مبتكرة للمشاكل الصعبة المتعلقة بالتعلم الآلي وإنترنت الأشياء والتقنيات التي لا تحتاج إلى خادم. يعيش في آن أربور بولاية ميشيغان ويستمتع بممارسة اليوجا وتقديم الطعام لكلابه ولعب البوكر.

جريج سومرفيل هو مهندس أول للنماذج الأولية في فريق AWS للنماذج الأولية والهندسة السحابية ، حيث يساعد عملاء AWS على تنفيذ حلول مبتكرة للمشاكل الصعبة المتعلقة بالتعلم الآلي وإنترنت الأشياء والتقنيات التي لا تحتاج إلى خادم. يعيش في آن أربور بولاية ميشيغان ويستمتع بممارسة اليوجا وتقديم الطعام لكلابه ولعب البوكر.

جيف هارمان هو مهندس أول للنماذج الأولية في فريق AWS للنماذج الأولية والهندسة السحابية ، حيث يساعد عملاء AWS على تنفيذ حلول مبتكرة للمشكلات الصعبة. يعيش في يونيونفيل بولاية كونيتيكت ويستمتع بالأعمال الخشبية والحدادة وماين كرافت.

جيف هارمان هو مهندس أول للنماذج الأولية في فريق AWS للنماذج الأولية والهندسة السحابية ، حيث يساعد عملاء AWS على تنفيذ حلول مبتكرة للمشكلات الصعبة. يعيش في يونيونفيل بولاية كونيتيكت ويستمتع بالأعمال الخشبية والحدادة وماين كرافت.

- AI

- ai الفن

- مولد الفن ai

- الروبوت ai

- الأمازون إعادة الاعتراف

- الذكاء الاصطناعي

- شهادة الذكاء الاصطناعي

- الذكاء الاصطناعي في البنوك

- روبوت ذكاء اصطناعي

- روبوتات الذكاء الاصطناعي

- برنامج ذكاء اصطناعي

- التعلم الآلي من AWS

- سلسلة كتلة

- مؤتمر blockchain ai

- عملة عبقرية

- الذكاء الاصطناعي للمحادثة

- مؤتمر التشفير ai

- دال

- التعلم العميق

- google ai

- آلة التعلم

- أفلاطون

- أفلاطون ع

- الذكاء افلاطون البيانات

- لعبة أفلاطون

- أفلاطون داتا

- بلاتوغمينغ

- مقياس ai

- بناء الجملة

- زفيرنت