على مدى السنوات القليلة الماضية ، شهدت منصات التعليم عبر الإنترنت زيادة في اعتماد وزيادة الطلب على التعلم المستند إلى الفيديو لأنه يوفر وسيلة فعالة لإشراك المتعلمين. للتوسع في الأسواق الدولية ومخاطبة السكان المتنوعين ثقافيًا ولغويًا ، تبحث الشركات أيضًا في تنويع عروض التعلم الخاصة بهم من خلال توطين المحتوى إلى لغات متعددة. تبحث هذه الشركات عن طرق موثوقة وفعالة من حيث التكلفة لحل حالات استخدام الأقلمة.

يتضمن تعريب المحتوى بشكل أساسي ترجمة الأصوات الأصلية إلى لغات جديدة وإضافة مساعدات بصرية مثل الترجمة. تقليديا ، هذه العملية باهظة التكلفة ، يدوية ، وتستغرق الكثير من الوقت ، بما في ذلك العمل مع متخصصي الترجمة. مع قوة خدمات التعلم الآلي (ML) من AWS مثل الأمازون النسخ, ترجمة أمازونو الأمازون بولي، يمكنك إنشاء حل توطين قابل للتطبيق وفعال من حيث التكلفة. يمكنك استخدام Amazon Transcribe لإنشاء نسخة من تدفقات الصوت والفيديو الموجودة لديك ، ثم ترجمة هذا النص إلى لغات متعددة باستخدام Amazon Translate. يمكنك بعد ذلك استخدام Amazon Polly ، وهي خدمة تحويل النص إلى كلام ، لتحويل النص المترجم إلى كلام بشري يبدو طبيعيًا.

الخطوة التالية في الترجمة هي إضافة ترجمات إلى المحتوى ، والتي يمكن أن تحسن إمكانية الوصول والفهم ، وتساعد المشاهدين على فهم مقاطع الفيديو بشكل أفضل. قد يكون إنشاء الترجمة على محتوى الفيديو أمرًا صعبًا لأن الكلام المترجم لا يتطابق مع توقيت الكلام الأصلي. تعد هذه المزامنة بين الصوت والترجمة مهمة حاسمة يجب مراعاتها لأنها قد تؤدي إلى فصل الجمهور عن المحتوى الخاص بك إذا لم تكن متزامنة. تقدم Amazon Polly حلاً لهذا التحدي من خلال التمكين علامات الكلام، والتي يمكنك استخدامها لإنشاء ملف ترجمة يمكن مزامنته مع إخراج الكلام الذي تم إنشاؤه.

في هذا المنشور ، نراجع أحد حلول الترجمة باستخدام خدمات AWS ML حيث نستخدم مقطع فيديو أصليًا باللغة الإنجليزية ونحوله إلى اللغة الإسبانية. نركز أيضًا على استخدام علامات الكلام لإنشاء ملف ترجمة متزامن باللغة الإسبانية.

حل نظرة عامة

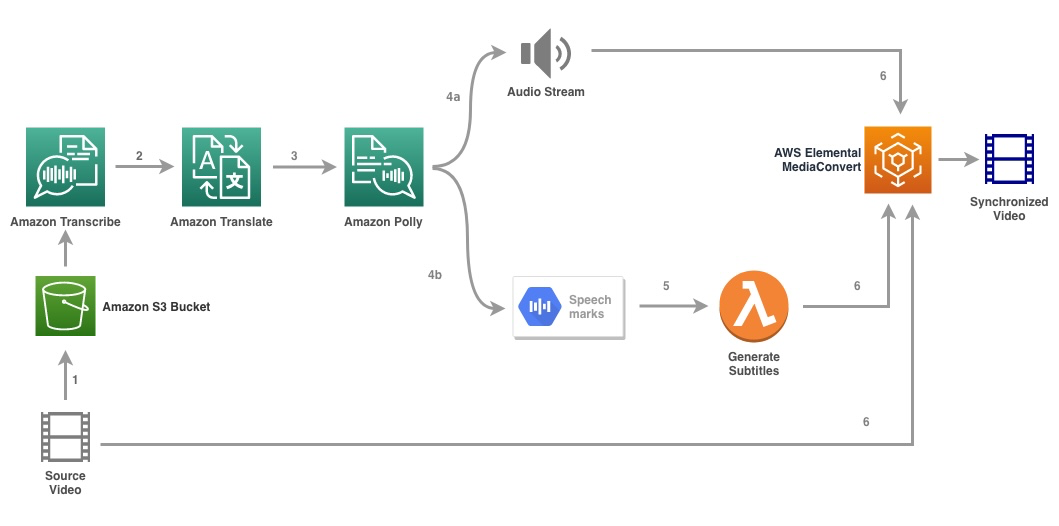

يوضح الرسم البياني التالي بنية الحل.

يأخذ الحل ملف فيديو وإعدادات اللغة المستهدفة كمدخلات ويستخدم Amazon Transcribe لإنشاء نسخ للفيديو. ثم نستخدم Amazon Translate لترجمة النص إلى اللغة الهدف. يتم توفير النص المترجم كمدخل إلى Amazon Polly لإنشاء دفق الصوت وعلامات الكلام في اللغة الهدف. عودة أمازون بولي إخراج علامة الكلام في دفق JSON محدد بسطر ، والذي يحتوي على الحقول مثل الوقت والنوع والبدء والانتهاء والقيمة. قد تختلف القيمة اعتمادًا على نوع علامة الكلام المطلوبة في الإدخال ، مثل اس اس ام ال, com.vismeأو كلمة أو جملة. لغرض مثالنا ، طلبنا نوع علامة الكلام as word. باستخدام هذا الخيار ، تقسم Amazon Polly الجملة إلى كلماتها الفردية في الجملة ووقتي البداية والنهاية في البث الصوتي. باستخدام هذه البيانات الوصفية ، تتم معالجة علامات الكلام بعد ذلك لإنشاء ترجمات لدفق الصوت المقابل الذي تم إنشاؤه بواسطة Amazon Polly.

أخيرا ، نستخدم AWS عنصري MediaConvert لعرض الفيديو النهائي بالصوت المترجم والترجمات المقابلة.

يوضح الفيديو التالي النتيجة النهائية للحل:

سير عمل AWS Step Functions

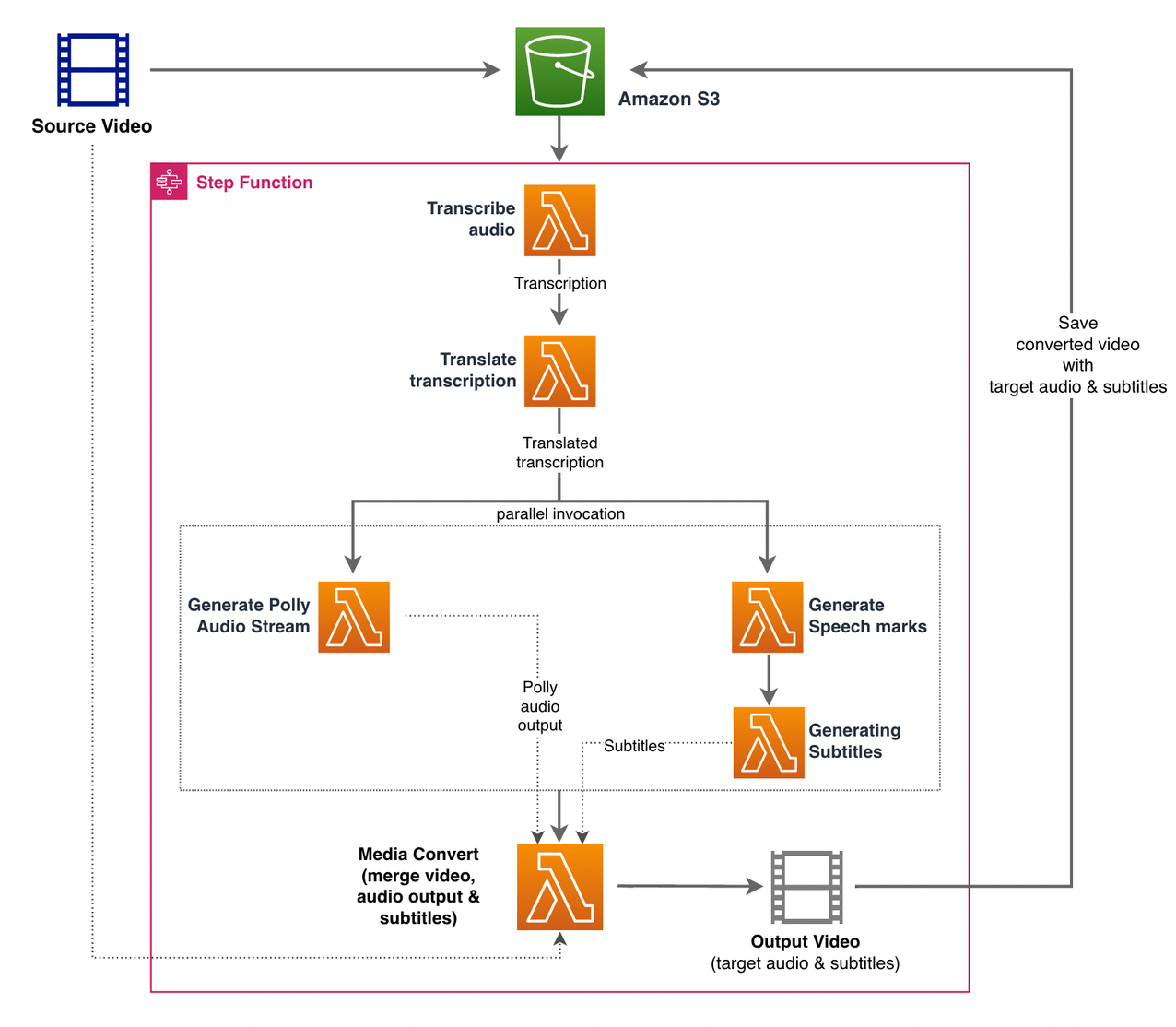

نستخدم وظائف خطوة AWS لتنظيم هذه العملية. يوضح الشكل التالي طريقة عرض عالية المستوى لسير عمل Step Functions (تم حذف بعض الخطوات من الرسم التخطيطي للحصول على وضوح أفضل).

خطوات سير العمل كالتالي:

- يقوم المستخدم بتحميل ملف الفيديو المصدر إلى ملف خدمة تخزين أمازون البسيطة دلو (أمازون S3).

- • إشعار حدث S3 يؤدي إلى AWS لامدا وظيفة State_machine.py (غير موضح في الرسم التخطيطي) ، والذي يستدعي آلة حالة Step Functions.

- الخطوة الأولى، نسخ الصوت، لاستدعاء وظيفة Lambda Transcribe.py، والذي يستخدم Amazon Transcribe لإنشاء نسخة من الصوت من الفيديو المصدر.

يوضح نموذج التعليمات البرمجية التالي كيفية إنشاء وظيفة نسخ باستخدام Amazon Transcribe بوتو 3 بايثون SDK:

بعد اكتمال المهمة ، يتم حفظ ملفات الإخراج في حاوية S3 وتستمر العملية إلى الخطوة التالية لترجمة المحتوى.

- • ترجمة النسخ تستدعي الخطوة دالة Lambda ترجمة. py التي تستخدم Amazon Translate لترجمة النص إلى اللغة الهدف. هنا ، نستخدم الترجمة المتزامنة / في الوقت الفعلي باستخدام ترجمة_نص وظيفة:

الترجمة المتزامنة لها حدود على حجم الوثيقة التي يمكن ترجمتها ؛ حتى كتابة هذه السطور ، تم ضبطه على 5,000 بايت. لأحجام المستندات الأكبر ، ضع في اعتبارك استخدام مسار غير متزامن لإنشاء المهمة باستخدام start_text_translation_job والتحقق من الحالة عبر description_text_translation_job.

- الخطوة التالية هي Step Functions موازية الدولة ، حيث نقوم بإنشاء فروع متوازية في آلة دولتنا.

- في الفرع الأول ، نستدعي دالة Lambda دالة Lambda create_polly_audio.py لإنشاء دفق صوت Amazon Polly الخاص بنا:

هنا نستخدم ملف start_speech_ynthetic_task طريقة Amazon Polly Python SDK لتشغيل مهمة تركيب الكلام التي تنشئ صوت Amazon Polly. وضعنا

OutputFormatإلىmp3، والذي يخبر Amazon Polly بإنشاء دفق صوتي لاستدعاء API هذا. - في الفرع الثاني ، نستدعي دالة Lambda create_speech_marks.py لإنشاء إخراج علامات الكلام:

- في الفرع الأول ، نستدعي دالة Lambda دالة Lambda create_polly_audio.py لإنشاء دفق صوت Amazon Polly الخاص بنا:

- نحن مرة أخرى نستخدم start_speech_ynthetic_task طريقة ولكن تحدد

OutputFormatإلىjson، والذي يخبر Amazon Polly بإنشاء علامات الكلام لاستدعاء واجهة برمجة التطبيقات هذا.

في الخطوة التالية من الفرع الثاني ، نستدعي دالة Lambda create_subtitles.py، والذي يقوم بتنفيذ المنطق لإنشاء ملف ترجمة من إخراج علامات الكلام.

يستخدم وحدة Python في الملف webvtt_utils.py. تحتوي هذه الوحدة على وظائف مفيدة متعددة لإنشاء ملف الترجمة ؛ طريقة واحدة من هذا القبيل get_phrases_from_speechmarks مسؤول عن تحليل ملف علامات الكلام. يوفر الكلام الذي يشير إلى بنية JSON وقت البدء فقط لكل كلمة على حدة. لإنشاء توقيت الترجمة المطلوب لملف SRT ، نقوم أولاً بإنشاء عبارات حول الكلمات n (حيث n = 10) من قائمة الكلمات في ملف علامات الكلام. ثم نكتبها في تنسيق ملف SRT ، مع أخذ وقت البدء من الكلمة الأولى في العبارة ، وفي وقت النهاية نستخدم وقت بدء الكلمة (n + 1) ونطرحها بمقدار 1 لإنشاء الإدخال المتسلسل . تقوم الوظيفة التالية بإنشاء العبارات استعدادًا لكتابتها في ملف SRT:

- الخطوة الأخيرة ، تحويل وسائل الإعلام، لاستدعاء وظيفة Lambda create_mediaconvert_job.py لدمج دفق الصوت من Amazon Polly وملف الترجمة مع ملف الفيديو المصدر لإنشاء ملف الإخراج النهائي ، والذي يتم تخزينه بعد ذلك في حاوية S3. تستخدم هذه الخطوة

MediaConvert، خدمة تحويل ترميز فيديو قائمة على الملفات مع ميزات من فئة البث. يتيح لك إنشاء محتوى فيديو عند الطلب بسهولة ويجمع بين إمكانات الفيديو والصوت المتقدمة مع واجهة ويب بسيطة. هنا مرة أخرى نستخدم Python بوتو 3 SDK لإنشاء ملفMediaConvertمهنة:

المتطلبات الأساسية المسبقة

قبل البدء ، يجب أن تكون لديك المتطلبات الأساسية التالية:

انشر الحل

لنشر الحل باستخدام AWS CDK ، أكمل الخطوات التالية:

- استنساخ مستودع:

- للتأكد من أن AWS CDK هو ألبس الحذاءقم بتشغيل الأمر

cdk bootstrapمن جذر المستودع: - قم بتغيير دليل العمل إلى جذر المستودع وقم بتشغيل الأمر التالي:

بشكل افتراضي ، يتم تعيين إعدادات الصوت الهدف على اللغة الإسبانية الأمريكية (es-US). إذا كنت تخطط لاختباره بلغة هدف مختلفة ، فاستخدم الأمر التالي:

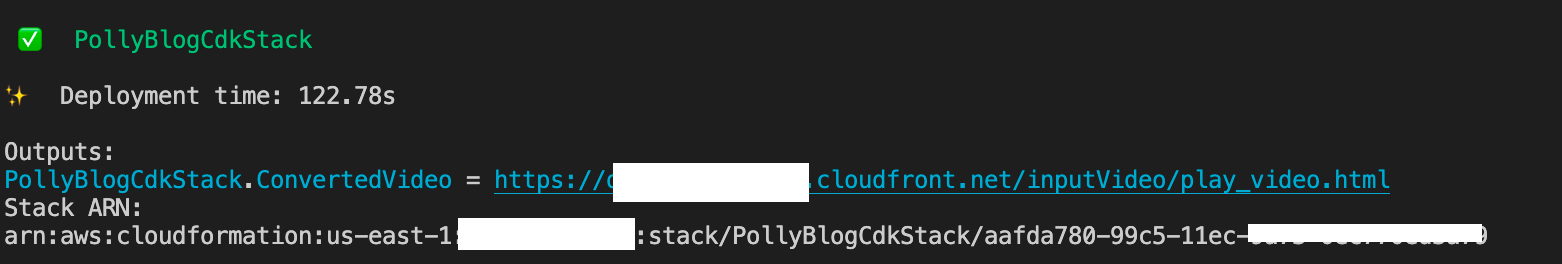

تستغرق العملية بضع دقائق حتى تكتمل ، وبعد ذلك تعرض ارتباطًا يمكنك استخدامه لعرض ملف الفيديو الهدف مع الصوت المترجم والترجمات المترجمة.

اختبر المحلول

لاختبار هذا الحل ، استخدمنا جزءًا صغيرًا مما يلي AWS re: Invent 2017 video من YouTube ، حيث تم تقديم Amazon Transcribe لأول مرة. يمكنك أيضًا اختبار الحل باستخدام الفيديو الخاص بك. اللغة الأصلية لفيديو الاختبار الخاص بنا هي الإنجليزية. عند نشر هذا الحل ، يمكنك تحديد إعدادات الصوت الهدف أو يمكنك استخدام إعدادات الصوت الهدف الافتراضية ، والتي تستخدم اللغة الإسبانية لتوليد الصوت والترجمة. ينشئ الحل حاوية S3 يمكن استخدامها لتحميل ملف الفيديو إليه.

- في وحدة التحكم Amazon S3 ، انتقل إلى الحاوية

PollyBlogBucket.

- اختر الدلو ، وانتقل إلى

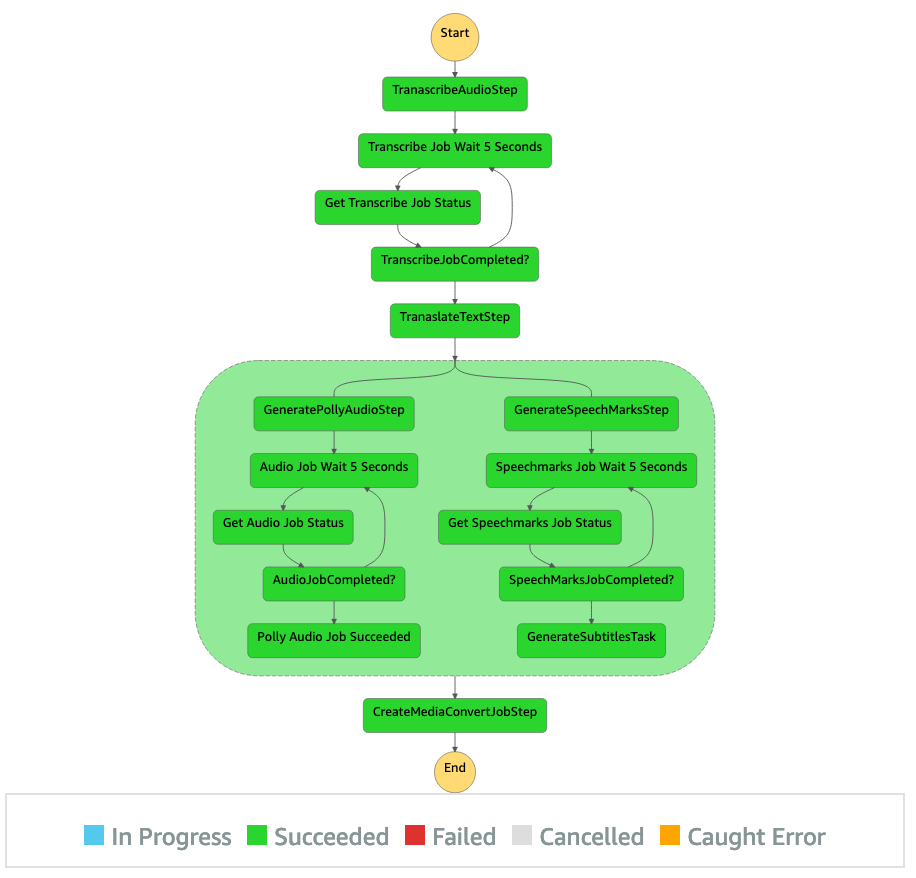

/inputVideoالدليل ، وتحميل ملف الفيديو (يتم اختبار الحل باستخدام مقاطع فيديو من النوع mp4). في هذه المرحلة ، يؤدي إشعار حدث S3 إلى تشغيل وظيفة Lambda ، والتي تبدأ تشغيل جهاز الحالة. - في وحدة التحكم في وظائف الخطوة ، استعرض للوصول إلى جهاز الحالة (

ProcessAudioWithSubtitles). - اختر أحد عمليات تشغيل جهاز الحالة لتحديد موقع ملف مفتش الرسم البياني.

يعرض هذا نتائج التشغيل لكل ولاية. يستغرق سير عمل Step Functions بضع دقائق ليكتمل ، وبعد ذلك يمكنك التحقق مما إذا كانت جميع الخطوات قد اكتملت بنجاح.

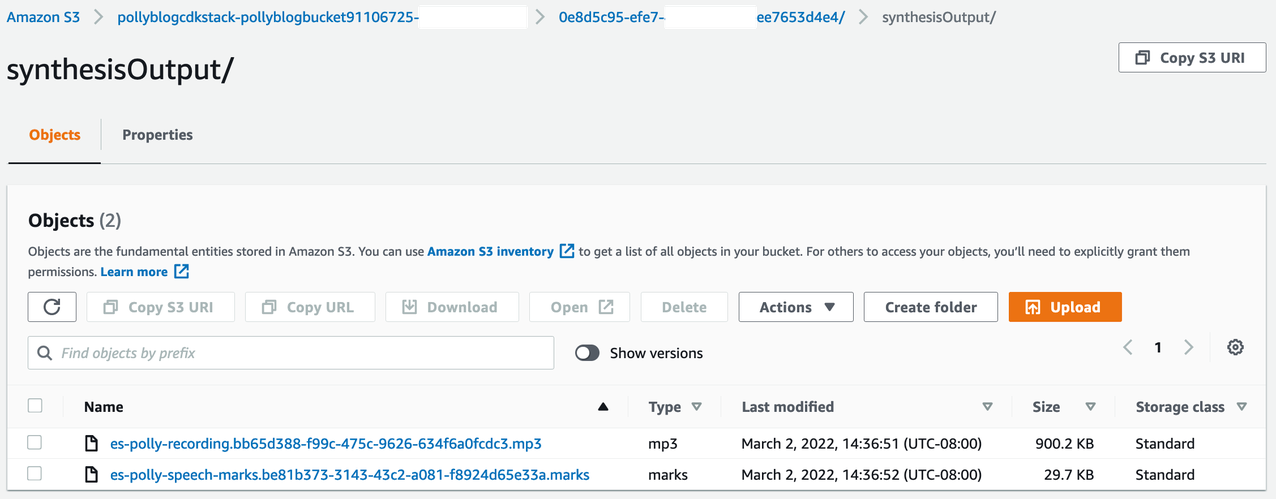

راجع الإخراج

لمراجعة الإخراج ، افتح وحدة تحكم Amazon S3 وتحقق مما إذا كان ملف الصوت (.mp3) وملف علامة الكلام (.marks) مخزنين في حاوية S3 ضمن <ROOT_S3_BUCKET>/<UID>/synthesisOutput/.

فيما يلي عينة من ملف علامة الكلام الذي تم إنشاؤه من النص المترجم:

في هذا الإخراج ، يتم تقسيم كل جزء من النص من حيث علامات الكلام:

- الوقت - الطابع الزمني بالمللي ثانية من بداية دفق الصوت المقابل

- نوع - نوع علامة الكلام (جملة ، كلمة ، viseme ، أو SSML)

- بداية - الإزاحة بالبايت (وليس بالأحرف) لبداية الكائن في نص الإدخال (لا يشمل علامات الرؤية)

- النهاية - الإزاحة بالبايت (وليس بالأحرف) لنهاية الكائن في نص الإدخال (لا تشمل علامات الرؤية)

- قيمنا - الكلمات الفردية في الجملة

تتم إعادة كتابة ملف الترجمة الذي تم إنشاؤه إلى حاوية S3. يمكنك العثور على الملف أسفل <ROOT_S3_BUCKET>/<UID>/subtitlesOutput/. افحص ملف الترجمة ؛ يجب أن يكون المحتوى مشابهًا للنص التالي:

بعد إنشاء ملف الترجمة والملف الصوتي ، يتم إنشاء ملف الفيديو المصدر النهائي باستخدام MediaConvert. تحقق من وحدة تحكم MediaConvert للتحقق مما إذا كانت حالة الوظيفة هي COMPLETE.

عند اكتمال مهمة MediaConvert ، يتم إنشاء ملف الفيديو النهائي وحفظه مرة أخرى في حاوية S3 ، والتي يمكن العثور عليها ضمن <ROOT_S3_BUCKET>/<UID>/convertedAV/.

كجزء من هذا النشر ، يتم توزيع الفيديو النهائي من خلال ملف الأمازون CloudFront (CDN) ويتم عرضه في المحطة أو في ملف تكوين سحابة AWS وحدة التحكم.

افتح عنوان URL في المستعرض لعرض الفيديو الأصلي مع خيارات إضافية للصوت والترجمة. يمكنك التحقق من أن الصوت المترجم والترجمات متزامنة.

وفي الختام

في هذا المنشور ، ناقشنا كيفية إنشاء إصدارات لغة جديدة لملفات الفيديو دون الحاجة إلى تدخل يدوي. يمكن لمنشئي المحتوى استخدام هذه العملية لمزامنة الصوت والترجمة لمقاطع الفيديو الخاصة بهم والوصول إلى جمهور عالمي.

يمكنك بسهولة دمج هذا النهج في خطوط أنابيب الإنتاج الخاصة بك للتعامل مع الأحجام الكبيرة والقياس وفقًا لاحتياجاتك. يستخدم أمازون بولي العصبية TTS (NTTS) لإنتاج أصوات تحويل النص إلى كلام طبيعية وشبيهة بالبشر. كما أنه يدعم ملفات توليد الكلام من SSML، مما يمنحك تحكمًا إضافيًا في كيفية قيام Amazon Polly بتوليد الكلام من النص المقدم. يوفر Amazon Polly أيضًا ملف مجموعة متنوعة من الأصوات المختلفة بلغات متعددة لدعم احتياجاتك.

ابدأ في استخدام خدمات التعلم الآلي من AWS من خلال زيارة موقع صفحة المنتج، أو قم بإحالة مختبر أمازون لحلول التعلم الآلي الصفحة حيث يمكنك التعاون مع الخبراء لتقديم حلول التعلم الآلي لمؤسستك.

موارد إضافية

لمزيد من المعلومات حول الخدمات المستخدمة في هذا الحل ، يرجى الرجوع إلى ما يلي:

عن المؤلفين

ريغان روزاريو يعمل كمهندس حلول في AWS مع التركيز على شركات تكنولوجيا التعليم. إنه يحب مساعدة العملاء في بناء حلول قابلة للتطوير ومتاحة للغاية وآمنة في سحابة AWS. لديه أكثر من عقد من الخبرة في العمل في مجموعة متنوعة من الأدوار التكنولوجية ، مع التركيز على هندسة البرمجيات والهندسة المعمارية.

ريغان روزاريو يعمل كمهندس حلول في AWS مع التركيز على شركات تكنولوجيا التعليم. إنه يحب مساعدة العملاء في بناء حلول قابلة للتطوير ومتاحة للغاية وآمنة في سحابة AWS. لديه أكثر من عقد من الخبرة في العمل في مجموعة متنوعة من الأدوار التكنولوجية ، مع التركيز على هندسة البرمجيات والهندسة المعمارية.

أنيل كودالي مهندس حلول مع Amazon Web Services. إنه يعمل مع عملاء AWS EdTech ، ويوجههم بأفضل الممارسات المعمارية لترحيل أعباء العمل الحالية إلى السحابة وتصميم أعباء عمل جديدة باستخدام نهج السحابة أولاً. قبل انضمامه إلى AWS ، عمل مع كبار بائعي التجزئة لمساعدتهم في عمليات ترحيل السحابة الخاصة بهم.

أنيل كودالي مهندس حلول مع Amazon Web Services. إنه يعمل مع عملاء AWS EdTech ، ويوجههم بأفضل الممارسات المعمارية لترحيل أعباء العمل الحالية إلى السحابة وتصميم أعباء عمل جديدة باستخدام نهج السحابة أولاً. قبل انضمامه إلى AWS ، عمل مع كبار بائعي التجزئة لمساعدتهم في عمليات ترحيل السحابة الخاصة بهم.

براسانا ساراسواثي كريشنان هو مهندس حلول مع Amazon Web Services ويعمل مع عملاء EdTech. إنه يساعدهم على توجيه بنية السحابة واستراتيجية البيانات الخاصة بهم باستخدام أفضل الممارسات. تتمثل خلفيته في الحوسبة الموزعة وتحليلات البيانات الضخمة وهندسة البيانات. إنه شغوف بالتعلم الآلي ومعالجة اللغة الطبيعية.

براسانا ساراسواثي كريشنان هو مهندس حلول مع Amazon Web Services ويعمل مع عملاء EdTech. إنه يساعدهم على توجيه بنية السحابة واستراتيجية البيانات الخاصة بهم باستخدام أفضل الممارسات. تتمثل خلفيته في الحوسبة الموزعة وتحليلات البيانات الضخمة وهندسة البيانات. إنه شغوف بالتعلم الآلي ومعالجة اللغة الطبيعية.

- AI

- ai الفن

- مولد الفن ai

- الروبوت ai

- مختبر أمازون ML Solutions

- الأمازون بولي

- الأمازون النسخ

- ترجمة أمازون

- الذكاء الاصطناعي

- شهادة الذكاء الاصطناعي

- الذكاء الاصطناعي في البنوك

- روبوت ذكاء اصطناعي

- روبوتات الذكاء الاصطناعي

- برنامج ذكاء اصطناعي

- التعلم الآلي من AWS

- سلسلة كتلة

- مؤتمر blockchain ai

- عملة عبقرية

- الذكاء الاصطناعي للمحادثة

- مؤتمر التشفير ai

- دال

- التعلم العميق

- google ai

- آلة التعلم

- أفلاطون

- أفلاطون ع

- الذكاء افلاطون البيانات

- لعبة أفلاطون

- أفلاطون داتا

- بلاتوغمينغ

- مقياس ai

- بناء الجملة

- زفيرنت