على الرغم من الاعتماد الذي لا يمكن إيقافه على ما يبدو للماجستير في إدارة الأعمال عبر الصناعات، إلا أنها تمثل أحد مكونات النظام البيئي التكنولوجي الأوسع الذي يحرك موجة الذكاء الاصطناعي الجديدة. تتطلب العديد من حالات استخدام الذكاء الاصطناعي للمحادثة وجود شهادات ماجستير في القانون مثل Llama 2 وFlan T5 وBloom للرد على استفسارات المستخدم. تعتمد هذه النماذج على المعرفة البارامترية للإجابة على الأسئلة. يتعلم النموذج هذه المعرفة أثناء التدريب ويقوم بترميزها في معلمات النموذج. من أجل تحديث هذه المعرفة، يجب علينا إعادة تدريب LLM، الأمر الذي يستغرق الكثير من الوقت والمال.

ولحسن الحظ، يمكننا أيضًا استخدام المعرفة المصدرية لإبلاغ طلاب ماجستير الإدارة لدينا. المعرفة المصدرية هي المعلومات التي يتم إدخالها في LLM من خلال موجه الإدخال. أحد الأساليب الشائعة لتوفير المعرفة المصدرية هو الاسترجاع المعزز (RAG). باستخدام RAG، نقوم باسترداد المعلومات ذات الصلة من مصدر بيانات خارجي ونقوم بإدخال تلك المعلومات في LLM.

في منشور المدونة هذا، سنستكشف كيفية نشر LLMs مثل Llama-2 باستخدام Amazon Sagemaker JumpStart وإبقاء LLMs لدينا محدثين بالمعلومات ذات الصلة من خلال Retrieval Augmented Generation (RAG) باستخدام قاعدة بيانات متجهات Pinecone لمنع هلوسة الذكاء الاصطناعي. .

الجيل المعزز للاسترجاع (RAG) في Amazon SageMaker

سوف يتعامل Pinecone مع مكون الاسترجاع في RAG، لكنك تحتاج إلى مكونين أكثر أهمية: مكان لتشغيل استدلال LLM ومكان ما لتشغيل نموذج التضمين.

Amazon SageMaker Studio عبارة عن بيئة تطوير متكاملة (IDE) توفر واجهة مرئية واحدة قائمة على الويب حيث يمكنك الوصول إلى الأدوات المصممة لهذا الغرض لتنفيذ جميع عمليات تطوير التعلم الآلي (ML). فهو يوفر SageMaker JumpStart وهو مركز نموذج حيث يمكن للمستخدمين تحديد موقع نموذج معين ومعاينته وتشغيله في حساب SageMaker الخاص بهم. فهو يوفر نماذج مدربة مسبقًا ومتاحة للعامة ومملوكة لمجموعة واسعة من أنواع المشكلات، بما في ذلك النماذج الأساسية.

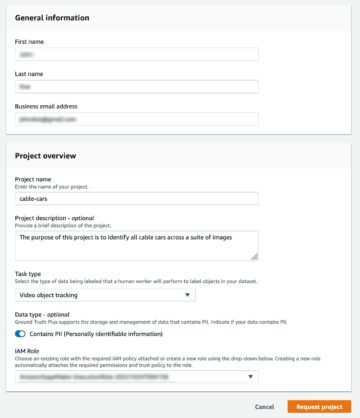

يوفر Amazon SageMaker Studio بيئة مثالية لتطوير خطوط أنابيب LLM التي تدعم RAG. أولاً، باستخدام وحدة تحكم AWS، انتقل إلى Amazon SageMaker وقم بإنشاء مجال SageMaker Studio وافتح دفتر ملاحظات Jupyter Studio.

المتطلبات الأساسية المسبقة

أكمل الخطوات الأساسية التالية:

- قم بإعداد Amazon SageMaker Studio.

- الانضمام إلى مجال Amazon SageMaker.

- قم بالتسجيل في قاعدة بيانات Pinecone Vector ذات المستوى المجاني.

- مكتبات المتطلبات الأساسية: SageMaker Python SDK، Pinecone Client

تجول الحل

باستخدام دفتر ملاحظات SageMaker Studio، نحتاج أولاً إلى تثبيت مكتبات المتطلبات الأساسية:

نشر LLM

في هذا المنشور، نناقش طريقتين لنشر LLM. الأول هو من خلال HuggingFaceModel هدف. يمكنك استخدام هذا عند نشر LLMs (ونماذج التضمين) مباشرة من مركز نموذج Hugging Face.

على سبيل المثال، يمكنك إنشاء تكوين قابل للنشر لـ جوجل / فلان-t5-xl النموذج كما هو موضح في لقطة الشاشة التالية:

عند نشر النماذج مباشرة من Hugging Face، قم بتهيئة my_model_configuration كالآتي: info@yagoat.com

- An

envيخبرنا التكوين بالنموذج الذي نريد استخدامه ولأي مهمة. - تنفيذ SageMaker الخاص بنا

roleيمنحنا الأذونات لنشر نموذجنا. - An

image_uriعبارة عن تكوين صورة مخصص لنشر LLMs من Hugging Face.

وبدلاً من ذلك، يحتوي SageMaker على مجموعة من النماذج المتوافقة مباشرة مع أبسط JumpStartModel هدف. يدعم هذا النموذج العديد من برامج LLM الشائعة مثل Llama 2، والتي يمكن تهيئتها كما هو موضح في لقطة الشاشة التالية:

لكلا الإصدارين my_model، قم بنشرها كما هو موضح في لقطة الشاشة التالية:

مع نقطة نهاية LLM التي تمت تهيئتها، يمكنك البدء في الاستعلام. قد يختلف تنسيق استفساراتنا (خاصة بين طلاب LLM المحادثة وغير المحادثة)، ولكن العملية هي نفسها بشكل عام. بالنسبة لنموذج الوجه المعانق، قم بما يلي:

تجدون الحل في مستودع جيثب.

إن الإجابة التي نتلقاها هنا ليس لها أي معنى، إنها هلوسة.

توفير سياق إضافي لـ LLM

يحاول Llama 2 الإجابة على سؤالنا بناءً على المعرفة البارامترية الداخلية فقط. من الواضح أن معلمات النموذج لا تخزن المعرفة بالمثيلات التي يمكننا تخزينها من خلال التدريب الموضعي المُدار في SageMaker.

للإجابة على هذا السؤال بشكل صحيح، يجب علينا استخدام المعرفة المصدرية. أي أننا نقدم معلومات إضافية إلى LLM عبر الموجه. دعونا نضيف هذه المعلومات مباشرة كسياق إضافي للنموذج.

والآن نرى الإجابة الصحيحة على السؤال؛ كان ذلك سهلا! ومع ذلك، من غير المرجح أن يقوم المستخدم بإدراج سياقات في مطالباته، فهو يعرف بالفعل إجابة سؤاله.

بدلاً من إدراج سياق واحد يدويًا، يمكنك تحديد المعلومات ذات الصلة تلقائيًا من قاعدة بيانات أكثر شمولاً للمعلومات. للقيام بذلك، سوف تحتاج إلى الجيل المعزز للاسترجاع.

الجيل المعزز الاسترداد

باستخدام تقنية "الجيل المعزز للاسترجاع"، يمكنك تشفير قاعدة بيانات من المعلومات في مساحة متجهة حيث يمثل القرب بين المتجهات أهميتها/تشابهها الدلالي. باستخدام مساحة المتجه هذه كقاعدة معرفية، يمكنك تحويل استعلام مستخدم جديد، وترميزه في نفس مساحة المتجه، واسترداد السجلات الأكثر صلة التي تمت فهرستها مسبقًا.

بعد استرداد هذه السجلات ذات الصلة، حدد عددًا قليلًا منها وقم بإدراجها في موجه LLM كسياق إضافي، مما يوفر لـ LLM معرفة مصدرية ذات صلة كبيرة. هذه عملية من خطوتين حيث:

- تقوم الفهرسة بملء فهرس المتجه بالمعلومات من مجموعة البيانات.

- يحدث الاسترداد أثناء الاستعلام وهو المكان الذي نسترد فيه المعلومات ذات الصلة من فهرس المتجهات.

تتطلب كلتا الخطوتين نموذج تضمين لترجمة النص العادي الذي يمكن قراءته بواسطة الإنسان إلى مساحة متجهة دلالية. استخدم محول الجملة MiniLM عالي الكفاءة من Hugging Face كما هو موضح في لقطة الشاشة التالية. هذا النموذج ليس LLM وبالتالي لم تتم تهيئته بنفس طريقة نموذج Llama 2 الخاص بنا.

في مجلة hub_config، حدد معرف النموذج كما هو موضح في لقطة الشاشة أعلاه ولكن بالنسبة للمهمة، استخدم ميزة استخراج الميزات لأننا نقوم بإنشاء تضمينات متجهة وليس نصًا مثل ماجستير إدارة الأعمال الخاص بنا. بعد ذلك، قم بتهيئة تكوين النموذج باستخدام HuggingFaceModel كما كان من قبل، ولكن هذه المرة بدون صورة LLM ومع بعض معلمات الإصدار.

يمكنك نشر النموذج مرة أخرى باستخدام deploy، باستخدام المثيل الأصغر (وحدة المعالجة المركزية فقط) لـ ml.t2.large. طراز MiniLM صغير الحجم، لذا فهو لا يتطلب قدرًا كبيرًا من الذاكرة ولا يحتاج إلى وحدة معالجة الرسومات (GPU) لأنه يمكنه إنشاء عمليات التضمين بسرعة حتى على وحدة المعالجة المركزية (CPU). إذا كنت تفضل ذلك، يمكنك تشغيل النموذج بشكل أسرع على وحدة معالجة الرسومات.

لإنشاء التضمينات، استخدم predict الطريقة وتمرير قائمة السياقات للتشفير عبر ملف inputs المفتاح كما هو موضح:

يتم تمرير سياقي إدخال، مما يؤدي إلى إرجاع اثنين من عمليات تضمين ناقل السياق كما هو موضح:

len(out)

2

أبعاد التضمين لنموذج MiniLM هي 384 وهو ما يعني أن كل متجه يتضمن مخرجات MiniLM يجب أن يكون له أبعاد تبلغ 384. ومع ذلك، بالنظر إلى طول التضمين لدينا، سترى ما يلي:

len(out[0]), len(out[1])

(8, 8)

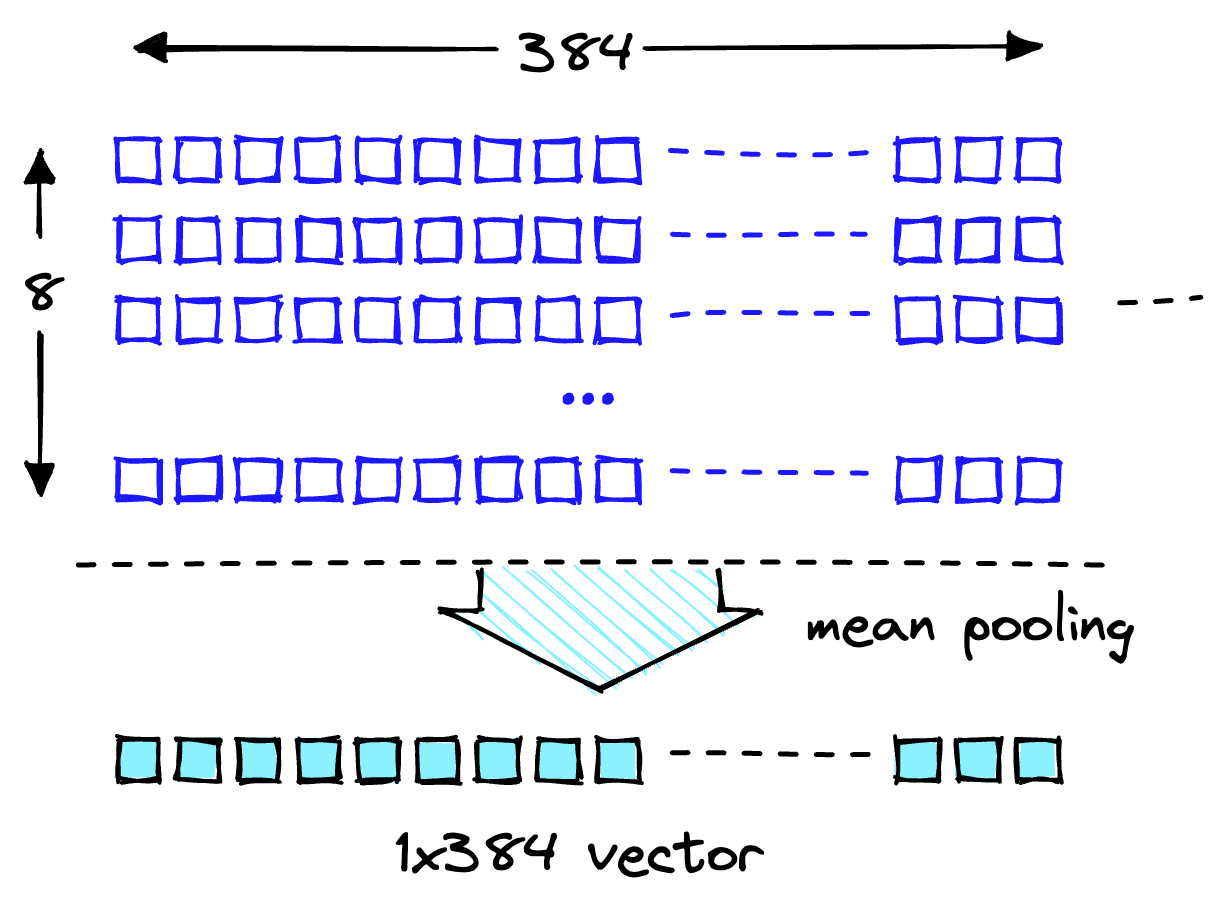

تحتوي كل قائمتين على ثمانية عناصر. تقوم MiniLM أولاً بمعالجة النص في خطوة الترميز. يعمل هذا الترميز على تحويل النص العادي الذي يمكن قراءته بواسطة الإنسان إلى قائمة من معرفات الرموز المميزة التي يمكن قراءتها بواسطة النموذج. في ميزات الإخراج للنموذج، يمكنك رؤية التضمينات على مستوى الرمز المميز. يُظهر أحد هذه التضمينات الأبعاد المتوقعة لـ 384 كما هو موضح:

len(out[0][0])

384

قم بتحويل عمليات التضمين على مستوى الرمز المميز هذه إلى عمليات تضمين على مستوى المستند باستخدام القيم المتوسطة عبر كل بُعد متجه، كما هو موضح في الرسم التوضيحي التالي.

عملية التجميع المتوسطة للحصول على ناقل واحد ذو 384 بعدًا.

مع اثنين من عمليات التضمين المتجهية ذات 384 بُعدًا، واحدة لكل نص مُدخل. لجعل حياتنا أسهل، قم بتجميع عملية التشفير في وظيفة واحدة كما هو موضح في لقطة الشاشة التالية:

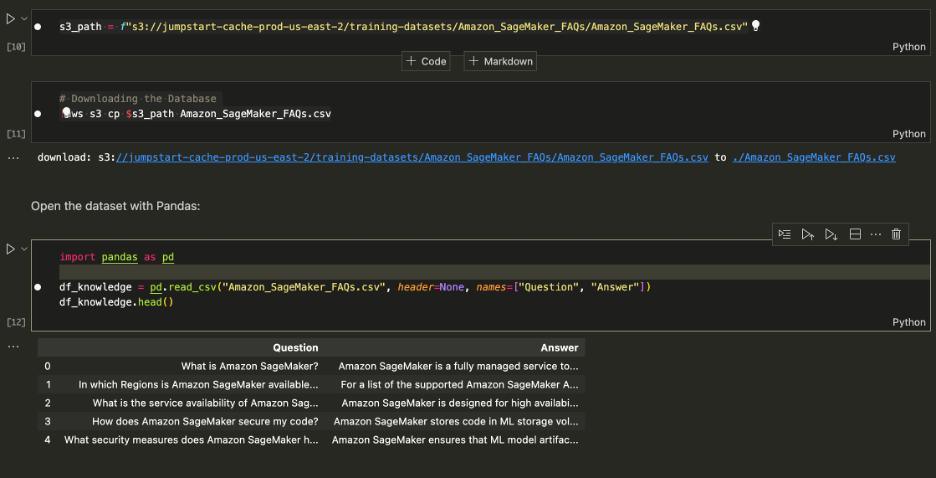

تنزيل مجموعة البيانات

قم بتنزيل الأسئلة الشائعة الخاصة بـ Amazon SageMaker كقاعدة معرفية للحصول على البيانات التي تحتوي على أعمدة الأسئلة والأجوبة.

قم بتنزيل الأسئلة الشائعة حول Amazon SageMaker

عند إجراء البحث، ابحث عن الإجابات فقط، حتى تتمكن من إسقاط عمود الأسئلة. انظر دفتر الملاحظات للحصول على التفاصيل.

مجموعة البيانات الخاصة بنا وخط أنابيب التضمين جاهزان. الآن كل ما نحتاجه هو مكان لتخزين تلك التضمينات.

الفهرسة

تقوم قاعدة بيانات ناقل Pinecone بتخزين تضمينات المتجهات والبحث فيها بكفاءة على نطاق واسع. لإنشاء قاعدة بيانات، ستحتاج إلى مفتاح API مجاني من Pinecone.

بعد الاتصال بقاعدة بيانات متجهات Pinecone، قم بإنشاء فهرس متجه واحد (مشابه لجدول في قواعد البيانات التقليدية). قم بتسمية الفهرس retrieval-augmentation-aws ومحاذاة الفهرس dimension و metric المعلمات مع تلك التي يتطلبها نموذج التضمين (MiniLM في هذه الحالة).

للبدء في إدراج البيانات، قم بتشغيل ما يلي:

يمكنك البدء في الاستعلام عن الفهرس بالسؤال السابق في هذا المنشور.

يوضح الناتج أعلاه أننا نعيد السياقات ذات الصلة لمساعدتنا في الإجابة على سؤالنا. منذ نحن top_k = 1, index.query أعادت النتيجة العليا جنبًا إلى جنب مع البيانات الوصفية التي تقرأ Managed Spot Training can be used with all instances supported in Amazon.

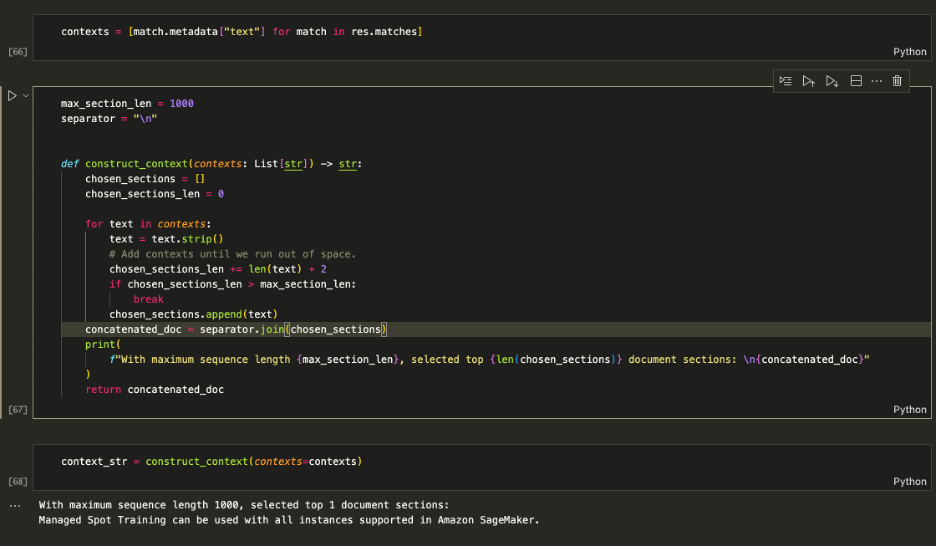

زيادة الموجه

استخدم السياقات المستردة لزيادة الموجه وتحديد الحد الأقصى لحجم السياق لإدخاله في LLM. استخدم ال 1000 حد الأحرف لإضافة كل سياق تم إرجاعه إلى الموجه بشكل متكرر حتى تتجاوز طول المحتوى.

زيادة الموجه

اطعم ال context_str في موجه LLM كما هو موضح في لقطة الشاشة التالية:

[الإدخال]: ما هي المثيلات التي يمكنني استخدامها مع Managed Spot Training في SageMaker؟ [الإخراج]: استنادًا إلى السياق المقدم، يمكنك استخدام Managed Spot Training مع جميع المثيلات المدعومة في Amazon SageMaker. لذلك، الجواب هو: جميع المثيلات مدعومة في Amazon SageMaker.

يعمل المنطق، لذا قم بتجميعه في وظيفة واحدة للحفاظ على نظافة الأشياء.

يمكنك الآن طرح أسئلة مثل تلك الموضحة في ما يلي:

تنظيف

للتوقف عن تحمل أي رسوم غير مرغوب فيها، احذف النموذج ونقطة النهاية.

وفي الختام

في هذا المنشور، قدمنا لك RAG مع LLMs ذات الوصول المفتوح على SageMaker. لقد أظهرنا أيضًا كيفية نشر نماذج Amazon SageMaker Jumpstart مع Llama 2، وHugging Face LLMs مع Flan T5، وتضمين النماذج مع MiniLM.

لقد قمنا بتنفيذ خط أنابيب RAG كامل من طرف إلى طرف باستخدام نماذج الوصول المفتوح الخاصة بنا ومؤشر ناقل Pinecone. باستخدام هذا، أظهرنا كيفية تقليل الهلوسة، والحفاظ على تحديث المعرفة في LLM، وفي نهاية المطاف تعزيز تجربة المستخدم والثقة في أنظمتنا.

لتشغيل هذا المثال بنفسك، انسخ مستودع GitHub هذا ونفذ الخطوات السابقة باستخدام ملف دفتر ملاحظات للإجابة على الأسئلة على GitHub.

عن المؤلفين

فيدانت جاين هو متخصص كبير في الذكاء الاصطناعي/تعلم الآلة، ويعمل على مبادرات الذكاء الاصطناعي التوليدية الإستراتيجية. قبل انضمامه إلى AWS، شغل فيدانت مناصب متخصصة في تعلم الآلة/علوم البيانات في شركات مختلفة مثل Databricks وHortonworks (الآن Cloudera) وJP Morgan Chase. بعيدًا عن عمله، فإن فيدانت شغوف بصنع الموسيقى وتسلق الصخور واستخدام العلم لعيش حياة ذات معنى واستكشاف المأكولات من جميع أنحاء العالم.

فيدانت جاين هو متخصص كبير في الذكاء الاصطناعي/تعلم الآلة، ويعمل على مبادرات الذكاء الاصطناعي التوليدية الإستراتيجية. قبل انضمامه إلى AWS، شغل فيدانت مناصب متخصصة في تعلم الآلة/علوم البيانات في شركات مختلفة مثل Databricks وHortonworks (الآن Cloudera) وJP Morgan Chase. بعيدًا عن عمله، فإن فيدانت شغوف بصنع الموسيقى وتسلق الصخور واستخدام العلم لعيش حياة ذات معنى واستكشاف المأكولات من جميع أنحاء العالم.

جيمس بريجز هو أحد محامي مطوري الموظفين في Pinecone، وهو متخصص في البحث عن المتجهات والذكاء الاصطناعي/تعلم الآلة. وهو يرشد المطورين والشركات في تطوير حلول GenAI الخاصة بهم من خلال التعليم عبر الإنترنت. قبل انضمامه إلى Pinecone، عمل جيمس في مجال الذكاء الاصطناعي للشركات الناشئة في مجال التكنولوجيا الصغيرة وشركات التمويل القائمة. خارج العمل، لدى جيمس شغف بالسفر وخوض مغامرات جديدة، بدءًا من ركوب الأمواج والغطس وحتى Muay Thai وBJJ.

جيمس بريجز هو أحد محامي مطوري الموظفين في Pinecone، وهو متخصص في البحث عن المتجهات والذكاء الاصطناعي/تعلم الآلة. وهو يرشد المطورين والشركات في تطوير حلول GenAI الخاصة بهم من خلال التعليم عبر الإنترنت. قبل انضمامه إلى Pinecone، عمل جيمس في مجال الذكاء الاصطناعي للشركات الناشئة في مجال التكنولوجيا الصغيرة وشركات التمويل القائمة. خارج العمل، لدى جيمس شغف بالسفر وخوض مغامرات جديدة، بدءًا من ركوب الأمواج والغطس وحتى Muay Thai وBJJ.

شين هوانغ هو عالم تطبيقي كبير في Amazon SageMaker JumpStart وخوارزميات Amazon SageMaker المدمجة. يركز على تطوير خوارزميات التعلم الآلي القابلة للتطوير. تتركز اهتماماته البحثية في مجال معالجة اللغة الطبيعية ، والتعلم العميق القابل للتفسير على البيانات المجدولة ، والتحليل القوي لتجميع الزمكان غير المعياري. وقد نشر العديد من الأوراق في مؤتمرات ACL و ICDM و KDD والجمعية الملكية للإحصاء: السلسلة أ.

شين هوانغ هو عالم تطبيقي كبير في Amazon SageMaker JumpStart وخوارزميات Amazon SageMaker المدمجة. يركز على تطوير خوارزميات التعلم الآلي القابلة للتطوير. تتركز اهتماماته البحثية في مجال معالجة اللغة الطبيعية ، والتعلم العميق القابل للتفسير على البيانات المجدولة ، والتحليل القوي لتجميع الزمكان غير المعياري. وقد نشر العديد من الأوراق في مؤتمرات ACL و ICDM و KDD والجمعية الملكية للإحصاء: السلسلة أ.

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- PlatoData.Network Vertical Generative Ai. تمكين نفسك. الوصول هنا.

- أفلاطونايستريم. ذكاء Web3. تضخيم المعرفة. الوصول هنا.

- أفلاطون كربون، كلينتك ، الطاقة، بيئة، شمسي، إدارة المخلفات. الوصول هنا.

- أفلاطون هيلث. التكنولوجيا الحيوية وذكاء التجارب السريرية. الوصول هنا.

- المصدر https://aws.amazon.com/blogs/machine-learning/mitigate-hallucinations-through-retrieval-augmented-generation-using-pinecone-vector-database-llama-2-from-amazon-sagemaker-jumpstart/

- :لديها

- :يكون

- :ليس

- :أين

- $ UP

- 1

- 10

- 100

- 11

- 12

- 14

- 15%

- 16

- 17

- 19

- 23

- 32

- 7

- 8

- 9

- a

- من نحن

- فوق

- الوصول

- وفقا

- حسابي

- في

- تضيف

- إضافي

- معلومات اضافية

- تبني

- مغامرات

- محام

- مرة أخرى

- AI

- حالات استخدام ai

- AI / ML

- خوارزميات

- محاذاة

- الكل

- على طول

- سابقا

- أيضا

- أمازون

- الأمازون SageMaker

- أمازون سيج ميكر جومب ستارت

- أمازون ساجميكر ستوديو

- أمازون ويب سيرفيسز

- كمية

- an

- تحليل

- و

- إجابة

- الأجوبة

- أي وقت

- API

- التطبيق

- تطبيقي

- نهج

- اقتراب

- هي

- المنطقة

- حول

- AS

- تطلب

- At

- محاولات

- زيادة

- المعزز

- السيارات

- تلقائيا

- متاح

- AWS

- قاعدة

- على أساس

- BE

- لان

- قبل

- بدأ

- ما بين

- المدونة

- إزهار

- على حد سواء

- أوسع

- نساعدك في بناء

- مدمج

- الأعمال

- لكن

- by

- CAN

- أسر

- حقيبة

- الحالات

- الأحرف

- اسعارنا محددة من قبل وزارة العمل

- مطاردة

- نظيف

- بوضوح

- التسلق

- Cloudera

- المجموعات

- عمود

- الأعمدة

- الشركات

- متوافق

- إكمال

- عنصر

- مكونات

- المؤتمرات

- متصل

- كنسولات

- تحتوي على

- يحتوي

- محتوى

- سياق الكلام

- السياقات

- تحادثي

- محادثة منظمة العفو الدولية

- تحول

- الشركات

- تصحيح

- بشكل صحيح

- خلق

- حرج

- حاليا

- البيانات

- قاعدة البيانات

- التاريخ

- DBS

- تقرر

- عميق

- التعلم العميق

- نشر

- نشر

- المطور

- المطورين

- تطوير

- التطوير التجاري

- بعد

- مباشرة

- بحث

- do

- هل

- لا توجد الآن

- لا

- نطاق

- دون

- قطرة

- أثناء

- كل

- في وقت سابق

- أسهل

- النظام الإيكولوجي

- التعليم

- فعال

- بكفاءة

- تضمين

- احتضان

- ترميز

- النهاية

- النهائي إلى نهاية

- نقطة النهاية

- تعزيز

- البيئة

- أنشئ

- حتى

- مثال

- تجاوز

- متوقع

- الخبره في مجال الغطس

- اكتشف

- استكشاف

- واسع

- خارجي

- استخراج

- الوجه

- أسرع

- المميزات

- بنك الاحتياطي الفيدرالي

- قليل

- تمويل

- نهاية

- الاسم الأول

- تطفو

- ويركز

- متابعيك

- في حالة

- شكل

- دورة تأسيسية

- مجانا

- تبدأ من

- وظيفة

- على العموم

- ولدت

- توليد

- جيل

- توليدي

- الذكاء الاصطناعي التوليدي

- دولار فقط واحصل على خصم XNUMX% على جميع

- GitHub جيثب:

- منح

- معطى

- يعطي

- Go

- يذهب

- وحدة معالجة الرسوميات:

- دليل

- مقبض

- يحدث

- يملك

- he

- عقد

- مساعدة

- هنا

- جدا

- له

- كيفية

- كيفية

- لكن

- HTTPS

- هوانغ

- محور

- تعانق الوجه

- انسان قارئ

- i

- ID

- المثالي

- تحديد

- IDS

- if

- صورة

- نفذت

- استيراد

- in

- تتضمن

- بما فيه

- القيمة الاسمية

- مؤشر

- مفهرس

- الصناعات

- إعلام

- معلومات

- المبادرات

- إدخال

- المدخلات

- تثبيت

- مثل

- المتكاملة

- السريرية

- السطح البيني

- داخلي

- إلى

- أدخلت

- IT

- العناصر

- جيمس

- انضمام

- jp

- جيه بي مورغان

- JP مورغان تشيس

- JPG

- احتفظ

- القفل

- علم

- المعرفة

- لغة

- كبير

- أكبر

- إطلاق

- قيادة

- تعلم

- يتعلم

- الطول

- المكتبات

- الحياة

- مثل

- مما سيحدث

- قائمة

- قوائم

- حياة

- اللاما نوع من الجمال

- LLM

- منطق

- بحث

- أبحث

- الكثير

- آلة

- آلة التعلم

- جعل

- القيام ب

- تمكن

- يدويا

- كثير

- مباراة

- اعواد الثقاب

- أقصى

- الحد الأقصى للمبلغ

- مايو..

- تعني

- ذات مغزى

- يعني

- مكبر الصوت : يدعم، مع دعم ميكروفون مدمج لمنع الضوضاء

- البيانات الوصفية

- طريقة

- تخفيف

- ML

- نموذج

- عارضات ازياء

- مال

- الأكثر من ذلك

- مورغان

- أكثر

- كثيرا

- متعدد

- موسيقى

- يجب

- الاسم

- طبيعي

- معالجة اللغات الطبيعية

- حاجة

- إحتياجات

- جديد

- التالي

- البرمجة اللغوية العصبية

- مفكرة

- الآن

- نمباي

- موضوع

- of

- on

- ONE

- online

- فقط

- جاكيت

- عملية

- or

- طلب

- OS

- وإلا

- لنا

- خارج

- الناتج

- النتائج

- في الخارج

- الخاصة

- أوراق

- المعلمات

- خاص

- خاصة

- pass

- مرت

- شغف

- عاطفي

- نفذ

- أداء

- أذونات

- صورة

- خط أنابيب

- عادي

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- الرائج

- مواقف

- منشور

- توفير الطاقة

- تنبؤ

- تنبؤات

- متنبئ

- المفضل

- منع

- أرسال

- سابق

- سابقا

- قبل

- المشكلة

- عملية المعالجة

- العمليات

- معالجة

- ملفي الشخصي

- مطالبات

- الملكية

- المقدمة

- ويوفر

- توفير

- علانية

- نشرت

- بايثون

- pytorch

- الاستفسارات

- سؤال

- الأسئلة المتكررة

- بسرعة

- نطاق

- تتراوح

- استعداد

- يستلم

- تسجيل

- المناطق

- ذات الصلة

- اعتمد

- مستودع

- يمثل

- تطلب

- مطلوب

- بحث

- الرد

- نتيجة

- النتائج

- عائد أعلى

- عودة

- قوي

- صخرة

- النوع

- ملكي

- يجري

- يدير

- sagemaker

- نفسه

- قول

- تحجيم

- حجم

- علوم

- عالم

- أحرز هدفاً

- شاشة

- الإستراحة

- بحث

- البحث

- انظر تعريف

- على ما يبدو

- حدد

- كبير

- إحساس

- عقوبة

- مسلسلات

- السلسلة أ

- خدماتنا

- طقم

- ينبغي

- إظهار

- أظهرت

- أظهرت

- يظهر

- جانب

- مماثل

- بساطة

- منذ

- عزباء

- المقاس

- صغير

- الأصغر

- So

- جاليات

- فقط

- حل

- الحلول

- بعض

- في مكان ما

- مصدر

- الفضاء

- متخصص

- متخصصة

- تخصص

- على وجه التحديد

- بقعة

- فريق العمل

- البدء

- إحصائي

- خطوة

- خطوات

- قلة النوم

- متجر

- فروعنا

- إستراتيجي

- خيط

- ستوديو

- هذه

- الدعم

- مدعومة

- الدعم

- نظام

- أنظمة

- جدول

- يأخذ

- مهمة

- التكنولوجيا

- الشركات الناشئة التكنولوجيا

- تكنولوجيا

- يروي

- نص

- التايلاندية

- من

- أن

- •

- المنطقة

- العالم

- من مشاركة

- منهم

- وبالتالي

- تشبه

- هم

- الأشياء

- هؤلاء

- عبر

- الوقت

- إلى

- رمز

- Tokenization

- جدا

- أدوات

- تيشرت

- تقليدي

- قادة الإيمان

- محول

- محولات

- التحويلات

- ترجمه

- السفر

- الثقة

- اثنان

- أنواع

- في النهاية

- من غير المحتمل

- لا يمكن وقفه.

- حتى

- غير مرغوب فيه

- تحديث

- us

- تستخدم

- مستعمل

- مستخدم

- تجربة المستخدم

- المستخدمين

- استخدام

- القيم

- مختلف

- الإصدار

- الإصدارات

- بواسطة

- بصري

- انتظر

- تجول

- تريد

- وكان

- موجة

- طريق..

- we

- الويب

- خدمات ويب

- على شبكة الإنترنت

- ابحث عن

- متى

- التي

- في حين

- واسع

- مدى واسع

- سوف

- مع

- بدون

- للعمل

- عمل

- عامل

- أعمال

- العالم

- سوف

- التفاف

- X

- نعم فعلا

- أنت

- حل متجر العقارات الشامل الخاص بك في جورجيا

- زفيرنت