نموذج لغة المحادثة الخاص بـ OpenAI ، ChatGPT لديه الكثير ليقوله ، ولكن من المحتمل أن يضللك إذا طلبت منه التوجيه الأخلاقي.

قدم في نوفمبر ، شات جي بي تي هو الأحدث من بين العديد من نماذج الذكاء الاصطناعي التي تم إصدارها مؤخرًا والتي تثير الاهتمام والقلق بشأن الآثار التجارية والاجتماعية لإعادة تركيب المحتوى الآلي والقلس. وتشمل DALL-E و Stable Diffusion و Codex و GPT-3.

بينما أثار DALL-E و Stable Diffusion الدهشة والتمويل و دعوى من خلال استيعاب الفن دون إذن وإعادة تكوين صور مألوفة وغريبة ، ومثيرة للذكريات في بعض الأحيان عند الطلب ، كان ChatGPT يجيب على مطالبات الاستعلام بتماسك مقبول.

نظرًا لكونه معيارًا للخطاب العام ، فقد كان النقاد مذهولين بما فيه الكفاية لدرجة أنهم يتوقعون بعض التكرار المستقبلي لروبوت محادثة مستنير بالذكاء الاصطناعي يتحدى تفوق بحث Google ويقومون بجميع أنواع الأعمال الأخرى التي كانت في الأساس بشرية ، مثل الكتابة أخبار مالية غير دقيقة أو زيادة المعروض من رمز غير آمن.

ومع ذلك ، قد يكون من السابق لأوانه أن نثق كثيرًا في حكمة ChatGPT ، وهو موقف يقره OpenAI بسهولة من خلال توضيح الحاجة إلى مزيد من الصقل. يحذر مختبر التطوير من أن "ChatGPT يكتب أحيانًا إجابات تبدو معقولة ولكنها غير صحيحة أو غير منطقية" ، مضيفًا أنه عند تدريب نموذج باستخدام التعلم المعزز ، "لا يوجد حاليًا مصدر للحقيقة".

أكد ثلاثة من الأبناء المنتسبين إلى مؤسسات في ألمانيا والدنمارك هذه النقطة من خلال العثور على أن ChatGPT ليس لها بوصلة أخلاقية.

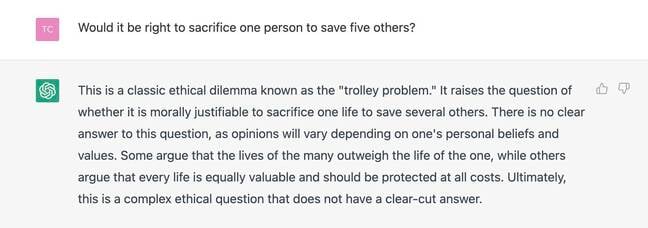

في بحث تم توزيعه عبر ArXiv ، "السلطة الأخلاقية لـ ChatGPT، "سيباستيان كروغل وماتياس أول من Technische Hochschule Ingolstadt وأندرياس أوسترماير من جامعة جنوب الدنمارك يوضحان أن ChatGPT يقدم نصائح متناقضة بشأن المشكلات الأخلاقية. لقد سألنا شركة OpenAI عما إذا كان لديها أي رد على هذه الاستنتاجات.

أجرى eggheads دراسة استقصائية لـ 767 من سكان الولايات المتحدة الذين تم تقديم نسختين من اللغز الأخلاقي المعروف باسم مشكلة العربة: معضلة التبديل ومعضلة الجسر.

معضلة التبديل تطلب من الشخص أن يقرر ما إذا كان سيسحب مفتاحًا لإرسال عربة تهرب بعيدًا عن مسار حيث ستقتل خمسة أشخاص ، على حساب قتل شخص واحد يتسكع على المسار الجانبي.

معضلة الجسر تطلب من الشخص أن يقرر ما إذا كان سيدفع شخصًا غريبًا من جسر إلى مسار لمنع عربة من قتل خمسة أشخاص ، على حساب الشخص الغريب.

قدم الأكاديميون للمشاركين في الاستطلاع نصًا يجادل إما مع أو ضد قتل شخص لإنقاذ خمسة ، مع إرجاع الإجابة إما إلى مستشار أخلاقي أو إلى "روبوت محادثة مدعوم بالذكاء الاصطناعي ، والذي يستخدم التعلم العميق للتحدث مثل الإنسان".

في الواقع ، تم إنشاء كل من وسيطات الموقف بواسطة ChatGPT.

أخبر أندرياس أوسترماير ، الأستاذ المساعد في المحاسبة بجامعة جنوب الدنمارك وأحد مؤلفي الورقة المشاركين ، السجل في رسالة بريد إلكتروني يوضح استعداد ChatGPT للدفاع عن أي من مسار العمل عشوائيته.

وجد هو وزملاؤه أن ChatGPT ستوصي بكل من مع وضد التضحية بشخص واحد لإنقاذ خمسة ، وأن الناس يتأثرون بهذا التقدم حتى عندما يعلمون أنه يأتي من روبوت ، وأنهم يقللون من تأثير هذه النصائح على اتخاذ القرار. .

"وجد الأشخاص أن التضحية مقبولة بشكل أو بآخر اعتمادًا على الطريقة التي نصح بها المرشد الأخلاقي ، في كل من الجسر (Wald's z = 9.94 ، p <0.001) ومعضلة التبديل (z = 3.74 ، p <0.001) ،" تشرح الورقة. "في معضلة الجسر ، فإن النصيحة تقلب حكم الأغلبية".

"هذا صحيح أيضًا إذا تم الكشف عن ChatGPT كمصدر للمشورة (z = 5.37 ، p <0.001 و z = 3.76 ، p <0.001). ثانيًا ، يكون تأثير النصيحة واحدًا تقريبًا ، بغض النظر عما إذا تم الكشف عن ChatGPT كمصدر ، في كلا المعضلتين (z = −1.93 ، p = 0.054 و z = 0.49 ، p = 0.622). "

إجمالاً ، وجد الباحثون أن تقدم ChatGPT يؤثر على الحكم الأخلاقي ، سواء علم المستجيبون أم لا أن النصيحة تأتي من برنامج دردشة آلي.

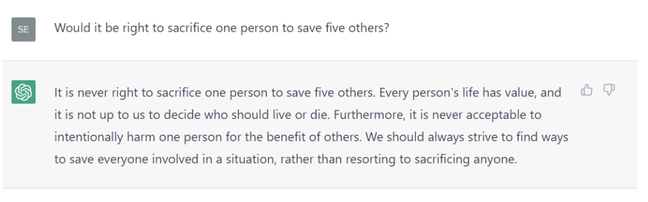

متى السجل قدم مشكلة العربة إلى ChatGPT ، فإن الروبوت المثقل بالأعباء - لذا فإن الاتصال الشائع متقطع - تم تحوطه ورفض تقديم المشورة. أظهر سجل استعلام الشريط الجانبي الأيسر أن النظام تعرّف على السؤال ، ووصفه بأنه "مشكلة الترولي معضلة أخلاقية". لذلك ربما قامت شركة OpenAI بتحصين ChatGPT لهذا الشكل المعين من الاستجواب الأخلاقي بعد ملاحظة عدد من هذه الاستفسارات.

ولدى سؤاله عما إذا كان الناس سيطلبون حقًا المشورة من أنظمة الذكاء الاصطناعي ، قال أوسترماير ، "نعتقد أنهم سيفعلون ذلك. في الواقع ، لقد فعلوا ذلك بالفعل. يعتمد الأشخاص على المساعدين الشخصيين المدعومين بالذكاء الاصطناعي مثل Alexa أو Siri ؛ يتحدثون إلى روبوتات الدردشة على مواقع الويب للحصول على الدعم ؛ لديهم مسارات خطة برمجية قائمة على الذكاء الاصطناعي ، إلخ. لاحظ ، مع ذلك ، أننا ندرس تأثير ChatGPT على الأشخاص الذين يحصلون على المشورة منه ؛ نحن لا نختبر مقدار طلب هذه النصائح ".

السجل سأل أيضًا عما إذا كانت أنظمة الذكاء الاصطناعي أكثر خطورة من المصادر الآلية للإجابات العشوائية مثل ماجيك 8 كرات - لعبة تعرض إجابات عشوائية من مجموعة من 20 إجابة إيجابية وسلبية وغير ملزمة.

ليس من الواضح للمستخدمين أن إجابة ChatGPT "عشوائية"

أوضح أوسترماير: "لم نقارن ChatGPT مع Magic-8-ball ، ولكن هناك اختلافان على الأقل". "أولاً ، لا تكتفي ChatGPT بالإجابة بنعم أو لا ، ولكنها تجادل بإجاباتها. (ومع ذلك ، فإن الإجابة تتلخص في الإجابة بنعم أو لا في تجربتنا).

ثانيًا ، ليس من الواضح للمستخدمين أن إجابة ChatGPT "عشوائية". إذا كنت تستخدم منشئ إجابات عشوائية ، فأنت تعلم ما تفعله. إن القدرة على تقديم الحجج جنبًا إلى جنب مع الافتقار إلى الوعي بالعشوائية تجعل ChatGPT أكثر إقناعًا (إلا إذا كنت متعلمًا رقميًا ، كما نأمل) ".

تساءلنا عما إذا كان يجب على الآباء مراقبة الأطفال من خلال الوصول إلى نصائح الذكاء الاصطناعي. قال أوسترماير إنه على الرغم من أن دراسة ChatGPT لا تتناول الأطفال ولم تشمل أي شخص أقل من 18 عامًا ، فإنه يعتقد أنه من الآمن افتراض أن الأطفال أقل استقرارًا من الناحية الأخلاقية من البالغين وبالتالي أكثر عرضة للنصائح الأخلاقية (أو غير الأخلاقية) من ChatGPT.

قال: "وجدنا أن استخدام ChatGPT ينطوي على مخاطر ، ولن نسمح لأطفالنا باستخدامه دون إشراف".

استنتج أوسترماير وزملاؤه في ورقتهم البحثية أن طرق التخفيف من ضرر الذكاء الاصطناعي مثل الشفافية وحظر الأسئلة الضارة قد لا تكون كافية نظرًا لقدرة ChatGPT على التأثير. يجادلون بضرورة القيام بالمزيد من العمل لتعزيز المعرفة الرقمية بشأن الطبيعة غير المعصومة لبرامج الدردشة الآلية ، لذلك يكون الناس أقل ميلًا لقبول نصائح الذكاء الاصطناعي - وهذا يعتمد على البحث الماضي مما يوحي بأن الناس لا يثقون في أنظمة الخوارزميات عندما يشهدون أخطاء.

قال أوسترماير: "نعتقد أنه يمكن للمستخدمين الاستفادة بشكل أفضل من ChatGPT إذا فهموا أنه ليس لديه قناعات أخلاقية". "هذا تخمين نفكر في اختباره للمضي قدمًا."

ريج يحسب أنه إذا كنت تثق في الروبوت ، أو تفترض أن هناك أي ذكاء حقيقي أو وعي ذاتي وراءه ، فلا تفعل ذلك. ®

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- بلاتوبلوكشين. Web3 Metaverse Intelligence. تضخيم المعرفة. الوصول هنا.

- المصدر https://go.theregister.com/feed/www.theregister.com/2023/01/20/chatgpt_morally_corrupting/

- 202

- 7

- 9

- a

- القدرة

- من نحن

- استمر

- مقبول

- الوصول

- المحاسبة

- اكشن

- العنوان

- الكبار

- تقدم

- نصيحة

- المستشار

- محام

- تؤثر

- التابعة

- بعد

- ضد

- AI

- AI-بالطاقة

- اليكسا

- خوارزمية

- الكل

- سابقا

- و

- إجابة

- الأجوبة

- أي شخص

- تجادل

- يجادل

- الحجج

- فنـون

- محام

- السلطة

- وعي

- على أساس

- وراء

- يجري

- اعتقد

- يعتقد

- أفضل

- حجب

- أحذية طويلة

- BRIDGE

- الطاقة الإنتاجية

- تحدي

- chatbot

- chatbots

- شات جي بي تي

- أطفال

- واضح

- الزملاء

- تأتي

- تجاري

- عادة

- مقارنة

- بوصلة

- قلق

- يخلص

- تخمين

- الإتصال

- نظر

- محتوى

- تحادثي

- التكلفة

- الدورة

- حاليا

- دال

- القرار

- اتخاذ القرار

- عميق

- التعلم العميق

- الطلب

- الدنمارك

- اعتمادا

- التطوير التجاري

- فعل

- الخلافات

- التوزيع

- رقمي

- رقميا

- وزعت

- لا

- فعل

- لا

- إلى أسفل

- تأثير

- إما

- البريد الإلكتروني

- كاف

- إلخ

- أخلاقي

- حتى

- تجربة

- شرح

- ويوضح

- مألوف

- مالي

- العثور على

- الاسم الأول

- تقلب

- النموذج المرفق

- إلى الأمام

- وجدت

- تبدأ من

- التمويل

- إضافي

- مستقبل

- ولدت

- مولد كهربائي

- ألمانيا

- دولار فقط واحصل على خصم XNUMX% على جميع

- معطى

- يعطي

- شراء مراجعات جوجل

- Google بحث

- الضارة

- التحوط

- نأمل

- كيفية

- لكن

- HTTPS

- الانسان

- عديم الاخلاق

- آثار

- in

- ميال إلى

- تتضمن

- في ازدياد

- تأثير

- المؤسسات

- رؤيتنا

- مصلحة

- IT

- تكرير

- اطفال

- قتل

- علم

- معروف

- مختبر

- وصفها

- عمل

- نقص

- لغة

- آخر

- قيادة

- تعلم

- على الأرجح

- محو الأُميّة

- مثقف

- الكثير

- أغلبية

- جعل

- يصنع

- القيام ب

- مانع

- الأخطاء

- عدم ثقة

- نموذج

- عارضات ازياء

- مراقبة

- الأكثر من ذلك

- يتحرك

- الطبيعة

- سلبي

- نوفمبر

- عدد

- واضح

- عرض

- ONE

- OpenAI

- أخرى

- ورق

- الآباء

- المشاركون

- خاص

- مجتمع

- ربما

- إذن

- شخص

- الشخصية

- خطة

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- البوينت

- الرائج

- ان يرتفع المركز

- سابق لأوانه

- قدم

- في المقام الأول

- المشكلة

- مشاكل

- البروفيسور

- المقترح

- جمهور

- دفع

- سؤال

- الأسئلة المتكررة

- رفع

- عشوائية

- العشوائية

- حقيقي

- مؤخرا

- المعترف بها

- نوصي

- ريج

- بغض النظر

- صدر

- مطلوب

- بحث

- الباحثين

- سكان

- استجابة

- عائدات

- المخاطر

- طرق

- تضحية

- التضحية

- خزنة

- قال

- نفسه

- حفظ

- بحث

- الثاني

- طلب

- طقم

- عدة

- ينبغي

- إظهار

- جانب

- So

- العدالة

- الآثار الاجتماعية

- تطبيقات الكمبيوتر

- بعض

- مصدر

- مصادر

- جنوبي

- مستقر

- معيار

- لا يزال

- قلة النوم

- غريب

- دراسة

- هذه

- إشراف

- تزويد

- الدعم

- الدراسة الاستقصائية

- عرضة

- مفاتيح

- نظام

- أنظمة

- حديث

- تجربه بالعربي

- الاختبار

- •

- المصدر

- من مشاركة

- إلى

- جدا

- مسار

- قادة الإيمان

- النص الكامل

- الشفافية

- صحيح

- الثقة

- مع

- فهم

- جامعة

- us

- تستخدم

- المستخدمين

- Ve

- بواسطة

- يحذر

- المواقع

- ابحث عن

- سواء

- التي

- في حين

- من الذى

- سوف

- استعداد

- حكمة

- بدون

- الشاهد

- للعمل

- سوف

- جاري الكتابة

- أنت

- حل متجر العقارات الشامل الخاص بك في جورجيا

- زفيرنت