- ٣ فبراير ٢٠٢٤

- فاسيليس فرينيوتيس

- . 5 تعليقات

في تصنيف النص ، فإن اختيار الميزة هو عملية اختيار مجموعة فرعية معينة من شروط مجموعة التدريب واستخدامها فقط في خوارزمية التصنيف. تتم عملية اختيار الميزة قبل تدريب المصنف.

تحديث: أصبح Datumbox Machine Learning Framework مفتوح المصدر ومجانيًا الآن بإمكانك تحميله. تحقق من اختيار الحزمة com.datumbox.framework.machinelearning.features لمعرفة تنفيذ طرق Chi-square و Mutual Information Feature Selection في Java.

تتمثل المزايا الرئيسية لاستخدام خوارزميات اختيار الميزات في الحقائق التي تقلل من أبعاد بياناتنا ، وتجعل التدريب أسرع ويمكن أن تحسن الدقة عن طريق إزالة الميزات الصاخبة. ونتيجة لذلك ، يمكن أن يساعدنا اختيار الميزة على تجنب فرط التجهيز.

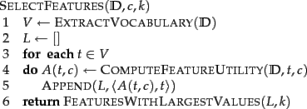

يتم عرض خوارزمية الاختيار الأساسية لاختيار أفضل الميزات أدناه (مانينغ وآخرون ، 2008):

في الأقسام التالية نقدم خوارزميتين مختلفتين لاختيار الميزات: المعلومات المتبادلة و Chi Square.

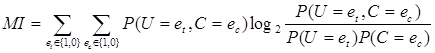

المعلومات المتبادلة

واحدة من أكثر طرق اختيار الميزات شيوعًا هي المعلومات المتبادلة للمصطلح t في الفئة c (مانينغ وآخرون ، 2008). يقيس هذا مقدار المعلومات التي يساهم بها وجود أو عدم وجود مصطلح معين في اتخاذ قرار التصنيف الصحيح بشأن c. يمكن حساب المعلومات المتبادلة باستخدام الصيغة التالية:

[1]

[1]

في حساباتنا ، نظرًا لأننا نستخدم تقديرات الاحتمالية القصوى للاحتمالات ، يمكننا استخدام المعادلة التالية:

![]() [2]

[2]

حيث N هو العدد الإجمالي للمستندات ، Ntcهي عدد الوثائق التي لها القيم هt (حدوث المصطلح t في المستند ؛ يأخذ القيمة 1 أو 0) و ec(حدوث المستند في الفئة c ؛ يأخذ القيمة 1 أو 0) التي يشار إليها برقمين ، ![]() و

و ![]() . أخيرًا ، يجب أن نلاحظ أن جميع المتغيرات المذكورة أعلاه تأخذ قيمًا غير سالبة.

. أخيرًا ، يجب أن نلاحظ أن جميع المتغيرات المذكورة أعلاه تأخذ قيمًا غير سالبة.

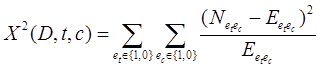

ساحة تشي

طريقة أخرى شائعة لاختيار الميزة هي ساحة تشي. x2 يستخدم الاختبار في الإحصاء ، من بين أشياء أخرى ، لاختبار استقلالية حدثين. بشكل أكثر تحديدًا في اختيار الميزات ، نستخدمها لاختبار ما إذا كان حدوث مصطلح معين وحدوث فئة معينة مستقلان. وبالتالي فإننا نقدر الكمية التالية لكل مصطلح ونقوم بترتيبها حسب درجاتها:

[3]

[3]

درجات عالية في x2 تشير إلى أن الفرضية الصفرية (H0) الاستقلال يجب رفضه وبالتالي فإن حدوث المصطلح والطبقة يعتمدان. إذا كانوا تابعين ، فنحن نختار ميزة تصنيف النص.

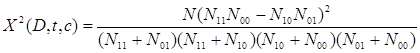

يمكن إعادة كتابة الصيغة أعلاه على النحو التالي:

[4]

[4]

إذا استخدمنا طريقة Chi Square ، فيجب أن نختار فقط عددًا محددًا مسبقًا من الميزات ذات الفأس2 نتيجة الاختبار أكبر من 10.83 مما يدل على دلالة إحصائية عند مستوى 0.001.

أخيرًا وليس آخرًا ، يجب أن نلاحظ أنه من الناحية الإحصائية ، فإن اختيار ميزة Chi Square غير دقيق ، بسبب درجة واحدة من الحرية و تصحيح ييتس يجب استخدامها بدلاً من ذلك (مما سيجعل من الصعب الوصول إلى الأهمية الإحصائية). وبالتالي ، يجب أن نتوقع أنه من إجمالي الميزات المحددة ، يكون جزء صغير منها مستقلًا عن الفصل). وبالتالي ، يجب أن نتوقع أنه من إجمالي الميزات المحددة ، يكون جزء صغير منها مستقلًا عن الفصل. ومع ذلك مانينغ وآخرون (2008) أظهرت ، أن هذه الميزات الصاخبة لا تؤثر بشكل خطير على الدقة الكلية لمصنفنا.

إزالة السمات الصاخبة / النادرة

هناك طريقة أخرى يمكن أن تساعدنا في تجنب الإفراط في التجهيز وتقليل استهلاك الذاكرة وتحسين السرعة ، وهي إزالة جميع المصطلحات النادرة من المفردات. على سبيل المثال ، يمكن حذف جميع المصطلحات التي حدثت مرة واحدة فقط عبر جميع الفئات. يمكن أن تؤدي إزالة هذه المصطلحات إلى تقليل استخدام الذاكرة بعامل مهم وتحسين سرعة التحليل. أخيرًا ، لا ينبغي استخدام هذه التقنية بالاقتران مع خوارزميات اختيار الميزة أعلاه.

هل أعجبك المقال؟ يرجى قضاء دقيقة لمشاركتها على تويتر. 🙂

- AI

- ai الفن

- مولد الفن ai

- الروبوت ai

- الذكاء الاصطناعي

- شهادة الذكاء الاصطناعي

- روبوت ذكاء اصطناعي

- روبوتات الذكاء الاصطناعي

- برنامج ذكاء اصطناعي

- سلسلة كتلة

- مؤتمر blockchain ai

- عملة عبقرية

- الذكاء الاصطناعي للمحادثة

- مؤتمر التشفير ai

- دال

- داتومبوكس

- التعلم العميق

- google ai

- آلة التعلم

- تعلم الآلة والإحصاء

- أفلاطون

- أفلاطون ع

- الذكاء افلاطون البيانات

- لعبة أفلاطون

- أفلاطون داتا

- بلاتوغمينغ

- مقياس ai

- بناء الجملة

- زفيرنت