অ্যামাজন ইলাস্টিক কম্পিউট ক্লাউড (আমাজন ইসি 2) G5 উদাহরণ ক্লাউডে NVIDIA A10G টেনসর কোর জিপিইউ বৈশিষ্ট্যের প্রথম এবং একমাত্র দৃষ্টান্ত যা আপনি গ্রাফিক্স-ইনটেনসিভ এবং মেশিন লার্নিং (ML) ব্যবহারের ক্ষেত্রে বিস্তৃত পরিসরের জন্য ব্যবহার করতে পারেন। G5 দৃষ্টান্তের সাথে, ML গ্রাহকরা প্রাকৃতিক ভাষা প্রক্রিয়াকরণ (NLP), কম্পিউটার ভিশন (CV) এবং সুপারিশকারী ইঞ্জিন ব্যবহারের ক্ষেত্রে প্রশিক্ষিত এবং আরও বৃহত্তর এবং আরও পরিশীলিত মডেলগুলিকে প্রশিক্ষিত করার জন্য উচ্চ কার্যক্ষমতা এবং একটি ব্যয়-দক্ষ অবকাঠামো পান।

এই পোস্টের উদ্দেশ্য হল বড় আকারের এমএল ইনফারেন্স ওয়ার্কলোডের জন্য G5 দৃষ্টান্তগুলির কার্যকারিতা সুবিধাগুলি প্রদর্শন করা। আমরা G4dn দৃষ্টান্তগুলির সাথে NLP এবং CV মডেলগুলির জন্য মূল্য-কর্মক্ষমতা ($ প্রতি মিলিয়ন অনুমান হিসাবে পরিমাপ করা) তুলনা করে এটি করি। আমরা আমাদের বেঞ্চমার্কিং পদ্ধতির বর্ণনা দিয়ে শুরু করি এবং তারপর ব্যাচের আকার এবং ডেটা টাইপ নির্ভুলতা জুড়ে থ্রুপুট বনাম লেটেন্সি কার্ভ উপস্থাপন করি। G4dn দৃষ্টান্তের তুলনায়, আমরা দেখতে পাই যে G5 দৃষ্টান্তগুলি উচ্চতর থ্রুপুট এবং কম লেটেন্সি অর্জন করার সময় এনএলপি এবং সিভি মডেলগুলির জন্য সম্পূর্ণ নির্ভুলতা এবং মিশ্র নির্ভুলতা মোড উভয়ের জন্য প্রতি মিলিয়ন অনুমানের জন্য ধারাবাহিকভাবে কম খরচ প্রদান করে।

বেঞ্চমার্কিং পদ্ধতি

G5 এবং G4dn-এর মধ্যে একটি মূল্য-পারফরম্যান্স স্টাডি বিকাশ করতে, ব্যাচ আকারের একটি ফাংশন হিসাবে আমাদের থ্রুপুট, লেটেন্সি এবং প্রতি মিলিয়ন ইনফারেন্সের খরচ পরিমাপ করতে হবে। আমরা সম্পূর্ণ নির্ভুলতা বনাম মিশ্র নির্ভুলতার প্রভাবও অধ্যয়ন করি। মডেল গ্রাফ এবং ইনপুট উভয়ই অনুমান করার আগে CUDA-তে লোড করা হয়।

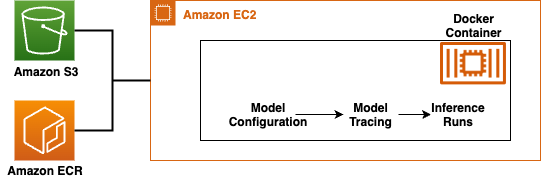

নিম্নলিখিত আর্কিটেকচার ডায়াগ্রামে দেখানো হয়েছে, আমরা প্রথমে অন্তর্নিহিত EC2 দৃষ্টান্তের (G4dn, G5) জন্য CUDA-এর সাথে সংশ্লিষ্ট বেস কন্টেইনার ইমেজ তৈরি করি। বেস কন্টেইনার ইমেজ তৈরি করতে, আমরা শুরু করি AWS ডিপ লার্নিং কন্টেইনার, যা মিনিটের মধ্যে গভীর শিক্ষার পরিবেশ স্থাপন করতে পূর্ব-প্যাকেজড ডকার চিত্রগুলি ব্যবহার করে। ছবিতে প্রয়োজনীয় ডিপ লার্নিং পাইটর্চ লাইব্রেরি এবং টুল রয়েছে। মনিটরিং, কমপ্লায়েন্স এবং ডেটা প্রসেসিং এর উপর উচ্চ মাত্রার নিয়ন্ত্রণের জন্য আপনি এই চিত্রগুলির উপরে আপনার নিজস্ব লাইব্রেরি এবং সরঞ্জামগুলি যোগ করতে পারেন।

তারপরে আমরা একটি মডেল-নির্দিষ্ট কন্টেইনার ইমেজ তৈরি করি যা মডেল কনফিগারেশন, মডেল ট্রেসিং এবং ফরওয়ার্ড পাস চালানোর জন্য সম্পর্কিত কোডগুলিকে এনক্যাপসুলেট করে। সমস্ত ধারক ইমেজ মধ্যে লোড করা হয় আমাজন ইসিআর বিভিন্ন মডেল কনফিগারেশনের জন্য এই মডেলগুলির অনুভূমিক স্কেলিং করার অনুমতি দিতে। আমরা ব্যাবহার করি আমাজন সিম্পল স্টোরেজ সার্ভিস (Amazon S3) কনফিগারেশন ডাউনলোড করতে এবং সারসংক্ষেপের জন্য বেঞ্চমার্ক ফলাফল আপলোড করার জন্য একটি সাধারণ ডেটা স্টোর হিসাবে। আপনি এই আর্কিটেকচারটি বেঞ্চমার্ক ফলাফলগুলি পুনরায় তৈরি এবং পুনরুত্পাদন করতে ব্যবহার করতে পারেন এবং EC2 দৃষ্টান্তের ধরন (CPU, GPU, Inf1) জুড়ে বিভিন্ন মডেল প্রকারের (যেমন Hugging Face মডেল, PyTorch মডেল, অন্যান্য কাস্টম মডেল) বেঞ্চমার্কের জন্য পুনরায় উদ্দেশ্য করতে পারেন।

এই পরীক্ষাটি সেট আপ করার সাথে সাথে, আমাদের লক্ষ্য হল থ্রুপুটের একটি ফাংশন হিসাবে লেটেন্সি অধ্যয়ন করা। লক্ষ্য অ্যাপ্লিকেশনের জন্য একটি ব্যয়-অনুকূল পরিকাঠামোতে পৌঁছানোর জন্য অ্যাপ্লিকেশন ডিজাইনের জন্য এই বক্ররেখা গুরুত্বপূর্ণ। এটি অর্জন করতে, আমরা একাধিক থ্রেড থেকে প্রশ্ন সারিবদ্ধ করে এবং তারপর প্রতিটি সম্পূর্ণ অনুরোধের জন্য রাউন্ড-ট্রিপ সময় পরিমাপ করে বিভিন্ন লোড অনুকরণ করি। থ্রুপুট পরিমাপ করা হয় প্রতি ইউনিট ঘড়ির সময় সম্পন্ন করা অনুরোধের সংখ্যার উপর ভিত্তি করে। অধিকন্তু, আপনি ব্যাচের আকার এবং অন্যান্য ভেরিয়েবল যেমন সিকোয়েন্স দৈর্ঘ্য এবং সম্পূর্ণ নির্ভুলতা বনাম অর্ধ নির্ভুলতা পরিবর্তিত করতে পারেন নির্দেশক কর্মক্ষমতা মেট্রিক্সে পৌঁছানোর জন্য ডিজাইনের স্থানটি ব্যাপকভাবে সুইপ করতে। আমাদের গবেষণায়, ব্যাচের আকারের প্যারামেট্রিক সুইপ এবং মাল্টি-থ্রেডেড ক্লায়েন্টদের প্রশ্নের মাধ্যমে, থ্রুপুট বনাম লেটেন্সি বক্ররেখা নির্ধারণ করা হয়। এক্সিলারেটরের সম্পূর্ণ ব্যবহার নিশ্চিত করার জন্য প্রতিটি অনুরোধ ব্যাচ করা যেতে পারে, বিশেষ করে ছোট অনুরোধের জন্য যা সম্পূর্ণরূপে গণনা নোড ব্যবহার করতে পারে না। আপনি সর্বোত্তম কর্মক্ষমতা জন্য ক্লায়েন্ট-সাইড ব্যাচ আকার সনাক্ত করতে এই সেটআপ গ্রহণ করতে পারেন।

সংক্ষেপে, আমরা এই সমস্যাটিকে গাণিতিকভাবে উপস্থাপন করতে পারি: (থ্রুপুট, লেটেন্সি) = ফাংশন এর (ব্যাচের আকার, থ্রেডের সংখ্যা, যথার্থতা)।

এর মানে, সম্পূর্ণ স্থান দেওয়া, পরীক্ষার সংখ্যা বড় হতে পারে। ভাগ্যক্রমে, প্রতিটি পরীক্ষা স্বাধীনভাবে চালানো যেতে পারে। আমরা ব্যবহার করার পরামর্শ দিই AWS ব্যাচ পরীক্ষার জন্য একটি রৈখিক পদ্ধতির তুলনায় বেঞ্চমার্কিং খরচ বৃদ্ধি না করে সংকুচিত সময়ে এই অনুভূমিকভাবে স্কেল করা বেঞ্চমার্কিং সম্পাদন করতে। ফলাফল প্রতিলিপি জন্য কোড উপস্থিত আছে GitHub সংগ্রহস্থল AWS Re:Invent 2021-এর জন্য প্রস্তুত। বিভিন্ন এক্সিলারেটরের বেঞ্চমার্কিং করার জন্য ভান্ডারটি ব্যাপক। আপনি কন্টেইনার তৈরি করতে কোডের GPU দিকটি উল্লেখ করতে পারেন (Dockerfile-gpu) এবং তারপর ভিতরে কোড পড়ুন Container-Root BERT এবং ResNet50 এর জন্য নির্দিষ্ট উদাহরণের জন্য।

আমরা দুটি মডেলের ধরন জুড়ে কর্মক্ষমতা অধ্যয়ন বিকাশের জন্য পূর্ববর্তী পদ্ধতি ব্যবহার করেছি: বার্ট-বেস-আনকেসড (110 মিলিয়ন প্যারামিটার, NLP) এবং ResNet50 (25.6 মিলিয়ন প্যারামিটার, CV)। নিম্নলিখিত সারণী মডেলের বিবরণ সংক্ষিপ্ত করে।

| মডেল প্রকার | মডেল | বিস্তারিত |

| NLP | twmkn9/bert-base-uncased-squad2 | 110 মিলিয়ন প্যারামিটার ক্রম দৈর্ঘ্য = 128 |

| CV | ResNet50 | 25.6 মিলিয়ন প্যারামিটার |

উপরন্তু, ডেটা টাইপ জুড়ে বেঞ্চমার্ক করতে (পূর্ণ, অর্ধেক নির্ভুলতা), আমরা ব্যবহার করি torch.cuda.amp, যা মিশ্র নির্ভুলতা পরিচালনা করার জন্য সুবিধাজনক পদ্ধতি প্রদান করে যেখানে কিছু অপারেশন ব্যবহার করে torch.float32 (ফ্লোট) ডেটা টাইপ এবং অন্যান্য অপারেশন ব্যবহার torch.float16 (অর্ধেক)। উদাহরণস্বরূপ, রৈখিক স্তর এবং কনভোলিউশনের মতো অপারেটরগুলি ফ্লোট16 এর সাথে অনেক দ্রুত হয়, যেখানে অন্যান্য হ্রাসের মতো প্রায়শই ফ্লোট32 এর গতিশীল পরিসরের প্রয়োজন হয়। স্বয়ংক্রিয় মিশ্র নির্ভুলতা নেটওয়ার্কের রানটাইম এবং মেমরি ফুটপ্রিন্ট অপ্টিমাইজ করার জন্য প্রতিটি অপারেটরকে তার উপযুক্ত ডেটা টাইপের সাথে মেলানোর চেষ্টা করে।

বেঞ্চমার্কিং ফলাফল

একটি ন্যায্য তুলনা জন্য, আমরা নির্বাচন G4dn.4x বড় এবং G5.4x বড় নিম্নলিখিত সারণীতে তালিকাভুক্ত অনুরূপ বৈশিষ্ট্য সহ দৃষ্টান্ত।

| দৃষ্টান্ত | জিপিইউ | GPU মেমরি (GiB) | vCPUs | মেমরি (GiB) | ইনস্ট্যান্স স্টোরেজ (GB) | নেটওয়ার্ক কর্মক্ষমতা (Gbps) | EBS ব্যান্ডউইথ (Gbps) | লিনাক্স অন-ডিমান্ড প্রাইসিং (ইউএস-ইস্ট-1) |

| G5.4x বড় | 1 | 24 | 16 | 64 | 1x 600 NVMe SSD | 25 পর্যন্ত | 8 | $ 1.204 / ঘন্টা |

| G4dn.4x বড় | 1 | 16 | 16 | 64 | 1x 225 NVMe SSD | 25 পর্যন্ত | 4.75 | $ 1.624 / ঘন্টা |

নিম্নলিখিত বিভাগগুলিতে, আমরা BERT এবং RESNET50 মডেলগুলির ML অনুমান কর্মক্ষমতা তুলনা করি একটি গ্রিড সুইপ পদ্ধতির সাথে নির্দিষ্ট ব্যাচের আকার (32, 16, 8, 4, 1) এবং থ্রুপুটে পৌঁছানোর জন্য ডেটা টাইপ নির্ভুলতা (পূর্ণ এবং অর্ধেক নির্ভুলতা)। বনাম লেটেন্সি কার্ভ। উপরন্তু, আমরা সম্পূর্ণ এবং অর্ধেক নির্ভুলতার জন্য থ্রুপুট বনাম ব্যাচ আকারের প্রভাব তদন্ত করি। পরিশেষে, ব্যাচ আকারের একটি ফাংশন হিসাবে আমরা প্রতি মিলিয়ন অনুমানের খরচ পরিমাপ করি। এই পরীক্ষাগুলি জুড়ে একত্রিত ফলাফল এই পোস্টে পরে সংক্ষিপ্ত করা হয়েছে।

থ্রুপুট বনাম লেটেন্সি

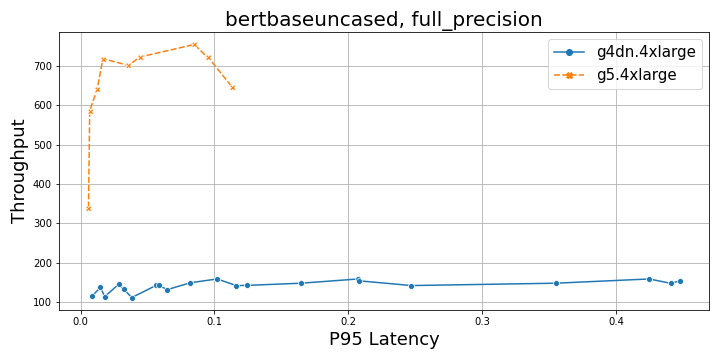

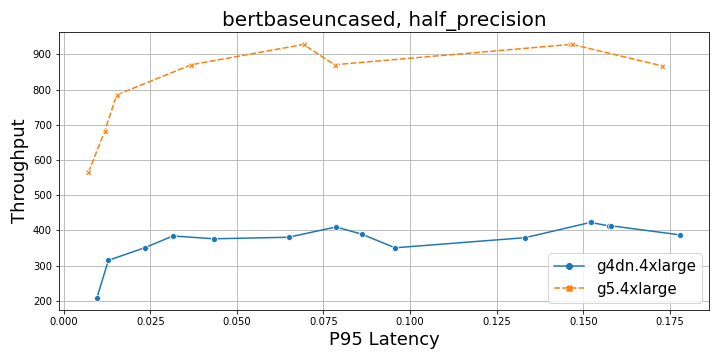

নিম্নলিখিত পরিসংখ্যানগুলি সম্পূর্ণ এবং অর্ধেক নির্ভুলতায় NLP এবং CV কাজের চাপের জন্য G4dn এবং G5 উদাহরণগুলির তুলনা করে। G4dn দৃষ্টান্তের তুলনায়, G5 দৃষ্টান্ত একটি BERT বেস মডেলের জন্য প্রায় পাঁচ গুণ বেশি (সম্পূর্ণ নির্ভুলতা) এবং প্রায় 2.5 গুণ বেশি (অর্ধ নির্ভুলতা) এবং ResNet2 মডেলের জন্য প্রায় 2.5-50 গুণ বেশি থ্রুপুট প্রদান করে। সামগ্রিকভাবে, G5 হল একটি পছন্দের পছন্দ, পারফরম্যান্সের দৃষ্টিকোণ থেকে সম্পূর্ণ এবং মিশ্র নির্ভুলতার জন্য উভয় মডেলের জন্য ব্যাচের আকার বৃদ্ধি করা।

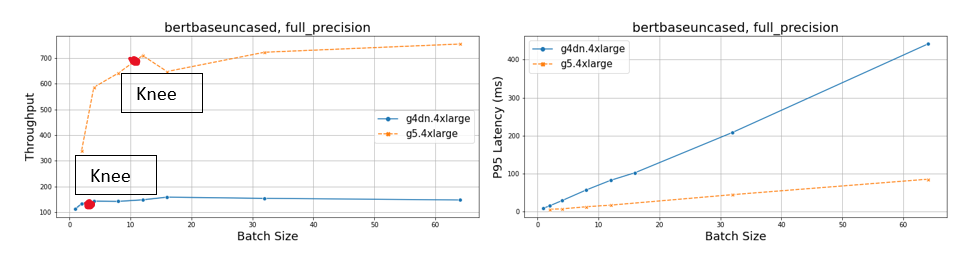

নিম্নলিখিত গ্রাফগুলি BERT-এর জন্য সম্পূর্ণ এবং অর্ধেক নির্ভুলতায় থ্রুপুট এবং P95 লেটেন্সি তুলনা করে।

|

|

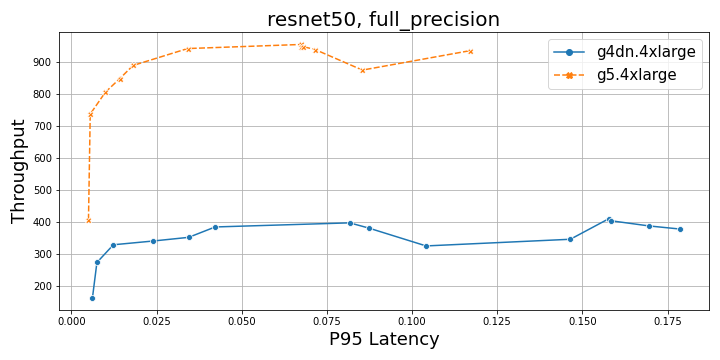

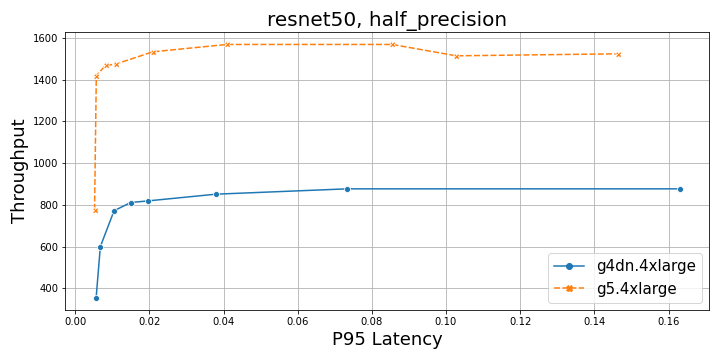

নিম্নলিখিত গ্রাফগুলি ResNet95 এর জন্য সম্পূর্ণ এবং অর্ধেক নির্ভুলতায় থ্রুপুট এবং P50 লেটেন্সি তুলনা করে।

|

|

থ্রুপুট এবং লেটেন্সি বনাম ব্যাচ সাইজ

নিম্নলিখিত গ্রাফগুলি ব্যাচ আকারের একটি ফাংশন হিসাবে থ্রুপুট দেখায়। কম ব্যাচের আকারে, অ্যাক্সিলারেটর তার পূর্ণ ক্ষমতায় কাজ করছে না এবং ব্যাচের আকার বাড়ার সাথে সাথে লেটেন্সি খরচে থ্রুপুট বাড়ানো হয়। থ্রুপুট বক্ররেখা একটি সর্বাধিক মান যা অ্যাক্সিলারেটরের কার্যকারিতার একটি ফাংশন অ্যাসিম্পটোট করে। বক্ররেখার দুটি স্বতন্ত্র বৈশিষ্ট্য রয়েছে: একটি ক্রমবর্ধমান অংশ এবং একটি সমতল অ্যাসিম্পটোটিক বিভাগ। একটি প্রদত্ত মডেলের জন্য, একটি পারফরম্যান্ট অ্যাক্সিলারেটর (G5) উচ্চতর থ্রুপুটে G4dn এবং অ্যাসিম্পটোট থেকে উচ্চতর ব্যাচের আকারে ক্রমবর্ধমান অংশকে প্রসারিত করতে সক্ষম। এছাড়াও, লেটেন্সি এবং ব্যাচের আকারের মধ্যে একটি লিনিয়ার ট্রেড-অফ রয়েছে। অতএব, যদি অ্যাপ্লিকেশনটি লেটেন্সি বাউন্ড হয়, তাহলে আমরা সর্বোত্তম ব্যাচের আকার নির্ধারণ করতে P95 লেটেন্সি বনাম ব্যাচের আকার ব্যবহার করতে পারি। যাইহোক, যদি উদ্দেশ্যটি হয় সর্বনিম্ন লেটেন্সিতে থ্রুপুট সর্বাধিক করা, তাহলে রাইজিং এবং অ্যাসিম্পোটিক বিভাগগুলির মধ্যে "হাঁটু" এর সাথে সঙ্গতিপূর্ণ ব্যাচের আকার নির্বাচন করা ভাল, কারণ ব্যাচের আকারে আরও বৃদ্ধির ফলে একই থ্রুপুট হবে খারাপ বিলম্ব সর্বোত্তম মূল্য-কর্মক্ষমতা অনুপাত অর্জন করতে, সর্বনিম্ন বিলম্বে উচ্চতর থ্রুপুট লক্ষ্য করে, আপনি কেবল ব্যাচের আকার বাড়ানোর পরিবর্তে একাধিক অনুমান সার্ভারের মাধ্যমে এই সর্বোত্তমটি অনুভূমিকভাবে স্কেল করা ভাল।

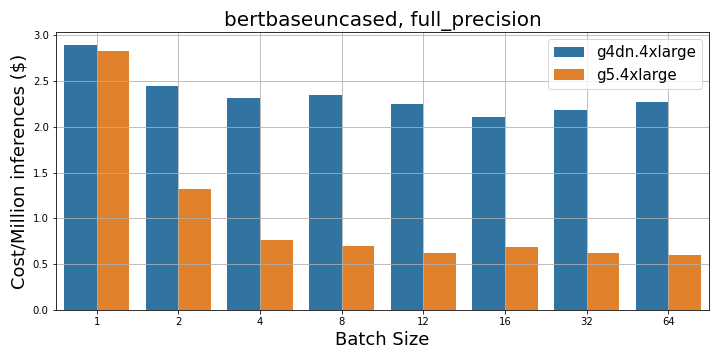

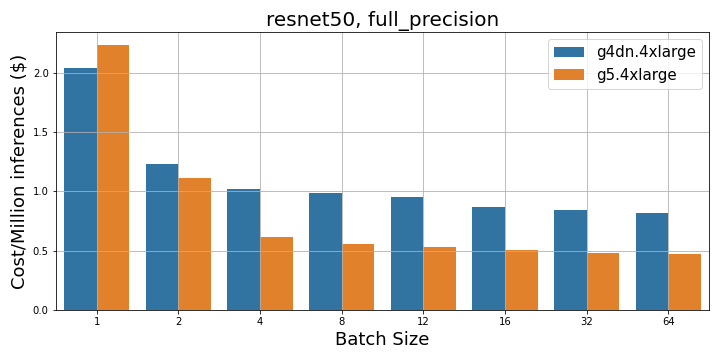

খরচ বনাম ব্যাচ আকার

এই বিভাগে, আমরা ব্যাচের আকার বনাম অনুমান খরচের ($ প্রতি মিলিয়ন অনুমান) তুলনামূলক ফলাফল উপস্থাপন করি। নিম্নলিখিত চিত্র থেকে, আমরা স্পষ্টভাবে লক্ষ্য করতে পারি যে খরচ ($ প্রতি মিলিয়ন অনুমানের হিসাবে পরিমাপ করা) ধারাবাহিকভাবে G5 বনাম G4dn উভয়ের সাথে কম (পূর্ণ এবং অর্ধেক নির্ভুলতা)।

|

|

নিম্নলিখিত সারণীটি নির্দিষ্ট ব্যাচের আকারের জন্য উভয় নির্ভুলতা মোড জুড়ে BERT এবং RESNET50 মডেলগুলির জন্য থ্রুপুট, লেটেন্সি, এবং খরচ ($ প্রতি মিলিয়ন অনুমান) তুলনা সংক্ষিপ্ত করে। দৃষ্টান্ত প্রতি উচ্চ খরচ হওয়া সত্ত্বেও, সমস্ত ব্যাচের আকারের জন্য অনুমানের লেটেন্সি, থ্রুপুট এবং খরচ ($ প্রতি মিলিয়ন অনুমান) এর সমস্ত দিক জুড়ে G5 ধারাবাহিকভাবে G4dn-কে ছাড়িয়ে যায়। বিভিন্ন মেট্রিক্সকে একটি খরচে ($ প্রতি মিলিয়ন অনুমান), BERT মডেল (32 ব্যাচের আকার, সম্পূর্ণ নির্ভুলতা) G5 এর সাথে মিলিয়ে G3.7dn এর চেয়ে 4 গুণ বেশি অনুকূল, এবং ResNet50 মডেলের সাথে (32 ব্যাচের আকার, সম্পূর্ণ নির্ভুলতা), এটি 1.6। G4dn এর চেয়ে গুণ বেশি অনুকূল।

| মডেল | ব্যাচ আকার | স্পষ্টতা |

থ্রুপুট (ব্যাচ আকার X অনুরোধ/সেকেন্ড) |

Latency (ms) |

$/ মিলিয়ন অনুমান (অন-ডিমান্ড) |

খরচের সুবিধা (G5 ওভার G4dn) |

|||

| . | . | . | G5 | G4dn | G5 | G4dn | G5 | G4dn | |

| বার্ট-বেস-আনকেসড | 32 | পূর্ণ | 723 | 154 | 44 | 208 | $0.6 | $2.2 | 3.7X |

| মিশ্র | 870 | 410 | 37 | 79 | $0.5 | $0.8 | 1.6X | ||

| 16 | পূর্ণ | 651 | 158 | 25 | 102 | $0.7 | $2.1 | 3.0X | |

| মিশ্র | 762 | 376 | 21 | 43 | $0.6 | $0.9 | 1.5X | ||

| 8 | পূর্ণ | 642 | 142 | 13 | 57 | $0.7 | $2.3 | 3.3X | |

| মিশ্র | 681 | 350 | 12 | 23 | $0.7 | $1.0 | 1.4X | ||

| . | 1 | পূর্ণ | 160 | 116 | 6 | 9 | $2.8 | $2.9 | 1.0X |

| মিশ্র | 137 | 102 | 7 | 10 | $3.3 | $3.3 | 1.0X | ||

| ResNet50 | 32 | পূর্ণ | 941 | 397 | 34 | 82 | $0.5 | $0.8 | 1.6X |

| মিশ্র | 1533 | 851 | 21 | 38 | $0.3 | $0.4 | 1.3X | ||

| 16 | পূর্ণ | 888 | 384 | 18 | 42 | $0.5 | $0.9 | 1.8X | |

| মিশ্র | 1474 | 819 | 11 | 20 | $0.3 | $0.4 | 1.3X | ||

| 8 | পূর্ণ | 805 | 340 | 10 | 24 | $0.6 | $1.0 | 1.7X | |

| মিশ্র | 1419 | 772 | 6 | 10 | $0.3 | $0.4 | 1.3X | ||

| . | 1 | পূর্ণ | 202 | 164 | 5 | 6 | $2.2 | $2 | 0.9X |

| মিশ্র | 196 | 180 | 5 | 6 | $2.3 | $1.9 | 0.8X | ||

অতিরিক্ত অনুমান বেঞ্চমার্ক

পূর্ববর্তী বিভাগে BERT বেস এবং ResNet50 ফলাফল ছাড়াও, আমরা PyTorch-এ অন্যান্য সাধারণভাবে ব্যবহৃত বড় NLP এবং CV মডেলগুলির জন্য অতিরিক্ত বেঞ্চমার্কিং ফলাফল উপস্থাপন করি। G5dn-এর উপর G4-এর পারফরম্যান্স বেনিফিট বিভিন্ন নির্ভুলতায় BERT বড় মডেলের জন্য এবং বিভিন্ন আকারের জন্য Yolo-v5 মডেলের জন্য উপস্থাপন করা হয়েছে। বেঞ্চমার্কের প্রতিলিপি করার জন্য কোডের জন্য, পড়ুন টেনসর কোরের জন্য NVIDIA গভীর শিক্ষার উদাহরণ. এই ফলাফলগুলি বিভিন্ন ধরণের মডেলের বিস্তৃত অনুমান কার্যগুলির জন্য G5dn এর উপর G4 ব্যবহার করার সুবিধা দেখায়।

| মডেল | স্পষ্টতা | ব্যাচ আকার | ক্রম দৈর্ঘ্য | থ্রুপুট (প্রেরিত/সেকেন্ড) | থ্রুপুট: G4dn | G4dn-এর উপরে স্পিডআপ |

| BERT- বড় | FP16 | 1 | 128 | 93.5 | 40.31 | 2.3 |

| BERT- বড় | FP16 | 4 | 128 | 264.2 | 87.4 | 3.0 |

| BERT- বড় | FP16 | 8 | 128 | 392.1 | 107.5 | 3.6 |

| BERT- বড় | FP32 | 1 | 128 | 68.4 | 22.67 | 3.0 |

| BERT- বড় | 4 | 128 | 118.5 | 32.21 | 3.7 | |

| BERT- বড় | 8 | 128 | 132.4 | 34.67 | 3.8 |

| মডেল | GFLOPS | প্যারামিটারের সংখ্যা | প্রিপ্রসেসিং (ms) | অনুমান (ms) | অনুমান (অ-সর্বোচ্চ-দমন) (NMS/ছবি) |

| YOLOv5s | 16.5 | 7.2M | 0.2 | 3.6 | 4.5 |

| YOLOv5 মি | 49.1 | 21M | 0.2 | 6.5 | 4.5 |

| YOLOv5l | 109.3 | 46M | 0.2 | 9.1 | 3.5 |

| YOLOv5x | 205.9 | 86M | 0.2 | 14.4 | 1.3 |

উপসংহার

এই পোস্টে, আমরা দেখিয়েছি যে বড় NLP এবং CV PyTorch মডেলগুলির অনুমানের জন্য, EC2 G5 দৃষ্টান্তগুলি G4dn দৃষ্টান্তগুলির তুলনায় একটি ভাল পছন্দ৷ যদিও G5 দৃষ্টান্তগুলির জন্য অন-ডিমান্ড প্রতি ঘন্টা খরচ G4dn দৃষ্টান্তগুলির চেয়ে বেশি, তবে এর উচ্চ কার্যক্ষমতা NLP এবং CV মডেলগুলির জন্য যে কোনও নির্ভুলতায় 2-5 গুণ থ্রুপুট অর্জন করতে পারে, যা প্রতি মিলিয়ন অনুমানের চেয়ে 1.5-3.5 গুণ বেশি অনুকূল করে তোলে G4dn উদাহরণ। এমনকি লেটেন্সি বাউন্ড অ্যাপ্লিকেশানগুলির জন্য, G5 NLP এবং CV মডেলগুলির জন্য G2.5dn থেকে 5-4 গুণ ভাল৷

সংক্ষেপে, AWS G5 দৃষ্টান্তগুলি পারফরম্যান্স এবং মূল্য প্রতি অনুমান দৃষ্টিকোণ থেকে আপনার অনুমানের প্রয়োজনের জন্য একটি চমৎকার পছন্দ। CUDA ফ্রেমওয়ার্কের সার্বজনীনতা এবং AWS-এ G5 ইন্সট্যান্স পুলের স্কেল এবং গভীরতা আপনাকে স্কেলে অনুমান করার অনন্য ক্ষমতা প্রদান করে।

লেখক সম্পর্কে

অঙ্কুর শ্রীবাস্তব এমএল ফ্রেমওয়ার্কস টিমের একজন সিনিয়র সলিউশন আর্কিটেক্ট। তিনি AWS-এ স্ব-পরিচালিত বিতরণ প্রশিক্ষণ এবং অনুমান সহ গ্রাহকদের সাহায্য করার দিকে মনোনিবেশ করেন। তার অভিজ্ঞতার মধ্যে রয়েছে শিল্প ভবিষ্যদ্বাণীমূলক রক্ষণাবেক্ষণ, ডিজিটাল যমজ, সম্ভাব্য নকশা অপ্টিমাইজেশন এবং রাইস ইউনিভার্সিটির মেকানিক্যাল ইঞ্জিনিয়ারিং থেকে তার ডক্টরেট অধ্যয়ন এবং ম্যাসাচুসেটস ইনস্টিটিউট অফ টেকনোলজি থেকে পোস্ট-ডক্টরাল গবেষণা সম্পন্ন করেছেন।

অঙ্কুর শ্রীবাস্তব এমএল ফ্রেমওয়ার্কস টিমের একজন সিনিয়র সলিউশন আর্কিটেক্ট। তিনি AWS-এ স্ব-পরিচালিত বিতরণ প্রশিক্ষণ এবং অনুমান সহ গ্রাহকদের সাহায্য করার দিকে মনোনিবেশ করেন। তার অভিজ্ঞতার মধ্যে রয়েছে শিল্প ভবিষ্যদ্বাণীমূলক রক্ষণাবেক্ষণ, ডিজিটাল যমজ, সম্ভাব্য নকশা অপ্টিমাইজেশন এবং রাইস ইউনিভার্সিটির মেকানিক্যাল ইঞ্জিনিয়ারিং থেকে তার ডক্টরেট অধ্যয়ন এবং ম্যাসাচুসেটস ইনস্টিটিউট অফ টেকনোলজি থেকে পোস্ট-ডক্টরাল গবেষণা সম্পন্ন করেছেন।

সুন্দর রঙ্গনাথন Amazon EC2 টিমের এমএল ফ্রেমওয়ার্কস বিজনেস ডেভেলপমেন্টের প্রধান। তিনি Amazon EKS, Amazon ECS, ইলাস্টিক ফ্যাব্রিক অ্যাডাপ্টার, AWS ব্যাচ এবং Amazon SageMaker এর মত AWS পরিষেবা জুড়ে বৃহৎ-স্কেল এমএল ওয়ার্কলোডের উপর ফোকাস করেন। তার অভিজ্ঞতার মধ্যে রয়েছে NetApp, মাইক্রোন টেকনোলজি, কোয়ালকম এবং মেন্টর গ্রাফিক্সে পণ্য ব্যবস্থাপনা এবং পণ্য উন্নয়নে নেতৃত্বের ভূমিকা।

সুন্দর রঙ্গনাথন Amazon EC2 টিমের এমএল ফ্রেমওয়ার্কস বিজনেস ডেভেলপমেন্টের প্রধান। তিনি Amazon EKS, Amazon ECS, ইলাস্টিক ফ্যাব্রিক অ্যাডাপ্টার, AWS ব্যাচ এবং Amazon SageMaker এর মত AWS পরিষেবা জুড়ে বৃহৎ-স্কেল এমএল ওয়ার্কলোডের উপর ফোকাস করেন। তার অভিজ্ঞতার মধ্যে রয়েছে NetApp, মাইক্রোন টেকনোলজি, কোয়ালকম এবং মেন্টর গ্রাফিক্সে পণ্য ব্যবস্থাপনা এবং পণ্য উন্নয়নে নেতৃত্বের ভূমিকা।

মহাদেবন বালাসুব্রমানিয়াম স্বায়ত্তশাসিত কম্পিউটিং-এর জন্য একজন প্রধান সলিউশন আর্কিটেক্ট, যার প্রায় 20 বছরের অভিজ্ঞতার সাথে পদার্থবিদ্যার গভীর শিক্ষা, বিল্ডিং, এবং স্কেলে শিল্প ব্যবস্থার জন্য ডিজিটাল টুইন স্থাপনের ক্ষেত্রে। মহাদেবন ম্যাসাচুসেটস ইনস্টিটিউট অফ টেকনোলজি থেকে মেকানিকাল ইঞ্জিনিয়ারিংয়ে পিএইচডি করেছেন এবং তার কৃতিত্বের জন্য 25টিরও বেশি পেটেন্ট এবং প্রকাশনা রয়েছে।

মহাদেবন বালাসুব্রমানিয়াম স্বায়ত্তশাসিত কম্পিউটিং-এর জন্য একজন প্রধান সলিউশন আর্কিটেক্ট, যার প্রায় 20 বছরের অভিজ্ঞতার সাথে পদার্থবিদ্যার গভীর শিক্ষা, বিল্ডিং, এবং স্কেলে শিল্প ব্যবস্থার জন্য ডিজিটাল টুইন স্থাপনের ক্ষেত্রে। মহাদেবন ম্যাসাচুসেটস ইনস্টিটিউট অফ টেকনোলজি থেকে মেকানিকাল ইঞ্জিনিয়ারিংয়ে পিএইচডি করেছেন এবং তার কৃতিত্বের জন্য 25টিরও বেশি পেটেন্ট এবং প্রকাশনা রয়েছে।

আমর রাগব AWS-এর জন্য EC2 অ্যাক্সিলারেটেড প্ল্যাটফর্মের একজন প্রধান সমাধান স্থপতি, গ্রাহকদের স্কেলে কম্পিউটেশনাল ওয়ার্কলোড চালাতে সাহায্য করার জন্য নিবেদিত৷ তার অবসর সময়ে তিনি ভ্রমণ করতে পছন্দ করেন এবং দৈনন্দিন জীবনে প্রযুক্তিকে সংহত করার নতুন উপায় খুঁজে পান।

আমর রাগব AWS-এর জন্য EC2 অ্যাক্সিলারেটেড প্ল্যাটফর্মের একজন প্রধান সমাধান স্থপতি, গ্রাহকদের স্কেলে কম্পিউটেশনাল ওয়ার্কলোড চালাতে সাহায্য করার জন্য নিবেদিত৷ তার অবসর সময়ে তিনি ভ্রমণ করতে পছন্দ করেন এবং দৈনন্দিন জীবনে প্রযুক্তিকে সংহত করার নতুন উপায় খুঁজে পান।

- উন্নত (300)

- AI

- ai শিল্প

- এআই আর্ট জেনারেটর

- আইআই রোবট

- আমাজন EC2

- কৃত্রিম বুদ্ধিমত্তা

- কৃত্রিম বুদ্ধিমত্তা সার্টিফিকেশন

- ব্যাংকিং এ কৃত্রিম বুদ্ধিমত্তা

- কৃত্রিম বুদ্ধিমত্তার রোবট

- কৃত্রিম বুদ্ধিমত্তার রোবট

- কৃত্রিম বুদ্ধিমত্তা সফ্টওয়্যার

- এডাব্লুএস মেশিন লার্নিং

- blockchain

- ব্লকচেইন সম্মেলন এআই

- coingenius

- কথোপকথন কৃত্রিম বুদ্ধিমত্তা

- ক্রিপ্টো সম্মেলন এআই

- ডাল-ই

- গভীর জ্ঞানার্জন

- গুগল আই

- মেশিন লার্নিং

- Plato

- প্লেটো এআই

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটো গেম

- প্লেটোডাটা

- প্লেটোগেমিং

- স্কেল ai

- বাক্য গঠন

- zephyrnet