এটি একটি অতিথি ব্লগ পোস্ট যা বাইটেড্যান্স থেকে মিনঝুই ইউ এবং জিয়ানজে জিয়াও-এর সাথে সহ-লিখিত।

ByteDance একটি প্রযুক্তি কোম্পানী যা বিভিন্ন ভাষা, সংস্কৃতি এবং ভৌগোলিক অঞ্চলের লোকেদের জানাতে, শিক্ষিত করতে, বিনোদন দিতে এবং অনুপ্রাণিত করতে বিভিন্ন বিষয়বস্তু প্ল্যাটফর্ম পরিচালনা করে। ব্যবহারকারীরা আমাদের বিষয়বস্তু প্ল্যাটফর্মগুলিকে বিশ্বাস করে এবং উপভোগ করে কারণ তারা প্রদান করে সমৃদ্ধ, স্বজ্ঞাত এবং নিরাপদ অভিজ্ঞতা। এই অভিজ্ঞতাগুলি আমাদের মেশিন লার্নিং (ML) ব্যাকএন্ড ইঞ্জিন দ্বারা সম্ভব হয়েছে, ML মডেলগুলি বিষয়বস্তু নিয়ন্ত্রন, অনুসন্ধান, সুপারিশ, বিজ্ঞাপন এবং অভিনব ভিজ্যুয়াল প্রভাবগুলির জন্য তৈরি করা হয়েছে৷

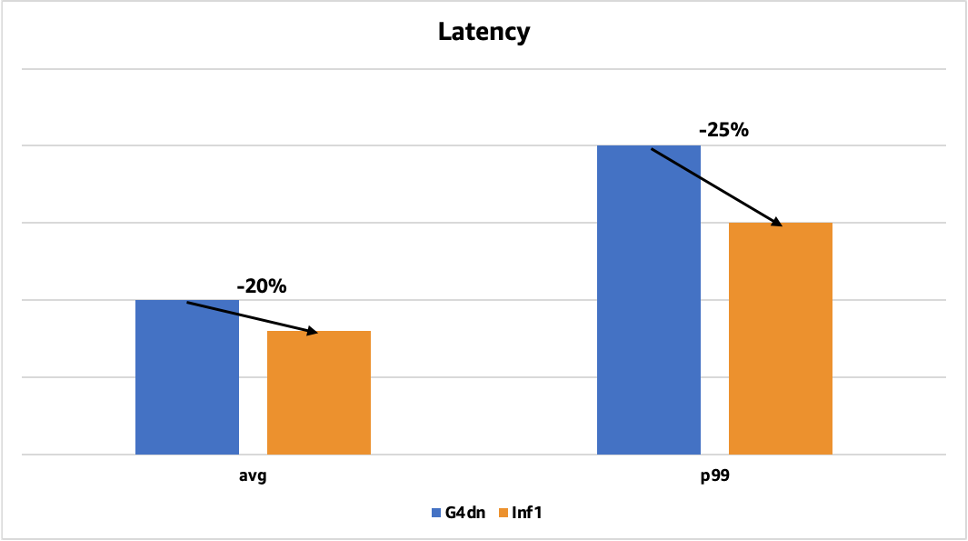

বাইটড্যান্স এএমএল (অ্যাপ্লাইড মেশিন লার্নিং) টিম কোম্পানির ব্যবসার জন্য অত্যন্ত পারফরম্যান্স, নির্ভরযোগ্য এবং মাপযোগ্য এমএল সিস্টেম এবং এন্ড-টু-এন্ড এমএল পরিষেবা সরবরাহ করে। আমরা প্রতিক্রিয়ার সময় না বাড়িয়ে খরচ কমাতে আমাদের এমএল ইনফারেন্স সিস্টেমগুলিকে অপ্টিমাইজ করার উপায়গুলি নিয়ে গবেষণা করছিলাম। যখন AWS চালু হয়েছে এডাব্লুএস ইনফেরেন্টিয়া, AWS দ্বারা নির্মিত একটি উচ্চ-পারফরম্যান্স এমএল ইনফরেন্স চিপ, আমরা আমাদের AWS অ্যাকাউন্ট টিমের সাথে কাজ করেছি পরীক্ষা করার জন্য যে AWS Inferentia আমাদের অপ্টিমাইজেশন লক্ষ্যগুলি পূরণ করতে পারে কিনা৷ আমরা ধারণার বেশ কয়েকটি প্রমাণ চালিয়েছি, যার ফলে T60 GPU-ভিত্তিক EC4 G2dn দৃষ্টান্তগুলির তুলনায় 4% পর্যন্ত কম অনুমান খরচ এবং 25% পর্যন্ত কম অনুমান বিলম্ব হয়েছে৷ এই খরচ সাশ্রয় এবং কর্মক্ষমতা উন্নতি উপলব্ধি করার জন্য, আমরা AWS Inferentia-ভিত্তিক মডেল স্থাপন করার সিদ্ধান্ত নিয়েছি অ্যামাজন ইলাস্টিক কম্পিউট ক্লাউড (Amazon EC2) উৎপাদনে Inf1 দৃষ্টান্ত।

নিম্নলিখিত চার্টটি আমাদের মুখ সনাক্তকরণ মডেলগুলির একটির জন্য লেটেন্সি উন্নতি দেখায় যা পূর্বে Tensor RT-এর সাথে GPU-তে স্থাপন করা হয়েছিল। গড় বিলম্বতা 20% কমেছে (50 মিলিসেকেন্ড থেকে 40 মিলিসেকেন্ডে), এবং p99 লেটেন্সি 25% কমেছে (200 মিলিসেকেন্ড থেকে 150 মিলিসেকেন্ডে)।

এই পোস্টে, আমরা শেয়ার করি কিভাবে আমরা AWS Inferentia ব্যবহার করে বিলম্ব কমাতে এবং থ্রুপুট বাড়ানোর সময় অনুমান খরচ বাঁচিয়েছি।

উচ্চ-কর্মক্ষমতা, খরচ-কার্যকর গণনার সন্ধানে

বাইটড্যান্স এএমএল টিম অত্যাধুনিক এমএল সিস্টেমের গবেষণা এবং বাস্তবায়ন এবং তাদের প্রয়োজনীয় ভিন্ন ভিন্ন কম্পিউটিং সংস্থানগুলির উপর দৃষ্টি নিবদ্ধ করে। আমরা বিভিন্ন ধরণের সুপারিশকারী, প্রাকৃতিক ভাষা প্রক্রিয়াকরণ (NLP) এবং কম্পিউটার ভিশন (সিভি) মডেলগুলির জন্য বড় আকারের প্রশিক্ষণ এবং অনুমান ব্যবস্থা তৈরি করি। এই মডেলগুলি অত্যন্ত জটিল এবং বাইটড্যান্স পরিচালনা করে এমন অনেক সামগ্রী প্ল্যাটফর্ম থেকে বিপুল পরিমাণ ডেটা প্রক্রিয়া করে। এই মডেলগুলি স্থাপনের জন্য গুরুত্বপূর্ণ GPU সংস্থান প্রয়োজন, তা ক্লাউডে বা প্রাঙ্গনেই হোক না কেন। অতএব, এই অনুমান সিস্টেমগুলির জন্য গণনা খরচ বেশ বেশি।

আমরা থ্রুপুট বা লেটেন্সি প্রভাবিত না করে এই খরচগুলি কমাতে চাইছিলাম। আমরা ক্লাউডের নমনীয়তা এবং দ্রুত ডেলিভারি চক্র চেয়েছিলাম, যা একটি অন-প্রিমিসেস সেটআপের জন্য প্রয়োজনের তুলনায় অনেক ছোট। এবং যদিও আমরা ত্বরান্বিত ML-এর জন্য নতুন বিকল্পগুলি অন্বেষণ করার জন্য উন্মুক্ত ছিলাম, আমরা একটি নির্বিঘ্ন বিকাশকারী অভিজ্ঞতাও চেয়েছিলাম।

আমরা আমাদের AWS টিম থেকে শিখেছি যে AWS Inferentia-ভিত্তিক EC2 Inf1 দৃষ্টান্তগুলি ক্লাউডে সর্বনিম্ন মূল্য-প্রতি-অনুমানে উচ্চ-কর্মক্ষমতা ML অনুমান সরবরাহ করে। আমরা সেগুলি অন্বেষণ করতে আগ্রহী ছিলাম এবং সেগুলিকে আমাদের ব্যবহারের ক্ষেত্রে উপযুক্ত বলে খুঁজে পেয়েছি, কারণ আমরা প্রচুর পরিমাণে চিত্র, বস্তু, বক্তৃতা এবং পাঠ্য ডেটার উপর যথেষ্ট মেশিন লার্নিং চালাই৷ এগুলি অবশ্যই আমাদের লক্ষ্যগুলির জন্য উপযুক্ত ছিল, কারণ আমরা আমাদের মডেলগুলির জটিলতা এবং দৈনিক ভবিষ্যদ্বাণীগুলির পরিমাণের কারণে বিপুল ব্যয় সাশ্রয় উপলব্ধি করতে পারি৷ অধিকন্তু, AWS Inferentia-এ প্রচুর পরিমাণে অন-চিপ মেমরি রয়েছে, যা আপনি চিপ বন্ধ রাখার পরিবর্তে বড় মডেলকে ক্যাশে করার জন্য ব্যবহার করতে পারেন। আমরা স্বীকার করেছি যে এটি অনুমানের লেটেন্সি কমাতে উল্লেখযোগ্য প্রভাব ফেলতে পারে কারণ নিউরনকোরস নামক AWS ইনফেরেনশিয়ার প্রসেসিং কোরগুলির মডেলগুলিতে উচ্চ-গতির অ্যাক্সেস রয়েছে যা অন-চিপ মেমরিতে সংরক্ষণ করা হয় এবং অফ-চিপ মেমরি দ্বারা সীমাবদ্ধ নয়। ব্যান্ডউইথ

পরিশেষে, বেশ কয়েকটি বিকল্পের মূল্যায়ন করার পরে, আমরা EC2 Inf1 দৃষ্টান্তগুলিকে G4dn দৃষ্টান্ত এবং প্রাঙ্গনে NVIDIA T4 এর তুলনায় তাদের ভাল কর্মক্ষমতা/মূল্য অনুপাতের জন্য বেছে নিয়েছি। Inf1-এর মূল্য এবং কার্যকারিতা সুবিধাগুলি আনলক করতে আমরা AWS টিমের সাথে ক্রমাগত পুনরাবৃত্তির একটি চক্রে নিযুক্ত হয়েছি।

AWS Inferentia-এ ইনফারেন্স ওয়ার্কলোড স্থাপন করা হচ্ছে

AWS নিউরন SDK ব্যবহার করে AWS Inferentia দিয়ে শুরু করা দুটি পর্যায় জড়িত: মডেল কোড সংকলন এবং Inf1 দৃষ্টান্তে স্থাপনা। যেকোন নতুন পরিকাঠামোতে ML মডেলগুলিকে স্থানান্তর করার সময় সাধারণ হিসাবে, আমরা কিছু চ্যালেঞ্জের মুখোমুখি হয়েছিলাম। আমরা আমাদের AWS টিমের অধ্যবসায় এবং সমর্থন দিয়ে এই চ্যালেঞ্জগুলি কাটিয়ে উঠতে সক্ষম হয়েছি। নিম্নলিখিত বিভাগে, আমরা AWS Inferentia-তে ইনফারেন্স ওয়ার্কলোড স্থাপন করার অভিজ্ঞতার ভিত্তিতে বেশ কিছু দরকারী টিপস এবং পর্যবেক্ষণ শেয়ার করি।

OCR এর জন্য কনফর্মার মডেল

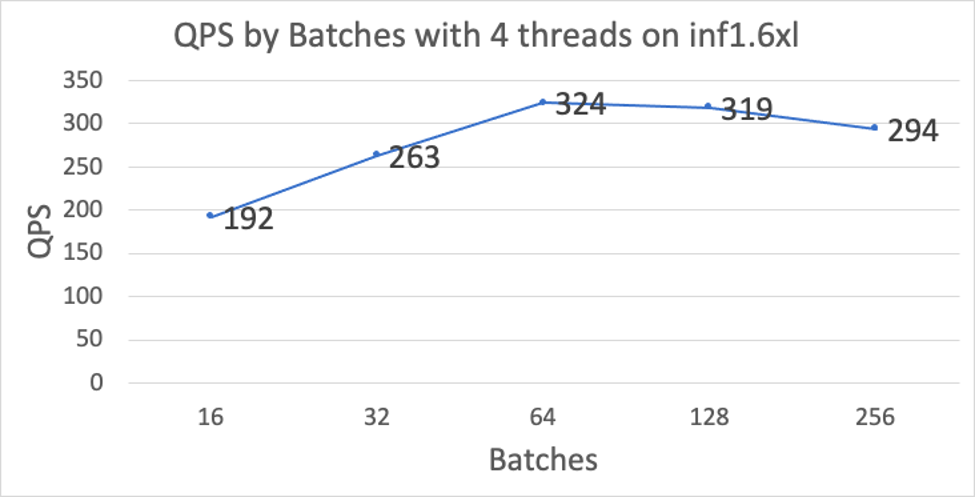

আমাদের অপটিক্যাল ক্যারেক্টার রিকগনিশন (OCR) কনফর্মার মডেল চিত্রগুলির মধ্যে পাঠ্য সনাক্ত করে এবং পাঠ করে। আমরা লেটেন্সি কম রেখে বিভিন্ন ব্যাচের আকারের জন্য উচ্চ কার্যক্ষমতা (QPS) পেতে বেশ কয়েকটি অপ্টিমাইজেশানে কাজ করেছি। কিছু মূল অপ্টিমাইজেশান নীচে উল্লেখ করা হয়েছে:

- কম্পাইলার অপ্টিমাইজেশান - ডিফল্টরূপে, ইনফরেন্টিয়া একটি নির্দিষ্ট ক্রম দৈর্ঘ্য সহ ইনপুটগুলিতে সর্বোত্তম কার্য সম্পাদন করে, যা পাঠ্য ডেটার দৈর্ঘ্য স্থির না থাকায় একটি চ্যালেঞ্জ উপস্থাপন করে। এটি কাটিয়ে উঠতে, আমরা আমাদের মডেলকে দুটি ভাগে বিভক্ত করেছি: একটি এনকোডার এবং একটি ডিকোডার৷ আমরা এই দুটি সাব-মডেল আলাদাভাবে কম্পাইল করেছি এবং তারপর টর্চস্ক্রিপ্টের মাধ্যমে একটি একক মডেলে একত্রিত করেছি। CPU-তে লুপ কন্ট্রোল ফ্লো চালানোর মাধ্যমে, এই পদ্ধতিটি ইনফেরেনশিয়াতে পরিবর্তনশীল ক্রম দৈর্ঘ্যের জন্য সমর্থন সক্ষম করে।

- গভীরভাবে আবর্তন কর্মক্ষমতা - আমরা গভীরভাবে কনভোলিউশন অপারেশনে একটি DMA বাধার সম্মুখীন হয়েছি, যা আমাদের কনফর্মার মডেল দ্বারা ব্যাপকভাবে ব্যবহৃত হয়। আমরা AWS নিউরন টিমের সাথে ঘনিষ্ঠভাবে কাজ করেছি DMA অ্যাক্সেস পারফরম্যান্স বটলনেক সনাক্ত করতে এবং সমাধান করতে, যা এই অপারেশনের কর্মক্ষমতা উন্নত করেছে এবং আমাদের OCR মডেলের সামগ্রিক কর্মক্ষমতা উন্নত করেছে।

Inferentia-এ আমাদের স্থাপনা অপ্টিমাইজ করার জন্য আমরা দুটি নতুন মডেল ভেরিয়েন্ট তৈরি করেছি:

- সম্মিলিত এবং আনরোল করা এনকোডার/ডিকোডার - একটি স্বাধীনভাবে সংকলিত এনকোডার এবং ডিকোডার ব্যবহার করার পরিবর্তে, আমরা একটি একক মডেলে এনকোডার এবং একটি সম্পূর্ণ আনরোলড ডিকোডারকে একত্রিত করেছি এবং এই মডেলটিকে একটি একক NEFF হিসাবে কম্পাইল করেছি৷ ডিকোডার আনরোল করা কোনো CPU ক্রিয়াকলাপ ব্যবহার না করেই Inferentia-এ সমস্ত ডিকোডার নিয়ন্ত্রণ প্রবাহ চালানো সম্ভব করে তোলে। এই পদ্ধতির সাথে, ডিকোডারের প্রতিটি পুনরাবৃত্তি সেই টোকেনের জন্য প্রয়োজনীয় গণনার পরিমাণ ঠিক ব্যবহার করে। এই পদ্ধতিটি কর্মক্ষমতা উন্নত করে কারণ আমরা অতিরিক্ত গণনা উল্লেখযোগ্যভাবে হ্রাস করি যা পূর্বে প্যাডিং ইনপুট দ্বারা প্রবর্তিত হয়েছিল। তদ্ব্যতীত, ডিকোডার পুনরাবৃত্তির মধ্যে Inferentia থেকে CPU-তে কোনো ডেটা স্থানান্তর প্রয়োজন নেই, যা I/O সময়কে ব্যাপকভাবে হ্রাস করে। মডেলের এই সংস্করণটি তাড়াতাড়ি থামানো সমর্থন করে না।

- বিভাজিত আনরোলড ডিকোডার - সম্মিলিত সম্পূর্ণ আনরোল করা মডেলের মতো, মডেলের এই রূপটি ডিকোডারের একাধিক পুনরাবৃত্তি আনরোল করে এবং সেগুলিকে একক এক্সিকিউশন হিসাবে কম্পাইল করে (কিন্তু এনকোডার অন্তর্ভুক্ত করে না)। উদাহরণস্বরূপ, 75-এর সর্বাধিক ক্রম দৈর্ঘ্যের জন্য, আমরা ডিকোডারটিকে 3টি পার্টিশনে আনরোল করতে পারি যা 1-25, 26-50 এবং 51-75 টোকেন গণনা করে। I/O এর পরিপ্রেক্ষিতে, এটিও উল্লেখযোগ্যভাবে দ্রুত কারণ আমাদের প্রতি পুনরাবৃত্তিতে একবার এনকোডার আউটপুট স্থানান্তর করার দরকার নেই। পরিবর্তে, প্রতিটি ডিকোডার পার্টিশনে আউটপুটগুলি শুধুমাত্র একবার স্থানান্তরিত হয়। মডেলের এই সংস্করণটি প্রাথমিকভাবে থামানো সমর্থন করে, তবে শুধুমাত্র পার্টিশনের সীমানায়। পার্টিশনের সীমানা প্রতিটি নির্দিষ্ট অ্যাপ্লিকেশনের জন্য টিউন করা যেতে পারে যাতে বেশিরভাগ অনুরোধ শুধুমাত্র একটি পার্টিশন কার্যকর করে।

কর্মক্ষমতা আরও উন্নত করতে, আমরা মেমরির ব্যবহার কমাতে বা অ্যাক্সেস দক্ষতা উন্নত করতে নিম্নলিখিত অপ্টিমাইজেশনগুলি করেছি:

- টেনসর ডিডপ্লিকেশন এবং কম কপি - এটি একটি কম্পাইলার অপ্টিমাইজেশান যা স্থানের দক্ষতা উন্নত করতে টেনসরগুলি পুনরায় ব্যবহার করে আনরোল করা মডেলের আকার এবং নির্দেশাবলী/মেমরি অ্যাক্সেসের সংখ্যা উল্লেখযোগ্যভাবে হ্রাস করে।

- কম নির্দেশনা - এটি একটি কম্পাইলার অপ্টিমাইজেশান যা ডিকোডারের নন-প্যাডেড সংস্করণের সাথে উল্লেখযোগ্যভাবে নির্দেশের মোট সংখ্যা কমাতে ব্যবহৃত হয়।

- মাল্টি-কোর ডিডপ্লিকেশন - এটি একটি রানটাইম অপ্টিমাইজেশান যা টেনসর ডিডপ্লিকেশনের বিকল্প। এই বিকল্পের সাহায্যে, সমস্ত মাল্টিকোর মডেল উল্লেখযোগ্যভাবে আরো স্থান দক্ষ হবে।

ইমেজ শ্রেণীবিভাগের জন্য ResNet50 মডেল

ResNet-50 হল ইমেজ শ্রেণীবিভাগের জন্য একটি প্রাক-প্রশিক্ষিত গভীর শিক্ষার মডেল। এটি একটি কনভোল্যুশনাল নিউরাল নেটওয়ার্ক (CNN বা ConvNet) যা ভিজ্যুয়াল ইমেজ বিশ্লেষণের জন্য সবচেয়ে বেশি প্রয়োগ করা হয়। Inferentia-এ এই মডেলের কর্মক্ষমতা উন্নত করতে আমরা নিম্নলিখিত কৌশলগুলি ব্যবহার করেছি:

- মডেল রূপান্তর – বাইটড্যান্সের অনেক মডেল ONNX ফরম্যাটে রপ্তানি করা হয়, যা বর্তমানে Inferentia স্থানীয়ভাবে সমর্থন করে না। এই ONNX মডেলগুলি পরিচালনা করার জন্য, AWS নিউরন দল আমাদের মডেলগুলিকে ONNX ফর্ম্যাট থেকে PyTorch মডেলগুলিতে রূপান্তর করার জন্য স্ক্রিপ্ট সরবরাহ করেছে, যা টর্চ-নিউরন ব্যবহার করে ইনফেরেনশিয়ার জন্য সরাসরি সংকলিত করা যেতে পারে।

- পারফরমেন্স অপ্টিমাইজেশন - আমরা সঙ্গে ঘনিষ্ঠভাবে কাজ AWS নিউরন আমাদের ResNet-50 মডেলের পারফরম্যান্স অপ্টিমাইজ করতে কম্পাইলারে শিডিউল হিউরিস্টিক টিউন করবে।

বিষয়বস্তু সংযমের জন্য মাল্টি-মডেল মডেল

আমাদের মাল্টি-মডেল ডিপ লার্নিং মডেল হল একাধিক পৃথক মডেলের সংমিশ্রণ। এই মডেলের আকার তুলনামূলকভাবে বড়, যা ইনফেরেনশিয়াতে মডেল লোডিং ব্যর্থতার কারণ। AWS নিউরন টিম সফলভাবে ডিভাইসের মেমরি ব্যবহার কমাতে ওজন ভাগ করে নেওয়ার মাধ্যমে এই সমস্যার সমাধান করেছে। নিউরন দল নিউরন libnrt লাইব্রেরিতে এই ওজন ডি-ডুপ্লিকেশন বৈশিষ্ট্যটি প্রকাশ করেছে এবং আরও সুনির্দিষ্ট মেট্রিক্সের জন্য নিউরন সরঞ্জামগুলিকে উন্নত করেছে। রানটাইম ওজন ডি-ডুপ্লিকেশন বৈশিষ্ট্যটি অনুমান চালানোর আগে নিম্নলিখিত পরিবেশ পরিবর্তনশীল সেট করে সক্ষম করা যেতে পারে:

NEURON_RT_MULTI_INSTANCE_SHARED_WEIGHTS=1

আপডেট হওয়া নিউরন SDK আমাদের সদৃশ মডেলগুলির সামগ্রিক মেমরি খরচ কমিয়েছে, যা আমাদের মাল্টি-কোর ইনফারেন্সের জন্য আমাদের মাল্টি-মোডাল মডেল স্থাপন করতে সক্ষম করেছে।

AWS Inferentia-এ আরও মডেল স্থানান্তর করা হচ্ছে

ByteDance-এ, আমরা প্রায় 2 বিলিয়ন মাসিক সক্রিয় ব্যবহারকারীদের আনন্দদায়ক ব্যবহারকারীর অভিজ্ঞতা প্রদানের জন্য উদ্ভাবনী গভীর শিক্ষার মডেলগুলি স্থাপন করতে থাকি। আমরা যে বিশাল স্কেলে কাজ করি তার পরিপ্রেক্ষিতে, আমরা ক্রমাগত খরচ বাঁচাতে এবং কর্মক্ষমতা অপ্টিমাইজ করার উপায় খুঁজছি। আমরা মডেলগুলিকে AWS Inferentia-এ স্থানান্তর করা চালিয়ে যাব যাতে এর উচ্চ কার্যক্ষমতা এবং খরচ-দক্ষতা থেকে উপকৃত হতে পারি। আমরা আরও চাই যে AWS আরও AWS Inferentia-ভিত্তিক দৃষ্টান্তের ধরন চালু করুক, যেমন প্রি-প্রসেসিং কাজগুলির জন্য আরও vCPU আছে। সামনের দিকে, ByteDance ML অ্যাপ্লিকেশনের জন্য সেরা মূল্যের কর্মক্ষমতা প্রদানের জন্য AWS থেকে আরও সিলিকন উদ্ভাবন দেখার আশা করছে।

আপনি যদি আপনার অনুমান অ্যাপ্লিকেশনের জন্য কর্মক্ষমতা অপ্টিমাইজ করার সময় AWS Inferentia আপনাকে খরচ বাঁচাতে সাহায্য করতে পারে সে সম্পর্কে আরও জানতে আগ্রহী হলে, এখানে যান Amazon EC2 Inf1 দৃষ্টান্ত পণ্য পাতা.

লেখক সম্পর্কে

মিনঝুই ইউ বাইটড্যান্সে অনুমানের জন্য একজন সিনিয়র মেশিন লার্নিং টিম লিড। তার ফোকাস এরিয়া হল এআই কম্পিউটিং অ্যাক্সিলারেশন এবং মেশিন লার্নিং সিস্টেম। তিনি মুর-পরবর্তী যুগে ভিন্নধর্মী কম্পিউটিং এবং কম্পিউটার স্থাপত্যে খুব আগ্রহী। তার অবসর সময়ে, তিনি বাস্কেটবল এবং তীরন্দাজ পছন্দ করেন।

মিনঝুই ইউ বাইটড্যান্সে অনুমানের জন্য একজন সিনিয়র মেশিন লার্নিং টিম লিড। তার ফোকাস এরিয়া হল এআই কম্পিউটিং অ্যাক্সিলারেশন এবং মেশিন লার্নিং সিস্টেম। তিনি মুর-পরবর্তী যুগে ভিন্নধর্মী কম্পিউটিং এবং কম্পিউটার স্থাপত্যে খুব আগ্রহী। তার অবসর সময়ে, তিনি বাস্কেটবল এবং তীরন্দাজ পছন্দ করেন।

জিয়াঞ্জে জিয়াও বাইটড্যান্সে এএমএল টিমের একজন সিনিয়র সফটওয়্যার ইঞ্জিনিয়ার টিম লিড। তার বর্তমান কাজটি ব্যবসায়িক দলকে মডেল স্থাপন প্রক্রিয়ার গতি বাড়ানো এবং মডেলের অনুমান কর্মক্ষমতা উন্নত করতে সহায়তা করার উপর দৃষ্টি নিবদ্ধ করে। কাজের বাইরে তিনি পিয়ানো বাজানো উপভোগ করেন।

জিয়াঞ্জে জিয়াও বাইটড্যান্সে এএমএল টিমের একজন সিনিয়র সফটওয়্যার ইঞ্জিনিয়ার টিম লিড। তার বর্তমান কাজটি ব্যবসায়িক দলকে মডেল স্থাপন প্রক্রিয়ার গতি বাড়ানো এবং মডেলের অনুমান কর্মক্ষমতা উন্নত করতে সহায়তা করার উপর দৃষ্টি নিবদ্ধ করে। কাজের বাইরে তিনি পিয়ানো বাজানো উপভোগ করেন।

তিয়ান শি AWS-এর একজন সিনিয়র সলিউশন আর্কিটেক্ট। তার ফোকাস এলাকা ডেটা বিশ্লেষণ, মেশিন লার্নিং এবং সার্ভারহীন। তিনি গ্রাহকদের ক্লাউডে নির্ভরযোগ্য এবং মাপযোগ্য সমাধান ডিজাইন করতে এবং তৈরি করতে সহায়তা করার বিষয়ে উত্সাহী। তার অবসর সময়ে, তিনি সাঁতার কাটা এবং পড়া উপভোগ করেন।

তিয়ান শি AWS-এর একজন সিনিয়র সলিউশন আর্কিটেক্ট। তার ফোকাস এলাকা ডেটা বিশ্লেষণ, মেশিন লার্নিং এবং সার্ভারহীন। তিনি গ্রাহকদের ক্লাউডে নির্ভরযোগ্য এবং মাপযোগ্য সমাধান ডিজাইন করতে এবং তৈরি করতে সহায়তা করার বিষয়ে উত্সাহী। তার অবসর সময়ে, তিনি সাঁতার কাটা এবং পড়া উপভোগ করেন।

জিয়া ডং AWS-এ কাস্টমার সলিউশন ম্যানেজার। তিনি AWS AI/ML পরিষেবাগুলি সম্পর্কে শিখতে উপভোগ করেন এবং গ্রাহকদের তাদের জন্য সমাধান তৈরি করে তাদের ব্যবসায়িক ফলাফলগুলি পূরণ করতে সহায়তা করেন৷ কাজের বাইরে, জিয়া ভ্রমণ, যোগব্যায়াম এবং সিনেমা উপভোগ করেন।

জিয়া ডং AWS-এ কাস্টমার সলিউশন ম্যানেজার। তিনি AWS AI/ML পরিষেবাগুলি সম্পর্কে শিখতে উপভোগ করেন এবং গ্রাহকদের তাদের জন্য সমাধান তৈরি করে তাদের ব্যবসায়িক ফলাফলগুলি পূরণ করতে সহায়তা করেন৷ কাজের বাইরে, জিয়া ভ্রমণ, যোগব্যায়াম এবং সিনেমা উপভোগ করেন।

জোনাথন লুন্ট এমএল ফ্রেমওয়ার্ক ডেভেলপমেন্টের উপর ফোকাস সহ অ্যামাজনে একজন সফ্টওয়্যার প্রকৌশলী। তার কর্মজীবনে তিনি মডেল ডেভেলপমেন্ট, অবকাঠামো স্থাপন এবং হার্ডওয়্যার-নির্দিষ্ট অপ্টিমাইজেশান সহ ডেটা সায়েন্সের ভূমিকার সম্পূর্ণ বিস্তৃতির মাধ্যমে কাজ করেছেন।

জোনাথন লুন্ট এমএল ফ্রেমওয়ার্ক ডেভেলপমেন্টের উপর ফোকাস সহ অ্যামাজনে একজন সফ্টওয়্যার প্রকৌশলী। তার কর্মজীবনে তিনি মডেল ডেভেলপমেন্ট, অবকাঠামো স্থাপন এবং হার্ডওয়্যার-নির্দিষ্ট অপ্টিমাইজেশান সহ ডেটা সায়েন্সের ভূমিকার সম্পূর্ণ বিস্তৃতির মাধ্যমে কাজ করেছেন।

জোশুয়া হান্নান আমাজনের একজন মেশিন লার্নিং ইঞ্জিনিয়ার। তিনি বড় আকারের কম্পিউটার দৃষ্টি এবং প্রাকৃতিক ভাষা প্রক্রিয়াকরণ অ্যাপ্লিকেশনের জন্য গভীর শিক্ষার মডেলগুলিকে অপ্টিমাইজ করার জন্য কাজ করেন।

জোশুয়া হান্নান আমাজনের একজন মেশিন লার্নিং ইঞ্জিনিয়ার। তিনি বড় আকারের কম্পিউটার দৃষ্টি এবং প্রাকৃতিক ভাষা প্রক্রিয়াকরণ অ্যাপ্লিকেশনের জন্য গভীর শিক্ষার মডেলগুলিকে অপ্টিমাইজ করার জন্য কাজ করেন।

শ্রুতি কোপারকার AWS-এর একজন সিনিয়র প্রোডাক্ট মার্কেটিং ম্যানেজার। তিনি গ্রাহকদের তাদের মেশিন লার্নিং প্রয়োজনের জন্য EC2 ত্বরিত কম্পিউটিং পরিকাঠামো অন্বেষণ, মূল্যায়ন এবং গ্রহণ করতে সহায়তা করেন।

শ্রুতি কোপারকার AWS-এর একজন সিনিয়র প্রোডাক্ট মার্কেটিং ম্যানেজার। তিনি গ্রাহকদের তাদের মেশিন লার্নিং প্রয়োজনের জন্য EC2 ত্বরিত কম্পিউটিং পরিকাঠামো অন্বেষণ, মূল্যায়ন এবং গ্রহণ করতে সহায়তা করেন।

- AI

- ai শিল্প

- এআই আর্ট জেনারেটর

- আইআই রোবট

- কৃত্রিম বুদ্ধিমত্তা

- কৃত্রিম বুদ্ধিমত্তা সার্টিফিকেশন

- ব্যাংকিং এ কৃত্রিম বুদ্ধিমত্তা

- কৃত্রিম বুদ্ধিমত্তার রোবট

- কৃত্রিম বুদ্ধিমত্তার রোবট

- কৃত্রিম বুদ্ধিমত্তা সফ্টওয়্যার

- এডাব্লুএস ইনফেরেন্টিয়া

- এডাব্লুএস মেশিন লার্নিং

- blockchain

- ব্লকচেইন সম্মেলন এআই

- coingenius

- কথোপকথন কৃত্রিম বুদ্ধিমত্তা

- ক্রিপ্টো সম্মেলন এআই

- ডাল-ই

- গভীর জ্ঞানার্জন

- গুগল আই

- মেশিন লার্নিং

- Plato

- প্লেটো এআই

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটো গেম

- প্লেটোডাটা

- প্লেটোগেমিং

- স্কেল ai

- বাক্য গঠন

- zephyrnet