মস্তিষ্ক কীভাবে স্থানিক তথ্য সংগঠিত করে এবং অ্যাক্সেস করে তা বোঝা — আমরা কোথায় আছি, কোণে কী আছে, কীভাবে সেখানে যেতে হবে — একটি দুর্দান্ত চ্যালেঞ্জ রয়ে গেছে। এই প্রক্রিয়াটির মধ্যে রয়েছে স্মৃতির একটি সম্পূর্ণ নেটওয়ার্ক এবং কয়েক বিলিয়ন নিউরন থেকে সংরক্ষিত স্থানিক ডেটা, প্রতিটি হাজার হাজার অন্যের সাথে সংযুক্ত। স্নায়ুবিজ্ঞানীরা যেমন মূল উপাদান চিহ্নিত করেছেন গ্রিড কোষ, নিউরন যে ম্যাপ অবস্থান. তবে আরও গভীরে যাওয়া কঠিন প্রমাণিত হবে: গবেষকরা মানুষের ধূসর পদার্থের টুকরোগুলি সরিয়ে ফেলতে এবং অধ্যয়ন করতে পারেন তা দেখতে কীভাবে চিত্র, শব্দ এবং গন্ধের অবস্থান-ভিত্তিক স্মৃতিগুলি প্রবাহিত হয় এবং একে অপরের সাথে সংযুক্ত হয় তা দেখার জন্য।

কৃত্রিম বুদ্ধিমত্তা আরেকটি উপায় প্রদান করে৷ বছরের পর বছর ধরে, স্নায়ুবিজ্ঞানীরা মস্তিষ্কে নিউরনের ফায়ারিং মডেলের জন্য অনেক ধরণের নিউরাল নেটওয়ার্ক - ইঞ্জিন যা সবচেয়ে গভীর শিক্ষার অ্যাপ্লিকেশনগুলিকে শক্তি দেয় - ব্যবহার করেছে৷ সাম্প্রতিক কাজে, গবেষকরা দেখিয়েছেন যে হিপ্পোক্যাম্পাস, মস্তিষ্কের একটি কাঠামো যা স্মৃতির জন্য গুরুত্বপূর্ণ, মূলত একটি বিশেষ ধরনের স্নায়ু জাল, যা একটি ট্রান্সফরমার, গুপ্তবেশে. তাদের নতুন মডেল এমনভাবে স্থানিক তথ্য ট্র্যাক করে যা মস্তিষ্কের অভ্যন্তরীণ কাজের সমান্তরাল করে। তারা অসাধারণ সাফল্য দেখেছে।

"আমরা জানি যে মস্তিষ্কের এই মডেলগুলি ট্রান্সফরমারের সমতুল্য, এর অর্থ হল আমাদের মডেলগুলি অনেক ভাল কাজ করে এবং প্রশিক্ষণ দেওয়া সহজ," বলেন জেমস উইটিংটন, একজন জ্ঞানীয় স্নায়ুবিজ্ঞানী যিনি স্ট্যানফোর্ড ইউনিভার্সিটি এবং এর ল্যাবের মধ্যে তার সময় ভাগ করেন টিম বেহরেন্স অক্সফোর্ড বিশ্ববিদ্যালয়ে।

হুইটিংটন এবং অন্যদের দ্বারা অধ্যয়নগুলি ইঙ্গিত দেয় যে ট্রান্সফরমারগুলি গ্রিড কোষ এবং মস্তিষ্কের অন্যান্য অংশ দ্বারা পরিচালিত বিভিন্ন ধরণের গণনা অনুকরণ করতে নিউরাল নেটওয়ার্ক মডেলগুলির ক্ষমতাকে ব্যাপকভাবে উন্নত করতে পারে। এই ধরনের মডেলগুলি কৃত্রিম নিউরাল নেটওয়ার্কগুলি কীভাবে কাজ করে এবং আরও সম্ভবত, মস্তিষ্কে কীভাবে গণনা করা হয় সে সম্পর্কে আমাদের বোঝার জন্য ধাক্কা দিতে পারে, হুইটিংটন বলেছিলেন।

"আমরা মস্তিষ্ক পুনরায় তৈরি করার চেষ্টা করছি না," বলেন ডেভিড হা, গুগল ব্রেইনের একজন কম্পিউটার বিজ্ঞানী যিনি ট্রান্সফরমার মডেলেও কাজ করেন। "কিন্তু আমরা কি এমন একটি প্রক্রিয়া তৈরি করতে পারি যা মস্তিষ্ক যা করে তা করতে পারে?"

ট্রান্সফরমারগুলি পাঁচ বছর আগে ভাষা প্রক্রিয়া করার জন্য এআই-এর একটি নতুন উপায় হিসাবে প্রথম উপস্থিত হয়েছিল। তারা যারা শিরোনাম-দখল বাক্য-সম্পূর্ণ প্রোগ্রাম মত গোপন সস বার্ট এবং GPT-3, যা বিশ্বাসযোগ্য গানের লিরিক্স তৈরি করতে পারে, শেক্সপিয়রীয় সনেট রচনা করতে পারে এবং গ্রাহক পরিষেবা প্রতিনিধিদের ছদ্মবেশ ধারণ করতে পারে।

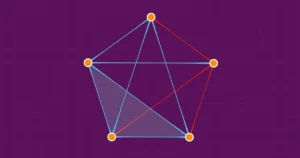

ট্রান্সফরমারগুলি স্ব-মনোযোগ নামক একটি প্রক্রিয়া ব্যবহার করে কাজ করে, যেখানে প্রতিটি ইনপুট - একটি শব্দ, একটি পিক্সেল, একটি ক্রমানুসারে একটি সংখ্যা - সবসময় অন্য প্রতিটি ইনপুটের সাথে সংযুক্ত থাকে। (অন্যান্য নিউরাল নেটওয়ার্ক ইনপুটগুলিকে শুধুমাত্র নির্দিষ্ট কিছু ইনপুটের সাথে সংযুক্ত করে।) কিন্তু যখন ট্রান্সফরমারগুলি ভাষার কাজের জন্য ডিজাইন করা হয়েছিল, তখন থেকে তারা অন্যান্য কাজে যেমন চিত্র শ্রেণীবদ্ধকরণ - এবং এখন, মস্তিষ্কের মডেলিং-এ দক্ষতা অর্জন করেছে।

2020 সালে, একটি গ্রুপের নেতৃত্বে সেপ হোচরিটার, অস্ট্রিয়ার জোহানেস কেপলার ইউনিভার্সিটি লিঞ্জের একজন কম্পিউটার বিজ্ঞানী, হপফিল্ড নেটওয়ার্ক নামে পরিচিত মেমরি পুনরুদ্ধারের একটি শক্তিশালী, দীর্ঘস্থায়ী মডেল পুনরুদ্ধার করতে একটি ট্রান্সফরমার ব্যবহার করেন। প্রিন্সটনের পদার্থবিদ জন হপফিল্ড 40 বছর আগে প্রথম প্রবর্তন করেছিলেন, এই নেটওয়ার্কগুলি একটি সাধারণ নিয়ম অনুসরণ করে: একই সময়ে সক্রিয় নিউরনগুলি একে অপরের সাথে শক্তিশালী সংযোগ তৈরি করে।

Hochreiter এবং তার সহযোগীরা, লক্ষ্য করেছেন যে গবেষকরা মেমরি পুনরুদ্ধারের আরও ভাল মডেলের সন্ধান করছেন, হপফিল্ড নেটওয়ার্কগুলি কীভাবে স্মৃতি পুনরুদ্ধার করে এবং কীভাবে ট্রান্সফরমারগুলি মনোযোগ দেয় তার মধ্যে একটি সংযোগ দেখেছে। তারা হপফিল্ড নেটওয়ার্ককে আপগ্রেড করেছে, মূলত এটিকে একটি ট্রান্সফরমারে পরিণত করেছে। এই পরিবর্তনটি মডেলটিকে আরও কার্যকর সংযোগের কারণে আরও স্মৃতি সংরক্ষণ এবং পুনরুদ্ধার করার অনুমতি দেয়, হুইটিংটন বলেছিলেন। হপফিল্ড নিজে, এমআইটি-আইবিএম ওয়াটসন এআই ল্যাবে দিমিত্রি ক্রোটভের সাথে, প্রমাণ করেছেন যে একটি ট্রান্সফরমার-ভিত্তিক হপফিল্ড নেটওয়ার্ক জৈবিকভাবে বিশ্বাসযোগ্য।

তারপর, এই বছরের শুরুতে, Whittington এবং Behrens Hochreiter এর পদ্ধতির আরও পরিবর্তন করতে সাহায্য করেছেন, ট্রান্সফরমারকে পরিবর্তন করেছেন যাতে স্মৃতিগুলিকে একটি রৈখিক ক্রম হিসাবে বিবেচনা করার পরিবর্তে - একটি বাক্যে শব্দের একটি স্ট্রিং এর মতো - এটি উচ্চ-মাত্রিক স্থানগুলিতে স্থানাঙ্ক হিসাবে তাদের এনকোড করে। যে "মোচড়", গবেষকরা এটিকে বলেছেন, স্নায়ুবিজ্ঞানের কাজগুলিতে মডেলটির কার্যকারিতা আরও উন্নত করেছে। তারা আরও দেখিয়েছে যে মডেলটি গাণিতিকভাবে গ্রিড সেল ফায়ারিং প্যাটার্নের মডেলগুলির সমতুল্য যা স্নায়ুবিজ্ঞানীরা এফএমআরআই স্ক্যানগুলিতে দেখেন।

ইউনিভার্সিটি কলেজ লন্ডনের নিউরোসায়েন্টিস্ট ক্যাসওয়েল ব্যারি বলেন, "গ্রিড সেলগুলির এই ধরনের উত্তেজনাপূর্ণ, সুন্দর, নিয়মিত গঠন এবং আকর্ষণীয় প্যাটার্ন রয়েছে যা এলোমেলোভাবে পপ আপ হওয়ার সম্ভাবনা কম।" নতুন কাজটি দেখিয়েছে যে কীভাবে ট্রান্সফরমারগুলি হিপ্পোক্যাম্পাসে পর্যবেক্ষণ করা সেই নিদর্শনগুলির প্রতিলিপি করে। "তারা স্বীকার করেছে যে একটি ট্রান্সফরমার পূর্ববর্তী অবস্থার উপর ভিত্তি করে কোথায় এবং এটি কীভাবে স্থানান্তরিত হয়েছে তা নির্ধারণ করতে পারে এবং এমনভাবে যা গ্রিড কোষের ঐতিহ্যবাহী মডেলগুলিতে চাবি করা হয়।"

অন্যান্য সাম্প্রতিক কাজগুলি পরামর্শ দেয় যে ট্রান্সফরমারগুলি মস্তিষ্কের অন্যান্য ফাংশনগুলি সম্পর্কেও আমাদের বোঝার উন্নতি করতে পারে। গত বছর, ম্যাসাচুসেটস ইনস্টিটিউট অফ টেকনোলজির কম্পিউটেশনাল নিউরোসায়েন্টিস্ট মার্টিন স্ক্রিম্প, 43টি ভিন্ন নিউরাল নেট মডেল বিশ্লেষণ করা হয়েছে এফএমআরআই এবং ইলেক্ট্রোকোর্টিকোগ্রাফি দ্বারা রিপোর্ট করা মানুষের স্নায়ু কার্যকলাপের পরিমাপের ভবিষ্যদ্বাণী কতটা ভাল তা দেখতে। ট্রান্সফরমার, তিনি খুঁজে পেয়েছেন, বর্তমান নেতৃস্থানীয়, অত্যাধুনিক নিউরাল নেটওয়ার্ক, যা ইমেজিং-এ পাওয়া প্রায় সমস্ত বৈচিত্র্যের পূর্বাভাস দেয়।

আর হা, সহ কম্পিউটার বিজ্ঞানী ড ইউজিন তাং, সম্প্রতি একটি মডেল ডিজাইন করা হয়েছে যা ইচ্ছাকৃতভাবে একটি ট্রান্সফরমারের মাধ্যমে একটি এলোমেলো, ক্রমহীন উপায়ে প্রচুর পরিমাণে ডেটা পাঠাতে পারে, মানবদেহ কীভাবে সংবেদনশীল পর্যবেক্ষণগুলি মস্তিষ্কে প্রেরণ করে তা অনুকরণ করে৷ তাদের ট্রান্সফরমার, আমাদের মস্তিষ্কের মতো, তথ্যের একটি বিকৃত প্রবাহ সফলভাবে পরিচালনা করতে পারে।

"নিউরাল নেটগুলি একটি নির্দিষ্ট ইনপুট গ্রহণ করার জন্য হার্ড-ওয়্যার্ড হয়," ট্যাং বলেছিলেন। কিন্তু বাস্তব জীবনে, ডেটা সেটগুলি প্রায়শই দ্রুত পরিবর্তিত হয় এবং বেশিরভাগ AI এর সামঞ্জস্য করার কোন উপায় নেই। "আমরা এমন একটি স্থাপত্য নিয়ে পরীক্ষা করতে চেয়েছিলাম যা খুব দ্রুত মানিয়ে নিতে পারে।"

অগ্রগতির এই লক্ষণগুলি সত্ত্বেও, বেহরেন্স ট্রান্সফরমারগুলিকে মস্তিষ্কের একটি সঠিক মডেলের দিকে একটি পদক্ষেপ হিসাবে দেখেন - অনুসন্ধানের শেষ নয়। "আমাকে এখানে একজন সংশয়বাদী স্নায়ুবিজ্ঞানী হতে হবে," তিনি বলেছিলেন। "আমি মনে করি না যে ট্রান্সফরমারগুলি মস্তিষ্কে ভাষা সম্পর্কে আমরা যেভাবে চিন্তা করি তা শেষ হবে, উদাহরণস্বরূপ, যদিও তাদের কাছে বাক্যের সেরা বর্তমান মডেল রয়েছে।"

"আমি কোথায় আছি এবং আমি পরবর্তীতে কী দেখব সে সম্পর্কে ভবিষ্যদ্বাণী করার জন্য এটি কি সবচেয়ে কার্যকরী ভিত্তি? যদি আমি সৎ হই, এটা বলা খুব শীঘ্রই,” ব্যারি বলেন।

শ্রিম্পফও উল্লেখ করেছেন যে এমনকি সেরা-পারফর্মিং ট্রান্সফরমারগুলিও সীমিত, শব্দ এবং ছোট বাক্যাংশের জন্য ভাল কাজ করে, উদাহরণস্বরূপ, কিন্তু গল্প বলার মতো বড় মাপের ভাষার কাজের জন্য নয়।

"আমার ধারণা হল এই আর্কিটেকচার, এই ট্রান্সফরমার, আপনাকে মস্তিষ্কের গঠন বোঝার জন্য সঠিক জায়গায় রাখে এবং প্রশিক্ষণের মাধ্যমে উন্নত করা যেতে পারে," বলেছেন শ্রিম্পফ। "এটি একটি ভাল দিক, কিন্তু ক্ষেত্রটি অত্যন্ত জটিল।"