জেনারেটিভ এআই অ্যাপ্লিকেশনগুলির দ্রুত গ্রহণের সাথে, উচ্চতর থ্রুপুট সহ অনুভূত লেটেন্সি কমাতে এই অ্যাপ্লিকেশনগুলির সময়মতো সাড়া দেওয়ার প্রয়োজন রয়েছে। ফাউন্ডেশন মডেলগুলি (FMs) প্রায়শই লক্ষ লক্ষ থেকে বিলিয়ন এবং তারও বেশি মাপের পরিমাপ সহ বিশাল কর্পোরা ডেটার উপর প্রাক-প্রশিক্ষিত হয়। বড় ভাষা মডেল (LLMs) হল এক ধরনের FM যা ব্যবহারকারীর অনুমানের প্রতিক্রিয়া হিসাবে পাঠ্য তৈরি করে। অনুমান পরামিতিগুলির বিভিন্ন কনফিগারেশনের সাথে এই মডেলগুলিকে অনুমান করা অসঙ্গত বিলম্বের দিকে পরিচালিত করতে পারে। অসামঞ্জস্যতা হতে পারে কারণ আপনি মডেল থেকে আশা করছেন বিভিন্ন সংখ্যক প্রতিক্রিয়া টোকেন বা মডেলটি যে ধরনের এক্সিলারেটর ব্যবহার করা হয়েছে।

উভয় ক্ষেত্রেই, সম্পূর্ণ প্রতিক্রিয়ার জন্য অপেক্ষা করার পরিবর্তে, আপনি আপনার অনুমানগুলির জন্য প্রতিক্রিয়া স্ট্রিমিংয়ের পদ্ধতি অবলম্বন করতে পারেন, যা তৈরি হওয়ার সাথে সাথে তথ্যের অংশগুলি ফেরত পাঠায়। এটি আপনাকে বিলম্বিত সম্পূর্ণ প্রতিক্রিয়ার পরিবর্তে রিয়েল টাইমে আংশিক প্রতিক্রিয়া স্ট্রিম দেখার অনুমতি দিয়ে একটি ইন্টারেক্টিভ অভিজ্ঞতা তৈরি করে।

আনুষ্ঠানিক ঘোষণা দিয়েই ড অ্যামাজন সেজমেকার রিয়েল-টাইম ইনফারেন্স এখন প্রতিক্রিয়া স্ট্রিমিং সমর্থন করে, ব্যবহার করার সময় আপনি এখন ক্রমাগত অনুমান প্রতিক্রিয়া ক্লায়েন্টের কাছে ফেরত পাঠাতে পারেন আমাজন সেজমেকার প্রতিক্রিয়া স্ট্রিমিং সহ রিয়েল-টাইম অনুমান। এই সমাধানটি আপনাকে বিভিন্ন জেনারেটিভ এআই অ্যাপ্লিকেশন যেমন চ্যাটবট, ভার্চুয়াল সহকারী এবং মিউজিক জেনারেটরের জন্য ইন্টারেক্টিভ অভিজ্ঞতা তৈরি করতে সাহায্য করবে। এই পোস্টটি আপনাকে দেখায় কিভাবে টাইম টু ফার্স্ট বাইট (TTFB) আকারে দ্রুত প্রতিক্রিয়ার সময় উপলব্ধি করা যায় এবং Llama 2 মডেলের অনুমান করার সময় সামগ্রিক অনুভূত বিলম্ব কমাতে হয়।

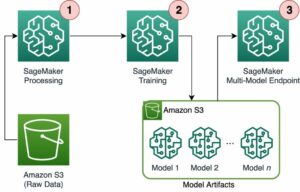

সমাধানটি বাস্তবায়নের জন্য, আমরা সম্পূর্ণরূপে পরিচালিত পরিকাঠামো, সরঞ্জাম এবং কর্মপ্রবাহের সাথে যেকোন ব্যবহারের ক্ষেত্রে ডেটা প্রস্তুত করতে এবং মেশিন লার্নিং (ML) মডেলগুলি তৈরি, প্রশিক্ষণ এবং স্থাপন করতে সম্পূর্ণরূপে পরিচালিত পরিষেবা SageMaker ব্যবহার করি৷ সেজমেকার প্রদান করে বিভিন্ন স্থাপনার বিকল্প সম্পর্কে আরও তথ্যের জন্য, পড়ুন Amazon SageMaker মডেল হোস্টিং FAQs. আসুন আমরা কীভাবে প্রতিক্রিয়া স্ট্রিমিংয়ের সাথে রিয়েল-টাইম ইনফারেন্স ব্যবহার করে লেটেন্সি সমস্যাগুলি সমাধান করতে পারি তা বোঝা যাক।

সমাধান ওভারভিউ

যেহেতু আমরা LLM-এর সাথে রিয়েল-টাইম ইনফারেন্সের সাথে যুক্ত উপরে উল্লিখিত বিলম্বগুলি সমাধান করতে চাই, আসুন প্রথমে বুঝতে পারি কিভাবে আমরা Llama 2-এর জন্য রিয়েল-টাইম ইনফারেন্সিংয়ের জন্য প্রতিক্রিয়া স্ট্রিমিং সমর্থন ব্যবহার করতে পারি। যাইহোক, যেকোনো LLM রিয়েল-এর সাথে প্রতিক্রিয়া স্ট্রিমিং সমর্থনের সুবিধা নিতে পারে। - সময়ের অনুমান।

Llama 2 হল 7 বিলিয়ন থেকে 70 বিলিয়ন প্যারামিটারের স্কেলে প্রাক-প্রশিক্ষিত এবং সূক্ষ্ম-টিউনড জেনারেটিভ টেক্সট মডেলের একটি সংগ্রহ। লামা 2 মডেলগুলি শুধুমাত্র ডিকোডার আর্কিটেকচার সহ অটোরিগ্রেসিভ মডেল। একটি প্রম্পট এবং অনুমান পরামিতি প্রদান করা হলে, Llama 2 মডেলগুলি পাঠ্য প্রতিক্রিয়া তৈরি করতে সক্ষম। এই মডেলগুলি অনুবাদ, সংক্ষিপ্তকরণ, প্রশ্নের উত্তর এবং চ্যাটের জন্য ব্যবহার করা যেতে পারে।

এই পোস্টের জন্য, আমরা লামা 2 চ্যাট মডেল স্থাপন করি meta-llama/Llama-2-13b-chat-hf রেসপন্স স্ট্রিমিং এর সাথে রিয়েল-টাইম ইনফারেন্সিং এর জন্য SageMaker-এ।

যখন সেজমেকার এন্ডপয়েন্টগুলিতে মডেল স্থাপনের কথা আসে, আপনি বিশেষায়িত ব্যবহার করে মডেলগুলিকে ধারণ করতে পারেন AWS ডিপ লার্নিং কন্টেইনার জনপ্রিয় ওপেন সোর্স লাইব্রেরির জন্য উপলব্ধ (DLC) ছবি। লামা 2 মডেলগুলি পাঠ্য প্রজন্মের মডেল; আপনি হয় ব্যবহার করতে পারেন সেজমেকারে আলিঙ্গন করা ফেস এলএলএম ইনফারেন্স কন্টেনার আলিঙ্গন মুখ দ্বারা চালিত টেক্সট জেনারেশন ইনফারেন্স (TGI) বা AWS DLC এর জন্য বড় মডেল অনুমান (এলএমআই)।

এই পোস্টে, আমরা G2 দৃষ্টান্ত দ্বারা চালিত রিয়েল-টাইম অনুমানের জন্য SageMaker হোস্টিং-এ DLC ব্যবহার করে Llama 13 5B চ্যাট মডেল স্থাপন করি। G5 দৃষ্টান্তগুলি গ্রাফিক্স-নিবিড় অ্যাপ্লিকেশন এবং ML অনুমানের জন্য একটি উচ্চ-পারফরম্যান্স GPU-ভিত্তিক উদাহরণ। আপনি ইন্সট্যান্স কনফিগারেশন অনুযায়ী উপযুক্ত পরিবর্তন সহ সমর্থিত উদাহরণ প্রকার p4d, p3, g5 এবং g4dn ব্যবহার করতে পারেন।

পূর্বশর্ত

এই সমাধান বাস্তবায়ন করতে, আপনার নিম্নলিখিত থাকা উচিত:

- একটি সঙ্গে একটি AWS অ্যাকাউন্ট এডাব্লুএস আইডেন্টিটি এবং অ্যাক্সেস ম্যানেজমেন্ট সমাধানের অংশ হিসাবে তৈরি সংস্থানগুলি পরিচালনা করার অনুমতি সহ (IAM) ভূমিকা।

- যদি এটি আপনার সাথে প্রথমবার কাজ করেন অ্যামাজন সেজমেকার স্টুডিও, আপনাকে প্রথমে একটি তৈরি করতে হবে সেজমেকার ডোমেইন.

- একটি আলিঙ্গন মুখ অ্যাকাউন্ট. নিবন্ধন করুন আপনার যদি ইতিমধ্যে অ্যাকাউন্ট না থাকে তবে আপনার ইমেলের সাথে।

- ফাইন-টিউনিং এবং অনুমান করার উদ্দেশ্যে, হাগিং ফেস-এ উপলব্ধ মডেলগুলির বিরামহীন অ্যাক্সেসের জন্য, বিশেষ করে গেটেড মডেল যেমন লামা, একটি রিড অ্যাক্সেস টোকেন পাওয়ার জন্য আপনার একটি আলিঙ্গন মুখ অ্যাকাউন্ট থাকা উচিত৷ আপনি আপনার আলিঙ্গন মুখ অ্যাকাউন্টে সাইন আপ করার পরে, লগ ইন করুন পরিদর্শন করতে https://huggingface.co/settings/tokens একটি পঠন অ্যাক্সেস টোকেন তৈরি করতে।

- Llama 2-এ অ্যাক্সেস, একই ইমেল আইডি ব্যবহার করে যা আপনি Hugging Face-এর জন্য সাইন আপ করতে ব্যবহার করেছিলেন।

- হাগিং ফেসের মাধ্যমে উপলব্ধ Llama 2 মডেলগুলি গেটেড মডেল। লামা মডেলের ব্যবহার মেটা লাইসেন্স দ্বারা পরিচালিত হয়। মডেল ওজন এবং টোকেনাইজার ডাউনলোড করতে, লামা অ্যাক্সেসের অনুরোধ করুন এবং তাদের লাইসেন্স গ্রহণ করুন।

- আপনাকে অ্যাক্সেস দেওয়ার পরে (সাধারণত কয়েক দিনের মধ্যে), আপনি একটি ইমেল নিশ্চিতকরণ পাবেন। এই উদাহরণের জন্য, আমরা মডেল ব্যবহার করি

Llama-2-13b-chat-hf, কিন্তু আপনি অন্যান্য বৈকল্পিক অ্যাক্সেস করতে সক্ষম হবেন।

পদ্ধতি 1: আলিঙ্গন মুখ TGI

এই বিভাগে, আমরা আপনাকে দেখাই কিভাবে স্থাপন করতে হয় meta-llama/Llama-2-13b-chat-hf হাগিং ফেস টিজিআই ব্যবহার করে প্রতিক্রিয়া স্ট্রিমিং সহ একটি সেজমেকার রিয়েল-টাইম এন্ডপয়েন্টের মডেল। নিম্নলিখিত সারণী এই স্থাপনার জন্য স্পেসিফিকেশন রূপরেখা.

| সবিস্তার বিবরণী | মূল্য |

| আধার | আলিঙ্গন মুখ TGI |

| ণশড | meta-llama/Llama-2-13b-chat-hf |

| এমএল উদাহরণ | ml.g5.12x বড় |

| অনুমিতি | প্রতিক্রিয়া স্ট্রিমিং সহ রিয়েল-টাইম |

মডেল মোতায়েন করুন

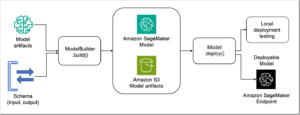

প্রথমে, আপনি LLM স্থাপনের জন্য ভিত্তি চিত্রটি পুনরুদ্ধার করুন৷ আপনি তারপর বেস ইমেজ উপর মডেল নির্মাণ. অবশেষে, আপনি রিয়েল-টাইম অনুমানের জন্য SageMaker হোস্টিং-এর এমএল উদাহরণে মডেলটি স্থাপন করেন।

চলুন লক্ষ্য করা যাক কিভাবে প্রোগ্রাম্যাটিকভাবে স্থাপনা অর্জন করা যায়। সংক্ষিপ্ততার জন্য, এই বিভাগে শুধুমাত্র যে কোডটি স্থাপনার ধাপে সাহায্য করে তা নিয়ে আলোচনা করা হয়েছে। স্থাপনার জন্য সম্পূর্ণ সোর্স কোড নোটবুকে উপলব্ধ llama-2-hf-tgi/llama-2-13b-chat-hf/1-deploy-llama-2-13b-chat-hf-tgi-sagemaker.ipynb.

প্রি-বিল্টের মাধ্যমে TGI দ্বারা চালিত সর্বশেষ Hugging Face LLM DLC পুনরুদ্ধার করুন সেজমেকার ডিএলসি. আপনি স্থাপন করতে এই ইমেজ ব্যবহার করুন meta-llama/Llama-2-13b-chat-hf সেজমেকারে মডেল। নিম্নলিখিত কোড দেখুন:

নিম্নরূপ সংজ্ঞায়িত কনফিগারেশন পরামিতি সহ মডেলের জন্য পরিবেশ সংজ্ঞায়িত করুন:

প্রতিস্থাপন করা <YOUR_HUGGING_FACE_READ_ACCESS_TOKEN> কনফিগার প্যারামিটারের জন্য HUGGING_FACE_HUB_TOKEN এই পোস্টের পূর্বশর্ত বিভাগে বিস্তারিত হিসাবে আপনার আলিঙ্গন মুখ প্রোফাইল থেকে প্রাপ্ত টোকেনের মান সহ। কনফিগারেশনে, আপনি একটি মডেলের প্রতি প্রতিলিপিতে ব্যবহৃত GPU-এর সংখ্যা 4 হিসাবে সংজ্ঞায়িত করেন SM_NUM_GPUS. তারপর আপনি স্থাপন করতে পারেন meta-llama/Llama-2-13b-chat-hf একটি ml.g5.12x বড় উদাহরণের মডেল যা 4টি GPU এর সাথে আসে।

এখন আপনি এর উদাহরণ তৈরি করতে পারেন HuggingFaceModel উপরে উল্লিখিত পরিবেশ কনফিগারেশন সহ:

পরিশেষে, মডেলে উপলব্ধ ডিপ্লয় পদ্ধতিতে আর্গুমেন্ট প্রদান করে মডেলটি স্থাপন করুন যেমন বিভিন্ন প্যারামিটার মান সহ endpoint_name, initial_instance_count, এবং instance_type:

অনুমান সম্পাদন করুন

Hugging Face TGI DLC মডেলে কোনো কাস্টমাইজেশন বা কোড পরিবর্তন ছাড়াই প্রতিক্রিয়া স্ট্রিম করার ক্ষমতা নিয়ে আসে। তুমি ব্যবহার করতে পার ইনভোক_এন্ডপয়েন্ট_সাথে_প্রতিক্রিয়া_স্ট্রিম আপনি যদি Boto3 বা ব্যবহার করেন InvokeEndpointWithResponseStream SageMaker Python SDK এর সাথে প্রোগ্রামিং করার সময়।

সার্জারির InvokeEndpointWithResponseStream SageMaker-এর API ডেভেলপারদের SageMaker মডেলগুলি থেকে প্রতিক্রিয়াগুলি স্ট্রিম করার অনুমতি দেয়, যা অনুভূত লেটেন্সি কমিয়ে গ্রাহকের সন্তুষ্টি উন্নত করতে সাহায্য করতে পারে। এটি জেনারেটিভ এআই মডেলের সাথে নির্মিত অ্যাপ্লিকেশনগুলির জন্য বিশেষভাবে গুরুত্বপূর্ণ, যেখানে সম্পূর্ণ প্রতিক্রিয়ার জন্য অপেক্ষা করার চেয়ে তাত্ক্ষণিক প্রক্রিয়াকরণ আরও গুরুত্বপূর্ণ।

এই উদাহরণের জন্য, আমরা মডেল অনুমান করতে Boto3 ব্যবহার করি এবং SageMaker API ব্যবহার করি invoke_endpoint_with_response_stream নিম্নরূপ:

যুক্তি CustomAttributes মান সেট করা হয় accept_eula=false. সার্জারির accept_eula পরামিতি সেট করা আবশ্যক true সফলভাবে Llama 2 মডেল থেকে প্রতিক্রিয়া পেতে. সফল আমন্ত্রণ ব্যবহার করার পরে invoke_endpoint_with_response_stream, পদ্ধতিটি বাইটের একটি প্রতিক্রিয়া স্ট্রীম ফিরিয়ে দেবে।

নিম্নলিখিত চিত্রটি এই কর্মপ্রবাহকে চিত্রিত করে।

আপনার একটি পুনরাবৃত্তিকারীর প্রয়োজন যা বাইটের স্রোতে লুপ করে এবং সেগুলিকে পাঠযোগ্য পাঠ্যে পার্স করে। দ্য LineIterator বাস্তবায়ন এ পাওয়া যাবে llama-2-hf-tgi/llama-2-13b-chat-hf/utils/LineIterator.py. এখন আপনি মডেলটি অনুমান করার সময় একটি পেলোড হিসাবে ব্যবহার করার জন্য প্রম্পট এবং নির্দেশাবলী প্রস্তুত করতে প্রস্তুত৷

একটি প্রম্পট এবং নির্দেশাবলী প্রস্তুত করুন

এই ধাপে, আপনি আপনার এলএলএম-এর জন্য প্রম্পট এবং নির্দেশাবলী প্রস্তুত করুন। Llama 2 প্রম্পট করার জন্য, আপনার নিম্নলিখিত প্রম্পট টেমপ্লেট থাকা উচিত:

আপনি পদ্ধতিতে প্রোগ্রাম্যাটিকভাবে সংজ্ঞায়িত প্রম্পট টেমপ্লেট তৈরি করেন build_llama2_prompt, যা পূর্বোক্ত প্রম্পট টেমপ্লেটের সাথে সারিবদ্ধ। তারপরে আপনি ব্যবহারের ক্ষেত্রে নির্দেশাবলী সংজ্ঞায়িত করুন। এই ক্ষেত্রে, আমরা মডেলটিকে একটি বিপণন প্রচারের জন্য একটি ইমেল তৈরি করার নির্দেশ দিচ্ছি get_instructions পদ্ধতি এই পদ্ধতির জন্য কোড আছে llama-2-hf-tgi/llama-2-13b-chat-hf/2-sagemaker-realtime-inference-llama-2-13b-chat-hf-tgi-streaming-response.ipynb নোটবই. বিশদভাবে সম্পাদিত কাজের সাথে মিলিত নির্দেশনা তৈরি করুন user_ask_1 নিম্নরূপ:

আমরা build_llama2_prompt দ্বারা উত্পন্ন প্রম্পট টেমপ্লেট অনুযায়ী প্রম্পট তৈরি করার নির্দেশাবলী পাস করি।

আমরা কী সহ প্রম্পট সহ অনুমান পরামিতিগুলিকে ক্লাব করি stream মান সহ True একটি চূড়ান্ত পেলোড গঠন করতে। পেলোড পাঠান get_realtime_response_stream, যা রেসপন্স স্ট্রিমিং সহ একটি এন্ডপয়েন্ট চালু করতে ব্যবহার করা হবে:

LLM থেকে জেনারেট করা টেক্সট নিচের অ্যানিমেশনে দেখানো আউটপুটে স্ট্রিম করা হবে।

পদ্ধতি 2: ডিজেএল সার্ভিং সহ LMI

এই বিভাগে, আমরা প্রদর্শন করি কিভাবে স্থাপন করা যায় meta-llama/Llama-2-13b-chat-hf ডিজেএল সার্ভিংয়ের সাথে LMI ব্যবহার করে প্রতিক্রিয়া স্ট্রিমিং সহ একটি সেজমেকার রিয়েল-টাইম এন্ডপয়েন্টের মডেল। নিম্নলিখিত সারণী এই স্থাপনার জন্য স্পেসিফিকেশন রূপরেখা.

| সবিস্তার বিবরণী | মূল্য |

| আধার | DJL পরিবেশন সহ LMI ধারক চিত্র |

| ণশড | meta-llama/Llama-2-13b-chat-hf |

| এমএল উদাহরণ | ml.g5.12x বড় |

| অনুমিতি | প্রতিক্রিয়া স্ট্রিমিং সহ রিয়েল-টাইম |

আপনি প্রথমে মডেলটি ডাউনলোড করুন এবং এটি সংরক্ষণ করুন আমাজন সিম্পল স্টোরেজ সার্ভিস (Amazon S3)। আপনি তারপরে মডেলের S3 উপসর্গ নির্দেশ করে S3 URI নির্দিষ্ট করুন৷ serving.properties ফাইল এর পরে, আপনি LLM স্থাপনের জন্য ভিত্তি চিত্রটি পুনরুদ্ধার করেন। আপনি তারপর বেস ইমেজ উপর মডেল নির্মাণ. অবশেষে, আপনি রিয়েল-টাইম অনুমানের জন্য SageMaker হোস্টিং-এর এমএল উদাহরণে মডেলটি স্থাপন করেন।

চলুন লক্ষ্য করা যাক কিভাবে পূর্বোক্ত স্থাপনার পদক্ষেপগুলি প্রোগ্রামগতভাবে অর্জন করা যায়। সংক্ষিপ্ততার জন্য, শুধুমাত্র যে কোডটি স্থাপনার ধাপে সাহায্য করে তা এই বিভাগে বিস্তারিত আছে। এই স্থাপনার জন্য সম্পূর্ণ সোর্স কোড নোটবুকে উপলব্ধ llama-2-lmi/llama-2-13b-chat/1-deploy-llama-2-13b-chat-lmi-response-streaming.ipynb.

আলিঙ্গন মুখ থেকে মডেল স্ন্যাপশট ডাউনলোড করুন এবং Amazon S3 এ মডেলের নিদর্শনগুলি আপলোড করুন

উপরে উল্লিখিত পূর্বশর্তগুলির সাথে, SageMaker নোটবুকের উদাহরণে মডেলটি ডাউনলোড করুন এবং তারপরে আরও স্থাপনের জন্য এটি S3 বালতিতে আপলোড করুন:

মনে রাখবেন যে আপনি একটি বৈধ অ্যাক্সেস টোকেন প্রদান না করলেও, মডেলটি ডাউনলোড হবে। কিন্তু আপনি যখন এই ধরনের একটি মডেল স্থাপন করেন, মডেল পরিবেশন সফল হবে না। অতএব, এটি প্রতিস্থাপন করার সুপারিশ করা হয় <YOUR_HUGGING_FACE_READ_ACCESS_TOKEN> যুক্তির জন্য token আপনার আলিঙ্গন মুখ প্রোফাইল থেকে প্রাপ্ত টোকেনের মান সহ পূর্বশর্তগুলিতে বিশদ বিবরণ দেওয়া আছে। এই পোস্টের জন্য, আমরা Llama 2-এর জন্য অফিসিয়াল মডেলের নাম উল্লেখ করি যেটি মান সহ Hugging Face-এ চিহ্নিত meta-llama/Llama-2-13b-chat-hf. আনকম্প্রেস মডেল ডাউনলোড করা হবে local_model_path পূর্বোক্ত কোড চালানোর ফলে।

Amazon S3 এ ফাইলগুলি আপলোড করুন এবং URI পান, যা পরে ব্যবহার করা হবে৷ serving.properties.

আপনি প্যাকেজিং করা হবে meta-llama/Llama-2-13b-chat-hf ডিজেএল সার্ভিং এর মাধ্যমে নির্দিষ্ট করা কনফিগারেশন ব্যবহার করে LMI কন্টেইনার ইমেজে মডেল serving.properties. তারপর আপনি SageMaker ML ইনস্ট্যান্স ml.g5.12xlarge-এ কন্টেইনার ইমেজে প্যাকেজ করা মডেল আর্টিফ্যাক্ট সহ মডেলটি স্থাপন করুন। তারপরে আপনি রিয়েল-টাইম ইনফারেন্সিংয়ের জন্য সেজমেকার হোস্টিংয়ের জন্য এই এমএল উদাহরণটি ব্যবহার করুন।

DJL পরিবেশনের জন্য মডেল আর্টিফ্যাক্ট প্রস্তুত করুন

একটি তৈরি করে আপনার মডেল নিদর্শন প্রস্তুত করুন serving.properties কনফিগারেশন ফাইল:

আমরা এই কনফিগারেশন ফাইলে নিম্নলিখিত সেটিংস ব্যবহার করি:

- ইঞ্জিন - এটি ডিজেএল ব্যবহারের জন্য রানটাইম ইঞ্জিন নির্দিষ্ট করে। সম্ভাব্য মান অন্তর্ভুক্ত

Python,DeepSpeed,FasterTransformer, এবংMPI. এই ক্ষেত্রে, আমরা এটি সেটMPI. মডেল প্যারালালাইজেশন এবং ইনফারেন্স (MPI) সমস্ত উপলব্ধ GPU তে মডেলটিকে বিভাজন করার সুবিধা দেয় এবং তাই অনুমানকে ত্বরান্বিত করে। - option.entryPoint - এই বিকল্পটি নির্দিষ্ট করে যে ডিজেএল সার্ভিং দ্বারা অফার করা হ্যান্ডলার আপনি ব্যবহার করতে চান৷ সম্ভাব্য মান হল

djl_python.huggingface,djl_python.deepspeed, এবংdjl_python.stable-diffusion। আমরা ব্যাবহার করিdjl_python.huggingfaceআলিঙ্গন মুখ ত্বরান্বিত জন্য. - option.tensor_parallel_degree – এই বিকল্পটি মডেলে সম্পাদিত টেনসর সমান্তরাল পার্টিশনের সংখ্যা নির্দিষ্ট করে। আপনি GPU ডিভাইসের সংখ্যা সেট করতে পারেন যার উপর মডেলটি পার্টিশন করতে হবে। এই প্যারামিটারটি মডেল প্রতি কর্মীদের সংখ্যা নিয়ন্ত্রণ করে যেগুলি DJL পরিবেশন চলাকালীন শুরু হবে। উদাহরণস্বরূপ, যদি আমাদের একটি 4টি জিপিইউ মেশিন থাকে এবং আমরা চারটি পার্টিশন তৈরি করি, তাহলে অনুরোধগুলি পরিবেশন করার জন্য আমাদের প্রতি মডেলে একজন কর্মী থাকবে।

- option.low_cpu_mem_usage - মডেল লোড করার সময় এটি CPU মেমরির ব্যবহার হ্রাস করে। আমরা সুপারিশ করি যে আপনি এটি সেট করুন৷

TRUE. - option.rolling_batch - এটি সমর্থিত কৌশলগুলির একটি ব্যবহার করে পুনরাবৃত্তি-স্তরের ব্যাচিং সক্ষম করে। মান অন্তর্ভুক্ত

auto,scheduler, এবংlmi-dist। আমরা ব্যাবহার করিlmi-distLlama 2 এর জন্য একটানা ব্যাচিং চালু করার জন্য। - option.max_rolling_batch_size - এটি ক্রমাগত ব্যাচে সমকালীন অনুরোধের সংখ্যা সীমিত করে। মান ডিফল্ট 32.

- option.model_id - আপনার প্রতিস্থাপন করা উচিত

{{model_id}}একটি এর ভিতরে হোস্ট করা একটি প্রাক-প্রশিক্ষিত মডেলের মডেল আইডি সহ আলিঙ্গন মুখে মডেল সংগ্রহস্থল অথবা মডেল আর্টিফ্যাক্টের S3 পথ।

আরও কনফিগারেশন বিকল্প পাওয়া যাবে কনফিগারেশন এবং সেটিংস.

যেহেতু DJL সার্ভিং আশা করে যে মডেল আর্টিফ্যাক্টগুলি প্যাকেজ করা হবে এবং একটি .tar ফাইলে ফরম্যাট করা হবে, তাই .tar ফাইলটিকে কম্প্রেস করতে এবং Amazon S3 এ আপলোড করতে নিম্নলিখিত কোড স্নিপেটটি চালান:

DJL পরিবেশন সহ সর্বশেষ LMI কন্টেইনার চিত্র পুনরুদ্ধার করুন

এরপরে, আপনি মডেলটি স্থাপন করতে LMI-এর জন্য SageMaker-এর সাথে উপলব্ধ DLC ব্যবহার করুন। এর জন্য SageMaker ইমেজ URI পুনরুদ্ধার করুন djl-deepspeed নিম্নলিখিত কোড ব্যবহার করে প্রোগ্রাম্যাটিকভাবে ধারক:

আপনি স্থাপন করতে পূর্বোক্ত ইমেজ ব্যবহার করতে পারেন meta-llama/Llama-2-13b-chat-hf সেজমেকারে মডেল। এখন আপনি মডেল তৈরি করতে এগিয়ে যেতে পারেন.

মডেল তৈরি করুন

আপনি মডেল তৈরি করতে পারেন যার ধারক ব্যবহার করে নির্মিত হয় inference_image_uri এবং S3 URI-তে অবস্থিত মডেল সার্ভিং কোড দ্বারা নির্দেশিত s3_code_artifact:

এখন আপনি শেষ পয়েন্ট কনফিগারেশনের জন্য সমস্ত বিবরণ সহ মডেল কনফিগারেশন তৈরি করতে পারেন।

মডেল কনফিগারেশন তৈরি করুন

দ্বারা চিহ্নিত মডেলের জন্য একটি মডেল কনফিগার তৈরি করতে নিম্নলিখিত কোড ব্যবহার করুন model_name:

মডেল কনফিগার এর জন্য সংজ্ঞায়িত করা হয় ProductionVariants স্থিতিমাপ InstanceType ML উদাহরণের জন্য ml.g5.12xlarge. এছাড়াও আপনি প্রদান ModelName আপনি আগের ধাপে মডেলটি তৈরি করতে যে নামটি ব্যবহার করেছিলেন সেই একই নাম ব্যবহার করে, যার ফলে মডেল এবং এন্ডপয়েন্ট কনফিগারেশনের মধ্যে একটি সম্পর্ক স্থাপন করা হয়।

এখন আপনি মডেল এবং মডেল কনফিগারেশন সংজ্ঞায়িত করেছেন, আপনি সেজমেকার এন্ডপয়েন্ট তৈরি করতে পারেন।

সেজমেকার এন্ডপয়েন্ট তৈরি করুন

নিম্নলিখিত কোড স্নিপেট ব্যবহার করে মডেল স্থাপন করতে শেষ পয়েন্ট তৈরি করুন:

আপনি নিম্নলিখিত কোড স্নিপেট ব্যবহার করে স্থাপনার অগ্রগতি দেখতে পারেন:

স্থাপনা সফল হওয়ার পরে, শেষ পয়েন্টের অবস্থা হবে InService. এখন যেহেতু এন্ডপয়েন্ট প্রস্তুত, চলুন রেসপন্স স্ট্রিমিং এর মাধ্যমে অনুমান করা যাক।

প্রতিক্রিয়া স্ট্রিমিং সহ রিয়েল-টাইম অনুমান

যেমনটি আমরা আলিঙ্গন মুখ TGI এর জন্য পূর্বের পদ্ধতিতে কভার করেছি, আপনি একই পদ্ধতি ব্যবহার করতে পারেন get_realtime_response_stream সেজমেকার এন্ডপয়েন্ট থেকে প্রতিক্রিয়া স্ট্রিমিং আহ্বান করতে। LMI পদ্ধতি ব্যবহার করে অনুমান করার জন্য কোড আছে llama-2-lmi/llama-2-13b-chat/2-inference-llama-2-13b-chat-lmi-response-streaming.ipynb নোটবই. দ্য LineIterator বাস্তবায়ন অবস্থিত llama-2-lmi/utils/LineIterator.py। নোট করুন যে LineIterator LMI কন্টেইনারে স্থাপন করা Llama 2 চ্যাট মডেলের থেকে আলাদা LineIterator আলিঙ্গন মুখ TGI বিভাগে উল্লেখ করা হয়েছে. দ্য LineIterator LMI ধারক দ্বারা অনুমান করা Llama 2 চ্যাট মডেল থেকে বাইট স্ট্রীমের উপর লুপ djl-deepspeed সংস্করণ 0.25.0। নিম্নলিখিত সাহায্যকারী ফাংশন এর মাধ্যমে করা অনুমান অনুরোধ থেকে প্রাপ্ত প্রতিক্রিয়া স্ট্রীম পার্স করবে invoke_endpoint_with_response_stream এপিআই:

পূর্ববর্তী পদ্ধতিটি দ্বারা পঠিত ডেটার প্রবাহ প্রিন্ট করে LineIterator মানুষের-পাঠযোগ্য বিন্যাসে।

মডেলটি অনুমান করার সময় পেলোড হিসাবে ব্যবহার করার জন্য প্রম্পট এবং নির্দেশাবলী কীভাবে প্রস্তুত করা যায় তা অন্বেষণ করা যাক।

যেহেতু আপনি Hugging Face TGI এবং LMI উভয় ক্ষেত্রেই একই মডেলের অনুমান করছেন, তাই প্রম্পট এবং নির্দেশাবলী প্রস্তুত করার প্রক্রিয়া একই। অতএব, আপনি পদ্ধতি ব্যবহার করতে পারেন get_instructions এবং build_llama2_prompt অনুমান করার জন্য।

সার্জারির get_instructions পদ্ধতি নির্দেশাবলী প্রদান করে। বিশদভাবে সম্পাদিত কাজের সাথে সম্মিলিত নির্দেশাবলী তৈরি করুন user_ask_2 নিম্নরূপ:

দ্বারা উত্পন্ন প্রম্পট টেমপ্লেট অনুযায়ী প্রম্পট তৈরি করার নির্দেশাবলী পাস করুন build_llama2_prompt:

আমরা একটি চূড়ান্ত পেলোড গঠনের জন্য প্রম্পটের সাথে অনুমানের পরামিতিগুলিকে ক্লাব করি। তারপর আপনি পেলোড পাঠান get_realtime_response_stream, যা রেসপন্স স্ট্রিমিং সহ একটি এন্ডপয়েন্ট আহ্বান করতে ব্যবহৃত হয়:

LLM থেকে জেনারেট করা টেক্সট নিচের অ্যানিমেশনে দেখানো আউটপুটে স্ট্রিম করা হবে।

পরিষ্কার কর

অপ্রয়োজনীয় চার্জ এড়াতে, ব্যবহার করুন এডাব্লুএস ম্যানেজমেন্ট কনসোল পোস্টে উল্লিখিত পদ্ধতিগুলি চালানোর সময় তৈরি করা শেষ পয়েন্ট এবং এর সাথে সম্পর্কিত সংস্থানগুলি মুছতে। উভয় স্থাপনার পদ্ধতির জন্য, নিম্নলিখিত ক্লিনআপ রুটিন সম্পাদন করুন:

প্রতিস্থাপন করা <SageMaker_Real-time_Endpoint_Name> পরিবর্তনশীল জন্য endpoint_name প্রকৃত শেষ বিন্দু সহ।

দ্বিতীয় পদ্ধতির জন্য, আমরা Amazon S3 এ মডেল এবং কোড আর্টিফ্যাক্ট সংরক্ষণ করেছি। আপনি নিম্নলিখিত কোড ব্যবহার করে S3 বালতি পরিষ্কার করতে পারেন:

উপসংহার

এই পোস্টে, আমরা আলোচনা করেছি যে কীভাবে বিভিন্ন সংখ্যক প্রতিক্রিয়া টোকেন বা অনুমান প্যারামিটারের একটি ভিন্ন সেট এলএলএম-এর সাথে যুক্ত বিলম্বকে প্রভাবিত করতে পারে। প্রতিক্রিয়া স্ট্রিমিংয়ের সাহায্যে কীভাবে সমস্যাটি সমাধান করা যায় তা আমরা দেখিয়েছি। আমরা তখন AWS DLCs-LMI এবং Hugging Face TGI ব্যবহার করে Llama 2 চ্যাট মডেল স্থাপন এবং অনুমান করার জন্য দুটি পন্থা চিহ্নিত করেছি।

আপনার এখন স্ট্রিমিং প্রতিক্রিয়ার গুরুত্ব এবং এটি কীভাবে অনুভূত বিলম্ব কমাতে পারে তা বোঝা উচিত। স্ট্রিমিং প্রতিক্রিয়া ব্যবহারকারীর অভিজ্ঞতা উন্নত করতে পারে, যা অন্যথায় আপনাকে LLM সম্পূর্ণ প্রতিক্রিয়া তৈরি না হওয়া পর্যন্ত অপেক্ষা করতে বাধ্য করবে। উপরন্তু, প্রতিক্রিয়া স্ট্রিমিং সহ Llama 2 চ্যাট মডেল স্থাপন করা ব্যবহারকারীর অভিজ্ঞতা উন্নত করে এবং আপনার গ্রাহকদের খুশি করে।

আপনি অফিসিয়াল aws-নমুনা উল্লেখ করতে পারেন amazon-sagemaker-llama2-প্রতিক্রিয়া-স্ট্রিমিং-রেসিপি যেটি অন্যান্য Llama 2 মডেল ভেরিয়েন্টের জন্য স্থাপনা কভার করে।

তথ্যসূত্র

লেখক সম্পর্কে

পবন কুমার রাও নাভুলে অ্যামাজন ওয়েব সার্ভিসের একজন সলিউশন আর্কিটেক্ট। তিনি ভারতে ISV-এর সাথে কাজ করে তাদের AWS-এ উদ্ভাবন করতে সাহায্য করেন। তিনি "ভি প্রোগ্রামিং দিয়ে শুরু করা" বইয়ের একজন প্রকাশিত লেখক। তিনি ইন্ডিয়ান ইনস্টিটিউট অফ টেকনোলজি (IIT), হায়দ্রাবাদ থেকে ডেটা সায়েন্সে এক্সিকিউটিভ এম.টেক করেছেন। এছাড়াও তিনি ইন্ডিয়ান স্কুল অফ বিজনেস ম্যানেজমেন্ট অ্যান্ড অ্যাডমিনিস্ট্রেশন থেকে আইটি স্পেশালাইজেশানে এক্সিকিউটিভ এমবিএ করেছেন এবং ভ্যাগদেবী ইনস্টিটিউট অফ টেকনোলজি অ্যান্ড সায়েন্স থেকে ইলেকট্রনিক্স অ্যান্ড কমিউনিকেশন ইঞ্জিনিয়ারিংয়ে বি.টেক করেছেন৷ পবন একজন AWS সার্টিফাইড সলিউশন আর্কিটেক্ট প্রফেশনাল এবং অন্যান্য সার্টিফিকেশন যেমন AWS সার্টিফাইড মেশিন লার্নিং স্পেশালিটি, মাইক্রোসফট সার্টিফাইড প্রফেশনাল (MCP), এবং Microsoft সার্টিফাইড টেকনোলজি স্পেশালিস্ট (MCTS) রয়েছে। তিনি একজন ওপেন সোর্স উত্সাহীও। তার অবসর সময়ে, তিনি সিয়া এবং রিহানার দুর্দান্ত জাদুকরী কণ্ঠ শুনতে পছন্দ করেন।

পবন কুমার রাও নাভুলে অ্যামাজন ওয়েব সার্ভিসের একজন সলিউশন আর্কিটেক্ট। তিনি ভারতে ISV-এর সাথে কাজ করে তাদের AWS-এ উদ্ভাবন করতে সাহায্য করেন। তিনি "ভি প্রোগ্রামিং দিয়ে শুরু করা" বইয়ের একজন প্রকাশিত লেখক। তিনি ইন্ডিয়ান ইনস্টিটিউট অফ টেকনোলজি (IIT), হায়দ্রাবাদ থেকে ডেটা সায়েন্সে এক্সিকিউটিভ এম.টেক করেছেন। এছাড়াও তিনি ইন্ডিয়ান স্কুল অফ বিজনেস ম্যানেজমেন্ট অ্যান্ড অ্যাডমিনিস্ট্রেশন থেকে আইটি স্পেশালাইজেশানে এক্সিকিউটিভ এমবিএ করেছেন এবং ভ্যাগদেবী ইনস্টিটিউট অফ টেকনোলজি অ্যান্ড সায়েন্স থেকে ইলেকট্রনিক্স অ্যান্ড কমিউনিকেশন ইঞ্জিনিয়ারিংয়ে বি.টেক করেছেন৷ পবন একজন AWS সার্টিফাইড সলিউশন আর্কিটেক্ট প্রফেশনাল এবং অন্যান্য সার্টিফিকেশন যেমন AWS সার্টিফাইড মেশিন লার্নিং স্পেশালিটি, মাইক্রোসফট সার্টিফাইড প্রফেশনাল (MCP), এবং Microsoft সার্টিফাইড টেকনোলজি স্পেশালিস্ট (MCTS) রয়েছে। তিনি একজন ওপেন সোর্স উত্সাহীও। তার অবসর সময়ে, তিনি সিয়া এবং রিহানার দুর্দান্ত জাদুকরী কণ্ঠ শুনতে পছন্দ করেন।

সুধাংশু হেটে AWS-এর প্রধান AI/ML বিশেষজ্ঞ এবং ক্লায়েন্টদের তাদের MLOps এবং জেনারেটিভ AI যাত্রার বিষয়ে পরামর্শ দেওয়ার জন্য তাদের সাথে কাজ করে। Amazon-এর আগে তার আগের ভূমিকায়, তিনি গ্রাউন্ড-আপ ওপেন সোর্স-ভিত্তিক AI এবং গ্যামিফিকেশন প্ল্যাটফর্ম তৈরি করতে দলগুলিকে ধারণা, তৈরি এবং নেতৃত্ব দিয়েছিলেন এবং 100 টিরও বেশি ক্লায়েন্টের সাথে সফলভাবে বাণিজ্যিকীকরণ করেছিলেন। সুধাংশু তার কৃতিত্বের জন্য কয়েকটি পেটেন্ট, দুটি বই এবং বেশ কয়েকটি গবেষণাপত্র এবং ব্লগ লিখেছেন এবং বিভিন্ন প্রযুক্তিগত ফোরামে তার দৃষ্টিভঙ্গি উপস্থাপন করেছেন। তিনি একজন চিন্তাশীল নেতা এবং বক্তা ছিলেন এবং প্রায় 25 বছর ধরে শিল্পে রয়েছেন। তিনি সারা বিশ্বে ফরচুন 1000 ক্লায়েন্টদের সাথে কাজ করেছেন এবং সম্প্রতি ভারতে ডিজিটাল নেটিভ ক্লায়েন্টদের সাথে কাজ করেছেন।

সুধাংশু হেটে AWS-এর প্রধান AI/ML বিশেষজ্ঞ এবং ক্লায়েন্টদের তাদের MLOps এবং জেনারেটিভ AI যাত্রার বিষয়ে পরামর্শ দেওয়ার জন্য তাদের সাথে কাজ করে। Amazon-এর আগে তার আগের ভূমিকায়, তিনি গ্রাউন্ড-আপ ওপেন সোর্স-ভিত্তিক AI এবং গ্যামিফিকেশন প্ল্যাটফর্ম তৈরি করতে দলগুলিকে ধারণা, তৈরি এবং নেতৃত্ব দিয়েছিলেন এবং 100 টিরও বেশি ক্লায়েন্টের সাথে সফলভাবে বাণিজ্যিকীকরণ করেছিলেন। সুধাংশু তার কৃতিত্বের জন্য কয়েকটি পেটেন্ট, দুটি বই এবং বেশ কয়েকটি গবেষণাপত্র এবং ব্লগ লিখেছেন এবং বিভিন্ন প্রযুক্তিগত ফোরামে তার দৃষ্টিভঙ্গি উপস্থাপন করেছেন। তিনি একজন চিন্তাশীল নেতা এবং বক্তা ছিলেন এবং প্রায় 25 বছর ধরে শিল্পে রয়েছেন। তিনি সারা বিশ্বে ফরচুন 1000 ক্লায়েন্টদের সাথে কাজ করেছেন এবং সম্প্রতি ভারতে ডিজিটাল নেটিভ ক্লায়েন্টদের সাথে কাজ করেছেন।

- এসইও চালিত বিষয়বস্তু এবং পিআর বিতরণ। আজই পরিবর্ধিত পান।

- PlatoData.Network উল্লম্ব জেনারেটিভ Ai. নিজেকে ক্ষমতায়িত করুন। এখানে প্রবেশ করুন.

- প্লেটোএআইস্ট্রিম। Web3 ইন্টেলিজেন্স। জ্ঞান প্রসারিত. এখানে প্রবেশ করুন.

- প্লেটোইএসজি। কার্বন, ক্লিনটেক, শক্তি, পরিবেশ সৌর, বর্জ্য ব্যবস্থাপনা. এখানে প্রবেশ করুন.

- প্লেটো হেলথ। বায়োটেক এবং ক্লিনিক্যাল ট্রায়াল ইন্টেলিজেন্স। এখানে প্রবেশ করুন.

- উত্স: https://aws.amazon.com/blogs/machine-learning/inference-llama-2-models-with-real-time-response-streaming-using-amazon-sagemaker/

- : আছে

- : হয়

- :কোথায়

- $ ইউপি

- 1

- 10

- 100

- 11

- 12

- 14

- 15%

- 150

- 16

- 19

- 1st

- 25

- 32

- 385

- 50

- 7

- 70

- 8

- 9

- a

- ক্ষমতা

- সক্ষম

- সম্পর্কে

- দ্রুততর করা

- খানি

- বেগবর্ধক ব্যক্তি

- সমর্থন দিন

- প্রবেশ

- হিসাব

- অর্জন করা

- দিয়ে

- কর্ম

- আসল

- উপরন্তু

- ঠিকানা

- প্রশাসন

- পোষ্যপুত্র গ্রহণ করা

- গ্রহণ

- সুবিধা

- পরামর্শ

- প্রভাবিত

- পর

- AI

- এআই মডেল

- এআই / এমএল

- এলিস

- সারিবদ্ধ

- সব

- অনুমতি

- অনুমতি

- বরাবর

- ইতিমধ্যে

- এছাড়াও

- মর্দানী স্ত্রীলোক

- আমাজন সেজমেকার

- অ্যামাজন ওয়েব সার্ভিসেস

- an

- এবং

- অ্যানিমেশন

- ঘোষিত

- ঘোষণা

- কোন

- API

- অ্যাপ্লিকেশন

- অভিগমন

- পন্থা

- যথাযথ

- স্থাপত্য

- স্থাপত্য

- রয়েছি

- যুক্তি

- আর্গুমেন্ট

- AS

- সহায়ক

- যুক্ত

- At

- লেখক

- সহজলভ্য

- এড়াতে

- ডেস্কটপ AWS

- পিছনে

- ভিত্তি

- Batching

- BE

- কারণ

- হয়েছে

- আগে

- মধ্যে

- তার পরেও

- বিলিয়ন

- কোটি কোটি

- বিন

- ব্লগ

- শরীর

- বই

- বই

- উভয়

- নির্মাণ করা

- তৈরী করে

- নির্মিত

- ব্যবসায়

- কিন্তু

- by

- কল

- ক্যাম্পেইন

- CAN

- সক্ষম

- কেস

- সার্টিফিকেশন

- প্রত্যয়িত

- পরিবর্তন

- চার্জ

- চ্যাট

- chatbots

- পরিষ্কার

- মক্কেল

- ক্লায়েন্ট

- ক্লাব

- কোড

- সংগ্রহ

- এর COM

- মিলিত

- আসে

- যোগাযোগ

- সহগামী

- কনফিগারেশন

- অনুমোদন

- আধার

- কন্টেনারগুলি

- একটানা

- একটানা

- নিয়ন্ত্রণগুলি

- পারা

- দম্পতি

- কুপন

- আবৃত

- কভার

- সৃষ্টি

- নির্মিত

- সৃষ্টি

- তৈরি করা হচ্ছে

- ধার

- ক্রেতা

- গ্রাহক সন্তুষ্টি

- গ্রাহকদের

- উপাত্ত

- তথ্য বিজ্ঞান

- দিন

- গভীর

- গভীর জ্ঞানার্জন

- অক্ষমতা

- নির্ধারণ করা

- সংজ্ঞায়িত

- বিলম্বিত

- প্রদর্শন

- স্থাপন

- মোতায়েন

- মোতায়েন

- বিস্তৃতি

- বিশদ

- বিস্তারিত

- ডেভেলপারদের

- ডিভাইস

- বিভিন্ন

- ডিজিটাল

- আলোচনা

- Dont

- ডাউনলোড

- সময়

- পূর্বে

- পারেন

- ইলেক্ট্রনিক্স

- ইমেইল

- সম্ভব

- শেষপ্রান্ত

- ইঞ্জিন

- প্রকৌশল

- কৌতূহলী ব্যক্তি

- সমগ্র

- পরিবেশ

- বিশেষত

- প্রতিষ্ঠার

- এমন কি

- উদাহরণ

- কার্যনির্বাহী

- আশা করা

- আশা

- অভিজ্ঞতা

- অভিজ্ঞতা

- অন্বেষণ করুণ

- মুখ

- সমাধা

- মিথ্যা

- দ্রুত

- ফাইল

- নথি পত্র

- চূড়ান্ত

- পরিশেষে

- প্রথম

- প্রথমবার

- অনুসরণ

- অনুসরণ

- জন্য

- ফর্ম

- বিন্যাস

- ভাগ্য

- ফোরাম

- পাওয়া

- ভিত

- চার

- বিনামূল্যে

- থেকে

- সম্পূর্ণ

- সম্পূর্ণরূপে

- ক্রিয়া

- অধিকতর

- অনুপাত হল

- গেটেড

- উত্পাদন করা

- উত্পন্ন

- উৎপাদিত

- প্রজন্ম

- সৃজক

- জেনারেটিভ এআই

- জেনারেটর

- পাওয়া

- GIF

- পৃথিবী

- Go

- পরিচালিত

- জিপিইউ

- জিপিইউ

- মঞ্জুর

- মহান

- খুশি

- ঘৃণা

- আছে

- he

- সাহায্য

- সাহায্য

- উচ্চ পারদর্শিতা

- ঊর্ধ্বতন

- তার

- ঝুলিতে

- হোস্ট

- হোস্টিং

- কিভাবে

- কিভাবে

- যাহোক

- এইচটিএমএল

- HTTP

- HTTPS দ্বারা

- জড়িয়ে আছে

- মানব পাঠযোগ্য

- ID

- চিহ্নিত

- পরিচয়

- if

- প্রকাশ

- ভাবমূর্তি

- চিত্র

- আশু

- বাস্তবায়ন

- বাস্তবায়ন

- আমদানি

- গুরুত্ব

- গুরুত্বপূর্ণ

- উন্নত করা

- উন্নত

- in

- অন্তর্ভুক্ত করা

- সুদ্ধ

- ভারত

- ভারতীয়

- জ্ঞাপিত

- শিল্প

- তথ্য

- পরিকাঠামো

- পরিবর্তন করা

- ইনপুট

- ইনপুট

- ভিতরে

- উদাহরণ

- পরিবর্তে

- প্রতিষ্ঠান

- নির্দেশাবলী

- ইন্টারেক্টিভ

- Internet

- সমস্যা

- IT

- এর

- যাত্রা

- JSON

- চাবি

- কুমার

- ভাষা

- বড়

- অদৃশ্যতা

- বিলম্ব সমস্যা

- পরে

- সর্বশেষ

- শুরু করা

- নেতৃত্ব

- নেতা

- শিক্ষা

- বরফ

- লম্বা

- লাইব্রেরি

- লাইসেন্স

- মত

- সীমা

- লাইন

- শোনা

- শিখা

- LLM

- বোঝাই

- অবস্থিত

- ভালবাসে

- মেশিন

- মেশিন লার্নিং

- প্রণীত

- করা

- তৈরি করে

- পরিচালনা করা

- পরিচালিত

- ব্যবস্থাপনা

- Marketing

- সর্বোচ্চ

- মে..

- MCP

- স্মৃতি

- উল্লিখিত

- মেটা

- পদ্ধতি

- পদ্ধতি

- মাইক্রোসফট

- লক্ষ লক্ষ

- ML

- এমএলওএস

- মডেল

- মডেল

- মাসের

- অধিক

- সেতু

- সঙ্গীত

- অবশ্যই

- নাম

- নামে

- স্থানীয়

- প্রায়

- প্রয়োজন

- চাহিদা

- নতুন

- পরবর্তী

- বিঃদ্রঃ

- নোটবই

- এখন

- সংখ্যা

- বস্তু

- মান্য করা

- প্রাপ্ত

- প্রাপ্ত

- of

- প্রদত্ত

- কর্মকর্তা

- প্রায়ই

- on

- ONE

- কেবল

- খোলা

- ওপেন সোর্স

- পছন্দ

- অপশন সমূহ

- or

- অন্যান্য

- অন্যভাবে

- প্রান্তরেখা

- আউটপুট

- শেষ

- সামগ্রিক

- গাঁটবন্দী

- প্যাকেজিং

- কাগজপত্র

- সমান্তরাল

- স্থিতিমাপ

- পরামিতি

- অংশ

- পাস

- পেটেন্ট

- পথ

- প্রতি

- অনুভূত

- সম্পাদন করা

- সম্পাদিত

- অনুমতি

- প্ল্যাটফর্ম

- Plato

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটোডাটা

- পয়েন্ট

- জনপ্রিয়

- সম্ভব

- পোস্ট

- চালিত

- পূর্ববর্তী

- প্রস্তুত করা

- প্রস্তুতি

- পূর্বশর্ত

- উপস্থাপন

- আগে

- অধ্যক্ষ

- কপি করে প্রিন্ট

- সমস্যা

- এগিয়ে

- প্রক্রিয়া

- প্রক্রিয়াকৃত

- প্রক্রিয়াজাতকরণ

- পণ্য

- পণ্য উদ্বোধন

- পেশাদারী

- প্রোফাইল

- প্রোগ্রামিং

- উন্নতি

- বৈশিষ্ট্য

- প্রদান

- প্রদত্ত

- উপলব্ধ

- প্রদানের

- প্রকাশিত

- উদ্দেশ্য

- পাইথন

- পাইটার্চ

- প্রশ্ন

- রেঞ্জিং

- দ্রুত

- বরং

- পড়া

- প্রস্তুত

- বাস্তব

- প্রকৃত সময়

- সাধা

- গ্রহণ করা

- গৃহীত

- সম্প্রতি

- সুপারিশ করা

- সুপারিশ করা

- হ্রাস করা

- হ্রাস

- হ্রাস

- পড়ুন

- সম্পর্ক

- প্রতিস্থাপন করা

- অবিকল প্রতিরুপ

- সংগ্রহস্থলের

- অনুরোধ

- অনুরোধ

- Resources

- প্রতিক্রিয়া

- প্রতিক্রিয়া

- প্রতিক্রিয়া

- ফল

- প্রত্যাবর্তন

- আয়

- ভূমিকা

- দৈনন্দিন

- চালান

- দৌড়

- রান

- রানটাইম

- ঋষি নির্মাতা

- একই

- সন্তোষ

- স্কেল

- স্কুল

- বিজ্ঞান

- SDK

- নির্বিঘ্ন

- দ্বিতীয়

- অধ্যায়

- দেখ

- পাঠান

- পাঠায়

- পরিবেশন করা

- সেবা

- সেবা

- ভজনা

- সেট

- সেটিংস

- বিভিন্ন

- সংক্ষিপ্ত

- উচিত

- প্রদর্শনী

- দেখিয়েছেন

- প্রদর্শিত

- শো

- চিহ্ন

- সহজ

- স্ন্যাপশট

- টুকিটাকি

- সমাধান

- সলিউশন

- শীঘ্রই

- উৎস

- সোর্স কোড

- বক্তা

- বিশেষজ্ঞ

- বিশেষজ্ঞ

- বিশিষ্টতা

- স্পেসিফিকেশনের

- নিদিষ্ট

- শুরু

- অবস্থা

- ধাপ

- প্রারম্ভিক ব্যবহারের নির্দেশাবলী

- থামুন

- স্টোরেজ

- দোকান

- সঞ্চিত

- কৌশল

- প্রবাহ

- স্ট্রীম

- স্ট্রিমিং

- স্ট্রিমিং পরিষেবা

- সফল

- সফল

- সফলভাবে

- এমন

- সমর্থন

- সমর্থিত

- সমর্থন

- টেবিল

- গ্রহণ করা

- কার্য

- দল

- প্রযুক্তি

- কারিগরী

- প্রযুক্তিঃ

- টেমপ্লেট

- পাঠ

- চেয়ে

- যে

- সার্জারির

- তাদের

- তাহাদিগকে

- তারপর

- সেখানে।

- যার ফলে

- অতএব

- এইগুলো

- তারা

- এই

- যদিও?

- চিন্তা

- থ্রুপুট

- সময়

- বার

- থেকে

- টোকেন

- টোকেন

- সরঞ্জাম

- রেলগাড়ি

- অনুবাদ

- সত্য

- বাঁক

- দুই

- আদর্শ

- ধরনের

- সাধারণত

- বোঝা

- অপ্রয়োজনীয়

- পর্যন্ত

- ব্যবহার

- ব্যবহার

- ব্যবহার ক্ষেত্রে

- ব্যবহৃত

- ব্যবহারকারী

- ব্যবহারকারীর অভিজ্ঞতা

- ব্যবহার

- বৈধ

- মূল্য

- মানগুলি

- পরিবর্তনশীল

- বিভিন্ন

- অসমজ্ঞ্জস

- সুবিশাল

- সংস্করণ

- মাধ্যমে

- চেক

- ভার্চুয়াল

- দেখুন

- ভয়েস

- অপেক্ষা করুন

- প্রতীক্ষা

- প্রয়োজন

- we

- ওয়েব

- ওয়েব সার্ভিস

- আমরা একটি

- ছিল

- কখন

- যে

- যখন

- সমগ্র

- যাহার

- ইচ্ছা

- সঙ্গে

- মধ্যে

- ছাড়া

- কাজ করছে

- কর্মী

- শ্রমিকদের

- কর্মপ্রবাহ

- কর্মপ্রবাহ

- কাজ

- কাজ

- would

- লেখা

- লিখিত

- বছর

- আপনি

- আপনার

- zephyrnet