কেটি কর্পোরেশন দক্ষিণ কোরিয়ার অন্যতম বৃহত্তম টেলিযোগাযোগ প্রদানকারী, ফিক্সড-লাইন টেলিফোন, মোবাইল যোগাযোগ, এবং ইন্টারনেট এবং এআই পরিষেবা সহ বিস্তৃত পরিসরের পরিষেবা অফার করে৷ কেটি-এর এআই ফুড ট্যাগ হল একটি এআই-ভিত্তিক খাদ্যতালিকাগত ব্যবস্থাপনার সমাধান যা একটি কম্পিউটার ভিশন মডেল ব্যবহার করে ফটোতে খাবারের ধরন এবং পুষ্টি উপাদান চিহ্নিত করে। কেটি দ্বারা বিকশিত এই দৃষ্টি মডেলটি বিভিন্ন খাবারের পুষ্টির বিষয়বস্তু এবং ক্যালোরি তথ্য বিশ্লেষণ করার জন্য প্রচুর পরিমাণে লেবেলবিহীন চিত্র ডেটা সহ প্রাক-প্রশিক্ষিত একটি মডেলের উপর নির্ভর করে। এআই ফুড ট্যাগ ডায়াবেটিসের মতো দীর্ঘস্থায়ী রোগে আক্রান্ত রোগীদের তাদের খাদ্যাভ্যাস পরিচালনা করতে সাহায্য করতে পারে। কেটি AWS ব্যবহার করেছে এবং আমাজন সেজমেকার এই এআই ফুড ট্যাগ মডেলটিকে আগের চেয়ে 29 গুণ দ্রুত প্রশিক্ষণ দিতে এবং একটি মডেল পাতন কৌশলের সাথে উত্পাদন স্থাপনের জন্য এটিকে অপ্টিমাইজ করতে। এই পোস্টে, আমরা SageMaker ব্যবহার করে KT-এর মডেল ডেভেলপমেন্ট যাত্রা এবং সাফল্য বর্ণনা করি।

কেটি প্রকল্প প্রবর্তন এবং সমস্যা সংজ্ঞায়িত করা

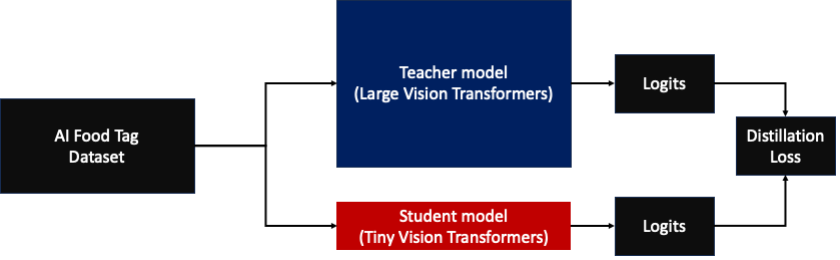

কেটি দ্বারা প্রি-প্রশিক্ষিত AI ফুড ট্যাগ মডেলটি ভিশন ট্রান্সফরমার (ViT) আর্কিটেকচারের উপর ভিত্তি করে এবং নির্ভুলতা উন্নত করতে তাদের পূর্ববর্তী ভিশন মডেলের তুলনায় আরও বেশি মডেল প্যারামিটার রয়েছে। উৎপাদনের জন্য মডেলের আকার সঙ্কুচিত করার জন্য, KT একটি নলেজ ডিস্টিলেশন (KD) কৌশল ব্যবহার করছে যাতে নির্ভুলতার উপর উল্লেখযোগ্য প্রভাব ছাড়াই মডেল প্যারামিটারের সংখ্যা কমানো যায়। জ্ঞান পাতনের সাথে, প্রাক-প্রশিক্ষিত মডেলকে বলা হয় a শিক্ষক মডেল, এবং একটি লাইটওয়েট আউটপুট মডেল একটি হিসাবে প্রশিক্ষিত হয় ছাত্র মডেল, নিম্নলিখিত চিত্রে চিত্রিত হিসাবে। লাইটওয়েট স্টুডেন্ট মডেলে শিক্ষকের তুলনায় কম মডেল প্যারামিটার রয়েছে, যা মেমরির প্রয়োজনীয়তা হ্রাস করে এবং ছোট, কম ব্যয়বহুল উদাহরণগুলিতে স্থাপনের অনুমতি দেয়। শিক্ষক মডেলের আউটপুট থেকে শেখার মাধ্যমে ছাত্র গ্রহণযোগ্য নির্ভুলতা বজায় রাখে যদিও এটি ছোট।

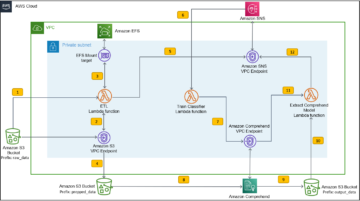

KD চলাকালীন শিক্ষক মডেল অপরিবর্তিত থাকে, কিন্তু ছাত্র মডেলকে শিক্ষক মডেলের আউটপুট লগিট ব্যবহার করে ক্ষতি গণনা করার জন্য লেবেল হিসেবে প্রশিক্ষণ দেওয়া হয়। এই KD দৃষ্টান্তের সাথে, শিক্ষক এবং ছাত্র উভয়কেই প্রশিক্ষণের জন্য একক GPU মেমরিতে থাকতে হবে। KT প্রাথমিকভাবে তাদের অভ্যন্তরীণ, অন-প্রিমিসেস পরিবেশে দুটি GPUs (A100 80 GB) ব্যবহার করে ছাত্র মডেলকে প্রশিক্ষণ দেয়, কিন্তু প্রক্রিয়াটি 40টি যুগকে কভার করতে প্রায় 300 দিন সময় নেয়। প্রশিক্ষণ ত্বরান্বিত করতে এবং কম সময়ে একটি ছাত্র মডেল তৈরি করতে, KT AWS এর সাথে অংশীদারিত্ব করেছে। একসাথে, দলগুলি মডেল প্রশিক্ষণের সময় উল্লেখযোগ্যভাবে হ্রাস করেছে। এই পোস্টটি দলটি কীভাবে ব্যবহার করেছে তা বর্ণনা করে আমাজন সেজমেকার প্রশিক্ষণ, দ্য সেজমেকার ডেটা সমান্তরালতা গ্রন্থাগার, আমাজন সেজমেকার ডিবাগার, এবং অ্যামাজন সেজমেকার প্রোফাইলার সফলভাবে একটি লাইটওয়েট এআই ফুড ট্যাগ মডেল তৈরি করতে।

SageMaker এর সাথে একটি বিতরণ করা প্রশিক্ষণ পরিবেশ তৈরি করা

SageMaker Training হল AWS-এ একটি ম্যানেজড মেশিন লার্নিং (ML) প্রশিক্ষণ পরিবেশ যা প্রশিক্ষণের অভিজ্ঞতাকে সহজ করার জন্য বৈশিষ্ট্য এবং সরঞ্জামগুলির একটি স্যুট প্রদান করে এবং বিতরণ করা কম্পিউটিং-এ উপযোগী হতে পারে, যেমনটি নিচের চিত্রে দেখানো হয়েছে।

সেজমেকার গ্রাহকরা বিভিন্ন পূর্ব-ইন্সটল করা ডিপ লার্নিং ফ্রেমওয়ার্ক এবং মডেল প্রশিক্ষণের জন্য প্রয়োজনীয় লিনাক্স, এনসিসিএল এবং পাইথন প্যাকেজ সহ বিল্ট-ইন ডকার ইমেজগুলিও অ্যাক্সেস করতে পারেন। ডেটা সায়েন্টিস্ট বা এমএল ইঞ্জিনিয়ার যারা মডেল ট্রেনিং চালাতে চান তারা প্রশিক্ষণের অবকাঠামো কনফিগার করার বা ডকার পরিচালনার বোঝা ছাড়া এবং বিভিন্ন লাইব্রেরির সামঞ্জস্য ছাড়াই তা করতে পারেন।

1 দিনের কর্মশালার সময়, আমরা KT-এর AWS অ্যাকাউন্টের মধ্যে SageMaker-এর উপর ভিত্তি করে একটি বিতরণ করা প্রশিক্ষণ কনফিগারেশন সেট আপ করতে সক্ষম হয়েছি, SageMaker ডিস্ট্রিবিউটেড ডেটা প্যারালাল (DDP) লাইব্রেরি ব্যবহার করে KT-এর প্রশিক্ষণ স্ক্রিপ্টগুলিকে ত্বরান্বিত করতে এবং এমনকি দুই মিলি ব্যবহার করে একটি প্রশিক্ষণের কাজ পরীক্ষা করতে সক্ষম হয়েছি। p4d.24x বড় দৃষ্টান্ত। এই বিভাগে, আমরা AWS টিমের সাথে কাজ করার এবং SageMaker ব্যবহার করে তাদের মডেল তৈরি করার জন্য KT-এর অভিজ্ঞতা বর্ণনা করি।

ধারণার প্রমাণে, আমরা সেজমেকার ডিডিপি লাইব্রেরি ব্যবহার করে একটি প্রশিক্ষণের কাজ দ্রুত করতে চেয়েছিলাম, যা বিতরণ করা প্রশিক্ষণের সময় AWS পরিকাঠামোর জন্য অপ্টিমাইজ করা হয়েছে। PyTorch DDP থেকে SageMaker DDP-তে পরিবর্তন করতে, আপনাকে কেবল ঘোষণা করতে হবে torch_smddp প্যাকেজ এবং ব্যাকএন্ড পরিবর্তন করুন smddp, নিম্নলিখিত কোডে দেখানো হয়েছে:

সেজমেকার ডিডিপি লাইব্রেরি সম্পর্কে আরও জানতে, পড়ুন সেজমেকারের ডেটা প্যারালেলিজম লাইব্রেরি.

সেজমেকার ডিবাগার এবং প্রোফাইলারের সাথে ধীর প্রশিক্ষণের গতির কারণগুলি বিশ্লেষণ করা

প্রশিক্ষণের কাজের চাপকে অপ্টিমাইজ করার এবং ত্বরান্বিত করার প্রথম ধাপে কোথায় কোন বাধা সৃষ্টি হয় তা বোঝা এবং নির্ণয় করা জড়িত। কেটি-এর প্রশিক্ষণ কাজের জন্য, আমরা ডেটা লোডার, ফরোয়ার্ড পাস এবং ব্যাকওয়ার্ড পাসের পুনরাবৃত্তির প্রশিক্ষণের সময় পরিমাপ করেছি:

| 1 বার সময় - ডেটালোডার: 0.00053 সেকেন্ড, ফরোয়ার্ড: 7.77474 সেকেন্ড, পিছনে: 1.58002 শুষ্ক |

| 2 বার সময় - ডেটালোডার: 0.00063 সেকেন্ড, ফরোয়ার্ড: 0.67429 সেকেন্ড, পিছনে: 24.74539 শুষ্ক |

| 3 বার সময় - ডেটালোডার: 0.00061 সেকেন্ড, ফরোয়ার্ড: 0.90976 সেকেন্ড, পিছনে: 8.31253 শুষ্ক |

| 4 বার সময় - ডেটালোডার: 0.00060 সেকেন্ড, ফরোয়ার্ড: 0.60958 সেকেন্ড, পিছনে: 30.93830 শুষ্ক |

| 5 বার সময় - ডেটালোডার: 0.00080 সেকেন্ড, ফরোয়ার্ড: 0.83237 সেকেন্ড, পিছনে: 8.41030 শুষ্ক |

| 6 বার সময় - ডেটালোডার: 0.00067 সেকেন্ড, ফরোয়ার্ড: 0.75715 সেকেন্ড, পিছনে: 29.88415 শুষ্ক |

প্রতিটি পুনরাবৃত্তির জন্য স্ট্যান্ডার্ড আউটপুটে সময়ের দিকে তাকিয়ে, আমরা দেখেছি যে পশ্চাদগামী পাসের রান টাইম পুনরাবৃত্তি থেকে পুনরাবৃত্তিতে উল্লেখযোগ্যভাবে ওঠানামা করেছে। এই বৈচিত্রটি অস্বাভাবিক এবং মোট প্রশিক্ষণের সময়কে প্রভাবিত করতে পারে। এই অসামঞ্জস্যপূর্ণ প্রশিক্ষণের গতির কারণ খুঁজে বের করার জন্য, আমরা প্রথমে সিস্টেম মনিটর (সেজমেকার ডিবাগার UI) ব্যবহার করে সংস্থানগুলির বাধাগুলি সনাক্ত করার চেষ্টা করেছি, যা আপনাকে সেজমেকার প্রশিক্ষণে প্রশিক্ষণের কাজগুলি ডিবাগ করতে এবং পরিচালিত প্রশিক্ষণ প্ল্যাটফর্মের মতো সংস্থানগুলির অবস্থা দেখতে দেয়। CPU, GPU, নেটওয়ার্ক, এবং I/O নির্দিষ্ট সেকেন্ডের মধ্যে।

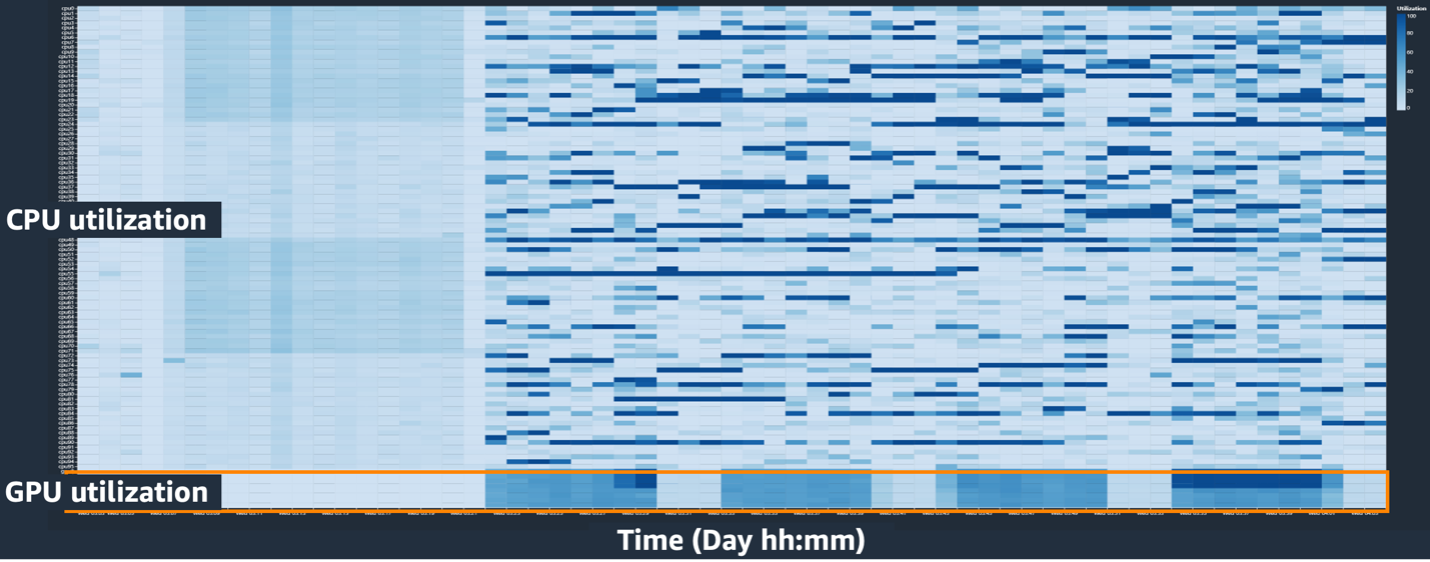

সেজমেকার ডিবাগার UI বিশদ এবং প্রয়োজনীয় ডেটা সরবরাহ করে যা প্রশিক্ষণের কাজের বাধাগুলি সনাক্ত করতে এবং নির্ণয় করতে সহায়তা করতে পারে। বিশেষ করে, সিপিইউ ইউটিলাইজেশন লাইন চার্ট এবং সিপিইউ/জিপিইউ ইউটিলাইজেশন হিট ম্যাপ প্রতি ইন্সট্যান্স টেবিল আমাদের নজর কেড়েছে।

CPU ইউটিলাইজেশন লাইন চার্টে, আমরা লক্ষ্য করেছি যে কিছু CPU 100% ব্যবহার করা হচ্ছে।

হিট ম্যাপে (যেখানে গাঢ় রং উচ্চতর ব্যবহার নির্দেশ করে), আমরা লক্ষ করেছি যে কয়েকটি CPU কোরের পুরো প্রশিক্ষণ জুড়ে উচ্চ ব্যবহার ছিল, যেখানে GPU ব্যবহার সময়ের সাথে ধারাবাহিকভাবে বেশি ছিল না।

এখান থেকে, আমরা সন্দেহ করতে শুরু করি যে ধীর প্রশিক্ষণের গতির একটি কারণ হল একটি CPU বাধা। আমরা ট্রেনিং স্ক্রিপ্ট কোড পর্যালোচনা করেছি যে কিছু CPU বাধা সৃষ্টি করছে কিনা। সবচেয়ে সন্দেহজনক অংশ বড় মান ছিল num_workers ডেটা লোডারে, তাই আমরা CPU ব্যবহার কমাতে এই মানটিকে 0 বা 1 এ পরিবর্তন করেছি। তারপরে আমরা আবার প্রশিক্ষণের কাজ চালিয়েছি এবং ফলাফল পরীক্ষা করেছি।

নিচের স্ক্রিনশটগুলি CPU ইউটিলাইজেশন লাইন চার্ট, GPU ইউটিলাইজেশন, এবং CPU বাধা প্রশমিত করার পরে হিট ম্যাপ দেখায়।

শুধু পরিবর্তন করে num_workers, আমরা CPU ব্যবহারে উল্লেখযোগ্য হ্রাস এবং GPU ব্যবহারের সামগ্রিক বৃদ্ধি দেখেছি। এটি একটি গুরুত্বপূর্ণ পরিবর্তন যা প্রশিক্ষণের গতিকে উল্লেখযোগ্যভাবে উন্নত করেছে। তবুও, আমরা দেখতে চেয়েছিলাম কোথায় আমরা GPU ব্যবহার অপ্টিমাইজ করতে পারি। এর জন্য, আমরা সেজমেকার প্রোফাইলার ব্যবহার করেছি।

সেজমেকার প্রোফাইলার অপ্টিমাইজেশান ক্লুগুলি সনাক্ত করতে সাহায্য করে অপারেশনের মাধ্যমে ব্যবহারে দৃশ্যমানতা প্রদান করে, যার মধ্যে ট্র্যাকিং জিপিইউ এবং সিপিইউ ইউটিলাইজেশন মেট্রিক্স এবং ট্রেনিং স্ক্রিপ্টের মধ্যে জিপিইউ/সিপিইউ-এর কার্নেল ব্যবহার। এটি ব্যবহারকারীদের বুঝতে সাহায্য করে যে কোন অপারেশনগুলি সম্পদ ব্যবহার করছে। প্রথমত, সেজমেকার প্রোফাইলার ব্যবহার করতে, আপনাকে যোগ করতে হবে ProfilerConfig SageMaker SDK ব্যবহার করে যে ফাংশনটি প্রশিক্ষণের কাজ শুরু করে, তা নিম্নলিখিত কোডে দেখানো হয়েছে:

SageMaker Python SDK-তে, আপনার যোগ করার নমনীয়তা আছে annotate SageMaker Profiler-এর জন্য ফাংশন কোড বা প্রশিক্ষণ স্ক্রিপ্টের ধাপ নির্বাচন করার জন্য যার প্রোফাইলিং প্রয়োজন। প্রশিক্ষণের স্ক্রিপ্টগুলিতে সেজমেকার প্রোফাইলারের জন্য আপনাকে যে কোডটি ঘোষণা করা উচিত তার একটি উদাহরণ নীচে দেওয়া হল:

পূর্ববর্তী কোড যোগ করার পরে, আপনি যদি প্রশিক্ষণের স্ক্রিপ্টগুলি ব্যবহার করে একটি প্রশিক্ষণের কাজ চালান, তবে আপনি একটি নির্দিষ্ট সময়ের জন্য প্রশিক্ষণ চলার পরে GPU কার্নেল (নিচের চিত্রে দেখানো হয়েছে) দ্বারা ব্যবহৃত ক্রিয়াকলাপ সম্পর্কে তথ্য পেতে পারেন। কেটি-এর প্রশিক্ষণ স্ক্রিপ্টের ক্ষেত্রে, আমরা এটিকে এক যুগের জন্য চালিয়েছি এবং নিম্নলিখিত ফলাফল পেয়েছি।

যখন আমরা সেজমেকার প্রোফাইলারের ফলাফলগুলির মধ্যে জিপিইউ কার্নেলের শীর্ষ পাঁচটি অপারেশন খরচের সময় পরীক্ষা করেছি, তখন আমরা দেখতে পেয়েছি যে কেটি প্রশিক্ষণ স্ক্রিপ্টের জন্য, ম্যাট্রিক্স পণ্য অপারেশন দ্বারা সর্বাধিক সময় ব্যয় করা হয়, যা একটি সাধারণ ম্যাট্রিক্স গুণন (GEMM) অপারেশন। GPU-তে। SageMaker প্রোফাইলার থেকে এই গুরুত্বপূর্ণ অন্তর্দৃষ্টি দিয়ে, আমরা এই ক্রিয়াকলাপগুলিকে ত্বরান্বিত করার এবং GPU ব্যবহার উন্নত করার উপায়গুলি অনুসন্ধান শুরু করেছি৷

প্রশিক্ষণের সময় ত্বরান্বিত করা

আমরা ম্যাট্রিক্স গুণের গণনার সময় কমানোর বিভিন্ন উপায় পর্যালোচনা করেছি এবং দুটি PyTorch ফাংশন প্রয়োগ করেছি।

জিরোরেডানডেন্সি অপ্টিমাইজারের সাথে শার্ড অপ্টিমাইজার বলে

আপনি যদি তাকান জিরো রিডানডেন্সি অপ্টিমাইজার (জিরো), DeepSpeed/ZeRO কৌশলটি মডেলের দ্বারা ব্যবহৃত মেমরির অপ্রয়োজনীয়তা দূর করে একটি বৃহৎ মডেলের দক্ষতার সাথে ভাল প্রশিক্ষণের গতির প্রশিক্ষণ সক্ষম করে। জিরোরিডানডেন্সি অপ্টিমাইজার পাইটর্চে ডিস্ট্রিবিউটেড ডেটা প্যারালাল (ডিডিপি) এ একটি প্রক্রিয়ার প্রতি মেমরির ব্যবহার কমাতে অপ্টিমাইজার স্টেট শার্ড করার কৌশল ব্যবহার করে। ডিডিপি ব্যাকওয়ার্ড পাসে সিঙ্ক্রোনাইজড গ্রেডিয়েন্ট ব্যবহার করে যাতে সমস্ত অপ্টিমাইজারের প্রতিলিপি একই প্যারামিটার এবং গ্রেডিয়েন্ট মানের উপর পুনরাবৃত্তি করে, কিন্তু সমস্ত মডেল প্যারামিটার থাকার পরিবর্তে, মেমরির ব্যবহার কমাতে শুধুমাত্র বিভিন্ন ডিডিপি প্রক্রিয়ার জন্য শার্ডিংয়ের মাধ্যমে প্রতিটি অপ্টিমাইজার অবস্থা বজায় রাখা হয়।

এটি ব্যবহার করতে, আপনি আপনার বিদ্যমান অপ্টিমাইজারটি রেখে যেতে পারেন৷ optimizer_class এবং একটি ঘোষণা ZeroRedundancyOptimizer মডেলের বাকি প্যারামিটার এবং পরামিতি হিসাবে শেখার হার সহ।

স্বয়ংক্রিয় মিশ্র নির্ভুলতা

স্বয়ংক্রিয় মিশ্র নির্ভুলতা (এএমপি) কিছু অপারেশনের জন্য torch.float32 ডেটা টাইপ ব্যবহার করে এবং torch.bfloat16 বা torch.float16 অন্যদের জন্য, দ্রুত গণনার সুবিধার জন্য এবং মেমরির ব্যবহার হ্রাস। বিশেষ করে, যেহেতু ডিপ লার্নিং মডেলগুলি সাধারণত তাদের কম্পিউটেশনে ভগ্নাংশ বিটের চেয়ে এক্সপোনেন্ট বিটের প্রতি বেশি সংবেদনশীল, তাই torch.bfloat16 হল torch.float32-এর এক্সপোনেন্ট বিটের সমতুল্য, যাতে তারা ন্যূনতম ক্ষতি সহ দ্রুত শিখতে পারে। torch.bfloat16 শুধুমাত্র A100 NVIDIA আর্কিটেকচার (Ampere) বা উচ্চতর, যেমন ml.p4d.24xlarge, ml.p4de.24xlarge, এবং ml.p5.48xlarge এর ক্ষেত্রে চলে।

এএমপি প্রয়োগ করতে, আপনি ঘোষণা করতে পারেন torch.cuda.amp.autocast উপরের কোডে দেখানো ট্রেনিং স্ক্রিপ্টে এবং ঘোষণা করুন dtype torch.bfloat16 হিসাবে।

SageMaker প্রোফাইলার ফলাফল

ট্রেনিং স্ক্রিপ্টগুলিতে দুটি ফাংশন প্রয়োগ করার পরে এবং আবার এক যুগের জন্য ট্রেনের কাজ চালানোর পরে, আমরা সেজমেকার প্রোফাইলারে GPU কার্নেলের জন্য শীর্ষ পাঁচটি অপারেশন ব্যবহারের সময় পরীক্ষা করেছি। নিম্নলিখিত চিত্র আমাদের ফলাফল দেখায়.

আমরা দেখতে পাচ্ছি যে GEMM অপারেশন, যা দুটি টর্চ ফাংশন প্রয়োগ করার আগে তালিকার শীর্ষে ছিল, শীর্ষ পাঁচটি অপারেশন থেকে অদৃশ্য হয়ে গেছে, ReduceScatter অপারেশন দ্বারা প্রতিস্থাপিত হয়েছে, যা সাধারণত বিতরণ করা প্রশিক্ষণে ঘটে।

কেটি পাতিত মডেলের প্রশিক্ষণের গতির ফলাফল

দুটি টর্চ ফাংশন প্রয়োগ করার ফলে মেমরি সঞ্চয়ের জন্য আমরা প্রশিক্ষণ ব্যাচের আকার আরও 128 বৃদ্ধি করেছি, যার ফলে চূড়ান্ত ব্যাচের আকার 1152 এর পরিবর্তে 1024 হয়েছে। চূড়ান্ত ছাত্র মডেলের প্রশিক্ষণ প্রতি 210 দিনে 1টি যুগ চালাতে সক্ষম হয়েছিল। ; কেটি-এর অভ্যন্তরীণ প্রশিক্ষণ পরিবেশ এবং সেজমেকারের মধ্যে প্রশিক্ষণের সময় এবং গতি নিম্নলিখিত সারণীতে সংক্ষিপ্ত করা হয়েছে।

| প্রশিক্ষণ পরিবেশ | প্রশিক্ষণ GPU বৈশিষ্ট্য. | GPU এর সংখ্যা | প্রশিক্ষণের সময় (ঘন্টা) | কাল | প্রতি যুগে ঘন্টা | হ্রাসকৃত অনুপাত |

| KT এর অভ্যন্তরীণ প্রশিক্ষণ পরিবেশ | A100 (80 গিগাবাইট) | 2 | 960 | 300 | 3.20 | 29 |

| আমাজন সেজমেকার | A100 (40 গিগাবাইট) | 32 | 24 | 210 | 0.11 | 1 |

AWS-এর স্কেলেবিলিটি আমাদের প্রাঙ্গনে 29টির পরিবর্তে 32টি GPU ব্যবহার করার আগে থেকে 2 গুণ দ্রুত প্রশিক্ষণের কাজটি সম্পূর্ণ করতে দেয়। ফলস্বরূপ, সেজমেকারে আরও জিপিইউ ব্যবহার করে প্রশিক্ষণের সময় উল্লেখযোগ্যভাবে হ্রাস পাবে এবং সামগ্রিক প্রশিক্ষণের খরচের কোনো পার্থক্য নেই।

উপসংহার

কেটি-এর কনভারজেন্স টেকনোলজি সেন্টারের AI2XL ল্যাব থেকে পার্ক স্যাং-মিন (ভিশন এআই সার্ভিং টেকনোলজি টিম লিডার) এআই ফুড ট্যাগ মডেল তৈরি করতে AWS-এর সাথে সহযোগিতার বিষয়ে মন্তব্য করেছেন:

“সম্প্রতি, দৃষ্টি ক্ষেত্রে আরও ট্রান্সফরমার-ভিত্তিক মডেল থাকায়, মডেলের পরামিতি এবং প্রয়োজনীয় GPU মেমরি বাড়ছে। আমরা এই সমস্যাটি সমাধান করার জন্য হালকা প্রযুক্তি ব্যবহার করছি, এবং এটি শিখতে অনেক সময় লাগে, প্রায় এক মাস। AWS-এর সাথে এই PoC-এর মাধ্যমে, আমরা SageMaker Profiler এবং Debugger-এর সাহায্যে রিসোর্সের প্রতিবন্ধকতাগুলি চিহ্নিত করতে পেরেছি, সেগুলি সমাধান করতে পেরেছি এবং তারপর SageMaker-এর ডেটা প্যারালেলিজম লাইব্রেরি ব্যবহার করে চার ml.p4d-এ অপ্টিমাইজ করা মডেল কোড সহ প্রায় এক দিনের মধ্যে প্রশিক্ষণ সম্পূর্ণ করতে পেরেছি। 24x বড় দৃষ্টান্ত।"

সেজমেকার সাং-মিনের দলকে মডেল প্রশিক্ষণ এবং উন্নয়নে কয়েক সপ্তাহের সময় বাঁচাতে সাহায্য করেছে।

ভিশন মডেলের এই সহযোগিতার উপর ভিত্তি করে, AWS এবং SageMaker টিম SageMaker ক্ষমতা প্রয়োগের মাধ্যমে মডেল উন্নয়ন এবং পরিষেবা উত্পাদনশীলতা উন্নত করতে বিভিন্ন AI/ML গবেষণা প্রকল্পে KT-এর সাথে সহযোগিতা চালিয়ে যাবে।

সেজমেকারে সম্পর্কিত বৈশিষ্ট্যগুলি সম্পর্কে আরও জানতে, নিম্নলিখিতগুলি দেখুন:

লেখক সম্পর্কে

ইয়ংজুন চোই, AI/ML Expert SA, একজন ডেভেলপার, আর্কিটেক্ট এবং ডেটা সায়েন্টিস্ট হিসেবে ম্যানুফ্যাকচারিং, হাই-টেক, এবং ফিনান্সের মতো বিভিন্ন শিল্পে এন্টারপ্রাইজ আইটি-এর অভিজ্ঞতা রয়েছে। তিনি মেশিন লার্নিং এবং গভীর শিক্ষার উপর গবেষণা পরিচালনা করেন, বিশেষ করে হাইপারপ্যারামিটার অপ্টিমাইজেশান এবং ডোমেন অভিযোজন, অ্যালগরিদম এবং কাগজপত্র উপস্থাপনের মতো বিষয়গুলিতে। AWS-এ, তিনি শিল্প জুড়ে AI/ML-এ বিশেষজ্ঞ, বিতরণ করা প্রশিক্ষণ/বড় স্কেল মডেল এবং MLOps তৈরির জন্য AWS পরিষেবা ব্যবহার করে প্রযুক্তিগত বৈধতা প্রদান করে। তিনি AI/ML ইকোসিস্টেমের সম্প্রসারণে অবদান রাখার লক্ষ্যে স্থাপত্যের প্রস্তাব ও পর্যালোচনা করেন।

ইয়ংজুন চোই, AI/ML Expert SA, একজন ডেভেলপার, আর্কিটেক্ট এবং ডেটা সায়েন্টিস্ট হিসেবে ম্যানুফ্যাকচারিং, হাই-টেক, এবং ফিনান্সের মতো বিভিন্ন শিল্পে এন্টারপ্রাইজ আইটি-এর অভিজ্ঞতা রয়েছে। তিনি মেশিন লার্নিং এবং গভীর শিক্ষার উপর গবেষণা পরিচালনা করেন, বিশেষ করে হাইপারপ্যারামিটার অপ্টিমাইজেশান এবং ডোমেন অভিযোজন, অ্যালগরিদম এবং কাগজপত্র উপস্থাপনের মতো বিষয়গুলিতে। AWS-এ, তিনি শিল্প জুড়ে AI/ML-এ বিশেষজ্ঞ, বিতরণ করা প্রশিক্ষণ/বড় স্কেল মডেল এবং MLOps তৈরির জন্য AWS পরিষেবা ব্যবহার করে প্রযুক্তিগত বৈধতা প্রদান করে। তিনি AI/ML ইকোসিস্টেমের সম্প্রসারণে অবদান রাখার লক্ষ্যে স্থাপত্যের প্রস্তাব ও পর্যালোচনা করেন।

জং হুন কিম AWS কোরিয়ার SA একটি অ্যাকাউন্ট। হাই-টেক, ম্যানুফ্যাকচারিং, ফিনান্স এবং পাবলিক সেক্টরের মতো বিভিন্ন শিল্পে অ্যাপ্লিকেশন আর্কিটেকচার ডিজাইন, ডেভেলপমেন্ট এবং সিস্টেম মডেলিংয়ের অভিজ্ঞতার ভিত্তিতে, তিনি এডব্লিউএস ক্লাউড যাত্রা এবং এন্টারপ্রাইজ গ্রাহকদের জন্য AWS-এ ওয়ার্কলোড অপ্টিমাইজেশানে কাজ করছেন।

জং হুন কিম AWS কোরিয়ার SA একটি অ্যাকাউন্ট। হাই-টেক, ম্যানুফ্যাকচারিং, ফিনান্স এবং পাবলিক সেক্টরের মতো বিভিন্ন শিল্পে অ্যাপ্লিকেশন আর্কিটেকচার ডিজাইন, ডেভেলপমেন্ট এবং সিস্টেম মডেলিংয়ের অভিজ্ঞতার ভিত্তিতে, তিনি এডব্লিউএস ক্লাউড যাত্রা এবং এন্টারপ্রাইজ গ্রাহকদের জন্য AWS-এ ওয়ার্কলোড অপ্টিমাইজেশানে কাজ করছেন।

রক সাকং কেটি R&D-এর একজন গবেষক। তিনি বিভিন্ন ক্ষেত্রে দৃষ্টি AI এর জন্য গবেষণা ও উন্নয়ন পরিচালনা করেছেন এবং প্রধানত মুখের বৈশিষ্ট্য (লিঙ্গ/চশমা, টুপি ইত্যাদি)/মুখের সাথে সম্পর্কিত মুখ শনাক্তকরণ প্রযুক্তি পরিচালনা করেছেন। বর্তমানে, তিনি দৃষ্টি মডেলের জন্য হালকা প্রযুক্তিতে কাজ করছেন।

রক সাকং কেটি R&D-এর একজন গবেষক। তিনি বিভিন্ন ক্ষেত্রে দৃষ্টি AI এর জন্য গবেষণা ও উন্নয়ন পরিচালনা করেছেন এবং প্রধানত মুখের বৈশিষ্ট্য (লিঙ্গ/চশমা, টুপি ইত্যাদি)/মুখের সাথে সম্পর্কিত মুখ শনাক্তকরণ প্রযুক্তি পরিচালনা করেছেন। বর্তমানে, তিনি দৃষ্টি মডেলের জন্য হালকা প্রযুক্তিতে কাজ করছেন।

মনোজ রবি অ্যামাজন সেজমেকারের একজন সিনিয়র প্রোডাক্ট ম্যানেজার। তিনি পরবর্তী প্রজন্মের AI পণ্য তৈরির বিষয়ে উত্সাহী এবং গ্রাহকদের জন্য বড় আকারের মেশিন লার্নিং সহজ করতে সফ্টওয়্যার এবং সরঞ্জামগুলিতে কাজ করেন৷ তিনি হাস স্কুল অফ বিজনেস থেকে এমবিএ এবং কার্নেগি মেলন ইউনিভার্সিটি থেকে ইনফরমেশন সিস্টেম ম্যানেজমেন্টে মাস্টার্স করেছেন। তার অবসর সময়ে, মনোজ টেনিস খেলা এবং ল্যান্ডস্কেপ ফটোগ্রাফি অনুসরণ করে।

মনোজ রবি অ্যামাজন সেজমেকারের একজন সিনিয়র প্রোডাক্ট ম্যানেজার। তিনি পরবর্তী প্রজন্মের AI পণ্য তৈরির বিষয়ে উত্সাহী এবং গ্রাহকদের জন্য বড় আকারের মেশিন লার্নিং সহজ করতে সফ্টওয়্যার এবং সরঞ্জামগুলিতে কাজ করেন৷ তিনি হাস স্কুল অফ বিজনেস থেকে এমবিএ এবং কার্নেগি মেলন ইউনিভার্সিটি থেকে ইনফরমেশন সিস্টেম ম্যানেজমেন্টে মাস্টার্স করেছেন। তার অবসর সময়ে, মনোজ টেনিস খেলা এবং ল্যান্ডস্কেপ ফটোগ্রাফি অনুসরণ করে।

রবার্ট ভ্যান ডুসেন অ্যামাজন সেজমেকারের একজন সিনিয়র প্রোডাক্ট ম্যানেজার। তিনি গভীর শিক্ষার প্রশিক্ষণের জন্য ফ্রেমওয়ার্ক, কম্পাইলার এবং অপ্টিমাইজেশন কৌশলগুলির নেতৃত্ব দেন।

রবার্ট ভ্যান ডুসেন অ্যামাজন সেজমেকারের একজন সিনিয়র প্রোডাক্ট ম্যানেজার। তিনি গভীর শিক্ষার প্রশিক্ষণের জন্য ফ্রেমওয়ার্ক, কম্পাইলার এবং অপ্টিমাইজেশন কৌশলগুলির নেতৃত্ব দেন।

- এসইও চালিত বিষয়বস্তু এবং পিআর বিতরণ। আজই পরিবর্ধিত পান।

- PlatoData.Network উল্লম্ব জেনারেটিভ Ai. নিজেকে ক্ষমতায়িত করুন। এখানে প্রবেশ করুন.

- প্লেটোএআইস্ট্রিম। Web3 ইন্টেলিজেন্স। জ্ঞান প্রসারিত. এখানে প্রবেশ করুন.

- প্লেটোইএসজি। কার্বন, ক্লিনটেক, শক্তি, পরিবেশ সৌর, বর্জ্য ব্যবস্থাপনা. এখানে প্রবেশ করুন.

- প্লেটো হেলথ। বায়োটেক এবং ক্লিনিক্যাল ট্রায়াল ইন্টেলিজেন্স। এখানে প্রবেশ করুন.

- উত্স: https://aws.amazon.com/blogs/machine-learning/kts-journey-to-reduce-training-time-for-a-vision-transformers-model-using-amazon-sagemaker/

- : আছে

- : হয়

- :কোথায়

- $ ইউপি

- 1

- 10

- 100

- 11

- 12

- 15%

- 22

- 29

- 32

- 378

- 40

- 7

- 710

- 80

- a

- সক্ষম

- সম্পর্কে

- উপরে

- দ্রুততর করা

- ত্বরক

- গ্রহণযোগ্য

- প্রবেশ

- হিসাব

- সঠিকতা

- দিয়ে

- অভিযোজন

- যোগ

- যোগ

- পর

- আবার

- AI

- এআই পরিষেবা

- এআই / এমএল

- লক্ষ্য

- আলগোরিদিম

- সব

- অনুমতি

- অনুমতি

- অনুমতি

- এছাড়াও

- মর্দানী স্ত্রীলোক

- আমাজন সেজমেকার

- অ্যামাজন ওয়েব সার্ভিসেস

- মধ্যে

- পরিমাণ

- amp

- an

- বিশ্লেষণ করা

- এবং

- কিছু

- অ্যাপ্লিকেশন

- ফলিত

- প্রয়োগ করা

- প্রয়োগ করা হচ্ছে

- স্থাপত্য

- রয়েছি

- AS

- At

- বৈশিষ্ট্যাবলী

- ডেস্কটপ AWS

- ব্যাক-এন্ড

- ভিত্তি

- BE

- কারণ

- আগে

- শুরু হয়

- হচ্ছে

- উত্তম

- মধ্যে

- উভয়

- বাধা

- ভবন

- বিল্ট-ইন

- বোঝা

- ব্যবসায়

- কিন্তু

- by

- গণনা করা

- নামক

- CAN

- পেতে পারি

- ক্ষমতা

- কার্নেগী মেলন

- কেস

- ধরা

- কারণ

- কারণসমূহ

- যার ফলে

- কেন্দ্র

- পরিবর্তন

- পরিবর্তিত

- পরিবর্তন

- তালিকা

- চেক

- চেক করা হয়েছে

- মেঘ

- কোড

- সহযোগিতা করা

- সহযোগিতা

- মন্তব্য

- যোগাযোগ

- সঙ্গতি

- সম্পূর্ণ

- গণনা

- গণনা

- কম্পিউটার

- কম্পিউটার ভিশন

- কম্পিউটিং

- ধারণা

- পরিচালিত

- কনফিগারেশন

- ধারাবাহিকভাবে

- ক্ষয়প্রাপ্ত

- গ্রাসকারী

- খরচ

- বিষয়বস্তু

- অবিরত

- অবদান

- সুবিধা

- অভিসৃতি

- খরচ

- পারা

- আবরণ

- এখন

- গ্রাহকদের

- গাঢ়

- উপাত্ত

- তথ্য বিজ্ঞানী

- দিন

- দিন

- DDP

- হ্রাস

- গভীর

- গভীর জ্ঞানার্জন

- সংজ্ঞা

- বিস্তৃতি

- বর্ণনা করা

- নকশা

- বিশদ

- বিকাশ

- উন্নত

- বিকাশকারী

- উন্নয়ন

- ডায়াবেটিস

- নির্ণয় করা হচ্ছে

- পার্থক্য

- বিভিন্ন

- রোগ

- বণ্টিত

- ডিস্ট্রিবিউটেড কম্পিউটিং

- বিতরণ করা প্রশিক্ষণ

- do

- ডকশ্রমিক

- ডোমেইন

- সময়

- প্রতি

- সহজ

- বাস্তু

- দক্ষতার

- দূর

- সক্ষম করা

- সম্ভব

- প্রকৌশলী

- উদ্যোগ

- পরিবেশ

- কাল

- পর্বগুলি

- সমতুল্য

- অপরিহার্য

- ইত্যাদি

- এমন কি

- উদাহরণ

- বিদ্যমান

- সম্প্রসারণ

- ব্যয়বহুল

- অভিজ্ঞতা

- অভিজ্ঞ

- অভিজ্ঞতা

- ক্যান্সার

- চোখ

- মুখ

- সম্মুখস্থ

- দ্রুত

- দ্রুত

- বৈশিষ্ট্য

- কয়েক

- কম

- ক্ষেত্র

- ক্ষেত্রসমূহ

- ব্যক্তিত্ব

- চূড়ান্ত

- অর্থ

- আবিষ্কার

- প্রথম

- পাঁচ

- নমনীয়তা

- ওঠানামা

- অনুসরণ

- খাদ্য

- খাদ্য

- জন্য

- অগ্রবর্তী

- পাওয়া

- চার

- ভগ্নাংশ

- অবকাঠামো

- থেকে

- ক্রিয়া

- ক্রিয়াকলাপ

- সাধারণ

- উত্পাদন করা

- পাওয়া

- পেয়েছিলাম

- জিপিইউ

- জিপিইউ

- গ্রেডিয়েন্টস

- ছিল

- আছে

- জমিদারি

- he

- সাহায্য

- সাহায্য

- সাহায্য

- এখানে

- হাই টেক

- উচ্চ

- ঊর্ধ্বতন

- তার

- ঝুলিতে

- ঘন্টার

- কিভাবে

- এইচটিএমএল

- HTTPS দ্বারা

- হাইপারপ্যারামিটার অপ্টিমাইজেশান

- শনাক্ত

- সনাক্ত করা

- চিহ্নিতকরণের

- if

- ভাবমূর্তি

- চিত্র

- প্রভাব

- আমদানি

- গুরুত্বপূর্ণ

- উন্নত করা

- উন্নত

- in

- সুদ্ধ

- বৃদ্ধি

- বর্ধিত

- ক্রমবর্ধমান

- ইঙ্গিত

- শিল্প

- তথ্য

- তথ্য ব্যবস্থা

- পরিকাঠামো

- প্রাথমিকভাবে

- সূক্ষ্মদৃষ্টি

- উদাহরণ

- পরিবর্তে

- অভ্যন্তরীণ

- Internet

- মধ্যে

- অনুসন্ধানী

- পূজা

- সমস্যা

- IT

- পুনরাবৃত্তির

- কাজ

- জবস

- যাত্রা

- জ্ঞান

- কোরিয়া

- গবেষণাগার

- লেবেলগুলি

- ভূদৃশ্য

- বড়

- বড় আকারের

- বৃহত্তম

- নেতা

- বিশালাকার

- শিখতে

- শিক্ষা

- ত্যাগ

- কম

- লাইব্রেরি

- লাইব্রেরি

- লাইটওয়েট

- মত

- লাইন

- লিনাক্স

- তালিকা

- লোডার

- দেখুন

- ক্ষতি

- অনেক

- মেশিন

- মেশিন লার্নিং

- প্রধানত

- রক্ষণাবেক্ষণ

- করা

- পরিচালনা করা

- পরিচালিত

- ব্যবস্থাপনা

- ম্যানেজমেন্ট সমাধান

- পরিচালক

- পরিচালক

- উত্পাদন

- মানচিত্র

- জরায়ু

- মেলন

- স্মৃতি

- ছন্দোবিজ্ঞান

- যত্সামান্য

- প্রশমন

- মিশ্র

- ML

- এমএলওএস

- মোবাইল

- মডেল

- মূর্তিনির্মাণ

- মডেল

- মনিটর

- মাস

- অধিক

- সেতু

- প্রয়োজনীয়

- প্রয়োজন

- চাহিদা

- নেটওয়ার্ক

- না।

- সুপরিচিত

- সংখ্যা

- পুষ্টির

- এনভিডিয়া

- of

- নৈবেদ্য

- on

- একদা

- ONE

- কেবল

- অপারেশন

- অপারেশনস

- অপ্টিমাইজেশান

- অপ্টিমিজ

- অপ্টিমাইজ

- সর্বোচ্চকরন

- or

- অন্যরা

- আমাদের

- বাইরে

- আউটপুট

- আউটপুট

- শেষ

- সামগ্রিক

- প্যাকেজ

- প্যাকেজ

- কাগজপত্র

- দৃষ্টান্ত

- সমান্তরাল

- পরামিতি

- অংশ

- বিশেষ

- যৌথভাবে কাজ

- পাস

- কামুক

- রোগীদের

- প্রতি

- কাল

- ফটোগ্রাফি

- দা

- প্ল্যাটফর্ম

- Plato

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটোডাটা

- কেলি

- POC

- পোস্ট

- স্পষ্টতা

- আগে

- সমস্যা

- প্রক্রিয়া

- প্রসেস

- পণ্য

- পণ্য ব্যবস্থাপক

- উত্পাদনের

- প্রমোদ

- পণ্য

- প্রোফাইলিং

- প্রকল্প

- প্রকল্প

- প্রমাণ

- ধারণা প্রমাণ

- প্রস্তাব

- প্রদানকারীর

- উপলব্ধ

- প্রদানের

- প্রকাশ্য

- পাইথন

- পাইটার্চ

- দ্রুত

- গবেষণা ও উন্নয়ন

- পরিসর

- মর্যাদাক্রম

- হার

- কারণে

- স্বীকার

- হ্রাস করা

- হ্রাসপ্রাপ্ত

- হ্রাস

- পড়ুন

- সংশ্লিষ্ট

- দেহাবশেষ

- প্রতিস্থাপিত

- প্রয়োজনীয়

- আবশ্যকতা

- গবেষণা

- গবেষণা ও উন্নয়ন

- গবেষক

- সমাধান

- সংস্থান

- Resources

- বিশ্রাম

- ফল

- ফলে এবং

- ফলাফল

- পর্যালোচনা

- পর্যালোচনা

- চালান

- দৌড়

- রান

- SA

- ঋষি নির্মাতা

- একই

- সংরক্ষণ করুন

- জমা

- করাত

- স্কেলেবিলিটি

- স্কেল

- স্কুল

- বিজ্ঞানী

- বিজ্ঞানীরা

- স্ক্রিনশট

- লিপি

- স্ক্রিপ্ট

- SDK

- এসইসি

- সেকেন্ড

- অধ্যায়

- সেক্টর

- দেখ

- জ্যেষ্ঠ

- সংবেদনশীল

- সেবা

- সেবা

- ভজনা

- সেট

- শারডিং

- উচিত

- প্রদর্শনী

- প্রদর্শিত

- শো

- গুরুত্বপূর্ণ

- উল্লেখযোগ্যভাবে

- সহজতর করা

- কেবল

- একক

- আয়তন

- ধীর

- ক্ষুদ্রতর

- So

- সফটওয়্যার

- সমাধান

- সমাধান

- কিছু

- দক্ষিণ

- দক্ষিণ কোরিয়া

- বিশেষ

- বিশেষভাবে

- স্পীড

- অতিবাহিত

- মান

- রাষ্ট্র

- যুক্তরাষ্ট্র

- অবস্থা

- ধাপ

- প্রারম্ভিক ব্যবহারের নির্দেশাবলী

- এখনো

- ছাত্র

- সাফল্য

- সফলভাবে

- এমন

- অনুসরণ

- সন্দেহজনক

- পদ্ধতি

- সিস্টেম

- টেবিল

- TAG

- লাগে

- লক্ষ্য

- টীম

- দল

- কারিগরী

- প্রযুক্তি

- প্রযুক্তি

- প্রযুক্তিঃ

- টেলিযোগাযোগ

- পরীক্ষা

- চেয়ে

- যে

- সার্জারির

- জরায়ু

- তাদের

- তাহাদিগকে

- তারপর

- সেখানে।

- এইগুলো

- এই

- যদিও?

- দ্বারা

- সর্বত্র

- সময়

- বার

- থেকে

- একসঙ্গে

- গ্রহণ

- সরঞ্জাম

- শীর্ষ

- টপিক

- মশাল

- মোট

- অনুসরণকরণ

- রেলগাড়ি

- প্রশিক্ষিত

- প্রশিক্ষণ

- ট্রান্সফরমার

- চেষ্টা

- সত্য

- দুই

- আদর্শ

- সাধারণত

- ui

- বোঝা

- বোধশক্তি

- বিশ্ববিদ্যালয়

- us

- ব্যবহার

- ব্যবহার

- ব্যবহৃত

- ব্যবহারকারী

- ব্যবহারসমূহ

- ব্যবহার

- ব্যবহার

- বৈধতা

- মূল্য

- মানগুলি

- বিভিন্ন

- চেক

- দৃষ্টিপাত

- দৃষ্টি

- প্রয়োজন

- চেয়েছিলেন

- ছিল

- উপায়

- we

- ওয়েব

- ওয়েব সার্ভিস

- সপ্তাহ

- ছিল

- যেহেতু

- যে

- হু

- ব্যাপক

- প্রশস্ত পরিসর

- উইকিপিডিয়া

- ইচ্ছা

- সঙ্গে

- মধ্যে

- ছাড়া

- কাজ

- কাজ

- কারখানা

- would

- আপনি

- আপনার

- zephyrnet

- শূন্য