ডিসেম্বর 2020 এ, AWS ঘোষিত সাধারণ প্রাপ্যতা আমাজন সেজমেকার জাম্পস্টার্ট, একটি ক্ষমতা আমাজন সেজমেকার যা আপনাকে দ্রুত এবং সহজেই মেশিন লার্নিং (ML) দিয়ে শুরু করতে সাহায্য করে। 2022 সালের মার্চ মাসে, আমরাও ঘোষিত জাম্পস্টার্টে API-এর জন্য সমর্থন। জাম্পস্টার্ট জনপ্রিয় ML টাস্ক জুড়ে এক-ক্লিক ফাইন-টিউনিং এবং বিভিন্ন ধরণের প্রাক-প্রশিক্ষিত মডেলের স্থাপনা প্রদান করে, সেইসাথে সাধারণ ব্যবসায়িক সমস্যাগুলি সমাধান করে এমন এন্ড-টু-এন্ড সমাধানগুলির একটি নির্বাচন। এই বৈশিষ্ট্যগুলি ML প্রক্রিয়ার প্রতিটি ধাপ থেকে ভারী উত্তোলনকে সরিয়ে দেয়, এটি উচ্চ-মানের মডেলগুলি বিকাশ করা সহজ করে এবং স্থাপনার সময় হ্রাস করে।

এই পোস্টে, আমরা জাম্পস্টার্টের সাথে কীভাবে স্বয়ংক্রিয় মডেল টিউনিং চালাতে হয় তা প্রদর্শন করি।

সেজমেকার স্বয়ংক্রিয় মডেল টিউনিং

ঐতিহ্যগতভাবে, এমএল ইঞ্জিনিয়াররা হাইপারপ্যারামিটারের সঠিক সেট খুঁজে পেতে একটি ট্রায়াল এবং ত্রুটি পদ্ধতি প্রয়োগ করে। পরীক্ষা চালানোর জন্য প্রয়োজনীয় সংস্থানগুলির বিধান করার সময় ট্রায়াল এবং ত্রুটি ক্রমানুসারে বা সমান্তরালে একাধিক কাজ চালানো জড়িত।

সঙ্গে সেজমেকার স্বয়ংক্রিয় মডেল টিউনিং, ML ইঞ্জিনিয়ার এবং ডেটা বিজ্ঞানীরা তাদের মডেল অপ্টিমাইজ করার সময়সাপেক্ষ কাজটি অফলোড করতে পারেন এবং সেজমেকারকে পরীক্ষা চালাতে দিতে পারেন৷ SageMaker AWS প্ল্যাটফর্মের স্থিতিস্থাপকতার সুবিধা গ্রহণ করে দক্ষতার সাথে এবং একযোগে একটি ডেটাসেটে একাধিক প্রশিক্ষণ সিমুলেশন চালাতে এবং একটি মডেলের জন্য সর্বোত্তম হাইপারপ্যারামিটার খুঁজে বের করতে।

সেজমেকার স্বয়ংক্রিয় মডেল টিউনিং অ্যালগরিদম ব্যবহার করে আপনার ডেটাসেটে অনেক প্রশিক্ষণের কাজ চালানোর মাধ্যমে একটি মডেলের সেরা সংস্করণ খুঁজে পায় এবং রেঞ্জ আপনার নির্দিষ্ট করা হাইপারপ্যারামিটারের। এটি তারপর হাইপারপ্যারামিটার মানগুলি বেছে নেয় যার ফলে একটি মডেল যা সর্বোত্তম কার্য সম্পাদন করে, যেমন a দ্বারা পরিমাপ করা হয় ছন্দোময় যেটা তুমি চয়ন করো।

স্বয়ংক্রিয় মডেল টিউনিং হয় একটি ব্যবহার করে বায়েসিয়ান (ডিফল্ট) বা ক এলোমেলো হাইপারপ্যারামিটারের জন্য সর্বোত্তম মান খুঁজে পেতে অনুসন্ধান কৌশল। Bayesian অনুসন্ধান একটি মত হাইপারপ্যারামিটার টিউনিং আচরণ করে প্রত্যাগতি সমস্যা পরবর্তী প্রশিক্ষণের কাজের জন্য সর্বোত্তম হাইপারপ্যারামিটারগুলি বেছে নেওয়ার সময়, এটি এখন পর্যন্ত সমস্যাটি সম্পর্কে যা কিছু জানে তা বিবেচনা করে এবং অ্যালগরিদমকে সর্বোত্তম-পরিচিত ফলাফলগুলিকে কাজে লাগাতে দেয়৷

এই পোস্টে, আমরা জাম্পস্টার্ট ব্যবহার করে স্বয়ংক্রিয় মডেল টিউনিং চালানোর সাথে জড়িত পদক্ষেপগুলি প্রদর্শন করতে ডিফল্ট বায়েসিয়ান অনুসন্ধান কৌশল ব্যবহার করি। লাইটজিবিএম মডেল.

জাম্পস্টার্ট বর্তমানে স্বয়ংক্রিয় মডেল টিউনিং সহ 10টি উদাহরণ নোটবুক সমর্থন করে। এটি ট্যাবুলার ডেটা মডেলিংয়ের জন্য চারটি জনপ্রিয় অ্যালগরিদম সমর্থন করে। তাদের নমুনা নোটবুকের কাজ এবং লিঙ্কগুলি নিম্নলিখিত টেবিলে সংক্ষিপ্ত করা হয়েছে।

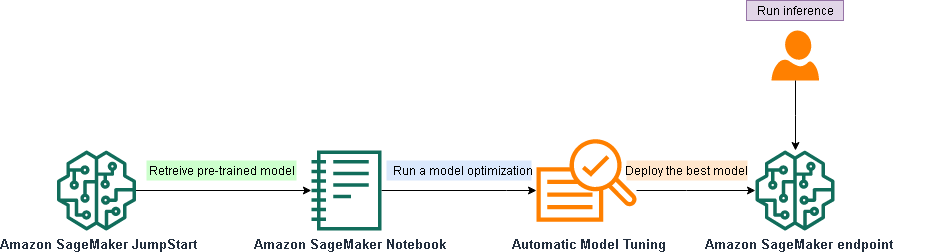

সমাধান ওভারভিউ

এই প্রযুক্তিগত কর্মপ্রবাহ বিভিন্ন Amazon Sagemaker বৈশিষ্ট্যগুলির একটি ওভারভিউ দেয় এবং একটি জাম্পস্টার্ট মডেল স্বয়ংক্রিয়ভাবে টিউন করার জন্য প্রয়োজনীয় পদক্ষেপগুলি দেয়৷

নিম্নলিখিত বিভাগে, আমরা লাইটজিবিএম অ্যালগরিদম ব্যবহার করে জাম্পস্টার্টের সাথে কীভাবে স্বয়ংক্রিয় মডেল টিউনিং চালাতে হয় তার একটি ধাপে ধাপে ওয়াকথ্রু প্রদান করি। আমরা একটি সহগামী প্রদান নোটবই এই ওয়াকথ্রু জন্য.

আমরা নিম্নোক্ত উচ্চ-স্তরের ধাপগুলোর মধ্য দিয়ে চলেছি:

- জাম্পস্টার্ট প্রাক-প্রশিক্ষিত মডেল এবং ছবি ধারক পুনরুদ্ধার করুন।

- স্ট্যাটিক হাইপারপ্যারামিটার সেট করুন।

- টিউনযোগ্য হাইপারপ্যারামিটার ব্যাপ্তি সংজ্ঞায়িত করুন।

- স্বয়ংক্রিয় মডেল টিউনিং শুরু করুন।

- টিউনিং কাজ চালান।

- একটি শেষ পয়েন্টে সেরা মডেল স্থাপন করুন.

জাম্পস্টার্ট প্রাক-প্রশিক্ষিত মডেল এবং ছবি ধারক পুনরুদ্ধার করুন

এই বিভাগে, আমরা ফাইন-টিউনিংয়ের জন্য লাইটজিবিএম শ্রেণীবিভাগের মডেল বেছে নিই। আমরা ml.m5.xlarge ইনস্ট্যান্স টাইপ ব্যবহার করি যার উপর মডেলটি চালানো হয়। তারপরে আমরা প্রশিক্ষণ ডকার কন্টেইনার, প্রশিক্ষণ অ্যালগরিদম উত্স এবং প্রাক-প্রশিক্ষিত মডেল পুনরুদ্ধার করি। নিম্নলিখিত কোড দেখুন:

training_instance_type = "ml.m5.xlarge" # Retrieve the docker image

train_image_uri = image_uris.retrieve(

region=None,

framework=None,

model_id=train_model_id,

model_version=train_model_version,

image_scope=train_scope,

instance_type=training_instance_type,

)

# Retrieve the training script

train_source_uri = script_uris.retrieve(

model_id=train_model_id, model_version=train_model_version, script_scope=train_scope

)

# Retrieve the pre-trained model tarball to further fine-tune

train_model_uri = model_uris.retrieve(

model_id=train_model_id, model_version=train_model_version, model_scope=train_scope

)

স্ট্যাটিক হাইপারপ্যারামিটার সেট করুন

আমরা এখন এই লাইটজিবিএম মডেলের জন্য ডিফল্ট হাইপারপ্যারামিটার পুনরুদ্ধার করি, যেমন জাম্পস্টার্ট দ্বারা প্রি-কনফিগার করা হয়েছে। আমরা ওভাররাইড num_boost_round একটি কাস্টম মান সহ হাইপারপ্যারামিটার।

# Retrieve the default hyper-parameters for fine-tuning the model

hyperparameters = hyperparameters.retrieve_default(

model_id=train_model_id, model_version=train_model_version

)

# [Optional] Override default hyperparameters with custom valuesটিউনযোগ্য হাইপারপ্যারামিটার ব্যাপ্তি সংজ্ঞায়িত করুন

পরবর্তীতে আমরা হাইপারপ্যারামিটার রেঞ্জগুলিকে সংজ্ঞায়িত করি স্বয়ংক্রিয় মডেল টিউনিং দ্বারা অপ্টিমাইজ করা. আমরা মডেল দ্বারা প্রত্যাশিত হিসাবে হাইপারপ্যারামিটার নামটি সংজ্ঞায়িত করি এবং তারপর এই হাইপারপ্যারামিটারের জন্য চেষ্টা করা মানগুলির পরিসরগুলি। স্বয়ংক্রিয় মডেল টিউনিং নমুনা আঁকে (এর সমান max_jobs প্যারামিটার) হাইপারপ্যারামিটারের স্থান থেকে, বায়েসিয়ান অনুসন্ধান নামক একটি কৌশল ব্যবহার করে। প্রতিটি টানা হাইপারপ্যারামিটার নমুনার জন্য, টিউনার সেই কনফিগারেশনের সাথে মডেলটির মূল্যায়ন করার জন্য একটি প্রশিক্ষণ কাজ তৈরি করে। নিম্নলিখিত কোড দেখুন:

hyperparameter_ranges = {

"learning_rate": ContinuousParameter(1e-4, 1, scaling_type="Logarithmic"),

"num_boost_round": IntegerParameter(2, 30),

"early_stopping_rounds": IntegerParameter(2, 30),

"num_leaves": IntegerParameter(10, 50),

"feature_fraction": ContinuousParameter(0, 1),

"bagging_fraction": ContinuousParameter(0, 1),

"bagging_freq": IntegerParameter(1, 10),

"max_depth": IntegerParameter(5, 30),

"min_data_in_leaf": IntegerParameter(5, 50),

}স্বয়ংক্রিয় মডেল টিউনিং শুরু করুন

আমরা একটি তৈরি করে শুরু করি মূল্নির্ধারক সমস্ত প্রয়োজনীয় সম্পদ সহ অবজেক্ট যা প্রশিক্ষণের কাজকে সংজ্ঞায়িত করে, যেমন প্রাক-প্রশিক্ষিত মডেল, প্রশিক্ষণ চিত্র এবং প্রশিক্ষণের স্ক্রিপ্ট। আমরা তারপর একটি সংজ্ঞায়িত হাইপারপ্যারামিটার টিউনার সেজমেকার হাইপারপ্যারামিটার টিউনিং API-এর সাথে ইন্টারঅ্যাক্ট করার জন্য অবজেক্ট।

সার্জারির HyperparameterTuner প্যারামিটার হিসাবে অনুমানকারী বস্তু গ্রহণ করে, লক্ষ্য মেট্রিক যার উপর ভিত্তি করে হাইপারপ্যারামিটারের সর্বোত্তম সেট নির্ধারণ করা হয়, প্রশিক্ষণ কাজের মোট সংখ্যা (max_jobs) হাইপারপ্যারামিটার টিউনিং কাজের জন্য শুরু করতে এবং চালানোর জন্য সর্বাধিক সমান্তরাল প্রশিক্ষণের কাজগুলি (max_parallel_jobs) প্রশিক্ষণের কাজগুলি লাইটজিবিএম অ্যালগরিদম এবং হাইপারপ্যারামিটার মানগুলির সাথে চালিত হয় যার ন্যূনতম mlogloss মেট্রিক নির্বাচন করা হয়। স্বয়ংক্রিয় মডেল টিউনিং কনফিগার করার বিষয়ে আরও তথ্যের জন্য, দেখুন হাইপারপ্যারামিটার টিউনিংয়ের জন্য সর্বোত্তম অনুশীলন.

# Create SageMaker Estimator instance

tabular_estimator = Estimator(

role=aws_role,

image_uri=train_image_uri,

source_dir=train_source_uri,

model_uri=train_model_uri,

entry_point="transfer_learning.py",

instance_count=1,

instance_type=training_instance_type,

max_run=360000,

hyperparameters=hyperparameters,

output_path=s3_output_location,

) tuner = HyperparameterTuner(

estimator=tabular_estimator,

objective_metric_name="multi_logloss",

hyperparameter_ranges=hyperparameter_ranges,

metric_definitions=[{"Name": "multi_logloss", "Regex": "multi_logloss: ([0-9\.]+)"}],

strategy="Bayesian",

max_jobs=10,

max_parallel_jobs=2,

objective_type="Minimize",

base_tuning_job_name=training_job_name,

)পূর্ববর্তী কোডে, আমরা টিউনারকে সর্বোচ্চ 10টি পরীক্ষা চালাতে বলি (max_jobs) এবং এক সময়ে মাত্র দুটি সমসাময়িক পরীক্ষা (max_parallel_jobs) এই উভয় পরামিতি আপনার খরচ এবং প্রশিক্ষণের সময় নিয়ন্ত্রণে রাখে।

টিউনিং কাজ চালান

সেজমেকার টিউনিং কাজ চালু করতে, আমরা হাইপারপ্যারামিটার টিউনার অবজেক্টের ফিট পদ্ধতিকে কল করি এবং পাস করি আমাজন সিম্পল স্টোরেজ সার্ভিস (Amazon S3) প্রশিক্ষণ ডেটার পথ:

tuner.fit({"training": training_dataset_s3_path}, logs=True)স্বয়ংক্রিয় মডেল টিউনিং সর্বোত্তম হাইপারপ্যারামিটারের জন্য অনুসন্ধান করার সময়, আপনি সেজমেকার কনসোলে বা অন করে তাদের অগ্রগতি নিরীক্ষণ করতে পারেন অ্যামাজন ক্লাউডওয়াচ. প্রশিক্ষণ সম্পূর্ণ হলে, প্রশিক্ষণ কনফিগারেশনে নির্দিষ্ট করা Amazon S3 আউটপুট অবস্থানে সেরা মডেলের সূক্ষ্ম-সুরক্ষিত শিল্পকর্মগুলি আপলোড করা হয়।

একটি শেষ পয়েন্টে সেরা মডেল স্থাপন করুন

টিউনিং কাজ সম্পূর্ণ হলে, সেরা মডেল নির্বাচন করা হয়েছে এবং Amazon S3 এ সংরক্ষণ করা হয়েছে। আমরা এখন সেই মডেলটিকে ডিপ্লোয় মেথড কল করে স্থাপন করতে পারি HyperparameterTuner অবজেক্ট এবং প্রয়োজনীয় পরামিতিগুলি পাস করা, যেমন তৈরি করা শেষ পয়েন্টের জন্য ব্যবহার করা দৃষ্টান্তের সংখ্যা, তাদের ধরন, স্থাপন করা চিত্র এবং চালানোর জন্য স্ক্রিপ্ট:

tuner.deploy(

initial_instance_count=1,

instance_type=inference_instance_type,

entry_point="inference.py",

image_uri=deploy_image_uri,

source_dir=deploy_source_uri,

endpoint_name=endpoint_name,

enable_network_isolation=True

)আমরা এখন অনুমান অনুরোধ করে তৈরি শেষ পয়েন্ট পরীক্ষা করতে পারি। আপনি সহগামী প্রক্রিয়া বাকি অনুসরণ করতে পারেন নোটবই.

উপসংহার

SageMaker-এ স্বয়ংক্রিয় মডেল টিউনিংয়ের মাধ্যমে, আপনি সমর্থিত অ্যালগরিদমগুলির একটি সহ প্রদত্ত ডেটাসেটে প্রশিক্ষণের কাজ চালিয়ে আপনার মডেলের সেরা সংস্করণটি খুঁজে পেতে পারেন। স্বয়ংক্রিয় মডেল টিউনিং আপনাকে আপনার নির্দিষ্ট করা হাইপারপ্যারামিটার রেঞ্জের মধ্যে সেরা হাইপারপ্যারামিটার কনফিগারেশনের জন্য স্বয়ংক্রিয়ভাবে অনুসন্ধান করে একটি মডেল টিউন করার সময় কমাতে দেয়।

এই পোস্টে, আমরা SageMaker API ব্যবহার করে একটি জাম্পস্টার্ট প্রাক-প্রশিক্ষিত মডেলে স্বয়ংক্রিয় মডেল টিউনিং চালানোর মান দেখিয়েছি। আমরা LightGBM অ্যালগরিদম ব্যবহার করেছি এবং সর্বাধিক 10টি প্রশিক্ষণের কাজ সংজ্ঞায়িত করেছি। আমরা জাম্পস্টার্ট মডেল অপ্টিমাইজেশানকে সমর্থন করে এমন এমএল ফ্রেমওয়ার্কগুলি প্রদর্শন করে উদাহরণ নোটবুকের লিঙ্কও দিয়েছি।

স্বয়ংক্রিয় মডেল টিউনিং সহ একটি জাম্পস্টার্ট মডেলকে কীভাবে অপ্টিমাইজ করা যায় সে সম্পর্কে আরও বিশদ বিবরণের জন্য, আমাদের উদাহরণ পড়ুন নোটবই.

লেখক সম্পর্কে

ডগ এমবায়া ডেটা এবং বিশ্লেষণে ফোকাস সহ একজন সিনিয়র পার্টনার সলিউশন আর্কিটেক্ট। ডগ AWS অংশীদারদের সাথে ঘনিষ্ঠভাবে কাজ করে, তাদের ক্লাউডে ডেটা এবং বিশ্লেষণ সমাধান একীভূত করতে সাহায্য করে।

ডগ এমবায়া ডেটা এবং বিশ্লেষণে ফোকাস সহ একজন সিনিয়র পার্টনার সলিউশন আর্কিটেক্ট। ডগ AWS অংশীদারদের সাথে ঘনিষ্ঠভাবে কাজ করে, তাদের ক্লাউডে ডেটা এবং বিশ্লেষণ সমাধান একীভূত করতে সাহায্য করে।

ক্রুথি জয়সিমহা রাও স্কেল-পিএসএ দলের একজন অংশীদার সলিউশন আর্কিটেক্ট। Kruthi অংশীদারদের জন্য প্রযুক্তিগত বৈধতা পরিচালনা করে যাতে তাদের অংশীদারি পথে অগ্রগতি হয়।

ক্রুথি জয়সিমহা রাও স্কেল-পিএসএ দলের একজন অংশীদার সলিউশন আর্কিটেক্ট। Kruthi অংশীদারদের জন্য প্রযুক্তিগত বৈধতা পরিচালনা করে যাতে তাদের অংশীদারি পথে অগ্রগতি হয়।

জিয়ানিস মিত্রোপোলস সেজমেকারের জন্য একজন সফটওয়্যার ডেভেলপমেন্ট ইঞ্জিনিয়ার স্বয়ংক্রিয় মডেল টিউনিং.

জিয়ানিস মিত্রোপোলস সেজমেকারের জন্য একজন সফটওয়্যার ডেভেলপমেন্ট ইঞ্জিনিয়ার স্বয়ংক্রিয় মডেল টিউনিং.

আশিস খেতান ড সঙ্গে একজন সিনিয়র ফলিত বিজ্ঞানী আমাজন সেজমেকার জাম্পস্টার্ট এবং Amazon SageMaker বিল্ট-ইন অ্যালগরিদম এবং মেশিন লার্নিং অ্যালগরিদম বিকাশে সাহায্য করে। তিনি মেশিন লার্নিং এবং পরিসংখ্যানগত অনুমানের একজন সক্রিয় গবেষক এবং নিউরিআইপিএস, আইসিএমএল, আইসিএলআর, জেএমএলআর এবং এসিএল সম্মেলনে অনেক গবেষণাপত্র প্রকাশ করেছেন।

আশিস খেতান ড সঙ্গে একজন সিনিয়র ফলিত বিজ্ঞানী আমাজন সেজমেকার জাম্পস্টার্ট এবং Amazon SageMaker বিল্ট-ইন অ্যালগরিদম এবং মেশিন লার্নিং অ্যালগরিদম বিকাশে সাহায্য করে। তিনি মেশিন লার্নিং এবং পরিসংখ্যানগত অনুমানের একজন সক্রিয় গবেষক এবং নিউরিআইপিএস, আইসিএমএল, আইসিএলআর, জেএমএলআর এবং এসিএল সম্মেলনে অনেক গবেষণাপত্র প্রকাশ করেছেন।

- "

- 10

- 100

- 2020

- 2022

- সম্পর্কে

- দিয়ে

- সক্রিয়

- সুবিধা

- অ্যালগরিদম

- আলগোরিদিম

- সব

- মর্দানী স্ত্রীলোক

- বৈশ্লেষিক ন্যায়

- API গুলি

- সম্পদ

- স্বয়ংক্রিয়

- উপস্থিতি

- ডেস্কটপ AWS

- সর্বোত্তম

- বিল্ট-ইন

- ব্যবসায়

- কল

- বেছে নিন

- মনোনীত

- শ্রেণীবিন্যাস

- মেঘ

- কোড

- সাধারণ

- সম্মেলন

- কনফিগারেশন

- বিবেচনা করে

- কনসোল

- আধার

- নিয়ন্ত্রণ

- সৃষ্টি

- নির্মিত

- সৃষ্টি

- তৈরি করা হচ্ছে

- এখন

- প্রথা

- উপাত্ত

- সিদ্ধান্ত নিয়েছে

- প্রদর্শন

- স্থাপন

- মোতায়েন

- বিস্তৃতি

- বিস্তারিত

- বিকাশ

- উন্নয়ন

- বিভিন্ন

- ডকশ্রমিক

- সহজে

- দক্ষতার

- সক্রিয়

- শেষপ্রান্ত

- প্রকৌশলী

- প্রকৌশলী

- মূল্যায়ন

- সব

- উদাহরণ

- প্রত্যাশিত

- পরীক্ষা

- কাজে লাগান

- বৈশিষ্ট্য

- খুঁজে বের করে

- ফিট

- কেন্দ্রবিন্দু

- অনুসরণ করা

- অনুসরণ

- অধিকতর

- সাধারণ

- উচ্চতা

- সাহায্য

- সাহায্য

- উচ্চ গুনসম্পন্ন

- কিভাবে

- কিভাবে

- HTTPS দ্বারা

- ভাবমূর্তি

- বাস্তবায়ন

- তথ্য

- সম্পূর্ণ

- জড়িত

- IT

- কাজ

- জবস

- শুরু করা

- শিক্ষা

- উদ্ধরণ

- লিঙ্ক

- অবস্থান

- মেশিন

- মেশিন লার্নিং

- মেকিং

- মার্চ

- ML

- মডেল

- মডেল

- মনিটর

- অধিক

- সেতু

- বহু

- সংখ্যা

- অপ্টিমাইজেশান

- অপ্টিমিজ

- সর্বোচ্চকরন

- হাসপাতাল

- অংশীদারদের

- পাসিং

- মাচা

- জনপ্রিয়

- সমস্যা

- সমস্যা

- প্রক্রিয়া

- প্রদান

- উপলব্ধ

- প্রশ্ন

- দ্রুত

- হ্রাস করা

- হ্রাস

- অনুরোধ

- প্রয়োজনীয়

- Resources

- বিশ্রাম

- ফলাফল

- চালান

- দৌড়

- বিজ্ঞানী

- বিজ্ঞানীরা

- সার্চ

- নির্বাচিত

- সেট

- বেড়াবে

- সহজ

- So

- সফটওয়্যার

- সফটওয়্যার উন্নয়ন

- সমাধান

- সলিউশন

- সমাধান

- স্থান

- শুরু

- শুরু

- পরিসংখ্যানসংক্রান্ত

- স্টোরেজ

- কৌশল

- সমর্থন

- সমর্থিত

- সমর্থন

- লক্ষ্য

- কাজ

- টীম

- কারিগরী

- পরীক্ষা

- দ্বারা

- সময়

- সময় অপগিত হয় এমন

- শিরনাম

- প্রশিক্ষণ

- পরীক্ষা

- ব্যবহার

- মূল্য

- বৈচিত্র্য

- যখন

- মধ্যে

- কাজ