Dette indlæg er skrevet sammen med Ming (Melvin) Qin, David Bericat og Brad Genereaux fra NVIDIA.

Medicinsk billeddannelse AI-forskere og -udviklere har brug for en skalerbar virksomhedsramme til at bygge, implementere og integrere deres AI-applikationer. AWS og NVIDIA er gået sammen for at gøre denne vision til virkelighed. AWS, NVIDIA og andre partnere byg applikationer og løsninger for at gøre sundhedspleje mere tilgængeligt, overkommeligt og effektivt ved at accelerere cloud-forbindelsen til virksomhedsbilleder. MONAI Deploy er et af nøglemodulerne indenfor MONAI (Medical Open Network for Artificial Intelligence) udviklet af et konsortium af akademiske ledere og industriledere, herunder NVIDIA. AWS HealthImaging (AHI) er en HIPAA-berettiget, yderst skalerbar, effektiv og omkostningseffektiv medicinsk billedbutik. Vi har udviklet et MONAI Deploy-stik til AHI for at integrere medicinsk billeddannelse AI-applikationer med sekundære billedhentningsforsinkelser i skala drevet af cloud-native API'er. MONAI AI-modellerne og -applikationerne kan hostes på Amazon SageMaker, som er en fuldt administreret tjeneste til at implementere maskinlæringsmodeller (ML) i stor skala. SageMaker tager sig af opsætning og styring af instanser til slutninger og leverer indbyggede metrics og logfiler til slutpunkter, som du kan bruge til at overvåge og modtage advarsler. Det tilbyder også en række NVIDIA GPU-forekomster for ML-inferens, samt flere modelimplementeringsmuligheder med automatisk skalering, herunder inferens i realtid, serverløs slutning, asynkron inferensog batch transformation.

I dette indlæg demonstrerer vi, hvordan man implementerer en MONAI Application Package (MAP) med forbindelsen til AWS HealthImaging, ved hjælp af et SageMaker multi-model slutpunkt til real-time inferens og asynkron inferens. Disse to muligheder dækker de fleste tilfælde af næsten-real-tids medicinsk billeddannelsesslutningspipelinebrug.

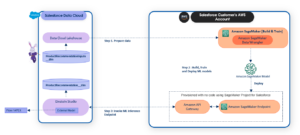

Løsningsoversigt

Følgende diagram illustrerer løsningsarkitekturen.

Forudsætninger

Udfør følgende forudsætningstrin:

- Brug en AWS-konto med en af følgende regioner, hvor AWS HealthImaging er tilgængelig: North Virginia (

us-east-1), Oregon (us-west-2), Irland (eu-west-1), og Sydney (ap-southeast-2). - Opret en Amazon SageMaker Studio domæne og brugerprofil med AWS identitets- og adgangsstyring (IAM) tilladelse til at få adgang til AWS HealthImaging.

- Aktiver JupyterLab v3-udvidelsen og installer Imjoy-jupyter-extension, hvis du vil visualisere medicinske billeder på SageMaker notebook interaktivt ved hjælp af itkwidgets.

MAP-stik til AWS HealthImaging

AWS HealthImaging importerer DICOM P10-filer og konverterer dem til ImageSets, som er en optimeret repræsentation af en DICOM-serie. AHI giver API-adgang til ImageSet-metadata og ImageFrames. Metadata indeholder alle DICOM-attributter i et JSON-dokument. ImageFrames returneres kodet i High-Throughput JPEG2000 (HTJ2K) tabsfrit format, som kan afkodes ekstremt hurtigt. ImageSets kan hentes ved at bruge AWS kommandolinjegrænseflade (AWS CLI) eller AWS SDK'er.

MONAI er en medicinsk billeddannende AI-ramme, der tager forskningsgennembrud og AI-applikationer ind i klinisk effekt. MONAI Deploy er behandlingspipelinen, der muliggør end-to-end workflow, herunder pakning, test, implementering og kørsel af medicinsk billeddannelse AI-applikationer i klinisk produktion. Det omfatter MONAI Implementer app-SDK, MONAI Deploy Express, Workflow Managerog Informatik Gateway. MONAI Deploy App SDK giver brugsklare algoritmer og en ramme til at accelerere opbygningen af medicinsk billeddannelse AI-applikationer samt hjælpeværktøjer til at pakke applikationen ind i en MAP-beholder. De indbyggede standardbaserede funktionaliteter i app-SDK'en gør det muligt for MAP at integreres problemfrit i sundheds-it-netværk, hvilket kræver brug af standarder som DICOM, HL7 og FHIR og på tværs af datacenter- og cloudmiljøer. MAP'er kan bruge både foruddefinerede og tilpassede operatører til DICOM-billedindlæsning, serievalg, modelslutning og efterbehandling

Vi har udviklet en Python modul ved hjælp af AWS HealthImaging Python SDK Boto3. Du kan pip-installere det og bruge hjælpefunktionen til at hente DICOM Service-Object Pair (SOP)-forekomster som følger:

!pip install -q AHItoDICOMInterface

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

helper = AHItoDICOM()

instances = helper.DICOMizeImageSet(datastore_id=datastoreId , image_set_id=next(iter(imageSetIds)))Output SOP-forekomsterne kan visualiseres ved hjælp af de interaktive 3D medicinske billedfremviser itkwidgets i det følgende notesbog. Det AHItoDICOM klasse udnytter flere processer til at hente pixelframes fra AWS HealthImaging parallelt, og afkode og HTJ2K binære klatter ved hjælp af Python OpenJPEG-bibliotek. ImageSetId'erne kommer fra outputfilerne fra et givet AWS HealthImaging-importjob. Givet DatastoreId og import JobId kan du hente ImageSetId, som svarer til DICOM-seriens instans-UID, som følger:

imageSetIds = {}

try: response = s3.head_object(Bucket=OutputBucketName, Key=f"output/{res_createstore['datastoreId']}-DicomImport-{res_startimportjob['jobId']}/job-output-manifest.json") if response['ResponseMetadata']['HTTPStatusCode'] == 200: data = s3.get_object(Bucket=OutputBucketName, Key=f"output/{res_createstore['datastoreId']}-DicomImport-{res_startimportjob['jobId']}/SUCCESS/success.ndjson") contents = data['Body'].read().decode("utf-8") for l in contents.splitlines(): isid = json.loads(l)['importResponse']['imageSetId'] if isid in imageSetIds: imageSetIds[isid]+=1 else: imageSetIds[isid]=1

except ClientError: passMed ImageSetId kan du hente DICOM-headerens metadata og billedpixel separat ved hjælp af native AWS HealthImaging API-funktioner. Det DICOM eksportør aggregater DICOM-headerne og billedpixel i Pydicom datasæt, som kan behandles af MAP DICOM data loader operatør. Ved at bruge funktionen DICOMizeImageSet() har vi oprettet en forbindelse til at indlæse billeddata fra AWS HealthImaging, baseret på MAP DICOM data loader operatør:

class AHIDataLoaderOperator(Operator): def __init__(self, ahi_client, must_load: bool = True, *args, **kwargs): self.ahi_client = ahi_client … def _load_data(self, input_obj: string): study_dict = {} series_dict = {} sop_instances = self.ahi_client.DICOMizeImageSet(input_obj['datastoreId'], input_obj['imageSetId'])I den foregående kode, ahi_client er en forekomst af AHItoDICOM DICOM eksportørklassen, med datahentningsfunktioner illustreret. Vi har inkluderet denne nye dataindlæseroperatør i en 3D miltsegmentering AI-applikation oprettet af MONAI Deploy App SDK. Du kan først undersøge, hvordan du opretter og kører denne applikation på en lokal notebook-forekomst, og implementer derefter denne MAP-applikation i SageMaker-styrede inferensendepunkter.

SageMaker asynkron inferens

En SageMaker asynkron inferens endepunkt bruges til anmodninger med store nyttelaststørrelser (op til 1 GB), lange behandlingstider (op til 15 minutter) og krav til ventetid næsten i realtid. Når der ikke er nogen anmodninger om at behandle, kan denne implementeringsmulighed nedskalere instanstællingen til nul for at spare omkostninger, hvilket er ideelt til ML-inferensarbejdsbelastninger for medicinsk billeddannelse. Følg trinene i eksempel notesbog at oprette og påberåbe SageMaker asynkrone inferensslutpunktet. Til oprette et asynkront inferensslutpunkt, skal du først oprette en SageMaker-model og slutpunktskonfiguration. For at oprette en SageMaker-model skal du indlæse en model.tar.gz-pakke med en defineret mappestruktur ind i en Docker-container. model.tar.gz-pakken inkluderer en forudtrænet miltsegmenteringsmodel.ts-fil og en tilpasset inference.py-fil. Vi har brugt en forudbygget container med Python 3.8 og PyTorch 1.12.1 framework-versioner til at indlæse modellen og køre forudsigelser.

I den tilpassede inference.py fil, instansierer vi en AHItoDICOM-hjælperklasse fra AHItoDICOMInterface og bruger den til at oprette en MAP-instans i model_fn() funktion, og vi kører MAP-applikationen på hver slutningsanmodning i predict_fn() fungere:

from app import AISpleenSegApp

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

helper = AHItoDICOM()

def model_fn(model_dir, context): … monai_app_instance = AISpleenSegApp(helper, do_run=False,path="/home/model-server") def predict_fn(input_data, model): with open('/home/model-server/inputImageSets.json', 'w') as f: f.write(json.dumps(input_data)) output_folder = "/home/model-server/output" if not os.path.exists(output_folder): os.makedirs(output_folder) model.run(input='/home/model-server/inputImageSets.json', output=output_folder, workdir='/home/model-server', model='/opt/ml/model/model.ts')Til påberåbe det asynkrone endepunkt, skal du uploade forespørgselsinput nyttelasten til Amazon Simple Storage Service (Amazon S3), som er en JSON-fil, der angiver AWS HealthImaging-datalager-id'et og ImageSet-id'et, der skal køre inferens på:

sess = sagemaker.Session()

InputLocation = sess.upload_data('inputImageSets.json', bucket=sess.default_bucket(), key_prefix=prefix, extra_args={"ContentType": "application/json"})

response = runtime_sm_client.invoke_endpoint_async(EndpointName=endpoint_name, InputLocation=InputLocation, ContentType="application/json", Accept="application/json")

output_location = response["OutputLocation"]Outputtet kan også findes i Amazon S3.

SageMaker multi-model real-time inferens

SageMaker inferens i realtid endepunkter opfylder interaktive krav med lav latens. Denne mulighed kan hoste flere modeller i én container bag ét slutpunkt, hvilket er en skalerbar og omkostningseffektiv løsning til implementering af flere ML-modeller. EN SageMaker multi-model slutpunkt bruger NVIDIA Triton Inference Server med GPU til at køre flere deep learning-modelslutninger.

I dette afsnit gennemgår vi, hvordan man opretter og kalder et multi-model slutpunkt tilpasse din egen inferensbeholder i det følgende eksempel notesbog. Forskellige modeller kan serveres i en delt container på den samme flåde af ressourcer. Multi-model-endepunkter reducerer implementeringsoverhead og skalamodelslutninger baseret på trafikmønstrene til slutpunktet. Vi brugte AWS udviklerværktøjer herunder Amazon CodeCommit, Amazon CodeBuildog Amazon CodePipeline at opbygge den tilpassede container for SageMaker model inferens. Vi forberedte en model_handler.py at bringe din egen container i stedet for filen inference.py i det foregående eksempel, og implementeret initialize(), preprocess() og inference() funktionerne:

from app import AISpleenSegApp

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

class ModelHandler(object): def __init__(self): self.initialized = False self.shapes = None def initialize(self, context): self.initialized = True properties = context.system_properties model_dir = properties.get("model_dir") gpu_id = properties.get("gpu_id") helper = AHItoDICOM() self.monai_app_instance = AISpleenSegApp(helper, do_run=False, path="/home/model-server/") def preprocess(self, request): inputStr = request[0].get("body").decode('UTF8') datastoreId = json.loads(inputStr)['inputs'][0]['datastoreId'] imageSetId = json.loads(inputStr)['inputs'][0]['imageSetId'] with open('/tmp/inputImageSets.json', 'w') as f: f.write(json.dumps({"datastoreId": datastoreId, "imageSetId": imageSetId})) return '/tmp/inputImageSets.json' def inference(self, model_input): self.monai_app_instance.run(input=model_input, output="/home/model-server/output/", workdir="/home/model-server/", model=os.environ["model_dir"]+"/model.ts")Efter at containeren er bygget og skubbet til Amazon Elastic Container Registry (Amazon ECR), du kan oprette SageMaker-model med den, plus forskellige modelpakker (tar.gz-filer) i en given Amazon S3-sti:

model_name = "DEMO-MONAIDeployModel" + strftime("%Y-%m-%d-%H-%M-%S", gmtime())

model_url = "s3://{}/{}/".format(bucket, prefix)

container = "{}.dkr.ecr.{}.amazonaws.com/{}:dev".format( account_id, region, prefix )

container = {"Image": container, "ModelDataUrl": model_url, "Mode": "MultiModel"}

create_model_response = sm_client.create_model(ModelName=model_name, ExecutionRoleArn=role, PrimaryContainer=container)Det er bemærkelsesværdigt, at model_url specificerer her kun stien til en mappe med tar.gz-filer, og du angiver, hvilken modelpakke der skal bruges til inferens, når du kalder slutpunktet, som vist i følgende kode:

Payload = {"inputs": [ {"datastoreId": datastoreId, "imageSetId": next(iter(imageSetIds))} ]}

response = runtime_sm_client.invoke_endpoint(EndpointName=endpoint_name, ContentType="application/json", Accept="application/json", TargetModel="model.tar.gz", Body=json.dumps(Payload))Vi kan tilføje flere modeller til det eksisterende multi-model inferens slutpunkt uden at skulle opdatere slutpunktet eller oprette et nyt.

Ryd op

Glem ikke at udfylde Slet hostingressourcerne trin i lab-3 , lab-4 notesbøger for at slette SageMaker-slutningsendepunkterne. Du bør skrue ned for SageMaker notebook-forekomsten for også at spare omkostninger. Endelig kan du enten kalde AWS HealthImaging API-funktionen eller bruge AWS HealthImaging-konsollen til at slette billedsæt og datalager, der er oprettet tidligere:

for s in imageSetIds.keys(): medicalimaging.deleteImageSet(datastoreId, s)

medicalimaging.deleteDatastore(datastoreId)Konklusion

I dette indlæg viste vi dig, hvordan du opretter en MAP-forbindelse til AWS HealthImaging, som kan genbruges i applikationer bygget med MONAI Deploy App SDK, for at integrere med og accelerere billeddatahentning fra en cloud-native DICOM-butik til medicinsk billedbehandling AI-arbejdsbelastninger . MONAI Deploy SDK kan bruges til at understøtte hospitalsdrift. Vi demonstrerede også to hostingmuligheder til at implementere MAP AI-applikationer på SageMaker i stor skala.

Gå gennem eksempelnotesbøgerne i GitHub repository for at lære mere om, hvordan man implementerer MONAI-applikationer på SageMaker med medicinske billeder gemt i AWS HealthImaging. For at vide, hvad AWS kan gøre for dig, skal du kontakte en AWS repræsentant.

For yderligere ressourcer henvises til følgende:

Om forfatterne

Ming (Melvin) Qin er en uafhængig bidragyder på Healthcare-teamet hos NVIDIA, der fokuserer på at udvikle en AI-inferensapplikationsramme og -platform til at bringe AI til medicinske billedbehandlingsarbejdsgange. Før han kom til NVIDIA i 2018 som stiftende medlem af Clara, brugte Ming 15 år på at udvikle Radiology PACS og Workflow SaaS som ledende ingeniør/arkitekt hos Stentor Inc., senere erhvervet af Philips Healthcare for at danne virksomhedens Enterprise Imaging.

Ming (Melvin) Qin er en uafhængig bidragyder på Healthcare-teamet hos NVIDIA, der fokuserer på at udvikle en AI-inferensapplikationsramme og -platform til at bringe AI til medicinske billedbehandlingsarbejdsgange. Før han kom til NVIDIA i 2018 som stiftende medlem af Clara, brugte Ming 15 år på at udvikle Radiology PACS og Workflow SaaS som ledende ingeniør/arkitekt hos Stentor Inc., senere erhvervet af Philips Healthcare for at danne virksomhedens Enterprise Imaging.

David Bericat er produktchef for Healthcare hos NVIDIA, hvor han leder Project MONAI Deploy-arbejdsgruppen for at bringe AI fra forskning til kliniske implementeringer. Hans passion er at fremskynde sundhedsinnovation globalt og oversætte det til ægte klinisk effekt. Tidligere arbejdede David hos Red Hat og implementerede open source-principper i krydsfeltet mellem AI, cloud, edge computing og IoT. Hans stolteste øjeblikke inkluderer at vandre til Everest base camp og spille fodbold i over 20 år.

David Bericat er produktchef for Healthcare hos NVIDIA, hvor han leder Project MONAI Deploy-arbejdsgruppen for at bringe AI fra forskning til kliniske implementeringer. Hans passion er at fremskynde sundhedsinnovation globalt og oversætte det til ægte klinisk effekt. Tidligere arbejdede David hos Red Hat og implementerede open source-principper i krydsfeltet mellem AI, cloud, edge computing og IoT. Hans stolteste øjeblikke inkluderer at vandre til Everest base camp og spille fodbold i over 20 år.

Brad Genereaux er Global Lead, Healthcare Alliances hos NVIDIA, hvor han er ansvarlig for udviklerrelationer med fokus på medicinsk billedbehandling for at accelerere kunstig intelligens og deep learning, visualisering, virtualisering og analyseløsninger. Brad evangeliserer den allestedsnærværende adoption og integration af sømløse arbejdsgange inden for sundhedspleje og medicinsk billeddannelse i den daglige kliniske praksis med mere end 20 års erfaring inden for sundheds-it.

Brad Genereaux er Global Lead, Healthcare Alliances hos NVIDIA, hvor han er ansvarlig for udviklerrelationer med fokus på medicinsk billedbehandling for at accelerere kunstig intelligens og deep learning, visualisering, virtualisering og analyseløsninger. Brad evangeliserer den allestedsnærværende adoption og integration af sømløse arbejdsgange inden for sundhedspleje og medicinsk billeddannelse i den daglige kliniske praksis med mere end 20 års erfaring inden for sundheds-it.

Gang Fu er Healthcare Solutions Architect hos AWS. Han har en ph.d. i farmaceutisk videnskab fra University of Mississippi og har over 10 års teknologi og biomedicinsk forskningserfaring. Han brænder for teknologi og den indflydelse, den kan have på sundhedsvæsenet.

Gang Fu er Healthcare Solutions Architect hos AWS. Han har en ph.d. i farmaceutisk videnskab fra University of Mississippi og har over 10 års teknologi og biomedicinsk forskningserfaring. Han brænder for teknologi og den indflydelse, den kan have på sundhedsvæsenet.

JP Leger er en Senior Solutions Architect, der understøtter akademiske medicinske centre og medicinsk billedbehandlingsarbejdsgange hos AWS. Han har over 20 års ekspertise inden for software engineering, sundheds-it og medicinsk billedbehandling med omfattende erfaring med at bygge systemer til ydeevne, skalerbarhed og sikkerhed i distribuerede implementeringer af store datamængder på stedet, i skyen og hybrid med analytics og AI .

JP Leger er en Senior Solutions Architect, der understøtter akademiske medicinske centre og medicinsk billedbehandlingsarbejdsgange hos AWS. Han har over 20 års ekspertise inden for software engineering, sundheds-it og medicinsk billedbehandling med omfattende erfaring med at bygge systemer til ydeevne, skalerbarhed og sikkerhed i distribuerede implementeringer af store datamængder på stedet, i skyen og hybrid med analytics og AI .

Chris Hafey er Principal Solutions Architect hos Amazon Web Services. Han har over 25 års erfaring i den medicinske billedbehandlingsindustri og har specialiseret sig i at bygge skalerbare højtydende systemer. Han er skaberen af det populære CornerstoneJS open source-projekt, som driver den populære OHIF open source zero footprint viewer. Han bidrog til DICOMweb-specifikationen og fortsætter med at arbejde for at forbedre dens ydeevne til webbaseret visning.

Chris Hafey er Principal Solutions Architect hos Amazon Web Services. Han har over 25 års erfaring i den medicinske billedbehandlingsindustri og har specialiseret sig i at bygge skalerbare højtydende systemer. Han er skaberen af det populære CornerstoneJS open source-projekt, som driver den populære OHIF open source zero footprint viewer. Han bidrog til DICOMweb-specifikationen og fortsætter med at arbejde for at forbedre dens ydeevne til webbaseret visning.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/build-a-medical-imaging-ai-inference-pipeline-with-monai-deploy-on-aws/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 10

- 100

- 12

- 15 år

- 15 %

- 20

- 20 år

- 200

- 2018

- 25

- 3d

- 7

- 8

- a

- Om

- akademisk

- fremskynde

- accelererende

- adgang

- tilgængelig

- Konto

- erhvervede

- tværs

- tilføje

- Yderligere

- Vedtagelse

- Fordel

- overkommelige

- AI

- AI modeller

- Advarsler

- algoritmer

- Alle

- Alliancer

- tillade

- også

- Amazon

- Amazon Web Services

- an

- analytics

- ,

- api

- API-adgang

- API'er

- app

- Anvendelse

- applikationer

- arkitektur

- ER

- kunstig

- kunstig intelligens

- AS

- At

- attributter

- Automatisk Ur

- til rådighed

- AWS

- bund

- baseret

- BE

- før

- bag

- biomedicinsk

- krop

- både

- brad

- gennembrud

- bringe

- bygge

- Bygning

- bygget

- indbygget

- by

- ringe

- Camp

- CAN

- hvilken

- tilfælde

- center

- Centers

- Clara

- klasse

- Klinisk

- Cloud

- kode

- Kom

- fuldføre

- omfatter

- computing

- Konfiguration

- Connectivity

- Konsol

- konsortium

- kontakt

- Container

- indeholder

- indhold

- sammenhæng

- fortsætter

- bidrog

- bidragsyder

- Koste

- omkostningsbesparelser

- omkostningseffektiv

- Omkostninger

- dæksel

- sammenskrevet

- skabe

- oprettet

- skaberen

- tilpassede

- data

- Data Center

- David

- dyb

- dyb læring

- demonstrere

- demonstreret

- indsætte

- implementering

- implementering

- implementeringer

- dev

- udviklet

- Udvikler

- udviklere

- udvikling

- forskellige

- distribueret

- do

- Docker

- dokumentet

- ned

- tidligere

- Edge

- kant computing

- effektiv

- enten

- andet

- muliggør

- ende til ende

- Endpoint

- Engineering

- Enterprise

- miljøer

- Ækvivalent

- everest

- Hver

- hverdagen

- eksempel

- Undtagen

- eksisterende

- erfaring

- ekspertise

- udforske

- omfattende

- Omfattende oplevelse

- ekstremt

- falsk

- FAST

- File (Felt)

- Filer

- Endelig

- Fornavn

- FLÅDE

- Fokus

- fokuserede

- følger

- efter

- følger

- Fodspor

- Til

- formular

- format

- fundet

- stiftende

- Framework

- fra

- fu

- fuldt ud

- funktion

- funktionaliteter

- funktioner

- GitHub

- given

- Global

- Globalt

- GPU

- gruppe

- hat

- Have

- have

- he

- headers

- Helse

- sundhedspleje

- link.

- Høj ydeevne

- stærkt

- hans

- besidder

- hospital

- host

- hostede

- Hosting

- Hvordan

- How To

- HTML

- http

- HTTPS

- Hybrid

- ID

- ideal

- Identity

- if

- illustrerer

- billede

- billeder

- Imaging

- KIMOs Succeshistorier

- implementeret

- gennemføre

- importere

- import

- forbedring

- in

- Inc.

- omfatter

- medtaget

- omfatter

- Herunder

- uafhængig

- industrien

- Innovation

- indgang

- indgange

- installere

- instans

- i stedet

- integrere

- integration

- Intelligens

- interaktiv

- vejkryds

- ind

- tingenes internet

- irland

- IT

- ITS

- Job

- sammenføjning

- jpg

- json

- Nøgle

- Kend

- stor

- Latency

- senere

- føre

- ledere

- Leads

- LÆR

- læring

- Line (linje)

- belastning

- loader

- lastning

- lokale

- Lang

- maskine

- machine learning

- Flertal

- lave

- lykkedes

- leder

- styring

- kort

- Maps

- medicinsk

- Mød

- medlem

- Metadata

- Metrics

- minutter

- ML

- tilstand

- model

- modeller

- Moduler

- Moments

- Overvåg

- mere

- Multi-model slutpunkt

- flere

- indfødte

- Behov

- netværk

- net

- Ny

- ingen

- Ingen

- Nord

- notesbog

- bemærkelsesværdigt

- Nvidia

- objekt

- of

- Tilbud

- on

- ONE

- kun

- åbent

- åbent netværk

- open source

- Produktion

- operatør

- Operatører

- optimeret

- Option

- Indstillinger

- or

- Oregon

- OS

- Andet

- output

- i løbet af

- egen

- pakke

- pakker

- emballage

- par

- Parallel

- lidenskab

- lidenskabelige

- sti

- mønstre

- ydeevne

- tilladelse

- Pharmaceutical

- phd

- pipeline

- pixel

- perron

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- plus

- Populær

- Indlæg

- strøm

- beføjelser

- praksis

- Forudsigelser

- forberedt

- tidligere

- tidligere

- Main

- principper

- behandle

- Behandlet

- Processer

- forarbejdning

- Produkt

- produktchef

- produktion

- projekt

- egenskaber

- giver

- skubbet

- Python

- pytorch

- realtid

- Reality

- modtage

- Rød

- Red Hat

- reducere

- henvise

- region

- regioner

- relationer

- repræsentation

- anmode

- anmodninger

- Krav

- Kræver

- forskning

- forskere

- Ressourcer

- svar

- ansvarlige

- afkast

- genanvendelige

- Kør

- kører

- s

- SaaS

- sagemaker

- SageMaker Inference

- samme

- Gem

- Besparelser

- Skalerbarhed

- skalerbar

- Scale

- skalering

- Videnskab

- SDK

- sømløs

- Sektion

- sikkerhed

- segmentering

- valg

- SELV

- senior

- Series

- serveret

- tjeneste

- Tjenester

- sæt

- indstilling

- flere

- former

- delt

- bør

- viste

- vist

- Simpelt

- størrelser

- glat

- Fodbold

- Software

- software Engineering

- løsninger

- Løsninger

- Kilde

- specialiseret

- specifikation

- brugt

- standarder

- Trin

- Steps

- opbevaring

- butik

- opbevaret

- String

- sådan

- support

- Støtte

- sydney

- Systemer

- tager

- hold

- Teknologier

- Test

- end

- at

- deres

- Them

- derefter

- Der.

- Disse

- denne

- Gennem

- gange

- til

- sammen

- værktøjer

- mod

- Trafik

- Triton

- sand

- prøv

- TUR

- to

- allestedsnærværende

- universitet

- Opdatering

- brug

- anvendte

- Bruger

- bruger

- ved brug af

- nytte

- række

- versioner

- visning

- Virginia

- vision

- visualisering

- Visualiser

- mængder

- W

- gå

- ønsker

- we

- web

- webservices

- web-baseret

- GODT

- Hvad

- hvornår

- som

- vilje

- med

- inden for

- uden

- Arbejde

- arbejdede

- workflow

- arbejdsgange

- arbejder

- Arbejdsgruppe

- år

- Du

- Din

- zephyrnet

- nul