- 30. Juni, 2014

- Vasilis Vryniotis

- . Ingen kommentarer

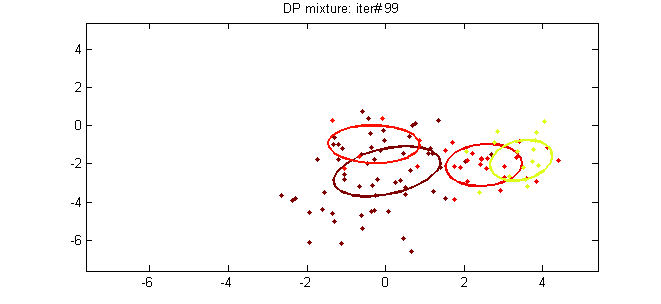

Denne artikel er den femte del af selvstudiet om Klynger med DPMM. I de tidligere indlæg dækkede vi i detaljer den teoretiske baggrund for metoden, og vi beskrev dens matematiske repræsentationermu og måder at konstruere den på. I dette indlæg vil vi forsøge at forbinde teorien med praksis ved at introducere to modeller DPMM: Dirichlet Multivariate Normal Mixture Model, som kan bruges til at klynge Gaussiske data og Dirichlet-Multinomial Mixture Model, som bruges til at klynge dokumenter.

Opdatering: Datumbox Machine Learning Framework er nu open source og gratis til downloade. Tjek pakken com.datumbox.framework.machinelearning.clustering for at se implementeringen af Dirichlet Process Mixture Models i Java.

1. Dirichlet multivariat normal blandingsmodel

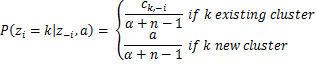

Den første Dirichlet-procesblandingsmodel, som vi vil undersøge, er Dirichlet Multivariate Normal Mixture Model, som kan bruges til at udføre clustering på kontinuerlige datasæt. Blandingsmodellen er defineret som følger:

![]()

![]()

![]()

Ligning 1: Dirichlet multivariat normal blandingsmodel

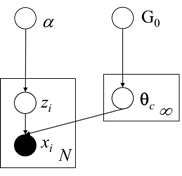

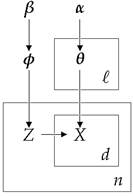

Som vi kan se ovenfor, antager den særlige model, at den generative distribution er den multinomiale gaussiske distribution og bruger den kinesiske restaurant-proces som tidligere for klyngetildelingerne. Desuden for basisfordelingen G0 den bruger Normal-Inverse-Wishart prior, som er konjugere forud af Multivariat Normalfordeling med ukendt middelværdi og kovariansmatrix. Nedenfor præsenterer vi den grafiske model af blandingsmodellen:

Figur 1: Grafisk model af Dirichlet multivariat normal blandingsmodel

Som vi diskuterede tidligere, for at kunne estimere klyngetildelingerne, vil vi bruge Kollapset Gibbs prøveudtagning hvilket kræver valg af passende konjugerede priors. Desuden bliver vi nødt til at opdatere parametrene bagud forud og beviser. Nedenfor ser vi MAP estimater af parametrene for en af klyngerne:

![]()

![]()

![]()

![]()

![]()

Ligning 2: MAP-estimater på klyngeparametre

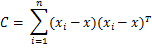

Hvor d er dimensionaliteten af vores data og ![]() er prøvegennemsnittet. Desuden har vi flere hyperparametre for Normal-Inverse-Wishart, såsom μ0 som er den indledende middelværdi, κ0 er middelbrøken, der fungerer som en udjævningsparameter, ν0 er de frihedsgrader, som er sat til antallet af dimensioner og Ψ0 er det parvise afvigelsesprodukt, som er sat til dxd-identitetsmatrixen ganget med en konstant. Fra nu af alle de tidligere hyperparametre i G0 vil blive betegnet med λ for at forenkle notationen. Endelig ved at have alt det ovenstående kan vi estimere de sandsynligheder, der kræves af Collapsed Gibbs Sampler. Sandsynligheden for, at observation i hører til klynge k givet klyngetildelingerne, datasættet og alle hyperparametrene α og λ af DP og G0 er givet nedenfor:

er prøvegennemsnittet. Desuden har vi flere hyperparametre for Normal-Inverse-Wishart, såsom μ0 som er den indledende middelværdi, κ0 er middelbrøken, der fungerer som en udjævningsparameter, ν0 er de frihedsgrader, som er sat til antallet af dimensioner og Ψ0 er det parvise afvigelsesprodukt, som er sat til dxd-identitetsmatrixen ganget med en konstant. Fra nu af alle de tidligere hyperparametre i G0 vil blive betegnet med λ for at forenkle notationen. Endelig ved at have alt det ovenstående kan vi estimere de sandsynligheder, der kræves af Collapsed Gibbs Sampler. Sandsynligheden for, at observation i hører til klynge k givet klyngetildelingerne, datasættet og alle hyperparametrene α og λ af DP og G0 er givet nedenfor:

![]()

![]()

Ligning 3: Sandsynligheder brugt af Gibbs Sampler for MNMM

Hvor zi er klyngetildelingen af observation xi, x1:n er det komplette datasæt, z-i er sættet af klyngetildelinger uden den af ith observation, x-i er det komplette datasæt eksklusive ith observation, ck,-jeg er det samlede antal observationer, der er tildelt klynge k ekskl. ith observation mens ![]() ,

, ![]() er middelværdien og kovariansmatrixen for klynge k ekskl. ith observation.

er middelværdien og kovariansmatrixen for klynge k ekskl. ith observation.

2. Dirichlet-multinomial blandingsmodel

Dirichlet-Multinomial Mixture Model bruges til at udføre klyngeanalyse af dokumenter. Den særlige model har et lidt mere kompliceret hierarki, da den modellerer dokumenternes emner/kategorier, ordsandsynligheder inden for hvert emne, klyngetildelinger og den generative fordeling af dokumenterne. Dens mål er at udføre uovervåget læring og gruppere en liste over dokumenter ved at tildele dem til grupper. Blandingsmodellen er defineret som følger:

![]()

![]()

![]()

![]()

Ligning 4: Dirichlet-multinomial blandingsmodel

Hvor φ modellerer emnesandsynligheder, zi er en emnevælger, θk er ordsandsynligheder i hver klynge og xi, j repræsenterer dokumentets ord. Vi skal bemærke, at denne teknik bruger pose-of-word ramme der repræsenterer dokumenterne som en uordnet samling af ord, der ser bort fra grammatik og ordstilling. Denne forenklede repræsentation er almindeligt anvendt i naturlig sprogbehandling og informationssøgning. Nedenfor præsenterer vi den grafiske model af blandingsmodellen:

Figur 2: Grafisk model af Dirichlet-multinomial blandingsmodellen

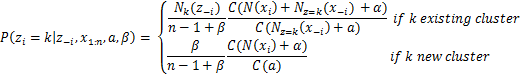

Den særlige model bruger Multinomial Diskret fordeling for den generative fordeling og Dirichlet-fordelinger for priorne. ℓ er størrelsen af vores aktive klynger, n det samlede antal dokumenter, β styrer det a priori forventede antal klynger, mens α kontrollerer antallet af ord, der er tildelt hver klynge. At estimere de sandsynligheder, der kræves af Sammenklappet Gibbs Sampler vi bruger følgende ligning:

![]()

Ligning 5: Sandsynligheder brugt af Gibbs Sampler til DMMM

Hvor Γ er gammafunktionen, zi er klyngetildelingen af dokument xi, x1:n er det komplette datasæt, z-i er sættet af klyngetildelinger uden den af ith dokument, x-i er det komplette datasæt eksklusive ith dokument, Nk(z-i) er antallet af observationer tildelt til klynge k ekskl. ith dokument, Nz=k(x-i) er en vektor med summen af antal for hvert ord for alle de dokumenter, der er tildelt til klynge k undtagen ith dokument og N(xi) er den sparsomme vektor med antallet af hvert ord i dokument xi. Endelig, som vi kan se ovenfor, ved at bruge Collapsed Gibbs Sampler med den kinesiske restaurantproces, θjk variabel som gemmer sandsynligheden for ord j i emne k kan integreres ud.

- AI

- ai kunst

- ai kunst generator

- en robot

- kunstig intelligens

- certificering af kunstig intelligens

- kunstig intelligens robot

- kunstig intelligens robotter

- software til kunstig intelligens

- blockchain

- blockchain konference ai

- coingenius

- samtale kunstig intelligens

- kryptokonference ai

- dalls

- Datumboks

- dyb læring

- du har google

- machine learning

- Maskinlæring og statistik

- plato

- platon ai

- Platon Data Intelligence

- Platon spil

- PlatoData

- platogaming

- skala ai

- syntaks

- zephyrnet