I dag bygger mange AWS-kunder enterprise-ready machine learning (ML) platforme på Amazon Elastic Kubernetes Service (Amazon EKS) ved hjælp af Kubeflow på AWS (en AWS-specifik distribution af Kubeflow) på tværs af mange use cases, herunder computersyn, naturlig sprogforståelse, taleoversættelse og økonomisk modellering.

Med seneste udgivelse af open source Kubeflow v1.6.1, fortsætter Kubeflow-fællesskabet med at understøtte denne storstilede anvendelse af Kubeflow til virksomhedsbrug. Den seneste udgivelse indeholder mange nye spændende funktioner som support til Kubernetes v1.22, kombineret Python SDK til PyTorch, MXNet, MPI, XGBoost i Kubeflows distribuerede Training Operator, nye ClusterServingRuntime og ServingRuntime CRD'er til modelservice og mange flere.

AWS-bidrag til Kubeflow med den nylige lancering af Kubeflow på AWS 1.6.1 understøtter alle upstream open source Kubeflow-funktioner og inkluderer mange nye integrationer med de meget optimerede, cloud-native, virksomhedsklare AWS-tjenester, der vil hjælpe dig med at opbygge yderst pålidelige, sikre, bærbare og skalerbare ML-systemer.

I dette indlæg diskuterer vi nye Kubeflow på AWS v1.6.1 funktioner og fremhæver tre vigtige integrationer, der er samlet på én platform for at tilbyde dig::

- Infrastructure as Code (IaaC) et-klik-løsning, der automatiserer end-to-end installationen af Kubeflow, inklusive oprettelse af EKS-klynge

- Støtte til distribueret træning vedr Amazon SageMaker ved brug af Amazon SageMaker-operatører til Kubernetes (ACK) og SageMaker komponenter til Kubeflow rørledninger og lokalt på Kubernetes vha Kubeflow træningsoperatører. Mange kunder bruger denne evne til at bygge hybride maskinlæringsarkitekturer, hvor de udnytter både Kubernetes compute til eksperimenteringsfasen og SageMaker til at køre arbejdsbelastninger i produktionsskala.

- Forbedret overvågning og observerbarhed for ML-arbejdsbelastninger, herunder Amazon EKS, Kubeflow-metrics og applikationslogfiler ved hjælp af Prometheus, Grafana og amazoncloudwatch integrationer

Use casen i denne blog vil specifikt fokusere på SageMaker-integration med Kubeflow på AWS, som kunne føjes til dine eksisterende Kubernetes-arbejdsgange, så du kan bygge hybride maskinlæringsarkitekturer.

Kubeflow på AWS

Kubeflow på AWS 1.6.1 giver en klar vej til at bruge Kubeflow, med tilføjelsen af følgende AWS-tjenester oven i eksisterende muligheder:

- SageMaker Integration med Kubeflow til at køre hybride ML-arbejdsgange ved hjælp af SageMaker Operators for Kubernetes (ACK) og SageMaker Components for Kubeflow Pipelines.

- Automatiske implementeringsmuligheder er blevet forbedret og forenklet ved hjælp af Kustomize-scripts og Helm-diagrammer.

- Tilføjet support til Infrastructure as Code (IaC) et-klik-implementering for Kubeflow på AWS ved hjælp af Terraform for alle de tilgængelige implementeringsmuligheder. Dette script automatiserer oprettelsen af følgende AWS-ressourcer:

- Støtte til AWS PrivateLink til Amazon S3, der gør det muligt for ikke-kommercielle regionsbrugere at oprette forbindelse til deres respektive S3-endepunkter.

- Tilføjet integration med Amazon Managed Service for Prometheus (AMP) og Amazon administrerede Grafana at overvåge metrics med Kubeflow på AWS.

- Opdaterede Kubeflow notebook-servercontainere med de seneste deep learning-containerbilleder baseret på TensorFlow 2.10.0 og PyTorch 1.12.1.

- Integration med AWS DLC'er for at køre distribueret uddannelse , følgeslutning arbejdsbelastninger.

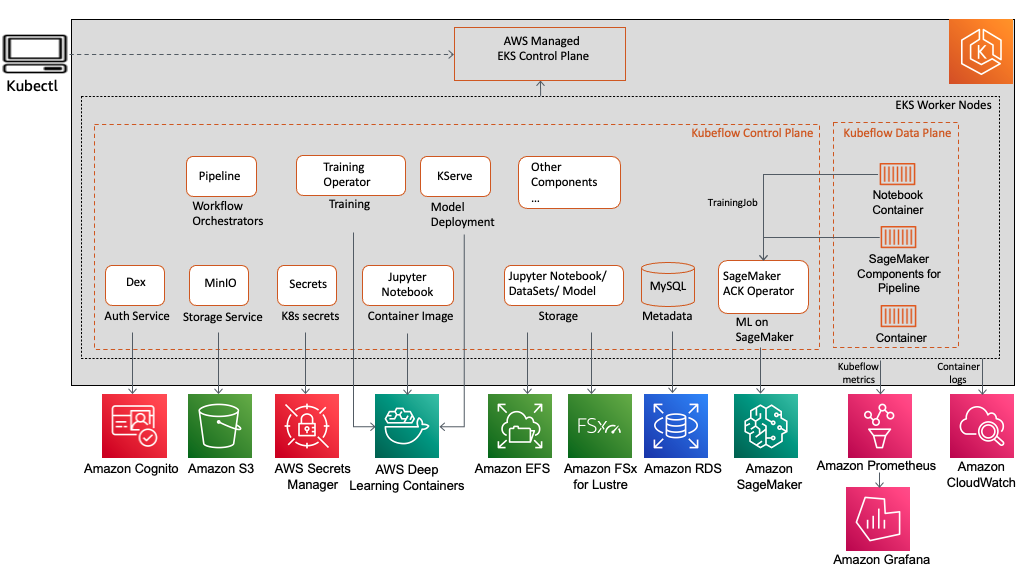

Følgende arkitekturdiagram er et hurtigt øjebliksbillede af alle serviceintegrationer (inklusive dem, der allerede er nævnt), der er tilgængelige for Kubeflow-kontrol- og dataplankomponenter i Kubeflow på AWS. Kubeflow-kontrolplanet er installeret oven på Amazon EKS, som er en administreret containertjeneste, der bruges til at køre og skalere Kubernetes-applikationer i skyen. Disse AWS-tjenesteintegrationer giver dig mulighed for at afkoble kritiske dele af Kubeflow-kontrolplanet fra Kubernetes, hvilket giver et sikkert, skalerbart, modstandsdygtigt og omkostningsoptimeret design. For flere detaljer om den værdi, som disse serviceintegrationer tilføjer over open source Kubeflow, henvises til Byg og implementer et skalerbart maskinlæringssystem på Kubernetes med Kubeflow på AWS.

Lad os diskutere mere detaljeret om, hvordan Kubeflow på AWS 1.6.1-nøglefunktionerne kan være nyttige for din organisation.

Kubeflow på AWS-funktionsdetaljer

Med Kubeflow 1.6.1-udgivelsen forsøgte vi at levere bedre værktøjer til forskellige slags kunder, der gør det nemt at komme i gang med Kubeflow, uanset hvilke muligheder du vælger. Disse værktøjer giver et godt udgangspunkt og kan modificeres, så de passer til netop dine behov.

Distributionsindstillinger

Vi tilbyder forskellige implementeringsmuligheder til forskellige kundetilfælde. Her kan du vælge, hvilke AWS-tjenester du vil integrere din Kubeflow-implementering med. Hvis du beslutter dig for at ændre implementeringsindstillinger senere, anbefaler vi, at du laver en ny installation til den nye implementering. Følgende implementeringsmuligheder er tilgængelige:

Hvis du vil implementere Kubeflow med minimale ændringer, skal du overveje vanilje implementeringsmulighed. Alle tilgængelige implementeringsmuligheder kan installeres ved hjælp af Kustomize, Helm eller Terraform.

Vi har også forskellige tilføjelsesinstallationer, der kan installeres oven på enhver af disse implementeringsmuligheder:

Installationsindstillinger

Når du har besluttet, hvilken implementeringsmulighed der passer bedst til dine behov, kan du vælge, hvordan du vil installere disse implementeringer. I et forsøg på at betjene både eksperter og nytilkomne har vi forskellige niveauer af automatisering og konfiguration.

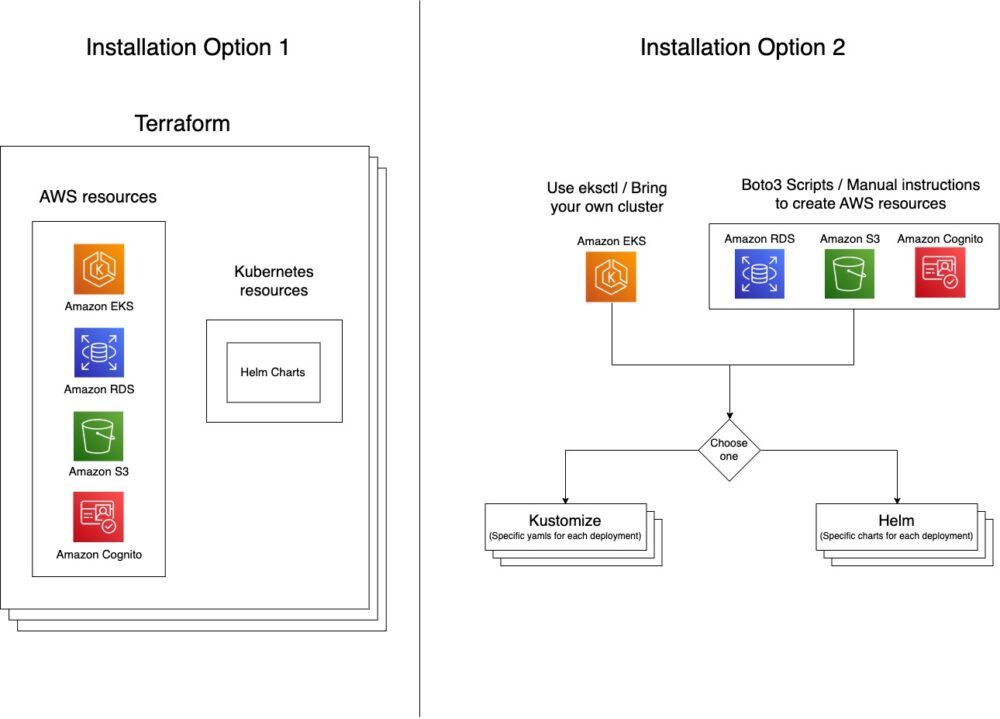

Mulighed 1: Terraform (IaC)

Dette opretter en EKS-klynge og alle de relaterede AWS-infrastrukturressourcer og implementerer derefter Kubeflow alt i én kommando ved hjælp af Terraform. Internt bruger dette EKS-planer og Helm-diagrammer.

Denne mulighed har følgende fordele:

- Det giver virksomheder fleksibilitet til at implementere Amazon EKS og Kubeflow med én kommando uden at skulle bekymre sig om specifikke Kubeflow-komponentkonfigurationer. Dette vil i høj grad hjælpe med at fremskynde teknologievaluering, prototyping og produktudviklingens livscyklus, hvilket giver fleksibilitet til at bruge terraform-moduler og modificere det for at imødekomme ethvert projektspecifikt behov.

- Mange organisationer i dag, som har Terraform som centrum for deres cloud-strategi, kan nu bruge Kubeflow på AWS Terraform-løsning til at opfylde deres cloud-mål.

Mulighed 2: Tilpasnings- eller Helm-diagrammer:

Denne mulighed giver dig mulighed for at implementere Kubeflow i en to-trins proces:

- Opret AWS-ressourcer som Amazon EKS, Amazon RDS, Amazon S3 og Amazon Cognito, enten gennem de automatiserede scripts inkluderet i AWS-distributionen eller manuelt efter en trin-for-trin guide.

- Installer Kubeflow-implementeringer enten ved hjælp af Helm-diagrammer eller Kustomize.

Denne mulighed har følgende fordele:

- Hovedmålet med denne installationsmulighed er at levere Kubeflow-relaterede Kubernetes-konfigurationer. Derfor kan du vælge at oprette eller bringe eksisterende EKS-klynger eller en hvilken som helst af de relaterede AWS-ressourcer som Amazon RDS, Amazon S3 og Amazon Cognito ind og konfigurere og administrere det til at arbejde med Kubeflow på AWS.

- Det er nemmere at flytte fra et open source Kustomize Kubeflow-manifest til AWS Kubeflow-distribution.

Følgende diagram illustrerer arkitekturen af begge muligheder.

Integration med SageMaker

SageMaker er en fuldt administreret tjeneste designet og optimeret specifikt til styring af ML-arbejdsgange. Det fjerner de udifferentierede tunge løft af infrastrukturstyring og eliminerer behovet for at investere i IT og DevOps til at administrere klynger til ML-modelopbygning, træning og inferens.

Mange AWS-kunder, der har mobilitetskrav eller lokale standardrestriktioner, bruger Amazon EKS til at opsætte repeterbare ML-pipelines, der kører trænings- og inferensarbejdsbelastninger. Dette kræver dog, at udviklere skriver tilpasset kode for at optimere den underliggende ML-infrastruktur, levere høj tilgængelighed og pålidelighed og overholde passende sikkerheds- og lovkrav. Disse kunder ønsker derfor at bruge SageMaker til omkostningsoptimeret og administreret infrastruktur til modeltræning og implementeringer og fortsætter med at bruge Kubernetes til orkestrering og ML-pipelines for at bevare standardisering og portabilitet.

For at imødekomme dette behov giver AWS dig mulighed for at træne, tune og implementere modeller i SageMaker fra Amazon EKS ved at bruge følgende to muligheder:

- Amazon SageMaker ACK Operators for Kubernetes, som er baseret på AWS-controllere til Kubernetes (ACK) ramme. ACK er AWS-strategien, der bringer standardisering til bygning af Kubernetes brugerdefinerede controllere, der tillader Kubernetes-brugere at levere AWS-ressourcer som databaser eller meddelelseskøer blot ved at bruge Kubernetes API. SageMaker ACK-operatører gør det nemmere for ML-udviklere og dataforskere, der bruger Kubernetes som deres kontrolplan, at træne, tune og implementere ML-modeller i SageMaker uden at logge ind på SageMaker-konsollen.

- SageMaker-komponenter til Kubeflow-rørledninger, som giver dig mulighed for at integrere SageMaker med portabiliteten og orkestreringen af Kubeflow Pipelines. Med SageMaker-komponenterne kører hvert job i pipeline-workflowet på SageMaker i stedet for den lokale Kubernetes-klynge. Dette giver dig mulighed for at oprette og overvåge indbygget SageMaker-træning, tuning, slutpunktsimplementering og batch-transformationsjob fra dine Kubeflow Pipelines, hvilket giver dig mulighed for at flytte komplet databehandling inklusive databehandling og træningsjob fra Kubernetes-klyngen til SageMakers maskinlæringsoptimerede administrerede service.

Fra og med Kubeflow på AWS v1.6.1 samler alle de tilgængelige Kubeflow-implementeringsmuligheder som standard begge Amazon SageMaker-integrationsmuligheder på én platform. Det betyder, at du nu kan indsende SageMaker-job ved hjælp af SageMaker ACK-operatører fra selve Kubeflow Notebook-serveren ved at indsende den tilpassede SageMaker-ressource eller fra Kubeflow-pipelinetrinet ved hjælp af SageMaker-komponenter.

Der er to versioner af SageMaker Components – Boto3 (AWS SDK for AWS SDK for Python)-baserede version 1-komponenter og SageMaker Operator til K8s (ACK)-baserede version 2-komponenter. De nye SageMaker-komponenter version 2 understøtter den seneste SageMaker-trænings-api, og vi vil fortsætte med at tilføje flere SageMaker-funktioner til denne version af komponenten. Du har dog fleksibiliteten til at kombinere Sagemaker-komponenter version 2 til træning og version 1 til andre SageMaker-funktioner som f.eks. hyperparameterjustering, behandlingsjob, hosting og mange flere.

Integration med Prometheus og Grafana

Prometheus er et open source-metrik-aggregeringsværktøj, som du kan konfigurere til at køre på Kubernetes-klynger. Når den kører på Kubernetes-klynger, skraber en hoved Prometheus-server med jævne mellemrum pod-endepunkter.

Kubeflow-komponenter, såsom Kubeflow Pipelines (KFP) og Notebook, udsender Prometheus-målinger for at tillade overvågning af komponentressourcer såsom antallet af kørende eksperimenter eller notebook-antal.

Disse metrics kan aggregeres af en Prometheus-server, der kører i Kubernetes-klyngen og forespørges ved hjælp af Prometheus Query Language (PromQL). For flere detaljer om de funktioner, som Prometheus understøtter, se Prometheus dokumentation.

Kubeflow på AWS-distributionen giver understøttelse af integrationen med følgende AWS-administrerede tjenester:

- Amazon Managed Prometheus (AMP), der er en Prometheus-kompatibel overvågningstjeneste for containerinfrastruktur og applikationsmålinger for containere, der gør det nemt for kunderne sikkert at overvåge containermiljøer i stor skala. Ved hjælp af AMP kan du visualisere, analysere og alarmere dine metrics, logfiler og spor indsamlet fra flere datakilder i dit observerbarhedssystem, herunder AWS, tredjeparts ISV'er og andre ressourcer på tværs af din it-portefølje.

- Amazon Managed Grafana, en fuldt administreret og sikker datavisualiseringstjeneste baseret på open source grafana projekt, der sætter kunder i stand til øjeblikkeligt at forespørge, korrelere og visualisere operationelle målinger, logfiler og spor for deres applikationer fra flere datakilder. Amazon Managed Grafana aflaster den operationelle administration af Grafana ved automatisk at skalere computer- og databaseinfrastruktur, efterhånden som brugskravene stiger, med automatiserede versionsopdateringer og sikkerhedsrettelser.

Kubeflow på AWS-distributionen giver understøttelse af integrationen af Amazon Managed Service for Prometheus og Amazon Managed Grafana for at lette indtagelse og visualisering af Prometheus-metrikker sikkert i skala.

Følgende metrics indtages og kan visualiseres:

- Metrics udsendt fra Kubeflow-komponenter såsom Kubeflow Pipelines og Notebook-serveren

- KubeFlow kontrolplanmålinger

For at konfigurere Amazon Managed Service til Prometheus og Amazon Managed Grafana til din Kubeflow-klynge, se Brug Prometheus, Amazon Managed Service for Prometheus og Amazon Managed Grafana til at overvåge metrics med Kubeflow på AWS.

Løsningsoversigt

I dette tilfælde bruger vi Kubeflow vanilla-implementeringen ved hjælp af Terraform-installationsmuligheden. Når installationen er færdig, logger vi ind på Kubeflow-dashboardet. Fra dashboardet spinder vi en Kubeflow Jupyter notebook-server op for at bygge en Kubeflow-pipeline, der bruger SageMaker til at køre distribueret træning til en billedklassificeringsmodel og et SageMaker-slutpunkt til modelimplementering.

Forudsætninger

Sørg for, at du opfylder følgende forudsætninger:

- Du har en AWS-konto.

- Sørg for, at du er i

us-west-2Region for at køre dette eksempel. - Brug Google Chrome til at interagere med AWS Management Console og Kubeflow.

- Sørg for, at din konto har en SageMaker Training-ressourcetypegrænse for ml.p3.2xlarge øget til 2 ved hjælp af Service Quotas-konsollen.

- Eventuelt kan du bruge AWS Cloud9, et cloud-baseret integreret udviklingsmiljø (IDE), der gør det muligt at fuldføre alt arbejdet fra din webbrowser. For opsætningsinstruktioner, se Opsæt Cloud9 IDE. Vælg Ubuntu Server 18.04 som platform i AWS Cloud9-indstillingerne.

Vælg derefter plustegnet fra dit AWS Cloud9-miljø, og åbn en ny terminal.

Vælg derefter plustegnet fra dit AWS Cloud9-miljø, og åbn en ny terminal.

Du konfigurerer også en AWS kommandolinjegrænseflade (AWS CLI) profil. For at gøre det skal du bruge et adgangsnøgle-id og en hemmelig adgangsnøgle til en AWS identitets- og adgangsstyring (JEG ER) bruger konto med administrative rettigheder (vedhæft den eksisterende administrerede politik) og programmatisk adgang. Se følgende kode:

Bekræft de tilladelser, som cloud9 vil bruge til at kalde AWS-ressourcer.

Bekræft fra nedenstående output, at du ser arn af den admin-bruger, som du har konfigureret i AWS CLI-profilen. I dette eksempel er det "kubeflow-bruger"

Installer Amazon EKS og Kubeflow på AWS

For at installere Amazon EKS og Kubeflow på AWS skal du udføre følgende trin:

- Konfigurer dit miljø til at implementere Kubeflow på AWS:

- Implementer vaniljeversionen af Kubeflow på AWS og relaterede AWS-ressourcer som EKS ved hjælp af Terraform. Bemærk venligst, at EBS-volumener, der bruges i EKS nodegroup, ikke er krypteret som standard:

Konfigurer Kubeflow-tilladelserne

- Tilføj tilladelser til Notebook-pod og Pipeline-komponentpod for at foretage SageMaker, S3 og IAM api-opkald ved hjælp af

kubeflow_iam_permissions.shscripts. - Opret SageMaker-udførelsesrolle for at gøre det muligt for SageMaker-uddannelsesjob at få adgang til træningsdatasæt fra S3-tjeneste ved hjælp af

sagemaker_role.shscripts.

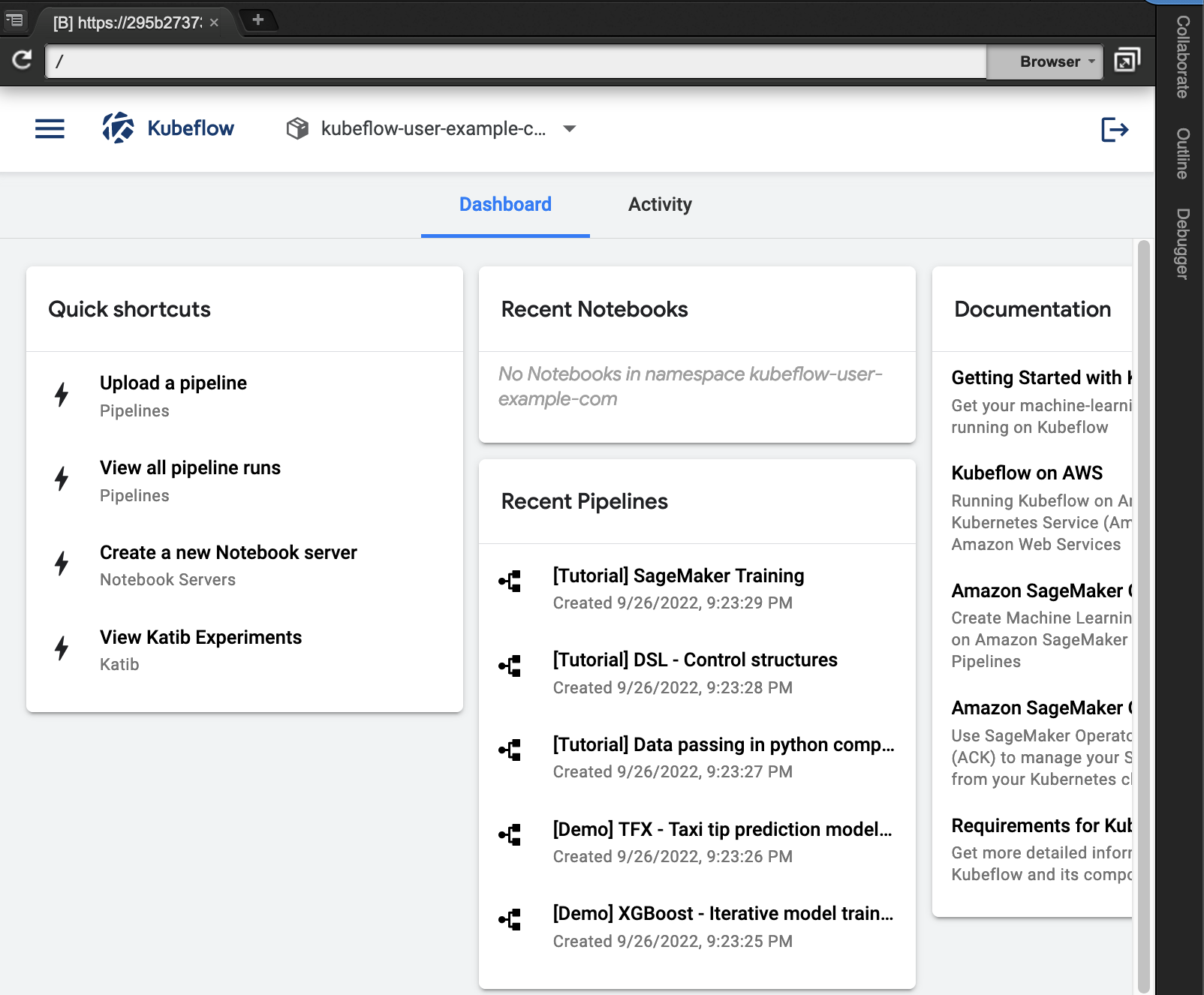

Få adgang til Kubeflow-dashboardet

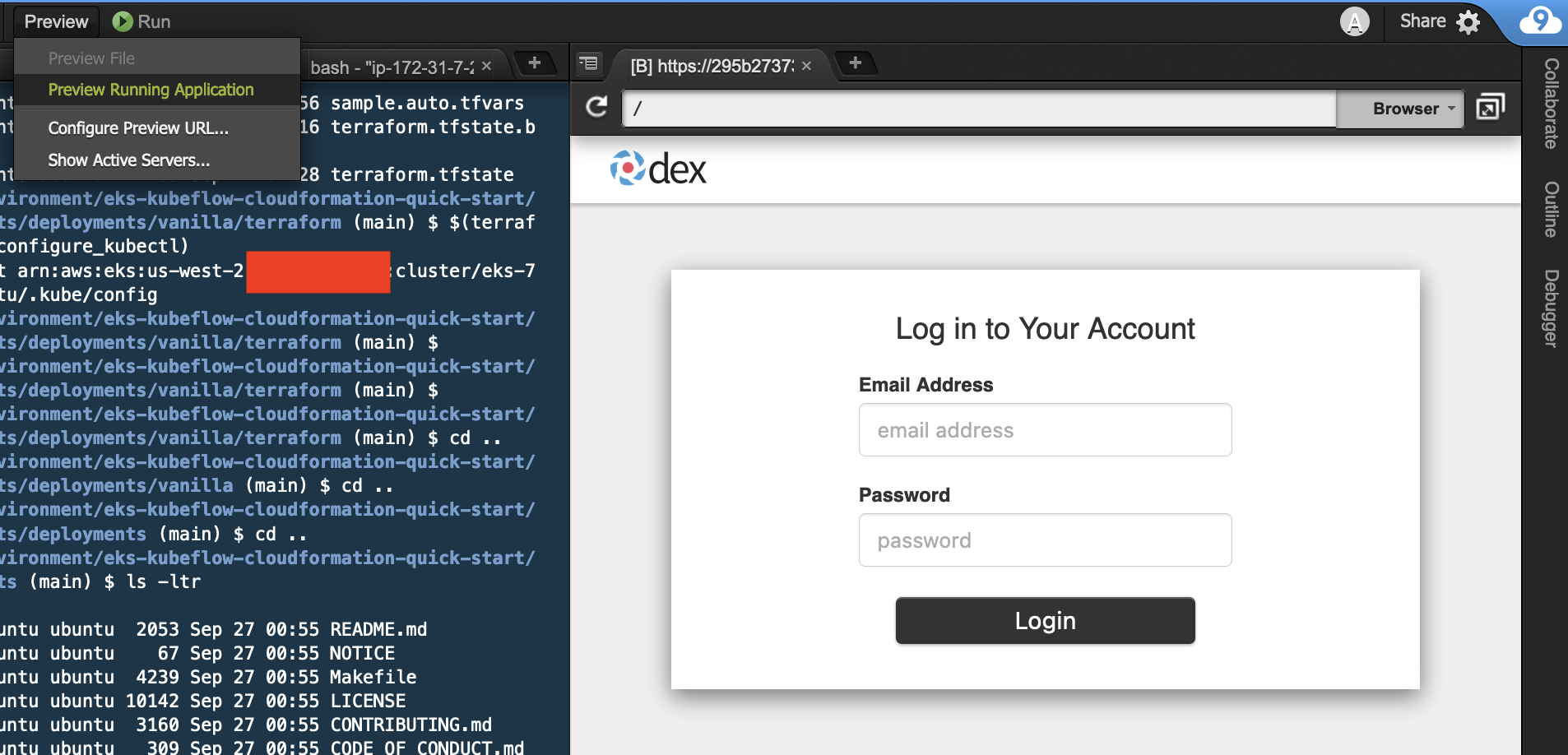

Udfør følgende trin for at få adgang til Kubeflow-dashboardet:

- Du kan køre Kubeflow-dashboard lokalt i Cloud9-miljøet uden at udsætte dine URL'er for offentligt internet ved at køre nedenstående kommandoer.

- Vælg Forhåndsvisning af kørende applikation.

- Vælg ikonet i hjørnet af Kubeflow-dashboardet for at åbne det som en separat fane i Chrome.

- Indtast standardoplysningerne (

user@example.com/12341234) for at logge ind på Kubeflow-dashboardet.

Konfigurer Kubeflow på AWS-miljøet

Når du er logget ind på Kubeflow-dashboardet, skal du sikre dig, at du har det rigtige navneområde (kubeflow-user-example-com) valgt. Udfør følgende trin for at konfigurere dit Kubeflow på AWS-miljø:

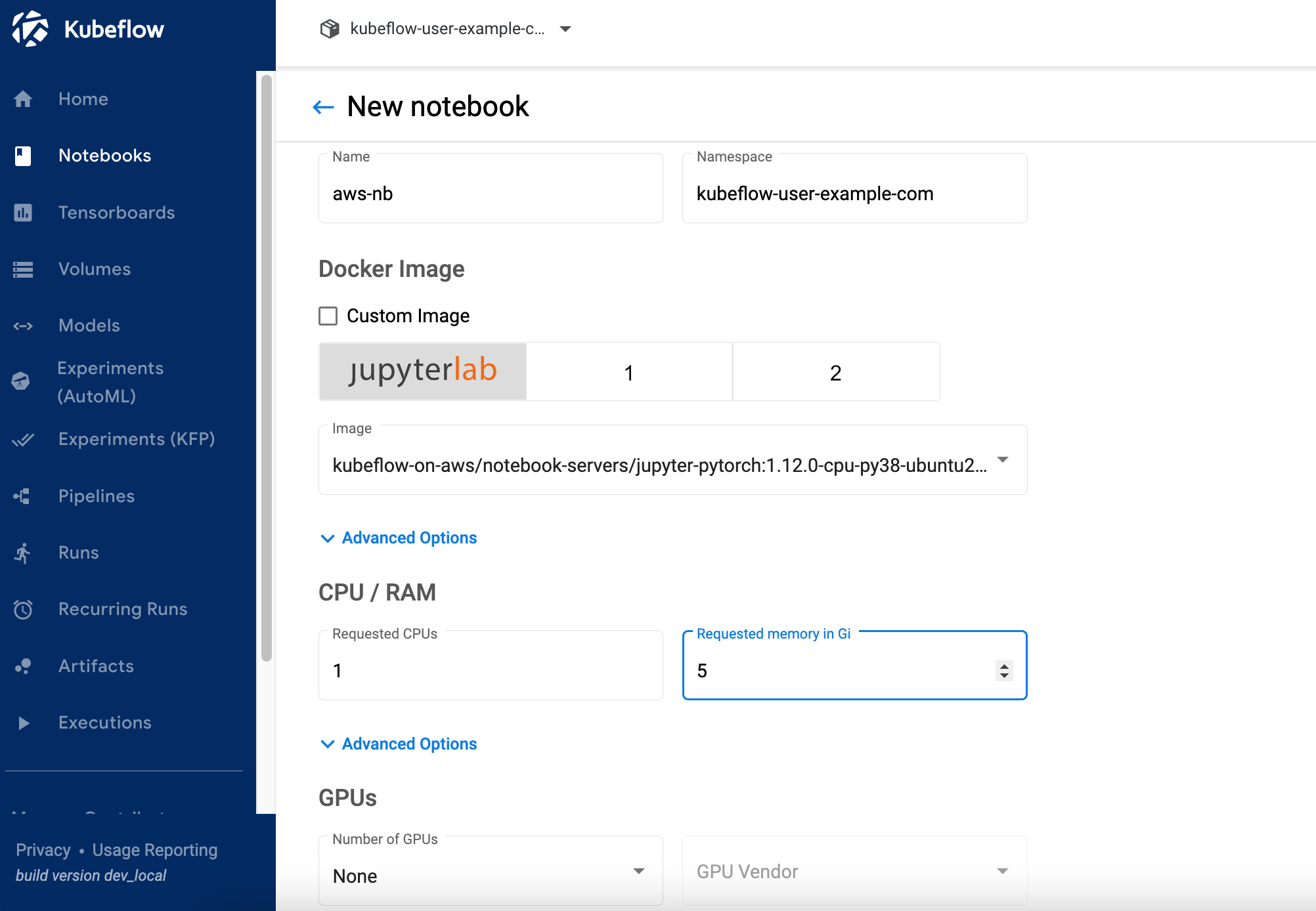

- Vælg på Kubeflow-dashboardet Notebooks i navigationsruden.

- Vælg Ny notesbog.

- Til Navn, gå ind

aws-nb. - Til Jupyter Docket billede, vælg billedet

jupyter-pytorch:1.12.0-cpu-py38-ubuntu20.04-ec2-2022-09-20(det seneste tilgængeligejupyter-pytorchDLC-billede). - Til CPU, gå ind

1. - Til Hukommelse, gå ind

5. - Til GPU'er, lad være som Ingen.

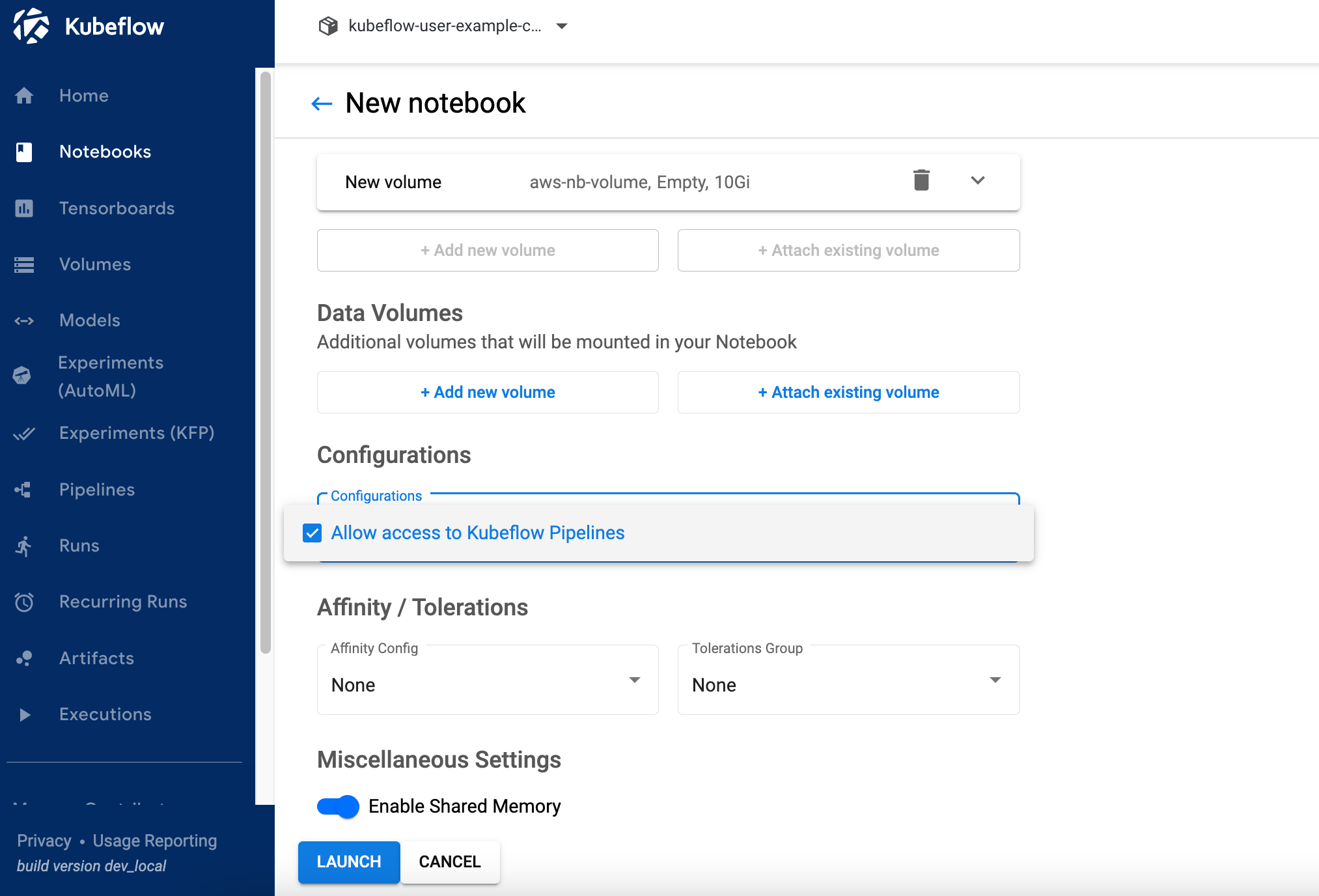

- Foretag ikke ændringer i Arbejdsområde , Datamængder sektioner.

- Type Tillad adgang til Kubeflow Pipelines i Konfigurationer sektion og vælg Start.

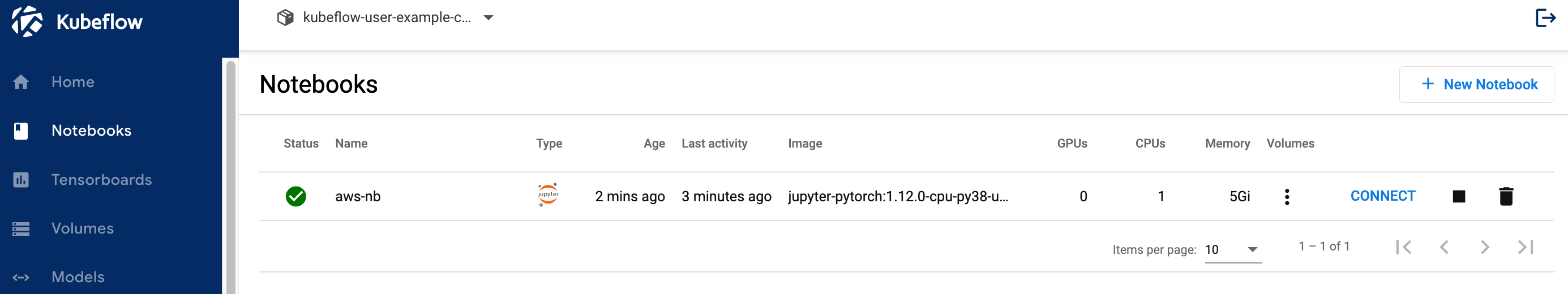

- Bekræft, at din notesbog er oprettet korrekt (det kan tage et par minutter).

- Vælg Tilslut for at logge ind på JupyterLab.

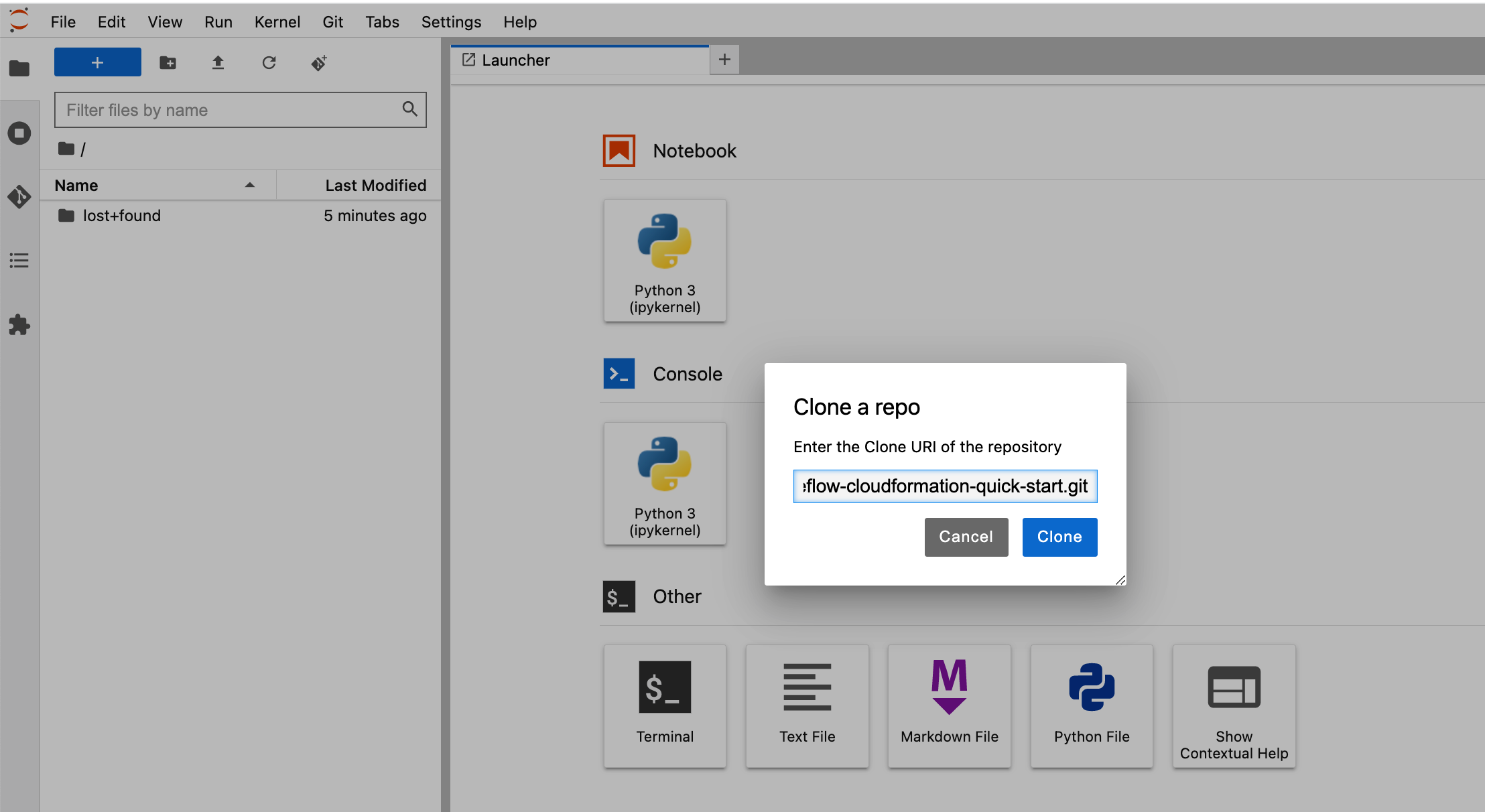

- Klon arkivet ved at gå ind

https://github.com/aws-samples/eks-kubeflow-cloudformation-quick-start.giti Klon en repo felt. - Vælg Klon.

Kør et distribueret træningseksempel

Når du har konfigureret Jupyter notesbogen, kan du køre hele demoen ved at bruge følgende trin på højt niveau fra mappen eks-kubeflow-cloudformation-quick-start/workshop/pytorch-distributed-training i det klonede depot:

- Kør PyTorch Distributed Data Parallel (DDP) træningsscript – Se PyTorch DDP-træningsscriptet

cifar10-distributed-gpu-final.py, som inkluderer et eksempel på et foldet neuralt netværk og logik til at distribuere træning på en multi-node CPU og GPU-klynge. - Opret en Kubeflow-pipeline – Kør notesbogen

STEP1.0_create_pipeline_k8s_sagemaker.ipynbat skabe en pipeline, der kører og implementerer modeller på SageMaker. Sørg for at installere SageMaker-biblioteket som en del af den første notebook-celle og genstart kernen, før du kører resten af notebook-cellerne. - Kald et SageMaker-slutpunkt – Kør notesbogen

STEP1.1_invoke_sagemaker_endpoint.ipynbfor at påkalde og teste SageMaker-modellens slutpunkt, der blev oprettet i den forrige notesbog.

I de efterfølgende afsnit diskuterer vi hvert af disse trin i detaljer.

Kør PyTorch DDP-træningsscriptet

Som en del af den distribuerede træning træner vi en klassifikationsmodel skabt af et simpelt foldet neuralt netværk, der opererer på CIFAR10-datasættet. Træningsmanuskriptet cifar10-distributed-gpu-final.py indeholder kun open source-biblioteker og er kompatibel til at køre både på Kubernetes og SageMaker træningsklynger på enten GPU-enheder eller CPU-instanser. Lad os se på et par vigtige aspekter af træningsscriptet, før vi kører vores notesbogseksempler.

Vi bruger torch.distributed modul, som indeholder PyTorch-understøttelse og kommunikationsprimitiver til multi-proces parallelisme på tværs af noder i klyngen:

Vi skaber en simpel billedklassificeringsmodel ved hjælp af en kombination af foldning, max pooling og lineære lag, hvortil en relu aktiveringsfunktionen anvendes i det fremadgående gennemløb af modeltræningen:

Hvis træningsklyngen har GPU'er, kører scriptet træningen på CUDA-enheder, og enhedsvariablen indeholder standard-CUDA-enheden:

Før du kører distribueret træning ved hjælp af PyTorch DistributedDataParallel for at køre distribueret behandling på flere noder, skal du initialisere det distribuerede miljø ved at kalde init_process_group. Dette initialiseres på hver maskine i træningsklyngen.

Vi instansierer klassificeringsmodellen og kopierer modellen til målenheden. Hvis distribueret træning er aktiveret til at køre på flere noder, DistributedDataParallel klasse bruges som et indpakningsobjekt omkring modelobjektet, hvilket tillader synkron distribueret træning på tværs af flere maskiner. Inputdataene opdeles på batchdimensionen, og en kopi af modellen placeres på hver maskine og hver enhed. Se følgende kode:

Opret en Kubeflow-pipeline

Notesbogen bruger Kubeflow Pipelines SDK og dets medfølgende sæt af Python-pakker til at specificere og køre ML-workflow-pipelines. Som en del af denne SDK bruger vi pakkedekoratoren for domænespecifikke sprog (DSL). dsl.pipeline, som dekorerer Python-funktionerne for at returnere en pipeline.

Kubeflow-pipelinen bruger SageMaker-komponent V2 til at indsende træning til SageMaker ved hjælp af SageMaker ACK-operatører. SageMaker-modeloprettelse og modelimplementering bruger SageMaker-komponent V1, som er Boto3-baserede SageMaker-komponenter. Vi bruger en kombination af begge komponenter i dette eksempel for at demonstrere den fleksibilitet, du har i valg.

- Indlæs SageMaker-komponenterne ved hjælp af følgende kode:

I den følgende kode opretter vi Kubeflow-pipeline, hvor vi kører SageMaker distribueret træning ved hjælp af to

ml.p3.2xlargetilfælde:Efter at pipelinen er defineret, kan du kompilere pipelinen til en Argo YAML-specifikation ved hjælp af Kubeflow Pipelines SDK'er

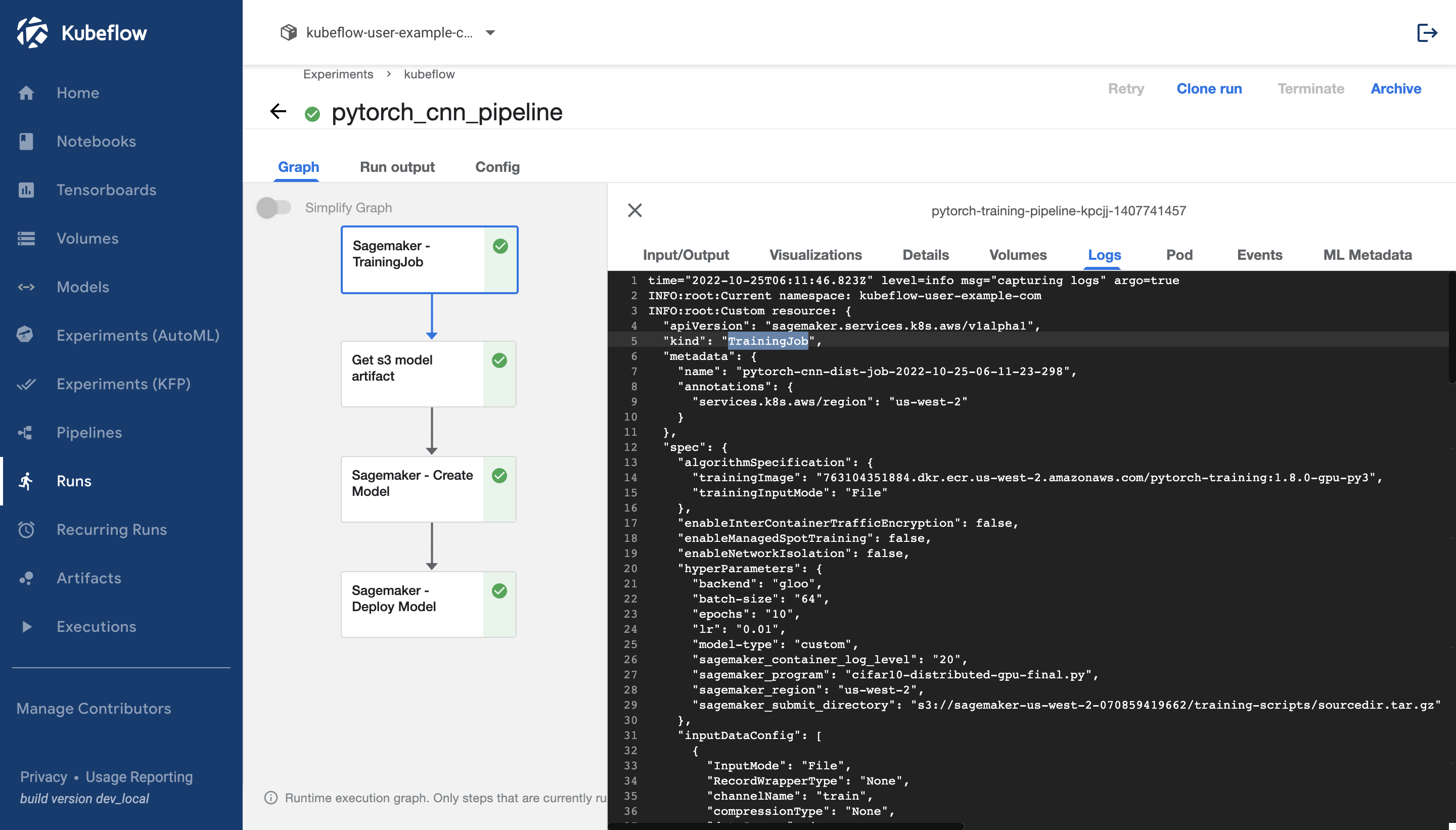

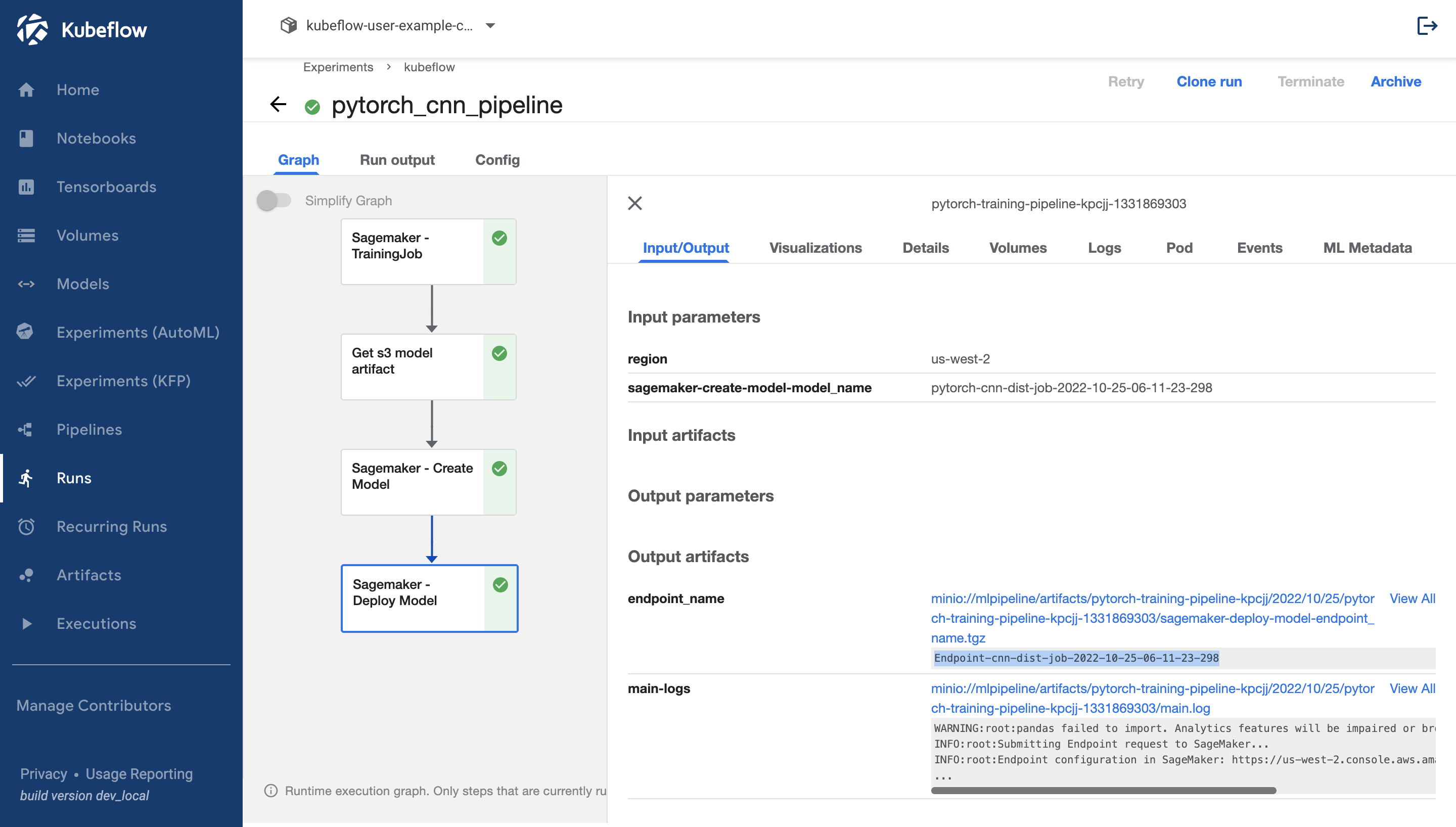

kfp.compilerpakke. Du kan køre denne pipeline ved hjælp af Kubeflow Pipelines SDK-klienten, som kalder Pipelines-tjenestens slutpunkt og sender passende godkendelsesheadere direkte fra notesbogen. Se følgende kode: - Vælg den Kør detaljer link under den sidste celle for at se Kubeflow-pipelinen. Følgende skærmbillede viser vores pipelinedetaljer for SageMaker-trænings- og implementeringskomponenten.

- Vælg træningsjobbet trin og på Logs fanen, skal du vælge linket CloudWatch-logfiler for at få adgang til SageMaker-logfilerne.

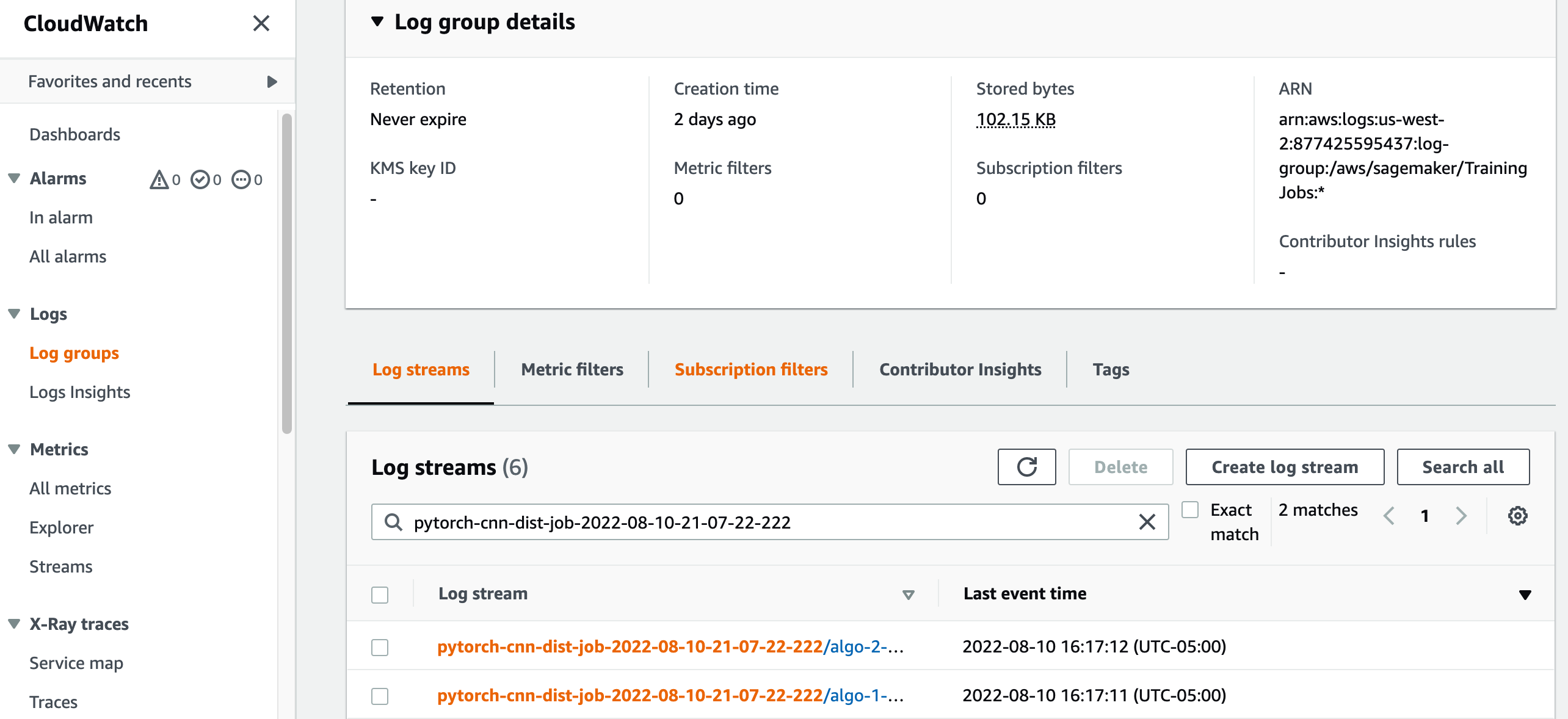

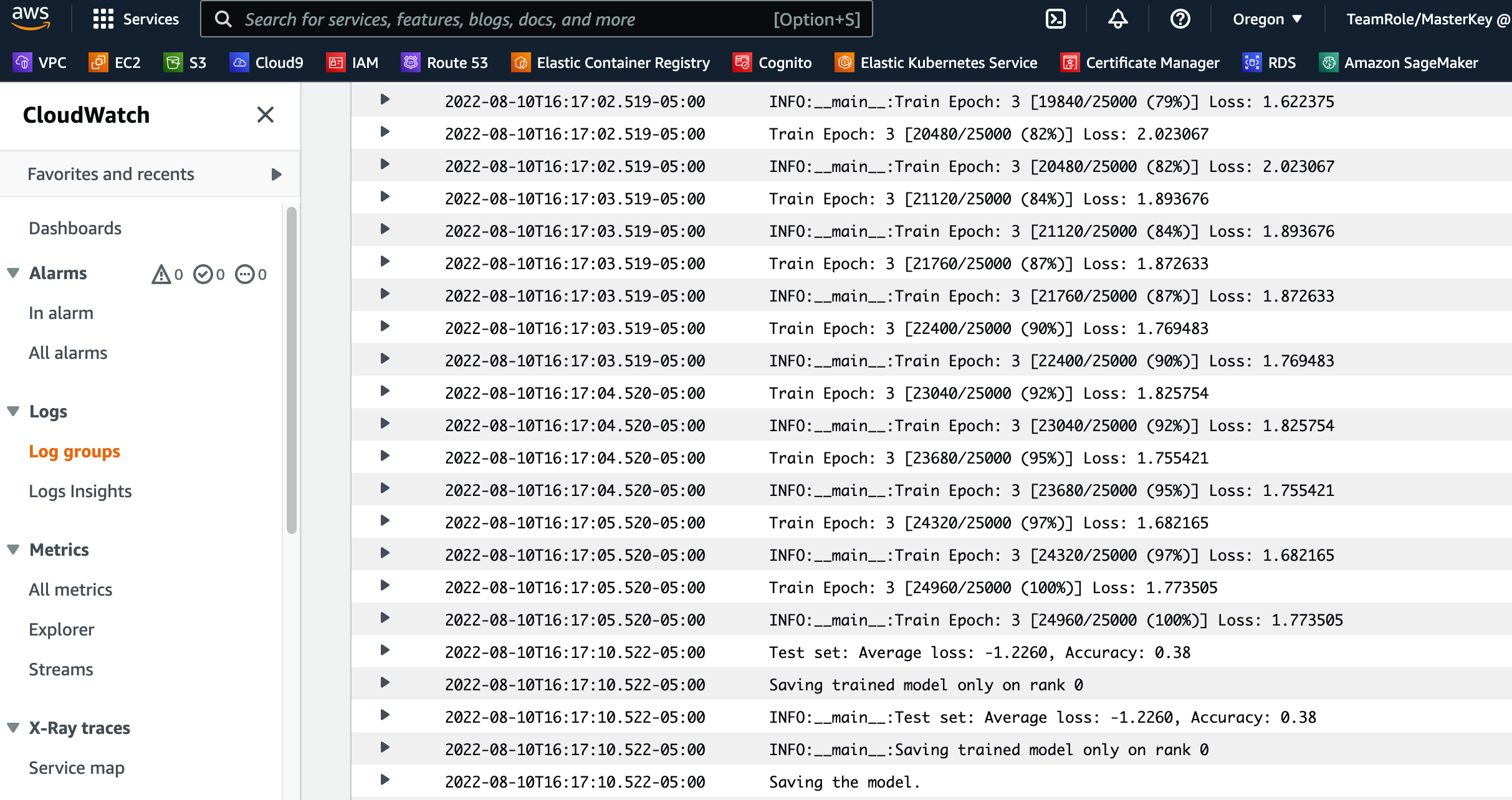

Følgende skærmbillede viser CloudWatch-logfilerne for hver af de to ml.p3.2xlarge-forekomster.

- Vælg en af grupperne for at se logfilerne.

- Fang SageMaker-slutpunktet ved at vælge Sagemaker – Implementeringsmodel trin og kopiering af

endpoint_nameoutput artefaktværdi.

Kald et SageMaker-slutpunkt

Notesbogen STEP1.1_invoke_sagemaker_endpoint.ipynb påberåber SageMaker-slutningsendepunktet oprettet i det forrige trin. Sørg for at opdatere slutpunktets navn:

Ryd op

For at rydde op i dine ressourcer skal du udføre følgende trin:

- Kør følgende kommandoer i AWS Cloud9 for at slette AWS-ressourcerne:

- Slet IAM-rolle "

sagemakerrole” ved at bruge følgende AWS CLI-kommando: - Slet SageMaker-slutpunktet ved hjælp af følgende AWS CLI-kommando:

Resumé

I dette indlæg fremhævede vi den værdi, som Kubeflow på AWS 1.6.1 giver gennem native AWS-administrerede serviceintegrationer for at imødekomme behovet for AI- og ML-brugscases på virksomhedsniveau. Du kan vælge mellem flere implementeringsmuligheder for at installere Kubeflow på AWS med forskellige serviceintegrationer ved hjælp af Terraform, Kustomize eller Helm. Use casen i dette indlæg demonstrerede en Kubeflow-integration med SageMaker, der bruger en SageMaker-administreret træningsklynge til at køre distribueret træning til en billedklassificeringsmodel og SageMaker-slutpunkt til modelimplementering.

Vi har også stillet en eksempel på pipeline der bruger de nyeste SageMaker-komponenter; du kan køre dette direkte fra Kubeflow-dashboardet. Denne pipeline kræver Amazon S3 data , SageMaker udførelse IAM rolle som de nødvendige inputs.

For at komme i gang med Kubeflow på AWS, se de tilgængelige AWS-integrerede implementeringsmuligheder i Kubeflow på AWS. Du kan følge AWS Labs repository at spore alle AWS-bidrag til Kubeflow. Du kan også finde os på Kubeflow #AWS Slack Channel; din feedback der vil hjælpe os med at prioritere de næste funktioner, der skal bidrage til Kubeflow-projektet.

Om forfatterne

Kanwaljit Khurmi er Senior Solutions Architect hos Amazon Web Services. Han arbejder sammen med AWS-kunderne for at yde vejledning og teknisk assistance, der hjælper dem med at forbedre værdien af deres løsninger, når de bruger AWS. Kanwaljit har specialiseret sig i at hjælpe kunder med container- og maskinlæringsapplikationer.

Kanwaljit Khurmi er Senior Solutions Architect hos Amazon Web Services. Han arbejder sammen med AWS-kunderne for at yde vejledning og teknisk assistance, der hjælper dem med at forbedre værdien af deres løsninger, når de bruger AWS. Kanwaljit har specialiseret sig i at hjælpe kunder med container- og maskinlæringsapplikationer.

Kartik Kalamadi er softwareudviklingsingeniør hos Amazon AI. I øjeblikket fokuseret på Machine Learning Kubernetes open source-projekter såsom Kubeflow og AWS SageMaker Controller til k8s. I min fritid kan jeg godt lide at spille pc-spil og fifle med VR ved hjælp af Unity-motoren.

Kartik Kalamadi er softwareudviklingsingeniør hos Amazon AI. I øjeblikket fokuseret på Machine Learning Kubernetes open source-projekter såsom Kubeflow og AWS SageMaker Controller til k8s. I min fritid kan jeg godt lide at spille pc-spil og fifle med VR ved hjælp af Unity-motoren.

Rahul Kharse er softwareudviklingsingeniør hos Amazon Web Services. Hans arbejde fokuserer på at integrere AWS-tjenester med open source containeriserede ML Ops-platforme for at forbedre deres skalerbarhed, pålidelighed og sikkerhed. Udover at fokusere på kundernes ønsker om funktioner, nyder Rahul også at eksperimentere med den nyeste teknologiske udvikling på området.

Rahul Kharse er softwareudviklingsingeniør hos Amazon Web Services. Hans arbejde fokuserer på at integrere AWS-tjenester med open source containeriserede ML Ops-platforme for at forbedre deres skalerbarhed, pålidelighed og sikkerhed. Udover at fokusere på kundernes ønsker om funktioner, nyder Rahul også at eksperimentere med den nyeste teknologiske udvikling på området.

- Avanceret (300)

- AI

- ai kunst

- ai kunst generator

- en robot

- Amazon SageMaker

- kunstig intelligens

- certificering af kunstig intelligens

- kunstig intelligens i banksektoren

- kunstig intelligens robot

- kunstig intelligens robotter

- software til kunstig intelligens

- AWS maskinindlæring

- blockchain

- blockchain konference ai

- coingenius

- samtale kunstig intelligens

- kryptokonference ai

- dalls

- dyb læring

- du har google

- KubeFlow

- machine learning

- plato

- platon ai

- Platon Data Intelligence

- Platon spil

- PlatoData

- platogaming

- skala ai

- syntaks

- zephyrnet