- Maj 12, 2014

- Vasilis Vryniotis

- . 4 kommentarer

Dette blogindlæg er anden del af en artikelserie om Dirichlet-procesblandingsmodeller. I den forrige artikel havde vi en oversigt over flere klyngeanalyseteknikker og vi diskuterede nogle af de problemer/begrænsninger, der opstår ved at bruge dem. Desuden præsenterede vi kort Dirichlet-procesblandingsmodellerne, vi talte om, hvorfor de er nyttige, og vi præsenterede nogle af deres anvendelser.

Opdatering: Datumbox Machine Learning Framework er nu open source og gratis til downloade. Tjek pakken com.datumbox.framework.machinelearning.clustering for at se implementeringen af Dirichlet Process Mixture Models i Java.

Dirichlet-procesblandingsmodellerne kan være lidt svære at sluge i begyndelsen, primært fordi de er uendelige blandingsmodeller med mange forskellige repræsentationer. Heldigvis er en god måde at nærme sig emnet på ved at tage udgangspunkt i de endelige blandingsmodeller med Dirichlet-fordeling og derefter gå videre til de uendelige.

Derfor vil jeg i denne artikel kort præsentere nogle vigtige distributioner, som vi har brug for, vi vil bruge dem til at konstruere Dirichlet Prior med Multinomial Likelihood-modellen, og derefter vil vi gå til Finite Mixture Model baseret på Dirichlet-fordelingen.

1. Beta distribution

Beta distribution er en familie af kontinuerte fordelinger, som er defineret i intervallet [0,1]. Den er parametriseret af to positive parametre a og b, og dens form afhænger i høj grad af valget af disse to parametre.

Figur 1: Betafordeling for forskellige a, b parametre

Beta-fordelingen bruges almindeligvis til at modellere en fordeling over sandsynligheder og har følgende sandsynlighedstæthed:

![]()

Ligning 1: Beta PDF

Hvor Γ(x) er gammafunktionen og a, b fordelingens parametre. Beta bruges almindeligvis som en fordeling af sandsynlighedsværdier og giver os sandsynligheden for, at den modellerede sandsynlighed er lig med en bestemt værdi P = p0. Ifølge sin definition er Beta-distribution i stand til at modellere sandsynligheden for binære udfald, som tager værdier sande eller falske. Parametrene a og b kan betragtes som pseudotællingerne for henholdsvis succes og fiasko. Betadistributionen modellerer således sandsynligheden for succes givet a succeser og b fiaskoer.

2. Dirichlet Fordeling

Dirichlet Distribution er generaliseringen af betadistribution for flere udfald (eller med andre ord bruges den til begivenheder med flere udfald). Den er parametriseret med k parametre ai hvilket skal være positivt. Dirichlet Distribution er lig med Beta Distribution, når antallet af variable k = 2.

Figur 2: Dirichlet Fordeling for forskellige eni parametre

Dirichlet-fordelingen bruges almindeligvis til at modellere en fordeling over sandsynligheder og har følgende sandsynlighedstæthed:

![]()

Ligning 2: Dirichlet PDF

Hvor Γ(x) er gammafunktionen, er pi tage værdier i [0,1] og Σpi=1. Dirichlet-fordelingen modellerer den fælles fordeling af si og giver sandsynligheden for P1=p1,P2=p2,….,Pk-1=pk-1 med Pk=1 – ΣPi. Som i tilfældet med Beta, er eni parametre kan betragtes som pseudotællinger af forekomsterne af hver i-begivenhed. Dirichlet-fordelingen bruges til at modellere sandsynligheden for, at k rivaliserende begivenheder indtræffer og betegnes ofte som Dirichlet(a).

3. Dirichlet Prior med Multinomial Sandsynlighed

Som tidligere nævnt kan Dirichlet-fordelingen ses som en fordeling over sandsynlighedsfordelinger. I tilfælde, hvor vi ønsker at modellere sandsynligheden for, at k begivenheder indtræffer, ville en Bayesiansk tilgang være at bruge Multinomial Likelihood og Dirichlet Priors .

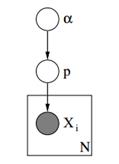

Nedenfor kan vi se den grafiske model af en sådan model.

Figur 3: Grafisk model af Dirichlet Priors med multinomial sandsynlighed

I ovenstående grafiske model er α ak dimensional vektor med hyperparametrene af Dirichlet priors, p er ak dimensional vektor med sandsynlighedsværdierne og xi er en skalarværdi fra 1 til k, som fortæller os, hvilken hændelse der har fundet sted. Endelig skal vi bemærke, at P følger Dirichlet-fordelingen parametriseret med vektor α og dermed P ~ Dirichlet(α), mens xi variabler følger den diskrete fordeling (multinomial) parametriseret med p-vektoren af sandsynligheder. Lignende hierarkiske modeller kan bruges i dokumentklassificering til at repræsentere fordelingen af nøgleordsfrekvenser for i forskellige emner.

4. Endelig blandingsmodel med Dirichlet-fordeling

Ved at bruge Dirichlet Distribution kan vi konstruere en Endelig blandingsmodel som kan bruges til at udføre clustering. Lad os antage, at vi har følgende model:

![]()

![]()

![]()

![]()

Ligning 3: Finit blandingsmodel med Dirichlet-fordeling

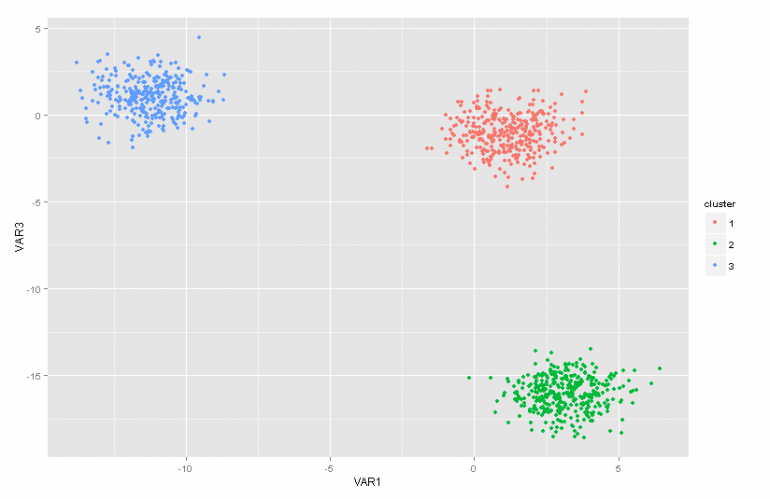

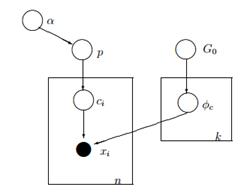

Ovenstående model forudsætter følgende: Vi har et datasæt X med n observationer, og vi ønsker at udføre klyngeanalyse på det. K er et konstant endeligt tal, som viser antallet af klynger/komponenter, som vi vil bruge. ci variabler lagrer klyngetildelingen af observation Xi, tager de værdier fra 1 til k og følger den diskrete fordeling med parameter p, som er blandingssandsynligheden for komponenterne. F er den generative fordeling af vores X, og den er parametriseret med en parameter ![]() som afhænger af klyngetildelingen af hver observation. I alt har vi k unikke

som afhænger af klyngetildelingen af hver observation. I alt har vi k unikke ![]() parametre svarende til antallet af vores klynger. Det

parametre svarende til antallet af vores klynger. Det ![]() variabel gemmer parametrene, der parametrerer den generative F-fordeling, og vi antager, at den følger en base G0 fordeling. P-variablen gemmer blandingsprocenterne for hver af k-klyngerne og følger Dirichlet med parametre α/k. Endelig er α en dimensionel vektor med hyperparametrene (pseudotællinger) af Dirichlet-fordelingen [2].

variabel gemmer parametrene, der parametrerer den generative F-fordeling, og vi antager, at den følger en base G0 fordeling. P-variablen gemmer blandingsprocenterne for hver af k-klyngerne og følger Dirichlet med parametre α/k. Endelig er α en dimensionel vektor med hyperparametrene (pseudotællinger) af Dirichlet-fordelingen [2].

Figur 4: Grafisk model af finit blandingsmodel med Dirichlet-fordeling

En enklere og mindre matematisk måde at forklare modellen på er følgende. Vi antager, at vores data kan grupperes i k klynger. Hver klynge har sine egne parametre ![]() og disse parametre bruges til at generere vores data. Parametrene

og disse parametre bruges til at generere vores data. Parametrene ![]() antages at følge en vis fordeling G0. Hver observation er repræsenteret med en vektor xi og aci værdi, som angiver den klynge, den tilhører. Følgelig er ci kan ses som en variabel, der følger efter den diskrete fordeling med en parameter p, som ikke er andet end blandingssandsynlighederne, altså sandsynligheden for forekomsten af hver klynge. Da vi håndterer vores problem på en Bayesiansk måde, behandler vi ikke parameteren p som en konstant ukendt vektor. I stedet antager vi, at P'en følger Dirichlet, som er parametriseret af hyperparametrene α/k.

antages at følge en vis fordeling G0. Hver observation er repræsenteret med en vektor xi og aci værdi, som angiver den klynge, den tilhører. Følgelig er ci kan ses som en variabel, der følger efter den diskrete fordeling med en parameter p, som ikke er andet end blandingssandsynlighederne, altså sandsynligheden for forekomsten af hver klynge. Da vi håndterer vores problem på en Bayesiansk måde, behandler vi ikke parameteren p som en konstant ukendt vektor. I stedet antager vi, at P'en følger Dirichlet, som er parametriseret af hyperparametrene α/k.

5. Arbejde med uendelige k klynger

Den tidligere blandingsmodel giver os mulighed for at udføre uovervåget læring, følger en Bayesiansk tilgang og kan udvides til at have en hierarkisk struktur. Ikke desto mindre er det en endelig model, fordi den bruger et konstant foruddefineret k-antal af klynger. Som et resultat kræver det, at vi definerer antallet af komponenter, før vi udfører Cluster Analysis, og som vi diskuterede tidligere i de fleste applikationer, er dette ukendt og kan ikke let estimeres.

En måde at løse dette på er at forestille sig, at k har en meget stor værdi, som har en tendens til uendelig. Med andre ord kan vi forestille os grænsen for denne model, når k har en tendens til det uendelige. Hvis dette er tilfældet, så kan vi se, at på trods af at antallet af klynger k er uendeligt, kan det faktiske antal klynger, der er aktive (dem, der har mindst én observation), ikke være større end n (hvilket er det samlede antal observationer i vores datasæt). Faktisk, som vi vil se senere, vil antallet af aktive klynger være væsentligt mindre end n, og de vil være proportionale med ![]() .

.

Selvfølgelig er det ikke-trivielt at tage grænsen for k til det uendelige. Flere spørgsmål rejser sig såsom om det er muligt at tage sådan en grænse, hvordan ville denne model se ud og hvordan kan vi konstruere og bruge sådan en model.

I den næste artikel vil vi fokusere på præcis disse spørgsmål: vi vil definere Dirichlet-processen, vi vil præsentere de forskellige repræsentationer af DP og til sidst vil vi fokusere på den kinesiske restaurantproces, som er en intuitiv og effektiv måde at konstruere en Dirichlet-proces på.

Jeg håber du fandt dette indlæg nyttigt. Hvis du gjorde det, så brug et øjeblik på at dele artiklen på Facebook og Twitter. 🙂

- AI

- ai kunst

- ai kunst generator

- en robot

- kunstig intelligens

- certificering af kunstig intelligens

- kunstig intelligens robot

- kunstig intelligens robotter

- software til kunstig intelligens

- blockchain

- blockchain konference ai

- coingenius

- samtale kunstig intelligens

- kryptokonference ai

- dalls

- Datumboks

- dyb læring

- du har google

- machine learning

- Maskinlæring og statistik

- plato

- platon ai

- Platon Data Intelligence

- Platon spil

- PlatoData

- platogaming

- skala ai

- syntaks

- zephyrnet