Dette indlæg er skrevet af Jyoti Sharma og Sharmo Sarkar fra Vericast.

For ethvert maskinlæringsproblem (ML) begynder dataforskeren med at arbejde med data. Dette omfatter indsamling, udforskning og forståelse af de forretningsmæssige og tekniske aspekter af dataene, sammen med evaluering af eventuelle manipulationer, der kan være nødvendige for modelopbygningsprocessen. Et aspekt af denne dataforberedelse er feature engineering.

Funktionsteknik refererer til processen, hvor relevante variabler identificeres, udvælges og manipuleres for at transformere rådataene til mere nyttige og brugbare former til brug med ML-algoritmen, der bruges til at træne en model og udføre slutninger mod den. Målet med denne proces er at øge ydeevnen af algoritmen og den resulterende prædiktive model. Funktionsudviklingsprocessen omfatter flere faser, herunder funktionsoprettelse, datatransformation, funktionsudtrækning og funktionsvalg.

Opbygning af en platform for generaliseret funktionskonstruktion er en almindelig opgave for kunder, der har behov for at producere mange ML-modeller med forskellige datasæt. Denne form for platform inkluderer oprettelsen af en programmatisk drevet proces til at producere færdiggjorte, funktionsudviklede data klar til modeltræning med lidt menneskelig indgriben. Alligevel er det en udfordring at generalisere feature engineering. Hvert forretningsproblem er forskelligt, hvert datasæt er forskelligt, datamængder varierer voldsomt fra klient til klient, og datakvalitet og ofte kardinalitet af en bestemt kolonne (i tilfælde af strukturerede data) kan spille en væsentlig rolle i kompleksiteten af funktionsteknologien behandle. Ydermere kan den dynamiske karakter af en kundes data også resultere i en stor variation af den behandlingstid og de ressourcer, der kræves for at fuldføre funktionsudviklingen optimalt.

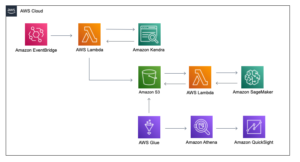

AWS kunde Vericast er en markedsføringsløsningsvirksomhed, der træffer datadrevne beslutninger for at øge marketing ROI'er for sine kunder. Vericasts interne cloud-baserede Machine Learning Platform, bygget op omkring CRISP-ML(Q)-processen, bruger forskellige AWS-tjenester, bl.a. Amazon SageMaker, Amazon SageMaker-behandling, AWS Lambdaog AWS-trinfunktioner, for at producere de bedst mulige modeller, der er skræddersyet til den specifikke kundes data. Denne platform har til formål at indfange gentageligheden af de trin, der indgår i opbygningen af forskellige ML-workflows og samle dem i standardgenererbare workflow-moduler inden for platformen.

I dette indlæg deler vi, hvordan Vericast optimerede feature engineering ved hjælp af SageMaker Processing.

Løsningsoversigt

Vericasts Machine Learning Platform hjælper med en hurtigere implementering af nye forretningsmodeller baseret på eksisterende arbejdsgange eller hurtigere aktivering af eksisterende modeller for nye kunder. For eksempel er en model, der forudsiger direct mail-tilbøjelighed, meget anderledes end en model, der forudsiger rabatkuponfølsomheden for kunderne i en Vericast-klient. De løser forskellige forretningsproblemer og har derfor forskellige brugsscenarier i et marketingkampagnedesign. Men fra et ML-synspunkt kan begge opfattes som binære klassifikationsmodeller og kan derfor dele mange fælles trin fra et ML-workflow-perspektiv, herunder modeljustering og træning, evaluering, fortolkning, implementering og inferens.

Fordi disse modeller er binære klassifikationsproblemer (i ML-termer), adskiller vi en virksomheds kunder i to klasser (binære): dem, der ville reagere positivt på kampagnen, og dem, der ikke ville. Desuden betragtes disse eksempler som en ubalanceret klassifikation, fordi de data, der blev brugt til at træne modellen, ikke ville indeholde et lige så stort antal kunder, som ville og ikke ville reagere positivt.

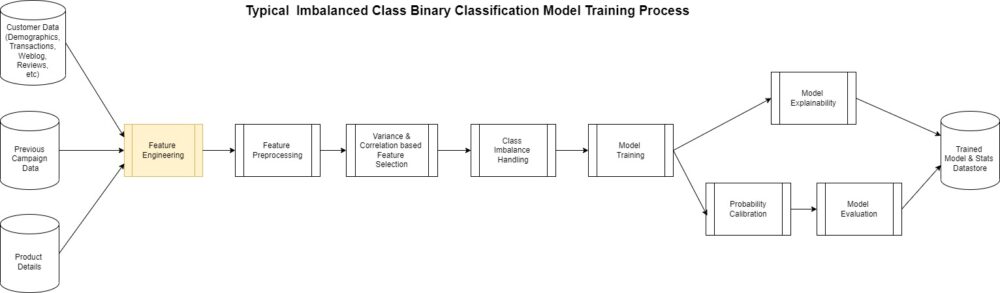

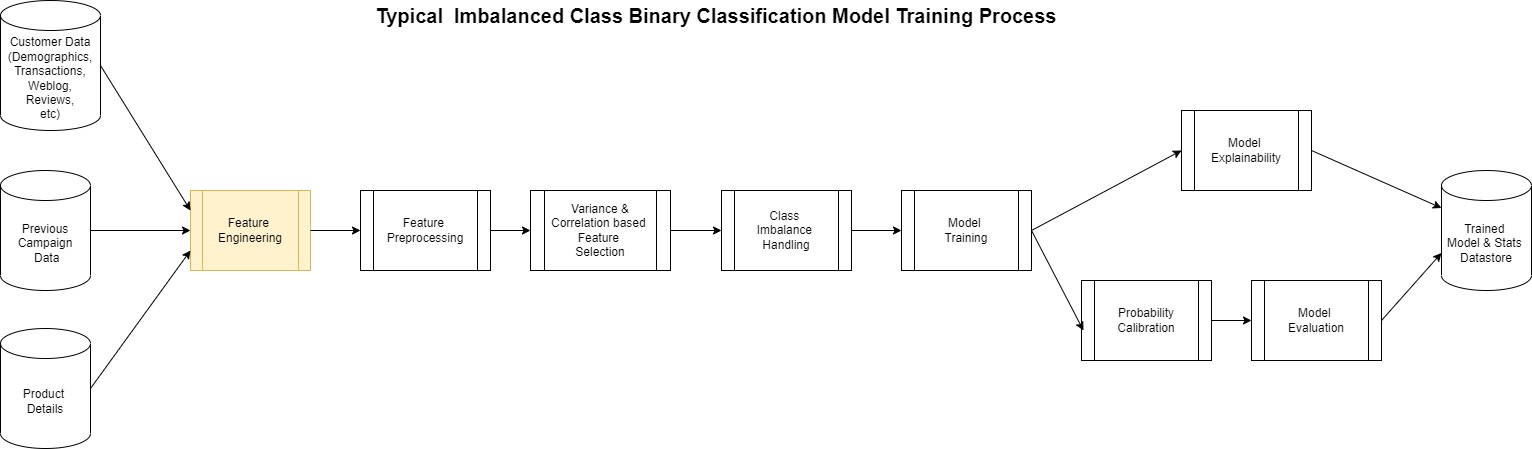

Selve skabelsen af en model som denne følger det generaliserede mønster vist i det følgende diagram.

Det meste af denne proces er den samme for enhver binær klassifikation undtagen funktionsingeniørtrinnet. Dette er måske det mest komplicerede, men til tider oversete trin i processen. ML-modeller er i høj grad afhængige af de funktioner, der bruges til at skabe den.

Vericasts cloud-native Machine Learning Platform har til formål at generalisere og automatisere funktionsudviklingstrinene for forskellige ML-arbejdsgange og optimere deres ydeevne på en omkostning vs. tid-metrik ved at bruge følgende funktioner:

- Platformens funktionsingeniørbibliotek – Dette består af et stadigt udviklende sæt af transformationer, der er blevet testet for at give højkvalitets generaliserbare funktioner baseret på specifikke klientkoncepter (f.eks. kundedemografi, produktdetaljer, transaktionsdetaljer og så videre).

- Intelligente ressourceoptimering – Platformen bruger AWS's on-demand infrastrukturkapacitet til at spinne den mest optimale type behandlingsressourcer op til det særlige funktionsingeniørjob baseret på den forventede kompleksitet af trinnet og mængden af data, det skal bruge.

- Dynamisk skalering af funktionsingeniørjob – En kombination af forskellige AWS-tjenester bruges til dette, men især SageMaker Processing. Dette sikrer, at platformen producerer funktioner af høj kvalitet på en omkostningseffektiv og rettidig måde.

Dette indlæg er fokuseret omkring det tredje punkt på denne liste og viser, hvordan man opnår dynamisk skalering af SageMaker Processing-job for at opnå en mere styret, effektiv og omkostningseffektiv databehandlingsramme for store datamængder.

SageMaker Processing muliggør arbejdsbelastninger, der kører trin til dataforbehandling eller efterbehandling, funktionsudvikling, datavalidering og modelevaluering på SageMaker. Det giver også et administreret miljø og fjerner kompleksiteten af udifferentierede tunge løft, der kræves for at opsætte og vedligeholde den nødvendige infrastruktur til at køre arbejdsbelastningerne. SageMaker Processing giver desuden en API-grænseflade til at køre, overvåge og evaluere arbejdsbyrden.

Kørsel af SageMaker Behandlingsjob foregår fuldt ud i en administreret SageMaker-klynge, med individuelle job placeret i instansbeholdere under kørsel. Den administrerede klynge, forekomster og containere rapporterer metrics til amazoncloudwatch, herunder brug af GPU, CPU, hukommelse, GPU-hukommelse, diskmetrics og hændelseslogning.

Disse funktioner giver fordele til Vericasts dataingeniører og videnskabsmænd ved at hjælpe med udviklingen af generaliserede forbehandlingsarbejdsgange og abstrahere vanskeligheden ved at vedligeholde genererede miljøer til at køre dem i. Der kan dog opstå tekniske problemer på grund af dataens dynamiske karakter og de forskellige funktioner, der kan indføjes i en sådan generel løsning. Systemet skal foretage et kvalificeret indledende gæt om størrelsen af klyngen og instanser, der udgør den. Dette gæt skal evaluere kriterierne for dataene og udlede CPU-, hukommelses- og diskkravene. Dette gæt kan være helt passende og udføre tilstrækkeligt til jobbet, men i andre tilfælde er det måske ikke. For et givet datasæt og forbehandlingsjob kan CPU'en være underdimensioneret, hvilket resulterer i maksimal behandlingsydelse og lang tid at fuldføre. Endnu værre kan hukommelsen blive et problem, hvilket resulterer i enten dårlig ydeevne eller hændelser, der mangler hukommelse, hvilket får hele jobbet til at mislykkes.

Med disse tekniske forhindringer i tankerne satte Vericast sig for at skabe en løsning. De skulle forblive generelle og passe ind i det større billede af forbehandlingsarbejdsgangen, der var fleksibel i de involverede trin. Det var også vigtigt at løse både det potentielle behov for at opskalere miljøet i tilfælde, hvor ydeevnen blev kompromitteret, og at komme sig elegant efter en sådan hændelse, eller når et job blev afsluttet for tidligt af en eller anden grund.

Løsningen bygget af Vericast til at løse dette problem bruger flere AWS-tjenester, der arbejder sammen for at nå deres forretningsmål. Det blev designet til at genstarte og opskalere SageMaker Processing-klyngen baseret på præstationsmålinger observeret ved hjælp af Lambda-funktioner, der overvåger jobs. For ikke at miste arbejde, når en skaleringshændelse finder sted, eller for at komme sig efter et job, der uventet stopper, blev der etableret en checkpoint-baseret service, der bruger Amazon DynamoDB og gemmer de delvist behandlede data i Amazon Simple Storage Service (Amazon S3) spande som trin fuldført. Det endelige resultat er en automatisk skalering, robust og dynamisk overvåget løsning.

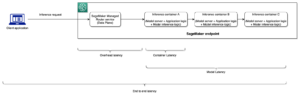

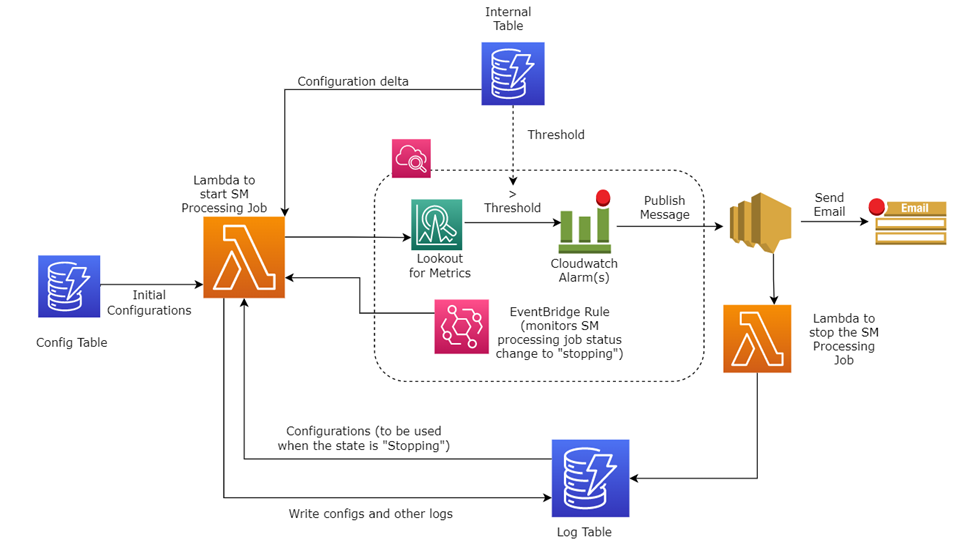

Følgende diagram viser et overblik over, hvordan systemet fungerer på højt niveau.

I de følgende afsnit diskuterer vi løsningskomponenterne mere detaljeret.

Initialisering af løsningen

Systemet forudsætter, at en separat proces sætter løsningen i gang. Omvendt er dette design ikke designet til at fungere alene, fordi det ikke vil give nogen artefakter eller output, men snarere fungerer som en sidevognsimplementering til et af de systemer, der bruger SageMaker Processing-job. I Vericasts tilfælde initieres løsningen ved et opkald fra et Step Functions-trin startet i et andet modul i det større system.

Når først løsningen er startet, og en første kørsel er udløst, læses en basisstandardkonfiguration fra en DynamoDB-tabel. Denne konfiguration bruges til at indstille parametre for SageMaker Processing-jobbet og har de indledende antagelser om infrastrukturbehov. SageMaker Processing-jobbet er nu startet.

Overvågning af metadata og output

Når jobbet starter, skriver en Lambda-funktion jobbehandlingsmetadataene (den aktuelle jobkonfiguration og andre logoplysninger) ind i DynamoDB-logtabellen. Disse metadata og logoplysninger vedligeholder en historik over jobbet, dets indledende og igangværende konfiguration og andre vigtige data.

På visse punkter, når trinene er afsluttet i jobbet, tilføjes kontrolpunktdata til DynamoDB-logtabellen. Bearbejdede outputdata flyttes til Amazon S3 for hurtig gendannelse, hvis det er nødvendigt.

Denne Lambda-funktion opsætter også en Amazon Eventbridge regel, der overvåger det kørende job for dets tilstand. Specifikt overvåger denne regel jobbet for at observere, om jobstatus ændres til stopping eller er i en stopped stat. Denne EventBridge-regel spiller en vigtig rolle ved genstart af et job, hvis der er en fejl, eller der opstår en planlagt automatisk skaleringshændelse.

Overvågning af CloudWatch-metrics

Lambda-funktionen indstiller også en CloudWatch-alarm baseret på et metrisk matematisk udtryk på behandlingsjobbet, som overvåger metrikken for alle instanserne for CPU-udnyttelse, hukommelsesudnyttelse og diskudnyttelse. Denne type alarm (metrik) bruger CloudWatch-alarmtærskler. Alarmen genererer hændelser baseret på værdien af metrikken eller udtrykket i forhold til tærsklerne over et antal tidsperioder.

I Vericasts brugstilfælde er tærskeludtrykket designet til at betragte driver- og eksekverforekomsterne som separate, med målinger, der overvåges individuelt for hver. Ved at have dem adskilt, ved Vericast, hvad der forårsager alarmen. Dette er vigtigt for at beslutte, hvordan man skalerer i overensstemmelse hermed:

- Hvis eksekveringsmålingerne passerer tærsklen, er det godt at skalere vandret

- Hvis driver-metrikken krydser tærsklen, hjælper det sandsynligvis ikke at skalere vandret, så vi skal skalere lodret

Alarmmetrik udtryk

Vericast kan få adgang til følgende metrics i sin evaluering for skalering og fejl:

- CPUUtilisation – Summen af hver enkelt CPU-kernes udnyttelse

- Hukommelsesudnyttelse – Procentdelen af hukommelse, der bruges af containerne på en instans

- DiskUtilization – Procentdelen af diskplads, der bruges af containerne på en instans

- GPUUtilisation – Procentdelen af GPU-enheder, der bruges af containerne på en instans

- GPUMemoryUtilization – Procentdelen af GPU-hukommelse, der bruges af containerne på en instans

Når dette skrives, overvejer Vericast kun CPUUtilization, MemoryUtilizationog DiskUtilization. I fremtiden har de tænkt sig at overveje GPUUtilization , GPUMemoryUtilization også.

Følgende kode er et eksempel på en CloudWatch-alarm baseret på et metrisk matematisk udtryk for Vericast-automatisk skalering:

Dette udtryk illustrerer, at CloudWatch-alarmen overvejer DriverMemoryUtilization (memoryDriver), CPUUtilization (cpuDriver), DiskUtilization (diskDriver), ExecutorMemoryUtilization (memoryExec), CPUUtilization (cpuExec)og DiskUtilization (diskExec) som overvågningsmålinger. Tallet 80 i det foregående udtryk står for tærskelværdien.

Her, IF((cpuDriver) > 80, 1, 0 indebærer, at hvis driverens CPU-udnyttelse går ud over 80 %, tildeles 1 som tærskelværdien ellers 0. IF(AVG(METRICS("memoryExec")) > 80, 1, 0 antyder, at alle metrics med streng memoryExec i den tages i betragtning og der beregnes et gennemsnit af det. Hvis den gennemsnitlige hukommelsesudnyttelsesprocent går ud over 80, tildeles 1 som tærsklen ellers 0.

Den logiske operator OR bruges i udtrykket til at forene alle anvendelser i udtrykket - hvis nogen af anvendelserne når sin tærskel, udløs alarmen.

For mere information om brug af CloudWatch metriske alarmer baseret på metriske matematiske udtryk, se Oprettelse af en CloudWatch-alarm baseret på et metrisk matematisk udtryk.

CloudWatch-alarmbegrænsninger

CloudWatch begrænser antallet af målinger pr. alarm til 10. Dette kan forårsage begrænsninger, hvis du skal overveje flere målinger end dette.

For at overvinde denne begrænsning har Vericast indstillet alarmer baseret på den samlede klyngestørrelse. Der oprettes én alarm pr. tre tilfælde (for tre tilfælde vil der være én alarm, fordi det ville lægge op til ni metrics). Forudsat at førerinstansen skal betragtes separat, oprettes en anden separat alarm for førerinstansen. Derfor svarer det samlede antal alarmer, der oprettes, nogenlunde til en tredjedel af antallet af eksekvereknudepunkter og en ekstra for driverforekomsten. I hvert tilfælde er antallet af metrics pr. alarm under begrænsningen på 10 metrics.

Hvad sker der i alarmtilstand

Hvis en forudbestemt tærskel er nået, går alarmen til en alarm stat, som bruger Amazon Simple Notification Service (Amazon SNS) for at sende meddelelser. I dette tilfælde sender den en e-mail-meddelelse til alle abonnenter med detaljerne om alarmen i beskeden.

Amazon SNS bruges også som en trigger til en Lambda-funktion, der stopper det aktuelt kørende SageMaker Processing-job, fordi vi ved, at jobbet sandsynligvis vil mislykkes. Denne funktion registrerer også logfiler til logtabellen relateret til hændelsen.

EventBridge-reglen, der er oprettet ved jobstart, vil bemærke, at jobbet er gået ind i en stopping angive et par sekunder senere. Denne regel kører derefter den første Lambda-funktion igen for at genstarte jobbet.

Den dynamiske skaleringsproces

Den første Lambda-funktion efter at have kørt to eller flere gange vil vide, at et tidligere job allerede var startet og nu er stoppet. Funktionen vil gennemgå en lignende proces med at hente basiskonfigurationen fra det originale job i loggen DynamoDB-tabellen og vil også hente opdateret konfiguration fra den interne tabel. Denne opdaterede konfiguration er en ressourcedelta-konfiguration, der er indstillet baseret på skaleringstypen. Skaleringstypen bestemmes ud fra alarmmetadataene som beskrevet tidligere.

Den originale konfiguration plus ressourcedeltaen bruges, fordi en ny konfiguration og et nyt SageMaker Processing-job startes med de øgede ressourcer.

Denne proces fortsætter, indtil jobbet fuldføres med succes og kan resultere i flere genstarter efter behov, hvilket tilføjer flere ressourcer hver gang.

Vericasts resultat

Denne brugerdefinerede automatiske skaleringsløsning har været medvirkende til at gøre Vericasts Machine Learning Platform mere robust og fejltolerant. Platformen kan nu elegant håndtere arbejdsbelastninger af forskellige datamængder med minimal menneskelig indgriben.

Før implementeringen af denne løsning var estimering af ressourcekravene for alle de Spark-baserede moduler i pipelinen en af de største flaskehalse i den nye klient-onboarding-proces. Arbejdsgange ville mislykkes, hvis klientdatamængden steg, eller omkostningerne ville være uberettigede, hvis datamængden faldt i produktionen.

Med dette nye modul på plads er arbejdsflowfejl på grund af ressourcebegrænsninger blevet reduceret med næsten 80 %. De få tilbageværende fejl skyldes for det meste AWS-kontobegrænsninger og ud over den automatiske skaleringsprocessen. Vericasts største gevinst med denne løsning er den lethed, hvormed de kan integrere nye kunder og arbejdsgange. Vericast forventer at fremskynde processen med mindst 60-70 %, med data, der stadig mangler at blive indsamlet til et endeligt antal.

Selvom dette ses som en succes af Vericast, er der en omkostning, der følger med det. Baseret på karakteren af dette modul og konceptet med dynamisk skalering som helhed, har arbejdsgangene en tendens til at tage omkring 30 % længere tid (gennemsnitligt tilfælde) end en arbejdsgang med en specialjusteret klynge for hvert modul i arbejdsgangen. Vericast fortsætter med at optimere på dette område og søger at forbedre løsningen ved at inkorporere heuristik-baseret ressourceinitialisering for hvert klientmodul.

Sharmo Sarkar, Senior Manager, Machine Learning Platform hos Vericast, siger: "Når vi fortsætter med at udvide vores brug af AWS og SageMaker, ville jeg bruge et øjeblik på at fremhæve det utrolige arbejde, som vores AWS Client Services Team, dedikerede AWS Solutions Architects, udfører, og AWS Professional Services, som vi arbejder med. Deres dybe forståelse af AWS og SageMaker gjorde det muligt for os at designe en løsning, der opfyldte alle vores behov og gav os den fleksibilitet og skalerbarhed, vi havde brug for. Vi er så taknemmelige for at have et så dygtigt og vidende supportteam på vores side.”

Konklusion

I dette indlæg delte vi, hvordan SageMaker og SageMaker Processing har gjort det muligt for Vericast at bygge en administreret, effektiv og omkostningseffektiv databehandlingsramme til store datamængder. Ved at kombinere kraften og fleksibiliteten i SageMaker Processing med andre AWS-tjenester, kan de nemt overvåge den generaliserede funktionsudviklingsproces. De kan automatisk opdage potentielle problemer, der er genereret af mangel på computer, hukommelse og andre faktorer, og automatisk implementere vertikal og horisontal skalering efter behov.

SageMaker og dets værktøjer kan også hjælpe dit team med at nå deres ML-mål. For at lære mere om SageMaker Processing og hvordan det kan hjælpe med dine databehandlingsarbejdsbelastninger, se Procesdata. Hvis du lige er begyndt med ML og leder efter eksempler og vejledning, Amazon SageMaker JumpStart kan få dig i gang. JumpStart er en ML-hub, hvorfra du kan få adgang til indbyggede algoritmer med forudtrænede fundamentmodeller til at hjælpe dig med at udføre opgaver såsom artikelresumé og billedgenerering og præbyggede løsninger til at løse almindelige use cases.

Endelig, hvis dette indlæg hjælper dig eller inspirerer dig til at løse et problem, vil vi meget gerne høre om det! Del venligst dine kommentarer og feedback.

Om forfatterne

Anthony McClure er Senior Partner Solutions Architect hos AWS SaaS Factory-teamet. Anthony har også en stærk interesse i maskinlæring og kunstig intelligens i samarbejde med AWS ML/AI Technical Field Community for at hjælpe kunder med at bringe deres maskinlæringsløsninger til virkelighed.

Anthony McClure er Senior Partner Solutions Architect hos AWS SaaS Factory-teamet. Anthony har også en stærk interesse i maskinlæring og kunstig intelligens i samarbejde med AWS ML/AI Technical Field Community for at hjælpe kunder med at bringe deres maskinlæringsløsninger til virkelighed.

Jyoti Sharma er en Data Science Engineer med maskinlæringsplatformteamet hos Vericast. Hun er passioneret omkring alle aspekter af datavidenskab og fokuseret på at designe og implementere en meget skalerbar og distribueret Machine Learning-platform.

Jyoti Sharma er en Data Science Engineer med maskinlæringsplatformteamet hos Vericast. Hun er passioneret omkring alle aspekter af datavidenskab og fokuseret på at designe og implementere en meget skalerbar og distribueret Machine Learning-platform.

Sharmo Sarkar er Senior Manager hos Vericast. Han leder Cloud Machine Learning Platform og Marketing Platform ML R&D teams hos Vericast. Han har stor erfaring med Big Data Analytics, Distributed Computing og Natural Language Processing. Uden for arbejdet nyder han at køre motorcykel, vandre og cykle på bjergstier.

Sharmo Sarkar er Senior Manager hos Vericast. Han leder Cloud Machine Learning Platform og Marketing Platform ML R&D teams hos Vericast. Han har stor erfaring med Big Data Analytics, Distributed Computing og Natural Language Processing. Uden for arbejdet nyder han at køre motorcykel, vandre og cykle på bjergstier.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoAiStream. Web3 Data Intelligence. Viden forstærket. Adgang her.

- Udmøntning af fremtiden med Adryenn Ashley. Adgang her.

- Køb og sælg aktier i PRE-IPO-virksomheder med PREIPO®. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/how-vericast-optimized-feature-engineering-using-amazon-sagemaker-processing/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 10

- 100

- 15 %

- 7

- a

- Om

- adgang

- derfor

- Konto

- opnå

- Aktivering

- handlinger

- tilføje

- tilføjet

- tilføje

- Yderligere

- tilstrækkeligt

- Efter

- mod

- hjælpemidler

- målsætninger

- alarm

- algoritme

- algoritmer

- Alle

- alene

- sammen

- allerede

- også

- Amazon

- Amazon SageMaker

- beløb

- an

- analytics

- ,

- En anden

- Anthony

- enhver

- api

- passende

- arkitektur

- ER

- OMRÅDE

- omkring

- artikel

- kunstig

- kunstig intelligens

- AS

- udseende

- aspekter

- tildelt

- hjælpe

- At

- auto

- automatisere

- automatisk

- gennemsnit

- AWS

- AWS Professional Services

- bund

- baseret

- BE

- fordi

- bliver

- været

- være

- fordele

- BEDSTE

- Beyond

- Big

- Big data

- Største

- boost

- både

- Bringe

- bygge

- Bygning

- bygget

- indbygget

- virksomhed

- men

- by

- beregnet

- ringe

- Kampagne

- CAN

- Kan få

- Optagelse

- tilfælde

- tilfælde

- Årsag

- forårsager

- vis

- udfordrende

- Ændringer

- klasse

- klasser

- klassificering

- kunde

- klient onboarding

- kunder

- Cloud

- Cluster

- kode

- Kolonne

- kombination

- kombinerer

- kommer

- kommentarer

- Fælles

- samfund

- selskab

- fuldføre

- Fuldender

- kompleksitet

- kompliceret

- komponenter

- Kompromitteret

- Compute

- computing

- Konceptet

- begreber

- Konfiguration

- Overvej

- betragtes

- Overvejer

- anser

- begrænsninger

- indeholder

- Beholdere

- fortsæt

- fortsætter

- Koste

- omkostningseffektiv

- kunne

- kupon

- skabe

- oprettet

- skabelse

- kriterier

- Cross

- Nuværende

- For øjeblikket

- skik

- kunde

- Kunder

- data

- Dataanalyse

- Dataforberedelse

- databehandling

- datalogi

- dataforsker

- datastyret

- datasæt

- beslutte

- afgørelser

- dedikeret

- dyb

- Delta

- Demografi

- afhængig

- implementering

- beskrevet

- Design

- konstrueret

- designe

- detail

- detaljer

- bestemmes

- Udvikling

- forskellige

- forskellige

- Vanskelighed

- direkte

- Rabat

- diskutere

- distribueret

- distribueret computing

- drevet

- driver

- grund

- dynamisk

- dynamisk

- hver

- tidligere

- lette

- nemt

- enten

- aktiveret

- muliggør

- ingeniør

- Engineering

- Ingeniører

- sikrer

- Hele

- Miljø

- miljøer

- lige

- Ækvivalent

- evaluere

- evaluere

- evaluering

- begivenhed

- begivenheder

- eksempel

- eksempler

- Undtagen

- eksisterende

- Udvid

- forventet

- forventer

- erfaring

- Udforskning

- udtryk

- omfattende

- Omfattende oplevelse

- faktorer

- fabrik

- FAIL

- Manglende

- Feature

- Funktionalitet

- Fed

- tilbagemeldinger

- få

- felt

- endelige

- færdiggjort

- Fornavn

- passer

- Fleksibilitet

- fleksibel

- fokuserede

- efter

- følger

- Til

- formularer

- Foundation

- Framework

- fra

- fuldt ud

- funktion

- funktioner

- Endvidere

- fremtiden

- indsamling

- Generelt

- genereret

- genererer

- generation

- få

- få

- given

- Go

- mål

- Mål

- Goes

- godt

- GPU

- taknemmelig

- vejledning

- havde

- håndtere

- sker

- Have

- have

- he

- høre

- tunge

- tunge løft

- hjælpe

- hjælper

- højt niveau

- høj kvalitet

- Fremhæv

- stærkt

- historie

- Vandret

- vandret

- Hvordan

- How To

- Men

- HTML

- http

- HTTPS

- Hub

- menneskelig

- Hurdles

- i

- identificeret

- if

- illustrerer

- billede

- gennemføre

- implementering

- gennemføre

- vigtigt

- Forbedre

- in

- I andre

- omfatter

- Herunder

- inkorporering

- Forøg

- øget

- utrolige

- individuel

- Individuelt

- oplysninger

- Infrastruktur

- initial

- Indleder

- instans

- medvirkende

- Intelligens

- hensigt

- interesse

- grænseflade

- interne

- indgriben

- ind

- involverede

- spørgsmål

- spørgsmål

- IT

- ITS

- Job

- Karriere

- jpg

- lige

- Venlig

- Kend

- Mangel

- Sprog

- stor

- vid udstrækning

- større

- senere

- Leads

- LÆR

- læring

- mindst

- Bibliotek

- løft

- begrænsning

- begrænsninger

- grænser

- Liste

- lidt

- log

- logning

- logisk

- længere

- leder

- taber

- kærlighed

- maskine

- machine learning

- vedligeholde

- Vedligeholdelse

- fastholder

- lave

- maerker

- Making

- lykkedes

- leder

- manipuleret

- måde

- mange

- Marketing

- matematik

- Kan..

- Mød

- Hukommelse

- besked

- Metadata

- metrisk

- Metrics

- måske

- tankerne

- mindste

- ML

- model

- modeller

- Moduler

- Moduler

- øjeblik

- Overvåg

- overvåges

- overvågning

- skærme

- mere

- mest

- for det meste

- Bjerg

- flere

- skal

- Natural

- Natural Language Processing

- Natur

- Behov

- behov

- behøve

- behov

- Ny

- noder

- især

- Varsel..

- underretning

- meddelelser

- nu

- nummer

- målsætninger

- observere

- of

- tit

- on

- On-Demand

- Ombord

- onboarding

- ONE

- igangværende

- kun

- operatør

- optimal

- Optimer

- optimeret

- or

- original

- Andet

- vores

- ud

- Resultat

- output

- uden for

- i løbet af

- samlet

- Overvind

- oversigt

- parametre

- del

- særlig

- partner

- Passing

- lidenskabelige

- Mønster

- procentdel

- Udfør

- ydeevne

- måske

- perioder

- perspektiv

- billede

- pipeline

- Place

- planlagt

- perron

- Platforme

- plato

- Platon Data Intelligence

- PlatoData

- Leg

- spiller

- Vær venlig

- plus

- Punkt

- punkter

- fattige

- mulig

- Indlæg

- potentiale

- magt

- forudsige

- tidligere

- sandsynligvis

- Problem

- problemer

- behandle

- Behandlet

- forarbejdning

- producere

- Produkt

- produktion

- professionel

- give

- forudsat

- giver

- sætte

- kvalitet

- Hurtig

- hurtigere

- F & U

- hellere

- Raw

- nå

- Læs

- klar

- Reality

- grund

- optegnelser

- Recover

- opsving

- Reduceret

- refererer

- relaterede

- relevant

- forblive

- resterende

- indberette

- påkrævet

- Krav

- ressource

- Ressourcer

- Svar

- resultere

- resulterer

- robust

- roller

- groft

- Herske

- Kør

- kører

- SaaS

- sagemaker

- samme

- siger

- Skalerbarhed

- skalerbar

- Scale

- skalering

- Skaleringsløsning

- scenarier

- Videnskab

- Videnskabsmand

- forskere

- sekunder

- sektioner

- valgt

- valg

- send

- sender

- senior

- Følsomhed

- adskille

- adskille

- tjeneste

- Tjenester

- sæt

- sæt

- flere

- Del

- delt

- Sharma

- hun

- vist

- Shows

- side

- signifikant

- lignende

- Simpelt

- Størrelse

- So

- løsninger

- Løsninger

- SOLVE

- Space

- specifikke

- specifikt

- hastighed

- Spin

- etaper

- standard

- står

- starte

- påbegyndt

- starter

- Tilstand

- Status

- Trin

- Steps

- Stadig

- stoppet

- standsning

- stopper

- opbevaring

- forhandler

- String

- stærk

- struktureret

- abonnenter

- succes

- Succesfuld

- sådan

- support

- systemet

- Systemer

- bord

- skræddersyet

- Tag

- tager

- talentfuld

- Opgaver

- opgaver

- hold

- hold

- Teknisk

- vilkår

- end

- at

- Fremtiden

- deres

- Them

- derefter

- Der.

- derfor

- Disse

- de

- Tredje

- denne

- dem

- tre

- tærskel

- Gennem

- tid

- gange

- til

- sammen

- værktøjer

- I alt

- Tog

- Kurser

- transaktion

- overførselsdetaljer

- Transform

- Transformation

- transformationer

- udløse

- udløst

- to

- typen

- typisk

- under

- forståelse

- enheder

- indtil

- opdateret

- us

- brugbar

- Brug

- brug

- brug tilfælde

- anvendte

- ved brug af

- validering

- værdi

- forskellige

- lodret

- bind

- mængder

- vs

- ønskede

- var

- ser

- Vej..

- we

- GODT

- hvornår

- som

- WHO

- Hele

- helt

- vilje

- vinde

- med

- inden for

- Arbejde

- arbejdsgange

- arbejder

- virker

- værre

- ville

- skrivning

- endnu

- Udbytte

- Du

- Din

- zephyrnet