By Kenna Hughes-Castleberry offentliggjort 02. december 2022

Takket være teknologiske fremskridt bliver det sværere at sige, hvad der er ægte, og hvad der ikke er. Dette problem forværres med brugen af deepfake-teknologi—lyd og videoer der bruger kunstig intelligens til at erstatte individer eller deres stemmer. Mens mange deepfakes er blevet brugt med succes til underholdning (såsom hvis Nicholas Cage var i Jagten på den forsvundne skat) eller spil (såsom i FIFA atleter), er en stor procentdel af dem blevet oprettet til mere skumle grunde. Efterhånden som det bliver nemmere at skabe disse behandlede videoer, håber mange eksperter, at kvantecomputere kan hjælpe med at overvinde de potentielle trusler fra denne stigende teknologi.

Hvordan virker Deepfake-teknologi?

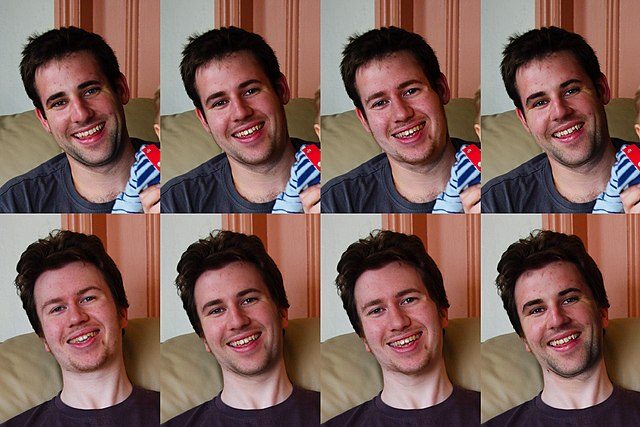

For at skabe en vellykket deepfake-video skal du bruge machine learning algoritmer. "Deep learning algoritmer lærer sig selv at løse problemer fra store datasæt og bruges derefter til at bytte ansigter på tværs af video og andet digitalt indhold," forklarede Post-kvante CEO Andersen Cheng. Post-Quantum er en førende cybersikkerhedsvirksomhed, hvis fokus er på kvantebestandig sikkerhed, herunder mod deepfakes. "Der er en række metoder til at skabe disse deepfakes," sagde Cheng, "men den mest populære er at bruge dybe neurale netværk, der involverer autoencodere. An autoindkodning er et deep learning AI-program, der studerer videoklip for at forstå, hvordan en person ser ud fra flere vinkler og det omgivende miljø, og så kortlægger det denne person på individet ved at finde fælles træk."

En deepfake-teknologi opsat (PC Wikimedia Commons)

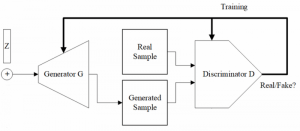

For at sikre, at autoencoderen fungerer med succes, skal flere videoklip af motivets ansigt analyseres for at give en større pulje af data. Så kan autoencoderen hjælpe med at skabe en sammensat video ved at bytte den oprindelige person med det nye emne. En anden type maskinlæring kaldet General Adversarial Network (GAN'er) vil opdage og forbedre fejl i den nye sammensatte video. Ifølge en 2022 artikel: "GAN'er træner en 'generator' til at skabe nye billeder ud fra den latente repræsentation af kildebilledet og en 'diskriminator' til at evaluere realismen af de genererede materialer." Denne proces sker flere gange, indtil diskriminatoren ikke kan se, om videoen er behandlet, og den dybe falske er fuldført.

Truslen fra Deepfake-teknologi

I øjeblikket er der mange open source-software eller gratis apps, som enkeltpersoner kan bruge til at skabe deepfakes. Selvom dette kan virke gavnligt for mange, især dem i underholdningsindustrien, har det ført til nogle alvorlige, endda kriminelle, problemer. Ifølge en Deeptrace rapport, 96 % af de deepfake-videoer online i 2019 var, ikke overraskende, pornografi. Mens mange af disse ulovlige videoer blev lavet for at hævne sig over en eks, blev andre brugt til at skabe skandaler for kvindelige berømtheder og endda politikere. I 2018 blev en deepfake-video udgivet fra en belgisk politisk parti viser daværende præsident Trump diskutere Paris-klimaaftalerne. Da falske nyheder allerede er ved at blive et problem for den brede offentlighed, kan deepfake-videoer være dråben, der knækker kamelens ryg. Også selvom dyb falsk lyd laver kaos, da en afrundet lydfil fra CEO af en teknologivirksomhed var med til at begå en bedrageri. For Cheng kan disse typer medier ret hurtigt slide offentlighedens tillid ned. "Vi har det bredere spørgsmål om samfundsmæssig tillid - hvordan vil offentligheden være i stand til at skelne mellem, hvad der er ægte, og hvad der er en dyb falsk," tilføjede Cheng. "Som vi har set, er der endda beviser for, at deepfakes bliver brugt til at omgå beskyttelsesforanstaltninger såsom biometrisk autentificering." Med disse voksende bekymringer mener Cheng og hans team hos Post-Quantum, at de har en løsning i form af Nomidio, en specialiseret ultrasikkerhedssoftware.

Forbereder sig på DeepFake-teknologitrusler

Når vi ser på de mange trusler, som kvantecomputere og deepfakes udgør, skabte Cheng og dette team Nomidio for at sikre, at login-identiteter og endda biometrisk autentificering forbliver sikre. "Nomidio er en biometrisk, adgangskodeløs multi-faktor biometrisk (MFB) tjeneste, der muliggør sikker autentificering med en enkel og intuitiv brugeroplevelse," sagde Cheng. "Det erstatter brugernavn/adgangskode-baseret login og single sign-on, hvor brugere bliver autentificeret mod deres biometriske profil med multi-factor authentication (MFA) bag kulisserne." Da Cheng har været ekspert i cybersikkerhed i mange år, sørgede han for, at Nomidio også kunne være sikker mod deepfakes. “Vores kernefilosofi, da vi lavede det, var at bruge så meget ekstra input som muligt og ægte multi-faktor-autentificering (dvs. med mere end to faktorer), så det er faktisk den ideelle løsning til at tackle enhver fremtidig udvikling inden for deepfake-teknologi. Dette skyldes i sidste ende, at traditionel MFA er utilstrækkelig, men MFB kan gøre realtidsangreb praktisk talt umulige. Det vil sige, at en kombination af for eksempel stemme, ansigt og en PIN-kode er yderst sikker ved, at enhver enkelt faktor kan være mulig at fake, men at fake alle tre i samme tilfælde er praktisk talt umuligt. Med Nomidio kan en kombination af stemme- og ansigtsbiometri, talegenkendelse, kontekstafhængige data og endda adfærdsanalyse kombineres til et enkelt autentificeringssystem. ”

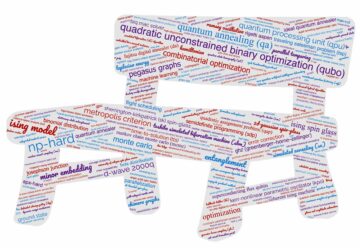

Selvom Nomidio ikke selv udnytter kvantecomputere til at overvinde deepfake trusler, kan kvantecomputere potentielt arbejde mod disse falske mediefiler. Som kvantecomputere ofte udnytter maskinlæringsalgoritmer til at arbejde hurtigere og mere effektivt, kan de muligvis opdage falske videoer eller lydfiler i en hurtigere hastighed. Mens teknologien stadig er ved at blive udviklet, og få ser på deepfakes som en potentiel use case for kvantecomputere, kan disse næste-niveau maskiner bruges i fremtiden til at gøre vores medier mere sandfærdige og nøjagtige.

Med truslerne fra deepfake-teknologi bliver mere og mere tydelige, forsøger mange regeringer og virksomheder allerede at finde måder at hjælpe med at bekæmpe det. I 2021 lancerede Facebook Deepfake Detection Challenge, med en præmie på $500,000 til dem, der skaber ny teknologi til at opdage deepfakes. I USA har stater som Californien, Texas og Virginia love, der forbyder deepfake-brug til både pornografi og politik. Det Europa-Parlamentet også etableret flere regler omkring deepfakes, og ændrede Digital Services Act for at pålægge brug af etiketter på deepfake-videoer. Selvom denne lovgivning ikke vil træde i kraft før 2024, viser den alvoren af den dybe falske teknologitrussel.

Kenna Hughes-Castleberry er medarbejderskribent hos Inside Quantum Technology og Science Communicator på JILA (et partnerskab mellem University of Colorado Boulder og NIST). Hendes skrivebeats inkluderer deep tech, metaverset og kvanteteknologi.