Internet Watch Foundation advarer om, at generativ kunstig intelligens truer med at muliggøre "generering af billeder i stor skala", som vil "overvælde dem, der arbejder for at bekæmpe seksuelt misbrug af børn online."

Kroppen er bekymret over den hurtige udvikling af generativ AI i løbet af det seneste år og forudsiger, at AI-genereret materiale om seksuelt misbrug af børn (CSAM) kun vil blive mere grafisk med tiden.

Den mest foruroligende forbrydelse

Internet Watch Foundation siger, at generative AI rummer et stort potentiale for at forbedre vores liv, men advarer om, at teknologien nemt kan vendes til ondsindede formål.

Susie Hargreaves, administrerende direktør for IWF, fortalte Guardian videre Onsdag at agenturets "værste mareridt er gået i opfyldelse."

"Tidligere i år advarede vi om, at AI-billeder snart kunne blive umulige at skelne fra rigtige billeder af børn, der lider under seksuelt misbrug, og at vi kunne begynde at se disse billeder sprede sig i meget større antal. Vi har nu passeret det punkt,” sagde Hargreaves.

Hun tilføjede: "Krygende nok ser vi kriminelle, der bevidst træner deres AI på billeder af virkelige ofre, som allerede har været udsat for misbrug. Børn, der tidligere er blevet voldtaget, bliver nu inkorporeret i nye scenarier, fordi nogen, et eller andet sted, ønsker at se det."

Omfanget af problemet skaber allerede store problemer for dem, der kæmper mod CSAM.

På en måned blev 20,254 AI-genererede billeder sendt til et mørkt web-CSAM-forum. IWF-analytikere identificerede 2,562 kriminelle pseudofotografier, skabt ved hjælp af generativ AI.

Mere end halvdelen af disse viste børn under 10 år, mens 564 blev klassificeret som kategori A-billeder - den mest alvorlige form for børnemishandlingsbilleder.

Celebrity CSAM-billeder

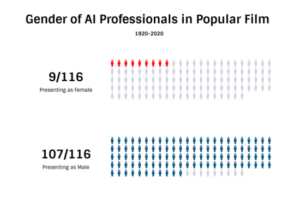

Generativ AI skaber nye kategorier af CSAM. IWF-resultater viser, at berømtheder bliver forældet og forvandlet til børn med AI-værktøjer.

De forældede berømtheder placeres derefter i misbrugsscenarier for at tilfredsstille onlinepædofile.

Børn af berømtheder er også målrettet, og "nudificerer" de unge for brugere på darknet-fora.

IWF siger, at disse billeder er stadig sværere at skelne fra ægte CSAM.

"Den mest overbevisende AI CSAM kan visuelt ikke skelnes fra ægte CSAM, selv for uddannede IWF-analytikere. Tekst-til-billede-teknologi vil kun blive bedre og udgøre flere udfordringer for IWF og de retshåndhævende myndigheder," lyder det. indberette.

Regeringens anbefalinger

IWF, som er baseret i UK, beder teknologivirksomheder fra hele verden om at sikre, at CSAM er imod deres vilkår for brugsaftaler. Den ønsker også bedre uddannelse af retshåndhævende myndigheder, så de lettere kan identificere disse typer billeder.

IWF beder også den britiske regering om at gøre AI CSAM til et stort diskussionsemne på det kommende AI-topmøde i Bletchley Park i næste måned.

Storbritannien håber at tiltrække nøglespillere fra erhvervslivet såvel som verdensledere til begivenheden. Indtil videre er den italienske premierminister Giorgia Meloni den eneste bekræftede leder af G7, der forventes at deltage.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://metanews.com/iwf-demands-action-on-pedophiles-using-generative-ai/

- :er

- 10

- 11

- 20

- a

- misbrug

- Handling

- tilføjet

- mod

- alder

- agenturer

- aftaler

- AI

- Støtte

- alarmeret

- allerede

- også

- Analytikere

- ,

- fra hinanden

- ER

- omkring

- AS

- spørge

- At

- deltage

- tiltrække

- baseret

- BE

- fordi

- bliver

- været

- være

- Bedre

- krop

- Britiske

- virksomhed

- men

- CAN

- kategorier

- Boligtype

- forårsager

- berømtheder

- udfordringer

- chef

- Administrerende direktør

- barn

- Børn

- klassificeret

- Kom

- Virksomheder

- BEKRÆFTET

- kunne

- Kursus

- oprettet

- Oprettelse af

- Criminal

- Kriminelle

- mørk

- Mørk Web

- Darknet

- krav

- svært

- diskussion

- nemt

- muliggøre

- håndhævelse

- sikre

- Endog

- begivenhed

- udøvende

- forventet

- langt

- kæmpe

- kampene

- fund

- Til

- formular

- forum

- fora

- Foundation

- fra

- generative

- Generativ AI

- få

- Regering

- Grafisk

- stor

- større

- værge

- Halvdelen

- Have

- Høj

- besidder

- håber

- HTTPS

- identificeret

- identificere

- billeder

- in

- Incorporated

- stigende

- Internet

- ind

- IT

- italiensk

- jpg

- Nøgle

- Lov

- retshåndhævelse

- leder

- ledere

- Lives

- større

- lave

- materiale

- max-bredde

- Måned

- mere

- mest

- meget

- Ny

- næste

- nu

- numre

- of

- on

- ONE

- online

- kun

- vores

- i løbet af

- Park

- Bestået

- forbi

- Billeder

- plato

- Platon Data Intelligence

- PlatoData

- spillere

- Punkt

- udgør

- indsendt

- potentiale

- forudser

- premier

- Problem

- problemer

- Progress

- formål

- hurtige

- let

- ægte

- Said

- siger

- Scale

- scenarier

- se

- se

- alvorlig

- Seksuel

- Vis

- viste

- So

- Nogen

- et eller andet sted

- snart

- starte

- lidt

- lidelse

- Summit

- målrettet

- tech

- tech virksomheder

- Teknologier

- fortælle

- vilkår

- end

- at

- verdenen

- deres

- derefter

- Disse

- de

- denne

- i år

- dem

- truer

- Dermed

- tid

- til

- fortalt

- værktøjer

- emne

- uddannet

- Kurser

- omdannet

- sand

- Drejede

- typer

- UK

- under

- kommende

- brug

- brugere

- ved brug af

- visuelt

- ønsker

- advarsel

- advarer

- Ur

- we

- web

- GODT

- var

- som

- WHO

- vilje

- med

- arbejder

- world

- år

- zephyrnet