Udbygning af en platform for maskinlæringsoperationer (MLOps) i det hastigt udviklende landskab af kunstig intelligens (AI) og maskinlæring (ML) for organisationer er afgørende for problemfrit at bygge bro mellem datavidenskabseksperimentering og implementering og samtidig opfylde kravene omkring modelydelse, sikkerhed og overholdelse.

For at opfylde regulatoriske krav og overholdelseskrav er nøglekravene ved design af en sådan platform:

- Adressedatadrift

- Overvåg modellens ydeevne

- Letter automatisk modelomskoling

- Angiv en proces for modelgodkendelse

- Opbevar modeller i et sikkert miljø

I dette indlæg viser vi, hvordan man opretter en MLOps-ramme for at imødekomme disse behov, mens vi bruger en kombination af AWS-tjenester og tredjepartsværktøjssæt. Løsningen indebærer et multimiljø-opsætning med automatiseret modeloplæring, batch-inferens og overvågning med Amazon SageMaker Model Monitor, modelversionering med SageMaker Model Registry, og en CI/CD-pipeline for at lette promovering af ML-kode og pipelines på tværs af miljøer ved at bruge Amazon SageMaker, Amazon Eventbridge, Amazon Simple Notification Service (Amazon S3), HashiCorp Terraform, GitHubog Jenkins CI/CD. Vi bygger en model til at forudsige sværhedsgraden (godartet eller ondartet) af en mammografisk masselæsion trænet med XGBoost algoritme ved hjælp af det offentligt tilgængelige UCI Mammografi Mass datasæt og implementer det ved hjælp af MLOps-rammeværket. Den fulde vejledning med kode er tilgængelig i GitHub repository.

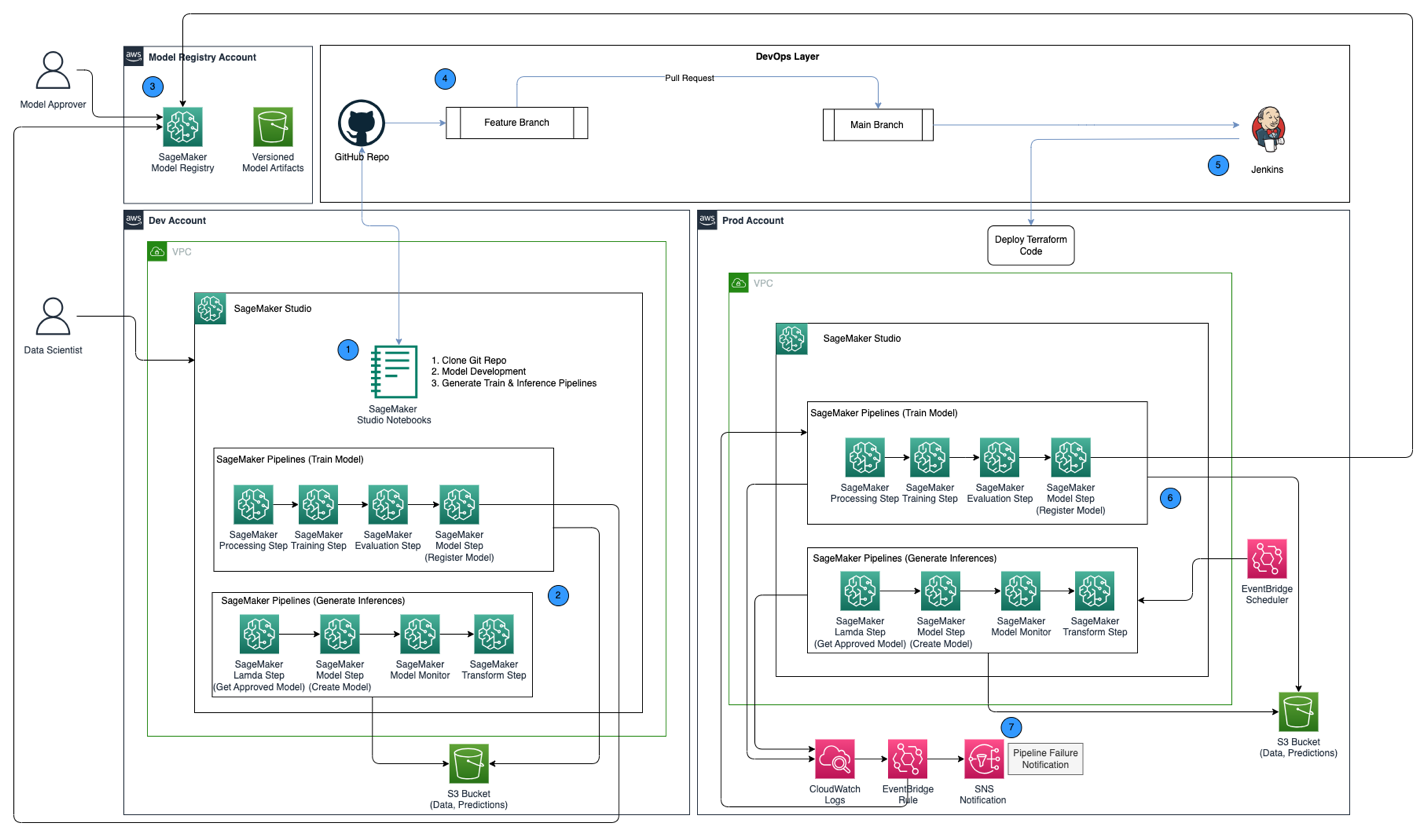

Løsningsoversigt

Følgende arkitekturdiagram viser en oversigt over MLOps-rammen med følgende nøglekomponenter:

- Multi-konto strategi – To forskellige miljøer (dev og prod) er oprettet i to forskellige AWS-konti efter AWS Well-Architected best practices, og en tredje konto er oprettet i det centrale modelregister:

- Udvikler miljø – Hvor en Amazon SageMaker Studio domæne er sat op til at tillade modeludvikling, modeltræning og test af ML-pipelines (train og inferens), før en model er klar til at blive promoveret til højere miljøer.

- Prod miljø – Hvor ML-pipelines fra dev forfremmes til som et første trin og planlægges og overvåges over tid.

- Central modelregister - Amazon SageMaker Model Registry er oprettet i en separat AWS-konto for at spore modelversioner genereret på tværs af dev- og prod-miljøer.

- CI/CD og kildekontrol – Udrulningen af ML-pipelines på tværs af miljøer håndteres via CI/CD opsætning med Jenkins, sammen med versionskontrol håndteret via GitHub. Kodeændringer flettet til det tilsvarende miljø git branch udløser en CI/CD arbejdsgang for at foretage passende ændringer til det givne målmiljø.

- Batch forudsigelser med modelovervågning – Inferensrørledningen bygget med Amazon SageMaker Pipelines kører på en planlagt basis for at generere forudsigelser sammen med modelovervågning ved hjælp af SageMaker Model Monitor til at detektere datadrift.

- Automatiseret genoptræningsmekanisme – Træningspipeline, der er bygget med SageMaker Pipelines, udløses, hver gang en datadrift detekteres i inferenspipelinen. Efter at den er trænet, registreres modellen i det centrale modelregister for at blive godkendt af en modelgodkender. Når den er godkendt, bruges den opdaterede modelversion til at generere forudsigelser gennem inferenspipelinen.

- Infrastruktur som kode – Infrastrukturen som kode (IaC), oprettet vha HashiCorp Terraform, understøtter planlægningen af inferensrørledningen med EventBridge, udløsning af togrørledningen baseret på en EventBridge-regel og sende meddelelser vha Amazon Simple Notification Service (Amazon SNS) emner.

MLOps-arbejdsgangen omfatter følgende trin:

- Få adgang til SageMaker Studio-domænet i udviklingskontoen, klon GitHub-lageret, gå gennem processen med modeludvikling ved hjælp af den leverede eksempelmodel, og generer tog- og inferenspipelines.

- Kør togpipelinen i udviklingskontoen, som genererer modelartefakter for den trænede modelversion og registrerer modellen i SageMaker Model Registry i den centrale modelregistreringskonto.

- Godkend modellen i SageMaker Model Registry i den centrale model Registry-konto.

- Skub koden (tog- og inferensrørledninger og Terraform IaC-koden for at oprette EventBridge-skemaet, EventBridge-reglen og SNS-emnet) ind i en funktionsgren af GitHub-lageret. Opret en pull-anmodning for at flette koden ind i hovedgrenen af GitHub-lageret.

- Udløs Jenkins CI/CD-pipeline, som er sat op med GitHub-lageret. CI/CD-pipelinen implementerer koden i prod-kontoen for at skabe tog- og inferens-pipelines sammen med Terraform-koden for at klargøre EventBridge-skemaet, EventBridge-reglen og SNS-emnet.

- Inferensrørledningen er planlagt til at køre på daglig basis, hvorimod togrørledningen er sat op til at køre, når datadrift detekteres fra inferensrørledningen.

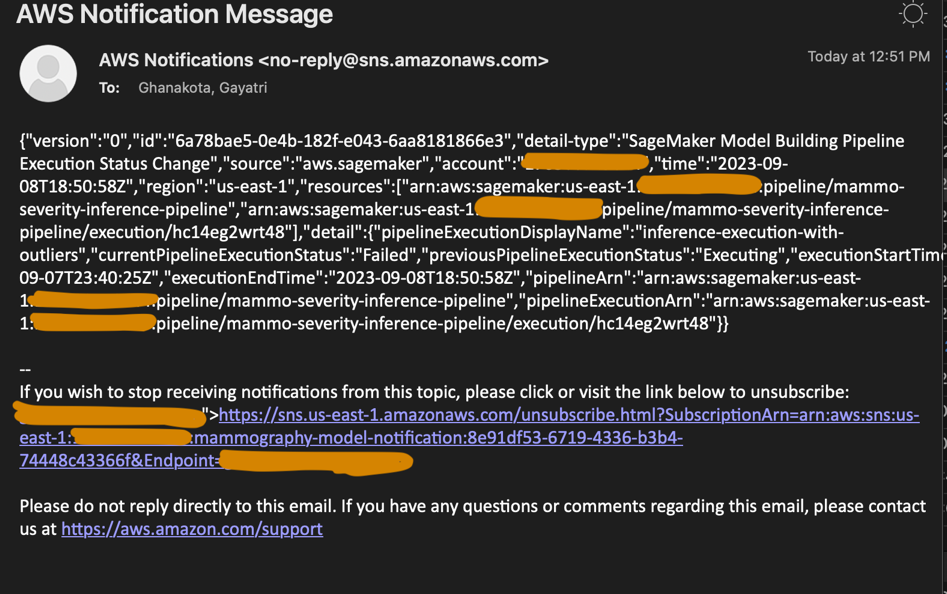

- Meddelelser sendes gennem SNS-emnet, når der er en fejl med enten toget eller inferensrørledningen.

Forudsætninger

For denne løsning skal du have følgende forudsætninger:

- Tre AWS-konti (dev-, prod- og centrale modelregistreringskonti)

- Et SageMaker Studio-domæne oprettet i hver af de tre AWS-konti (se Ombord på Amazon SageMaker Studio eller se videoen Kom hurtigt ombord til Amazon SageMaker Studio for opsætningsinstruktioner)

- Jenkins (vi bruger Jenkins 2.401.1) med administrative rettigheder installeret på AWS

- Terraform version 1.5.5 eller nyere installeret på Jenkins server

Til denne post arbejder vi i us-east-1 Region for at implementere løsningen.

Tilvejebring KMS-nøgler i udvikler- og prod-konti

Vores første skridt er at skabe AWS Key Management Service (AWS KMS) nøgler i dev- og prod-kontiene.

Opret en KMS-nøgle på udviklerkontoen og giv adgang til prodkontoen

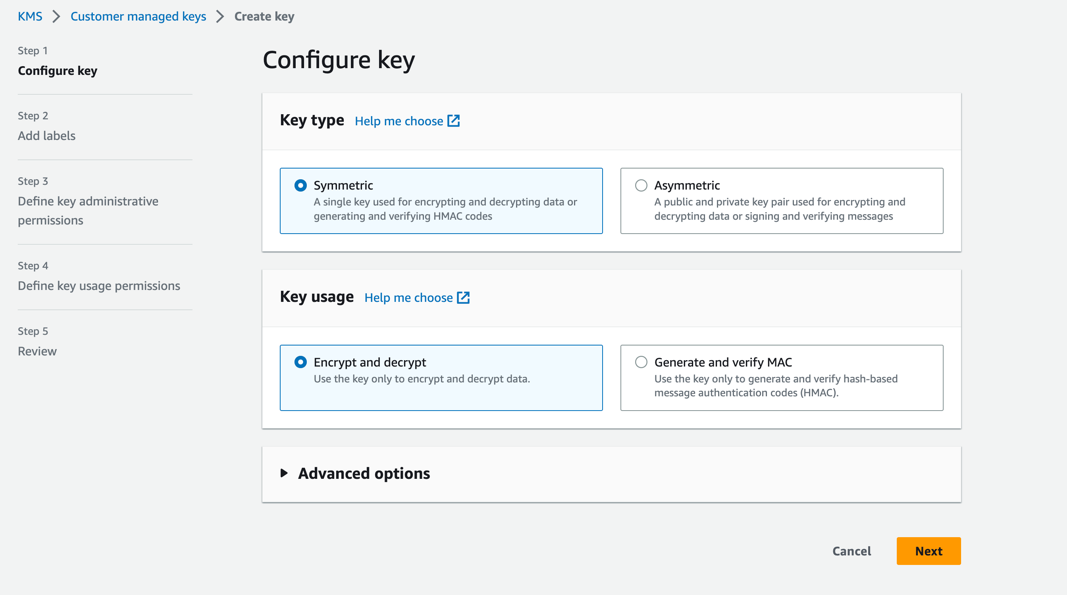

Udfør følgende trin for at oprette en KMS-nøgle på udviklerkontoen:

- På AWS KMS-konsollen skal du vælge Kundeadministrerede nøgler i navigationsruden.

- Vælg Opret nøgle.

- Til Nøgletype, Vælg Symmetrisk.

- Til Nøglebrug, Vælg Krypter og dekrypter.

- Vælg Næste.

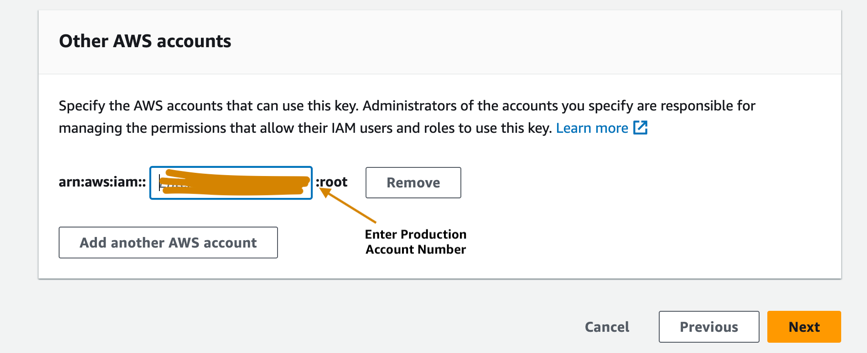

- Indtast produktionskontonummeret for at give produktionskontoen adgang til KMS-nøglen, der er klargjort i udviklerkontoen. Dette er et påkrævet trin, fordi første gang modellen trænes i udviklerkontoen, krypteres modelartefakterne med KMS-nøglen, før de skrives til S3-bøtten i den centrale modelregistreringskonto. Produktionskontoen skal have adgang til KMS-nøglen for at dekryptere modelartefakter og køre inferenspipelinen.

- Vælg Næste og færdiggør oprettelsen af din nøgle.

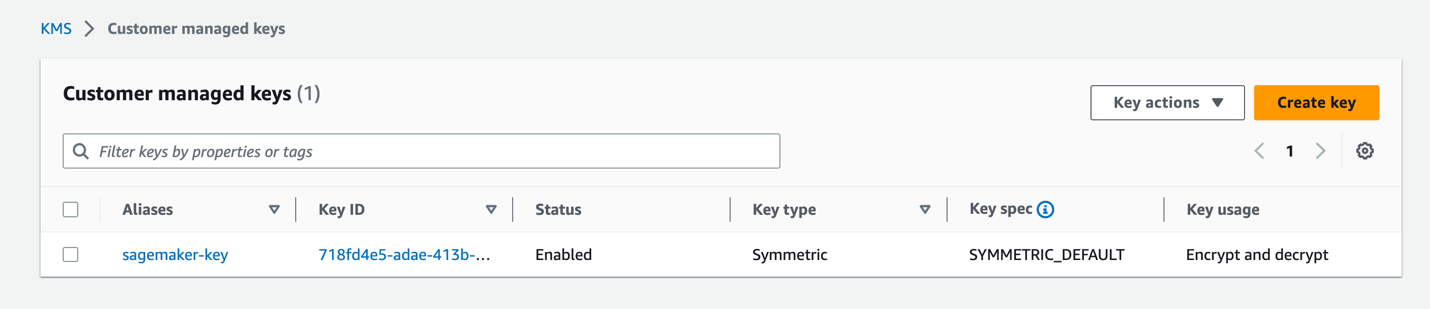

Når nøglen er klargjort, bør den være synlig på AWS KMS-konsollen.

Opret en KMS-nøgle i prod-kontoen

Gå gennem de samme trin i det foregående afsnit for at oprette en kundeadministreret KMS-nøgle i prod-kontoen. Du kan springe trinnet over for at dele KMS-nøglen med en anden konto.

Konfigurer en model artefakter S3-spand i den centrale modelregistreringskonto

Lav en S3-spand efter eget valg med snoren sagemaker i navnekonventionen som en del af buckets navn i den centrale modelregistreringskonto, og opdatere bucket-politikken på S3-bucket for at give tilladelser fra både dev- og prod-kontoen til at læse og skrive modelartefakter i S3-bucket.

Følgende kode er bucket-politikken, der skal opdateres på S3-bucket:

Konfigurer IAM-roller i dine AWS-konti

Næste trin er at konfigurere AWS identitets- og adgangsstyring (IAM) roller i dine AWS-konti med tilladelser til AWS Lambda, SageMaker og Jenkins.

Lambda-udførelsesrolle

Opsætning Lambda-udførelsesroller i dev- og prod-kontiene, som vil blive brugt af Lambda-funktionen, der køres som en del af SageMaker Pipelines Lambda-trin. Dette trin vil køre fra slutningspipelinen for at hente den seneste godkendte model, ved hjælp af hvilken slutninger genereres. Opret IAM-roller i udvikler- og prod-kontiene med navnekonventionen arn:aws:iam::<account-id>:role/lambda-sagemaker-role og vedhæft følgende IAM-politikker:

- Politik 1 – Opret en inline politik med navnet

cross-account-model-registry-access, som giver adgang til modelpakken, der er oprettet i modelregistret på den centrale konto: - Politik 2 – Vedhæft AmazonSageMakerFullAccess, som er en AWS-styret politik der giver fuld adgang til SageMaker. Det giver også udvalgt adgang til relaterede tjenester, som f.eks AWS Application Auto Scaling, Amazon S3, Amazon Elastic Container Registry (Amazon ECR), og Amazon CloudWatch-logfiler.

- Politik 3 – Vedhæft AWSLambda_Fuld adgang, som er en AWS-styret politik, der giver fuld adgang til Lambda, Lambda-konsolfunktioner og andre relaterede AWS-tjenester.

- Politik 4 – Brug følgende IAM-tillidspolitik til IAM-rollen:

SageMaker udførelsesrolle

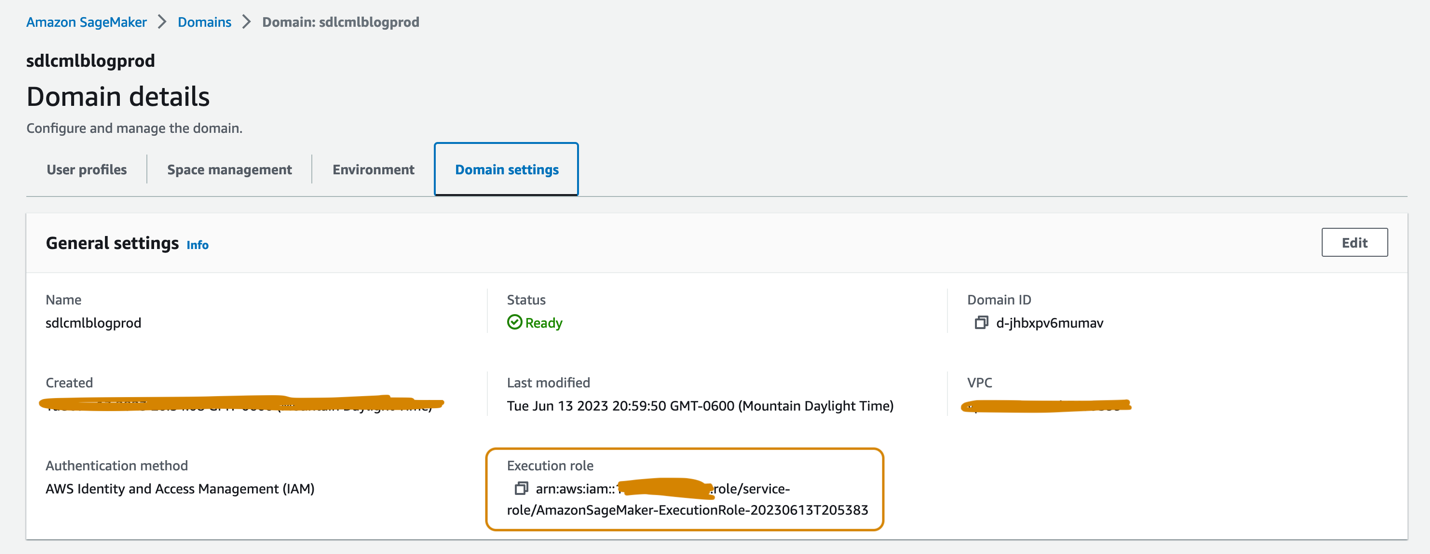

SageMaker Studio-domænerne, der er oprettet i dev- og prod-kontiene, bør hver have en udførelsesrolle tilknyttet, som kan findes på Domæneindstillinger fanen på siden med domænedetaljer, som vist på det følgende skærmbillede. Denne rolle bruges til at køre træningsjob, behandlingsjob og mere inden for SageMaker Studio-domænet.

Føj følgende politikker til SageMaker-udførelsesrollen på begge konti:

- Politik 1 – Opret en inline politik med navnet

cross-account-model-artifacts-s3-bucket-access, som giver adgang til S3-bøtten i den centrale modelregistreringskonto, som gemmer modelartefakter: - Politik 2 – Opret en inline politik med navnet

cross-account-model-registry-access, som giver adgang til modelpakken i modelregistret i den centrale modelregistreringskonto: - Politik 3 – Opret en inline politik med navnet

kms-key-access-policy, som giver adgang til KMS-nøglen oprettet i det foregående trin. Angiv det konto-id, hvor politikken oprettes, og det KMS-nøgle-id, der er oprettet på den konto. - Politik 4 – Vedhæft AmazonSageMakerFullAccess, som er en AWS-styret politik der giver fuld adgang til SageMaker og vælg adgang til relaterede tjenester.

- Politik 5 – Vedhæft AWSLambda_Fuld adgang, som er en AWS-styret politik, der giver fuld adgang til Lambda, Lambda-konsolfunktioner og andre relaterede AWS-tjenester.

- Politik 6 – Vedhæft CloudWatchEventsFullAccess, som er en AWS-styret politik, der giver fuld adgang til CloudWatch Events.

- Politik 7 – Tilføj følgende IAM-tillidspolitik for SageMaker-udførelses-IAM-rollen:

- Politik 8 (specifik for SageMaker-udførelsesrollen i prod-kontoen) – Opret en inline politik med navnet

cross-account-kms-key-access-policy, som giver adgang til den KMS-nøgle, der er oprettet på udviklerkontoen. Dette er påkrævet, for at slutningspipelinen kan læse modelartefakter, der er gemt i den centrale modelregistreringskonto, hvor modelartefakterne er krypteret ved hjælp af KMS-nøglen fra udviklerkontoen, når den første version af modellen oprettes fra udviklerkontoen.

Jenkins rolle på tværs af konti

Konfigurer en IAM-rolle kaldet cross-account-jenkins-role i prod-kontoen, som Jenkins vil antage for at implementere ML-pipelines og tilhørende infrastruktur i prod-kontoen.

Føj følgende administrerede IAM-politikker til rollen:

CloudWatchFullAccessAmazonS3FullAccessAmazonSNSFullAccessAmazonSageMakerFullAccessAmazonEventBridgeFullAccessAWSLambda_FullAccess

Opdater tillidsforholdet på rollen for at give tilladelser til AWS-kontoen, der hoster Jenkins-serveren:

Opdater tilladelser på IAM-rollen, der er knyttet til Jenkins-serveren

Hvis det antages, at Jenkins er blevet konfigureret på AWS, skal du opdatere IAM-rollen, der er knyttet til Jenkins, for at tilføje følgende politikker, som vil give Jenkins adgang til at implementere ressourcerne på prod-kontoen:

- Politik 1 – Opret følgende inline politik med navn

assume-production-role-policy: - Politik 2 – Fastgør

CloudWatchFullAccessadministreret IAM-politik.

Opsæt modelpakkegruppen i den centrale modelregistreringskonto

Fra SageMaker Studio-domænet i den centrale modelregistreringskonto skal du oprette en modelpakkegruppe kaldet mammo-severity-model-package ved hjælp af følgende kodestykke (som du kan køre med en Jupyter-notesbog):

Konfigurer adgang til modelpakken for IAM-roller i dev- og prod-kontiene

Giv adgang til SageMaker-udførelsesrollerne, der er oprettet i dev- og prod-kontiene, så du kan registrere modelversioner i modelpakken mammo-severity-model-package i det centrale modelregister fra begge konti. Kør følgende kode i en Jupyter-notesbog fra SageMaker Studio-domænet i den centrale modelregistreringskonto:

Indstil Jenkins

I dette afsnit konfigurerer vi Jenkins til at skabe ML-pipelines og den tilsvarende Terraform-infrastruktur i prod-kontoen gennem Jenkins CI/CD-pipeline.

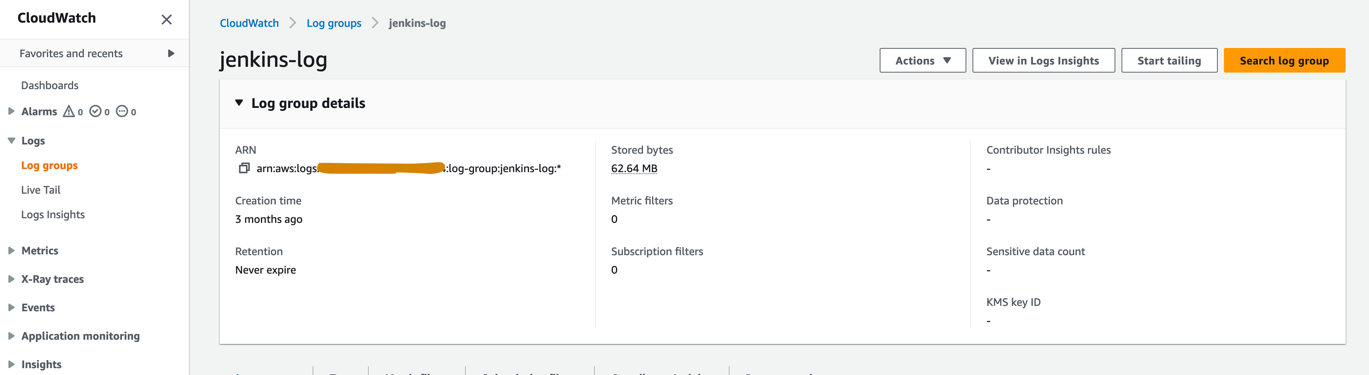

- På CloudWatch-konsollen skal du oprette en loggruppe med navnet

jenkins-loginden for den prod-konto, som Jenkins vil sende logfiler til fra CI/CD-pipelinen. Loggruppen skal oprettes i samme region som hvor Jenkins-serveren er sat op.

- Installer følgende plugins på din Jenkins-server:

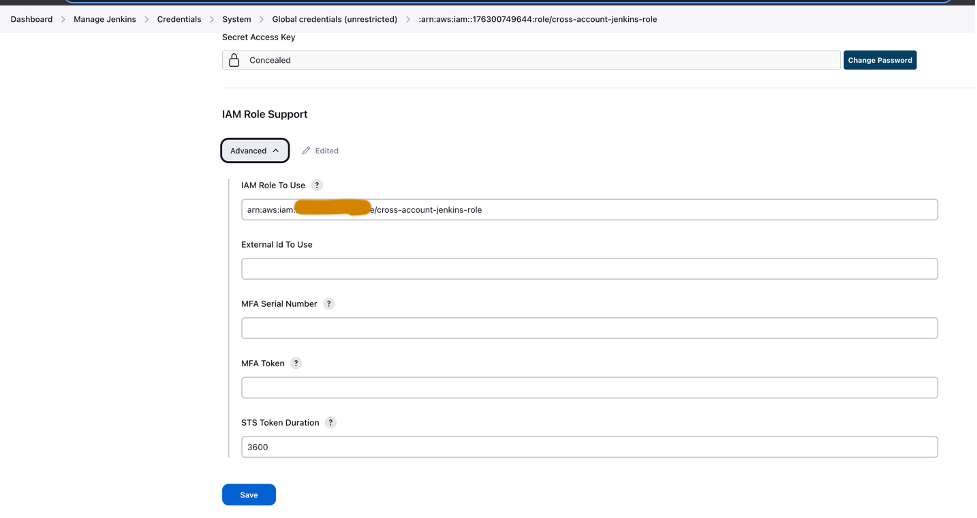

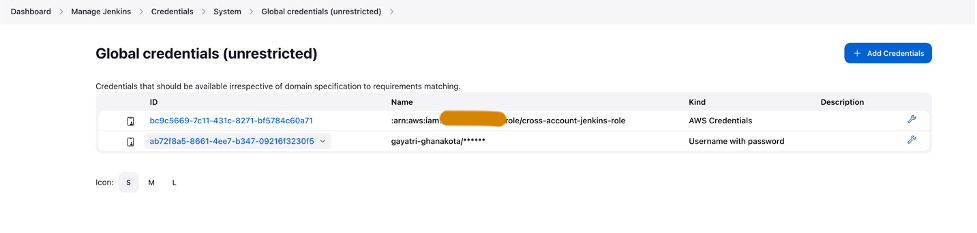

- Konfigurer AWS-legitimationsoplysninger i Jenkins ved hjælp af IAM-rollen på tværs af konti (

cross-account-jenkins-role) klargjort i prod-kontoen.

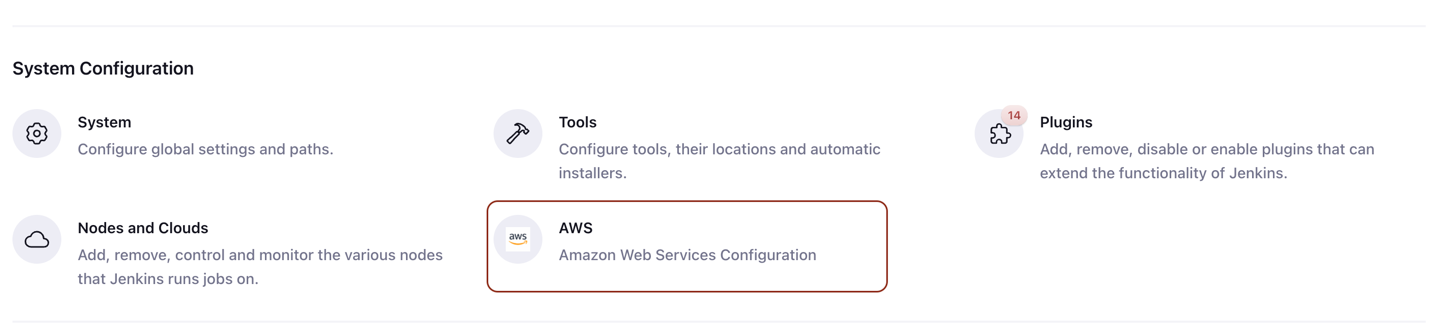

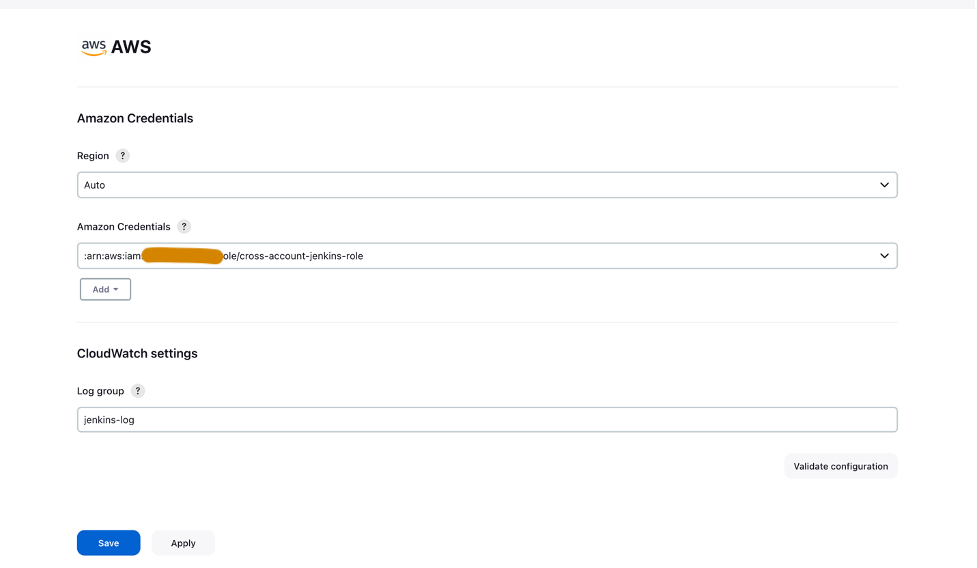

- Til System Configuration, vælg AWS.

- Angiv legitimationsoplysningerne og CloudWatch-loggruppen, du oprettede tidligere.

- Konfigurer GitHub-legitimationsoplysninger i Jenkins.

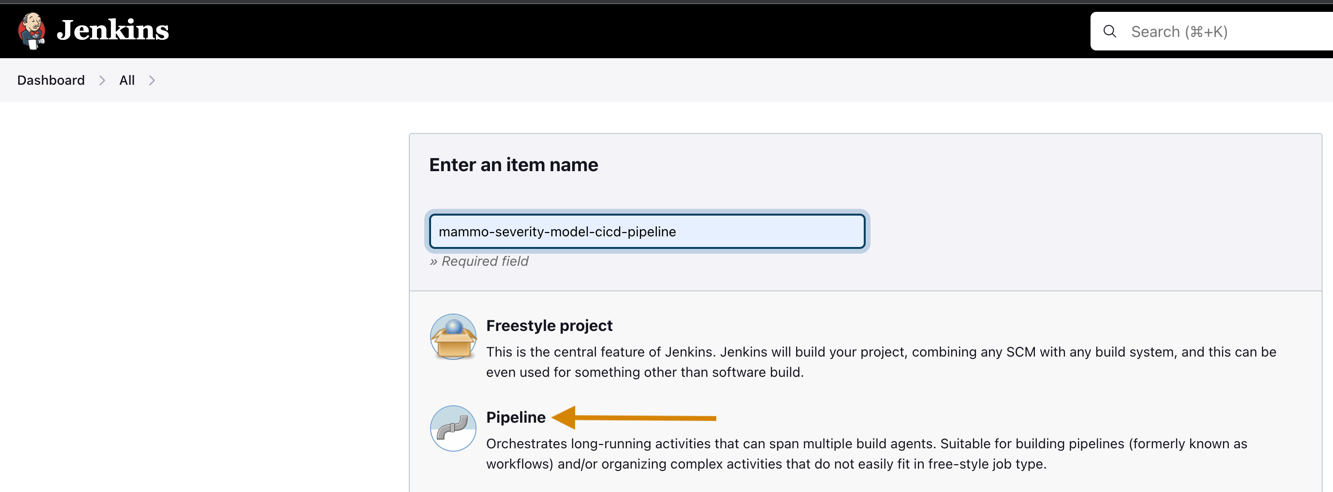

- Opret et nyt projekt i Jenkins.

- Indtast et projektnavn og vælg Pipeline.

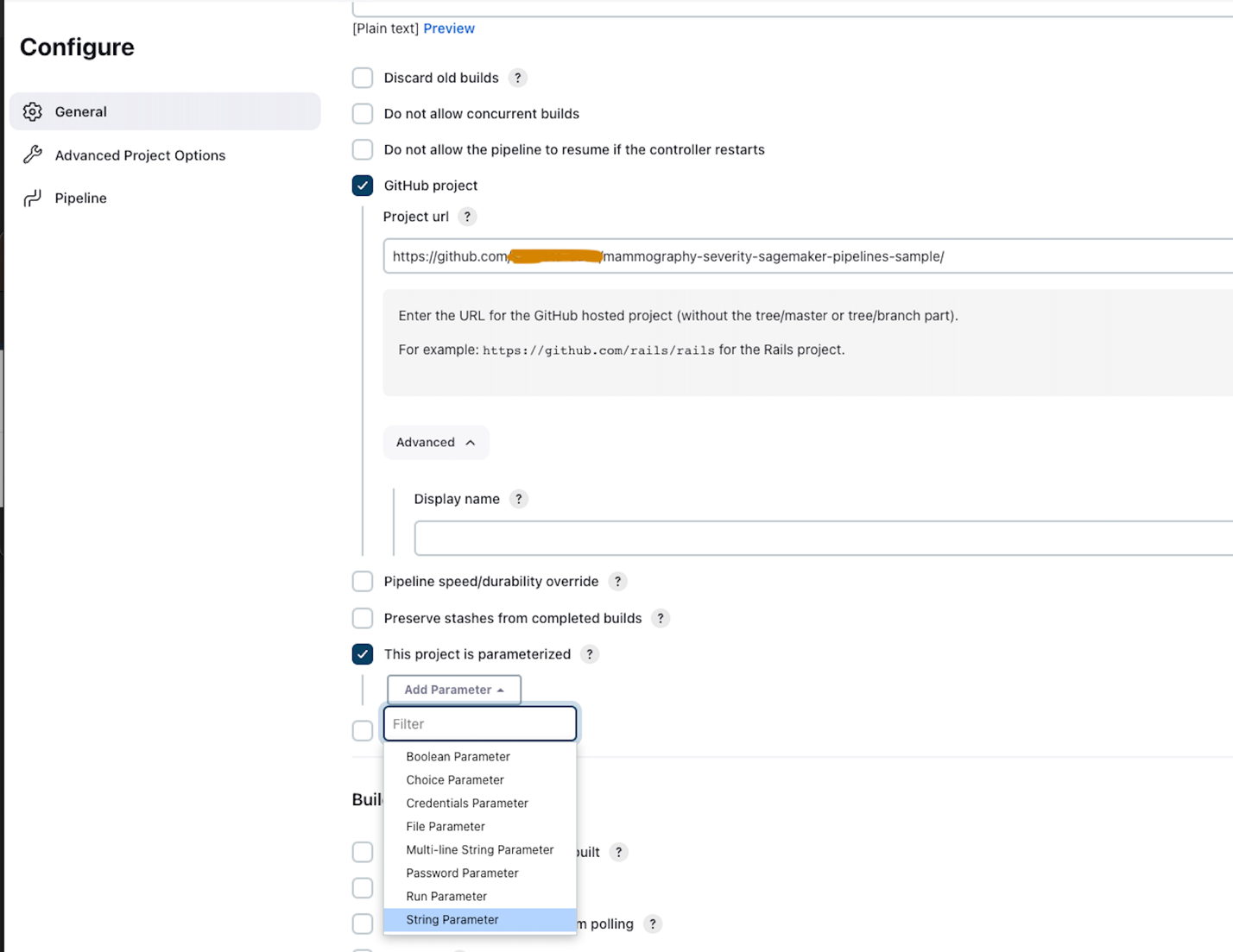

- På Generelt fanebladet, vælg GitHub-projekt og gå ind i gaflen GitHub repository URL.

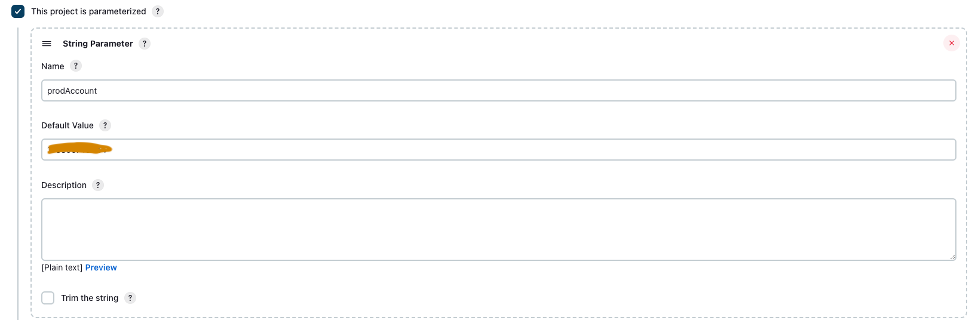

- Type Dette projekt er parametriseret.

- På Tilføj parameter menu, vælg Strengparameter.

- Til Navn, gå ind

prodAccount. - Til Standard værdi, skal du indtaste prod-konto-id'et.

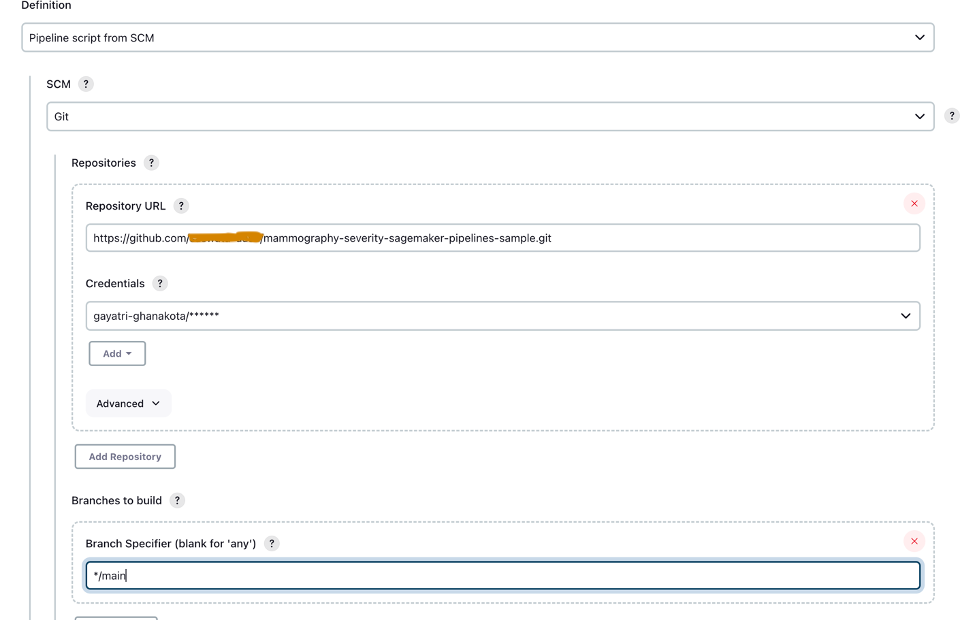

- Under Avancerede projektmuligheder, For Definition, Vælg Pipeline script fra SCM.

- Til SCM, vælg Git.

- Til Repository URL, ind i gaffelen GitHub repository URL.

- Til Legitimationsoplysninger, indtast GitHub-legitimationsoplysningerne, der er gemt i Jenkins.

- Indtast

maini Grene at bygge afsnit, baseret på hvilken CI/CD-pipeline vil blive udløst.

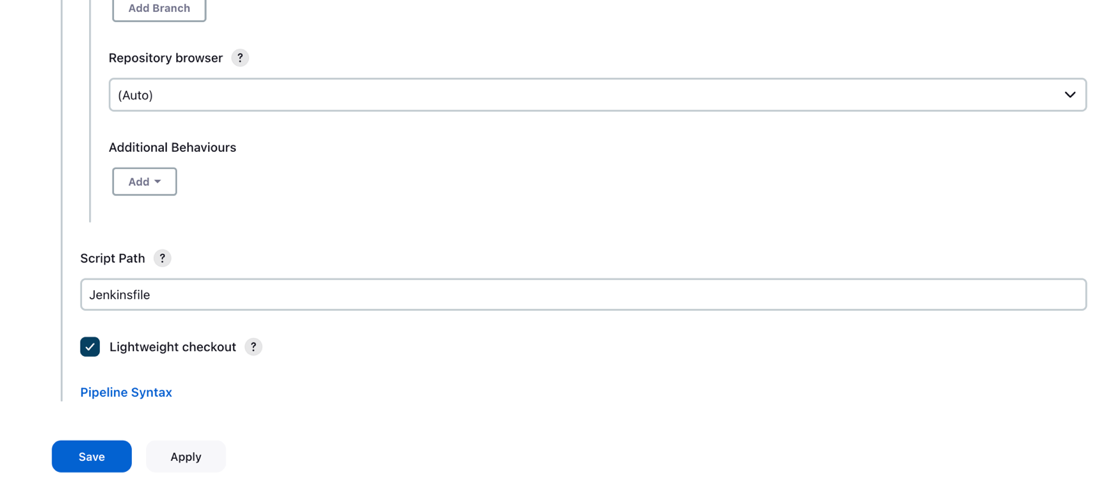

- Til Skriptsti, gå ind

Jenkinsfile. - Vælg Gem.

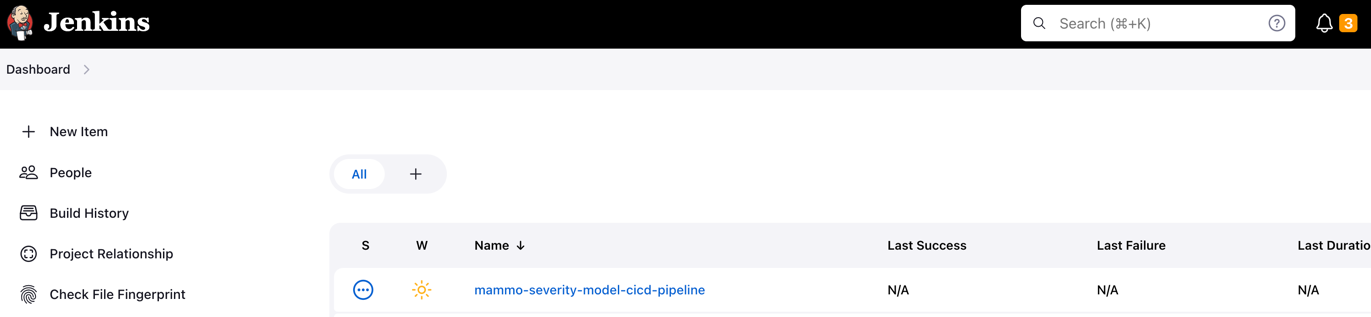

Jenkins pipeline skal være oprettet og synlig på dit dashboard.

Tilvejebring S3 buckets, indsamle og forberede data

Udfør følgende trin for at konfigurere dine S3-bøtter og data:

- Lav en S3-spand efter eget valg med snoren

sagemakeri navnekonventionen som en del af bøttens navn i både dev- og prod-konti for at gemme datasæt og modelartefakter. - Sæt en S3-spand op for at opretholde Terraform-tilstanden på prod-kontoen.

- Download og gem det offentligt tilgængelige UCI Mammografi Mass datasæt til den S3-bøtte, du oprettede tidligere på udviklerkontoen.

- Fork og klon GitHub repository inden for SageMaker Studio-domænet i udviklerkontoen. Repoen har følgende mappestruktur:

- /environments – Konfigurationsscript til prod-miljø

- /mlops-infra – Kode til implementering af AWS-tjenester ved hjælp af Terraform-kode

- /rørledninger – Kode til SageMaker rørledningskomponenter

- Jenkinsfile – Script til at implementere gennem Jenkins CI/CD pipeline

- setup.py – Nødvendig for at installere de nødvendige Python-moduler og oprette run-pipeline-kommandoen

- mammography-severity-modeling.ipynb – Giver dig mulighed for at oprette og køre ML-arbejdsgangen

- Opret en mappe kaldet data i den klonede GitHub-depotmappe og gem en kopi af den offentligt tilgængelige UCI Mammografi Mass datasæt.

- Følg Jupyter-notesbogen

mammography-severity-modeling.ipynb. - Kør følgende kode i notesbogen for at forbehandle datasættet og uploade det til S3-bøtten i udviklerkontoen:

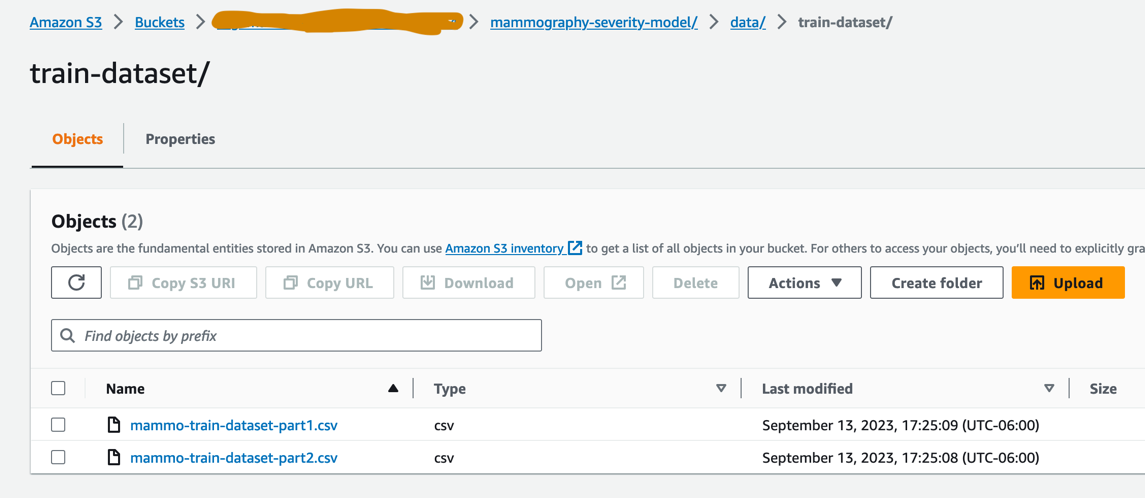

Koden vil generere følgende datasæt:

-

- data/ mammo-train-dataset-part1.csv – Vil blive brugt til at træne den første version af modellen.

- data/ mammo-train-dataset-part2.csv – Vil blive brugt til at træne den anden version af modellen sammen med mammo-train-dataset-part1.csv-datasættet.

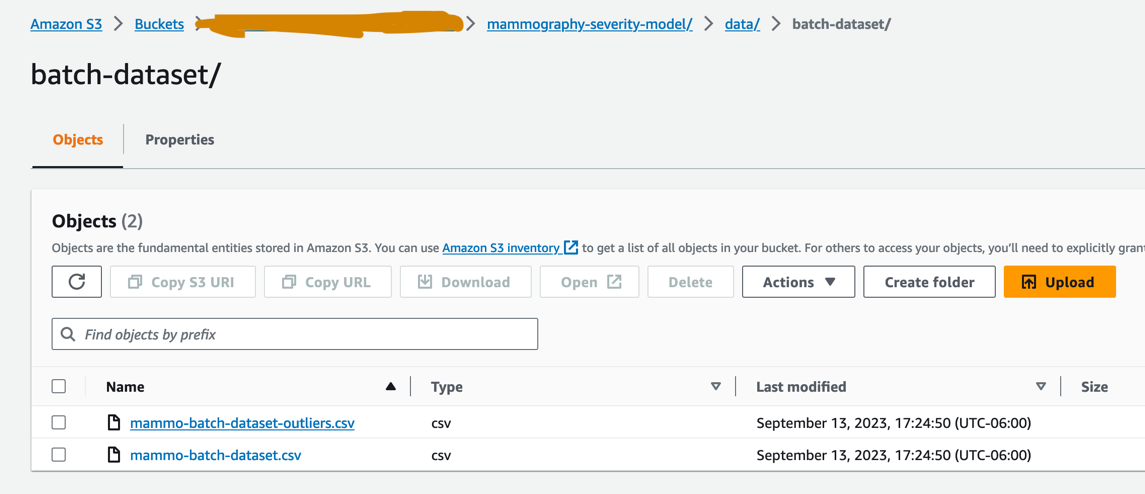

- data/mammo-batch-dataset.csv – Vil blive brugt til at generere slutninger.

- data/mammo-batch-dataset-outliers.csv – Vil indføre outliers i datasættet for at fejle inferenspipelinen. Dette vil gøre os i stand til at teste mønsteret for at udløse automatisk genoptræning af modellen.

- Upload datasættet

mammo-train-dataset-part1.csvunder præfiksetmammography-severity-model/train-dataset, og upload datasættenemammo-batch-dataset.csv,mammo-batch-dataset-outliers.csvtil præfiksetmammography-severity-model/batch-datasetaf S3-bøtten, der er oprettet på udviklerkontoen: - Upload datasættene

mammo-train-dataset-part1.csv,mammo-train-dataset-part2.csvunder præfiksetmammography-severity-model/train-datasetind i S3-bøtten, der er oprettet på prod-kontoen gennem Amazon S3-konsollen.

- Upload datasættene

mammo-batch-dataset.csv,mammo-batch-dataset-outliers.csvtil præfiksetmammography-severity-model/batch-datasetaf S3-spanden på prod-kontoen.

Kør togrørledningen

Under <project-name>/pipelines/train, kan du se følgende Python-scripts:

- scripts/raw_preprocess.py – Integreres med SageMaker Processing til funktionsudvikling

- scripts/evaluate_model.py – Tillader beregning af modelmetrik i dette tilfælde

auc_score - train_pipeline.py – Indeholder koden til modeltræningspipeline

Udfør følgende trin:

- Upload scripts til Amazon S3:

- Hent forekomsten af togrørledningen:

- Indsend togrørledningen og kør den:

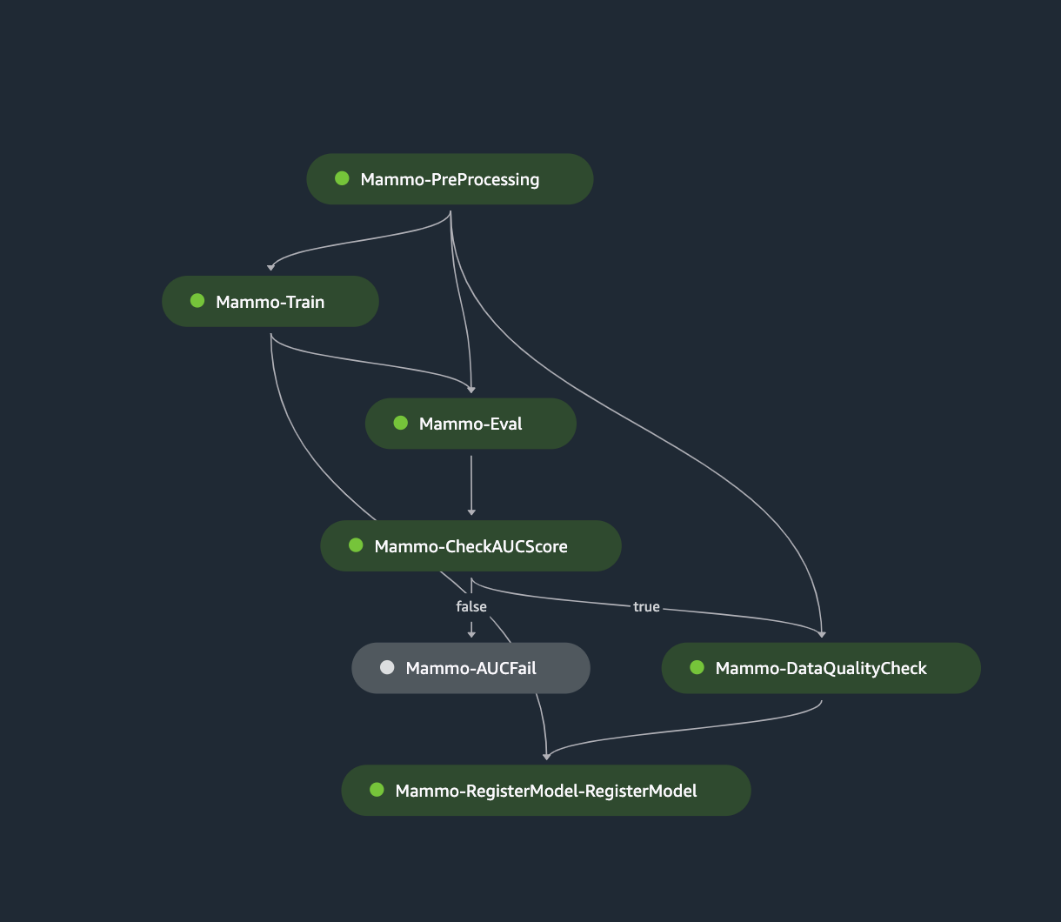

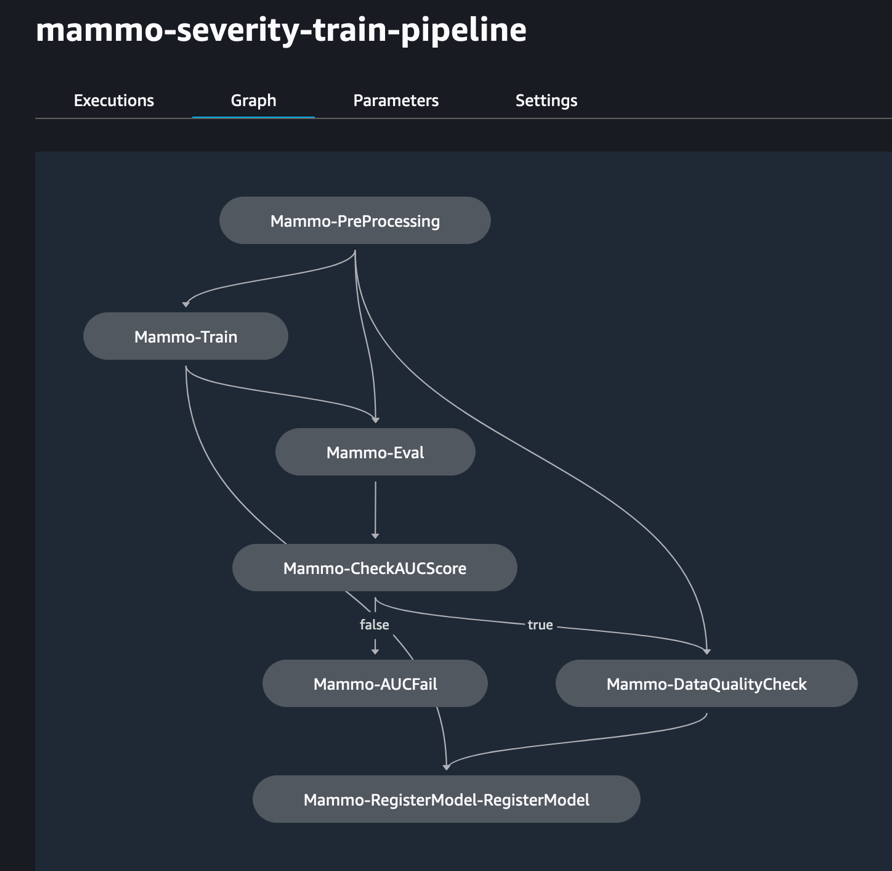

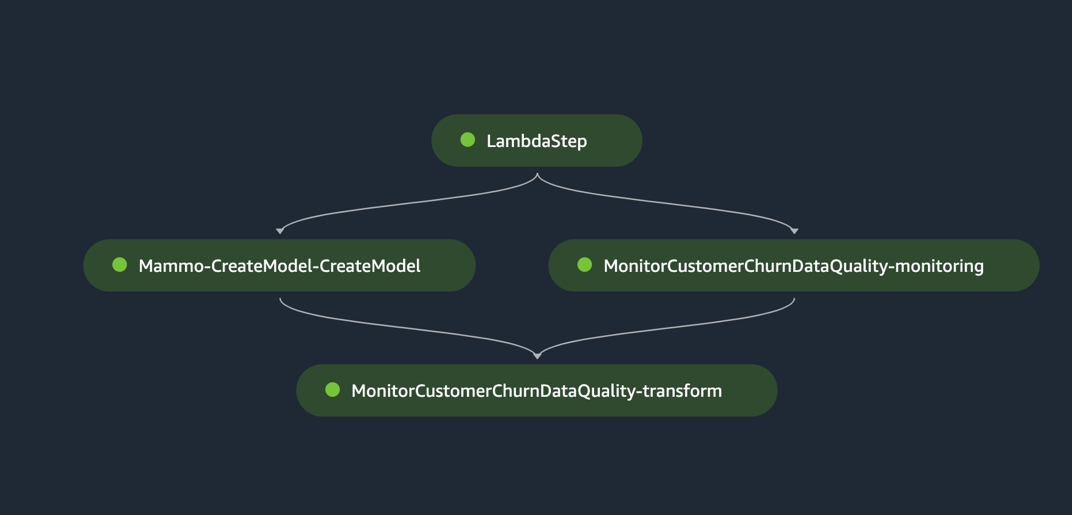

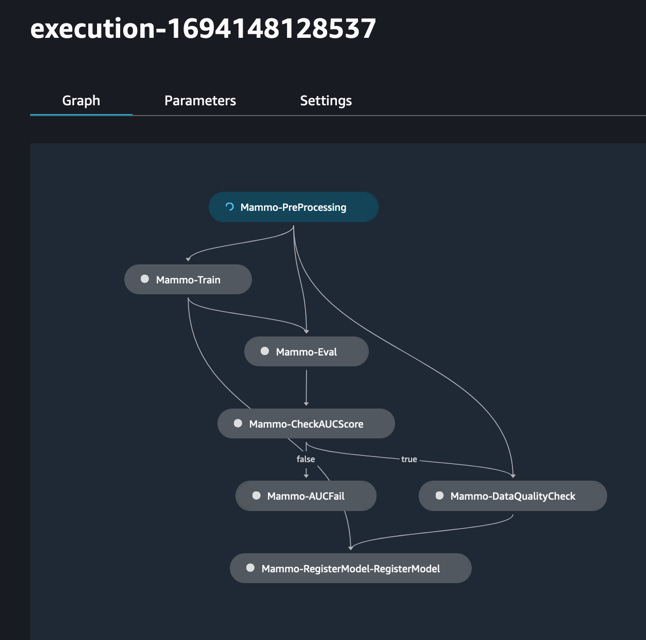

Følgende figur viser en vellykket kørsel af træningspipeline. Det sidste trin i pipelinen registrerer modellen i den centrale modelregistreringskonto.

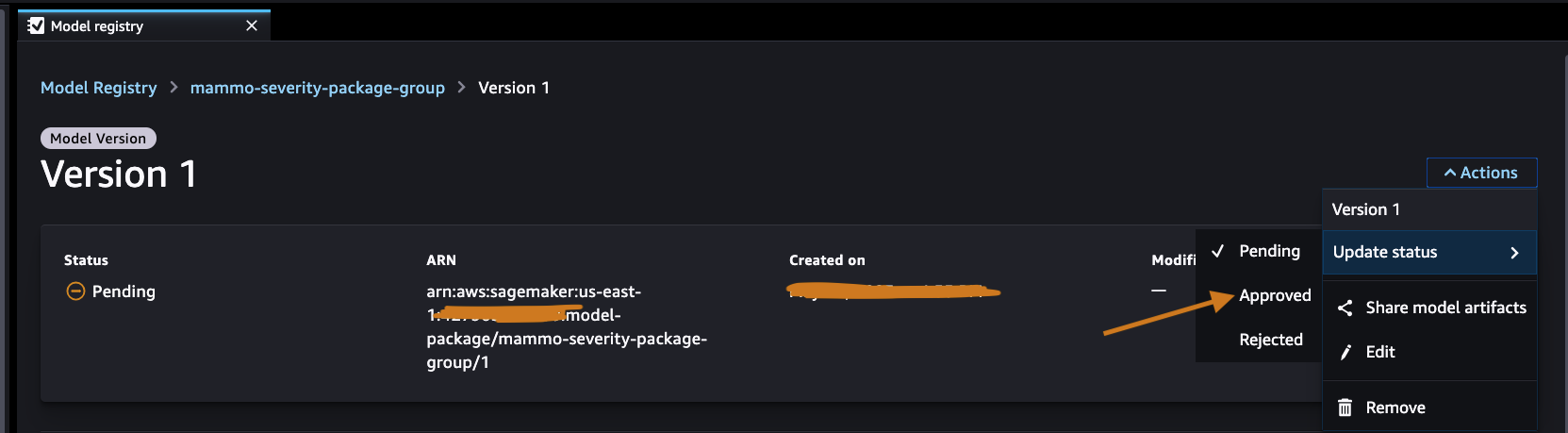

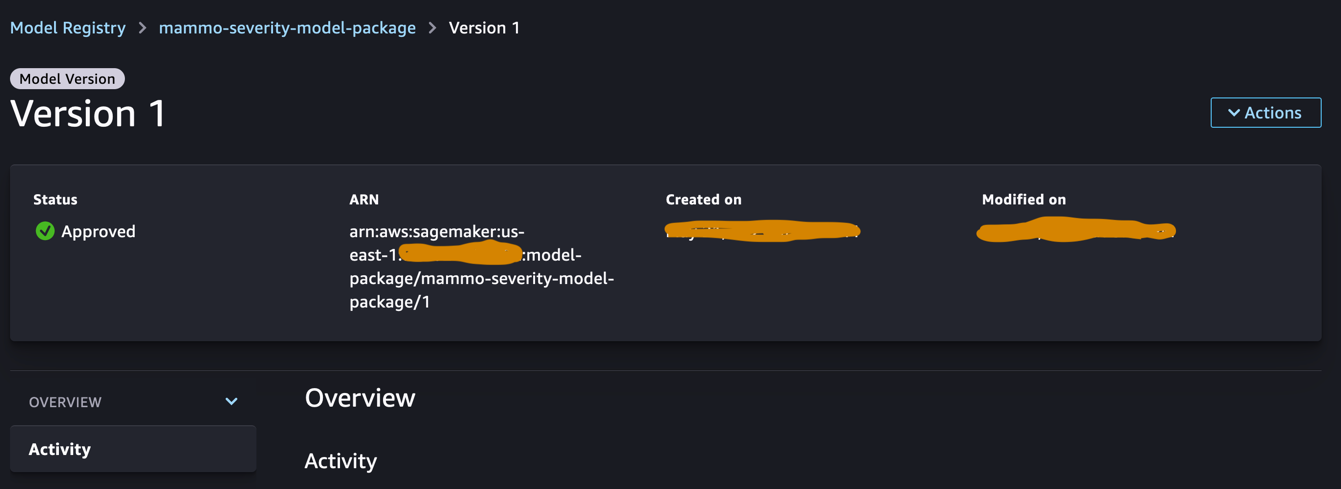

Godkend modellen i det centrale modelregister

Log ind på den centrale modelregistreringskonto og få adgang til SageMaker-modelregistret inden for SageMaker Studio-domænet. Skift modelversionsstatus til Godkendt.

Når den er godkendt, skal status ændres på modelversionen.

Kør inferenspipeline (valgfrit)

Dette trin er ikke påkrævet, men du kan stadig køre inferenspipelinen for at generere forudsigelser i udviklerkontoen.

Under <project-name>/pipelines/inference, kan du se følgende Python-scripts:

- scripts/lambda_helper.py – Trækker den seneste godkendte modelversion fra den centrale modelregistreringskonto ved hjælp af et SageMaker Pipelines Lambda-trin

- inference_pipeline.py – Indeholder koden for modelinferenspipeline

Udfør følgende trin:

- Upload scriptet til S3-bøtten:

- Hent inferenspipeline-forekomsten ved hjælp af det normale batch-datasæt:

- Indsend inferenspipeline og kør den:

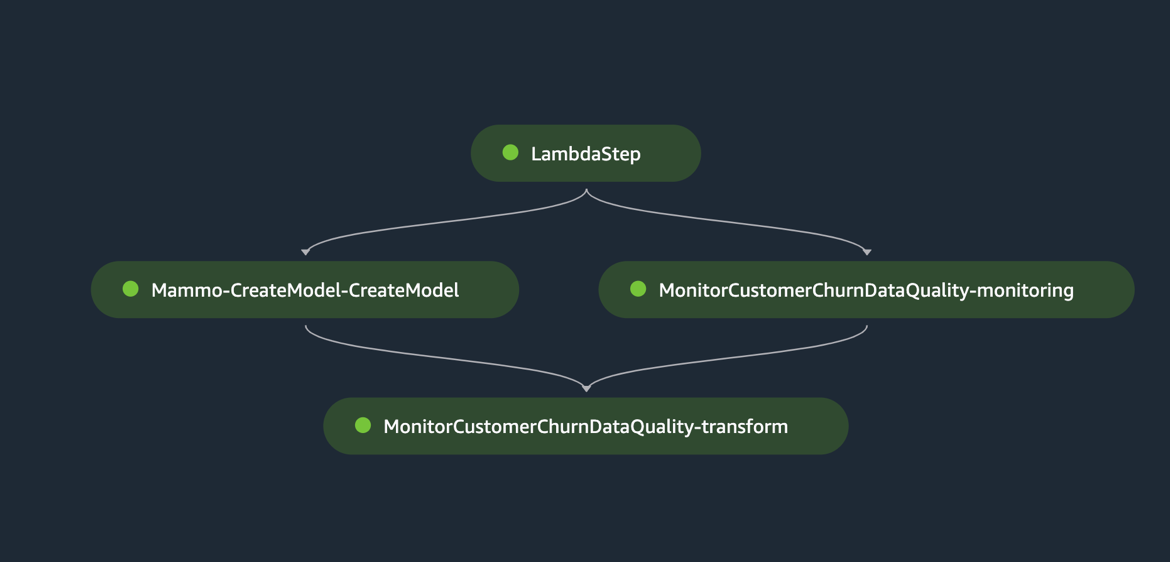

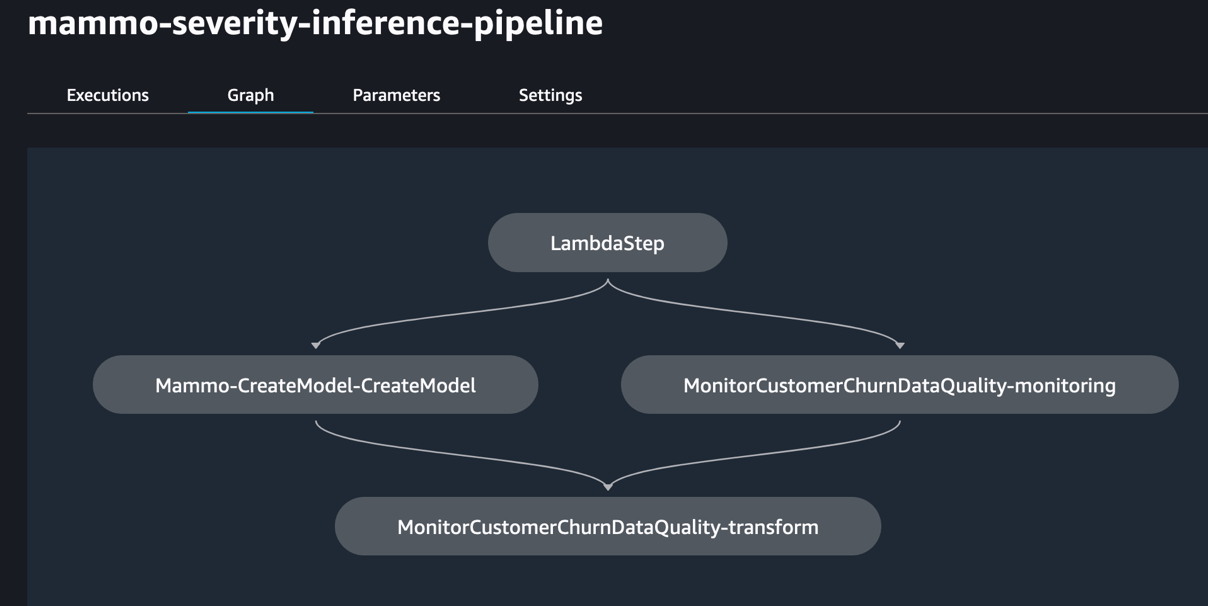

Følgende figur viser en vellykket kørsel af inferenspipelinen. Det sidste trin i pipelinen genererer forudsigelserne og gemmer dem i S3-bøtten. Vi bruger MonitorBatchTransformStep at overvåge input til batchtransformationsjobbet. Hvis der er nogen afvigere, går slutningspipelinen i en mislykket tilstand.

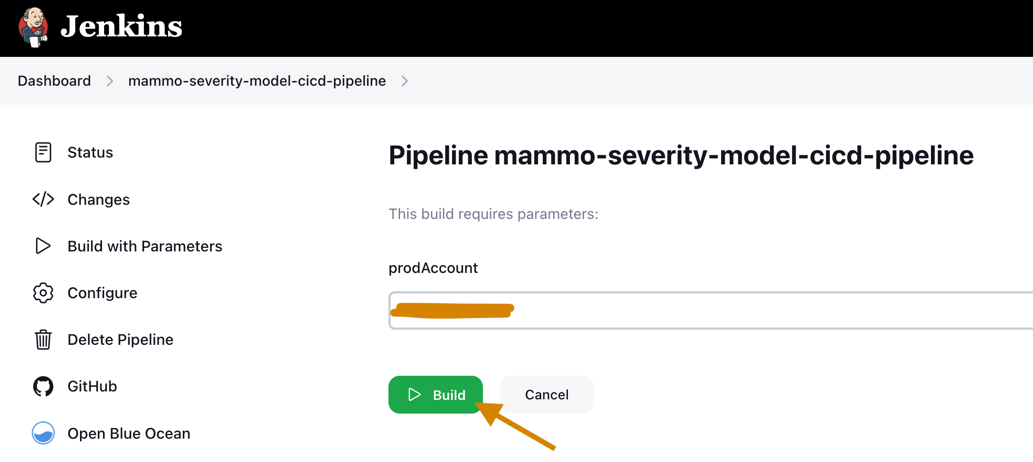

Kør Jenkins pipeline

environment/ mappen i GitHub-lageret indeholder konfigurationsscriptet for prod-kontoen. Udfør følgende trin for at udløse Jenkins pipeline:

- Opdater konfigurationsscriptet

prod.tfvars.jsonbaseret på de ressourcer, der er oprettet i de foregående trin: - Når den er opdateret, skal du skubbe koden ind i det gaflede GitHub-lager og flette koden ind i hovedgrenen.

- Gå til Jenkins UI, vælg Byg med parametre, og udløs den CI/CD-pipeline, der blev oprettet i de foregående trin.

Når opbygningen er færdig og vellykket, kan du logge ind på prod-kontoen og se tog- og inferenspipelines inden for SageMaker Studio-domænet.

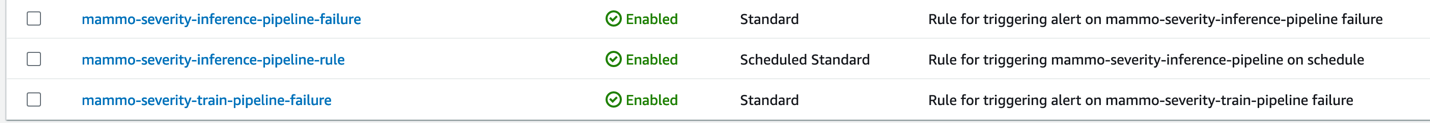

Derudover vil du se tre EventBridge-regler på EventBridge-konsollen i prod-kontoen:

- Planlæg inferenspipeline

- Send en fejlmeddelelse på togrørledningen

- Når inferensrørledningen ikke udløser togrørledningen, skal du sende en meddelelse

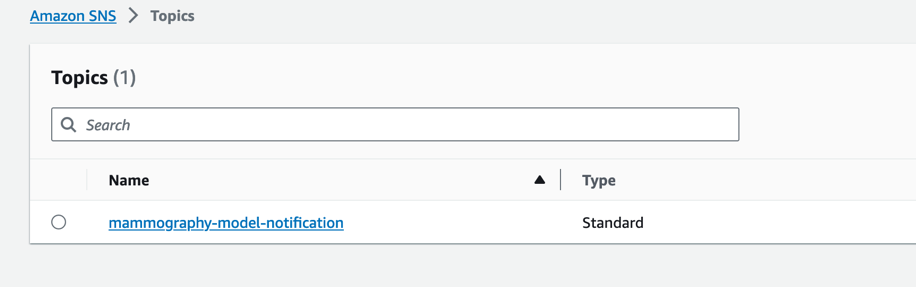

Endelig vil du se et SNS-meddelelsesemne på Amazon SNS-konsollen, der sender meddelelser via e-mail. Du får en e-mail, hvor du bliver bedt om at bekræfte accepten af disse underretnings-e-mails.

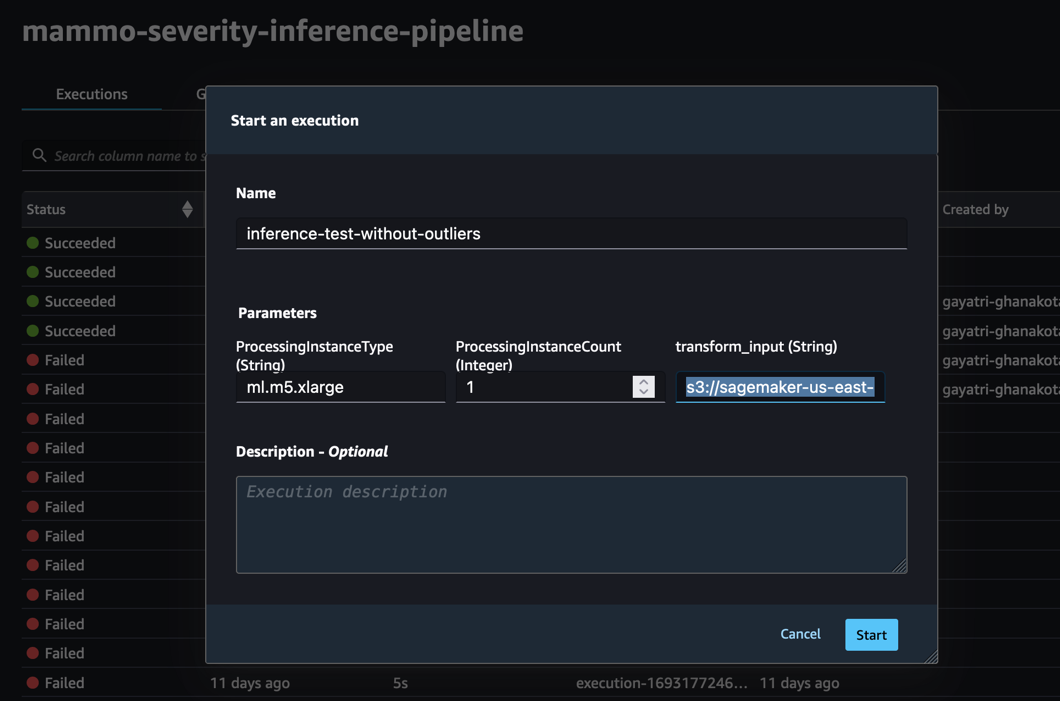

Test slutningspipelinen ved hjælp af et batchdatasæt uden outliers

For at teste, om inferenspipelinen fungerer som forventet i prodkontoen, kan vi logge ind på prodkontoen og udløse inferenspipelinen ved hjælp af batchdatasættet uden outliers.

Kør pipelinen via SageMaker Pipelines-konsollen i SageMaker Studio-domænet på prod-kontoen, hvor transform_input vil være S3 URI af datasættet uden afvigelser (s3://<s3-bucket-in-prod-account>/mammography-severity-model/data/mammo-batch-dataset.csv).

Inferenspipelinen lykkes og skriver forudsigelserne tilbage til S3-bøtten.

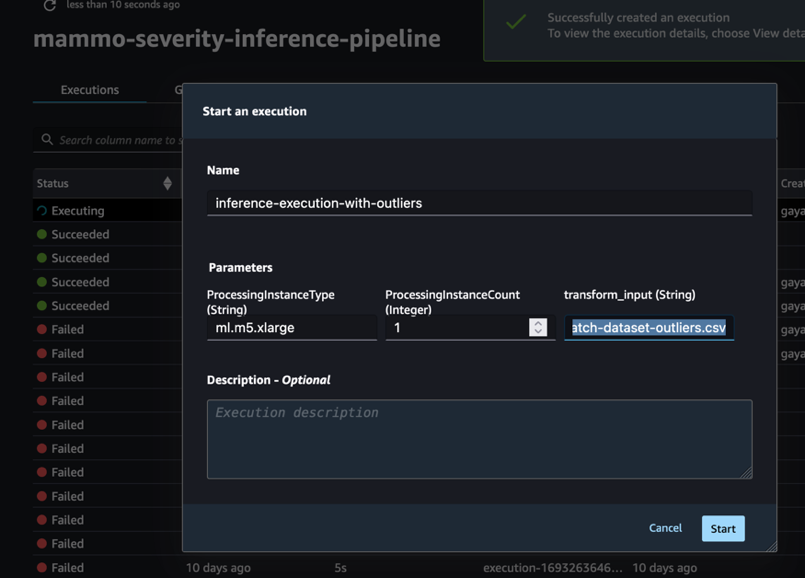

Test inferenspipelinen ved hjælp af et batchdatasæt med outliers

Du kan køre inferenspipelinen ved hjælp af batchdatasættet med outliers for at kontrollere, om den automatiske genoptræningsmekanisme fungerer som forventet.

Kør pipelinen via SageMaker Pipelines-konsollen i SageMaker Studio-domænet på prod-kontoen, hvor transform_input vil være S3 URI af datasættet med outliers (s3://<s3-bucket-in-prod-account>/mammography-severity-model/data/mammo-batch-dataset-outliers.csv).

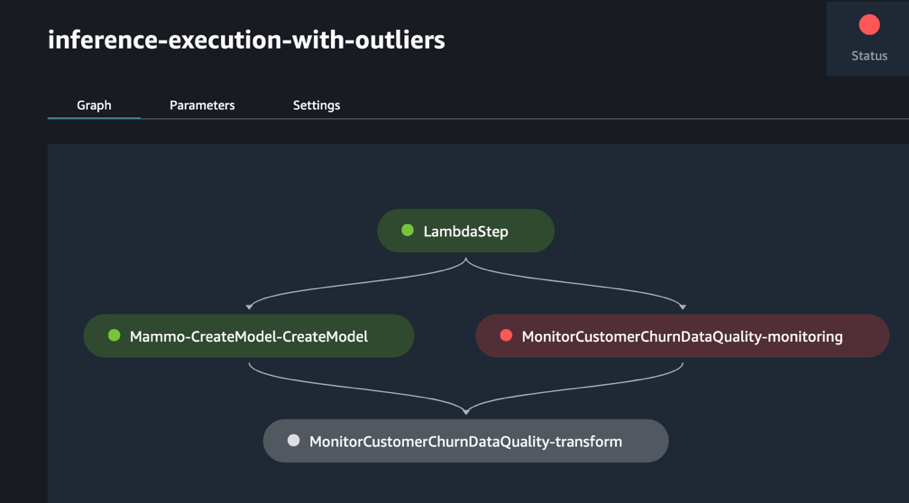

Inferenspipelinen fejler som forventet, hvilket udløser EventBridge-reglen, som igen udløser togpipelinen.

Efter et par øjeblikke bør du se en ny kørsel af togrørledningen på SageMaker Pipelines-konsollen, som opfanger de to forskellige togdatasæt (mammo-train-dataset-part1.csv , mammo-train-dataset-part2.csv) uploadet til S3-spanden for at genoptræne modellen.

Du vil også se en meddelelse sendt til den e-mail, der abonnerer på SNS-emnet.

For at bruge den opdaterede modelversion skal du logge ind på den centrale modelregistreringskonto og godkende modelversionen, som vil blive afhentet under den næste kørsel af inferenspipeline, der udløses gennem den planlagte EventBridge-regel.

Selvom tog- og inferenspipelines bruger en statisk datasæt-URL, kan du få datasæt-URL'en videregivet til tog- og inferenspipelines som dynamiske variabler for at bruge opdaterede datasæt til at genoptræne modellen og generere forudsigelser i et scenarie i den virkelige verden.

Ryd op

Udfør følgende trin for at undgå fremtidige gebyrer:

- Fjern SageMaker Studio-domænet på tværs af alle AWS-konti.

- Slet alle de ressourcer, der er oprettet uden for SageMaker, inklusive S3-buckets, IAM-roller, EventBridge-regler og SNS-emne, der er oprettet gennem Terraform i prod-kontoen.

- Slet SageMaker-pipelines, der er oprettet på tværs af konti ved hjælp af AWS kommandolinjegrænseflade (AWS CLI).

Konklusion

Organisationer skal ofte tilpasse sig værktøjssæt for hele virksomheden for at muliggøre samarbejde på tværs af forskellige funktionsområder og teams. Dette samarbejde sikrer, at din MLOps-platform kan tilpasse sig skiftende forretningsbehov og accelererer adoptionen af ML på tværs af teams. Dette indlæg forklarede, hvordan man opretter en MLOps-ramme i en multi-miljø-opsætning for at muliggøre automatiseret modeloplæring, batch-inferens og overvågning med Amazon SageMaker Model Monitor, modelversionering med SageMaker Model Registry og promovering af ML-kode og pipelines på tværs af miljøer med en CI/CD pipeline. Vi fremviste denne løsning ved hjælp af en kombination af AWS-tjenester og tredjepartsværktøjssæt. For instruktioner om implementering af denne løsning, se GitHub repository. Du kan også udvide denne løsning ved at bringe dine egne datakilder og modelleringsrammer ind.

Om forfatterne

Gayatri Ghanakota er en Sr. Machine Learning Engineer med AWS Professional Services. Hun brænder for at udvikle, implementere og forklare AI/ML-løsninger på tværs af forskellige domæner. Forud for denne rolle ledede hun flere initiativer som dataforsker og ML-ingeniør hos top globale firmaer inden for finans- og detailområdet. Hun har en mastergrad i datalogi med speciale i datavidenskab fra University of Colorado, Boulder.

Gayatri Ghanakota er en Sr. Machine Learning Engineer med AWS Professional Services. Hun brænder for at udvikle, implementere og forklare AI/ML-løsninger på tværs af forskellige domæner. Forud for denne rolle ledede hun flere initiativer som dataforsker og ML-ingeniør hos top globale firmaer inden for finans- og detailområdet. Hun har en mastergrad i datalogi med speciale i datavidenskab fra University of Colorado, Boulder.

Sunita Koppar er en Sr. Data Lake Architect med AWS Professional Services. Hun brænder for at løse kundesmerter ved at behandle big data og levere langsigtede skalerbare løsninger. Før denne rolle udviklede hun produkter inden for internet-, telekom- og bildomæner og har været AWS-kunde. Hun har en mastergrad i datavidenskab fra University of California, Riverside.

Sunita Koppar er en Sr. Data Lake Architect med AWS Professional Services. Hun brænder for at løse kundesmerter ved at behandle big data og levere langsigtede skalerbare løsninger. Før denne rolle udviklede hun produkter inden for internet-, telekom- og bildomæner og har været AWS-kunde. Hun har en mastergrad i datavidenskab fra University of California, Riverside.

Saswata Dash er DevOps-konsulent med AWS Professional Services. Hun har arbejdet med kunder på tværs af sundheds- og biovidenskab, luftfart og produktion. Hun brænder for alt inden for automatisering og har omfattende erfaring med at designe og bygge virksomhedsskala kundeløsninger i AWS. Uden for arbejdet forfølger hun sin passion for fotografering og at fange solopgange.

Saswata Dash er DevOps-konsulent med AWS Professional Services. Hun har arbejdet med kunder på tværs af sundheds- og biovidenskab, luftfart og produktion. Hun brænder for alt inden for automatisering og har omfattende erfaring med at designe og bygge virksomhedsskala kundeløsninger i AWS. Uden for arbejdet forfølger hun sin passion for fotografering og at fange solopgange.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/promote-pipelines-in-a-multi-environment-setup-using-amazon-sagemaker-model-registry-hashicorp-terraform-github-and-jenkins-ci-cd/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 10

- 100

- 12

- 13

- 14

- 16

- 17

- 19

- 23

- 27

- 31

- 320

- 7

- 8

- 9

- a

- Om

- accelererer

- accept

- adgang

- Konto

- Konti

- tværs

- Handling

- tilpasse

- tilføje

- adresse

- administrative

- Vedtagelse

- Efter

- alder

- AI

- tilpasse

- Alle

- tillade

- tillader

- sammen

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- ,

- En anden

- enhver

- Anvendelse

- passende

- Godkend

- godkendt

- arkitektur

- ER

- områder

- omkring

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- AS

- spørge

- forbundet

- antage

- vedhæfte

- auto

- Automatiseret

- Automatisk Ur

- Automation

- automotive

- til rådighed

- luftfart

- undgå

- AWS

- AWS kunde

- AWS Professional Services

- tilbage

- baseret

- grundlag

- BE

- fordi

- været

- før

- være

- BEDSTE

- bedste praksis

- mellem

- Big

- Big data

- både

- Branch

- brodannelse

- Bringe

- bygge

- Bygning

- bygget

- virksomhed

- men

- by

- beregning

- california

- kaldet

- CAN

- tilfælde

- central

- lave om

- ændret

- Ændringer

- afgifter

- kontrollere

- valg

- Vælg

- kode

- samarbejde

- indsamler

- Colorado

- Kolonne

- Kolonner

- KOM

- kombination

- fuldføre

- Compliance

- komponenter

- omfattende

- computer

- Datalogi

- betingelse

- Konfiguration

- Bekræfte

- Konsol

- konsulent

- Container

- indeholder

- kontrol

- Konventionen

- konvertere

- Tilsvarende

- skabe

- oprettet

- Oprettelse af

- Legitimationsoplysninger

- Cross

- kunde

- Kundeløsninger

- Kunder

- dagligt

- instrumentbræt

- data

- Data Lake

- datalogi

- dataforsker

- datasæt

- Dekryptér

- Standard

- Degree

- indsætte

- implementering

- implementering

- udruller

- designe

- detaljer

- opdage

- opdaget

- dev

- udviklet

- udvikling

- Udvikling

- DICT

- forskellige

- domæne

- Domæner

- i løbet af

- dynamisk

- hver

- tidligere

- effekt

- enten

- emails

- muliggøre

- krypteret

- ingeniør

- sikrer

- Indtast

- Miljø

- miljøer

- væsentlig

- begivenheder

- udviklende

- udførelse

- forventet

- erfaring

- forklarede

- forklarer

- udvide

- lette

- FAIL

- mislykkedes

- mislykkes

- Manglende

- Feature

- Funktionalitet

- få

- Figur

- File (Felt)

- endelige

- finansielle

- slut

- firmaer

- Fornavn

- første gang

- efter

- Til

- fundet

- Framework

- rammer

- fra

- Opfylde

- fuld

- funktion

- funktionel

- fremtiden

- kløft

- generere

- genereret

- genererer

- få

- Git

- GitHub

- Giv

- given

- giver

- Global

- Go

- Goes

- tilskud

- gruppe

- Have

- sundhedspleje

- hende

- højere

- besidder

- Hosting

- Hvordan

- How To

- HTML

- http

- HTTPS

- ID

- Identity

- if

- gennemføre

- importere

- in

- omfatter

- Herunder

- indeks

- Infrastruktur

- i første omgang

- initiativer

- indgange

- installere

- installeret

- instans

- anvisninger

- Integrerer

- Intelligens

- Internet

- ind

- indføre

- IT

- Job

- Karriere

- jpg

- json

- Nøgle

- nøgler

- etiket

- sø

- landskab

- senere

- seneste

- læring

- Led

- gearede

- Livet

- Life Sciences

- Line (linje)

- log

- langsigtet

- maskine

- machine learning

- Main

- vedligeholde

- lave

- lykkedes

- ledelse

- Produktion

- Margin

- Masse

- herres

- mekanisme

- møde

- Menu

- Flet

- Metrics

- mangler

- ML

- MLOps

- model

- modellering

- modeller

- ændre

- Moduler

- Moments

- Overvåg

- overvåges

- overvågning

- mere

- flere

- navn

- Som hedder

- navngivning

- Navigation

- Behov

- behov

- behov

- Ny

- næste

- normal

- notesbog

- underretning

- meddelelser

- nummer

- bedøvet

- of

- tit

- on

- ONE

- Produktion

- or

- ordrer

- organisationer

- Andet

- ud

- uden for

- i løbet af

- oversigt

- egen

- pakke

- side

- Smerte

- pandaer

- brød

- del

- dele

- Bestået

- lidenskab

- lidenskabelige

- Mønster

- ydeevne

- Tilladelser

- fotografering

- plukket

- picks

- pipeline

- perron

- plato

- Platon Data Intelligence

- PlatoData

- punkter

- politikker

- politik

- Indlæg

- praksis

- forudsige

- Forudsigelser

- Forbered

- forudsætninger

- tidligere

- Main

- Forud

- privilegier

- behandle

- forarbejdning

- produktion

- Produkter

- professionel

- projekt

- fremme

- fremmes

- forfremmelse

- give

- forudsat

- giver

- leverer

- bestemmelse

- offentligt

- Sweatre & trøjer

- Forfølger

- Skub ud

- Python

- hurtigt

- hurtigt

- Raw

- Læs

- klar

- virkelige verden

- region

- register

- registreret

- registre

- register

- lovgivningsmæssige

- relaterede

- forhold

- Fjern

- Repository

- anmode

- påkrævet

- Krav

- ressource

- Ressourcer

- svar

- detail

- afkast

- Riverside

- roller

- roller

- rod

- Herske

- regler

- Kør

- løber

- sagemaker

- SageMaker Pipelines

- samme

- Gem

- gemt

- skalerbar

- scenarie

- planlægge

- planlagt

- planlægning

- Videnskab

- VIDENSKABER

- Videnskabsmand

- script

- scripts

- problemfrit

- Anden

- Sektion

- sikker

- sikkerhed

- se

- send

- afsendelse

- sender

- sendt

- adskille

- server

- tjeneste

- Tjenester

- sæt

- indstillinger

- setup

- Shape

- Del

- hun

- bør

- Vis

- fremvist

- vist

- Shows

- Simpelt

- uddrag

- So

- løsninger

- Løsninger

- Løsning

- Kilde

- Kilder

- Space

- specialiserede

- specifikke

- delt

- Tilstand

- Statement

- statisk

- Status

- Trin

- Steps

- Stadig

- butik

- opbevaret

- forhandler

- String

- struktur

- Studio

- vellykket

- sådan

- Understøtter

- mål

- hold

- telecom

- terraform

- prøve

- Test

- at

- Them

- derefter

- Der.

- Disse

- ting

- Tredje

- tredjepart

- denne

- tre

- Gennem

- tid

- til

- værktøjssæt

- top

- emne

- spor

- Tog

- uddannet

- Kurser

- Transform

- udløse

- udløst

- udløsning

- sand

- Stol

- TUR

- to

- ui

- under

- universitet

- University of California

- Opdatering

- opdateret

- uploadet

- URL

- us

- brug

- anvendte

- ved brug af

- nytte

- Værdier

- forskellige

- udgave

- versioner

- via

- video

- synlig

- Ur

- we

- web

- webservices

- hvornår

- når

- ud fra følgende betragtninger

- som

- mens

- vilje

- med

- inden for

- uden

- Arbejde

- arbejdede

- workflow

- arbejder

- virker

- skriver

- skriftlig

- Du

- Din

- youtube

- zephyrnet