Et individs helbred er et utroligt personligt emne, og at gå til lægen kan være en skræmmende og stressende oplevelse. Dette gælder især for mennesker, der er en del af grupper, som det medicinske system historisk set har svigtet. Disse strukturelle problemer i sundhedsvæsenet har gennemsyret de algoritmer, der i stigende grad bliver brugt i diagnosticering og behandling af patienter. CCC organiserede et panel, "Health Equity: How Can Algorithms and Data Mitigate, Not Exacerbate, Harms?" der behandlede disse spørgsmål. Paneldeltagerne var Dr. Amaka Eneanya (Fresenius Medical Care), Dr. Mona Singh (Princeton University), Dr. Melanie Moses (University of New Mexico) og Dr. Katie Siek (Indiana University).

Et individs helbred er et utroligt personligt emne, og at gå til lægen kan være en skræmmende og stressende oplevelse. Dette gælder især for mennesker, der er en del af grupper, som det medicinske system historisk set har svigtet. Disse strukturelle problemer i sundhedsvæsenet har gennemsyret de algoritmer, der i stigende grad bliver brugt i diagnosticering og behandling af patienter. CCC organiserede et panel, "Health Equity: How Can Algorithms and Data Mitigate, Not Exacerbate, Harms?" der behandlede disse spørgsmål. Paneldeltagerne var Dr. Amaka Eneanya (Fresenius Medical Care), Dr. Mona Singh (Princeton University), Dr. Melanie Moses (University of New Mexico) og Dr. Katie Siek (Indiana University).

Dr. Eneanya indledte panelet med at diskutere, hvordan en ligning systematisk undervurderede nyresygdomse i sorte amerikanere i årtier. Hun forklarede, at i USA bliver alle patienter, der har en nyresygdom, registreret i et register. Forekomsten af sygdommen er generelt steget i de seneste årtier, og for sorte individer har den tendens til at være endnu mere udbredt og alvorlig.

Dr. Eneanya skitserede disse racemæssige/etniske forskelle i risikofaktorer for kronisk nyresygdom (CKD) og resultater (Eneanya ND et al. Natur Rev Neph. 2021, United States Renal Data System.):

- Forekomsten af diabetes er højest blandt sorte individer sammenlignet med andre racegrupper

- Sorte og latinamerikanske individer diagnosticeres i yngre aldre sammenlignet med hvide individer

- Sorte individer har signifikant højere forekomster af hypertension sammenlignet med hvide individer

- Hypertensionskontrol er mindre blandt sorte og latinamerikanske individer sammenlignet med hvide individer

- Sorte individer er mindre tilbøjelige til at modtage nefrologisk behandling før dialysestart sammenlignet med andre racegrupper

- Risiko for at udvikle nyresvigt, der kræver dialyse eller nyretransplantation

- 4 gange højere hos sorte versus hvide individer

- 1.3 gange højere hos latinamerikanske versus hvide individer

- Sorte individer er mindre tilbøjelige til at modtage nyretransplantation sammenlignet med andre racegrupper

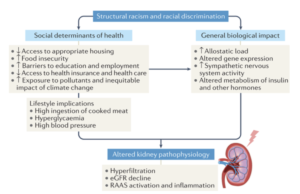

Strukturel racisme bidrager til dårlige helbredsresultater fra nyrerelaterede sygdomme, uddybede Dr. Eneanya (Eneanya ND et al. Natur Rev Neph. 2021.):

Hvilke livsstilsvaner du har råd til – såsom hvad du spiser, og biologiske påvirkninger som stress fra racisme og diskrimination fører alle til metaboliske ændringer i kroppen, som kan føre til nedsat nyrefunktion.

Dr. Eneanya drejede sig om et eksempel på, hvordan en algoritme, der i øjeblikket bruges af klinikere, har konsekvenser i den virkelige verden. eGFR-ligningen er en algoritme, der bruges til at bestemme, hvor stærk en patients nyrefunktion er. En højere eGFR repræsenterer bedre nyrefunktion. En patients eGFR-niveau afgør, om de er berettiget til visse behandlinger, og måske mest afgørende, en nyretransplantation. Algoritmen viser dog, at en sort og ikke-sort person, der er af samme alder, køn og har samme kreatininmål (en blodprøve, der måler nyrefunktionen), har forskellige eGFR-niveauer. Algoritmen beregner, at en sort person har en højere eGFR, angiveligt overlegen nyrefunktion, end den ikke-sort person. Dette begrænser den behandling, de er berettiget til, og betyder, at de skal være mere syge for at modtage den hjælp, de burde have ret til.

Dr. Eneanya forklarede historien om algoritmen, der afslører, hvorfor den beregner på denne forkerte måde: en undersøgelse fra 1999 tilskrev højere serumkreatinin til sorte personer på grund af den forkerte antagelse om, at de havde højere muskelmasse. Undersøgelsen udviklede den første eGFR-ligning brugt i USA og inkorporerede en "Sort race" multiplikationsfaktor, der forårsager højere eGFR blandt sorte individer. Brugen af eGFR er problematisk, fordi klinikere er overladt til at bedømme en persons race baseret på udseende eller medicinske journaler (der kan have race opført som en antagelse, der er tilbage fra en tidligere kliniker). Der er heller ikke en sondring for blandet race individer, eller en metode til at klassificere dem.

Dr. Eneanya var forfatter til en artikel, der ændrede, hvordan eGFR beregnes i sundhedsvæsenet ved at slå til lyd for en ligning, der ikke tager race med i estimeringen (Inker LA, Eneanya ND, et al. NEJM 2021, Delgado C, et al. JASN 2021). Dr. Eneanya og hendes kolleger vendte tilbage til den oprindelige undersøgelse fra 1999 og fjernede racen fra ligningen og ombyggede den med andre input. I dag bruger ⅓ af hospitaler og klinikker i USA den nye ligning, og United Network for Organ Sharing (UNOS) begrænsede især alle transplantationscentre fra at bruge den racebaserede ligning i juni 2022. De tog det et skridt videre i januar 2023 og erklærede, at alle amerikanske transplantationscentre er forpligtet til at gennemgå alle sorte patienter på ventelisten til nyretransplantation og ændre deres ventelistetid, hvis den blev påvirket af den racebaserede eGFR-ligning. Dr. Eneanya specificerede, at mens UNOS er en del af den føderale regering, var regeringen ikke direkte involveret i beslutningen om at forbyde brugen af den racebaserede ligning.

Ud over den universelle vedtagelse af den nye eGFR-ligning havde Dr. Eneanya et par flere fremtidige tilgange, som hun ser som nøglen til lige adgang til behandling af nyresygdom:

- Udvikle politikker og processer for at forbedre adgangen til forebyggende behandling af kroniske nyresygdomme

- Udvikle politikker for at øge adgangen til nyretransplantation

- Undersøg miljøeffekter (f.eks. stress, diskrimination) på nyrefunktion og sygdomsprogression

- Gennemsigtighed i at diskutere nyrefunktionsbestemmelse med patienter (herunder begrænsninger af eGFR-ligninger)

Dr. Eneanya uddybede, at det at drille stereotyper om sort race går ud på at fjerne fejlslutninger og falske nyheder, der ikke har noget videnskabeligt grundlag. For eksempel ændres medicinstudiets læseplaner for at vise, at der ikke er noget antropologisk grundlag for, at der er mere muskelmasse i en race frem for en anden. Medierne har også gjort et godt stykke arbejde med at dele denne knuste myte, og Dr. Eneanya konsulterede endda om en episode af Grey's Anatomy, der fremhævede de ødelæggende virkninger af eGFR-ligningen for sorte patienter med behov for en nyretransplantation.

Dr. Singh fortsatte samtalen om sundhedsforskelle ved at forklare, at sorte individer i USA har højere kræftdødelighed sammenlignet med hvide individer. Dette faktum eksemplificerer, at der er mange udfordringer, som medicinske fagfolk og computerforskere skal stå over for, og der er også mange muligheder for at udvikle metoder, der ikke udvider eksisterende uligheder.

Dr. Singh forklarede først kræftens biologi: "Kræft er en sygdom, hvor vores egne celler får mutationer, der tillader dem at vokse ukontrolleret. Så hvis vi ønsker at forstå den molekylære underbygning af kræft i ethvert ET individ, kan vi se på genomerne af hans eller hendes kræftceller og hans eller hendes ikke-kræftceller og sekvens. Når vi har sekventeret normale celler og kræftceller, kan vi sammenligne genomerne og afdække, hvilke mutationer vi har erhvervet i kræftceller, og det kan give os et hint om, hvilke ændringer der kan være dem, der er relevante for den enkeltes kræftsygdom. Det er præcis, hvad der er blevet gjort i de sidste 15 år eller deromkring, hvor tumorerne fra titusindvis af individer er blevet sekventeret og mutationer i dem identificeret."

Stort set alle kender nogen, der har fået konstateret kræft, og der findes ingen universel kur. Dr. Singh diskuterede dog løftet om præcision onkologi, hvor en videnskabsmand sekvenserer en patients tumor, identificerer deres DNA-mutationer og udfører computeranalyse for at bestemme, hvilke ændringer der kan målrettes mod. Immunterapi er en tilgang til at udnytte en persons eget immunsystem til at målrette deres tumorer. En lovende op og kommende immunterapi er at designe vacciner, der er tilpasset hver enkelt person, og disse vacciner fremkalder et immunrespons på deres tumorer.

Dr. Singh forklarer, hvordan dette fungerer, er, at hvert af vores immunsystemer har 6 forskellige kopier af det klassiske major histocompatibility complex (MHC) klasse I gener. Der er over 13,000 forskellige MHC-varianter af disse gener, så hver person har et andet sæt af MHC-gener. Nogle mutationer i kræftceller resulterer i "fremmede" proteiner, og nogle af disse kan bindes af et individs MHC'er. Disse komplekser af MHC bundet med et fragment af cancer-afledt protein genkendes af immunceller og kan aktivere et immunrespons. Dette er meget personligt, da hvert individs tumor kan have forskellige mutationer, og hvert individ har forskellige MHC'er. Forskere bruger maskinlæring til at forudsige, hvilke MHC-varianter der binder hvilke peptider, hvilket forhåbentlig vil fremme effektiviteten af immunterapi og i sidste ende føre til design af personlige neoantigen-vacciner.

Udvalget af MHC-gener varierer meget over hele kloden, uddyber Dr. Singh. De fleste MHC-alleler har ingen bindingsdata forbundet med dem, og dem, der har data om deres binding, er partiske til fordel for nogle racegrupper. Det er vigtigt, når man tester et datasæt, ikke kun at fokusere på den overordnede ydeevne, men også at overveje subpopulationer af data, så alle har lige adgang til de potentielle fordele ved denne forskning.

Træningssættet skal analyseres for bias, inden det anvendes. Desuden kan metoder til at estimere ydeevne på usete data afsløre skævhed i de data, det blev trænet på. Indsamling af data på en objektiv måde er afgørende for at begrænse muligheden for bias senere i brugen af algoritmen. Områder for fremtidigt arbejde med dette emne fokuserer på alternative træningsprocedurer og algoritmiske strategier for målrettet dataindsamling. Overordnet set er det afgørende at prioritere udviklingen af retfærdige præcisionsmedicinske tilgange, så terapier og forskning nedstrøms er retfærdige.

Dr. Moses talte derefter, og hun kontekstualiserede, hvordan eGFR- og MHC-peptidbindingsalgoritmerne passer ind i et større økosystem af, hvordan medicinske algoritmer påvirker sociale resultater. Hun forklarer, at videnskabsmænd bruger algoritmer og kunstig intelligens til at forudsige resultater, vi holder af, fra proxyer, der let kan måles, og disse proxyer kan være unøjagtige. For at gøre medicinske algoritmer endnu mere komplicerede interagerer de konstant med hinanden på uforudsigelige måder, så det fulde omfang af algoritmer til diagnosticering af en patient er typisk uklart. Derfor er det afgørende at bruge algoritmer med forsigtighed, især fordi når algoritmerne fejler, kan de være mest skadelige for de mest sårbare.

At finde ud af, hvem en algoritme påvirker og hvorfor er en vigtig del af medicinsk retfærdighed. Dr. Moses tager et skridt tilbage og definerer egenkapital. Den fælles grafik bruges til at skelne lighed fra lighed, hvor individer med 3 forskellige højder kæmper for at se en baseballkamp og forskellige måder at støtte dem på, er fejlbehæftet selv på det 3. billede, der fjerner barrieren, fordi det antyder, at der er noget iboende for personen med hensyn til hvorfor de har brug for støtten frem for sociale årsager, som kan have forårsaget uligheden i første omgang.

Dr. Moses viste en alternativ grafik til at definere, hvordan retfærdighed ser ud i et samfund med systemiske uretfærdigheder (Copyright 2020 af Nicolás E. Barceló og Sonya Shadravan (kunstner: Aria Ghalili)):

Denne grafik afslører, at ikke alle kan drage fordel af bare at barrieren fjernes, men der er dybt rodfæstede problemer, der skal håndteres for at opnå retfærdighed.

Dataforskere bør altid have denne vigtige kontekst i tankerne, hævder Dr. Moses. Det er ofte svært at identificere de antagelser, der var til stede i skabelsen af algoritmer, selv med de mest ligetil algoritmer. Det er også nemt at bruge en statistisk korrelation til at forudsige et udfald og antage, at korrelation er lig med årsagssammenhæng, men det er en fejlslutning.

Dr. Moses fortsætter med at give konkrete eksempler på ulige algoritmer, der er i brug i samfundet i dag på andre områder. For eksempel algoritmer i strafferetssystemet, der erstatter pengekaution for varetægtsfængsling. Hensigten er, at processen skal være en datadrevet, objektiv metode til at tilbageholde dem, der er en fare eller højrisiko for ikke at møde op til retssagen. Algoritmerne har dog mange mangler i både algoritmens evne til at lave retfærdige og præcise forudsigelser og biaserne i det system algoritmen er en del af, herunder biased input og biased fortolkninger af output. Et andet eksempel på, hvordan racemæssig skævhed foreviges i det strafferetlige system af algoritmer, er software til ansigtsgenkendelse. Mens ansigtsgenkendelse har vist sig at være mindst præcis til at identificere mørkere kvindelige ansigter, er det sorte mandlige ansigter, der oftest er blevet fejlidentificeret af disse algoritmer, hvilket fører til falske anholdelser. Dette viser, hvordan skævhed, der mest påvirker én gruppe (sorte kvinder) med hensyn til nøjagtig klassificering, kan have størst indflydelse på en anden gruppe (sorte mænd) på grund af skævheder i det strafferetlige system

Algoritmer kan forværre menneskelig skævhed og kan også afvises, hvis de ikke forstærker den bedømmelse, du ville have foretaget uden at konsultere algoritmen. Dette gælder også i forudindtaget algoritmer i medicin. For eksempel er pulsoximetre mindre nøjagtige til at detektere iltniveauer i mørkere hud, hvilket kan resultere i underdiagnosticering af luftvejssygdomme som alvorlig COVID. At bruge mængden af penge brugt på sundhedspleje som en proxy for, hvor sund en person er, er en anden urimelig foranstaltning. Eksemplerne Dr. Eneanya og Dr. Singh beskrev, eGFR nedsat nyrefunktion hos afroamerikanere og genomiske datasæt, der overrepræsenterer europæisk herkomst, er andre fremtrædende eksempler på forudindtaget algoritmer i medicin, der har farlige nedstrømskonsekvenser for de mennesker, der er berørt. eGFR-ligningen blev brugt til at identificere fanger, der var syge nok til at blive løsladt fra fængslet under COVID, hvilket resulterede i, at en afroamerikansk mand blev nægtet løsladelse, fordi hans nyrefunktion var overvurderet.

Feedback kan forbedre algoritmer eller forværre deres skader. Algoritmer er ikke en ensrettet gade, da de har til formål at forudsige adfærd ud fra data, og et års forudsigelse påvirker det næste års data. Algoritmer bør sigte mod at mindske skævheder over tid; f.eks. bør høringer om kaution hjælpe tiltalte med at møde op til retssagen i stedet for at forudsige fejl; Politiet bør sigte mod at reducere både kriminalitet og falske anholdelser. Algoritmer, der bruges på tværs af domæner, bør aldrig være hugget i sten, fordi der vil være feedback mellem mennesker, algoritmer og social kontekst.

Dr. Moses foreslog også yderligere veje fremad: fjern bias fra datasæt, sætter spørgsmålstegn ved antagelser, vend (ikke forstærk) systemisk bias, evaluer med en mangfoldighed af perspektiver, kræve gennemsigtige og forklarlige algoritmer og brug gradvise, adaptive implementeringer. Den almindelige opfattelse er, at algoritmer på en eller anden måde fjerner bias, men i virkeligheden kodificerer de ofte bias, og vi skal være på vagt over for algoritmer og deres resultater.

Den sidste del af panelet var en Q&A. Moderator Dr. Siek startede sessionen med at spørge, "hvordan kan algoritmer og data ikke forværre skaderne?"

- Dr. Eneanya: Hvis en forsker stopper med race, når han leder efter differentiatorer i en algoritme, er det doven og videnskabeligt ugyldigt. Genetisk ligner mennesker mere mellem racer end inden for. Det er vigtigere at tænke på biologiske egenskaber, der faktisk påvirker et menneskeligt system som nyrer. For eksempel bør forskere, når de tester pulsoximetret, have rådført sig med en hudlæge for at teste og validere pulsoximetre baseret på forskellige hudtoner – i stedet for at bruge én type enhed til personer med forskellige hudtoner.

- Dr. Moses: Vi bør bruge den samme tilgang til at validere algoritmer, efter at de er blevet taget i brug. At anerkende race som en social konstruktion gør det muligt at bemærke raceblinde undersøgelser har indflydelse. Det er vigtigt at se efter skelnen mellem grupper for at identificere potentielle forskelle, som algoritmen forstærker. Skal du vurdere, om algoritmen minimerer problemer eller gør den bedre?

- Dr. Singh: Race bør aldrig bruges som input, men det kan bruges til at evaluere output for bias. Hvis vi ikke tænkte på race, ville vi ikke engang kunne sige, at der er sundhedsmæssige forskelle. Indsamling af genomiske data og kategorisering efter herkomst er også en mangelfuld metode. Vi skal sørge for at vurdere, om metoder fungerer godt på tværs af befolkninger.

- Dr. Eneanya: Når vi diversificerer en undersøgelsespopulation, er vi nødt til at bevæge os væk fra kun at bringe grupper af hvide eller sorte mennesker ind. Vi er nødt til at se på flere forskelle inden for disse grupper såsom faktorer som social status, køn, seksualitet osv. Vi skal se på hele billedet og ikke kun mangfoldighedsdatasæt baseret på race.

- Dr. Moses: Algoritmer er præcis den type værktøjer, der skal hjælpe os med at gøre det, der er en masse potentielle computerstrategier, der kan hjælpe.

- Dr. Singh: Jeg er enig i, at algoritmer spiller en stor rolle her, så hvordan prioriterer vi dataindsamling? Vi er nødt til at tænke meget nøje over, hvordan vi gør det.

Et publikumsmedlem spurgte derefter: "I betragtning af det store hastværk med at udvikle algoritmer baseret på nuværende datasæt med skævheder, er der måder at modvirke skævhed i algoritmen ud over at slippe af med skævheder i datasættet?"

- Dr. Singh: Det er svært at overvinde bias i et datasæt; det er et aktivt forskningsområde. Det er nemt at over- eller underprøve data. Der er forskellige måder at træne ML-modeller på, hvor det overordnede mål (typisk en funktion du forsøger at minimere, normalt ved at bruge hele datasættet) er hvordan optimering skal se ud.

- Dr. Eneanya: Mange medicinske algoritmer anses for at skulle inkludere race for at være mere præcise. Men folk er nødt til kritisk at undersøge, hvorfor race bliver introduceret i første omgang? Fjernelse af race som en variabel ændrer muligvis ikke algoritmens ydeevne så meget, som du måske tror. Betyder det noget (klinisk), når resultaterne kun ændres med en lille smule efter at have fjernet en variabel såsom race?

- Dr. Singh: Det betyder især ikke noget, når dit træningssæt og det sæt, du bruger det på, er meget forskellige.

Dr. Siek tilskyndede paneldeltagerne med et andet spørgsmål: "Hvis vi kunne gøre det hele igen, hvad ville vi så gøre anderledes?"

- Dr. Eneanya: At stoppe med race, når man vurderer årsager til forskelle i sundhedsresultater, burde ikke være sket. For eksempel med kreatininniveauer, bør vi tænke på, hvad der ellers kan påvirke kreatinin? Vi har brug for bedre datasæt, hvilket kræver opbygning af tillid til lokalsamfund. Dette kan ligne at forbedre mangfoldigheden af forsøgspopulationer, evaluere, hvordan dit studiepersonale ser ud, osv. National Institute of Health-bevillinger kræver i stigende grad lokalsamfundsbaserede partnere og sundhedslighedsspecialister som en del af forskerholdet. Vi skal ændre de gamle sæt, men skal også bygge bedre sæt i fremtiden. Vi kan kun gøre så meget ved at prøve at omkonfigurere det, der er derude.

- Dr. Moses: Ud over hvad vi kunne gøre, hvis vi genstartede, kan jeg godt lide at tænke på algoritmer som spejle af samfundet. De trænes af alle på internettet. Ved at bruge det som input til det næste niveau af algoritme kan vi bestemme, hvor skævhederne er, hvorfor de er der, og hvad den fremtidige påvirkning er. Vi er nødt til at spørge, hvordan man bruger disse kvantitative værktøjer til at finde ud af, hvordan man løser disse situationer i stedet for at forværre dem.

- Dr. Singh: Mange genomer, der er blevet indsamlet, repræsenterer ikke befolkningen som helhed. Vi skal starte med involvering fra forskellige grupper af mennesker.

Det sidste publikumsspørgsmål var: "Indtil vi når et punkt, hvor vi har et komplet genomisk billede af alle mennesker, vil der være entusiasme for at bruge ML og algoritmer. Hvad er virkelige ting på peer review-niveau, som vi kan gøre nu, så vi ikke skal rette dem om 30 år?”

- Dr. Eneanya: Perfekt er det godes fjende. Vi skal gøre det bedste, vi kan. Vi kan identificere skævheder og derefter gøre det bedste, vi kan fremadrettet. Der findes barrierer, som ikke har noget at gøre med kliniske algoritmer. Bare det at fikse eGFR-algoritmen ved at slippe af med race vil ikke løse nyresygdomsforskelle. Der skal arbejdes meget med multivariable aspekter af undertrykkelse.

- Dr. Moses: Det arbejde du [Dr. Eneanya] har gjort for at omkonstruere algoritmen for alle er præcis, hvordan man kommer videre. Vi er nødt til at rette op på systemet. Bruger også det faktum, at det skulle ordnes; det var let at se bias skrevet ind i ligningen. Nyreligningen tjener som et spejl for et samfund, der tillod race at blive kodet på en måde, der stillede afroamerikanere dårligere i årtier. Forspændingen i den ligning var eksplicit og bevidst. Det vil være meget sværere at identificere bias i mere komplekse algoritmer i fremtiden.

Hold øje med endnu en AAAS 2023 CCC-sponsoreret panelrecap!

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- Platoblokkæde. Web3 Metaverse Intelligence. Viden forstærket. Adgang her.

- Kilde: https://feeds.feedblitz.com/~/733934357/0/cccblog~Health-Equity-How-Can-Algorithms-and-Data-Mitigate-Not-Exacerbate-Harms-AAAS-Panel-Recap/

- :er

- $OP

- 000

- 1

- 1999

- 2020

- 2021

- 2022

- 2023

- 7

- a

- evne

- I stand

- Om

- adgang

- præcis

- opnå

- erhverve

- erhvervede

- tværs

- aktiv

- faktisk

- Yderligere

- Tilføjer

- Vedtagelse

- fremme

- fortaler

- påvirke

- afrikansk

- Efter

- Ages

- AI

- AL

- algoritme

- algoritmisk

- algoritmer

- Alle

- tillader

- alternativ

- altid

- amerikansk

- Amerikanerne

- blandt

- beløb

- analyse

- anatomi

- ,

- En anden

- vises

- anvendt

- tilgang

- tilgange

- ER

- OMRÅDE

- områder

- hævder

- luft

- anholdelser

- artikel

- kunstner

- AS

- aspekter

- forbundet

- antagelse

- At

- publikum

- forfatter

- tilbage

- kaution

- Forbyde

- barriere

- barrierer

- Baseball

- baseret

- grundlag

- BE

- fordi

- begyndte

- være

- gavner det dig

- fordele

- BEDSTE

- Bedre

- mellem

- Beyond

- skævhed

- binde

- binding

- biologi

- Bit

- Sort

- blod

- krop

- Bound

- Bringe

- bygge

- Bygning

- by

- beregnet

- beregner

- CAN

- Kræft

- Kræftceller

- hvilken

- omhyggeligt

- kategorisere

- forårsagede

- årsager

- ccc

- Celler

- Centers

- vis

- udfordringer

- lave om

- Ændringer

- skiftende

- karakteristika

- klasse

- klassificering

- Klassificere

- Klinisk

- klinikere

- kolleger

- Indsamling

- samling

- kommer

- Fælles

- Fællesskaber

- Fællesskabsbaseret

- sammenligne

- sammenlignet

- fuldføre

- komplekse

- kompliceret

- computing

- Konsekvenser

- Overvej

- konstant

- konstruere

- rådgivning

- sammenhæng

- fortsatte

- fortsætter

- kontrol

- Samtale

- ophavsret

- Korrelation

- kunne

- Covid

- skabelse

- Kriminalitet

- Criminal

- afgørende

- afgørende

- helbrede

- Nuværende

- For øjeblikket

- FARE

- Dangerous

- data

- datasæt

- datasæt

- datasæt

- årtier

- beslutning

- falde

- dyb

- tiltalte

- definerer

- Efterspørgsel

- demonstrerer

- implementeringer

- beskrevet

- Design

- tilbageholdelse

- beslutsomhed

- Bestem

- bestemmer

- ødelæggende

- udvikle

- udviklet

- udvikling

- Udvikling

- enhed

- Diabetes

- forskelle

- forskellige

- differentiere

- svært

- direkte

- diskonteret

- drøftet

- diskuterer

- Sygdom

- sygdomme

- forskelligartede

- Mangfoldighed

- dna

- Doctor

- Er ikke

- Domæner

- Dont

- ned

- drevet

- i løbet af

- e

- hver

- nemt

- spiser

- økosystem

- effekter

- uddybet

- berettiget

- eliminere

- nok

- indtastet

- entusiasme

- miljømæssige

- lighed

- Lig

- ligninger

- egenkapital

- især

- væsentlig

- skøn

- etc.

- europæisk

- evaluere

- evaluere

- Endog

- alle

- præcist nok

- eksempel

- eksempler

- eksemplificerer

- eksisterende

- erfaring

- forklarede

- forklarer

- Forklarer

- Ansigtet

- ansigter

- ansigtsbehandling

- ansigtsgenkendelse

- faktorer

- FAIL

- mislykkedes

- Manglende

- retfærdig

- falsk

- falske nyheder

- favorisere

- Federal

- Føderale regering

- tilbagemeldinger

- kvinde

- få

- Figur

- endelige

- Fornavn

- passer

- Fix

- fast

- fejlbehæftet

- Fokus

- fokusering

- Til

- Videresend

- fra

- fuld

- funktion

- yderligere

- Endvidere

- fremtiden

- spil

- Køn

- få

- få

- Giv

- Give

- kloden

- mål

- gå

- godt

- godt arbejde

- Regering

- gradvis

- tilskud

- Grafisk

- størst

- gruppe

- Gruppens

- Grow

- skete

- Hård Ost

- skadelig

- skader

- seletøj

- Have

- Helse

- sundhedstilskud

- sundhedspleje

- sund

- højder

- hjælpe

- link.

- høj risiko

- højere

- højeste

- Fremhævet

- stærkt

- historisk

- historie

- Forhåbentlig

- sygehuse

- Hvordan

- How To

- Men

- HTTPS

- kæmpe

- menneskelig

- Mennesker

- Hypertension

- i

- identificeret

- identificerer

- identificere

- identificere

- billede

- Immunsystemet

- immunterapi

- KIMOs Succeshistorier

- påvirket

- Påvirkninger

- leverfunktion

- vigtigt

- Forbedre

- forbedring

- in

- I andre

- forkert

- omfatter

- Herunder

- Incorporated

- Forøg

- øget

- stigende

- utroligt

- individuel

- enkeltpersoner

- iboende

- indgang

- instans

- Institut

- hensigt

- interaktion

- Internet

- skræmmende

- introduceret

- involverede

- involvering

- spørgsmål

- IT

- januar

- Job

- dommer

- Retfærdighed

- Holde

- Nøgle

- nyre

- stor

- større

- føre

- førende

- læring

- sidesten

- Niveau

- niveauer

- livsstil

- ligesom

- Sandsynlig

- GRÆNSE

- begrænsninger

- grænser

- Børsnoterede

- Se

- ligner

- leder

- UDSEENDE

- Lot

- maskine

- machine learning

- lavet

- større

- lave

- Making

- mand

- måde

- mange

- Masse

- max-bredde

- midler

- måle

- foranstaltninger

- Medier

- medicinsk

- lægebehandling

- medicin

- medlem

- Hudpleje

- metode

- Metode

- metoder

- Mexico

- måske

- tankerne

- minimering

- spejl

- afbøde

- blandet

- ML

- modeller

- ændre

- molekylær

- Monetære

- penge

- mere

- mest

- bevæge sig

- komme videre

- flytning

- national

- Natur

- Behov

- behøve

- behov

- netværk

- Ny

- nyheder

- næste

- normal

- især

- of

- ofte

- Gammel

- on

- ONE

- Muligheder

- Opportunity

- optimering

- ordrer

- Organiseret

- original

- Andet

- Resultat

- skitseret

- samlet

- Overvind

- egen

- Oxygen

- panel

- del

- partnere

- forbi

- patient

- patienter

- peer

- Mennesker

- opfattelsen

- perfekt

- ydeevne

- udfører

- måske

- person,

- personale

- Personlig

- perspektiver

- billede

- Place

- plato

- Platon Data Intelligence

- PlatoData

- Leg

- Punkt

- politikker

- politiarbejde

- fattige

- befolkning

- populationer

- potentiale

- brug

- præcist

- Precision

- forudsige

- forudsigelse

- Forudsigelser

- præsentere

- fremherskende

- tidligere

- Forud

- Prioriter

- fængsel

- fanger

- problemer

- procedurer

- behandle

- Processer

- professionelle partnere

- fremtrædende

- løfte

- lovende

- foreslog

- Protein

- Proteiner

- proxy

- puls

- sætte

- Spørgsmål og svar

- kvantitativ

- spørgsmål

- Løb

- race bias

- racisme

- priser

- hellere

- ægte

- virkelige verden

- Reality

- årsager

- resumé

- modtage

- nylige

- anerkendelse

- anerkendt

- optegnelser

- reducere

- register

- styrke

- frigive

- frigivet

- relevant

- Fjern

- fjernet

- fjernelse

- erstatte

- repræsentere

- repræsenterer

- påkrævet

- Kræver

- forskning

- forsker

- forskere

- svar

- genstartes

- begrænset

- resultere

- Resultater

- afsløre

- afslører

- vende

- gennemgå

- Rid

- Risiko

- risikofaktorer

- roller

- haste

- samme

- Skole

- videnskabelig

- Videnskabsmand

- forskere

- Sees

- Sequence

- Serum

- tjener

- Session

- sæt

- sæt

- svær

- deling

- bør

- Vis

- vist

- Shows

- betydeligt

- lignende

- situationer

- hud

- So

- Social

- Samfund

- Software

- SOLVE

- nogle

- Nogen

- noget

- specialister

- specificeret

- brugt

- Personale

- starte

- Starter

- Stater

- statistiske

- Status

- Trin

- STONE

- standsning

- ligetil

- strategier

- gade

- stress

- stærk

- strukturel

- Kæmper

- undersøgelser

- Studere

- emne

- sådan

- foreslår

- overlegen

- support

- systemet

- systemisk

- Systemer

- Tag

- tager

- mål

- målrettet

- hold

- vilkår

- prøve

- Test

- at

- Fremtiden

- deres

- Them

- derfor

- Disse

- ting

- tusinder

- tid

- til

- i dag

- også

- værktøjer

- emne

- Tog

- uddannet

- Kurser

- gennemsigtig

- behandling

- retssag

- sand

- Stol

- typer

- typisk

- Ultimativt

- afdække

- under

- underbygninger

- forstå

- Forenet

- Forenede Stater

- Universal

- universitet

- uforudsigelige

- us

- Brug

- brug

- sædvanligvis

- VALIDATE

- række

- versus

- Sårbar

- Vej..

- måder

- GODT

- Hvad

- Hvad er

- som

- mens

- hvid

- WHO

- Hele

- vilje

- med

- inden for

- uden

- Dame

- Arbejde

- virker

- ville

- skriftlig

- år

- Du

- Yngre

- Din

- zephyrnet