Amazon SageMaker giver et bredt udvalg af maskinlæringsinfrastruktur (ML) og modelimplementeringsmuligheder for at hjælpe med at opfylde dine ML-slutningsbehov. Det er en fuldt administreret service og integreres med MLOps-værktøjer, så du kan arbejde på at skalere din modelimplementering, reducere slutningsomkostninger, administrere modeller mere effektivt i produktionen og reducere driftsbyrden. SageMaker giver flere slutningsmuligheder så du kan vælge den mulighed, der passer bedst til din arbejdsbyrde.

Nye generationer af CPU'er tilbyder en væsentlig forbedring af ydeevnen i ML-inferens på grund af specialiserede indbyggede instruktioner. I dette indlæg sætter vi fokus på, hvordan du kan drage fordel af AWS Graviton3-baseret Amazon Elastic Compute Cloud (EC2) C7g-forekomster at hjælpe med at reducere slutningsomkostninger med op til 50 % i forhold til sammenlignelige EC2-tilfælde for inferens i realtid på Amazon SageMaker. Vi viser, hvordan du kan evaluere inferens-ydeevnen og skifte dine ML-arbejdsbelastninger til AWS Graviton-instanser med blot nogle få trin.

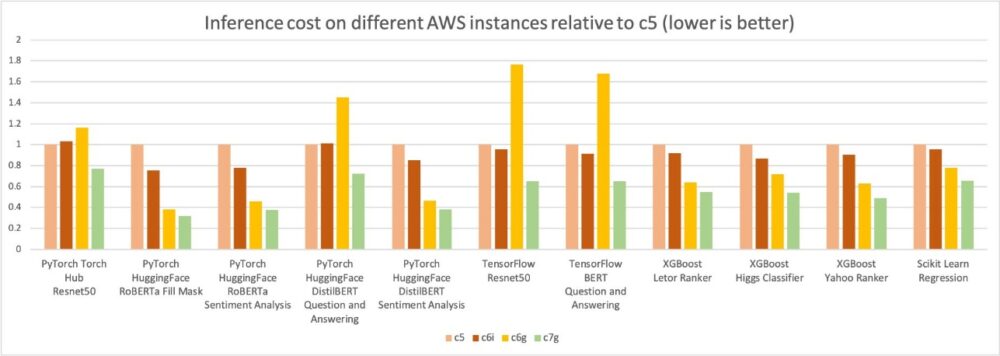

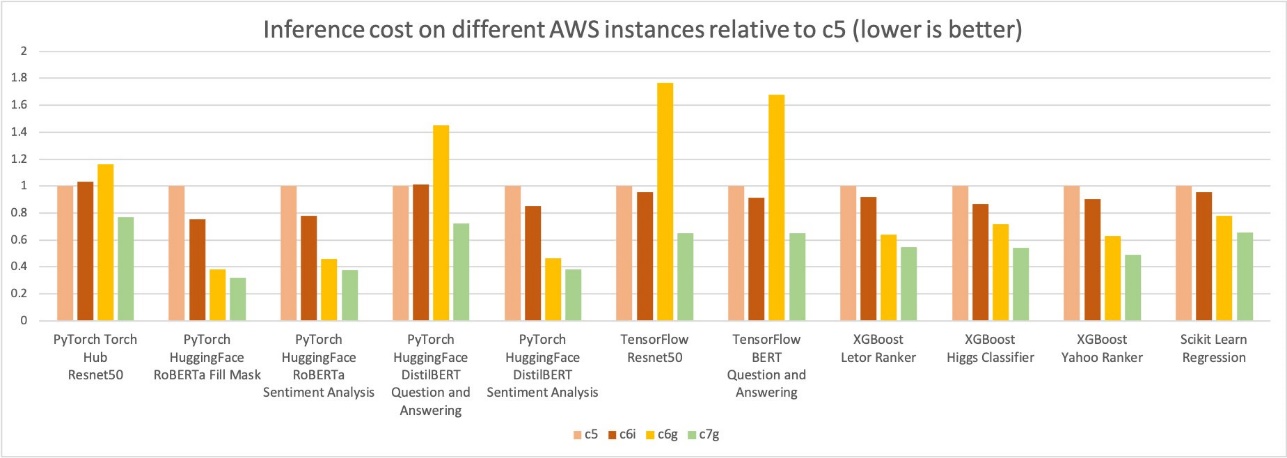

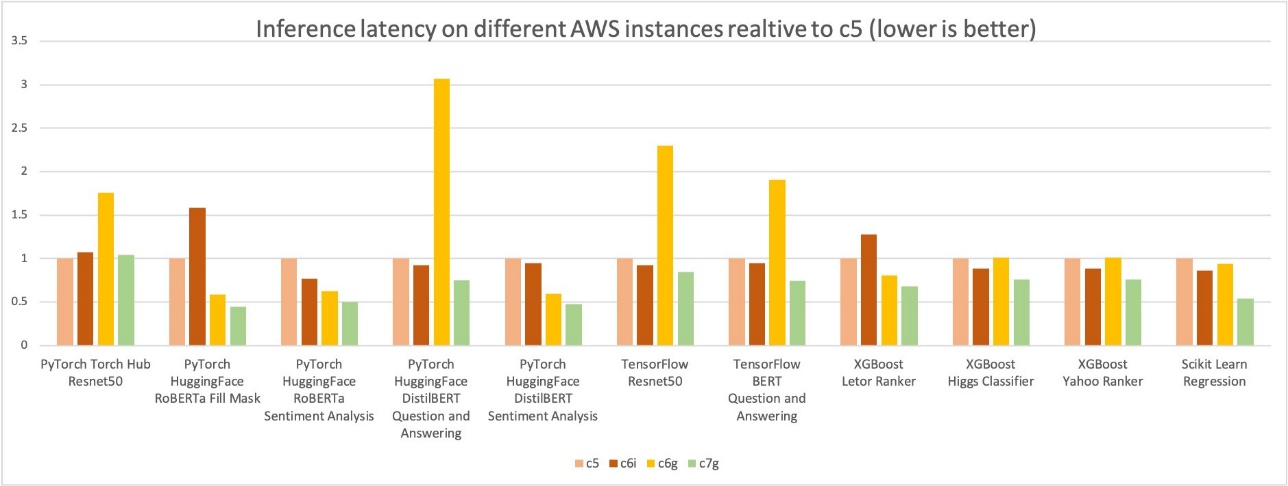

For at dække det populære og brede udvalg af kundeapplikationer diskuterer vi i dette indlæg slutningsydelsen af PyTorch, TensorFlow, XGBoost og scikit-learn frameworks. Vi dækker computersyn (CV), naturlig sprogbehandling (NLP), klassificering og rangeringsscenarier for modeller og ml.c6g, ml.c7g, ml.c5 og ml.c6i SageMaker-instanser til benchmarking.

Benchmarking resultater

AWS målte op til 50 % omkostningsbesparelser for PyTorch, TensorFlow, XGBoost og scikit-learn modelinferens med AWS Graviton3-baserede EC2 C7g-instanser i forhold til sammenlignelige EC2-instanser på Amazon SageMaker. Samtidig reduceres inferens latens også.

Til sammenligning brugte vi fire forskellige instanstyper:

Alle fire instanser har 16 vCPU'er og 32 GiB hukommelse.

I den følgende graf målte vi omkostningerne pr. million inferens for de fire instanstyper. Vi normaliserede yderligere omkostningerne pr. million inferensresultater til en c5.4xlarge instans, som måles som 1 på Y-aksen i diagrammet. Du kan se, at for XGBoost-modellerne er pris pr. million inferens for c7g.4xlarge (AWS Graviton3) omkring 50 % af c5.4xlarge og 40 % af c6i.4xlarge; for PyTorch NLP-modellerne er omkostningsbesparelserne omkring 30-50 % sammenlignet med c5 og c6i.4xlarge forekomster. For andre modeller og rammer målte vi mindst 30 % omkostningsbesparelser sammenlignet med c5 og c6i.4xlarge instanser.

I lighed med den foregående graf for sammenligningsomkostninger viser følgende graf model p90-latenstiden for de samme fire instanstyper. Vi normaliserede yderligere latensresultaterne til c5.4xlarge-instansen, som måles som 1 i diagrammets Y-akse. C7g.4xlarge (AWS Graviton3) modelinferenslatenstiden er op til 50 % bedre end latenserne målt på c5.4xlarge og c6i.4xlarge.

Migrer til AWS Graviton-instanser

For at implementere dine modeller til AWS Graviton-instanser kan du enten bruge AWS Deep Learning-containere (DLC'er) eller medbring selv containere der er kompatible med ARMv8.2-arkitekturen.

Migreringen (eller ny implementering) af dine modeller til AWS Graviton-instanser er ligetil, fordi AWS ikke kun leverer containere til værtsmodeller med PyTorch, TensorFlow, scikit-learn og XGBoost, men modellerne er også arkitektonisk agnostiske. Du kan også medbringe dine egne biblioteker, men vær sikker på, at din container er bygget med et miljø, der understøtter ARMv8.2-arkitekturen. For mere information, se Byg din egen algoritmebeholder.

Du skal udføre tre trin for at implementere din model:

- Opret en SageMaker-model. Dette vil blandt andre parametre indeholde oplysninger om modelfilens placering, den container, der vil blive brugt til udrulningen, og placeringen af inferensscriptet. (Hvis du allerede har en eksisterende model implementeret i en beregningsoptimeret inferensinstans, kan du springe dette trin over).

- Opret en slutpunktskonfiguration. Dette vil indeholde oplysninger om den type instans, du ønsker for endepunktet (f.eks. ml.c7g.xlarge for AWS Graviton3), navnet på den model, du oprettede i det foregående trin, og antallet af instanser pr. endepunkt.

- Start slutpunktet med den slutpunktskonfiguration, der blev oprettet i det forrige trin.

For detaljerede instruktioner, se Kør maskinlæringsindledningsarbejdsbelastninger på AWS Graviton-baserede instanser med Amazon SageMaker

Benchmarking metode

Vi brugte Amazon SageMaker Inference Recommender at automatisere performance benchmarking på tværs af forskellige instanser. Denne service sammenligner ydeevnen af din ML-model med hensyn til latens og omkostninger på forskellige forekomster og anbefaler den forekomst og konfiguration, der giver den bedste ydeevne til den laveste pris. Vi har indsamlet de førnævnte præstationsdata ved hjælp af Inference Recommender. For flere detaljer henvises til GitHub repo.

Du kan bruge eksempel notesbog at køre benchmarks og reproducere resultaterne. Vi brugte følgende modeller til benchmarking:

Konklusion

AWS målte op til 50 % omkostningsbesparelser for PyTorch, TensorFlow, XGBoost og scikit-learn modelinferens med AWS Graviton3-baserede EC2 C7g-instanser i forhold til sammenlignelige EC2-instanser på Amazon SageMaker. Du kan migrere dine eksisterende inferensbrugstilfælde eller implementere nye ML-modeller på AWS Graviton ved at følge trinene i dette indlæg. Du kan også henvise til AWS Graviton teknisk vejledning, som giver listen over optimerede biblioteker og bedste praksis, der hjælper dig med at opnå omkostningsfordele med AWS Graviton-instanser på tværs af forskellige arbejdsbelastninger.

Hvis du finder anvendelsestilfælde, hvor lignende præstationsgevinster ikke observeres på AWS Graviton, bedes du kontakte os. Vi vil fortsætte med at tilføje flere ydeevneforbedringer for at gøre AWS Graviton til den mest omkostningseffektive og effektive processor til generelle formål til ML-inferens.

Om forfatterne

Sunita Nadampalli er Software Development Manager hos AWS. Hun leder Graviton-softwareydelsesoptimeringer til maskinlæring, HPC og multimediearbejdsbelastninger. Hun brænder for open source-udvikling og levering af omkostningseffektive softwareløsninger med Arm SoC'er.

Sunita Nadampalli er Software Development Manager hos AWS. Hun leder Graviton-softwareydelsesoptimeringer til maskinlæring, HPC og multimediearbejdsbelastninger. Hun brænder for open source-udvikling og levering af omkostningseffektive softwareløsninger med Arm SoC'er.

Jaymin Desai er softwareudviklingsingeniør hos Amazon SageMaker Inference-teamet. Han brænder for at bringe AI til masserne og forbedre anvendeligheden af state-of-the-art AI-aktiver ved at produktisere dem til funktioner og tjenester. I sin fritid nyder han at udforske musik og rejse.

Jaymin Desai er softwareudviklingsingeniør hos Amazon SageMaker Inference-teamet. Han brænder for at bringe AI til masserne og forbedre anvendeligheden af state-of-the-art AI-aktiver ved at produktisere dem til funktioner og tjenester. I sin fritid nyder han at udforske musik og rejse.

Mike Schneider er systemudvikler med base i Phoenix AZ. Han er medlem af Deep Learning-beholdere, der understøtter forskellige Framework-beholderbilleder, for at inkludere Graviton Inference. Han er dedikeret til infrastruktureffektivitet og stabilitet.

Mike Schneider er systemudvikler med base i Phoenix AZ. Han er medlem af Deep Learning-beholdere, der understøtter forskellige Framework-beholderbilleder, for at inkludere Graviton Inference. Han er dedikeret til infrastruktureffektivitet og stabilitet.

Mohan Gandhi er senior softwareingeniør hos AWS. Han har været hos AWS i de sidste 10 år og har arbejdet på forskellige AWS-tjenester som EMR, EFA og RDS. I øjeblikket er han fokuseret på at forbedre SageMaker Inference Experience. I sin fritid nyder han at vandre og maratonløb.

Mohan Gandhi er senior softwareingeniør hos AWS. Han har været hos AWS i de sidste 10 år og har arbejdet på forskellige AWS-tjenester som EMR, EFA og RDS. I øjeblikket er han fokuseret på at forbedre SageMaker Inference Experience. I sin fritid nyder han at vandre og maratonløb.

Qingwei Li er Machine Learning Specialist hos Amazon Web Services. Han fik sin ph.d. i Operations Research, efter at han brød sin rådgivers forskningsbevillingskonto og undlod at levere den nobelpris, han lovede. I øjeblikket hjælper han kunder i finans- og forsikringsbranchen med at bygge maskinlæringsløsninger på AWS. I sin fritid holder han af at læse og undervise.

Qingwei Li er Machine Learning Specialist hos Amazon Web Services. Han fik sin ph.d. i Operations Research, efter at han brød sin rådgivers forskningsbevillingskonto og undlod at levere den nobelpris, han lovede. I øjeblikket hjælper han kunder i finans- og forsikringsbranchen med at bygge maskinlæringsløsninger på AWS. I sin fritid holder han af at læse og undervise.

Wayne Toh er Specialist Solutions Architect for Graviton hos AWS. Han fokuserer på at hjælpe kunder med at adoptere ARM-arkitektur til store container-arbejdsbelastninger. Før han kom til AWS, arbejdede Wayne for flere store softwareleverandører, herunder IBM og Red Hat.

Wayne Toh er Specialist Solutions Architect for Graviton hos AWS. Han fokuserer på at hjælpe kunder med at adoptere ARM-arkitektur til store container-arbejdsbelastninger. Før han kom til AWS, arbejdede Wayne for flere store softwareleverandører, herunder IBM og Red Hat.

Lauren Mullennex er en Solutions Architect baseret i Denver, CO. Hun arbejder med kunder for at hjælpe dem med at arkitekte løsninger på AWS. I sin fritid nyder hun at vandre og lave mad fra Hawaii.

Lauren Mullennex er en Solutions Architect baseret i Denver, CO. Hun arbejder med kunder for at hjælpe dem med at arkitekte løsninger på AWS. I sin fritid nyder hun at vandre og lave mad fra Hawaii.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoAiStream. Web3 Data Intelligence. Viden forstærket. Adgang her.

- Udmøntning af fremtiden med Adryenn Ashley. Adgang her.

- Køb og sælg aktier i PRE-IPO-virksomheder med PREIPO®. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/reduce-amazon-sagemaker-inference-cost-with-aws-graviton/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 10

- 100

- 7

- 98

- a

- Om

- Konto

- opnå

- tværs

- tilføje

- vedtage

- Fordel

- Efter

- AI

- algoritme

- allerede

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- blandt

- an

- ,

- applikationer

- arkitektur

- ER

- ARM

- AS

- Aktiver

- At

- automatisere

- AWS

- baseret

- BE

- fordi

- været

- benchmarking

- Benchmarks

- fordele

- BEDSTE

- bedste praksis

- Bedre

- bringe

- bred

- Broke

- bygge

- bygget

- indbygget

- byrde

- men

- by

- CAN

- tilfælde

- Chart

- klassificering

- Cloud

- CO

- sammenlignelig

- sammenlignet

- sammenligning

- kompatibel

- fuldføre

- Compute

- computer

- Computer Vision

- Konfiguration

- indeholder

- Container

- Beholdere

- fortsæt

- Koste

- omkostningsbesparelser

- omkostningseffektiv

- Omkostninger

- dæksel

- oprettet

- For øjeblikket

- kunde

- Kunder

- data

- dedikeret

- dyb

- dyb læring

- levere

- leverer

- Denver

- indsætte

- indsat

- implementering

- detaljeret

- detaljer

- Udvikler

- Udvikling

- forskellige

- diskutere

- gør

- grund

- effektivt

- effektivitet

- effektiv

- enten

- Endpoint

- ingeniør

- Miljø

- evaluere

- eksempel

- eksisterende

- erfaring

- Udforskning

- mislykkedes

- Funktionalitet

- få

- File (Felt)

- finansielle

- finansiel service

- Finde

- Fokus

- fokuserede

- fokuserer

- efter

- Til

- fire

- Framework

- rammer

- Gratis

- yderligere

- gevinster

- generelle formål

- generationer

- giver

- indrømme

- graf

- hat

- Have

- he

- hjælpe

- hjælpe

- hjælper

- hende

- hans

- host

- Hvordan

- HPC

- HTML

- HTTPS

- IBM

- if

- billeder

- forbedringer

- forbedring

- in

- omfatter

- Herunder

- industrien

- oplysninger

- Infrastruktur

- instans

- anvisninger

- forsikring

- Integrerer

- ind

- sammenføjning

- jpg

- lige

- Sprog

- stor

- Efternavn

- Latency

- Leads

- læring

- mindst

- biblioteker

- ligesom

- synes godt om

- Liste

- placering

- laveste

- maskine

- machine learning

- lave

- administrere

- leder

- masserne

- Mød

- medlem

- Hukommelse

- migrere

- migration

- million

- ML

- MLOps

- model

- modeller

- mere

- mest

- multimedie

- flere

- Musik

- navn

- Natural

- Natural Language Processing

- Behov

- behov

- Ny

- NLP

- Nobel pris

- nummer

- of

- tilbyde

- on

- kun

- open source

- operationelle

- Produktion

- optimeret

- Option

- Indstillinger

- or

- ordrer

- Andet

- ud

- egen

- parametre

- lidenskabelige

- ydeevne

- phoenix

- pick

- plato

- Platon Data Intelligence

- PlatoData

- Vær venlig

- Populær

- Indlæg

- praksis

- tidligere

- Forud

- præmie

- forarbejdning

- Processor

- produktion

- lovede

- give

- forudsat

- giver

- pytorch

- rækkevidde

- Ranking

- nå

- Læsning

- modtaget

- anbefaler

- Rød

- Red Hat

- reducere

- Reduceret

- forskning

- Resultater

- Kør

- sagemaker

- SageMaker Inference

- samme

- Besparelser

- Scale

- scenarier

- scikit-lære

- se

- valg

- senior

- tjeneste

- Tjenester

- flere

- hun

- Vis

- Shows

- signifikant

- lignende

- So

- Software

- softwareudvikling

- Software Engineer

- Løsninger

- specialist

- specialiserede

- Stabilitet

- state-of-the-art

- Trin

- Steps

- ligetil

- Støtte

- Understøtter

- Kontakt

- Systemer

- Tag

- tager

- Undervisning

- hold

- Teknisk

- tensorflow

- vilkår

- end

- at

- oplysninger

- Them

- denne

- tre

- tid

- til

- værktøjer

- Traveling

- typen

- typer

- us

- usability

- brug

- anvendte

- ved brug af

- forskellige

- leverandører

- vision

- ønsker

- we

- web

- webservices

- GODT

- som

- vilje

- med

- Arbejde

- arbejdede

- virker

- XGBoost

- år

- Du

- Din

- zephyrnet