In den letzten Jahren haben Fortschritte in der Computervision es Forschern, Ersthelfern und Regierungen ermöglicht, das schwierige Problem der Verarbeitung globaler Satellitenbilder anzugehen, um unseren Planeten und unsere Auswirkungen auf ihn zu verstehen. AWS wurde kürzlich veröffentlicht Geodatenfunktionen von Amazon SageMaker um Ihnen Satellitenbilder und hochmoderne ML-Modelle (Machine Learning) mit Geodaten zur Verfügung zu stellen und Barrieren für diese Art von Anwendungsfällen abzubauen. Weitere Informationen finden Sie unter Vorschau: Verwenden Sie Amazon SageMaker zum Erstellen, Trainieren und Bereitstellen von ML-Modellen unter Verwendung von Geodaten.

Viele Behörden, einschließlich Ersthelfer, nutzen diese Angebote, um ein umfassendes Situationsbewusstsein zu erlangen und Hilfsmaßnahmen in geografischen Gebieten, die von Naturkatastrophen heimgesucht wurden, zu priorisieren. Oft arbeiten diese Agenturen mit Katastrophenbildern aus geringer Höhe und Satellitenquellen, und diese Daten sind oft unbeschriftet und schwer zu verwenden. Hochmoderne Computer-Vision-Modelle sind oft leistungsschwach, wenn sie Satellitenbilder einer Stadt betrachten, die von einem Hurrikan oder Lauffeuer heimgesucht wurde. Angesichts des Mangels an diesen Datensätzen sind selbst hochmoderne ML-Modelle oft nicht in der Lage, die Genauigkeit und Präzision zu liefern, die für die Vorhersage von standardmäßigen FEMA-Katastrophenklassifizierungen erforderlich sind.

Geodatensätze enthalten nützliche Metadaten wie Breiten- und Längenkoordinaten sowie Zeitstempel, die Kontext für diese Bilder liefern können. Dies ist besonders hilfreich bei der Verbesserung der Genauigkeit von Geodaten-ML für Katastrophenszenen, da diese Bilder von Natur aus unordentlich und chaotisch sind. Gebäude sind weniger rechteckig, die Vegetation wurde beschädigt und lineare Straßen wurden durch Überschwemmungen oder Schlammlawinen unterbrochen. Da die Kennzeichnung dieser riesigen Datensätze teuer, manuell und zeitaufwändig ist, ist die Entwicklung von ML-Modellen, die die Bildkennzeichnung und -anmerkung automatisieren können, von entscheidender Bedeutung.

Um dieses Modell zu trainieren, benötigen wir eine beschriftete Ground-Truth-Teilmenge der LADI-Datensatz (Low Altitude Disaster Imagery). Dieser Datensatz besteht aus von Menschen und Maschinen kommentierten Luftbildern, die von der Civil Air Patrol zur Unterstützung verschiedener Katastropheneinsätze von 2015 bis 2019 gesammelt wurden. Diese LADI-Datensätze konzentrieren sich auf die Hurrikansaison im Atlantik und die Küstenstaaten entlang des Atlantiks und des Golfs von Mexiko. Zwei Hauptunterschiede sind die niedrige Höhe, die schräge Perspektive der Bilder und katastrophenbezogene Merkmale, die in Computer-Vision-Benchmarks und Datensätzen selten vorkommen. Die Teams verwendeten bestehende FEMA-Kategorien für Schäden wie Überschwemmungen, Trümmer, Feuer und Rauch oder Erdrutsche, die die Kennzeichnungskategorien standardisierten. Die Lösung ist dann in der Lage, Vorhersagen zu den restlichen Trainingsdaten zu treffen und Ergebnisse mit geringerer Zuverlässigkeit zur menschlichen Überprüfung weiterzuleiten.

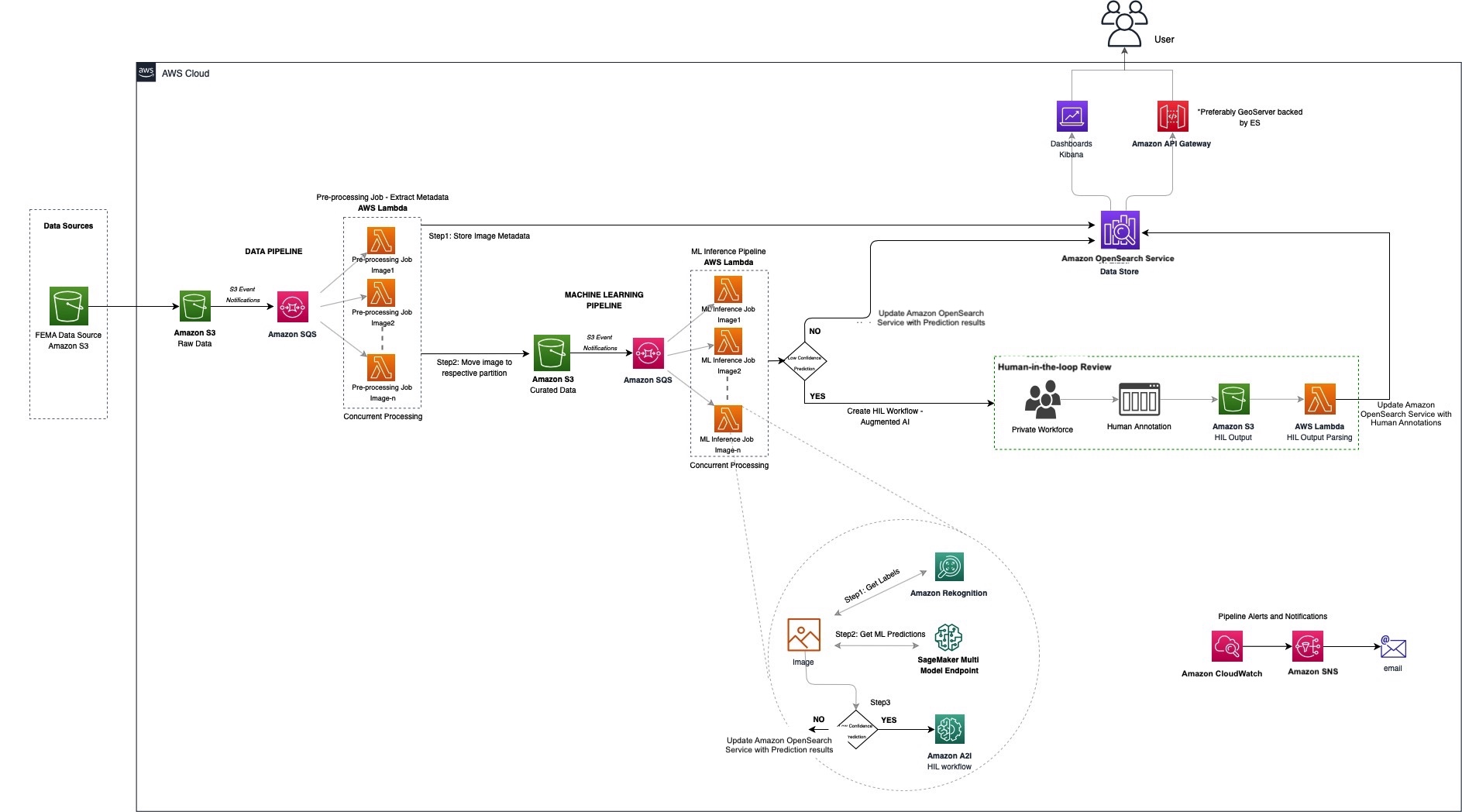

In diesem Beitrag beschreiben wir unser Design und die Implementierung der Lösung, Best Practices und die Schlüsselkomponenten der Systemarchitektur.

Lösungsüberblick

Kurz gesagt umfasste die Lösung den Bau von drei Pipelines:

- Datenpipeline – Extrahiert die Metadaten der Bilder

- Pipeline für maschinelles Lernen – Klassifiziert und beschriftet Bilder

- Human-in-the-Loop-Überprüfungspipeline – Verwendet ein menschliches Team, um die Ergebnisse zu überprüfen

Das folgende Diagramm zeigt die Lösungsarchitektur.

Angesichts der Beschaffenheit eines Kennzeichnungssystems wie diesem haben wir eine horizontal skalierbare Architektur entwickelt, die Aufnahmespitzen ohne übermäßige Bereitstellung mithilfe einer serverlosen Architektur bewältigen kann. Wir verwenden ein Eins-zu-viele-Muster von Amazon Simple Queue-Dienst (Amazon SQS) zu AWS Lambda an mehreren Stellen, um diese Aufnahmespitzen zu unterstützen, Resilienz bieten.

Verwenden einer SQS-Warteschlange für die Verarbeitung Amazon Simple Storage-Service (Amazon S3)-Ereignisse helfen uns, die Parallelität der nachgelagerten Verarbeitung (in diesem Fall Lambda-Funktionen) zu steuern und die eingehenden Datenspitzen zu bewältigen. Die Warteschlange eingehender Nachrichten dient auch als Pufferspeicher für den Fall, dass nachgelagerte Fehler auftreten.

Angesichts der hochgradig parallelen Anforderungen haben wir uns für Lambda entschieden, um unsere Bilder zu verarbeiten. Lambda ist ein Serverless-Computing-Dienst, mit dem wir Code ausführen können, ohne Server bereitzustellen oder zu verwalten, arbeitslastbewusste Cluster-Skalierungslogik zu erstellen, Ereignisintegrationen zu verwalten und Laufzeiten zu verwalten.

Wir verwenden Amazon OpenSearch-Dienst als unser zentraler Datenspeicher, um die hochgradig skalierbaren, schnellen Suchen und das integrierte Visualisierungstool OpenSearch Dashboards zu nutzen. Es ermöglicht uns, dem Bild iterativ Kontext hinzuzufügen, ohne es neu kompilieren oder neu skalieren zu müssen, und die Schemaentwicklung zu handhaben.

Amazon-Anerkennung macht es einfach, Bild- und Videoanalysen in unsere Anwendungen einzufügen, indem bewährte, hochskalierbare Deep-Learning-Technologie verwendet wird. Mit Amazon Rekognition erhalten wir eine gute Basislinie erkannter Objekte.

In den folgenden Abschnitten gehen wir detaillierter auf jede Pipeline ein.

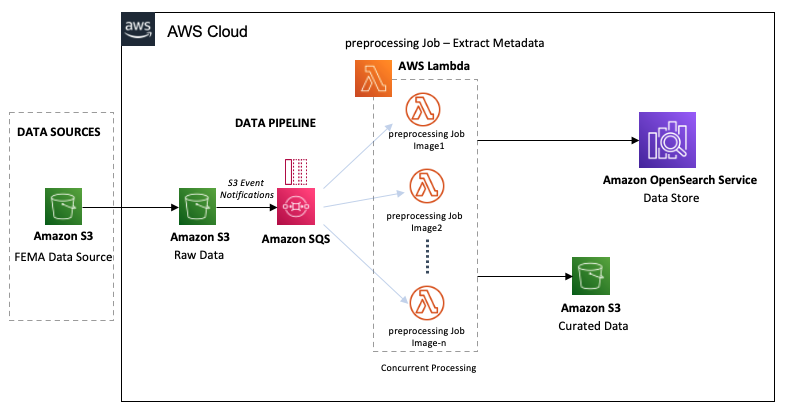

Datenpipeline

Das folgende Diagramm zeigt den Workflow der Datenpipeline.

Die LADI-Datenpipeline beginnt mit der Aufnahme von Rohdatenbildern aus der FEMA Common Alerting Protocol (CAP) in einen S3-Bucket. Während wir die Bilder in den Rohdaten-Bucket aufnehmen, werden sie in zwei Schritten nahezu in Echtzeit verarbeitet:

- Der S3-Bucket löst Ereignisbenachrichtigungen für alle Objekterstellungen aus und erstellt Nachrichten in der SQS-Warteschlange für jedes aufgenommene Bild.

- Die SQS-Warteschlange ruft gleichzeitig die Lambda-Vorverarbeitungsfunktionen für das Bild auf.

Die Lambda-Funktionen führen die folgenden Vorverarbeitungsschritte aus:

- Berechnen Sie die UUID für jedes Bild und stellen Sie eine eindeutige Kennung für jedes Bild bereit. Diese ID identifiziert das Bild für seinen gesamten Lebenszyklus.

- Extrahieren Sie Metadaten wie GPS-Koordinaten, Bildgröße, GIS-Informationen und S3-Standort aus dem Bild und speichern Sie sie in OpenSearch.

- Basierend auf einer Suche nach FIPS-Codes verschiebt die Funktion das Bild in den S3-Bucket für kuratierte Daten. Wir partitionieren die Daten nach FIPS-State-Code/FIPS-County-Code/Year/Month des Images.

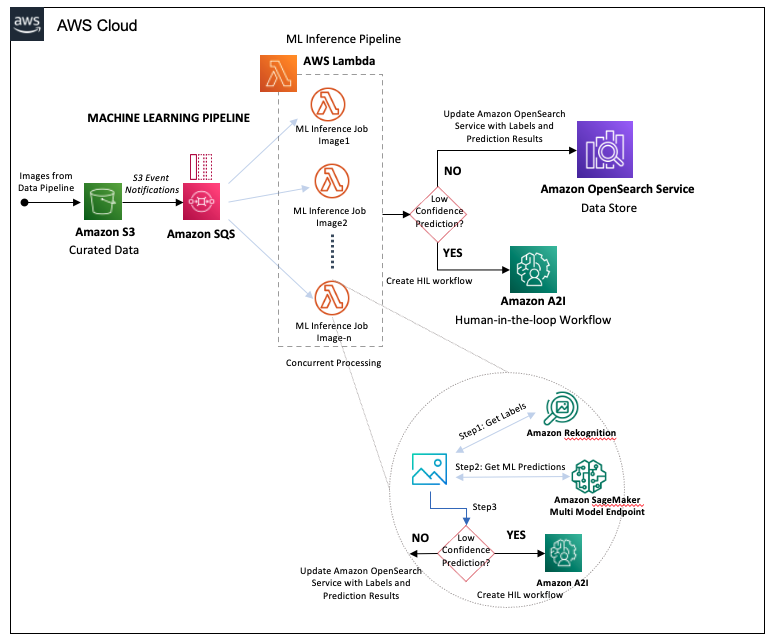

Pipeline für maschinelles Lernen

Die ML-Pipeline beginnt mit den Bildern, die im S3-Bucket für kuratierte Daten im Datenpipeline-Schritt landen, der die folgenden Schritte auslöst:

- Amazon S3 generiert für jedes im S3-Bucket mit kuratierten Daten erstellte Objekt eine Nachricht in einer anderen SQS-Warteschlange.

- Die SQS-Warteschlange löst gleichzeitig Lambda-Funktionen aus, um den ML-Inferenzjob für das Bild auszuführen.

Die Lambda-Funktionen führen die folgenden Aktionen aus:

- Senden Sie jedes Bild zur Objekterkennung an Amazon Rekognition und speichern Sie die zurückgegebenen Labels und die jeweiligen Konfidenzwerte.

- Setzen Sie die Amazon Rekognition-Ausgabe in Eingabeparameter für unsere Amazon Sage Maker Endpunkt mit mehreren Modellen. Dieser Endpunkt hostet unser Ensemble von Klassifikatoren, die für bestimmte Sätze von Schadenskennzeichnungen trainiert sind.

- Übergeben Sie die Ergebnisse des SageMaker-Endpunkts an Amazon Augmented AI (Amazon A2I).

Das folgende Diagramm veranschaulicht den Pipeline-Workflow.

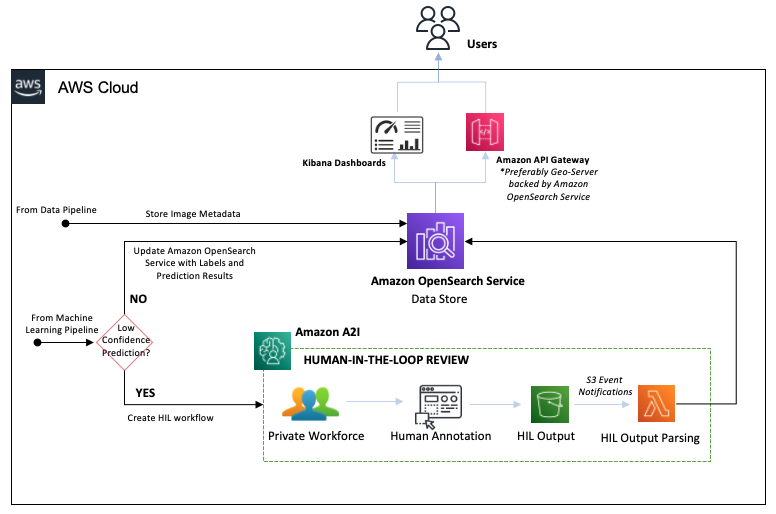

Human-in-the-Loop-Überprüfungspipeline

Das folgende Diagramm veranschaulicht die Human-in-the-Loop (HIL)-Pipeline.

Mit Amazon A2I können wir Schwellenwerte konfigurieren, die eine menschliche Überprüfung durch ein privates Team auslösen, wenn ein Modell eine Vorhersage mit geringem Vertrauen ergibt. Wir können Amazon A2I auch verwenden, um eine fortlaufende Prüfung der Vorhersagen unseres Modells bereitzustellen. Die Arbeitsschritte sind wie folgt:

- Amazon A2I leitet Vorhersagen mit hoher Zuverlässigkeit an OpenSearch Service weiter und aktualisiert die Etikettendaten des Bildes.

- Amazon A2I leitet Vorhersagen mit niedrigem Vertrauen an das private Team weiter, um Bilder manuell zu kommentieren.

- Der menschliche Prüfer vervollständigt die Anmerkung und generiert eine Ausgabedatei für menschliche Anmerkungen, die im HIL-Ausgabe-S3-Bucket gespeichert wird.

- Der HIL-Ausgabe-S3-Bucket löst eine Lambda-Funktion aus, die die Ausgabe der menschlichen Anmerkungen parst und die Bilddaten im OpenSearch-Dienst aktualisiert.

Indem wir die Ergebnisse der menschlichen Annotation zurück zum Datenspeicher leiten, können wir die Ensemble-Modelle neu trainieren und die Genauigkeit des Modells iterativ verbessern.

Da unsere hochwertigen Ergebnisse jetzt im OpenSearch-Dienst gespeichert sind, können wir mithilfe einer REST-API eine räumliche und zeitliche Suche durchführen Amazon API-Gateway und Geoserver. OpenSearch Dashboard ermöglicht es Benutzern auch, Analysen mit diesem Datensatz zu suchen und auszuführen.

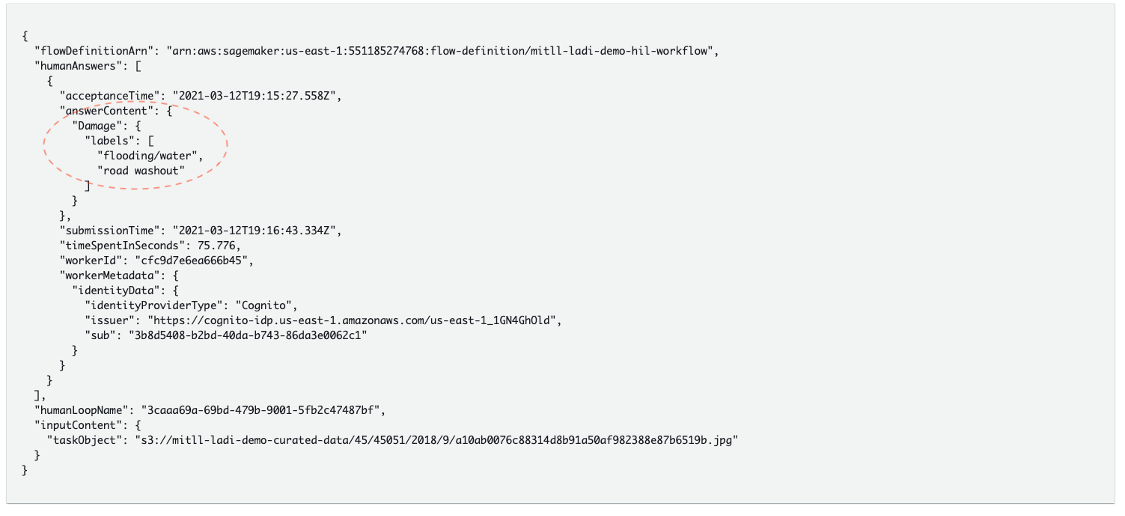

Die Ergebnisse

Der folgende Code zeigt ein Beispiel unserer Ergebnisse.

Mit dieser neuen Pipeline schaffen wir einen menschlichen Backstop für Modelle, die noch nicht voll leistungsfähig sind. Diese neue ML-Pipeline wurde zur Verwendung mit a in Produktion genommen Civil Air Patrol Image Filter-Microservice die das Filtern von Bildern der Zivilluftpatrouille in Puerto Rico ermöglicht. Dies ermöglicht es Ersthelfern, das Ausmaß des Schadens zu sehen und Bilder anzusehen, die mit diesem Schaden nach Hurrikanen verbunden sind. Das AWS Data Lab, das AWS Open Data Program, das Amazon Disaster Response Team und das AWS Human-in-the-Loop-Team haben mit Kunden zusammengearbeitet, um eine Open-Source-Pipeline zu entwickeln, die zur Analyse von Civil Air Patrol-Daten verwendet werden kann, die in Open Data gespeichert sind Programmieren Sie die Registrierung nach Bedarf nach einer Naturkatastrophe. Weitere Informationen zur Pipeline-Architektur und einen Überblick über die Zusammenarbeit und die Auswirkungen finden Sie im Video Konzentration auf Katastrophenschutz mit Amazon Augmented AI, dem AWS Open Data-Programm und AWS Snowball.

Zusammenfassung

Da der Klimawandel die Häufigkeit und Intensität von Stürmen und Waldbränden weiter erhöht, sehen wir weiterhin die Bedeutung der Verwendung von ML, um die Auswirkungen dieser Ereignisse auf lokale Gemeinschaften zu verstehen. Diese neuen Tools können die Maßnahmen zur Katastrophenabwehr beschleunigen und uns ermöglichen, die Daten aus diesen Nachereignisanalysen zu verwenden, um die Vorhersagegenauigkeit dieser Modelle durch aktives Lernen zu verbessern. Diese neuen ML-Modelle können die Datenannotation automatisieren, wodurch wir das Ausmaß des Schadens aus jedem dieser Ereignisse ableiten können, wenn wir Schadensetiketten mit Kartendaten überlagern. Diese kumulativen Daten können auch dazu beitragen, unsere Fähigkeit zu verbessern, Schäden für zukünftige Katastrophenereignisse vorherzusagen, die als Grundlage für Minderungsstrategien dienen können. Dies wiederum kann die Widerstandsfähigkeit von Gemeinschaften, Volkswirtschaften und Ökosystemen verbessern, indem es Entscheidungsträgern die Informationen liefert, die sie benötigen, um datengesteuerte Strategien zu entwickeln, um diesen aufkommenden Umweltbedrohungen zu begegnen.

In diesem Blogbeitrag haben wir die Verwendung von Computer Vision auf Satellitenbildern diskutiert. Diese Lösung ist als Referenzarchitektur oder Kurzanleitung gedacht, die Sie an Ihre eigenen Bedürfnisse anpassen können.

Probieren Sie es aus und lassen Sie uns wissen, wie dies Ihren Anwendungsfall gelöst hat, indem Sie Feedback im Kommentarbereich hinterlassen. Weitere Informationen finden Sie unter Geodatenfunktionen von Amazon SageMaker.

Über die Autoren

Vamshi Krishna Enabothala ist Senior Applied AI Specialist Architect bei AWS. Er arbeitet mit Kunden aus verschiedenen Branchen zusammen, um wirkungsvolle Daten-, Analyse- und maschinelle Lerninitiativen zu beschleunigen. Er interessiert sich leidenschaftlich für Empfehlungssysteme, NLP und Computer Vision-Bereiche in KI und ML. Außerhalb der Arbeit ist Vamshi ein RC-Enthusiast, der RC-Ausrüstung (Flugzeuge, Autos und Drohnen) baut und auch gerne im Garten arbeitet.

Vamshi Krishna Enabothala ist Senior Applied AI Specialist Architect bei AWS. Er arbeitet mit Kunden aus verschiedenen Branchen zusammen, um wirkungsvolle Daten-, Analyse- und maschinelle Lerninitiativen zu beschleunigen. Er interessiert sich leidenschaftlich für Empfehlungssysteme, NLP und Computer Vision-Bereiche in KI und ML. Außerhalb der Arbeit ist Vamshi ein RC-Enthusiast, der RC-Ausrüstung (Flugzeuge, Autos und Drohnen) baut und auch gerne im Garten arbeitet.

Morgan Dutton ist Senior Technical Program Manager im Team von Amazon Augmented AI und Amazon SageMaker Ground Truth. Sie arbeitet mit Kunden aus Unternehmen, Hochschulen und dem öffentlichen Sektor zusammen, um die Einführung von maschinellem Lernen und Human-in-the-Loop-ML-Diensten zu beschleunigen.

Morgan Dutton ist Senior Technical Program Manager im Team von Amazon Augmented AI und Amazon SageMaker Ground Truth. Sie arbeitet mit Kunden aus Unternehmen, Hochschulen und dem öffentlichen Sektor zusammen, um die Einführung von maschinellem Lernen und Human-in-the-Loop-ML-Diensten zu beschleunigen.

Sandeep Verma ist Senior Prototyping Architect bei AWS. Er taucht gerne tief in die Herausforderungen der Kunden ein und baut Prototypen für Kunden, um Innovationen zu beschleunigen. Er hat einen Hintergrund in KI/ML, Gründer von New Knowledge, und generell eine Leidenschaft für Technik. In seiner Freizeit reist er gerne und fährt mit seiner Familie Ski.

Sandeep Verma ist Senior Prototyping Architect bei AWS. Er taucht gerne tief in die Herausforderungen der Kunden ein und baut Prototypen für Kunden, um Innovationen zu beschleunigen. Er hat einen Hintergrund in KI/ML, Gründer von New Knowledge, und generell eine Leidenschaft für Technik. In seiner Freizeit reist er gerne und fährt mit seiner Familie Ski.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/accelerate-disaster-response-with-computer-vision-for-satellite-imagery-using-amazon-sagemaker-and-amazon-augmented-ai/

- 100

- 7

- 98

- a

- Fähigkeit

- Fähig

- Über Uns

- akademisch

- beschleunigen

- Genauigkeit

- Aktionen

- aktiv

- Handlungen

- Adresse

- Adoption

- Vorschüsse

- Vorteil

- gegen

- Agenturen

- AI

- AI / ML

- LUFT

- Alle

- erlaubt

- Amazon

- Amazon Augmented AI

- Amazon-Anerkennung

- Amazon Sage Maker

- Amazon Sagemaker Ground Truth

- Analysen

- Analyse

- Analytik

- analysieren

- und

- Ein anderer

- Bienen

- Anwendungen

- angewandt

- Angewandte KI

- Architektur

- Bereiche

- damit verbundenen

- Prüfung

- Augmented

- automatisieren

- Bewusstsein

- AWS

- Zurück

- Hintergrund

- Rücklaufsperre

- Barrieren

- Baseline

- weil

- Benchmarks

- BESTE

- Best Practices

- Blog

- puffern

- bauen

- Building

- Kappe

- Autos

- Häuser

- Fälle

- Kategorien

- Hauptgeschäftsstelle

- Herausforderungen

- herausfordernd

- Übernehmen

- aus der Ferne überprüfen

- wählten

- Stadt

- Klimaschutz

- Klimawandel

- Cluster

- Code

- Zusammenarbeit

- Bemerkungen

- gemeinsam

- Communities

- Wird abgeschlossen

- Komponenten

- Berechnen

- Computer

- Computer Vision

- Vertrauen

- enthalten

- Kontext

- fortsetzen

- weiter

- Smartgeräte App

- erstellen

- erstellt

- Erstellen

- Kreationen

- kritischem

- kuratiert

- Kunde

- Kunden

- anpassen

- Armaturenbrett

- technische Daten

- datengesteuerte

- Datensätze

- Behandlung

- Entscheidungsträger

- tief

- tiefe Lernen

- Übergeben

- Demand

- einsetzen

- beschreiben

- Design

- entworfen

- Detail

- erkannt

- Entdeckung

- entwickeln

- Entwicklung

- anders

- schwer

- Katastrophe

- Katastrophen

- diskutiert

- Drohnen

- jeder

- Wirtschaft

- Ecosystems

- Bemühungen

- aufstrebenden

- freigegeben

- ermöglicht

- Endpunkt

- Unternehmen

- Enthusiast

- Ganz

- Umwelt-

- Ausrüstung

- insbesondere

- Sogar

- Event

- Veranstaltungen

- Evolution

- Beispiel

- vorhandenen

- teuer

- KONZENTRAT

- Familie

- FAST

- funktions

- Eigenschaften

- Feedback

- Reichen Sie das

- Filter

- Filterung

- Feuer

- Vorname

- Setzen Sie mit Achtsamkeit

- Folgende

- folgt

- Gründer

- Frei

- Frequenz

- für

- voll

- Funktion

- Funktionen

- Zukunft

- Gewinnen

- allgemein

- erzeugt

- Erzeugung

- geographisch

- Geodaten-ML

- bekommen

- gegeben

- Unterstützung

- Global

- gut

- Regierungen

- gps

- Boden

- Guide

- Griff

- mit

- Hilfe

- hilfreich

- hilft

- GUTE

- hochwertige

- hoch

- Hit

- Gastgeber

- Ultraschall

- HTML

- HTTPS

- human

- Hurrikan

- ID

- Kennzeichnung

- identifizieren

- Image

- Bilder

- Impact der HXNUMXO Observatorien

- Implementierung

- Bedeutung

- zu unterstützen,

- Verbesserung

- in

- Einschließlich

- Eingehende

- Erhöhung

- Information

- Initiativen

- Innovation

- Varianten des Eingangssignals:

- integriert

- Integrationen

- unterbrochen

- ruft auf

- beteiligt

- IT

- Job

- Wesentliche

- Wissen

- Wissen

- Labor

- Label

- Beschriftung

- Etiketten

- Mangel

- Landung

- großflächig

- lernen

- Verlassen

- Lasst uns

- Lebenszyklus

- aus einer regionalen

- Standorte

- suchen

- Nachschlagen

- Sneaker

- Maschine

- Maschinelles Lernen

- Aufrechterhaltung

- um

- MACHT

- Manager

- flächendeckende Gesundheitsprogramme

- manuell

- manuell

- Karte

- Landkarten

- massiv

- Nachricht

- Nachrichten

- Metadaten

- México

- Milderung

- ML

- Modell

- für

- mehr

- bewegt sich

- Multi-Modell-Endpunkt

- mehrere

- Natürliche

- Natur

- Need

- Bedürfnisse

- Neu

- Nlp

- Benachrichtigungen

- Objekt

- Objekterkennung

- Objekte

- Ozean

- Angebote

- laufend

- XNUMXh geöffnet

- offene Daten

- Open-Source-

- aussen

- Überblick

- besitzen

- Parallel

- Parameter

- leidenschaftlich

- Schnittmuster

- Ausführen

- Perspektive

- Pipeline

- Planet

- Plato

- Datenintelligenz von Plato

- PlatoData

- Post

- Praktiken

- Präzision

- vorhersagen

- Prognose

- Prognosen

- Priorität einräumen

- privat

- Aufgabenstellung:

- Prozessdefinierung

- Verarbeitet

- Verarbeitung

- Produktion

- Programm

- Protokoll

- Prototypen

- Prototyping

- zuverlässig

- die

- Bereitstellung

- Öffentlichkeit

- Puerto

- Puerto Rico

- setzen

- Direkt

- Roh

- kürzlich

- kürzlich

- Software Empfehlungen

- Reduzierung

- Registratur

- freigegeben

- Erleichterung

- falls angefordert

- Forscher

- Elastizität

- diejenigen

- Antwort

- REST

- Die Ergebnisse

- Überprüfen

- RICO

- Straße

- Routen

- Führen Sie

- sagemaker

- Satellit

- skalierbaren

- Skalierung

- Szenen

- Suche

- Jahreszeiten

- Abschnitt

- Abschnitte

- Bibliotheken

- Sektoren

- Senior

- Serverlos

- Fertige Server

- Lösungen

- Sets

- Konzerte

- Einfacher

- Größe

- Rauchen

- Schnappschuss

- Lösung

- Quellen

- Spezialist

- spezifisch

- Spikes

- Standard

- Anfang

- beginnt

- State-of-the-art

- Staaten

- Schritt

- Shritte

- Lagerung

- speichern

- gelagert

- Stürme

- Strategien

- so

- Support

- System

- Systeme und Techniken

- Nehmen

- Team

- Teams

- Tech

- Technische

- Technologie

- Das

- die Informationen

- Bedrohungen

- nach drei

- Zeit

- Zeitaufwendig

- zu

- Werkzeug

- Werkzeuge

- Training

- trainiert

- Ausbildung

- Reise

- auslösen

- WENDE

- Typen

- verstehen

- einzigartiges

- Updates

- Aktualisierung

- us

- -

- Anwendungsfall

- Nutzer

- verschiedene

- Video

- Anzeigen

- Seh-

- Visualisierung

- welche

- werden wir

- ohne

- Arbeiten

- gearbeitet

- Werk

- würde

- Jahr

- Erträge

- Du

- Ihr

- Youtube

- Zephyrnet