In diesem Beitrag zeigen wir, wie Sie eine neue OAuth-basierte Authentifizierungsfunktion für die Verwendung konfigurieren Schneeflocke in Amazon SageMaker Data Wrangler. Snowflake ist eine Cloud-Datenplattform, die Datenlösungen für Data Warehousing für Data Science bereitstellt. Schneeflocke ist ein AWS-Partner mit mehreren AWS-Akkreditierungen, einschließlich AWS-Kompetenzen in maschinellem Lernen (ML), Einzelhandel sowie Daten und Analysen.

Data Wrangler vereinfacht die Datenvorbereitung und den Feature-Engineering-Prozess und verkürzt die dafür benötigte Zeit von Wochen auf Minuten, indem es Data Scientists eine einzige visuelle Schnittstelle bietet, um Daten auszuwählen und zu bereinigen, Features zu erstellen und die Datenvorbereitung in ML-Workflows zu automatisieren, ohne Code schreiben zu müssen. Sie können Daten aus mehreren Datenquellen importieren, z Amazon Simple Storage-Service (Amazon S3), Amazonas Athena, Amazon RedShift, Amazon EMR, und Schneeflocke. Mit dieser neuen Funktion können Sie Ihren eigenen Identitätsanbieter (IdP) wie z Okta, Azure AD, oder Ping Federate um sich über Data Wrangler mit Snowflake zu verbinden.

Lösungsüberblick

In den folgenden Abschnitten stellen wir Schritte für einen Administrator bereit, um IdP, Snowflake und Studio einzurichten. Wir beschreiben auch die Schritte, die Data Scientists unternehmen können, um den Datenfluss zu konfigurieren, die Datenqualität zu analysieren und Datentransformationen hinzuzufügen. Abschließend zeigen wir, wie Sie den Datenfluss exportieren und ein Modell damit trainieren SageMaker-Autopilot.

Voraussetzungen:

Für diese exemplarische Vorgehensweise sollten Sie die folgenden Voraussetzungen erfüllen:

- Für Administrator:

- Ein Snowflake-Benutzer mit Berechtigungen zum Erstellen von Speicherintegrationen und Sicherheitsintegrationen in Snowflake.

- Ein AWS-Konto mit Berechtigungen zum Erstellen AWS Identity and Access Management and (IAM)-Richtlinien und -Rollen.

- Zugriff und Berechtigungen zum Konfigurieren von IDP zum Registrieren der Data Wrangler-Anwendung und zum Einrichten des Autorisierungsservers oder der API.

- Für Datenwissenschaftler:

Administrator-Setup

Anstatt Ihre Benutzer ihre Snowflake-Anmeldeinformationen direkt in Data Wrangler eingeben zu lassen, können Sie sie einen IdP verwenden lassen, um auf Snowflake zuzugreifen.

Die folgenden Schritte sind erforderlich, um den OAuth-Zugriff von Data Wrangler auf Snowflake zu aktivieren:

- Konfigurieren Sie den IdP.

- Snowflake konfigurieren.

- Konfigurieren Sie SageMaker Studio.

Konfigurieren Sie den IdP

Um Ihren IdP einzurichten, müssen Sie die Data Wrangler-Anwendung registrieren und Ihren Autorisierungsserver oder Ihre API einrichten.

Registrieren Sie die Data Wrangler-Anwendung beim IdP

Informationen zu den von Data Wrangler unterstützten IdPs finden Sie in der folgenden Dokumentation:

Verwenden Sie die von Ihrem IdP bereitgestellte Dokumentation, um Ihre Data Wrangler-Anwendung zu registrieren. Die Informationen und Verfahren in diesem Abschnitt helfen Ihnen zu verstehen, wie Sie die von Ihrem IdP bereitgestellte Dokumentation richtig verwenden.

Spezifische Anpassungen zusätzlich zu den Schritten in den jeweiligen Leitfäden werden in den Unterabschnitten genannt.

- Wählen Sie die Konfiguration aus, die den Registrierungsprozess von Data Wrangler als Anwendung startet.

- Bieten Sie den Benutzern innerhalb des IdP Zugriff auf Data Wrangler.

- Aktivieren Sie die OAuth-Client-Authentifizierung, indem Sie die Client-Anmeldeinformationen als Secrets Manager-Secret speichern.

- Geben Sie eine Weiterleitungs-URL im folgenden Format an:

https://domain-ID.studio.AWS Region.sagemaker.aws/jupyter/default/lab.

Sie geben die SageMaker-Domänen-ID und die AWS-Region an, die Sie zum Ausführen von Data Wrangler verwenden. Sie müssen für jede Domäne und Region, in der Sie Data Wrangler ausführen, eine URL registrieren. Benutzer aus einer Domäne und Region, für die keine Umleitungs-URLs eingerichtet sind, können sich nicht beim IdP authentifizieren, um auf die Snowflake-Verbindung zuzugreifen.

- Stellen Sie sicher, dass der Autorisierungscode und die Erteilungstypen des Aktualisierungstokens für Ihre Data Wrangler-Anwendung zulässig sind.

Richten Sie den Autorisierungsserver oder die API innerhalb des IdP ein

Innerhalb Ihres IdP müssen Sie einen Autorisierungsserver oder eine Anwendungsprogrammierschnittstelle (API) einrichten. Für jeden Benutzer sendet der Autorisierungsserver oder die API Token an Data Wrangler mit Snowflake als Zielgruppe.

Snowflake verwendet das Konzept von Rollen die sich von den in AWS verwendeten IAM-Rollen unterscheiden. Sie müssen den IdP so konfigurieren, dass er JEDE Rolle verwendet, um die mit dem Snowflake-Konto verknüpfte Standardrolle zu verwenden. Zum Beispiel, wenn ein Benutzer hat systems administrator als Standardrolle in ihrem Snowflake-Profil die Verbindung von Data Wrangler zu Snowflake verwendet systems administrator als Rolle.

Verwenden Sie das folgende Verfahren, um den Autorisierungsserver oder die API in Ihrem IdP einzurichten:

- Beginnen Sie bei Ihrem IdP mit der Einrichtung des Servers oder der API.

- Konfigurieren Sie den Autorisierungsserver für die Verwendung des Autorisierungscodes und der Erteilungstypen des Aktualisierungstokens.

- Geben Sie die Lebensdauer des Zugriffstokens an.

- Legen Sie das Leerlaufzeitlimit für das Aktualisierungstoken fest.

Das Leerlaufzeitlimit ist die Zeit, die das Aktualisierungstoken abläuft, wenn es nicht verwendet wird. Wenn Sie Jobs in Data Wrangler planen, empfehlen wir, die Leerlauf-Timeout-Zeit größer als die Häufigkeit des Verarbeitungsjobs zu machen. Andernfalls könnten einige Verarbeitungsjobs fehlschlagen, weil das Aktualisierungstoken abgelaufen ist, bevor sie ausgeführt werden konnten. Wenn das Aktualisierungstoken abläuft, muss sich der Benutzer erneut authentifizieren, indem er auf die Verbindung zugreift, die er über Data Wrangler zu Snowflake hergestellt hat.

Beachten Sie, dass Data Wrangler rotierende Aktualisierungstoken nicht unterstützt. Die Verwendung rotierender Aktualisierungstoken kann zu Zugriffsfehlern führen oder Benutzer müssen sich häufig anmelden.

Wenn das Aktualisierungstoken abläuft, müssen sich Ihre Benutzer erneut authentifizieren, indem sie auf die Verbindung zugreifen, die sie über Data Wrangler zu Snowflake hergestellt haben.

- Angeben

session:role-anyals neuer Geltungsbereich.

Für Azure AD müssen Sie außerdem einen eindeutigen Bezeichner für den Bereich angeben.

Nachdem Sie den OAuth-Anbieter eingerichtet haben, stellen Sie Data Wrangler die Informationen zur Verfügung, die für die Verbindung mit dem Anbieter erforderlich sind. Sie können die Dokumentation Ihres IdP verwenden, um Werte für die folgenden Felder abzurufen:

- Token-URL – Die URL des Tokens, das der IdP an Data Wrangler sendet

- Autorisierungs-URL – Die URL des Autorisierungsservers des IdP

- Kunden-ID – Die ID des IdP

- Kundengeheimnis – Das Geheimnis, das nur der Autorisierungsserver oder die API erkennt

- OAuth-Bereich – Dies gilt nur für Azure AD

Snowflake konfigurieren

Um Snowflake zu konfigurieren, befolgen Sie die Anweisungen in Importieren Sie Daten aus Snowflake.

Verwenden Sie die Snowflake-Dokumentation für Ihren IdP, um eine externe OAuth-Integration in Snowflake einzurichten. Siehe vorheriger Abschnitt Registrieren Sie die Data Wrangler-Anwendung beim IdP für weitere Informationen zum Einrichten einer externen OAuth-Integration.

Stellen Sie beim Einrichten der Sicherheitsintegration in Snowflake sicher, dass Sie sie aktivieren external_oauth_any_role_mode.

Konfigurieren Sie SageMaker Studio

Sie speichern die Felder und Werte in einem Secrets Manager-Secret und fügen es der Studio-Lebenszykluskonfiguration hinzu, die Sie für Data Wrangler verwenden. Eine Lebenszykluskonfiguration ist ein Shell-Skript, das automatisch die im Geheimnis gespeicherten Anmeldeinformationen lädt, wenn sich der Benutzer bei Studio anmeldet. Informationen zum Erstellen von Geheimnissen finden Sie unter Verschieben Sie hartcodierte Geheimnisse in AWS Secrets Manager. Informationen zur Verwendung von Lebenszykluskonfigurationen in Studio finden Sie unter Verwenden Sie Lebenszykluskonfigurationen mit Amazon SageMaker Studio.

Erstellen Sie ein Geheimnis für Snowflake-Anmeldeinformationen

Führen Sie die folgenden Schritte aus, um Ihr Geheimnis für Snowflake-Anmeldeinformationen zu erstellen:

- Wählen Sie in der Secrets Manager-Konsole aus Speichern Sie ein neues Geheimnis.

- Aussichten für Geheimer TypWählen Andere Art von Geheimnis.

- Geben Sie die Details Ihres Geheimnisses als Schlüssel-Wert-Paare an.

Tastennamen erfordern aus Gründen der Groß- und Kleinschreibung Kleinbuchstaben. Data Wrangler gibt eine Warnung aus, wenn Sie diese falsch eingeben. Geben Sie die geheimen Werte als Schlüssel-Wert-Paare Schlüssel/Wert ein, wenn Sie möchten, oder verwenden Sie die Klartext .

Das Folgende ist das Format des Geheimnisses, das für Okta verwendet wird. Wenn Sie Azure AD verwenden, müssen Sie die hinzufügen datasource_oauth_scope Feld.

- Aktualisieren Sie die vorstehenden Werte mit Ihrer Wahl des IdP und den Informationen, die nach der Anwendungsregistrierung gesammelt wurden.

- Auswählen Weiter.

- Aussichten für Geheimer Name, füge das Präfix hinzu

AmazonSageMaker(zum Beispiel ist unser GeheimnisAmazonSageMaker-DataWranglerSnowflakeCreds). - Im Schlüsselwörter Abschnitt, fügen Sie ein Tag mit dem Schlüssel hinzu

SageMakerund Werttrue. - Auswählen Weiter.

- Die restlichen Felder sind optional; wählen Weiter bis du die Möglichkeit hast zu wählen Geschäft das Geheimnis zu speichern.

Nachdem Sie das Geheimnis gespeichert haben, kehren Sie zur Secrets Manager-Konsole zurück.

- Wählen Sie das gerade erstellte Geheimnis aus und rufen Sie dann den geheimen ARN ab.

- Speichern Sie diese in Ihrem bevorzugten Texteditor, um sie später beim Erstellen der Data Wrangler-Datenquelle zu verwenden.

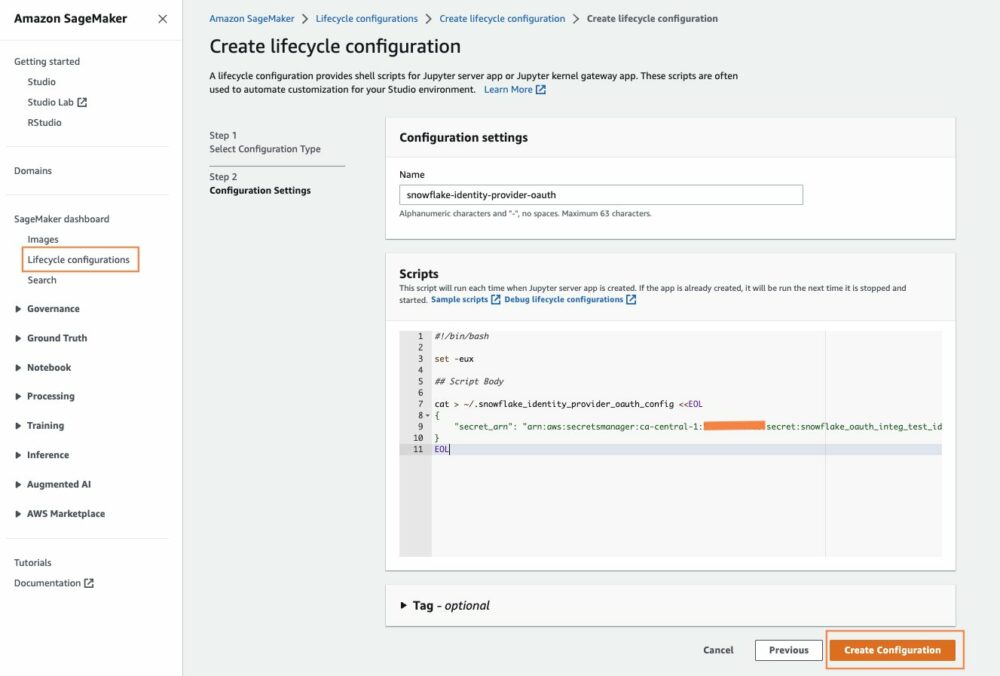

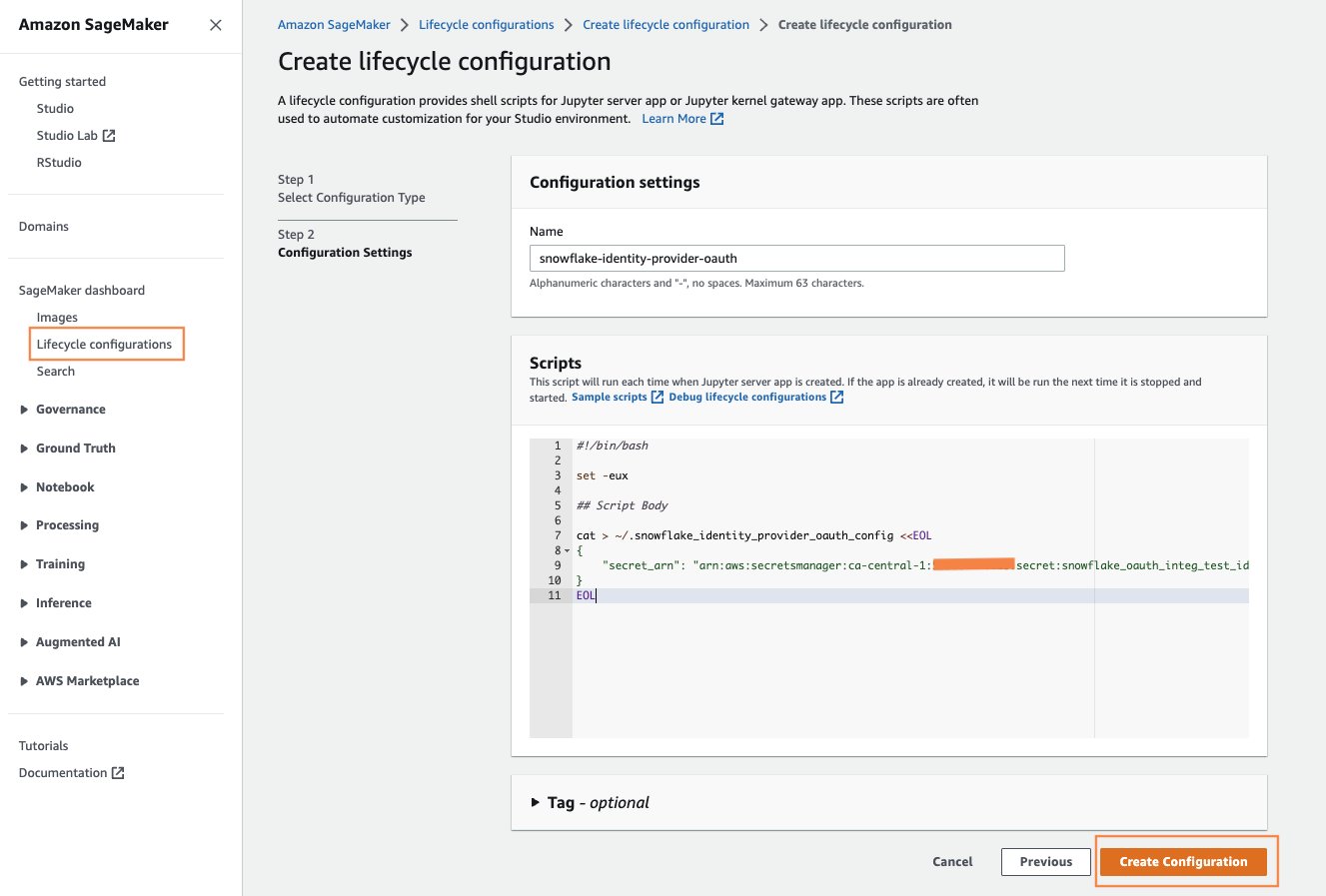

Erstellen Sie eine Studio-Lebenszykluskonfiguration

Führen Sie die folgenden Schritte aus, um eine Lebenszykluskonfiguration in Studio zu erstellen:

- Wählen Sie in der SageMaker-Konsole Lebenszykluskonfigurationen im Navigationsbereich.

- Auswählen Konfiguration erstellen.

- Auswählen Jupyter-Server-App.

- Erstellen Sie eine neue Lebenszykluskonfiguration oder hängen Sie eine vorhandene mit folgendem Inhalt an:

Die Konfiguration erstellt eine Datei mit dem Namen ".snowflake_identity_provider_oauth_config", die das Geheimnis im Home-Ordner des Benutzers enthält.

- Auswählen

Konfiguration erstellen.

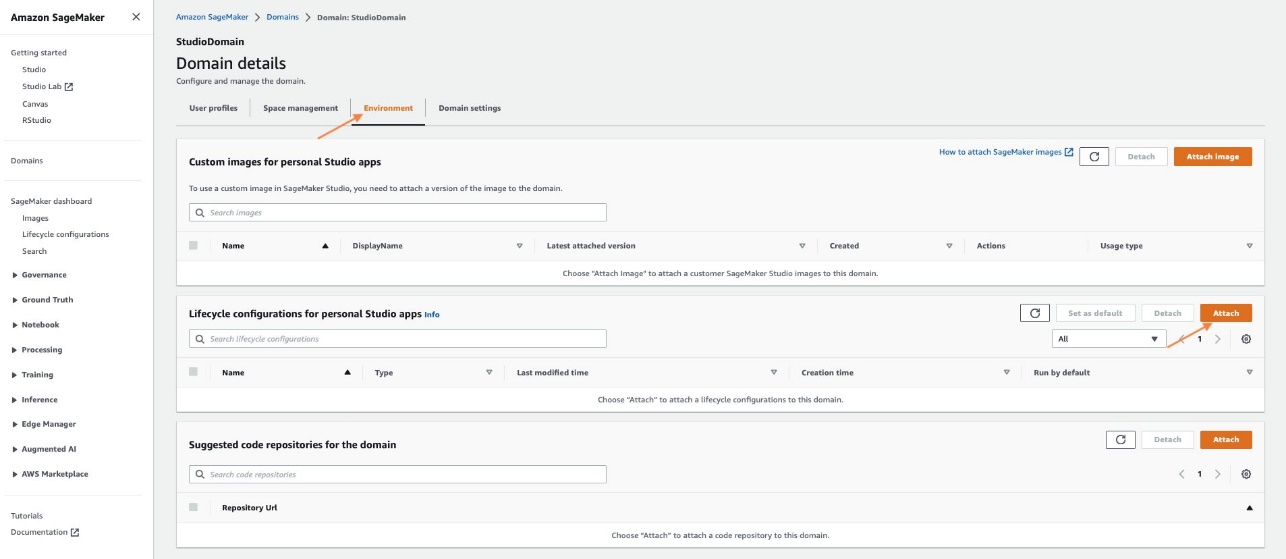

Legen Sie die standardmäßige Lebenszykluskonfiguration fest

Führen Sie die folgenden Schritte aus, um die soeben erstellte Lebenszykluskonfiguration als Standard festzulegen:

- Wählen Sie in der SageMaker-Konsole Domains im Navigationsbereich.

- Wählen Sie die Studio-Domain aus, die Sie für dieses Beispiel verwenden werden.

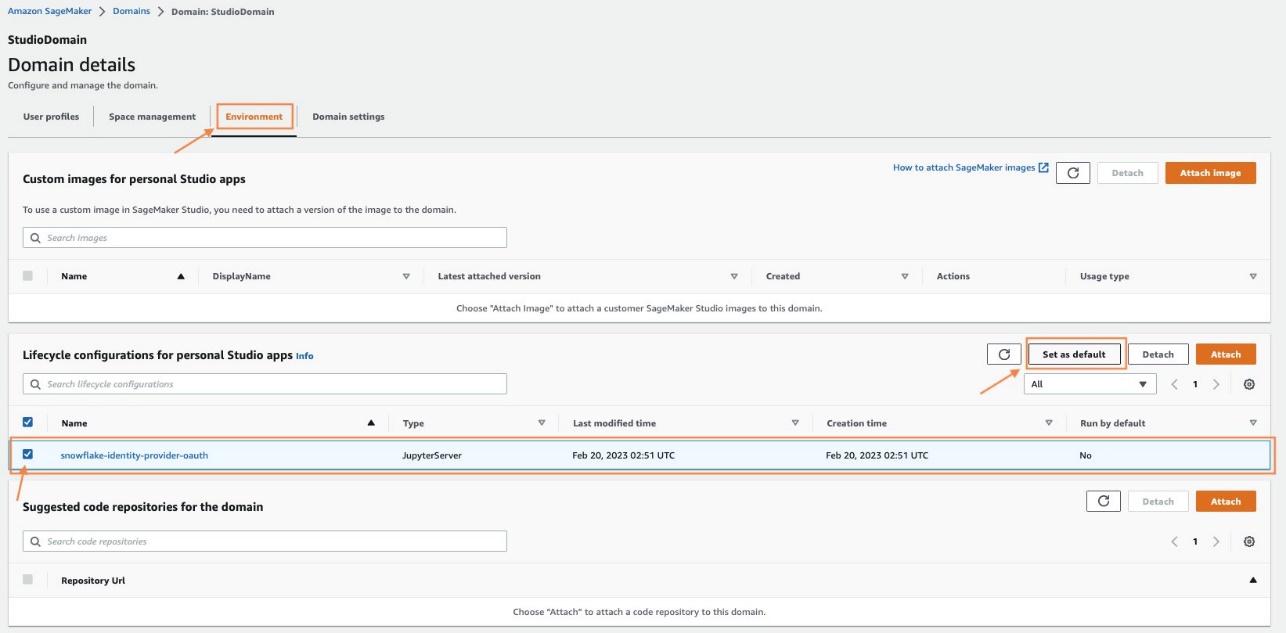

- Auf dem Arbeitsumfeld Registerkarte, in der Lebenszykluskonfigurationen für persönliche Studio-Apps Wählen Sie im Abschnitt Anfügen.

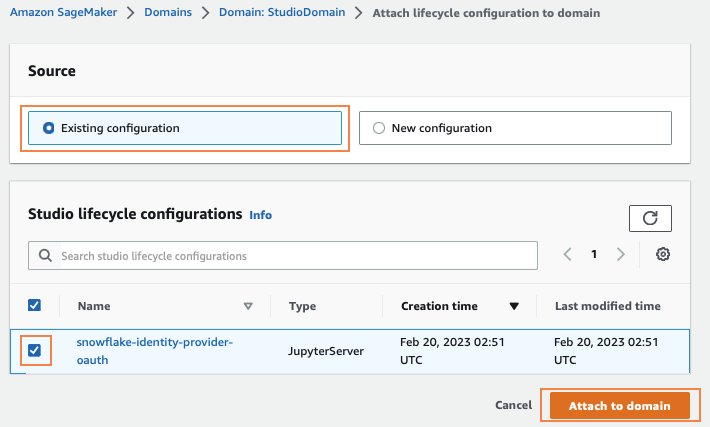

- Aussichten für QuelleWählen Bestehende Konfiguration.

- Wählen Sie die gerade erstellte Konfiguration aus und wählen Sie dann An Domäne anhängen.

- Wählen Sie die neue Konfiguration aus und wählen Sie Als Standard, Dann wählen Als Standard erneut in der Popup-Nachricht.

Ihre neuen Einstellungen sollten nun unter sichtbar sein Lebenszykluskonfigurationen für persönliche Studio-Apps als Standard.

- Beenden Sie die Studio-App und starten Sie sie neu, damit die Änderungen wirksam werden.

Erfahrung als Data Scientist

In diesem Abschnitt behandeln wir, wie Data Scientists eine Verbindung zu Snowflake als Datenquelle in Data Wrangler herstellen und Daten für ML vorbereiten können.

Erstellen Sie einen neuen Datenfluss

Führen Sie die folgenden Schritte aus, um Ihren Datenfluss zu erstellen:

- Wählen Sie in der SageMaker-Konsole Amazon SageMaker-Studio im Navigationsbereich.

- Auswählen Open Studio.

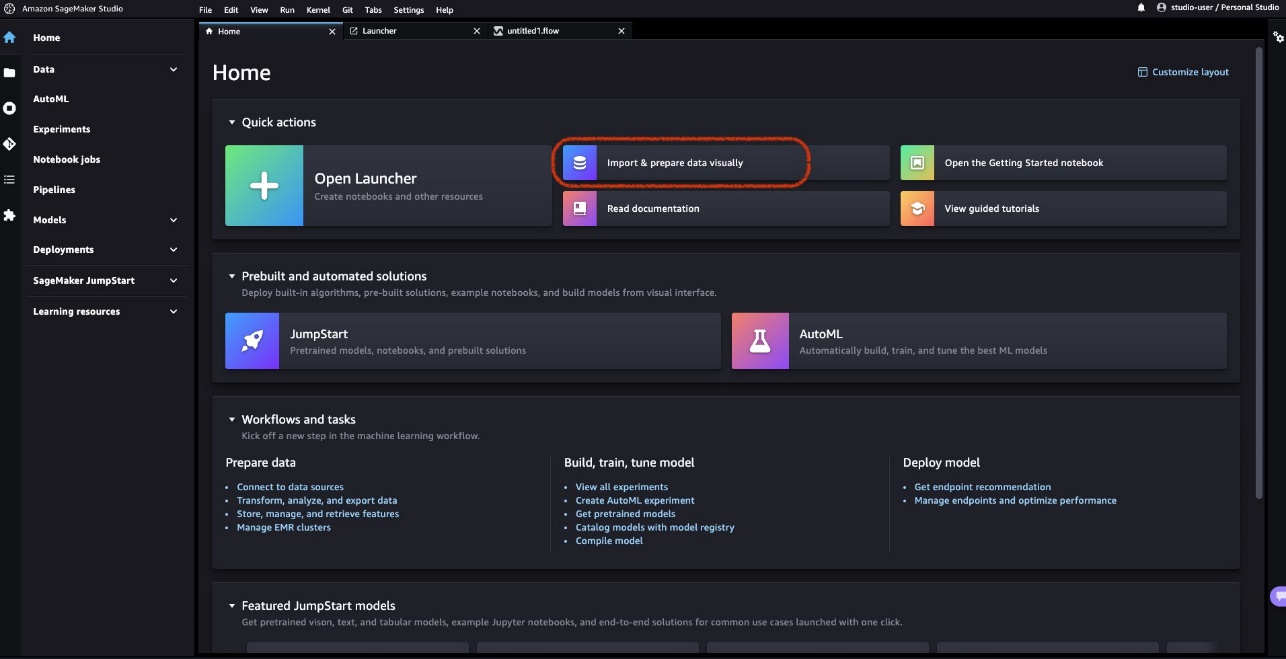

- Auf dem Studio Startseite Seite wählen Daten visuell importieren und aufbereiten. Alternativ auf der Reichen Sie das Dropdown, wählen Sie Neu, Dann wählen SageMaker Data Wrangler-Flow.

Das Erstellen eines neuen Flows kann einige Minuten dauern.

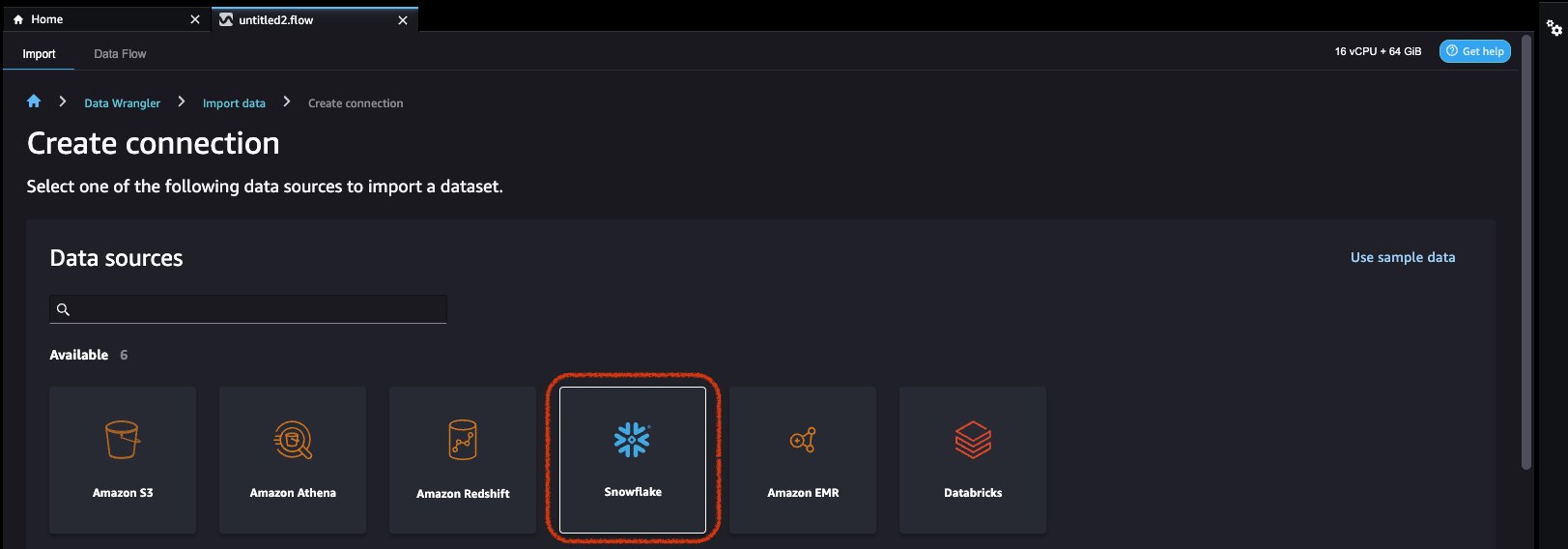

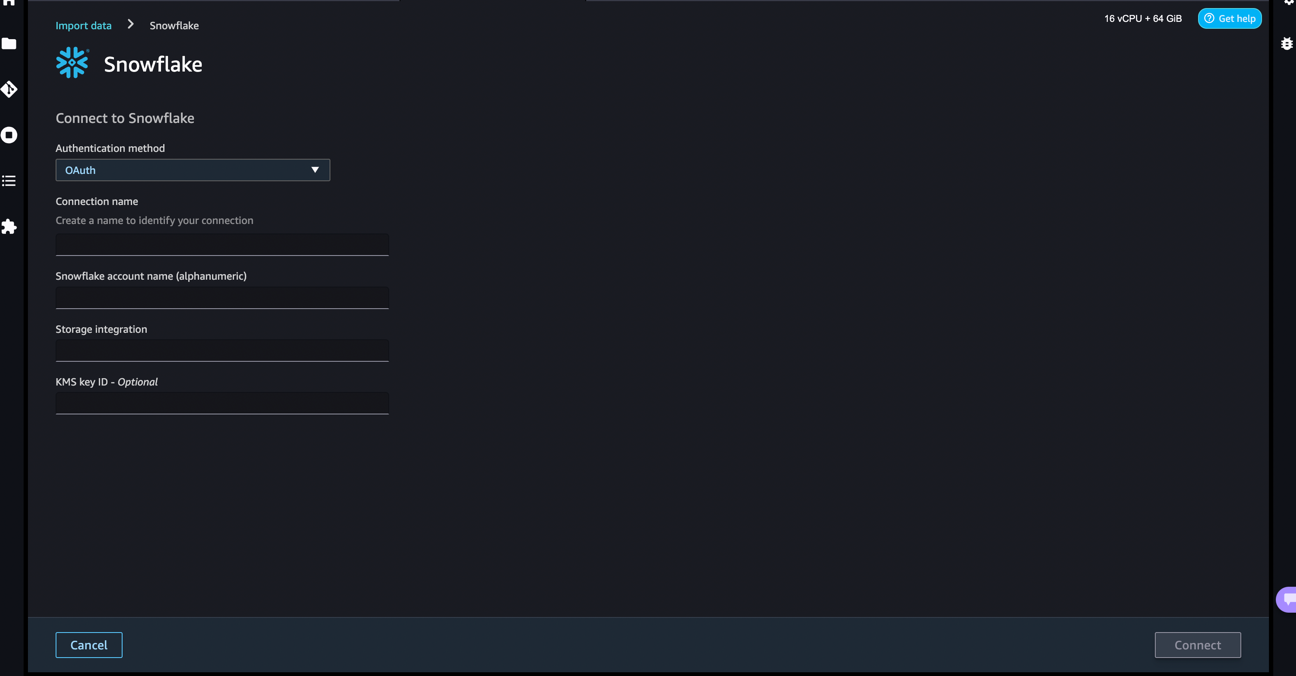

- Auf dem Daten importieren Seite wählen Verbindung herstellen.

- Auswählen

Schneeflocke aus der Liste der Datenquellen.

- Aussichten für Authentifizierungsmethode, wählen OAuth.

Wenn OAuth nicht angezeigt wird, überprüfen Sie die vorherigen Schritte zur Lebenszykluskonfiguration.

- Geben Sie Details ein für Snowflake-Kontoname und Speicherintegration.

- Geben Sie einen Verbindungsnamen ein und wählen Sie Vernetz Dich.

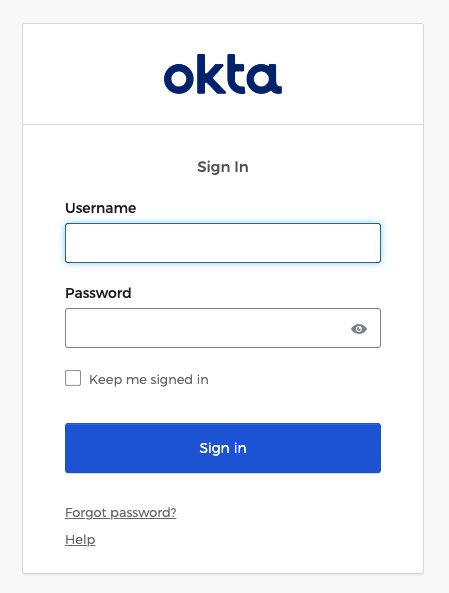

Sie werden zu einer IdP-Authentifizierungsseite weitergeleitet. Für dieses Beispiel verwenden wir Okta.

- Geben Sie Ihren Benutzernamen und Ihr Passwort ein und wählen Sie dann Anmelden.

Nach erfolgreicher Authentifizierung werden Sie zur Datenflussseite von Studio weitergeleitet.

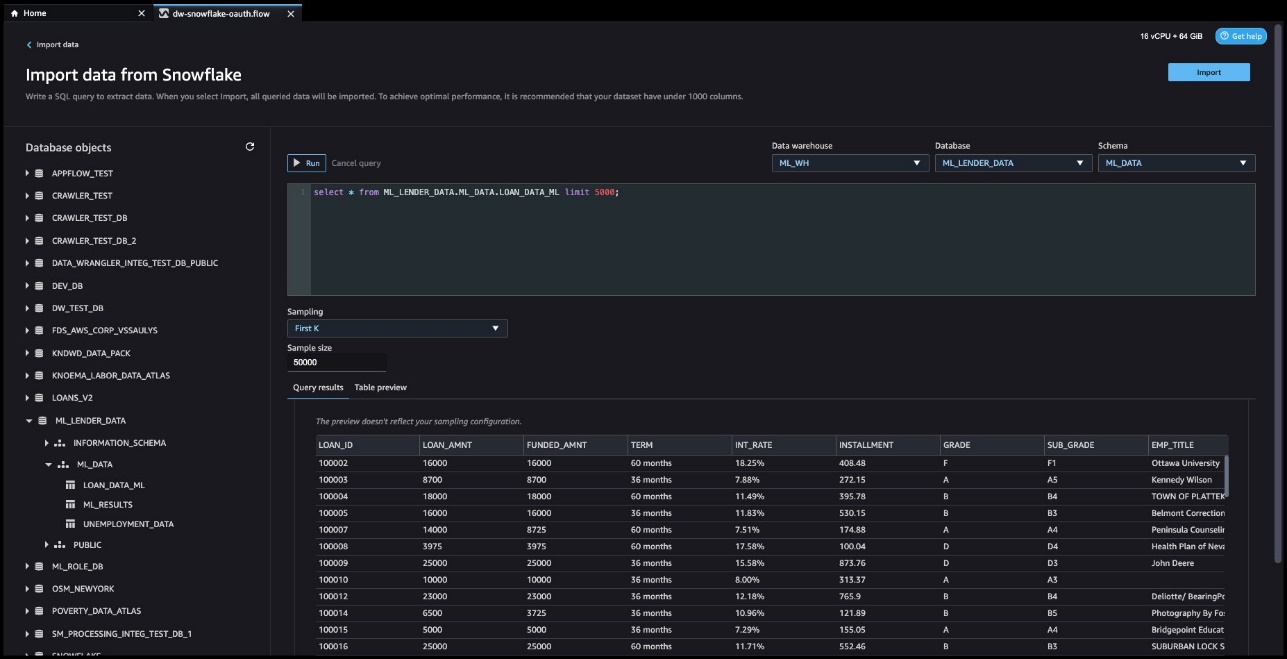

- Auf dem Importieren Sie Daten aus Snowflake Seite, durchsuchen Sie die Datenbankobjekte oder führen Sie eine Abfrage für die Zieldaten aus.

- Geben Sie im Abfrageeditor eine Abfrage ein und zeigen Sie die Ergebnisse in der Vorschau an.

Im folgenden Beispiel laden wir Ausleihdaten und alle Spalten aus 5,000 Zeilen abrufen.

- Auswählen

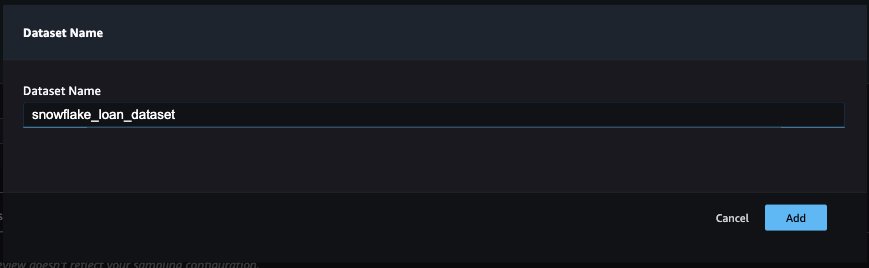

Import.

- Geben Sie einen Datensatznamen ein (für diesen Beitrag verwenden wir

snowflake_loan_dataset) und wähle Speichern.

Sie werden zu weitergeleitet Danach Seite, auf der Sie Transformationen und Analysen zu den Daten hinzufügen können.

Data Wrangler erleichtert die Aufnahme von Daten und die Durchführung von Datenvorbereitungsaufgaben wie explorative Datenanalyse, Feature-Auswahl und Feature-Engineering. Wir haben in diesem Beitrag zur Datenvorbereitung nur einige der Möglichkeiten von Data Wrangler behandelt; Sie können Data Wrangler für erweiterte Datenanalysen verwenden, z. B. Merkmalsbedeutung, Zielverlust und Modellerklärbarkeit über eine einfache und intuitive Benutzeroberfläche.

Datenqualität analysieren

Verwenden Sie das Datenqualitäts- und Insights-Bericht um eine Analyse der Daten durchzuführen, die Sie in Data Wrangler importiert haben. Data Wrangler erstellt den Bericht aus den Stichprobendaten.

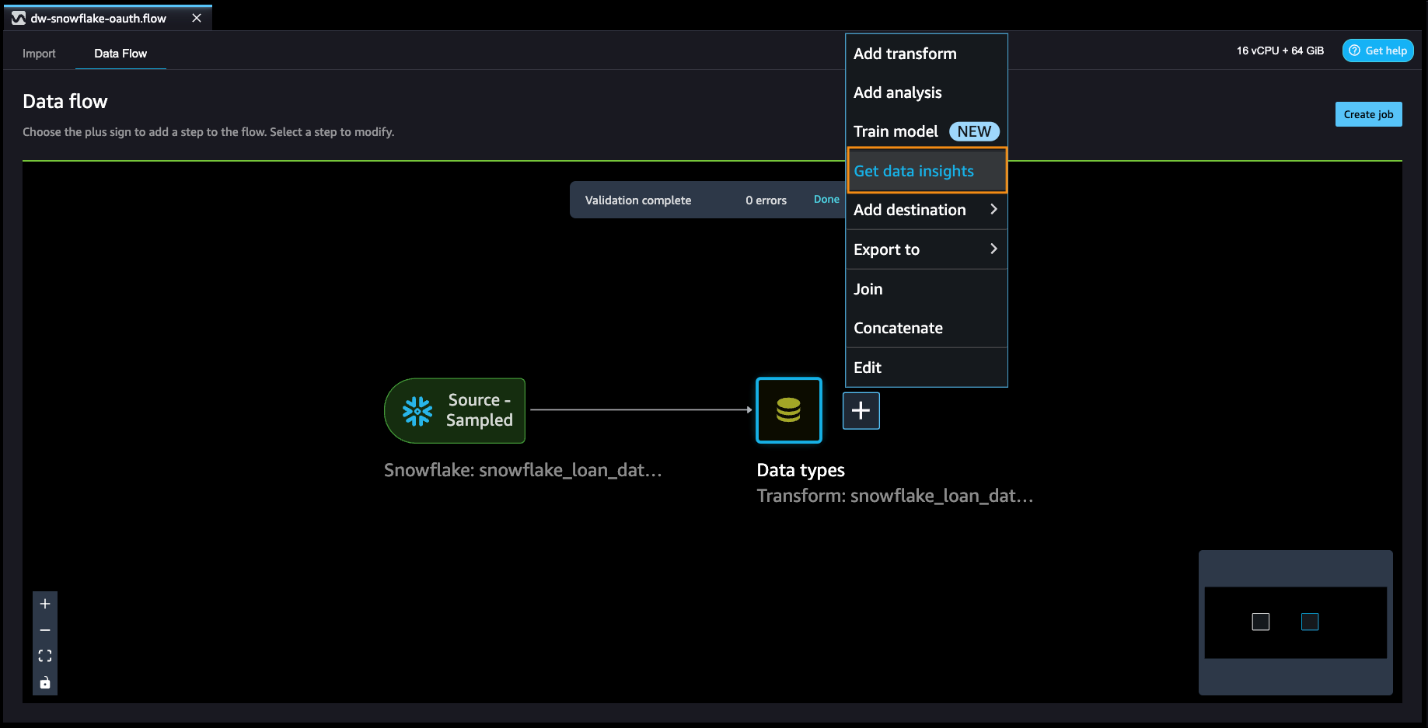

- Wählen Sie auf der Seite Data Wrangler-Flow das Pluszeichen neben aus Datentypen, Dann wählen Erhalten Sie Dateneinblicke.

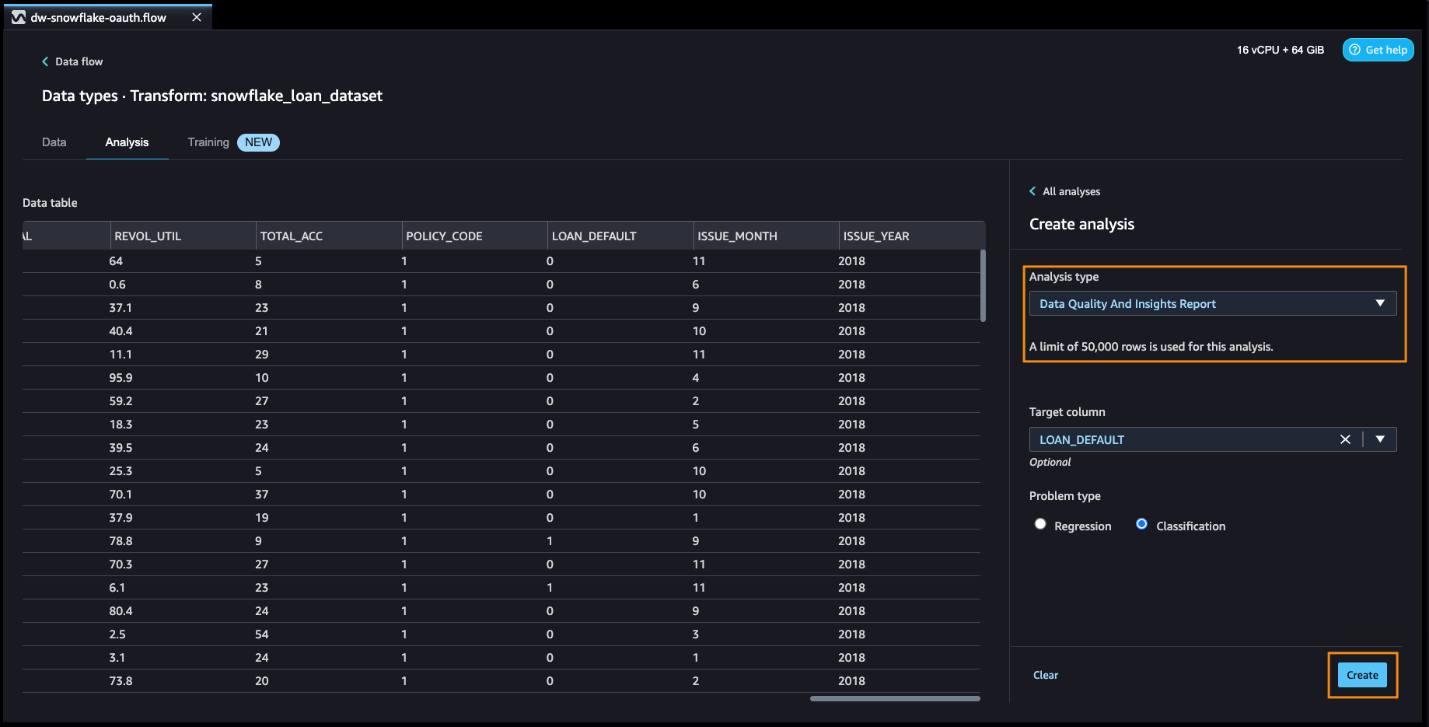

- Auswählen Datenqualitäts- und Insights-Bericht für Analysetyp.

- Aussichten für Zielspalte, wählen Sie Ihre Zielspalte aus.

- Aussichten für ProblemtypWählen Klassifikation.

- Auswählen

Erstellen.

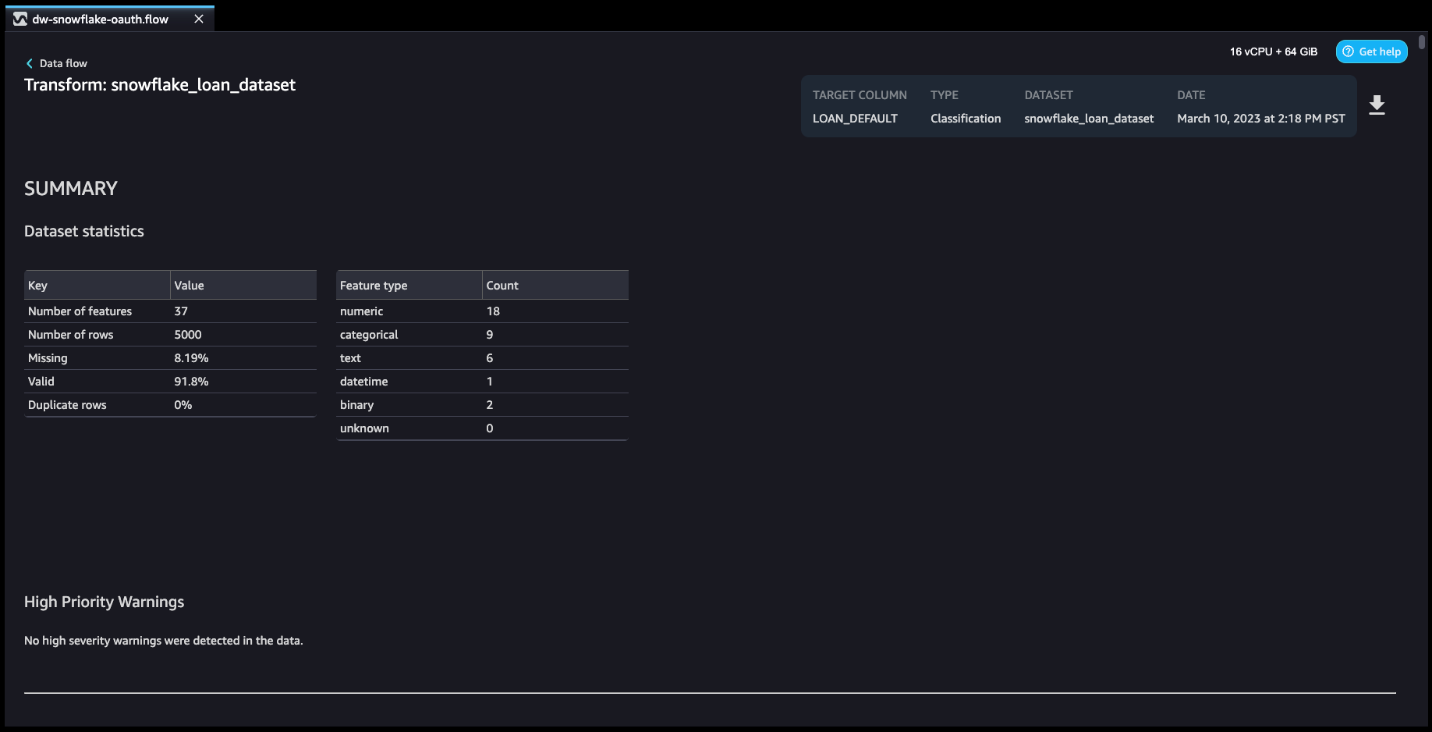

Der Insights-Bericht enthält eine kurze Zusammenfassung der Daten, die allgemeine Informationen wie fehlende Werte, ungültige Werte, Feature-Typen, Anzahl der Ausreißer und mehr enthält. Sie können den Bericht entweder herunterladen oder online anzeigen.

Transformationen zu den Daten hinzufügen

Data Wrangler verfügt über über 300 integrierte Transformationen. In diesem Abschnitt verwenden wir einige dieser Transformationen, um das Dataset für ein ML-Modell vorzubereiten.

- Wählen Sie auf der Seite Data Wrangler-Fluss das Pluszeichen und dann Auswählen aus Transformation hinzufügen.

Wenn Sie den Schritten im Beitrag folgen, werden Sie automatisch hierher geleitet, nachdem Sie Ihren Datensatz hinzugefügt haben.

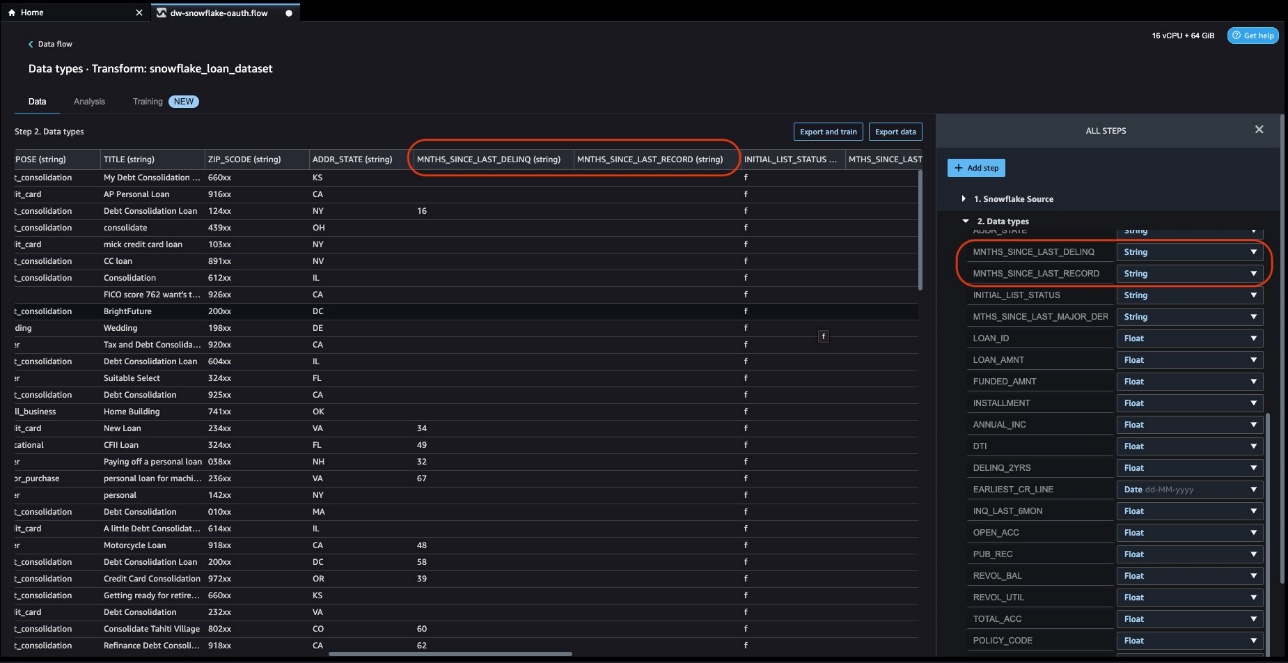

- Überprüfen und ändern Sie den Datentyp der Spalten.

Wenn wir die Spalten durchsehen, erkennen wir das MNTHS_SINCE_LAST_DELINQ und MNTHS_SINCE_LAST_RECORD sollte höchstwahrscheinlich eher als Zahlentyp als als Zeichenfolge dargestellt werden.

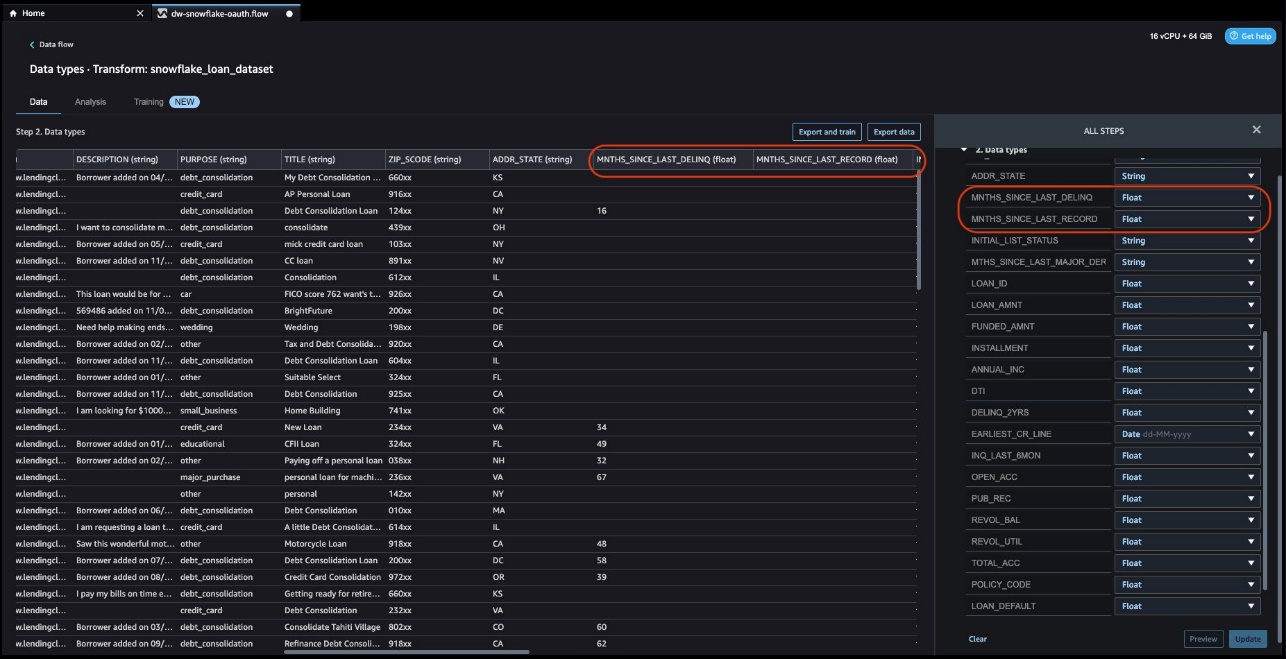

- Nachdem Sie die Änderungen übernommen und den Schritt hinzugefügt haben, können Sie überprüfen, ob der Datentyp der Spalte in Float geändert wurde.

Wenn wir die Daten durchsehen, können wir sehen, dass die Felder EMP_TITLE, URL, DESCRIPTION und TITLE werden unserem Modell in unserem Anwendungsfall wahrscheinlich keinen Wert verleihen, sodass wir sie fallen lassen können.

- Auswählen Schritt hinzufügen, Dann wählen Spalten verwalten.

- Aussichten für Transformieren, wählen Spalte löschen.

- Aussichten für Spalte zum Ablegen, spezifizieren

EMP_TITLE,URL,DESCRIPTIONundTITLE. - Auswählen Vorspann und Speichern.

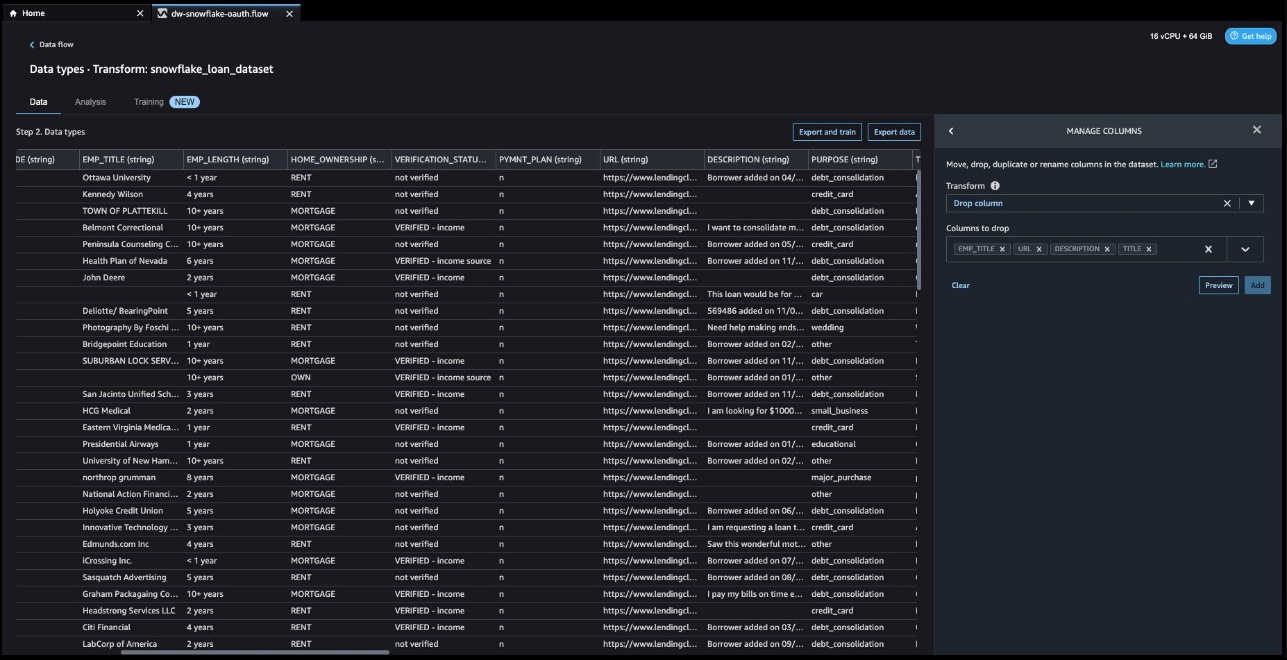

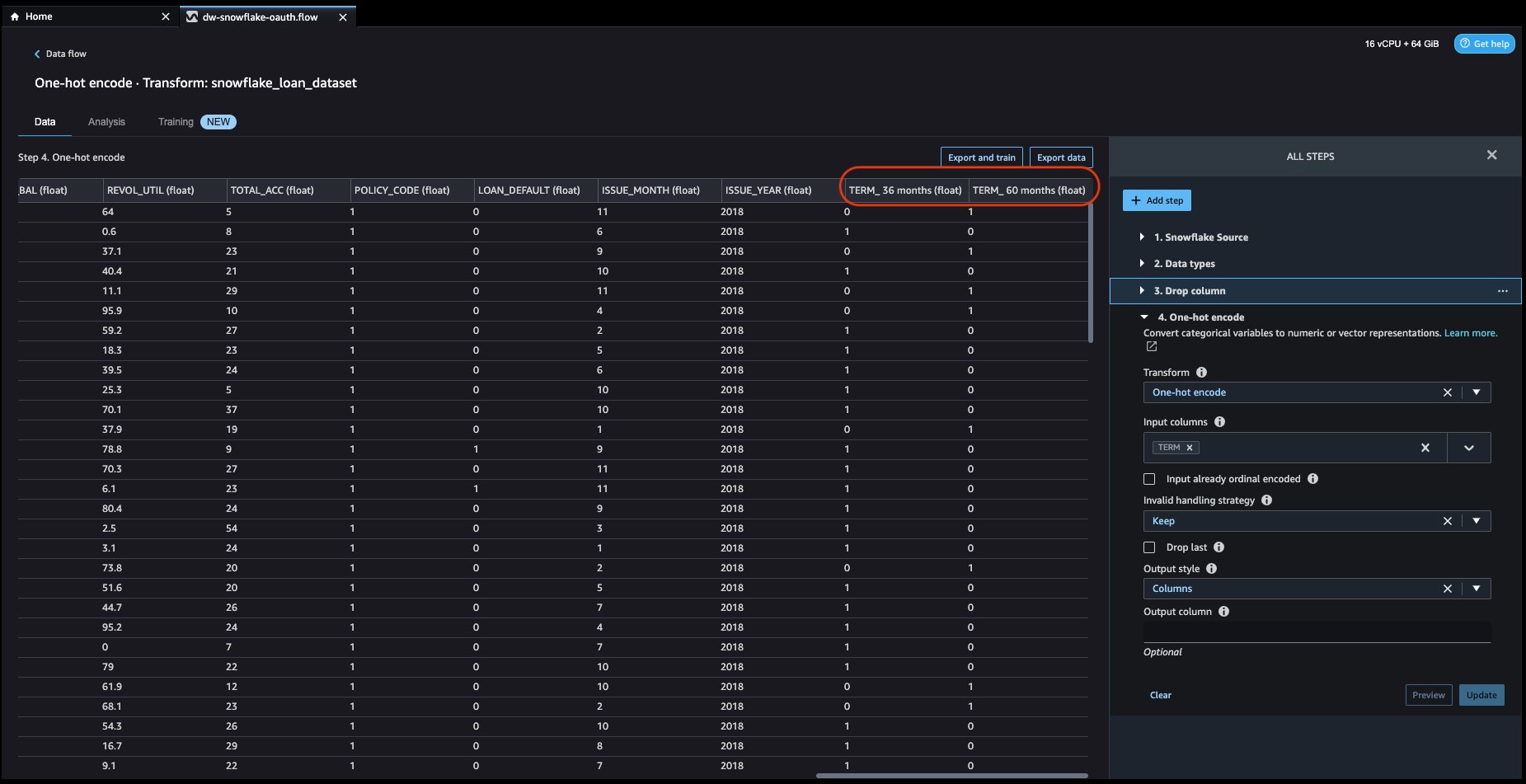

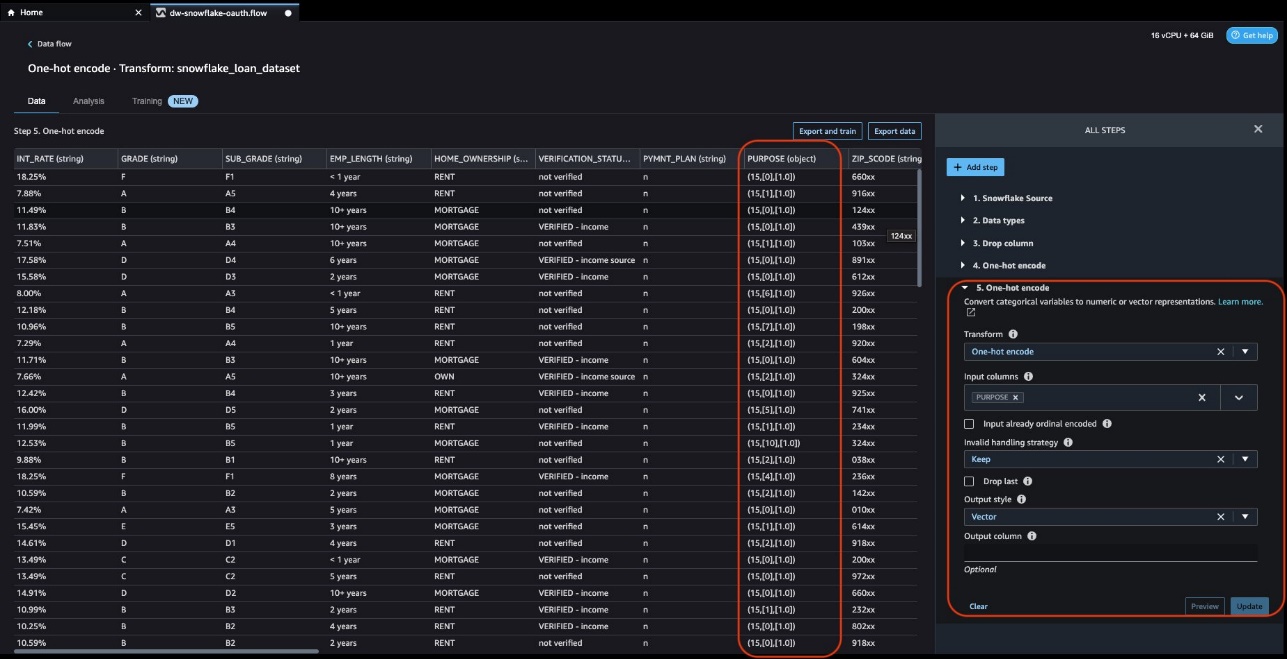

Als Nächstes möchten wir in unserem Datensatz nach kategorialen Daten suchen. Data Wrangler verfügt über eine integrierte Funktionalität zum Kodieren kategorialer Daten mit ordinalen und One-Hot-Kodierungen. Wenn wir uns unseren Datensatz ansehen, können wir sehen, dass die TERM, HOME_OWNERSHIP und PURPOSE Spalten scheinen alle kategorisch zu sein.

- Fügen Sie einen weiteren Schritt hinzu und wählen Sie aus Kategorial kodieren.

- Aussichten für Transformieren, wählen One-Hot-Codierung.

- Aussichten für Eingabespalte, wählen

TERM. - Aussichten für Ausgabestil, wählen Spalten.

- Belassen Sie alle anderen Einstellungen auf den Standardeinstellungen und wählen Sie dann aus Vorspann und Speichern.

Das HOME_OWNERSHIP Spalte hat vier mögliche Werte: RENT, MORTGAGE, OWN, und andere.

- Wiederholen Sie die vorherigen Schritte, um einen One-Hot-Codierungsansatz auf diese Werte anzuwenden.

Schließlich ist die PURPOSE Spalte hat mehrere mögliche Werte. Für diese Daten verwenden wir ebenfalls einen One-Hot-Codierungsansatz, setzen die Ausgabe jedoch auf einen Vektor und nicht auf Spalten.

- Aussichten für Transformieren, wählen One-Hot-Codierung.

- Aussichten für Eingabespalte, wählen

PURPOSE. - Aussichten für Ausgabestil, wählen Vector.

- Aussichten für Ausgabespalte, wir nennen diese Spalte

PURPOSE_VCTR.

So bleibt das Original erhalten PURPOSE Spalte, wenn wir uns entschließen, sie später zu verwenden.

- Belassen Sie alle anderen Einstellungen auf den Standardeinstellungen und wählen Sie dann aus Vorspann und Speichern.

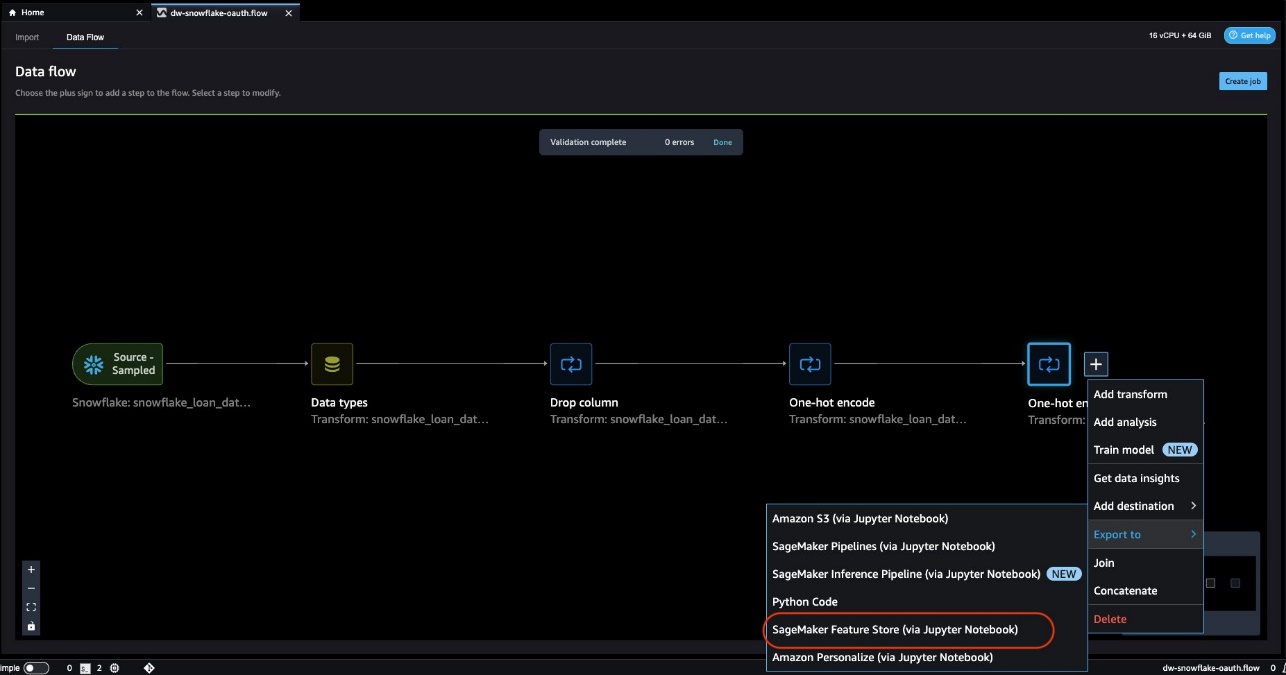

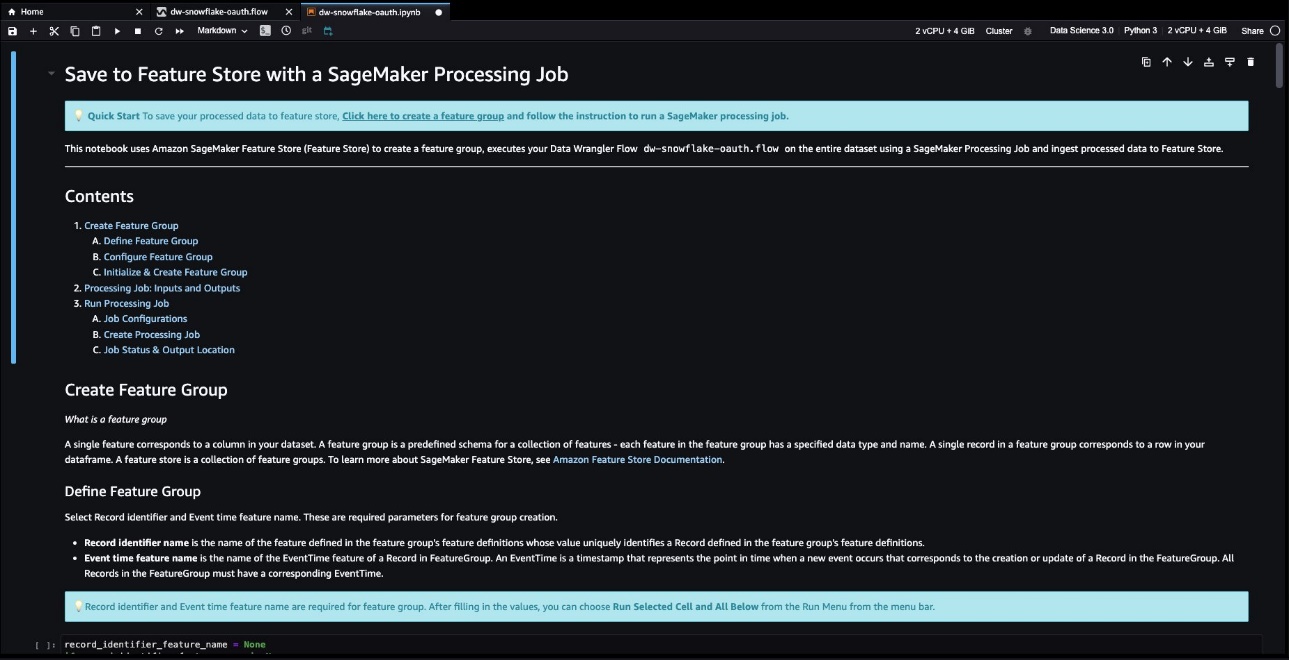

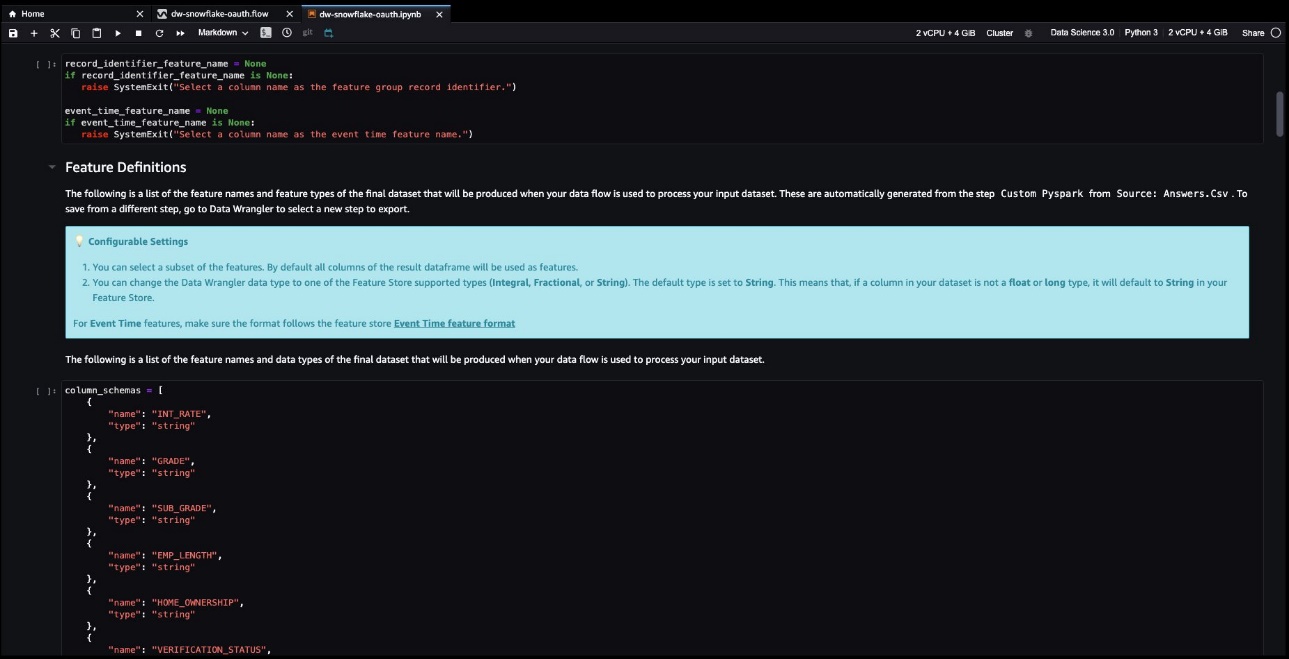

Exportieren Sie den Datenfluss

Schließlich exportieren wir diesen gesamten Datenfluss mit einem SageMaker Processing-Job in einen Feature Store, der ein Jupyter-Notebook mit dem vorab ausgefüllten Code erstellt.

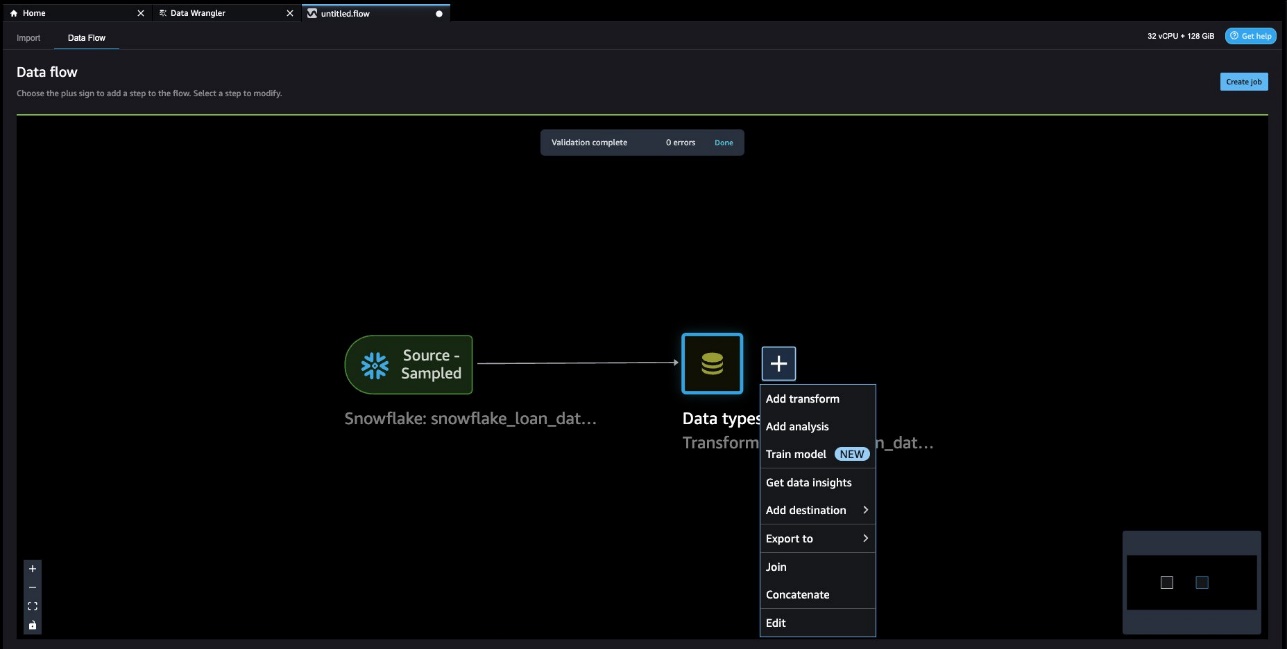

- Wählen Sie auf der Datenflussseite das Pluszeichen und aus Exportieren nach.

- Wählen Sie aus, wohin exportiert werden soll. Für unseren Anwendungsfall wählen wir SageMaker Feature Store.

Das exportierte Notebook ist jetzt betriebsbereit.

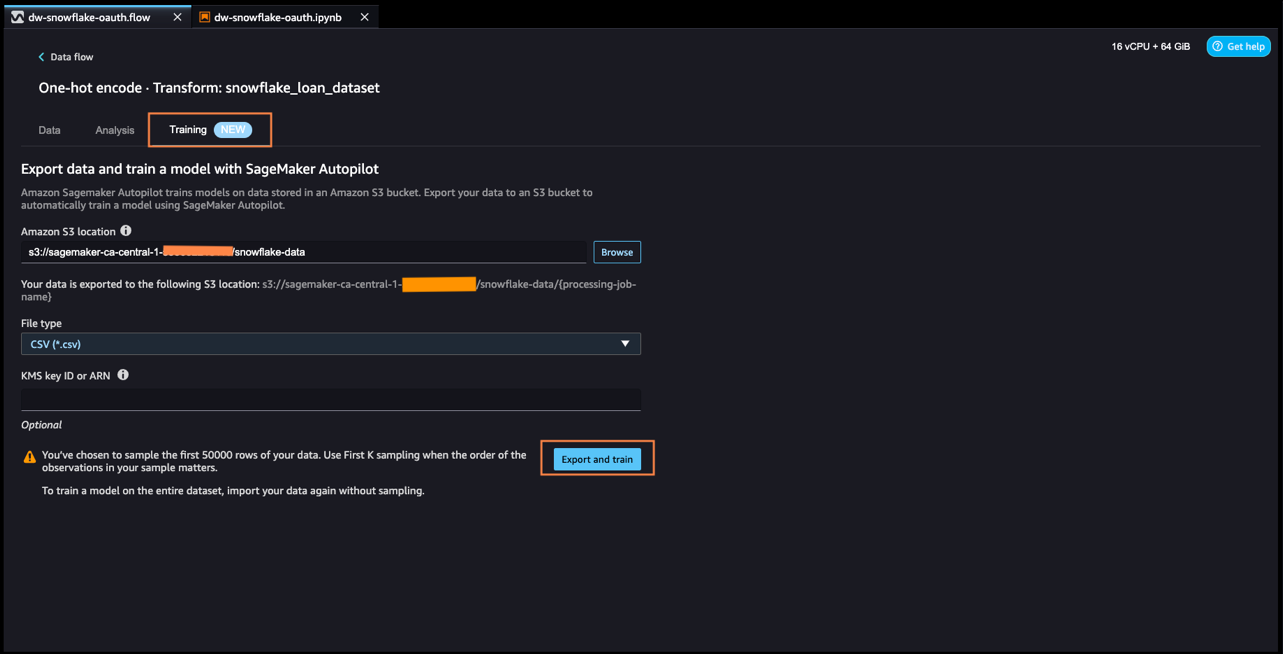

Exportieren Sie Daten und trainieren Sie ein Modell mit Autopilot

Jetzt können wir das Modell mit trainieren Amazon SageMaker-Autopilot.

- Wählen Sie auf der Datenflussseite die aus Ausbildung Tab.

- Aussichten für Amazon S3-Standort, geben Sie einen Speicherort für die zu speichernden Daten ein.

- Auswählen

Exportieren und trainieren.

- Legen Sie die Einstellungen in der fest Ziel und Funktionen, Trainingsmethode, Bereitstellung und erweiterte Einstellungen und Überprüfen und erstellen .

- Auswählen Versuch erstellen um das beste Modell für Ihr Problem zu finden.

Aufräumen

Wenn Ihre Arbeit mit Data Wrangler abgeschlossen ist, Fahren Sie Ihre Data Wrangler-Instanz herunter um zusätzliche Gebühren zu vermeiden.

Zusammenfassung

In diesem Beitrag haben wir das Verbinden demonstriert Data Wrangler zu Snowflake mit OAuth, ein Dataset transformieren und analysieren und schließlich in den Datenfluss exportieren, damit es in einem Jupyter-Notebook verwendet werden kann. Vor allem haben wir eine Pipeline für die Datenvorbereitung erstellt, ohne überhaupt Code schreiben zu müssen.

Informationen zu den ersten Schritten mit Data Wrangler finden Sie unter Vorbereiten von ML-Daten mit Amazon SageMaker Data Wrangler.

Über die Autoren

Ajjay Govindaram ist Senior Solutions Architect bei AWS. Er arbeitet mit strategischen Kunden zusammen, die KI/ML einsetzen, um komplexe Geschäftsprobleme zu lösen. Seine Erfahrung liegt in der Bereitstellung von technischer Anleitung sowie Designunterstützung für bescheidene bis große KI/ML-Anwendungsbereitstellungen. Sein Wissen reicht von Anwendungsarchitektur bis hin zu Big Data, Analytik und maschinellem Lernen. Er genießt es, Musik zu hören, während er sich ausruht, die Natur zu erleben und Zeit mit seinen Lieben zu verbringen.

Ajjay Govindaram ist Senior Solutions Architect bei AWS. Er arbeitet mit strategischen Kunden zusammen, die KI/ML einsetzen, um komplexe Geschäftsprobleme zu lösen. Seine Erfahrung liegt in der Bereitstellung von technischer Anleitung sowie Designunterstützung für bescheidene bis große KI/ML-Anwendungsbereitstellungen. Sein Wissen reicht von Anwendungsarchitektur bis hin zu Big Data, Analytik und maschinellem Lernen. Er genießt es, Musik zu hören, während er sich ausruht, die Natur zu erleben und Zeit mit seinen Lieben zu verbringen.

Bosco Albuquerque ist Sr. Partner Solutions Architect bei AWS und verfügt über mehr als 20 Jahre Erfahrung in der Arbeit mit Datenbank- und Analyseprodukten von Anbietern von Unternehmensdatenbanken und Cloud-Anbietern. Er hat große Technologieunternehmen bei der Entwicklung von Datenanalyselösungen unterstützt und Ingenieurteams bei der Entwicklung und Implementierung von Datenanalyseplattformen und Datenprodukten geleitet.

Bosco Albuquerque ist Sr. Partner Solutions Architect bei AWS und verfügt über mehr als 20 Jahre Erfahrung in der Arbeit mit Datenbank- und Analyseprodukten von Anbietern von Unternehmensdatenbanken und Cloud-Anbietern. Er hat große Technologieunternehmen bei der Entwicklung von Datenanalyselösungen unterstützt und Ingenieurteams bei der Entwicklung und Implementierung von Datenanalyseplattformen und Datenprodukten geleitet.

Matt Marzillo ist Senior Partner Sales Engineer bei Snowflake. Er verfügt über 10 Jahre Erfahrung in den Bereichen Datenwissenschaft und maschinelles Lernen, sowohl in der Beratung als auch bei Branchenorganisationen. Matt hat Erfahrung in der Entwicklung und Bereitstellung von KI- und ML-Modellen in vielen verschiedenen Organisationen in Bereichen wie Marketing, Vertrieb, Betrieb, Klinik und Finanzen sowie in beratenden Funktionen.

Matt Marzillo ist Senior Partner Sales Engineer bei Snowflake. Er verfügt über 10 Jahre Erfahrung in den Bereichen Datenwissenschaft und maschinelles Lernen, sowohl in der Beratung als auch bei Branchenorganisationen. Matt hat Erfahrung in der Entwicklung und Bereitstellung von KI- und ML-Modellen in vielen verschiedenen Organisationen in Bereichen wie Marketing, Vertrieb, Betrieb, Klinik und Finanzen sowie in beratenden Funktionen.

Huong Nguyen ist Produktführer für Amazon SageMaker Data Wrangler bei AWS. Sie verfügt über 15 Jahre Erfahrung in der Entwicklung kundenorientierter und datengesteuerter Produkte für Unternehmen und Verbraucher. In ihrer Freizeit liebt sie Hörbücher, Gartenarbeit, Wandern und verbringt Zeit mit ihrer Familie und Freunden.

Huong Nguyen ist Produktführer für Amazon SageMaker Data Wrangler bei AWS. Sie verfügt über 15 Jahre Erfahrung in der Entwicklung kundenorientierter und datengesteuerter Produkte für Unternehmen und Verbraucher. In ihrer Freizeit liebt sie Hörbücher, Gartenarbeit, Wandern und verbringt Zeit mit ihrer Familie und Freunden.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/access-snowflake-data-using-oauth-based-authentication-in-amazon-sagemaker-data-wrangler/

- :Ist

- $UP

- 000

- 10

- 100

- 15 Jahre

- 20 Jahre

- 7

- 8

- 9

- a

- Fähig

- Über Uns

- Zugang

- Zugriff auf Daten

- Zugriff

- Konto

- über

- Ad

- Zusatz

- Zusätzliche

- Administrator

- vorantreiben

- advanced

- Beratung

- Nach der

- AI

- AI / ML

- Alle

- Amazon

- Amazon Sage Maker

- Amazon SageMaker Data Wrangler

- Analysen

- Analyse

- Analytik

- analysieren

- Analyse

- und

- Ein anderer

- Bienen

- App

- erscheinen

- Anwendung

- Bewerbung

- Anwendung

- Ansatz

- Apps

- Architektur

- SIND

- Bereiche

- AS

- Hilfe

- damit verbundenen

- At

- anhängen

- Publikum

- Audio-

- authentifizieren

- Authentifizierung

- Genehmigung

- automatisieren

- Im Prinzip so, wie Sie es von Google Maps kennen.

- AWS

- Azure

- BE

- weil

- Bevor

- beginnen

- BESTE

- Big

- Big Data

- Körper

- Bücher

- eingebaut

- Geschäft

- by

- rufen Sie uns an!

- namens

- CAN

- Fähigkeiten

- Häuser

- CAT

- Änderungen

- Wahl

- Auswählen

- Auftraggeber

- Klinische

- Cloud

- Code

- Kolonne

- Spalten

- Unternehmen

- abschließen

- Komplex

- konzept

- Konfiguration

- Vernetz Dich

- Sich zusammenschliessen

- Verbindung

- Konsul (Console)

- Consulting

- Verbraucher

- Inhalt

- könnte

- Abdeckung

- bedeckt

- erstellen

- erstellt

- schafft

- Erstellen

- Referenzen

- Kunden

- technische Daten

- Datenanalyse

- Datenanalyse

- Datenplattform

- Datenaufbereitung

- Datenwissenschaft

- Datenwissenschaftler

- datengesteuerte

- Datenbase

- entscheidet

- Standard

- Synergie

- Bereitstellen

- Implementierungen

- Design

- Entwerfen

- Detail

- Details

- Entwicklung

- anders

- Richtung

- Direkt

- deutlich

- Dokumentation

- Tut nicht

- Domain

- Nicht

- nach unten

- herunterladen

- Drop

- jeder

- Herausgeber

- bewirken

- entweder

- ermöglichen

- Ingenieur

- Entwicklung

- Enter

- Unternehmen

- Arbeitsumfeld

- Beispiel

- vorhandenen

- ERFAHRUNGEN

- erleben

- Explorative Datenanalyse

- exportieren

- extern

- FAIL

- Familie

- Merkmal

- Eigenschaften

- Honorare

- wenige

- Feld

- Felder

- Reichen Sie das

- Endlich

- Finanzen

- Finden Sie

- Schwimmer

- Fluss

- Folgende

- Aussichten für

- Format

- Frequenz

- häufig

- Freunde

- für

- Funktionalität

- Allgemeines

- bekommen

- gibt

- gewähren

- mehr

- Anleitungen

- Haben

- mit

- Hilfe

- dazu beigetragen,

- hier

- Startseite

- Ultraschall

- Hilfe

- HTML

- http

- HTTPS

- ID

- Kennzeichnung

- identifizieren

- Identitätsschutz

- Leerlauf

- Umsetzung

- importieren

- Bedeutung

- in

- Dazu gehören

- Einschließlich

- falsch

- Energiegewinnung

- Information

- Varianten des Eingangssignals:

- Einblick

- Einblicke

- Anleitung

- Integration

- Integrationen

- Schnittstelle

- intuitiv

- beteiligt

- IT

- Job

- Jobs

- jpg

- Wesentliche

- Wissen

- grosse

- großflächig

- Führer

- lernen

- geführt

- liegt

- Lebenszyklus

- Lebensdauer

- Gefällt mir

- wahrscheinlich

- Liste

- Hören

- Belastung

- Belastungen

- Standorte

- aussehen

- suchen

- geliebt wird

- Maschine

- Maschinelles Lernen

- gemacht

- um

- MACHT

- Making

- Manager

- viele

- Marketing

- Nachricht

- könnte

- Minuten

- Kommt demnächst...

- ML

- Modell

- für

- ändern

- mehr

- vor allem warme

- mehrere

- Musik

- Name

- Namen

- Natur

- Menü

- Need

- benötigen

- Bedürfnisse

- Neu

- weiter

- vor allem

- Notizbuch

- Anzahl

- oauth

- Objekte

- of

- OKTA

- on

- EINEM

- Online

- Einkauf & Prozesse

- Option

- Organisationen

- Original

- Andere

- Andernfalls

- im Freien

- Möglichkeiten für das Ausgangssignal:

- besitzen

- Seite

- Paare

- Brot

- Partner

- Passwort

- Ausführen

- Berechtigungen

- persönliche

- Pipeline

- Plattform

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- erfahren

- Politik durchzulesen

- Pop-up

- möglich

- Post

- bevorzugt

- Danach

- Voraussetzungen

- Vorspann

- früher

- Aufgabenstellung:

- Probleme

- Verfahren

- Prozessdefinierung

- Verarbeitung

- Produkt

- Produkte

- Profil

- Programmierung

- richtig

- die

- vorausgesetzt

- Versorger

- Anbieter

- bietet

- Bereitstellung

- Qualität

- lieber

- bereit

- empfehlen

- umleiten

- Reduzierung

- Region

- Registrieren

- Registrieren

- Registrierung

- Relaunch

- berichten

- vertreten

- erfordern

- diejenigen

- REST

- Folge

- Die Ergebnisse

- Einzelhandel

- Rollen

- Rollen

- Führen Sie

- Laufen

- sagemaker

- Vertrieb

- Planung

- Wissenschaft

- Wissenschaftler

- Wissenschaftler

- Umfang

- Die Geheime

- Abschnitt

- Abschnitte

- Sicherheitdienst

- Auswahl

- Senior

- Sensitivität

- kompensieren

- Einstellung

- Einstellungen

- mehrere

- Schale

- sollte

- erklären

- Schild

- Einfacher

- Single

- So

- Lösungen

- LÖSEN

- einige

- Quelle

- Quellen

- Räume

- Ausgabe

- begonnen

- beginnt

- Schritt

- Shritte

- Lagerung

- speichern

- gelagert

- Speicherung

- Strategisch

- Schnur

- Studio Adressen

- erfolgreich

- so

- ZUSAMMENFASSUNG

- Support

- Unterstützt

- TAG

- Nehmen

- nimmt

- Target

- gezielt

- und Aufgaben

- Teams

- Technische

- Technologie

- Technologieunternehmen

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- die Informationen

- ihr

- Sie

- Diese

- Durch

- Zeit

- zu

- Zeichen

- Tokens

- Training

- Transformieren

- Transformationen

- Transformieren

- Typen

- für

- verstehen

- einzigartiges

- Aktualisierung

- URL

- -

- Anwendungsfall

- Mitglied

- Benutzerschnittstelle

- Nutzer

- Wert

- Werte

- Anbieter

- überprüfen

- Anzeigen

- sichtbar

- Walkthrough

- Warnung

- Wochen

- GUT

- welche

- während

- WHO

- ganze

- werden wir

- mit

- .

- ohne

- Arbeiten

- Workflows

- arbeiten,

- Werk

- schreiben

- Schreiben

- Jahr

- Du

- Ihr

- Zephyrnet