Wenn Sie in einem Land mit mehreren Amtssprachen oder in mehreren Regionen tätig sind, können Ihre Audiodateien verschiedene Sprachen enthalten. Die Teilnehmer können völlig unterschiedliche Sprachen sprechen oder zwischen den Sprachen wechseln. Erwägen Sie einen Kundendienstanruf, um ein Problem in einem Gebiet mit einer beträchtlichen mehrsprachigen Bevölkerung zu melden. Obwohl das Gespräch in einer Sprache beginnen könnte, ist es möglich, dass der Kunde in eine andere Sprache wechselt, um das Problem zu beschreiben, je nach Komfortniveau oder Verwendungspräferenzen mit anderen Sprachen. In ähnlicher Weise kann der Kundendienstmitarbeiter zwischen Sprachen wechseln, während er Betriebs- oder Fehlerbehebungsanweisungen übermittelt.

Mit mindestens 3 Sekunden Audio, Amazon Transcribe kann Transkripte in den im Audio gesprochenen Sprachen automatisch identifizieren und effizient erstellen, ohne dass Menschen die Sprachen angeben müssen. Dies gilt für verschiedene Anwendungsfälle wie das Transkribieren von Kundenanrufen, das Konvertieren von Voicemails in Text, das Erfassen von Besprechungsinteraktionen, das Verfolgen der Kommunikation in Benutzerforen oder das Überwachen von Produktions- und Lokalisierungsworkflows für Medieninhalte.

Dieser Beitrag führt Sie durch die Schritte zum Transkribieren einer mehrsprachigen Audiodatei mit Amazon Transcribe. Wir erörtern, wie Sie Amazon Transcribe Audiodateien zur Verfügung stellen und die Transkription mehrsprachiger Audiodateien beim Aufrufen von Amazon Transcribe-APIs aktivieren.

Lösungsüberblick

Amazon Transcribe ist ein AWS-Service, der es Ihnen leicht macht, Sprache in Text umzuwandeln. Mit Hilfe von Amazon Transcribe, einem automatisierten Spracherkennungsdienst (ASR), ist es einfach, jeder Anwendung Sprache-zu-Text-Funktionalität hinzuzufügen. Sie können Audioeingaben mit Amazon Transcribe aufnehmen, klare Transkripte erstellen, die leicht zu lesen und zu überprüfen sind, die Genauigkeit durch Anpassung erhöhen und Informationen filtern, um die Privatsphäre der Kunden zu schützen.

Die Lösung verwendet auch Amazon Simple Storage-Service (Amazon S3), ein Objektspeicherdienst zum Speichern und Abrufen beliebiger Datenmengen von überall. Es handelt sich um einen einfachen Speicherdienst, der branchenführende Haltbarkeit, Verfügbarkeit, Leistung, Sicherheit und praktisch unbegrenzte Skalierbarkeit zu sehr niedrigen Kosten bietet. Wenn Sie Daten in Amazon S3 speichern, arbeiten Sie mit Ressourcen, die als bekannt sind Eimer und Objekte. Ein Bucket ist ein Container für Objekte. Ein Objekt ist eine Datei und alle Metadaten, die die Datei beschreiben.

In diesem Beitrag führen wir Sie durch die folgenden Schritte zur Implementierung einer mehrsprachigen Audiotranskriptionslösung:

- Erstellen Sie einen S3-Bucket.

- Laden Sie Ihre Audiodatei in den Bucket hoch.

- Erstellen Sie den Transkriptionsauftrag.

- Überprüfen Sie die Jobausgabe.

Voraussetzungen:

Für diese exemplarische Vorgehensweise sollten Sie die folgenden Voraussetzungen erfüllen:

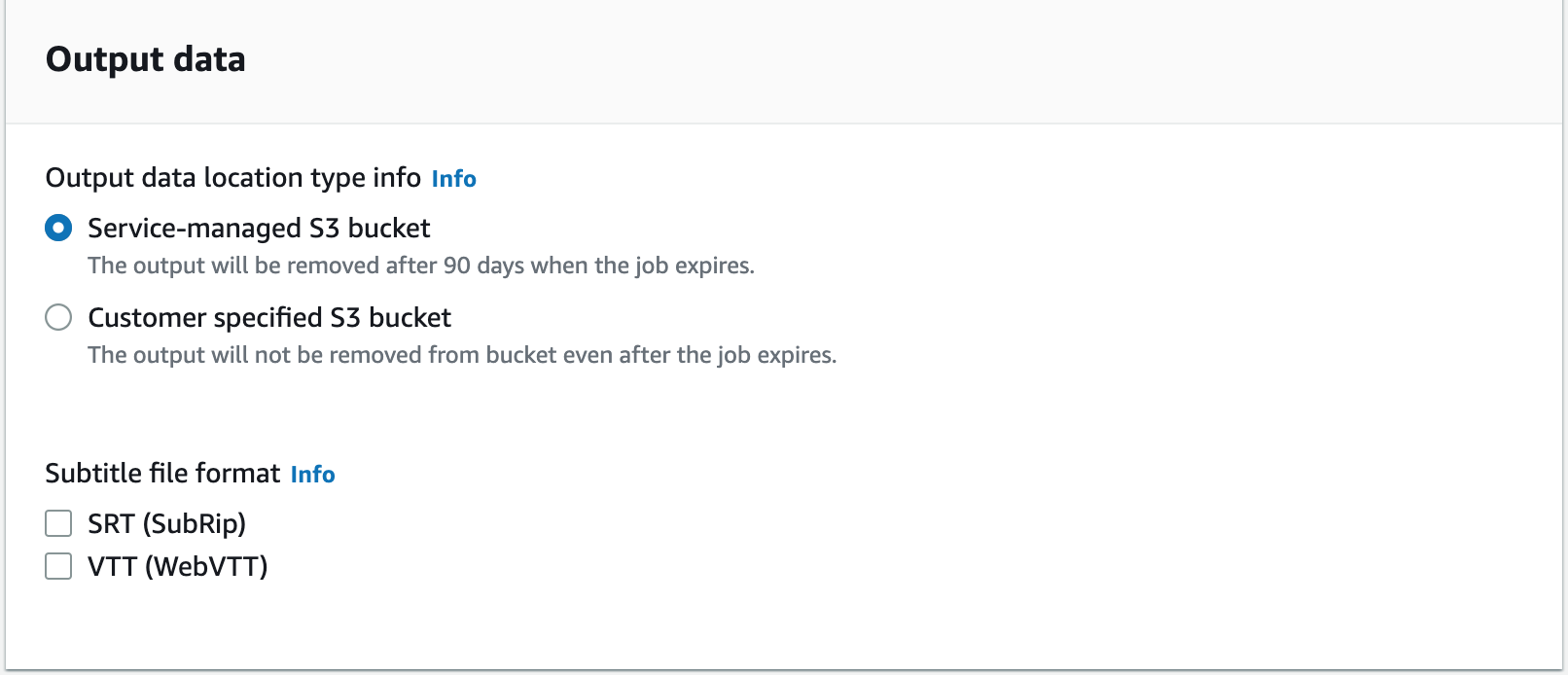

Amazon Transcribe bietet die Möglichkeit, die transkribierte Ausgabe entweder in einem vom Service verwalteten oder vom Kunden verwalteten S3-Bucket zu speichern. Für diesen Beitrag lassen wir Amazon Transcribe die Ergebnisse in einen serviceverwalteten S3-Bucket schreiben.

Beachten Sie, dass Amazon Transcribe ein regionaler Service ist und die aufgerufenen Amazon Transcribe-API-Endpunkte sich in derselben Region wie die S3-Buckets befinden müssen.

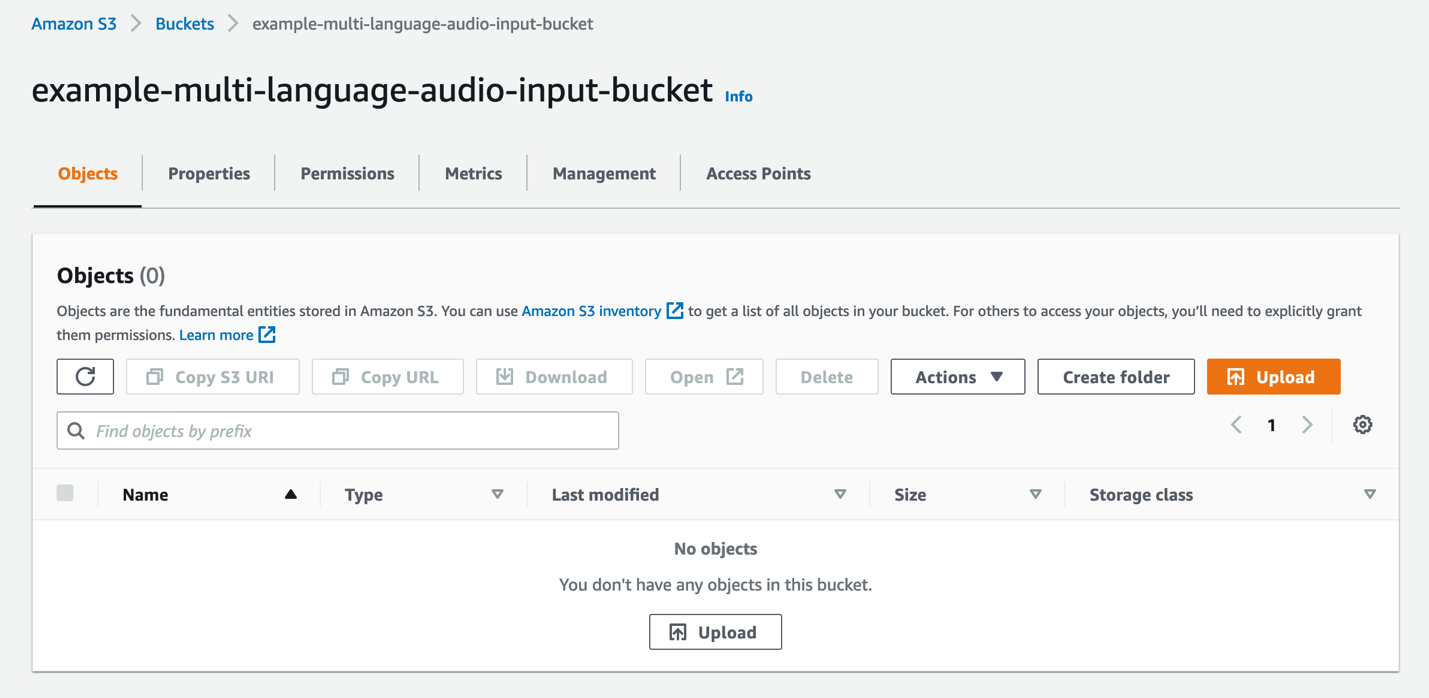

Erstellen Sie einen S3-Bucket zum Speichern Ihrer Audioeingabedateien

Führen Sie die folgenden Schritte aus, um Ihren S3-Bucket zu erstellen:

- Wählen Sie in der Amazon S3-Konsole aus Eimer erstellen.

- Aussichten für Eimername, geben Sie einen global eindeutigen Namen für den Bucket ein.

- Aussichten für AWS-Region, wählen Sie dieselbe Region wie Ihre Amazon Transcribe-API-Endpunkte aus.

- Belassen Sie alle Standardwerte wie sie sind.

- Auswählen

Eimer erstellen.

Laden Sie Ihre Audiodatei in den S3-Bucket hoch

Laden Sie Ihre mehrsprachige Audiodatei in den S3-Bucket in Ihrem AWS-Konto hoch. Für diese Übung verwenden wir das folgende Beispiel mehrsprachige Audiodatei. Es erfasst einen Kundendienstanruf in englischer und spanischer Sprache.

- Wählen Sie in der Amazon S3-Konsole aus Eimer im Navigationsbereich.

- Wählen Sie den zuvor erstellten Bucket zum Speichern der Eingabeaudiodateien aus.

- Auswählen

Hochladen.

- Auswählen

Hinzufügen von Dateien.

- Wählen Sie die Audiodatei, die Sie auf Ihrem lokalen Computer transkribieren möchten.

- Auswählen

Hochladen.

Ihre Audiodatei wird in Kürze im S3-Bucket verfügbar sein.

Erstellen Sie den Transkriptionsauftrag

Mit der hochgeladenen Audiodatei erstellen wir nun einen Transkriptionsauftrag.

- Wählen Sie in der Amazon Transcribe-Konsole aus Transkriptionsjobs im Navigationsbereich.

- Auswählen

Job erstellen.

- Aussichten für Name und Vorname, geben Sie einen eindeutigen Namen für den Job ein.

Dies ist auch der Name der Ausgabetranskriptdatei. - Aussichten für SpracheinstellungenWählen Automatische Erkennung mehrerer Sprachen.

Diese Funktion ermöglicht es Amazon Transcribe, alle in der Audiodatei gesprochenen Sprachen automatisch zu identifizieren und zu transkribieren.

- Aussichten für Sprachoptionen für die automatische Spracherkennung, lassen Sie es deaktiviert.

Amazon Transcribe identifiziert und transkribiert automatisch alle im Audio gesprochenen Sprachen. Um die Transkriptionsgenauigkeit zu verbessern, können Sie optional zwei oder mehr Sprachen auswählen, von denen Sie wissen, dass sie im Audio gesprochen wurden.

- Aussichten für Modelltyp, nur der Allgemeines Modell Option ist zum Zeitpunkt des Schreibens dieses Beitrags verfügbar.

- Aussichten für Eingabedaten, wählen Durchsuchen Sie S3.

- Wählen Sie die zuvor hochgeladene Audioquelldatei aus.

- Aussichten für Ausgabedatenkönnen Sie entweder auswählen Vom Dienst verwalteter S3-Bucket or Vom Kunden angegebener S3-Bucket. Wählen Sie für diesen Beitrag aus Vom Dienst verwalteter S3-Bucket.

- Auswählen Weiter.

- Auswählen Job erstellen.

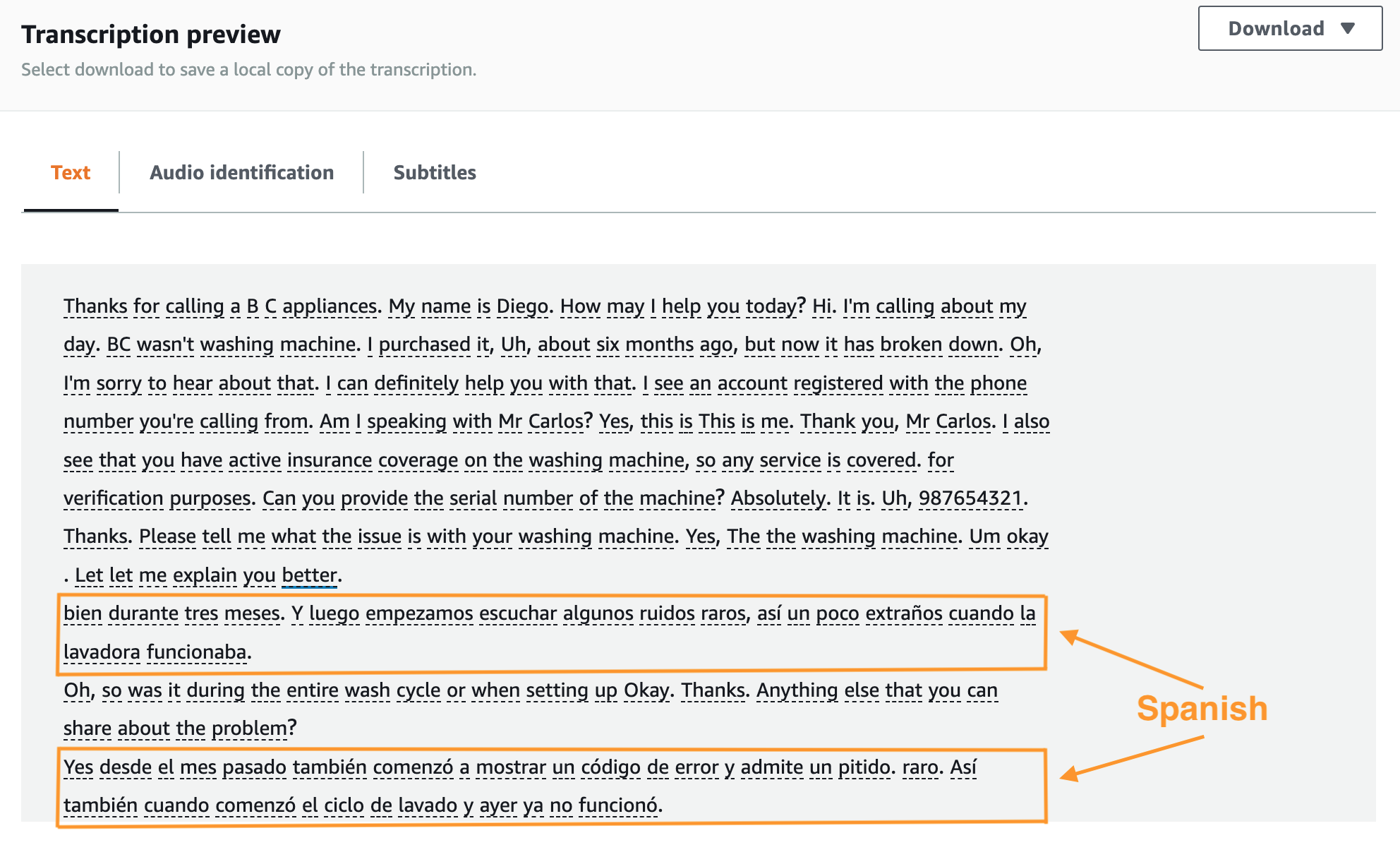

Überprüfen Sie die Jobausgabe

Wenn der Transkriptionsauftrag abgeschlossen ist, öffnen Sie den Transkriptionsauftrag.

Scrollen Sie nach unten zum Transkriptionsvorschau Sektion. Die Audiotranskription wird auf dem angezeigt Text Tab. Die Transkription umfasst sowohl den englischen als auch den spanischen Teil des Gesprächs.

Sie können optional eine Kopie des Transkripts als JSON-Datei herunterladen, die Sie für weitere Zwecke verwenden können Analysen nach dem Anruf.

Aufräumen

Um zukünftige Gebühren zu vermeiden, leeren und löschen Sie den S3-Bucket, den Sie zum Speichern der Eingabeaudioquelldatei erstellt haben. Stellen Sie sicher, dass Sie die Dateien an anderer Stelle gespeichert haben, da dadurch alle im Bucket enthaltenen Objekte dauerhaft entfernt werden. Wählen Sie in der Amazon Transcribe-Konsole den zuvor für die Transkription erstellten Auftrag aus und löschen Sie ihn.

Zusammenfassung

In diesem Beitrag haben wir einen End-to-End-Workflow erstellt, um die Identifizierung und Transkription mehrsprachiger Audiodateien zu automatisieren, ohne Code schreiben zu müssen. Wir haben die neue Funktion in Amazon Transcribe verwendet, um verschiedene Sprachen in einer Audiodatei automatisch zu identifizieren und jede Sprache korrekt zu transkribieren.

Weitere Informationen finden Sie unter Spracherkennung mit Batch-Transkriptionsaufträgen.

Über die Autoren

Murtuza Bootwala ist Senior Solutions Architect bei AWS mit Interesse an KI/ML-Technologien. Er arbeitet gerne mit Kunden zusammen, um ihnen zu helfen, ihre Geschäftsergebnisse zu erzielen. Außerhalb der Arbeit genießt er Outdoor-Aktivitäten und verbringt Zeit mit der Familie.

Murtuza Bootwala ist Senior Solutions Architect bei AWS mit Interesse an KI/ML-Technologien. Er arbeitet gerne mit Kunden zusammen, um ihnen zu helfen, ihre Geschäftsergebnisse zu erzielen. Außerhalb der Arbeit genießt er Outdoor-Aktivitäten und verbringt Zeit mit der Familie.

Victor Red hat eine Leidenschaft für KI/ML und Softwareentwicklung. Er half dabei, Amazon Alexa in den USA und Mexiko zum Laufen zu bringen. Er brachte auch Amazon Textract zu AWS-Partnern und brachte AWS Contact Center Intelligence (CCI) auf den Weg. Er ist derzeit der Global Tech Leader für Conversational AI Partners.

Victor Red hat eine Leidenschaft für KI/ML und Softwareentwicklung. Er half dabei, Amazon Alexa in den USA und Mexiko zum Laufen zu bringen. Er brachte auch Amazon Textract zu AWS-Partnern und brachte AWS Contact Center Intelligence (CCI) auf den Weg. Er ist derzeit der Global Tech Leader für Conversational AI Partners.

Babu Srinivasan ist eine AWS Sr. Specialist SA (Language AI Services) mit Sitz in Chicago. Er konzentriert sich auf Amazon Transcribe (Speech to Text) und hilft unseren Kunden, KI-Dienste zur Lösung von Geschäftsproblemen zu nutzen. Außerhalb der Arbeit beschäftigt er sich gerne mit Holzarbeiten und führt Zaubershows auf.

Babu Srinivasan ist eine AWS Sr. Specialist SA (Language AI Services) mit Sitz in Chicago. Er konzentriert sich auf Amazon Transcribe (Speech to Text) und hilft unseren Kunden, KI-Dienste zur Lösung von Geschäftsproblemen zu nutzen. Außerhalb der Arbeit beschäftigt er sich gerne mit Holzarbeiten und führt Zaubershows auf.

- AI

- Kunst

- KI-Kunstgenerator

- KI-Roboter

- Amazon Transcribe

- künstliche Intelligenz

- Zertifizierung für künstliche Intelligenz

- Künstliche Intelligenz im Bankwesen

- Roboter mit künstlicher Intelligenz

- Roboter mit künstlicher Intelligenz

- Software für künstliche Intelligenz

- AWS Maschinelles Lernen

- Blockchain

- Blockchain-Konferenz ai

- Einfallsreichtum

- dialogorientierte künstliche Intelligenz

- Krypto-Konferenz ai

- Dalls

- tiefe Lernen

- Google Ai

- Mittel (200)

- Maschinelles Lernen

- Plato

- platon ai

- Datenintelligenz von Plato

- Plato-Spiel

- PlatoData

- Platogaming

- Skala ai

- Syntax

- Technische Anleitung

- Zephyrnet