In nur 5 Jahren haben Zehntausende von Kunden angezapft Amazon Sage Maker um Millionen von Modellen zu erstellen, Modelle mit Milliarden von Parametern zu trainieren und Hunderte von Milliarden monatlicher Vorhersagen zu generieren.

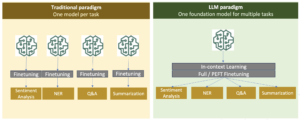

Die Saat für einen Paradigmenwechsel beim maschinellen Lernen (ML) war jahrzehntelang vorhanden, aber mit der sofortigen Verfügbarkeit von praktisch unbegrenzter Rechenkapazität, einer massiven Verbreitung von Daten und der schnellen Weiterentwicklung von ML-Technologien haben Kunden aus allen Branchen jetzt Zugang zu seiner Transformation Vorteile. Um diese Gelegenheit zu nutzen und ML aus dem Forschungslabor in die Hände von Organisationen zu bringen, hat AWS Amazon SageMaker entwickelt. Dieses Jahr feiern wir das 5-jährige Jubiläum von Amazon SageMaker, unserem vollständig verwalteten ML-Flaggschiff-Service, der auf der AWS re:Invent 2017 eingeführt wurde und sich zu einem der am schnellsten wachsenden Services in der Geschichte von AWS entwickelte.

AWS hat Amazon SageMaker eingeführt, um Barrieren für ML abzubauen und den Zugang zu Spitzentechnologie zu demokratisieren. Heute mag dieser Erfolg unvermeidlich erschienen sein, aber im Jahr 2017 erforderte ML immer noch spezielle Fähigkeiten, die typischerweise eine begrenzte Gruppe von Entwicklern, Forschern, Doktoranden oder Unternehmen besaßen, die ihr Geschäft auf ML aufgebaut hatten. Zuvor mussten Entwickler und Data Scientists Daten zunächst visualisieren, transformieren und in Formate vorverarbeiten, die Algorithmen zum Trainieren von Modellen verwenden konnten, was enorme Mengen an Rechenleistung, lange Schulungszeiten und dedizierte Teams erforderte, um Umgebungen zu verwalten, die sich oft über mehrere GPUs erstreckten. aktivierte Server – und ein gesundes Maß an manueller Leistungsoptimierung. Darüber hinaus erforderte die Bereitstellung eines trainierten Modells innerhalb einer Anwendung andere spezialisierte Fähigkeiten im Anwendungsdesign und in verteilten Systemen. Als Datensätze und Variablen wuchsen, mussten Unternehmen diesen Prozess wiederholen, um aus neuen Informationen zu lernen und sich weiterzuentwickeln, da ältere Modelle veraltet waren. Diese Herausforderungen und Hindernisse bedeuteten, dass ML für die meisten außer für gut finanzierte Organisationen und Forschungseinrichtungen unerreichbar war.

Der Beginn einer neuen Ära des maschinellen Lernens

Aus diesem Grund haben wir Amazon SageMaker eingeführt, unseren Flaggschiff-ML-Managed-Service, der es Entwicklern, Datenwissenschaftlern und Geschäftsanalysten ermöglicht, Daten schnell und einfach aufzubereiten und hochwertige ML-Modelle in großem Maßstab zu erstellen, zu trainieren und bereitzustellen. In den letzten 5 Jahren haben wir mehr als 250 neue Funktionen und Fähigkeiten hinzugefügt, darunter die weltweit erste integrierte Entwicklungsumgebung (IDE) für ML, Debugger, Modellmonitore, Profiler, AutoML, einen Feature Store, No-Code-Funktionen und das erste speziell entwickelte Tool für kontinuierliche Integration und kontinuierliche Bereitstellung (CI/CD), um ML weniger komplex und skalierbarer in der Cloud und auf Edge-Geräten zu machen.

Im Jahr 2021 haben wir die Demokratisierung noch weiter vorangetrieben, um ML für mehr Benutzer zugänglich zu machen. Amazon SageMaker ermöglicht es mehr Personengruppen, ML-Modelle zu erstellen, einschließlich der No-Code-Umgebung in Amazon SageMaker-Leinwand für Geschäftsanalysten ohne ML-Erfahrung sowie eine kostenlose ML-Umgebung ohne Einrichtung, damit Studenten ML schneller lernen und damit experimentieren können.

Heute können Kunden mit Amazon SageMaker über eine Auswahl an Tools innovativ sein – IDEs für Data Scientists und eine No-Code-Schnittstelle für Business-Analysten. Sie können auf große Mengen strukturierter Daten (Tabellendaten) und unstrukturierter Daten (Foto, Video und Audio) für ML zugreifen, sie kennzeichnen und verarbeiten. Mit Amazon SageMaker können Kunden mit optimierter Infrastruktur die Schulungszeiten von Stunden auf Minuten verkürzen. Und schließlich, Kunden, können Sie Machine Learning Operations (MLOps)-Praktiken in ihrer gesamten Organisation automatisieren und standardisieren, um Modelle in großem Maßstab zu erstellen, zu trainieren, bereitzustellen und zu verwalten.

Neue Funktionen für die nächste Generation von Innovationen

Auch in Zukunft entwickelt AWS aggressiv neue Funktionen, die Kunden helfen können, ML weiterzuentwickeln. Amazon SageMaker Multi-Model Endpoints (MMEs) ermöglichen es Kunden beispielsweise, Tausende von ML-Modellen auf einem einzigen Amazon SageMaker-Endpunkt bereitzustellen und die Kosten zu senken, indem sie hinter einem Endpunkt bereitgestellte Instanzen für alle Modelle gemeinsam nutzen. Bis vor kurzem wurden MMEs nur auf CPUs unterstützt, aber Amazon SageMaker MMEs unterstützen jetzt GPUs. Kunden können Amazon SageMaker MME verwenden, um Deep-Learning-Modelle auf GPU-Instanzen bereitzustellen und bis zu 90 % der Kosten zu sparen, indem sie Tausende von Deep-Learning-Modellen an einem einzigen Endpunkt mit mehreren Modellen bereitstellen. Amazon SageMaker hat auch die Unterstützung für computeroptimierte Amazon Elastic Compute-Cloud (Amazon EC2) Instanzen powered by AWS Graviton 2 und Graviton 3 Prozessoren, die sich gut für CPU-basierte ML-Inferenz eignen, sodass Kunden Modelle auf dem optimalen Instance-Typ für ihre Workloads bereitstellen können.

Amazon SageMaker-Kunden entfesseln die Kraft des maschinellen Lernens

Jeden Tag wenden sich Kunden aller Größen und aus allen Branchen an Amazon SageMaker, um ML-Modelle in kürzerer Zeit und zu geringeren Kosten als je zuvor zu experimentieren, zu erneuern und bereitzustellen. Infolgedessen verlagern sich die Gespräche jetzt von der Kunst des Möglichen hin zur Freisetzung neuer Produktivitätsebenen mit ML. Heute zählen zu den Kunden Capital One und Fannie Mae im Finanzdienstleistungsbereich, Philips und AstraZeneca im Gesundheitswesen und Life Sciences, Conde Nast und Thomson Reuters im Medienbereich, NFL und Formel 1 im Sportbereich, Amazon und Mercado Libre im Einzelhandel sowie Siemens und Bayer im Bereich Der Industriesektor nutzt ML-Services auf AWS, um Geschäftsinnovationen zu beschleunigen. Sie schließen sich zehntausenden anderen Amazon SageMaker-Kunden an, die den Service nutzen, um Millionen von Modellen zu verwalten, Modelle mit Milliarden von Parametern zu trainieren und jeden Monat Hunderte Milliarden Vorhersagen zu treffen.

Weitere Innovationen warten auf Sie. Aber in der Zwischenzeit halten wir inne, um auf die vielen Erfolge unserer Kunden anzustoßen.

Thomson Reuters

Thomson Reuters, ein führender Anbieter von Geschäftsinformationsdiensten, nutzt die Leistungsfähigkeit von Amazon SageMaker, um intuitivere Dienste für seine Kunden zu schaffen.

„Wir sind ständig auf der Suche nach soliden KI-basierten Lösungen, die eine langfristig positive Kapitalrendite liefern“, sagte Danilo Tommasina, Director of Engineering bei Thomson Reuters Labs. „Amazon SageMaker ist von zentraler Bedeutung für unsere KI-Forschungs- und Entwicklungsarbeit. Es ermöglicht uns, die Forschung effektiv in ausgereifte und hochautomatisierte Lösungen zu bringen. Mit Amazon SageMaker Studio können sich Forscher und Ingenieure mit allen für ihren ML-Workflow erforderlichen Tools in einer einzigen IDE auf die Lösung von Geschäftsproblemen konzentrieren. Wir führen alle unsere ML-Entwicklungsaktivitäten durch, einschließlich Notebooks, Experimentmanagement, ML-Pipeline-Automatisierung und Debugging direkt aus Amazon SageMaker Studio heraus.“

Salesforce

Salesforce, die weltweit führende CRM-Plattform, hat kürzlich neue Integrationen angekündigt, die es ermöglichen, Amazon SageMaker zusammen mit Einstein, der KI-Technologie von Salesforce, zu verwenden.

„Salesforce Einstein ist die erste umfassende KI für CRM und ermöglicht es jedem Unternehmen, durch eine integrierte Reihe von KI-Technologien für Vertrieb, Marketing, Handel, Service und IT intelligenter und vorausschauender über ihre Kunden zu werden“, sagte Rahul Auradkar, EVP von Einstein und Unified Data Services bei Salesforce. „Eine der größten Herausforderungen, denen Unternehmen heute gegenüberstehen, ist die Speicherung ihrer Daten in Silos. Es ist schwierig, Daten zusammenzuführen, um Kundenbindung in Echtzeit über alle Berührungspunkte hinweg bereitzustellen und aussagekräftige geschäftliche Erkenntnisse zu gewinnen. Angetrieben von Genie, der Echtzeit-Kundendatenplattform von Salesforce, ermöglicht die Integration von Salesforce und Amazon SageMaker Datenteams einen nahtlosen Zugriff auf einheitliche und harmonisierte Kundendaten zum Erstellen und Trainieren von ML-Modellen in Amazon SageMaker. Und nach der Bereitstellung können diese Amazon SageMaker-Modelle mit Einstein verwendet werden, um Vorhersagen und Einblicke auf der gesamten Salesforce-Plattform zu ermöglichen. Während sich die KI weiterentwickelt, erweitern wir Einstein weiterhin mit Bring-Your-Own-Modeling (BYOM), um Entwickler und Datenwissenschaftler dort zu treffen, wo sie arbeiten.“

Meta-KI

Meta AI ist ein Labor für künstliche Intelligenz, das zu Meta Platforms Inc. gehört.

„Meta AI hat mit AWS zusammengearbeitet, um Torch.distributed zu verbessern, um Entwicklern zu helfen, ihre Schulungen mit Amazon SageMaker und Trainium-basierten Instanzen zu skalieren“, sagte Geeta Chauhan, Applied AI Engineering Manager bei Meta AI. „Mit diesen Verbesserungen haben wir basierend auf unseren Tests eine Verringerung der Trainingszeit für große Modelle festgestellt. Wir freuen uns, dass Amazon SageMaker verteilte PyTorch-Schulungen unterstützt, um ML-Innovationen zu beschleunigen.“

Tyson Foods Inc.

Tyson Foods Inc., einer der weltweit größten Fleischverarbeiter und Vermarkter, setzt auf Amazon SageMaker, Amazon Sagemaker Ground Truth und AWS-Panorama um die Effizienz zu verbessern.

„Operational Excellence hat bei Tyson Foods höchste Priorität“, sagte Barret Miller, Senior Manager of Emerging Technology bei Tyson Foods Inc fehleranfällige Aufgaben. Wir haben mit dem Amazon Machine Learning Solutions Lab zusammengearbeitet, um ein hochmodernes Objekterkennungsmodell mit Amazon SageMaker Ground Truth und AWS Panorama zu erstellen. Mit dieser Lösung erhalten wir nahezu in Echtzeit Einblicke, die uns helfen, den benötigten Bestand zu produzieren und gleichzeitig Verschwendung zu minimieren.“

Autodesk

AutoCAD ist eine kommerzielle Softwareanwendung für computergestütztes Design und Zeichnen von Autodesk. AutoCAD verlässt sich auf Amazon SageMaker, um seinen generativen Designprozess zu optimieren.

„Wir wollten AutoCAD-Kunden zu mehr Effizienz verhelfen, indem wir personalisierte, aktuelle Nutzungstipps und Einblicke bereitstellen und sicherstellen, dass die Zeit, die sie mit AutoCAD verbringen, so produktiv wie möglich ist“, sagte Dania El Hassan, Director of Product Management für AutoCAD , bei Autodesk. „Amazon SageMaker war ein unverzichtbares Tool, das uns geholfen hat, unseren Benutzern proaktive Befehls- und Shortcut-Empfehlungen zu geben, sodass sie leistungsstarke neue Designergebnisse erzielen konnten.“

Torc.ai

Mit Hilfe von Amazon SageMaker und der Amazon SageMaker Distributed Data Parallel (SMDDP)-Bibliothek Torc.ai, seit 2005 ein führendes Unternehmen für autonome Fahrzeuge, vermarktet selbstfahrende Lastwagen für einen sicheren, nachhaltigen Langstreckenverkehr in der Frachtindustrie.

„Mein Team ist jetzt in der Lage, mithilfe von Amazon SageMaker Model Training und der Amazon SageMaker Distributed Data Parallel (SMDDP)-Bibliothek problemlos große verteilte Trainingsaufträge auszuführen, die Terabytes an Trainingsdaten und Modellen mit Millionen von Parametern umfassen“, sagte Derek Johnson, Vice Präsident der Technik bei Torc.ai. „Amazon SageMaker Distributed Model Training und SMDDP haben uns geholfen, nahtlos zu skalieren, ohne die Trainingsinfrastruktur verwalten zu müssen. Es reduzierte unsere Zeit zum Trainieren von Modellen von mehreren Tagen auf wenige Stunden, sodass wir unseren Konstruktionszyklus verkürzen und unserer Flotte neue autonome Fahrzeugfunktionen schneller denn je hinzufügen konnten.“

LG KI-Forschung

LG AI Research zielt darauf ab, die nächste Ära der KI anzuführen, indem Amazon SageMaker verwendet wird, um ML-Modelle schneller zu trainieren und bereitzustellen.

„Wir haben vor kurzem Tilda vorgestellt, die KI-Künstlerin powered by EXAONE, ein gigantisches KI-System, das 250 Millionen hochauflösende Bild-Text-Paar-Datensätze verarbeiten kann“, sagte Seung Hwan Kim, Vizepräsident und Vision Lab Leader bei LG AI Research. „Die multimodale KI ermöglicht es Tilda, selbst ein neues Bild zu schaffen, mit ihrer Fähigkeit, über die Sprache hinaus zu erforschen, die sie wahrnimmt. Amazon SageMaker war aufgrund seiner Skalierungs- und verteilten Trainingsfähigkeiten bei der Entwicklung von EXAONE von entscheidender Bedeutung. Insbesondere aufgrund der enormen Rechenleistung, die zum Trainieren dieser supergiganten KI erforderlich ist, ist eine effiziente Parallelverarbeitung sehr wichtig. Wir mussten auch große Datenmengen kontinuierlich verwalten und flexibel auf neu erfasste Daten reagieren können. Mithilfe von Amazon SageMaker-Modelltraining und verteilten Trainingsbibliotheken haben wir das verteilte Training optimiert und das Modell 59 % schneller trainiert – ohne größere Änderungen an unserem Trainingscode.“

Mueller Wasserprodukte

Mueller Water Products stellt technische Ventile, Hydranten, Rohrverbindungs- und Reparaturprodukte, Dosierprodukte, Lecksuchlösungen und mehr her. Es verwendete Amazon SageMaker, um eine innovative ML-Lösung zu entwickeln, um Wasserlecks schneller zu erkennen.

„Wir haben es uns zur Aufgabe gemacht, bis 7.7 2027 Milliarden Gallonen Wasserverlust einzusparen“, sagte Dave Johnston, Director of Smart Infrastructure bei Mueller Water Products. „Dank der auf Amazon SageMaker aufgebauten ML-Modelle haben wir die Präzision von EchoShore-DX, unserem akustikbasierten Anomalieerkennungssystem, verbessert. Dadurch können wir Versorgungskunden schneller informieren, wenn ein Leck auftritt. Diese Lösung hat im Jahr 675 schätzungsweise 2021 Millionen Gallonen Wasser eingespart. Wir freuen uns darauf, die AWS ML-Services weiterhin zu nutzen, um unser Technologieportfolio weiter zu verbessern und die Effizienz und Nachhaltigkeit bei unseren Versorgungskunden weiter voranzutreiben.“

canva

Canva, Hersteller des beliebten Online-Design- und Publishing-Tools, verlässt sich für eine schnelle Implementierung auf die Leistungsfähigkeit von Amazon SageMaker.

„Damit Canva in großem Umfang wachsen kann, brauchten wir ein Tool, das uns hilft, neue Funktionen ohne Verzögerungen oder Probleme einzuführen“, sagt Greg Roodt, Head of Data Platforms bei Canva. „Dank der Anpassungsfähigkeit von Amazon SageMaker konnten wir mehr Aufgaben mit weniger Ressourcen bewältigen, was zu einer schnelleren und effizienteren Arbeitsbelastung führte. Es gab unserem Engineering-Team die Gewissheit, dass die von ihnen eingeführten Funktionen für ihren Anwendungsfall skaliert werden. Mit Amazon SageMaker haben wir unser Text-zu-Bild-Modell in 2 Wochen mithilfe einer leistungsstarken verwalteten Infrastruktur bereitgestellt und wir freuen uns darauf, diese Funktion in naher Zukunft auf unsere Millionen von Benutzern auszudehnen.“

Andere

Inspire, ein verbraucherorientierter Gesundheitsinformationsdienst, verlässt sich auf Amazon SageMaker, um umsetzbare Erkenntnisse für bessere Pflege, Behandlungen und Ergebnisse zu liefern.

„Unsere Inhaltsempfehlungs-Engine ist ein wichtiger Treiber unseres Leistungsversprechens“, sagte Brian Loew, Chief Executive Officer und Gründer von Inspire. „Wir verwenden es, um unsere Benutzer (die mit bestimmten Bedingungen leben) auf relevante und spezifische Beiträge oder Artikel zu lenken. Mit Amazon SageMaker können wir Deep-Learning-Modelle einfach erstellen, trainieren und bereitstellen. Unsere ausgeklügelte ML-Lösung – basierend auf Amazon SageMaker – hilft uns, die Fähigkeit unserer Content-Empfehlungs-Engine zu verbessern, relevante Inhalte für 2 Millionen registrierte Benutzer vorzuschlagen, die aus unserer Bibliothek mit 1.5 Milliarden Wörtern zu 3,600 Bedingungen schöpfen. Amazon SageMaker hat es uns ermöglicht, Patienten und Pflegekräfte mit personalisierteren Inhalten und Ressourcen genau zu verbinden – einschließlich Informationen zu seltenen Krankheiten und Behandlungspfaden.“

ResMed

ResMed ist ein führender Anbieter von Cloud-verbundenen Lösungen für Menschen mit Schlafapnoe, COPD, Asthma und anderen chronischen Erkrankungen. Im Jahr 2014 brachte ResMed MyAir auf den Markt, eine personalisierte Plattform und Anwendung für das Therapiemanagement, mit der Patienten die Schlaftherapie verfolgen können.

„Vor Amazon SageMaker haben alle MyAir-Benutzer unabhängig von ihrem Zustand zur gleichen Zeit dieselben Nachrichten von der App erhalten“, sagte Badri Raghavan, Vice President of Data Science bei ResMed. „Amazon SageMaker hat es uns ermöglicht, mit Patienten über MyAir zu interagieren, basierend auf dem spezifischen ResMed-Gerät, das sie verwenden, ihren Wachzeiten und anderen Kontextdaten. Wir nutzen mehrere Amazon SageMaker-Funktionen, um Modellpipelines zu trainieren und Bereitstellungstypen auszuwählen, einschließlich Nahezu-Echtzeit- und Batch-Inferenzen, um maßgeschneiderte Inhalte bereitzustellen. Amazon SageMaker hat es uns ermöglicht, unser Ziel zu erreichen, ML-Funktionen weltweit einzubetten, indem wir Modelle in Tagen oder Wochen statt in Monaten bereitstellen.“

Verisk

Verisk bietet datengestützte analytische Erkenntnisse von Experten, die Unternehmen, Menschen und Gesellschaften helfen, stärker, widerstandsfähiger und nachhaltiger zu werden. Es verwendet Amazon SageMaker, um ML-Workflows zu optimieren.

„Verisk und Vexcel arbeiten eng zusammen, um riesige Datenmengen auf AWS zu speichern und zu verarbeiten, einschließlich der ultrahochauflösenden Luftbilddaten von Vexcel, die in 26 Ländern auf der ganzen Welt erfasst werden“, sagte Jeffrey C. Taylor, Präsident von Verisk 3D Visual Intelligenz. „Amazon SageMaker hilft uns, die Arbeit der ML- und MLOps-Teams zu rationalisieren, sodass wir uns darauf konzentrieren können, die Bedürfnisse unserer Kunden zu erfüllen, einschließlich Immobilienakteuren in den Bereichen Versicherung, Immobilien, Bauwesen und darüber hinaus.“

Smartocto BV

Mit Hilfe von Amazon SageMaker bietet Smartocto BV 350 Nachrichtenredaktionen und Medienunternehmen auf der ganzen Welt ML-gesteuerte Inhaltsanalysen an.

„Da das Unternehmen skalierte, mussten wir die Bereitstellung unserer ML-Modelle vereinfachen, die Markteinführungszeit verkürzen und unser Produktangebot erweitern“, sagte Ilija Susa, Chief Data Officer bei Smartocto. „Die Verwaltung der Kombination aus Open-Source- und Cloud-Lösungen zum Selbsthosten unserer ML-Workloads war jedoch zunehmend zeitaufwändig. Wir haben unsere ML-Modelle auf Amazon SageMaker-Endpunkte migriert und in weniger als 3 Monaten Smartify eingeführt, eine neue AWS-native Lösung. Smartify nutzt Amazon SageMaker, um prädiktive redaktionelle Analysen nahezu in Echtzeit bereitzustellen, die Kunden dabei helfen, ihre Inhalte zu verbessern und ihr Publikum zu erweitern.“

Visualfabriq

Visualfabriq bietet einigen der weltweit führenden Konsumgüterunternehmen eine Revenue-Management-Lösung mit angewandten Fähigkeiten der künstlichen Intelligenz. Es verwendet Amazon SageMaker, um die Leistung und Genauigkeit von ML-Modellen im großen Maßstab zu verbessern.

„Wir wollten unseren Technologie-Stack anpassen, um Leistung und Skalierbarkeit zu verbessern und Modelle einfacher hinzuzufügen, zu aktualisieren und neu zu trainieren“, sagte Jelle Verstraaten, Team Lead for Demand Forecast, Artificial Intelligence, and Revenue Growth Management bei Visualfabriq. „Die größte Auswirkung der Migration zu Amazon SageMaker war eine deutliche Leistungssteigerung unserer Lösung. Durch die Ausführung von Inferenzen auf dedizierten Servern anstelle von Webservern ist unsere Lösung effizienter und die Kosten sind konsistent und transparent. Wir haben die Reaktionszeit unseres Bedarfsprognoseservices – der die Auswirkungen einer Werbeaktion auf das Verkaufsvolumen eines Einzelhändlers vorhersagt – um 200 % verbessert und eine skalierbare Lösung bereitgestellt, die weniger manuelle Eingriffe erfordert und das Onboarding neuer Kunden beschleunigt.“

Sophos

Sophos, ein weltweit führender Anbieter von Cybersicherheitslösungen und -services der nächsten Generation, nutzt Amazon SageMaker, um seine ML-Modelle effizienter zu trainieren.

„Unsere leistungsstarke Technologie erkennt und eliminiert Dateien, die raffiniert mit Malware durchsetzt sind“, sagt Konstantin Berlin, Head of Artificial Intelligence bei Sophos. „Der Einsatz von XGBoost-Modellen zur Verarbeitung von Datensätzen mit mehreren Terabyte Größe war jedoch extrem zeitaufwändig – und manchmal bei begrenztem Speicherplatz einfach nicht möglich. Mit dem verteilten Training von Amazon SageMaker können wir erfolgreich ein leichtgewichtiges XGBoost-Modell trainieren, das viel kleiner auf der Festplatte (bis zu 25-mal kleiner) und im Arbeitsspeicher (bis zu fünfmal kleiner) ist als sein Vorgänger. Mit der automatischen Modelloptimierung von Amazon SageMaker und dem verteilten Training auf Spot-Instances können wir Modelle schnell und effektiver modifizieren und neu trainieren, ohne die zugrunde liegende Trainingsinfrastruktur anpassen zu müssen, die für die Skalierung auf solch große Datensätze erforderlich ist.“

Northwestern University

Studenten der Northwestern University im Programm Master of Science in Artificial Intelligence (MSAI) erhielten eine Führung Amazon SageMaker Studio Lab bevor Sie es während eines Hackathons verwenden.

„Die Benutzerfreundlichkeit von Amazon SageMaker Studio Lab ermöglichte es Studenten, ihr Gelerntes schnell anzuwenden, um kreative Lösungen zu entwickeln“, sagte Mohammed Alam, stellvertretender Direktor des MSAI-Programms. „Wir haben erwartet, dass die Schüler während des kurzen 5-stündigen Wettbewerbs natürlich auf einige Hindernisse stoßen. Stattdessen übertrafen sie unsere Erwartungen, indem sie nicht nur alle Projekte abschlossen, sondern auch beeindruckende Präsentationen lieferten, in denen sie komplexe ML-Konzepte auf wichtige reale Probleme anwendeten.“

Rensselaer Polytechnic Institute

Das Rensselaer Polytechnic Institute (RPI), eine technologische Forschungsuniversität in New York, verwendet Amazon SageMaker Studio, um Studenten beim schnellen Erlernen von ML-Konzepten zu unterstützen.

„RPI besitzt einen der leistungsstärksten Supercomputer der Welt, aber KI hat eine steile Lernkurve“, sagte Mohammed J. Zaki, Professor für Informatik. „Wir brauchten eine Möglichkeit für Studenten, kostengünstig zu beginnen. Die intuitive Benutzeroberfläche von Amazon SageMaker Studio Lab ermöglichte unseren Studenten einen schnellen Einstieg und stellte eine leistungsstarke GPU bereit, die es ihnen ermöglichte, mit komplexen Deep-Learning-Modellen für ihre Abschlussprojekte zu arbeiten.“

Hongkonger Institut für Berufsbildung

Die IT-Abteilung des Hong Kong Institute of Vocational Education (Lee Wai Lee) nutzt Amazon SageMaker Studio Lab, um Studenten die Möglichkeit zu bieten, an realen ML-Projekten zu arbeiten.

„Wir verwenden Amazon SageMaker Studio Lab in grundlegenden ML- und Python-bezogenen Kursen, die den Studenten eine solide Grundlage für viele Cloud-Technologien vermitteln“, sagte Cyrus Wong, Senior Lecturer. „Amazon SageMaker Studio Lab ermöglicht es unseren Studenten, praktische Erfahrungen mit realen Data-Science-Projekten zu sammeln, ohne sich in Setups oder Konfigurationen zu verzetteln. Im Gegensatz zu anderen Anbietern ist dies eine Linux-Maschine für Studenten, die es ihnen ermöglicht, viel mehr Programmierübungen zu machen.“

MapmyIndia

MapmyIndia, Indiens führender Anbieter von digitalen Karten, raumbezogener Software und standortbasierten Internet of Things (IoT)-Technologien, verwendet Amazon SageMaker zum Erstellen, Trainieren und Bereitstellen seiner ML-Modelle.

„MapmyIndia und unsere globale Plattform Mappls bieten robuste, hochgenaue und weltweite KI- und Computer-Vision-gesteuerte, auf Satelliten- und Straßenbildern basierende Analysen für eine Vielzahl von Anwendungsfällen, wie z. B. die Messung der wirtschaftlichen Entwicklung, des Bevölkerungswachstums und der Landwirtschaft Leistung, Bautätigkeit, Erkennung von Straßenschildern, Landsegmentierung und Erkennung von Straßenänderungen“, sagte Rohan Verma, Chief Executive Officer und Executive Director bei MapmyIndia. „Unsere Fähigkeit, Modelle schnell und genau zu erstellen, zu trainieren und bereitzustellen, hebt uns von anderen ab. Wir freuen uns über die Partnerschaft mit AWS für unsere KI/ML-Angebote und sind begeistert von der Fähigkeit von Amazon SageMaker, dies schnell zu skalieren.“

SatSure

SatSure, ein in Indien ansässiger führender Anbieter von Entscheidungsintelligenzlösungen, die Erdbeobachtungsdaten verwenden, um Erkenntnisse zu gewinnen, verlässt sich auf Amazon SageMaker, um Petabytes von ML-Daten vorzubereiten und zu trainieren.

„Wir verwenden Amazon SageMaker, um Petabytes an EO-, GIS-, Finanz-, Text- und Geschäftsdatensätzen zu verarbeiten, und nutzen seine KI/ML-Fähigkeiten, um unsere Modelle schnell zu innovieren und zu skalieren“, sagte Prateep Basu, Chief Executive Officer bei SatSure. „Wir verwenden AWS seit 2017 und haben Finanzinstituten geholfen, Kredite an mehr als 2 Millionen Landwirte in Indien, Nigeria und den Philippinen zu vergeben, während wir wöchentlich 1 Million Quadratkilometer überwachen.“

Zusammenfassung

Um mit Amazon SageMaker zu beginnen, besuchen Sie aws.amazon.com/sagemaker.

Über den Autor

Ankur Mehrotra kam 2008 zu Amazon und ist derzeit General Manager von Amazon SageMaker. Vor Amazon SageMaker arbeitete er am Aufbau der Werbesysteme und der automatisierten Preisgestaltungstechnologie von Amazon.com.

Ankur Mehrotra kam 2008 zu Amazon und ist derzeit General Manager von Amazon SageMaker. Vor Amazon SageMaker arbeitete er am Aufbau der Werbesysteme und der automatisierten Preisgestaltungstechnologie von Amazon.com.

- AI

- Kunst

- KI-Kunstgenerator

- KI-Roboter

- Amazon Sage Maker

- künstliche Intelligenz

- Zertifizierung für künstliche Intelligenz

- Künstliche Intelligenz im Bankwesen

- Roboter mit künstlicher Intelligenz

- Roboter mit künstlicher Intelligenz

- Software für künstliche Intelligenz

- AWS Maschinelles Lernen

- Blockchain

- Blockchain-Konferenz ai

- Einfallsreichtum

- dialogorientierte künstliche Intelligenz

- Krypto-Konferenz ai

- Dalls

- tiefe Lernen

- Google Ai

- Maschinelles Lernen

- Plato

- platon ai

- Datenintelligenz von Plato

- Plato-Spiel

- PlatoData

- Platogaming

- Skala ai

- Syntax

- Zephyrnet