Video Googles größtes KI-Sprachmodell hilft Robotern dabei, menschliche Befehle flexibler zu verstehen und zu interpretieren, so die neueste Studie des Webgiganten.

Maschinen reagieren in der Regel am besten auf sehr spezifische Anforderungen – offene Anfragen können sie manchmal aus der Fassung bringen und zu Ergebnissen führen, die der Benutzer nicht im Sinn hatte. Menschen lernen, auf starre Weise mit Robotern zu interagieren, indem sie beispielsweise Fragen auf eine bestimmte Art und Weise stellen, um die gewünschte Antwort zu erhalten.

Googles neuestes System namens PaLM-SayCan verspricht jedoch, intelligenter zu sein. Das physische Gerät von Everyday Robots – einem aus Google

Im folgenden Video können Sie den Roboter in Aktion sehen:

Fragen Sie den Roboter etwa: „Ich habe gerade trainiert, können Sie mir einen gesunden Snack besorgen?“ wird es dazu bringen, einen Apfel zu holen. „PaLM-SayCan [ist] ein interpretierbarer und allgemeiner Ansatz zur Nutzung von Wissen aus Sprachmodellen, der es einem Roboter ermöglicht, Textanweisungen auf hoher Ebene zu befolgen, um physikalisch fundierte Aufgaben auszuführen“, forschen Wissenschaftler des Brain-Teams von Google erklärt.

Google stellte sein größtes Sprachmodell vor Palme im April dieses Jahres. PaLM wurde anhand von Daten aus dem Internet trainiert, aber anstatt offene Textantworten auszuspucken, wurde das System so angepasst, dass es eine Liste mit Anweisungen generiert, denen der Roboter folgen muss.

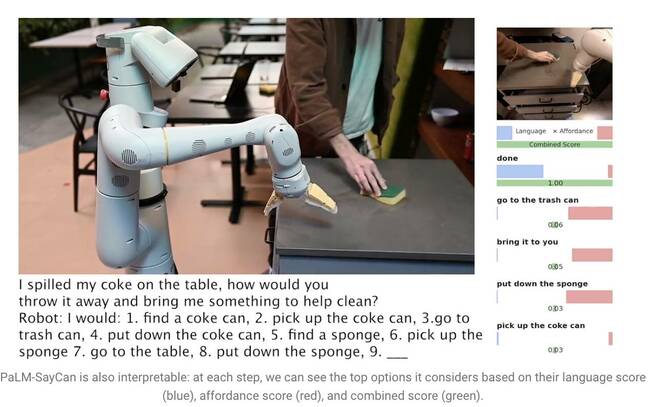

Wenn Sie sagen: „Ich habe meine Cola auf dem Tisch verschüttet. Wie würden Sie sie wegwerfen und mir etwas mitbringen, damit ich beim Putzen helfen kann?“ veranlasst PaLM dazu, die Frage zu verstehen und eine Liste mit Schritten zu erstellen, die der Roboter ausführen kann, um die Aufgabe zu erledigen, z. B. durchgehen die Dose aufheben, sie in einen Mülleimer werfen und einen Schwamm holen.

Große Sprachmodelle (LLMs) wie PaLM verstehen jedoch nicht die Bedeutung von allem, was sie sagen. Aus diesem Grund trainierten die Forscher ein separates Modell, das verstärktes Lernen nutzte, um abstrakte Sprache in visuelle Darstellungen und Handlungen zu verankern. Auf diese Weise lernt der Roboter, das Wort „Cola“ mit dem Bild einer Limonadendose zu assoziieren.

PaLM-SayCan lernt auch sogenannte „Affordance-Funktionen“ – eine Methode, die die Möglichkeit bewertet, eine bestimmte Aktion bei bestimmten Objekten in ihrer Umgebung auszuführen. Es ist wahrscheinlicher, dass der Roboter einen Schwamm aufnimmt als einen Staubsauger, wenn er beispielsweise einen Schwamm, aber keinen Staubsauger in der Nähe erkennt.

„Unsere Methode SayCan extrahiert und nutzt das Wissen innerhalb von LLMs in physisch fundierten Aufgaben“, erklärte das Team in einem Forschungsarbeit. „Das LLM (Say) bietet eine aufgabenbezogene Grundlage, um nützliche Maßnahmen für ein übergeordnetes Ziel zu bestimmen, und die erlernten Affordance-Funktionen (Can) bieten eine weltweite Grundlage, um zu bestimmen, was auf der Grundlage des Plans ausgeführt werden kann.“ Wir verwenden Reinforcement Learning (RL) als eine Möglichkeit, sprachbedingte Wertfunktionen zu erlernen, die Aufschluss darüber geben, was in der Welt möglich ist.“

Um zu verhindern, dass der Roboter von der Aufgabe abweicht, ist er darauf trainiert, Aktionen nur aus 101 verschiedenen Anweisungen auszuwählen. Google hat es darauf trainiert, sich an eine Küche anzupassen – PaLM-SayCan kann Snacks und Getränke besorgen und einfache Reinigungsaufgaben ausführen. Die Forscher glauben, dass LLMs der erste Schritt sind, um Roboter dazu zu bringen, komplexere Aufgaben mithilfe abstrakter Anweisungen sicher auszuführen.

„Unsere Experimente zu einer Reihe realer Roboteraufgaben zeigen die Fähigkeit, langfristige, abstrakte Anweisungen in natürlicher Sprache mit hoher Erfolgsquote zu planen und durchzuführen. Wir glauben, dass die Interpretierbarkeit von PaLM-SayCan eine sichere Benutzerinteraktion mit Robotern in der realen Welt ermöglicht“, schlussfolgerten sie. ®

- AI

- Kunst

- KI-Kunstgenerator

- KI-Roboter

- künstliche Intelligenz

- Zertifizierung für künstliche Intelligenz

- Künstliche Intelligenz im Bankwesen

- Roboter mit künstlicher Intelligenz

- Roboter mit künstlicher Intelligenz

- Software für künstliche Intelligenz

- Blockchain

- Blockchain-Konferenz ai

- Einfallsreichtum

- dialogorientierte künstliche Intelligenz

- Krypto-Konferenz ai

- Dalls

- tiefe Lernen

- Google Ai

- Maschinelles Lernen

- Plato

- platon ai

- Datenintelligenz von Plato

- Plato-Spiel

- PlatoData

- Platogaming

- Skala ai

- Syntax

- Das Register

- Zephyrnet