Teams für maschinelles Lernen (ML) benötigen die Flexibilität, ihre integrierte Entwicklungsumgebung (IDE) auszuwählen, wenn sie an einem Projekt arbeiten. Es ermöglicht Ihnen eine produktive Entwicklererfahrung und schnelle Innovationen. Sie können sogar mehrere IDEs innerhalb eines Projekts verwenden. Amazon Sage Maker ermöglicht ML-Teams die Wahl, in vollständig verwalteten, Cloud-basierten Umgebungen zu arbeiten Amazon SageMaker-Studio, SageMaker Notebook-Instanzen, oder von Ihrem lokalen Computer mit Lokalbetrieb.

SageMaker bietet Jupyter und RStudio eine Ein-Klick-Erfahrung zum Erstellen, Trainieren, Debuggen, Bereitstellen und Überwachen von ML-Modellen. In diesem Beitrag teilen wir auch a Lösung für das Hosting Code-Server auf SageMaker.

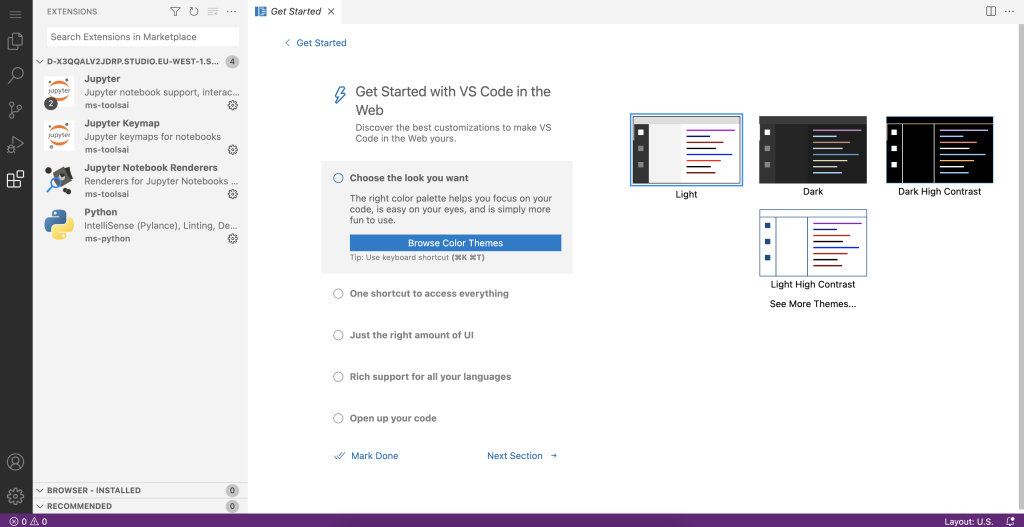

Mit Code-Server können Benutzer ausführen VS-Code auf Remote-Computern und greifen Sie in einem Webbrowser darauf zu. Für ML-Teams bietet das Hosten von Code-Servern auf SageMaker minimale Änderungen an einer lokalen Entwicklungserfahrung und ermöglicht es Ihnen, von überall aus auf skalierbarem Cloud-Computing zu programmieren. Mit VS Code können Sie auch integrierte Conda-Umgebungen mit AWS-optimiertem TensorFlow und PyTorch, verwalteten Git-Repositories, lokalem Modus und anderen von SageMaker bereitgestellten Funktionen verwenden, um Ihre Bereitstellung zu beschleunigen. Für IT-Administratoren ermöglicht es Ihnen, die Bereitstellung von verwalteten, sicheren IDEs in der Cloud zu standardisieren und zu beschleunigen, um ML-Teams schnell in ihre Projekte aufzunehmen und zu unterstützen.

Lösungsüberblick

In diesem Beitrag behandeln wir die Installation sowohl für Studio-Umgebungen (Option A) als auch für Notebook-Instanzen (Option B). Für jede Option durchlaufen wir einen manuellen Installationsprozess, den ML-Teams in ihrer Umgebung ausführen können, und eine automatisierte Installation, die IT-Administratoren über die für sie einrichten können AWS-Befehlszeilenschnittstelle (AWS-CLI).

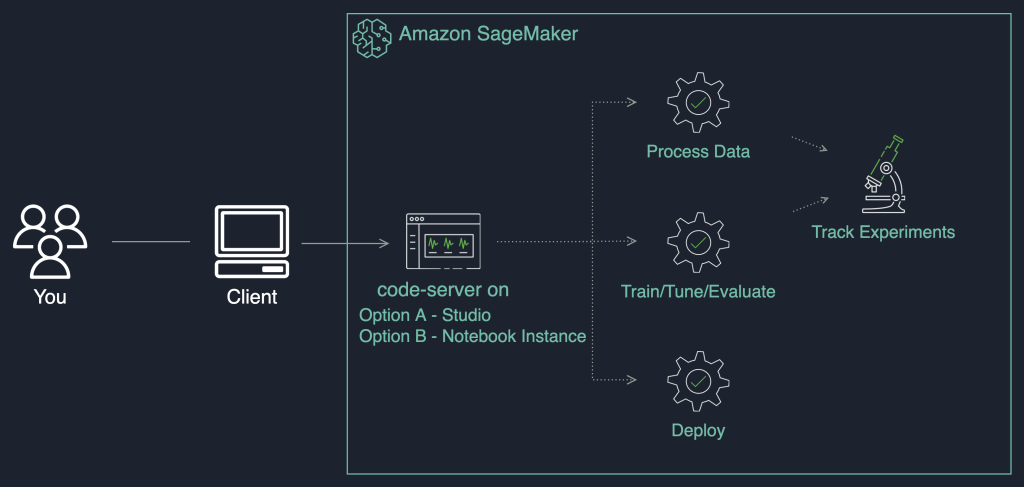

Das folgende Diagramm veranschaulicht die Architekturübersicht für das Hosten von Code-Servern auf SageMaker.

Unsere Lösung beschleunigt die Installation und Einrichtung des Code-Servers in Ihrer Umgebung. Es funktioniert sowohl für JupyterLab 3 (empfohlen) als auch für JupyterLab 1, die in Studio- und SageMaker-Notebook-Instanzen ausgeführt werden. Es besteht aus Shell-Skripten, die basierend auf der Option Folgendes tun.

Für Studio (Option A) führt das Shell-Skript Folgendes aus:

Für SageMaker-Notebook-Instances (Option B) führt das Shell-Skript Folgendes aus:

- Installiert den Code-Server.

- Fügt dem Dateimenü des Jupyter-Notebooks und dem JupyterLab-Startprogramm eine Code-Server-Verknüpfung für den schnellen Zugriff auf die IDE hinzu.

- Erstellt eine dedizierte Conda-Umgebung zum Verwalten von Abhängigkeiten.

- Installiert die Python und Docker Erweiterungen in der IDE.

In den folgenden Abschnitten führen wir den Lösungsinstallationsprozess für Option A und Option B durch. Stellen Sie sicher, dass Sie Zugriff auf Studio oder eine Notebook-Instance haben.

Option A: Code-Server auf Studio hosten

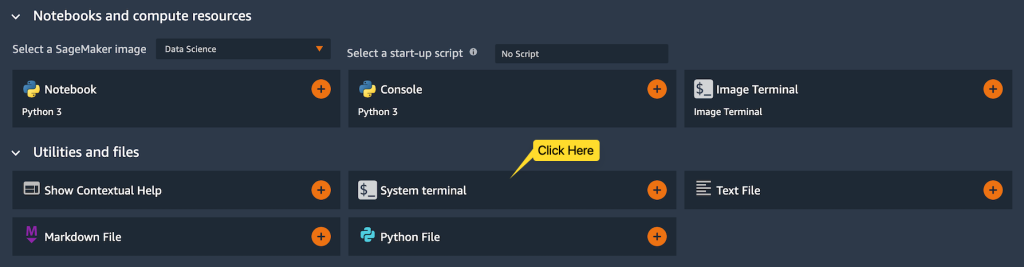

Führen Sie die folgenden Schritte aus, um den Code-Server in Studio zu hosten:

- Auswählen

Systemendgerät in Ihrem Studio-Launcher.

- Um die Code-Server-Lösung zu installieren, führen Sie die folgenden Befehle in Ihrem Systemterminal aus:

Die Ausführung der Befehle sollte einige Sekunden dauern.

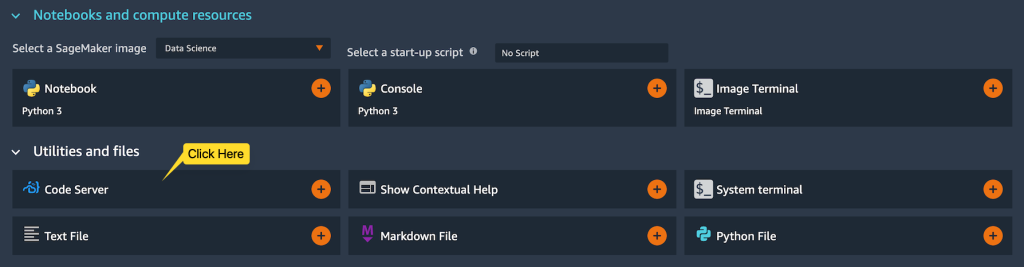

- Laden Sie die Browserseite neu, auf der Sie a sehen können Codeserver Schaltfläche in Ihrem Studio-Launcher.

- Auswählen

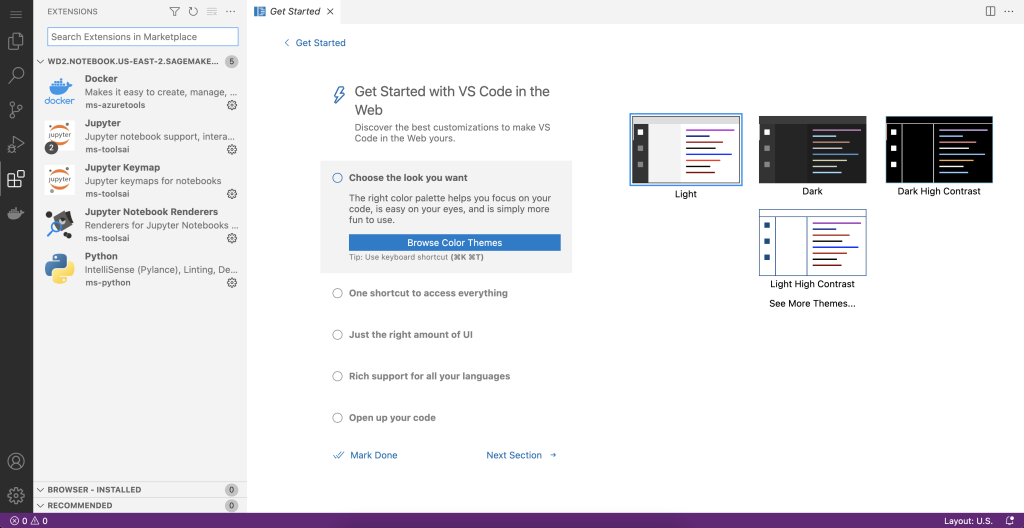

Codeserver , um einen neuen Browser-Tab zu öffnen, der Ihnen den Zugriff auf den Code-Server von Ihrem Browser aus ermöglicht.

Die Python-Erweiterung ist bereits installiert und Sie können in Ihrem ML-Projekt arbeiten.

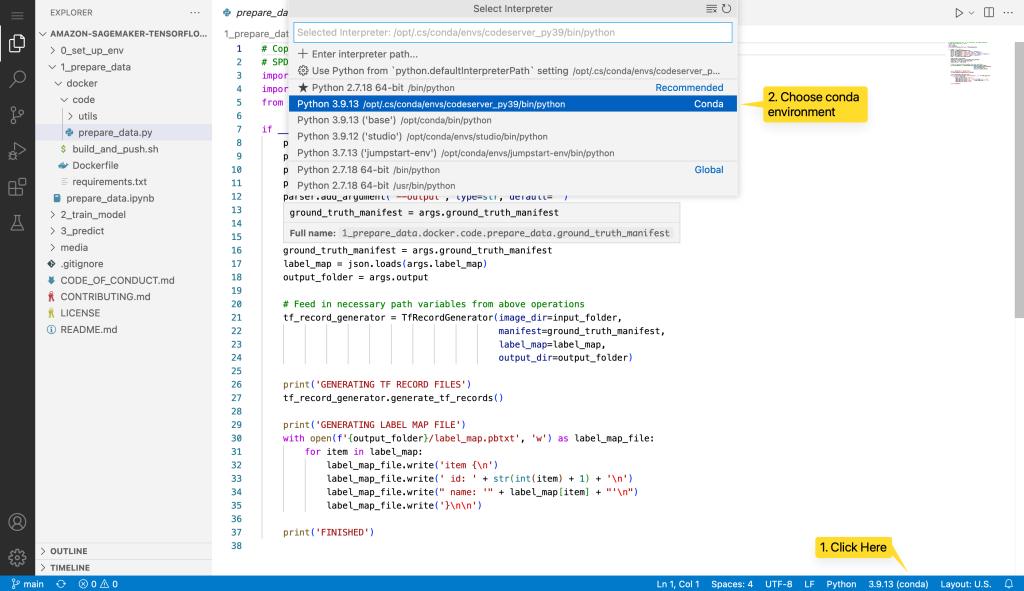

Sie können Ihren Projektordner in VS Code öffnen und die vorgefertigte Conda-Umgebung auswählen, um Ihre Python-Skripts auszuführen.

Automatisieren Sie die Code-Server-Installation für Benutzer in einer Studio-Domäne

Als IT-Administrator können Sie die Installation für Studio-Benutzer automatisieren, indem Sie a Lebenszykluskonfiguration. Dies kann für alle Benutzerprofile unter einer Studio-Domäne oder für bestimmte Benutzerprofile erfolgen. Sehen Passen Sie Amazon SageMaker Studio mithilfe von Lebenszykluskonfigurationen an für weitere Informationen an.

Für diesen Beitrag erstellen wir eine Lebenszykluskonfiguration aus der install-codeserver -Skript und hängen Sie es an eine vorhandene Studio-Domain an. Die Installation wird für alle Benutzerprofile in der Domäne durchgeführt.

Führen Sie auf einem Terminal, das mit der AWS CLI und den entsprechenden Berechtigungen konfiguriert ist, die folgenden Befehle aus:

Nach dem Neustart von Jupyter Server wird die Codeserver Die Schaltfläche wird in Ihrem Studio-Launcher angezeigt.

Option B: Code-Server auf einer SageMaker-Notebook-Instanz hosten

Führen Sie die folgenden Schritte aus, um Code-Server auf einer SageMaker-Notebook-Instance zu hosten:

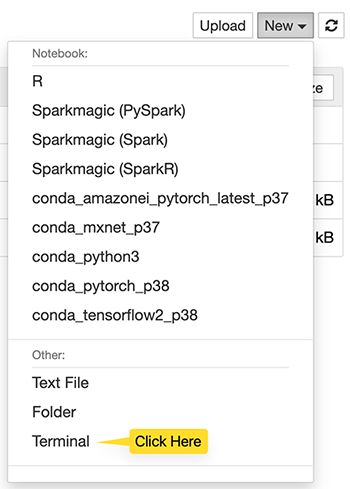

- Starten Sie ein Terminal über Jupyter oder JupyterLab für Ihre Notebook-Instance.

Wenn Sie Jupyter verwenden, wählen Sie Terminal auf die Neu Menü.

- Um die Code-Server-Lösung zu installieren, führen Sie die folgenden Befehle in Ihrem Terminal aus:

Die Installationen des Code-Servers und der Erweiterungen sind auf der Notebook-Instance persistent. Wenn Sie die Instanz jedoch stoppen oder neu starten, müssen Sie den folgenden Befehl ausführen, um den Code-Server neu zu konfigurieren:

sudo ./setup-codeserver.shDie Ausführung der Befehle sollte einige Sekunden dauern. Sie können die Terminal-Registerkarte schließen, wenn Sie Folgendes sehen.

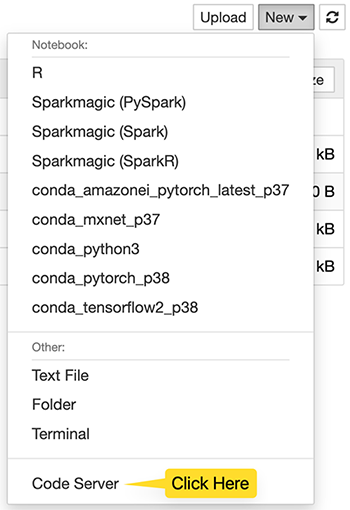

- Laden Sie nun die Jupyter-Seite neu und überprüfen Sie die Neu Menü wieder.

Das Codeserver Option sollte jetzt verfügbar sein.

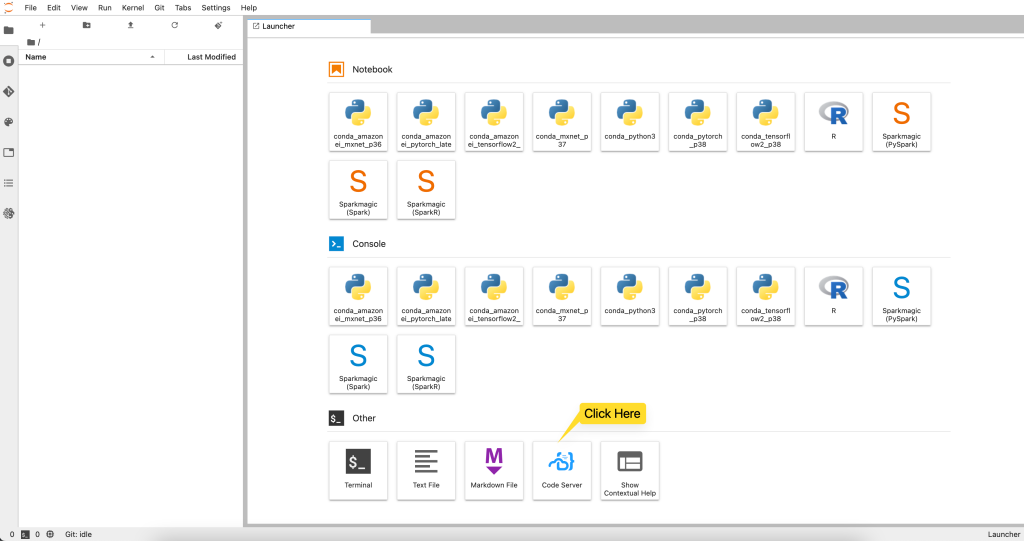

Sie können den Code-Server auch von JupyterLab aus starten, indem Sie eine dedizierte Launcher-Schaltfläche verwenden, wie im folgenden Screenshot gezeigt.

Die Wahl Codeserver öffnet einen neuen Browser-Tab, mit dem Sie von Ihrem Browser aus auf den Code-Server zugreifen können. Die Python- und Docker-Erweiterungen sind bereits installiert, und Sie können in Ihrem ML-Projekt arbeiten.

Automatisieren Sie die Code-Server-Installation auf einer Notebook-Instance

Als IT-Administrator können Sie die Code-Server-Installation mit a automatisieren Lebenszykluskonfiguration die bei der Instanzerstellung ausgeführt wird, und automatisieren Sie die Einrichtung mit einer, die beim Instanzstart ausgeführt wird.

Hier erstellen wir eine Beispiel-Notebook-Instance und eine Lebenszykluskonfiguration mit der AWS-CLIdem „Vermischten Geschmack“. Seine on-create Konfig läuft install-codeserver und on-start läuft Setup-Codeserver.

Führen Sie auf einem Terminal, das mit der AWS CLI und den entsprechenden Berechtigungen konfiguriert ist, die folgenden Befehle aus:

Die Code-Server-Installation ist jetzt für die Notebook-Instance automatisiert.

Zusammenfassung

Mit der Code-Server Auf SageMaker gehostet, können ML-Teams VS Code auf skalierbarem Cloud-Computing ausführen, von überall aus codieren und ihre ML-Projektbereitstellung beschleunigen. IT-Administratoren können damit die Bereitstellung verwalteter, sicherer IDEs in der Cloud standardisieren und beschleunigen, um ML-Teams schnell in ihre Projekte einzubinden und zu unterstützen.

In diesem Beitrag haben wir eine Lösung geteilt, mit der Sie Code-Server schnell sowohl auf Studio- als auch auf Notebook-Instanzen installieren können. Wir teilten einen manuellen Installationsprozess, den ML-Teams selbst ausführen können, und eine automatisierte Installation, die IT-Administratoren für sie einrichten können.

Um in Ihrem Lernen weiter zu gehen, besuchen Sie Ein toller SageMaker auf GitHub, um alle relevanten und aktuellen Ressourcen zu finden, die für die Arbeit mit SageMaker benötigt werden.

Über die Autoren

Giuseppe Angelo Porcelli ist ein Principal Machine Learning Specialist Solutions Architect für Amazon Web Services. Mit mehrjährigem Softwareentwicklungs- und ML-Hintergrund arbeitet er mit Kunden jeder Größe zusammen, um ihre geschäftlichen und technischen Anforderungen genau zu verstehen und Lösungen für KI und maschinelles Lernen zu entwickeln, die die AWS Cloud und den Amazon Machine Learning-Stack optimal nutzen. Er hat an Projekten in verschiedenen Bereichen gearbeitet, darunter MLOps, Computer Vision, NLP, und eine breite Palette von AWS-Services einbezogen. In seiner Freizeit spielt Giuseppe gerne Fußball.

Giuseppe Angelo Porcelli ist ein Principal Machine Learning Specialist Solutions Architect für Amazon Web Services. Mit mehrjährigem Softwareentwicklungs- und ML-Hintergrund arbeitet er mit Kunden jeder Größe zusammen, um ihre geschäftlichen und technischen Anforderungen genau zu verstehen und Lösungen für KI und maschinelles Lernen zu entwickeln, die die AWS Cloud und den Amazon Machine Learning-Stack optimal nutzen. Er hat an Projekten in verschiedenen Bereichen gearbeitet, darunter MLOps, Computer Vision, NLP, und eine breite Palette von AWS-Services einbezogen. In seiner Freizeit spielt Giuseppe gerne Fußball.

Sofian Hamiti ist ein AI / ML-spezialisierter Lösungsarchitekt bei AWS. Er hilft Kunden in verschiedenen Branchen, ihre AI / ML-Reise zu beschleunigen, indem er ihnen hilft, durchgängige Lösungen für maschinelles Lernen zu entwickeln und zu operationalisieren.

Sofian Hamiti ist ein AI / ML-spezialisierter Lösungsarchitekt bei AWS. Er hilft Kunden in verschiedenen Branchen, ihre AI / ML-Reise zu beschleunigen, indem er ihnen hilft, durchgängige Lösungen für maschinelles Lernen zu entwickeln und zu operationalisieren.

Eric Peña ist Senior Technical Product Manager im AWS-Team für künstliche Intelligenzplattformen und arbeitet an Amazon SageMaker Interactive Machine Learning. Derzeit konzentriert er sich auf IDE-Integrationen in SageMaker Studio. Er hat einen MBA-Abschluss vom MIT Sloan und spielt außerhalb der Arbeit gerne Basketball und Fußball.

Eric Peña ist Senior Technical Product Manager im AWS-Team für künstliche Intelligenzplattformen und arbeitet an Amazon SageMaker Interactive Machine Learning. Derzeit konzentriert er sich auf IDE-Integrationen in SageMaker Studio. Er hat einen MBA-Abschluss vom MIT Sloan und spielt außerhalb der Arbeit gerne Basketball und Fußball.

- Fortgeschritten (300)

- AI

- Kunst

- KI-Kunstgenerator

- KI-Roboter

- Amazon Machine Learning

- Amazon Sage Maker

- künstliche Intelligenz

- Zertifizierung für künstliche Intelligenz

- Künstliche Intelligenz im Bankwesen

- Roboter mit künstlicher Intelligenz

- Roboter mit künstlicher Intelligenz

- Software für künstliche Intelligenz

- AWS Maschinelles Lernen

- Blockchain

- Blockchain-Konferenz ai

- Einfallsreichtum

- dialogorientierte künstliche Intelligenz

- Krypto-Konferenz ai

- Dalls

- tiefe Lernen

- Google Ai

- Maschinelles Lernen

- Plato

- platon ai

- Datenintelligenz von Plato

- Plato-Spiel

- PlatoData

- Platogaming

- Skala ai

- Syntax

- Zephyrnet