Dieser Beitrag wurde gemeinsam von Jyoti Sharma und Sharmo Sarkar von Vericast geschrieben.

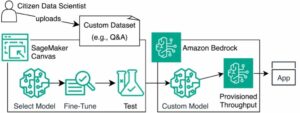

Bei jedem Problem des maschinellen Lernens (ML) beginnt der Data Scientist mit der Arbeit mit Daten. Dazu gehören das Sammeln, Untersuchen und Verstehen der geschäftlichen und technischen Aspekte der Daten sowie die Bewertung aller Manipulationen, die für den Modellerstellungsprozess erforderlich sein können. Ein Aspekt dieser Datenaufbereitung ist das Feature Engineering.

Feature Engineering bezieht sich auf den Prozess, bei dem relevante Variablen identifiziert, ausgewählt und manipuliert werden, um die Rohdaten in nützlichere und verwendbarere Formen für die Verwendung mit dem ML-Algorithmus umzuwandeln, der zum Trainieren eines Modells und zum Durchführen von Inferenzen verwendet wird. Das Ziel dieses Prozesses ist es, die Leistung des Algorithmus und des resultierenden Vorhersagemodells zu steigern. Der Feature-Engineering-Prozess umfasst mehrere Phasen, einschließlich Feature-Erstellung, Datentransformation, Feature-Extraktion und Feature-Auswahl.

Der Aufbau einer Plattform für generalisiertes Feature-Engineering ist eine häufige Aufgabe für Kunden, die viele ML-Modelle mit unterschiedlichen Datensätzen erstellen müssen. Diese Art von Plattform umfasst die Erstellung eines programmgesteuerten Prozesses, um mit wenig menschlichem Eingreifen fertige, funktionstechnische Daten zu erstellen, die für das Modelltraining bereit sind. Die Verallgemeinerung des Feature-Engineering ist jedoch eine Herausforderung. Jedes Geschäftsproblem ist anders, jeder Datensatz ist anders, die Datenmengen variieren stark von Kunde zu Kunde, und die Datenqualität und häufig die Kardinalität einer bestimmten Spalte (im Fall strukturierter Daten) können eine wichtige Rolle bei der Komplexität des Feature-Engineering spielen Verfahren. Darüber hinaus kann die dynamische Natur der Daten eines Kunden auch zu einer großen Varianz der Verarbeitungszeit und der Ressourcen führen, die erforderlich sind, um das Feature-Engineering optimal abzuschließen.

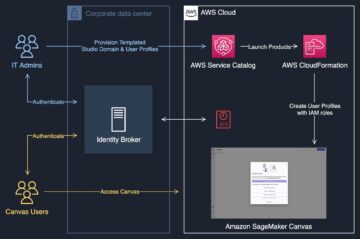

AWS-Kunde Vericast ist ein Unternehmen für Marketinglösungen, das datengesteuerte Entscheidungen trifft, um den Marketing-ROI für seine Kunden zu steigern. Die interne Cloud-basierte Plattform für maschinelles Lernen von Vericast, die um den CRISP-ML(Q)-Prozess herum aufgebaut ist, verwendet verschiedene AWS-Dienste, darunter Amazon Sage Maker, Amazon SageMaker-Verarbeitung, AWS Lambda und AWS Step-Funktionen, um die bestmöglichen Modelle zu erstellen, die auf die spezifischen Daten des Kunden zugeschnitten sind. Diese Plattform zielt darauf ab, die Wiederholbarkeit der Schritte zu erfassen, die zum Aufbau verschiedener ML-Workflows erforderlich sind, und sie in verallgemeinerbaren Standard-Workflow-Modulen innerhalb der Plattform zu bündeln.

In diesem Beitrag teilen wir mit, wie Vericast das Feature-Engineering mit SageMaker Processing optimiert hat.

Lösungsüberblick

Die Plattform für maschinelles Lernen von Vericast unterstützt die schnellere Bereitstellung neuer Geschäftsmodelle auf der Grundlage bestehender Workflows oder die schnellere Aktivierung bestehender Modelle für neue Kunden. Beispielsweise unterscheidet sich ein Modell, das die Neigung zu Direktwerbung vorhersagt, erheblich von einem Modell, das die Empfindlichkeit der Kunden eines Vericast-Kunden für Rabattcoupons vorhersagt. Sie lösen unterschiedliche Geschäftsprobleme und haben daher unterschiedliche Nutzungsszenarien im Design einer Marketingkampagne. Aber aus ML-Sicht können beide als binäre Klassifizierungsmodelle ausgelegt werden und könnten daher viele gemeinsame Schritte aus ML-Workflow-Perspektive teilen, einschließlich Modelloptimierung und -training, Bewertung, Interpretierbarkeit, Bereitstellung und Inferenz.

Da es sich bei diesen Modellen um binäre Klassifizierungsprobleme handelt (in ML-Begriffen), teilen wir die Kunden eines Unternehmens in zwei Klassen (binär) ein: diejenigen, die positiv auf die Kampagne reagieren würden, und diejenigen, die dies nicht tun würden. Darüber hinaus werden diese Beispiele als unausgewogene Klassifizierung angesehen, da die zum Trainieren des Modells verwendeten Daten nicht eine gleiche Anzahl von Kunden enthalten würden, die positiv und nicht positiv reagieren würden.

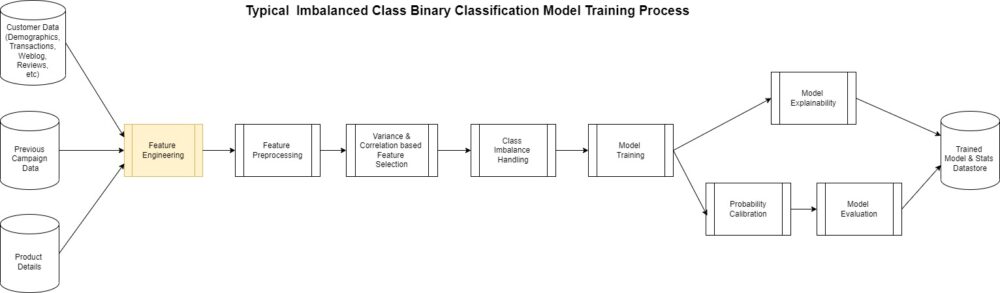

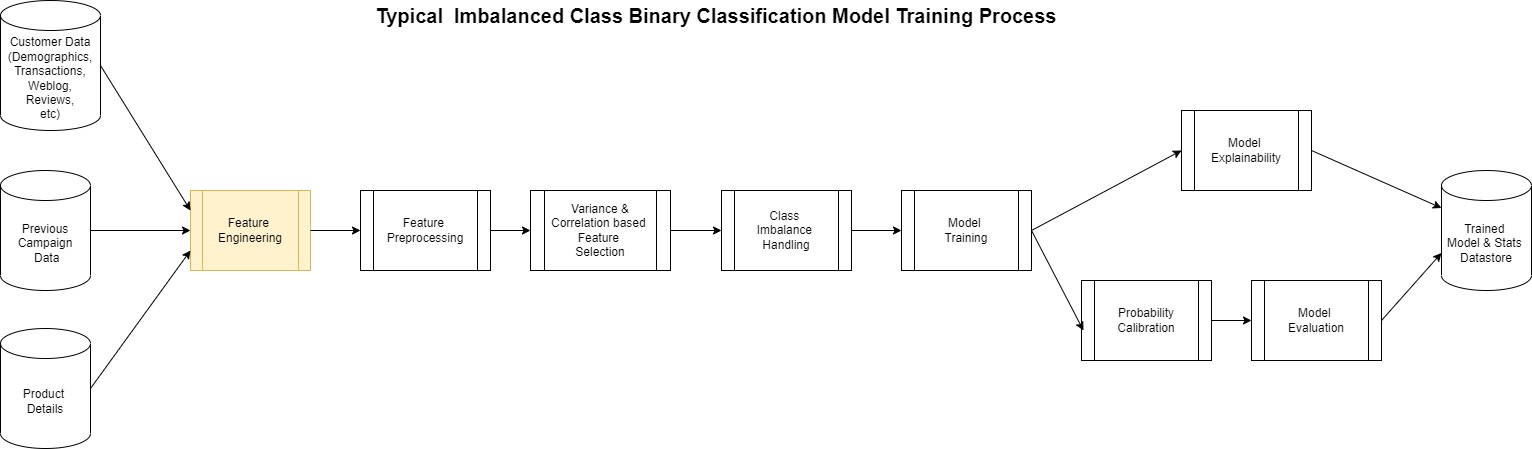

Die eigentliche Erstellung eines solchen Modells folgt dem verallgemeinerten Muster, das im folgenden Diagramm dargestellt ist.

Der größte Teil dieses Prozesses ist für jede binäre Klassifizierung gleich, mit Ausnahme des Merkmalsentwicklungsschritts. Dies ist vielleicht der komplizierteste Schritt in diesem Prozess, der jedoch manchmal übersehen wird. ML-Modelle sind weitgehend von den Funktionen abhängig, die zu ihrer Erstellung verwendet wurden.

Die Cloud-native Plattform für maschinelles Lernen von Vericast zielt darauf ab, die Feature-Engineering-Schritte für verschiedene ML-Workflows zu verallgemeinern und zu automatisieren und ihre Leistung anhand einer Kosten-Zeit-Metrik zu optimieren, indem sie die folgenden Funktionen verwendet:

- Die Feature-Engineering-Bibliothek der Plattform – Dies besteht aus einer sich ständig weiterentwickelnden Reihe von Transformationen, die getestet wurden, um qualitativ hochwertige generalisierbare Funktionen auf der Grundlage spezifischer Kundenkonzepte (z. B. demografische Kundendaten, Produktdetails, Transaktionsdetails usw.) zu erzielen.

- Intelligente Ressourcenoptimierer – Die Plattform nutzt die On-Demand-Infrastrukturfähigkeit von AWS, um die optimalste Art von Verarbeitungsressourcen für den jeweiligen Feature-Engineering-Auftrag bereitzustellen, basierend auf der erwarteten Komplexität des Schritts und der Datenmenge, die verarbeitet werden muss.

- Dynamische Skalierung von Feature-Engineering-Jobs – Dafür wird eine Kombination verschiedener AWS-Services verwendet, allen voran SageMaker Processing. Dadurch wird sichergestellt, dass die Plattform kosteneffizient und zeitnah qualitativ hochwertige Funktionen produziert.

Dieser Beitrag konzentriert sich auf den dritten Punkt in dieser Liste und zeigt, wie Sie eine dynamische Skalierung von SageMaker-Verarbeitungsaufträgen erreichen, um ein besser verwaltetes, leistungsfähigeres und kostengünstigeres Datenverarbeitungs-Framework für große Datenmengen zu erreichen.

Die SageMaker-Verarbeitung ermöglicht Workloads, die Schritte für die Datenvorverarbeitung oder -nachbearbeitung, Feature-Engineering, Datenvalidierung und Modellbewertung auf SageMaker ausführen. Es bietet auch eine verwaltete Umgebung und beseitigt die Komplexität undifferenzierter Schwerstarbeit, die erforderlich ist, um die Infrastruktur einzurichten und zu warten, die zum Ausführen der Workloads erforderlich ist. Darüber hinaus bietet SageMaker Processing eine API-Schnittstelle zum Ausführen, Überwachen und Auswerten der Arbeitslast.

Die Ausführung von SageMaker-Verarbeitungsjobs erfolgt vollständig innerhalb eines verwalteten SageMaker-Clusters, wobei einzelne Jobs zur Laufzeit in Instanzcontainern abgelegt werden. Der verwaltete Cluster, die Instanzen und die Container melden Metriken an Amazon CloudWatch, einschließlich Nutzung von GPU, CPU, Speicher, GPU-Speicher, Festplattenmetriken und Ereignisprotokollierung.

Diese Funktionen bieten Vericast-Datentechnikern und -Wissenschaftlern Vorteile, indem sie bei der Entwicklung allgemeiner Vorverarbeitungs-Workflows helfen und die Schwierigkeit abstrahieren, generierte Umgebungen zu verwalten, in denen sie ausgeführt werden. Aufgrund der dynamischen Natur der Daten und ihrer vielfältigen Merkmale, die in eine solche allgemeine Lösung eingespeist werden können, können jedoch technische Probleme auftreten. Das System muss eine fundierte Anfangsschätzung hinsichtlich der Größe des Clusters und der Instanzen, aus denen er besteht, anstellen. Diese Schätzung muss Kriterien der Daten auswerten und die CPU-, Arbeitsspeicher- und Festplattenanforderungen ableiten. Diese Vermutung kann durchaus angemessen sein und für den Job angemessen sein, in anderen Fällen jedoch möglicherweise nicht. Für einen bestimmten Datensatz und einen Vorverarbeitungsjob ist die CPU möglicherweise zu klein, was zu einer maximalen Verarbeitungsleistung und langen Ausführungszeiten führt. Schlimmer noch, der Arbeitsspeicher könnte zu einem Problem werden, was entweder zu einer schlechten Leistung oder zu Speichermangel führt, wodurch der gesamte Job fehlschlägt.

Angesichts dieser technischen Hürden machte sich Vericast daran, eine Lösung zu schaffen. Sie mussten allgemeiner Natur bleiben und sich in das größere Bild des Vorverarbeitungs-Workflows einfügen, der in den beteiligten Schritten flexibel sein sollte. Es war auch wichtig, sowohl die potenzielle Notwendigkeit zu lösen, die Umgebung in Fällen zu skalieren, in denen die Leistung beeinträchtigt wurde, als auch die ordnungsgemäße Wiederherstellung nach einem solchen Ereignis oder wenn ein Job aus irgendeinem Grund vorzeitig beendet wurde.

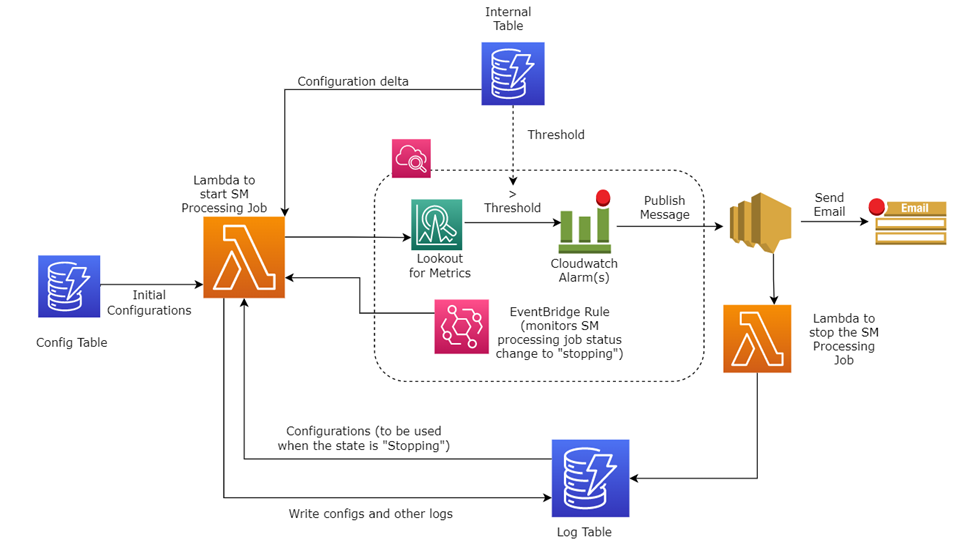

Die von Vericast zur Lösung dieses Problems entwickelte Lösung nutzt mehrere AWS-Services, die zusammenarbeiten, um ihre Geschäftsziele zu erreichen. Es wurde entwickelt, um den SageMaker-Verarbeitungscluster basierend auf Leistungsmetriken neu zu starten und hochzuskalieren, die mithilfe von Lambda-Funktionen beobachtet wurden, die die Jobs überwachen. Um keine Arbeit zu verlieren, wenn ein Skalierungsereignis stattfindet, oder um sich nach einem unerwartet beendeten Job wiederherzustellen, wurde ein Checkpoint-basierter Dienst eingerichtet, der verwendet Amazon DynamoDB und speichert die teilweise verarbeiteten Daten in Amazon Simple Storage-Service (Amazon S3) Buckets nach Abschluss der Schritte. Das Endergebnis ist eine automatisch skalierende, robuste und dynamisch überwachte Lösung.

Das folgende Diagramm zeigt einen groben Überblick über die Funktionsweise des Systems.

In den folgenden Abschnitten gehen wir näher auf die Lösungskomponenten ein.

Lösung initialisieren

Das System geht davon aus, dass ein separater Prozess die Lösung initiiert. Umgekehrt ist dieses Design nicht darauf ausgelegt, allein zu funktionieren, da es keine Artefakte oder Ausgaben liefert, sondern fungiert eher als Sidecar-Implementierung für eines der Systeme, die SageMaker-Verarbeitungsjobs verwenden. Im Fall von Vericast wird die Lösung durch einen Aufruf von einem Step Functions-Schritt initiiert, der in einem anderen Modul des größeren Systems gestartet wurde.

Sobald die Lösung initiiert und ein erster Lauf ausgelöst wurde, wird eine Basisstandardkonfiguration aus einer DynamoDB-Tabelle gelesen. Diese Konfiguration wird zum Festlegen von Parametern für den SageMaker-Verarbeitungsjob verwendet und enthält die anfänglichen Annahmen der Infrastrukturanforderungen. Der SageMaker-Verarbeitungsjob wird jetzt gestartet.

Überwachung von Metadaten und Ausgabe

Wenn der Job startet, schreibt eine Lambda-Funktion die Metadaten der Jobverarbeitung (die aktuelle Jobkonfiguration und andere Protokollinformationen) in die DynamoDB-Protokolltabelle. Diese Metadaten und Protokollinformationen enthalten einen Verlauf des Jobs, seine anfängliche und fortlaufende Konfiguration und andere wichtige Daten.

An bestimmten Punkten, wenn die Schritte im Job abgeschlossen sind, werden Prüfpunktdaten zur DynamoDB-Protokolltabelle hinzugefügt. Verarbeitete Ausgabedaten werden bei Bedarf zur schnellen Wiederherstellung nach Amazon S3 verschoben.

Diese Lambda-Funktion richtet auch eine ein Amazon EventBridge Regel, die den laufenden Job auf seinen Status überwacht. Insbesondere überwacht diese Regel den Job, um zu beobachten, ob sich der Jobstatus in ändert stopping oder ist in einem stopped Zustand. Diese EventBridge-Regel spielt eine wichtige Rolle beim Neustart eines Jobs, wenn ein Fehler auftritt oder ein geplantes Auto Scaling-Ereignis eintritt.

Überwachung von CloudWatch-Metriken

Die Lambda-Funktion setzt auch einen CloudWatch-Alarm basierend auf einem mathematischen Metrikausdruck für den Verarbeitungsauftrag, der die Metriken aller Instanzen für CPU-Auslastung, Speicherauslastung und Festplattenauslastung überwacht. Dieser Alarmtyp (Metrik) verwendet CloudWatch-Alarmschwellenwerte. Der Alarm generiert Ereignisse basierend auf dem Wert der Metrik oder des Ausdrucks relativ zu den Schwellenwerten über eine Reihe von Zeiträumen.

Im Anwendungsfall von Vericast ist der Schwellenwertausdruck so konzipiert, dass der Treiber und die Executor-Instanzen als getrennt betrachtet werden, wobei die Metriken für jede einzeln überwacht werden. Durch die Trennung weiß Vericast, was den Alarm verursacht. Dies ist wichtig, um zu entscheiden, wie entsprechend skaliert werden soll:

- Wenn die Executor-Metriken den Schwellenwert überschreiten, empfiehlt es sich, horizontal zu skalieren

- Wenn die Treibermetriken den Schwellenwert überschreiten, hilft eine horizontale Skalierung wahrscheinlich nicht, also müssen wir vertikal skalieren

Alarmmetrikausdruck

Vericast kann bei seiner Bewertung für Skalierung und Fehler auf die folgenden Metriken zugreifen:

- CPU-Auslastung – Die Summe der Auslastung jedes einzelnen CPU-Kerns

- Speicherauslastung – Der Prozentsatz des Arbeitsspeichers, der von den Containern auf einer Instanz verwendet wird

- Festplattennutzung – Der Prozentsatz des Speicherplatzes, der von den Containern auf einer Instanz verwendet wird

- GPU-Auslastung – Der Prozentsatz der GPU-Einheiten, die von den Containern auf einer Instanz verwendet werden

- GPU-Speicherauslastung – Der Prozentsatz des GPU-Speichers, der von den Containern auf einer Instanz verwendet wird

Zum jetzigen Zeitpunkt berücksichtigt Vericast nur CPUUtilization, MemoryUtilization und DiskUtilization. In Zukunft wollen sie darüber nachdenken GPUUtilization und GPUMemoryUtilization .

Der folgende Code ist ein Beispiel für einen CloudWatch-Alarm, der auf einem metrischen mathematischen Ausdruck für die automatische Skalierung von Vericast basiert:

Dieser Ausdruck veranschaulicht, dass der CloudWatch-Alarm berücksichtigt DriverMemoryUtilization (memoryDriver), CPUUtilization (cpuDriver), DiskUtilization (diskDriver), ExecutorMemoryUtilization (memoryExec), CPUUtilization (cpuExec) und DiskUtilization (diskExec) als Überwachungsmetriken. Die Zahl 80 im vorhergehenden Ausdruck steht für den Schwellwert.

Hier IF((cpuDriver) > 80, 1, 0 bedeutet, dass, wenn die CPU-Auslastung des Treibers 80 % überschreitet, 1 als Schwellenwert zugewiesen wird, andernfalls 0. IF(AVG(METRICS("memoryExec")) > 80, 1, 0 impliziert, dass alle Metriken mit Zeichenfolge memoryExec darin berücksichtigt und daraus ein Durchschnitt berechnet. Wenn dieser durchschnittliche Prozentsatz der Speicherauslastung über 80 hinausgeht, wird 1 als Schwellenwert zugewiesen, andernfalls 0.

Der logische Operator OR wird im Ausdruck verwendet, um alle Verwendungen im Ausdruck zu vereinheitlichen – wenn eine der Verwendungen ihren Schwellenwert erreicht, wird der Alarm ausgelöst.

Weitere Informationen zur Verwendung von CloudWatch-Metrikalarmen basierend auf mathematischen Metrikausdrücken finden Sie unter Erstellen eines CloudWatch-Alarms basierend auf einem metrischen mathematischen Ausdruck.

Einschränkungen für CloudWatch-Alarme

CloudWatch begrenzt die Anzahl der Metriken pro Alarm auf 10. Dies kann zu Einschränkungen führen, wenn Sie mehr Metriken berücksichtigen müssen.

Um diese Einschränkung zu umgehen, hat Vericast Alarme basierend auf der Gesamtclustergröße eingerichtet. Pro drei Instanzen wird ein Alarm erstellt (bei drei Instanzen gibt es einen Alarm, da dies neun Metriken ergeben würde). Unter der Annahme, dass die Treiberinstanz separat betrachtet werden soll, wird für die Treiberinstanz ein weiterer separater Alarm erstellt. Daher entspricht die Gesamtzahl der erstellten Alarme ungefähr einem Drittel der Anzahl der Executor-Knoten und einem zusätzlichen für die Treiberinstanz. In jedem Fall liegt die Anzahl der Metriken pro Alarm unter der 10-Metrik-Grenze.

Was passiert im Alarmzustand

Wenn ein vorgegebener Schwellenwert erreicht wird, geht der Alarm auf ein alarm Staat, der verwendet Amazon Simple Notification Service (Amazon SNS), um Benachrichtigungen zu versenden. In diesem Fall sendet es eine E-Mail-Benachrichtigung an alle Abonnenten mit den Details zum Alarm in der Nachricht.

Amazon SNS wird auch als Auslöser für eine Lambda-Funktion verwendet, die den derzeit ausgeführten SageMaker-Verarbeitungsjob stoppt, da wir wissen, dass der Job wahrscheinlich fehlschlagen wird. Diese Funktion zeichnet auch Protokolle in Bezug auf das Ereignis in der Protokolltabelle auf.

Die beim Jobstart eingerichtete EventBridge-Regel erkennt, dass der Job in a gegangen ist stopping Zustand ein paar Sekunden später. Diese Regel führt dann die erste Lambda-Funktion erneut aus, um den Job neu zu starten.

Der dynamische Skalierungsprozess

Die erste Lambda-Funktion nach zwei- oder mehrmaliger Ausführung weiß, dass ein vorheriger Job bereits gestartet wurde und nun gestoppt wurde. Die Funktion durchläuft einen ähnlichen Prozess zum Abrufen der Basiskonfiguration aus dem ursprünglichen Job in der DynamoDB-Protokolltabelle und ruft außerdem die aktualisierte Konfiguration aus der internen Tabelle ab. Diese aktualisierte Konfiguration ist eine Ressourcen-Deltakonfiguration, die basierend auf dem Skalierungstyp festgelegt wird. Der Skalierungstyp wird wie zuvor beschrieben aus den Alarmmetadaten bestimmt.

Die ursprüngliche Konfiguration plus das Ressourcendelta werden verwendet, da eine neue Konfiguration und ein neuer SageMaker-Verarbeitungsjob mit den erhöhten Ressourcen gestartet werden.

Dieser Prozess wird fortgesetzt, bis der Auftrag erfolgreich abgeschlossen ist, und kann bei Bedarf zu mehreren Neustarts führen, wobei jedes Mal weitere Ressourcen hinzugefügt werden.

Das Ergebnis von Vericast

Diese benutzerdefinierte Auto-Scaling-Lösung war maßgeblich daran beteiligt, die Machine Learning-Plattform von Vericast robuster und fehlertoleranter zu machen. Die Plattform kann nun Workloads unterschiedlicher Datenmengen mit minimalem menschlichem Eingriff problemlos bewältigen.

Vor der Implementierung dieser Lösung war die Schätzung des Ressourcenbedarfs für alle Spark-basierten Module in der Pipeline einer der größten Engpässe des Onboarding-Prozesses für neue Kunden. Workflows würden scheitern, wenn das Kundendatenvolumen zunimmt, oder die Kosten wären nicht vertretbar, wenn das Datenvolumen in der Produktion abnimmt.

Mit diesem neuen Modul wurden Workflow-Ausfälle aufgrund von Ressourcenengpässen um fast 80 % reduziert. Die wenigen verbleibenden Fehler sind hauptsächlich auf Einschränkungen des AWS-Kontos zurückzuführen und gehen über den automatischen Skalierungsprozess hinaus. Der größte Vorteil von Vericast bei dieser Lösung ist die Leichtigkeit, mit der neue Clients und Workflows integriert werden können. Vericast erwartet, den Prozess um mindestens 60–70 % zu beschleunigen, wobei noch Daten für eine endgültige Zahl gesammelt werden müssen.

Obwohl dies von Vericast als Erfolg angesehen wird, sind damit Kosten verbunden. Basierend auf der Art dieses Moduls und dem Konzept der dynamischen Skalierung insgesamt dauern die Workflows in der Regel etwa 30 % länger (Durchschnittsfall) als ein Workflow mit einem individuell abgestimmten Cluster für jedes Modul im Workflow. Vericast arbeitet in diesem Bereich weiter an der Optimierung und versucht, die Lösung durch die Integration einer heuristikbasierten Ressourceninitialisierung für jedes Client-Modul zu verbessern.

Sharmo Sarkar, Senior Manager, Machine Learning Platform bei Vericast, sagt: „Während wir unsere Nutzung von AWS und SageMaker weiter ausbauen, wollte ich mir einen Moment Zeit nehmen, um die unglaubliche Arbeit unseres AWS Client Services-Teams, engagierter AWS-Lösungsarchitekten, hervorzuheben. und AWS Professional Services, mit denen wir zusammenarbeiten. Ihr tiefes Verständnis von AWS und SageMaker ermöglichte es uns, eine Lösung zu entwickeln, die alle unsere Anforderungen erfüllte und uns die erforderliche Flexibilität und Skalierbarkeit bot. Wir sind so dankbar, ein so talentiertes und sachkundiges Support-Team an unserer Seite zu haben.“

Zusammenfassung

In diesem Beitrag haben wir mitgeteilt, wie SageMaker und SageMaker Processing es Vericast ermöglicht haben, ein verwaltetes, leistungsfähiges und kostengünstiges Datenverarbeitungs-Framework für große Datenmengen aufzubauen. Durch die Kombination der Leistung und Flexibilität von SageMaker Processing mit anderen AWS-Services können sie den generalisierten Feature-Engineering-Prozess einfach überwachen. Sie können potenzielle Probleme, die durch fehlende Rechenleistung, Arbeitsspeicher und andere Faktoren entstehen, automatisch erkennen und bei Bedarf automatisch vertikale und horizontale Skalierung implementieren.

SageMaker und seine Tools können auch Ihrem Team helfen, seine ML-Ziele zu erreichen. Um mehr über SageMaker Processing zu erfahren und wie es Sie bei Ihren Datenverarbeitungs-Workloads unterstützen kann, beziehen Sie sich auf Prozessdaten. Wenn Sie gerade erst mit ML beginnen und nach Beispielen und Anleitungen suchen, Amazon SageMaker-JumpStart kann Ihnen den Einstieg erleichtern. JumpStart ist ein ML-Hub, von dem aus Sie auf integrierte Algorithmen mit vortrainierten Basismodellen zugreifen können, die Ihnen bei der Durchführung von Aufgaben wie Artikelzusammenfassung und Bildgenerierung sowie vorgefertigten Lösungen zur Lösung häufiger Anwendungsfälle helfen.

Wenn dieser Beitrag Ihnen hilft oder Sie dazu inspiriert, ein Problem zu lösen, würden wir uns freuen, davon zu hören! Bitte teilen Sie Ihre Kommentare und Ihr Feedback.

Über die Autoren

Anthony McClure ist Senior Partner Solutions Architect im AWS SaaS Factory-Team. Anthony hat auch ein starkes Interesse an maschinellem Lernen und künstlicher Intelligenz und arbeitet mit der AWS ML/AI Technical Field Community zusammen, um Kunden dabei zu unterstützen, ihre Lösungen für maschinelles Lernen in die Realität umzusetzen.

Anthony McClure ist Senior Partner Solutions Architect im AWS SaaS Factory-Team. Anthony hat auch ein starkes Interesse an maschinellem Lernen und künstlicher Intelligenz und arbeitet mit der AWS ML/AI Technical Field Community zusammen, um Kunden dabei zu unterstützen, ihre Lösungen für maschinelles Lernen in die Realität umzusetzen.

Jyoti Sharma ist Data Science Engineer im Machine-Learning-Plattform-Team bei Vericast. Sie interessiert sich leidenschaftlich für alle Aspekte der Datenwissenschaft und konzentriert sich auf die Entwicklung und Implementierung einer hochskalierbaren und verteilten Plattform für maschinelles Lernen.

Jyoti Sharma ist Data Science Engineer im Machine-Learning-Plattform-Team bei Vericast. Sie interessiert sich leidenschaftlich für alle Aspekte der Datenwissenschaft und konzentriert sich auf die Entwicklung und Implementierung einer hochskalierbaren und verteilten Plattform für maschinelles Lernen.

Sharmo Sarkar ist Senior Manager bei Vericast. Er leitet die Cloud Machine Learning Platform und die Marketing Platform ML R&D Teams bei Vericast. Er verfügt über umfangreiche Erfahrung in den Bereichen Big Data Analytics, Distributed Computing und Natural Language Processing. Außerhalb der Arbeit fährt er gerne Motorrad, wandert und radelt auf Bergpfaden.

Sharmo Sarkar ist Senior Manager bei Vericast. Er leitet die Cloud Machine Learning Platform und die Marketing Platform ML R&D Teams bei Vericast. Er verfügt über umfangreiche Erfahrung in den Bereichen Big Data Analytics, Distributed Computing und Natural Language Processing. Außerhalb der Arbeit fährt er gerne Motorrad, wandert und radelt auf Bergpfaden.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoAiStream. Web3-Datenintelligenz. Wissen verstärkt. Hier zugreifen.

- Die Zukunft prägen mit Adryenn Ashley. Hier zugreifen.

- Kaufen und verkaufen Sie Anteile an PRE-IPO-Unternehmen mit PREIPO®. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/how-vericast-optimized-feature-engineering-using-amazon-sagemaker-processing/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 10

- 100

- 15%

- 7

- a

- Über Uns

- Zugang

- entsprechend

- Konto

- Erreichen

- Aktivierung

- Handlungen

- hinzufügen

- hinzugefügt

- Hinzufügen

- Zusätzliche

- angemessen

- Nach der

- gegen

- AIDS

- Ziel

- Alarm

- Algorithmus

- Algorithmen

- Alle

- allein

- entlang

- bereits

- ebenfalls

- Amazon

- Amazon Sage Maker

- Betrag

- an

- Analytik

- und

- Ein anderer

- Heinrich

- jedem

- Bienen

- angemessen

- Architektur

- SIND

- Bereich

- um

- Artikel

- künstlich

- künstliche Intelligenz

- AS

- Aussehen

- Aspekte

- zugewiesen

- helfen

- At

- Auto

- automatisieren

- Im Prinzip so, wie Sie es von Google Maps kennen.

- durchschnittlich

- AWS

- Professionelle AWS-Services

- Base

- basierend

- BE

- weil

- werden

- war

- Sein

- Vorteile

- BESTE

- Beyond

- Big

- Big Data

- Größte

- Auftrieb

- beide

- Bringing

- bauen

- Building

- erbaut

- eingebaut

- Geschäft

- aber

- by

- berechnet

- rufen Sie uns an!

- Kampagnen (Campaign)

- CAN

- Kann bekommen

- Capturing

- Häuser

- Fälle

- Verursachen

- verursacht

- sicher

- herausfordernd

- Änderungen

- Klasse

- Unterricht

- Einstufung

- Auftraggeber

- Client-Onboarding

- Kunden

- Cloud

- Cluster

- Code

- Kolonne

- Kombination

- Vereinigung

- kommt

- Bemerkungen

- gemeinsam

- community

- Unternehmen

- abschließen

- Wird abgeschlossen

- Komplexität

- kompliziert

- Komponenten

- Kompromittiert

- Berechnen

- Computing

- konzept

- Konzepte

- Konfiguration

- Geht davon

- betrachtet

- Berücksichtigung

- überlegt

- Einschränkungen

- enthalten

- Behälter

- fortsetzen

- weiter

- Kosten

- kostengünstiger

- könnte

- Gutschein

- erstellen

- erstellt

- Schaffung

- Kriterien

- Cross

- Strom

- Zur Zeit

- Original

- Kunde

- Kunden

- technische Daten

- Datenanalyse

- Datenaufbereitung

- Datenverarbeitung

- Datenwissenschaft

- Datenwissenschaftler

- datengesteuerte

- Datensätze

- entscheidet

- Entscheidungen

- gewidmet

- tief

- Delta

- Demographie

- abhängig

- Einsatz

- beschrieben

- Design

- entworfen

- Entwerfen

- Detail

- Details

- entschlossen

- Entwicklung

- anders

- verschieden

- Schwierigkeit

- Direkt

- Rabatt

- diskutieren

- verteilt

- Verteiltes rechnen

- angetrieben

- Fahrer

- zwei

- dynamisch

- dynamisch

- jeder

- Früher

- erleichtern

- leicht

- entweder

- freigegeben

- ermöglicht

- Ingenieur

- Entwicklung

- Ingenieure

- sorgt

- Ganz

- Arbeitsumfeld

- Umgebungen

- gleich

- Äquivalent

- bewerten

- Auswerten

- Auswertung

- Event

- Veranstaltungen

- Beispiel

- Beispiele

- Außer

- vorhandenen

- Erweitern Sie die Funktionalität der

- erwartet

- erwartet

- ERFAHRUNGEN

- Möglichkeiten sondieren

- Ausdrücke

- umfangreiche

- Langjährige Erfahrung

- Faktoren

- Fabrik

- FAIL

- Scheitern

- Merkmal

- Eigenschaften

- Fed

- Feedback

- wenige

- Feld

- Finale

- abgeschlossen

- Vorname

- passen

- Flexibilität

- flexibel

- konzentriert

- Folgende

- folgt

- Aussichten für

- Formen

- Foundation

- Unser Ansatz

- für

- voll

- Funktion

- Funktionen

- Außerdem

- Zukunft

- Sammlung

- Allgemeines

- erzeugt

- erzeugt

- Generation

- bekommen

- bekommen

- gegeben

- Go

- Kundenziele

- Ziele

- Goes

- gut

- GPU

- dankbar

- die Vermittlung von Kompetenzen,

- hätten

- Griff

- das passiert

- Haben

- mit

- he

- hören

- schwer

- schweres Heben

- Hilfe

- hilft

- High-Level

- hochwertige

- Hervorheben

- hoch

- Geschichte

- Horizontale

- horizontal

- Ultraschall

- Hilfe

- aber

- HTML

- http

- HTTPS

- Nabe

- human

- Hürden

- i

- identifiziert

- if

- zeigt

- Image

- implementieren

- Implementierung

- Umsetzung

- wichtig

- zu unterstützen,

- in

- In anderen

- Dazu gehören

- Einschließlich

- einarbeiten

- Erhöhung

- hat

- unglaublich

- Krankengymnastik

- Individuell

- Information

- Infrastruktur

- Anfangs-

- Initiiert

- Instanz

- instrumental

- Intelligenz

- wollen

- Interesse

- Schnittstelle

- intern

- Intervention

- in

- beteiligt

- Problem

- Probleme

- IT

- SEINE

- Job

- Jobs

- jpg

- nur

- Art

- Wissen

- Mangel

- Sprache

- grosse

- weitgehend

- größer

- später

- umwandeln

- LERNEN

- lernen

- am wenigsten

- Bibliothek

- Facelift

- Einschränkung

- Einschränkungen

- Grenzen

- Liste

- wenig

- Log

- Protokollierung

- logisch

- länger

- suchen

- verlieren

- ich liebe

- Maschine

- Maschinelles Lernen

- halten

- Aufrechterhaltung

- unterhält

- um

- MACHT

- Making

- verwaltet

- Manager

- manipuliert

- Weise

- viele

- Marketing

- Mathe

- Kann..

- Triff

- Memory

- Nachricht

- Metadaten

- Metrisch

- Metrik

- könnte

- Geist / Bewusstsein

- minimal

- ML

- Modell

- für

- Modul

- Module

- Moment

- Überwachen

- überwacht

- Überwachung

- Monitore

- mehr

- vor allem warme

- meist

- Mountain

- mehrere

- sollen

- Natürliche

- Verarbeitung natürlicher Sprache

- Natur

- Need

- erforderlich

- benötigen

- Bedürfnisse

- Neu

- Fiber Node

- vor allem

- Notiz..

- Benachrichtigung

- Benachrichtigungen

- jetzt an

- Anzahl

- beobachten

- of

- vorgenommen,

- on

- On-Demand

- Onboard

- Einsteigen

- EINEM

- laufend

- einzige

- Operator

- optimal

- Optimieren

- optimiert

- or

- Original

- Andere

- UNSERE

- Ergebnis

- Möglichkeiten für das Ausgangssignal:

- aussen

- übrig

- Gesamt-

- Überwinden

- Überblick

- Parameter

- Teil

- besondere

- Partner

- Bestehen

- leidenschaftlich

- Schnittmuster

- Prozentsatz

- Ausführen

- Leistung

- vielleicht

- Zeiträume

- Perspektive

- ein Bild

- Pipeline

- Ort

- geplant

- Plattform

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Play

- spielt

- Bitte

- erfahren

- Points

- Punkte

- Arm

- möglich

- Post

- Potenzial

- Werkzeuge

- Vorhersage

- früher

- wahrscheinlich

- Aufgabenstellung:

- Probleme

- Prozessdefinierung

- Verarbeitet

- Verarbeitung

- produziert

- Produkt

- Produktion

- Professionell

- die

- vorausgesetzt

- bietet

- setzen

- Qualität

- Direkt

- schneller

- F&E

- lieber

- Roh

- erreichen

- Lesen Sie mehr

- bereit

- Realität

- Grund

- Aufzeichnungen

- Entspannung

- Erholung

- Reduziert

- bezieht sich

- bezogene

- relevant

- bleiben

- verbleibenden

- berichten

- falls angefordert

- Voraussetzungen:

- Ressourcen

- Downloads

- Reagieren

- Folge

- was zu

- robust

- Rollen

- rund

- Regel

- Führen Sie

- Laufen

- SaaS

- sagemaker

- gleich

- sagt

- Skalierbarkeit

- skalierbaren

- Skalieren

- Skalierung

- Skalierungslösung

- Szenarien

- Wissenschaft

- Wissenschaftler

- Wissenschaftler

- Sekunden

- Abschnitte

- ausgewählt

- Auswahl

- senden

- sendet

- Senior

- Sensitivität

- getrennte

- Trennung

- Lösungen

- kompensieren

- Sets

- mehrere

- Teilen

- von Locals geführtes

- Sharma

- sie

- gezeigt

- Konzerte

- Seite

- signifikant

- ähnlich

- Einfacher

- Größe

- So

- Lösung

- Lösungen

- LÖSEN

- Raumfahrt

- spezifisch

- speziell

- Geschwindigkeit

- Wirbelsäule ... zu unterstützen.

- Stufen

- Standard

- steht

- Anfang

- begonnen

- beginnt

- Bundesstaat

- Status

- Schritt

- Shritte

- Immer noch

- gestoppt

- Einstellung

- Stoppt

- Lagerung

- Läden

- Schnur

- stark

- strukturierte

- weltweit

- Erfolg

- Erfolgreich

- so

- Support

- System

- Systeme und Techniken

- Tabelle

- zugeschnitten

- Nehmen

- nimmt

- talentiert

- Aufgabe

- und Aufgaben

- Team

- Teams

- Technische

- AGB

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Zukunft

- ihr

- Sie

- dann

- Dort.

- deswegen

- Diese

- vom Nutzer definierten

- Dritte

- fehlen uns die Worte.

- diejenigen

- nach drei

- Schwelle

- Durch

- Zeit

- mal

- zu

- gemeinsam

- Werkzeuge

- Gesamt

- Training

- Ausbildung

- Transaktion

- Transaktionsdetails

- Transformieren

- Transformation

- Transformationen

- auslösen

- ausgelöst

- XNUMX

- tippe

- typisch

- für

- Verständnis

- Bereiche

- bis

- aktualisiert

- us

- verwendbar

- Anwendungsbereich

- -

- Anwendungsfall

- benutzt

- Verwendung von

- Bestätigung

- Wert

- verschiedene

- vertikal

- Volumen

- Volumen

- vs

- wollte

- wurde

- beobachten

- Weg..

- we

- GUT

- wann

- welche

- WHO

- ganze

- ganz

- werden wir

- gewinnen

- mit

- .

- Arbeiten

- Workflows

- arbeiten,

- Werk

- schlimmer

- würde

- Schreiben

- noch

- Ausbeute

- Du

- Ihr

- Zephyrnet