By Kenna Hughes-Castleberry gepostet am 02

Dank technologischer Fortschritte wird es immer schwieriger zu sagen, was real ist und was nicht. Dieses Problem wird durch den Einsatz von Deepfake-Technologie noch verschlimmert—Audio und Videos die KI verwenden, um Einzelpersonen oder ihre Stimmen zu ersetzen. Während viele Deepfakes erfolgreich zur Unterhaltung verwendet wurden (wie z Nicholas Cage war in der Jäger des verlorenen Schatzes) oder Spiele (wie in FIFA-Athleten), ein großer Prozentsatz von ihnen wurde für mehr erstellt finstere Gründe. Da es einfacher wird, diese manipulierten Videos zu erstellen, hoffen viele Experten, dass Quantencomputer dazu beitragen können, die potenziellen Bedrohungen dieser aufstrebenden Technologie zu überwinden.

Wie funktioniert die Deepfake-Technologie?

Um ein erfolgreiches Deepfake-Video zu erstellen, benötigen Sie Maschinelles Lernen Algorithmen. „Deep-Learning-Algorithmen bringen sich selbst bei, wie man Probleme aus großen Datensätzen löst, und werden dann verwendet, um Gesichter über Videos und andere digitale Inhalte zu tauschen“, erklärte Post-Quantum CEO & Founder Andersen Cheng. Post-Quantum ist ein führendes Cybersicherheitsunternehmen, dessen Fokus auf quantenresistent Sicherheit, auch vor Deepfakes. „Es gibt eine Reihe von Methoden, um diese Deepfakes zu erstellen“, erklärte Cheng, „aber die beliebteste ist die Verwendung von tiefen neuronalen Netzwerken mit Autoencodern. Ein Autoencoder ist ein Deep-Learning-KI-Programm, das Videoclips untersucht, um zu verstehen, wie eine Person aus verschiedenen Blickwinkeln und der Umgebung aussieht, und diese Person dann auf die Person abbildet, indem es gemeinsame Merkmale findet.“

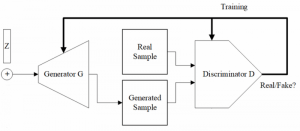

Einrichtung einer Deepfake-Technologie (PC Wikimedia Commons)

Um sicherzustellen, dass der Autoencoder erfolgreich funktioniert, müssen mehrere Videoclips des Gesichts der Person analysiert werden, um einen größeren Datenpool zu erhalten. Dann kann der Autoencoder helfen, ein zusammengesetztes Video zu erstellen, indem er das ursprüngliche Individuum mit dem neuen Motiv austauscht. Eine zweite Art des maschinellen Lernens namens General Adversarial Network (GANs) wird Fehler im neuen zusammengesetzten Video erkennen und verbessern. Laut a Artikel 2022: „GANs trainieren einen „Generator“, um aus der latenten Darstellung des Quellbilds neue Bilder zu erstellen, und einen „Diskriminator“, um den Realismus der generierten Materialien zu bewerten.“ Dieser Vorgang wiederholt sich mehrmals, bis der Diskriminator nicht feststellen kann, ob das Video manipuliert und der Deepfake vollständig ist.

Die Bedrohung durch Deepfake-Technologie

Derzeit gibt es viele Open-Source-Software oder kostenlose Apps, mit denen Einzelpersonen Deepfakes erstellen können. Während dies für viele, insbesondere in der Unterhaltungsindustrie, vorteilhaft erscheinen mag, hat es zu einigen ernsthaften, sogar kriminellen Problemen geführt. Laut a Deeptrace-Bericht, waren 96 % der Deepfake-Videos im Jahr 2019, nicht überraschend, Pornografie. Während viele dieser illegalen Videos aus Rache an einem Ex gemacht wurden, wurden andere verwendet, um Skandale für weibliche Prominente und sogar Politiker zu schaffen. Im Jahr 2018 wurde ein Deepfake-Video von a veröffentlicht Belgische politische Partei zeigt den damaligen Präsidenten Trump bei der Diskussion über das Pariser Klimaabkommen. Da gefälschte Nachrichten bereits zu einem Problem für die breite Öffentlichkeit geworden sind, könnten Deepfake-Videos der Tropfen sein, der das Fass zum Überlaufen bringt. Eben Deepfake-Audio richtet Chaos an, als eine manipulierte Audiodatei aus dem CEO & Founder eines Technologieunternehmens zu einer Betrugshandlung beigetragen. Für Cheng können diese Arten von Medien das Vertrauen der Öffentlichkeit ziemlich schnell zermürben. „Wir haben das umfassendere Problem des gesellschaftlichen Vertrauens – wie wird die Öffentlichkeit in der Lage sein, zwischen dem, was echt ist, und dem, was ein Deepfake ist, zu unterscheiden“, fügte Cheng hinzu. „Wie wir gesehen haben, gibt es sogar Hinweise darauf, dass Deepfakes verwendet werden, um Schutzmaßnahmen wie die biometrische Authentifizierung zu umgehen.“ Angesichts dieser wachsenden Bedenken glauben Cheng und sein Team bei Post-Quantum, dass sie eine Lösung in Form von haben Nomidio, eine spezialisierte Ultra-Sicherheitssoftware.

Vorbereitung auf Bedrohungen durch DeepFake-Technologie

Angesichts der zahlreichen Bedrohungen, die von Quantencomputern und Deepfakes ausgehen, haben Cheng und dieses Team Nomidio entwickelt, um sicherzustellen, dass Login-Identitäten und sogar biometrische Authentifizierungen sicher bleiben. „Nomidio ist ein biometrischer, passwortloser Multi-Faktor-Biometriedienst (MFB), der eine sichere Authentifizierung mit einer einfachen und intuitiven Benutzererfahrung ermöglicht“, sagte Cheng. „Es ersetzt die benutzername/passwortbasierte Anmeldung und einmalige Anmeldung, wobei Benutzer hinter den Kulissen anhand ihres biometrischen Profils mit Multi-Faktor-Authentifizierung (MFA) authentifiziert werden.“ Da Cheng seit vielen Jahren Experte für Cybersicherheit ist, hat er dafür gesorgt, dass Nomidio auch gegen Deepfakes sicher ist. „Unsere Kernphilosophie bei der Erstellung war es, so viel zusätzlichen Input wie möglich und eine echte Multi-Faktor-Authentifizierung (dh mit mehr als zwei Faktoren) zu verwenden, sodass es tatsächlich die ideale Lösung ist, um jede zukünftige Entwicklung in der Deepfake-Technologie anzugehen. Das liegt letztlich daran, dass herkömmliches MFA nicht ausreicht, MFB aber Echtzeitangriffe praktisch unmöglich machen kann. Das heißt, eine Kombination aus beispielsweise Stimme, Gesicht und einem PIN-Code ist aufgrund der Tatsache hochgradig sicher, dass jeder einzelne Faktor möglicherweise gefälscht werden kann, es jedoch praktisch unmöglich ist, alle drei gleichzeitig zu fälschen. Mit Nomidio kann eine Kombination aus Stimm- und Gesichtsbiometrie, Spracherkennung, kontextabhängigen Daten und sogar Verhaltensanalysen in einem einzigen Authentifizierungssystem kombiniert werden. ”

Während Nomidio selbst Quantencomputer nicht nutzt, um Deepfake-Bedrohungen zu überwinden, könnten Quantencomputer möglicherweise gegen diese gefälschten Mediendateien arbeiten. Wie Quantencomputer nutzen häufig maschinelle Lernalgorithmen, um schneller und effizienter zu arbeiten, können sie möglicherweise erkennen gefälschte Videos oder Audiodateien schneller. Während sich die Technologie noch in der Entwicklung befindet und nur wenige Deepfakes als potenziellen Anwendungsfall für Quantencomputer betrachten, könnten diese Maschinen der nächsten Stufe in Zukunft verwendet werden, um unsere Medien wahrheitsgemäßer und genauer zu machen.

Da die Bedrohungen durch die Deepfake-Technologie immer offensichtlicher werden, versuchen viele Regierungen und Unternehmen bereits, Wege zu finden, um sie zu bekämpfen. Im Jahr 2021 startete Facebook die Deepfake Detection Challenge, mit einem Preisgeld von 500,000 US-Dollar für diejenigen, die neue Technologien zur Erkennung von Deepfakes entwickeln. In den USA haben Staaten wie Kalifornien, Texas und Virginia Gesetze, die die Verwendung von Deepfakes sowohl für Pornografie als auch für Politik verbieten. Das Europäisches Parlament Außerdem wurden weitere Vorschriften für Deepfakes eingeführt, indem der Digital Services Act geändert wurde, um die Verwendung von Labels für Deepfake-Videos vorzuschreiben. Obwohl diese Gesetzgebung nicht vor 2024 in Kraft treten wird, zeigt sie doch die Ernsthaftigkeit der Bedrohung durch Deepfake-Technologie.

Kenna Hughes-Castleberry ist Mitarbeiterin bei Inside Quantum Technology und Science Communicator bei JILA (eine Partnerschaft zwischen der University of Colorado Boulder und NIST). Ihre Beats beim Schreiben umfassen Deep Tech, Metaverse und Quantentechnologie.