Letzten Monat feierte das Networking and Information Technology Research and Development (NITRD)-Programm in Washington DC seinen 30. Jahrestag. Sie können die vollständige Zusammenfassung der Veranstaltung lesen hier. Um die Auswirkungen der Bundesinvestitionen auf die Computerforschungsgemeinschaft hervorzuheben, umfasste die Veranstaltung fünf Panels, in denen die Teilnehmer die wichtigsten Errungenschaften auf diesem Gebiet in den letzten zehn Jahren und zukünftige Richtungen diskutierten. Jedes Panel konzentrierte sich auf einen wichtigen Teilbereich der Computerforschung: Computing at Scale, Networking and Security, Artificial Intelligence/Machine Learning, Privacy and the Internet of Things und Socially Responsible Computing.

Der Datenschutz ist zu einem großen Gesprächsthema geworden, nicht nur in der Computerforschungsgemeinschaft, sondern in allen Disziplinen sowohl in der Wissenschaft als auch in der Industrie. Die negativen Auswirkungen auf die Privatsphäre, die sich aus der Verfügbarkeit großer Datensätze ergeben, werden mit dem multipliziert vernetzte Sensoren, Geräte und Aktoren die das Internet der Dinge (IoT) ausmachen. Moderiert von Charles („Chuck“) Romine (NIST) und mit den Feldexperten Ed Felten (Princeton), Marc Groman (Groman Consulting), Katerina Megas (NIST) und Sunoo Park (Cornell), Panel 4: Datenschutz und IoT diskutiert wichtige Themen wie die Kompromisse zwischen Datennutzung und Datenschutz und potenzielle Forschungsziele, um effektive politische Lösungen zu erreichen.

Romine hob zunächst einen roten Faden in allen Panels hervor: „Sie sprach sowohl über die Vorteile als auch über die außergewöhnlichen Fähigkeiten, die durch Investitionen der Bundesförderung bereitgestellt werden, zusammen mit den damit verbundenen Risiken.“ IoT ist da nicht anders, es verschafft den Menschen Zugang zu unüberwindbaren Informationen, ermöglicht erfolgreiche Werbekampagnen und schneidet die Technologie nach Ihrem persönlichen Geschmack, aber es gefährdet auch die Privatsphäre der Benutzer.

Wie Megas betonte: „Der einzige Grund, warum wir diese Bemühungen unternehmen, ist, dass wir in der Lage sein wollen, dass das IoT tatsächlich anerkannt wird und die Gesellschaft die Vorteile nutzen kann.“ Sie fuhr fort, die potenziellen Vorteile und die Bedeutung der Möglichkeit zu teilen, Daten über das Internet der Dinge hinweg auszutauschen. Es gibt eine „phänomenale“ Skala von Geräten im IoT, die verwendet werden können, um Probleme über Datensätze hinweg zu identifizieren, Dinge zu lernen, die ein hohes Wirkungspotenzial für Einzelpersonen und die Gesellschaft haben, Technologien der künstlichen Intelligenz zu trainieren und es kleinen innovativen Unternehmen zu ermöglichen, ihre Geräte zu testen. Romine fragte die Diskussionsteilnehmer, welche Datenschutzrisiken in diesem Zusammenhang mit IoT und Informationsaustausch tatsächlich bestehen.

Groman antwortete, indem er zunächst das Zusammenspiel zwischen Datenschutz und IoT erklärte. Die Datenschutzseite des IoT ist eine Teilmenge von Daten innerhalb der größeren Menge, die gesammelt wird, die sich auf Personen bezieht oder sich auf diese bezieht. Wissen die Menschen, dass Daten über sie gesammelt werden? Gibt es eine Schnittstelle, über die Sie mit dem Gerät interagieren, erfahren, was es sammelt, oder es ändern können? Verstehen die Leute, welche Informationen gesammelt werden oder welche Schlussfolgerungen das Gerät oder Unternehmen aus den gesammelten Daten zieht? Aufgrund der monetären Anreizstruktur und der „riesigen“ Menge, die Unternehmen aus der Nutzung solcher Daten ziehen können, forderte Groman die Menschen auf, sich an die Politik zu wenden, um eine Lösung zu finden.

„Hier geht es darum, den Nutzen zu maximieren und den Schaden zu minimieren. Wir haben in diesem Land keinen politischen, rechtlichen oder regulatorischen Rahmen, der Anreize schafft, dorthin zu gelangen“ – Marc Groman

Romine entgegnete Gromans Haltung und fragte das Podium nach dem Potenzial für eine technologische Lösung.

Felten schlug vor, zunächst zu versuchen, die Kontrolle statistischer Informationen besser zu verstehen und anzuwenden und Tools zu entwickeln, die es Menschen ermöglichen, mit ihren Daten zu interagieren und negative Auswirkungen zu mindern. Park, der ein besonderes Interesse an kryptografischen Datenschutz-Tools hat, nannte eine Reihe von Möglichkeiten, wie Kryptographie in dieser Hinsicht helfen könnte.

„Kryptografie bietet ein Toolkit zum Erstellen von Systemen mit Konfigurationen von Informationsflüssen und einer feinkörnigeren Kontrolle über den Zugriff.“ – Sunoo-Park

Eines der Werkzeuge könnten Zero-Knowledge-Proofs sein, die den teilweisen Austausch von Daten ermöglichen, während andere Aspekte vor Entitäten geheim gehalten werden. Sie nannte das Beispiel eines Türstehers, der Ausweise überprüft, um in eine Bar zu gelangen – durch Zero-Knowledge-Beweise könnte man beweisen, dass man 21 ist, ohne seine Adresse oder seinen Geburtstag, der ebenfalls auf dem Ausweis steht, zu teilen.

Park warnte davor, dass die Kryptografie zwar „einen größeren Lösungsraum bietet, den wir zum Aufbau von Privatsphäre nutzen können“, aber nicht die Frage beantwortet, welche Art von Dingen wir mit diesen Tools erstellen sollten oder welche Formen von Informationen wir für angemessen oder wünschenswert halten, um sie weiterzugeben. Das müssen wir als Gesellschaft und Politik erarbeiten.

Schließlich wurden die Diskussionsteilnehmer gefragt, warum die Menschen sich darum kümmern sollten. Was, wenn sie nichts zu verbergen haben? Felten erntete ein Gelächter der Menge und scherzte, dass jeder etwas zu verbergen habe. In einer ernsteren Anmerkung fuhr er fort, den potenziellen Schaden der Datenprofilerstellung hervorzuheben.

„Die Leute da draußen bauen ein umfassendes Modell darüber auf, wer Sie sind und was Sie wahrscheinlich tun werden.“ – Ed Felten

Diese Annahmen sind bereits ein erschreckender Gedanke, aber diese Annahmen können falsch sein und manchmal die Möglichkeiten und die „Handlungsfreiheit“ in der Zukunft einschränken. Groman wies auf einen weiteren roten Faden in den Diskussionen der Podiumsdiskussionen hin – die Bedeutung der Erkenntnis, dass einige Gemeinschaften unverhältnismäßig stark betroffen sind. Die Einsätze können höher sein, um einige Daten privat zu halten, sei es für sexuelle Orientierung, Geschlecht, Rasse oder missbrauchte Frauen oder Kinder.

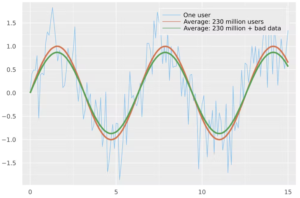

Während der Fragen und Antworten ging der ehemalige Sprecher von Panel 3, Ben Zorn, auf die Vorteile der Verwendung von Daten zum Trainieren von KI zurück. Er fragte, was getan werden könnte, wenn private Informationen durch die Datensätze, die zum Trainieren von KI verwendet werden, durchsickern.

Felten wies darauf hin, dass die Informationen fließen werden, es sei denn, Sie verwenden eine rigorose Methode, um das Heruntersickern von Informationen absichtlich zu stoppen. Aus diesem Grund ist es so wichtig, sich auf die Entwicklung rigoroser und beweisbarer Methoden für Dinge wie maschinelles Lernen unter Wahrung der Privatsphäre und Schnittstellen zur Kontrolle des Trickle-Down-Effekts zu konzentrieren.

Megas fasste es perfekt zusammen, dass wir letztendlich nicht alle schulen können, aber wir können den Menschen einen Rahmen bieten, der es ihnen ermöglicht, über Risiken nachzudenken, und ihnen Werkzeuge an die Hand geben, um ihnen eine bessere Kontrolle über ihre Daten zu geben. Sie können die vollständige Aufzeichnung auf der ansehen CCC-Webseite oder YouTube-Kanal des NITRD.

Halten Sie Ausschau nach dem letzten Blog der Reihe, Panel 5: How Technology Can Benefit Society: Broadening Perspectives in Fundamental Research.