Dies ist der zweite Beitrag einer vierteiligen Serie, in der beschrieben wird, wie NatWest-Gruppe, ein großes Finanzdienstleistungsinstitut, eine Partnerschaft mit Professionelle AWS-Services zum Aufbau einer neuen Plattform für maschinelles Lernen (MLOps). In diesem Beitrag teilen wir mit, wie die NatWest Group AWS nutzte, um die Self-Service-Bereitstellung ihrer standardisierten, sicheren und konformen MLOps-Plattform zu ermöglichen AWS-Servicekatalog und Amazon Sage Maker. Dadurch konnte der Zeitaufwand für die Bereitstellung neuer Umgebungen von Tagen auf wenige Stunden reduziert werden.

Wir glauben, dass Entscheidungsträger von diesen Inhalten profitieren können. CTOs, CDAOs, Senior Data Scientists und Senior Cloud Engineers können diesem Muster folgen, um innovative Lösungen für ihre Data Science- und Engineering-Teams bereitzustellen.

Lesen Sie die gesamte Serie:

|

Technologie bei der NatWest Group

Die NatWest Group ist eine Relationship Bank für eine digitale Welt, die mehr als 19 Millionen Kunden in ganz Großbritannien Finanzdienstleistungen anbietet. Die Gruppe verfügt über ein vielfältiges Technologieportfolio, in dem Lösungen für geschäftliche Herausforderungen oft mit maßgeschneiderten Designs und mit langen Zeitplänen geliefert werden.

Kürzlich hat die NatWest Group eine Cloud-First-Strategie eingeführt, die es dem Unternehmen ermöglicht, Managed Services zur Bereitstellung von Rechen- und Speicherressourcen auf Abruf zu nutzen. Dieser Schritt hat zu einer Verbesserung der allgemeinen Stabilität, Skalierbarkeit und Leistung von Geschäftslösungen geführt, während gleichzeitig die Kosten gesenkt und die Bereitstellungsfrequenz beschleunigt wurden. Darüber hinaus ermöglicht der Wechsel in die Cloud der NatWest Group, ihren Technologie-Stack zu vereinfachen, indem sie eine Reihe konsistenter, wiederholbarer und vorab genehmigter Lösungsdesigns durchsetzt, um behördliche Anforderungen zu erfüllen und auf kontrollierte Weise zu arbeiten.

Herausforderungen

Die Pilotphasen zur Einführung eines Cloud-First-Ansatzes umfassten mehrere Experimentier- und Evaluierungsphasen, in denen eine Vielzahl von Cloud-basierten Lösungen verwendet wurden Analysedienste auf AWS. Die ersten Iterationen der Cloud-Plattform der NatWest Group für Data-Science-Workloads standen vor Herausforderungen bei der Bereitstellung konsistenter, sicherer und konformer Cloud-Umgebungen. Der Prozess der Erstellung neuer Umgebungen dauerte einige Tage bis hin zu Wochen oder sogar Monaten. Die Abhängigkeit von zentralen Plattformteams zum Erstellen, Bereitstellen, Sichern, Bereitstellen und Verwalten von Infrastruktur und Datenquellen erschwerte das Onboarding neuer Teams für die Arbeit in der Cloud.

Aufgrund der Unterschiede in der Infrastrukturkonfiguration der AWS-Konten mussten Teams, die sich entschieden, ihre Workloads in die Cloud zu migrieren, einen aufwändigen Compliance-Prozess durchlaufen. Jede Infrastrukturkomponente musste separat analysiert werden, was die Zeitvorgaben für Sicherheitsüberprüfungen verlängerte.

Der Einstieg in die Entwicklung in AWS umfasste das Lesen einer Reihe von Dokumentationshandbüchern, die von Plattformteams verfasst wurden. Zu den anfänglichen Einrichtungsschritten der Umgebung gehörten die Verwaltung öffentlicher und privater Schlüssel für die Authentifizierung, die Konfiguration von Verbindungen zu Remotediensten mithilfe von AWS-Befehlszeilenschnittstelle (AWS CLI) oder SDK aus lokalen Entwicklungsumgebungen und Ausführen benutzerdefinierter Skripts zum Verknüpfen lokaler IDEs mit Cloud-Diensten. Technische Herausforderungen erschwerten oft das Onboarding neuer Teammitglieder. Nachdem die Entwicklungsumgebungen konfiguriert waren, war der Weg zur Freigabe der Software in der Produktion ähnlich komplex und langwierig.

Wie in Teil 1 dieser Serie beschrieben, sammelte das gemeinsame Projektteam vor dem Aufbau der neuen Data Science- und MLOps-Plattform große Mengen an Feedback zu Benutzererfahrung und Anforderungen von Teams der gesamten NatWest Group. Ein gemeinsames Thema in diesem Feedback war die Notwendigkeit von Automatisierung und Standardisierung als Vorläufer für eine schnelle und effiziente Projektabwicklung auf AWS. Die neue Plattform nutzt AWS Managed Services, um die Kosten zu optimieren, den Aufwand für die Plattformkonfiguration zu reduzieren und den COXNUMX-Fußabdruck durch die Ausführung unnötig großer Rechenaufträge zu reduzieren. Die Standardisierung ist in das Herz der Plattform eingebettet, mit vorab genehmigten, vollständig konfigurierten, sicheren, konformen und wiederverwendbaren Infrastrukturkomponenten, die von Daten- und Analyseteams gemeinsam genutzt werden können.

Warum SageMaker-Studio?

Das Team hat gewählt Amazon SageMaker-Studio als Haupttool zum Erstellen und Bereitstellen von ML-Pipelines. Studio bietet eine einzige webbasierte Schnittstelle, die Benutzern vollständigen Zugriff, Kontrolle und Einblick in jeden Schritt bietet, der zum Erstellen, Trainieren und Bereitstellen von Modellen erforderlich ist. Die Reife der Studio-IDE (integrierte Entwicklungsumgebung) für die Modellentwicklung, Metadatenverfolgung, Artefaktverwaltung und Bereitstellung gehörte zu den Funktionen, die das Team der NatWest Group stark ansprachen.

Data Scientists der NatWest Group arbeiten in den Anfangsphasen der Modellentwicklung mit SageMaker-Notebooks in Studio, um Datenanalysen, Data Wrangling und Feature Engineering durchzuführen. Nachdem die Benutzer mit den Ergebnissen dieser anfänglichen Arbeit zufrieden sind, lässt sich der Code einfach in zusammensetzbare Funktionen für Datentransformation, Modelltraining, Inferenz, Protokollierung und Komponententests konvertieren, sodass er in einem produktionsbereiten Zustand ist.

Spätere Phasen des Lebenszyklus der Modellentwicklung beinhalten die Verwendung von Amazon SageMaker-Pipelines, die in Studio visuell inspiziert und überwacht werden können. Pipelines werden in einem DAG (Directed Acyclic Graph) visualisiert, das Schritte basierend auf ihrem Status während der Ausführung der Pipeline farbcodiert. Außerdem eine Zusammenfassung von Amazon CloudWatch-Protokolle wird neben dem DAG angezeigt, um das Debuggen fehlgeschlagener Schritte zu erleichtern. Data Scientists erhalten eine Codevorlage, die alle grundlegenden Schritte in einer SageMaker-Pipeline enthält. Dies bietet ein standardisiertes Framework (konsistent für alle Benutzer der Plattform, um die Zusammenarbeit und den Wissensaustausch zu erleichtern), in das Entwickler die maßgeschneiderte Logik und den Anwendungscode einfügen können, die speziell auf die geschäftliche Herausforderung zugeschnitten sind, die sie lösen.

Entwickler führen die Pipelines in der Studio-IDE aus, um sicherzustellen, dass ihre Codeänderungen korrekt in andere Pipelineschritte integriert werden. Nachdem die Codeänderungen überprüft und genehmigt wurden, werden diese Pipelines basierend auf einem Git-Hauptrepository-Branch-Trigger automatisch erstellt und ausgeführt. Während des Modelltrainings werden Modellbewertungsmetriken in SageMaker-Experimenten gespeichert und nachverfolgt, die für die Hyperparameter-Abstimmung verwendet werden können. Nachdem ein Modell trainiert wurde, wird das Modellartefakt in gespeichert SageMaker-Modellregistrierung, zusammen mit Metadaten zu Modellcontainern, Daten, die während des Trainings verwendet werden, Modellfunktionen und Modellcode. Die Modellregistrierung spielt eine Schlüsselrolle im Modellbereitstellungsprozess, da sie alle Modellinformationen verpackt und die Automatisierung der Modellpromotion in Produktionsumgebungen ermöglicht.

MLOps-Ingenieure stellen verwaltete bereit SageMaker-Stapeltransformationsaufträge, die entsprechend den Arbeitslastanforderungen skaliert werden können. Sowohl Offline-Batch-Inferenzjobs als auch Online-Modelle, die über einen Endpunkt bereitgestellt werden, verwenden die verwaltete Inferenzfunktion von SageMaker. Davon profitieren sowohl Plattform- als auch Geschäftsanwendungsteams, da Plattformingenieure keine Zeit mehr mit der Konfiguration von Infrastrukturkomponenten für Modellrückschlüsse verbringen und Geschäftsanwendungsteams keinen zusätzlichen Boilerplate-Code schreiben müssen, um Recheninstanzen einzurichten und mit ihnen zu interagieren.

Warum AWS-Servicekatalog?

Das Team entschied sich für AWS Service Catalog, um einen Katalog mit sicheren, konformen und vorab genehmigten Infrastrukturvorlagen zu erstellen. Die Infrastrukturkomponenten in einem AWS Service Catalog-Produkt sind vorkonfiguriert, um die Sicherheitsanforderungen der NatWest Group zu erfüllen. Rollenzugriffsverwaltung, Ressourcenrichtlinien, Netzwerkkonfiguration und zentrale Steuerungsrichtlinien werden für jede Ressource konfiguriert, die in einem AWS Service Catalog-Produkt verpackt ist. Die Produkte werden versioniert und mit Anwendungsteams geteilt, indem ein Standardprozess befolgt wird, der es Data-Science- und Engineering-Teams ermöglicht, die Infrastruktur unmittelbar nach Erhalt des Zugriffs auf ihre AWS-Konten selbst zu bedienen und bereitzustellen.

Plattformentwicklungsteams können AWS Service Catalog-Produkte im Laufe der Zeit problemlos weiterentwickeln, um die Implementierung neuer Funktionen basierend auf Geschäftsanforderungen zu ermöglichen. Iterative Änderungen an Produkten werden mithilfe der Produktversionierung von AWS Service Catalog vorgenommen. Wenn eine neue Produktversion veröffentlicht wird, führt das Plattformteam Codeänderungen mit dem Git-Hauptzweig zusammen und erhöht die Version des AWS Service Catalog-Produkts. Bei der Aktualisierung der Infrastruktur besteht ein gewisses Maß an Autonomie und Flexibilität, da Geschäftsanwendungskonten frühere Produktversionen verwenden können, bevor sie auf die neueste Version migrieren.

Lösungsüberblick

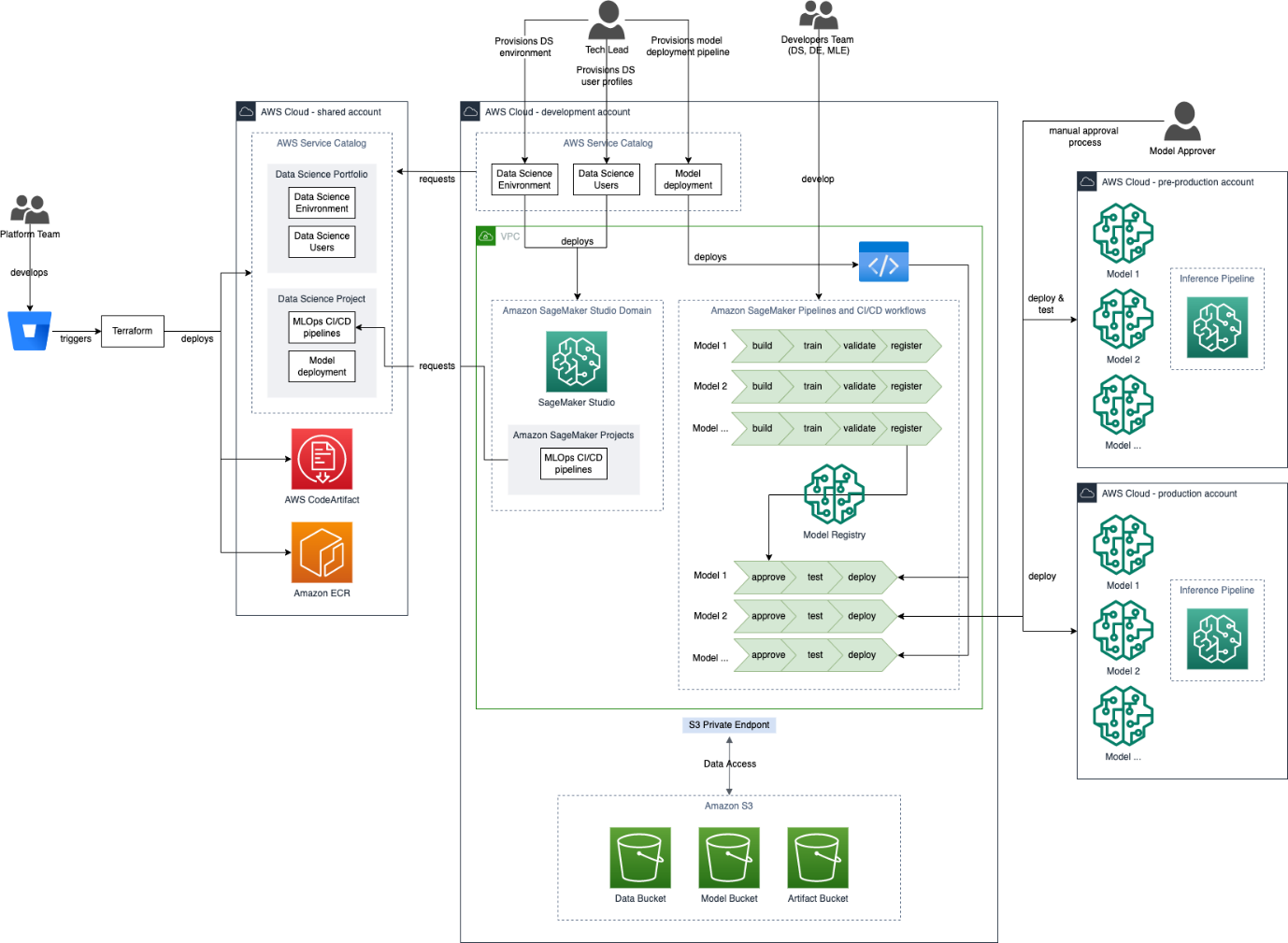

Das folgende allgemeine Architekturdiagramm zeigt, wie ein typischer Anwendungsfall einer Geschäftsanwendung auf AWS bereitgestellt wird. Die folgenden Abschnitte gehen detaillierter auf die Kontoarchitektur, die Bereitstellung der Infrastruktur, die Benutzerzugriffsverwaltung und die Verwendung verschiedener AWS-Services zum Erstellen von ML-Lösungen ein.

Wie im Architekturdiagramm gezeigt, folgen Konten einem Hub-and-Spoke-Modell. Ein gemeinsam genutztes Plattformkonto dient als Hub-Konto, in dem Ressourcen, die von Geschäftsanwendungsteam-Konten (Spoke-Konten) benötigt werden, vom Plattformteam gehostet werden. Diese Ressourcen umfassen Folgendes:

- Eine Bibliothek sicherer, standardisierter Infrastrukturprodukte, die für Self-Service-Infrastrukturbereitstellungen verwendet werden und von AWS Service Catalog gehostet werden

- Docker-Images, gespeichert in Amazon Elastic Container-Registrierung (Amazon ECR), die während der Ausführung von SageMaker-Pipelineschritten und Modellrückschlüssen verwendet werden

- AWS CodeArtifact Repositorys, die vorab genehmigte Python-Pakete hosten

Diese Ressourcen werden über die Portfoliofreigabe- und -importfunktion von AWS Service Catalog automatisch mit Spoke-Konten geteilt und AWS Identity and Access Management and (IAM)-Vertrauensrichtlinien sowohl für Amazon ECR als auch für CodeArtifact.

Jedem Geschäftsanwendungsteam werden drei AWS-Konten in der Infrastrukturumgebung der NatWest Group bereitgestellt: Entwicklung, Vorproduktion und Produktion. Die Umgebungsnamen beziehen sich auf die beabsichtigte Rolle des Kontos im Data Science-Entwicklungslebenszyklus. Das Entwicklungskonto wird verwendet, um Datenanalysen und Wrangling durchzuführen, Modell- und Modellpipelinecode zu schreiben, Modelle zu trainieren und Modellbereitstellungen in Vorproduktions- und Produktionsumgebungen über SageMaker Studio auszulösen. Das Vorproduktionskonto spiegelt die Einrichtung des Produktionskontos wider und wird zum Testen von Modellbereitstellungen und Stapeltransformationsaufträgen verwendet, bevor sie für die Produktion freigegeben werden. Das Produktionskonto hostet Modelle und führt Produktionsrückschlussworkloads aus.

Benutzerverwaltung

Die NatWest Group verfügt über strenge Governance-Prozesse, um die Trennung der Benutzerrollen durchzusetzen. Für jede Benutzerpersona wurden fünf separate IAM-Rollen erstellt.

Das Plattformteam verwendet die folgenden Rollen:

- Plattform-Support-Ingenieur – Diese Rolle enthält Berechtigungen für Business-as-usual-Aufgaben und eine schreibgeschützte Ansicht des Rests der Umgebung zum Überwachen und Debuggen der Plattform.

- Plattform-Fix-Ingenieur – Diese Rolle wurde mit erhöhten Berechtigungen erstellt. Es wird verwendet, wenn es Probleme mit der Plattform gibt, die ein manuelles Eingreifen erfordern. Diese Rolle wird nur genehmigt und zeitlich begrenzt übernommen.

Die Entwicklungsteams für Geschäftsanwendungen haben drei verschiedene Rollen:

- Technischer Vorsprung – Diese Rolle wird dem Leiter des Anwendungsteams zugewiesen, häufig einem Senior Data Scientist. Dieser Benutzer hat die Berechtigung, AWS Service Catalog-Produkte bereitzustellen und zu verwalten, Releases in der Produktion auszulösen und den Status der Umgebung zu überprüfen, wie z AWS CodePipeline Status und Protokolle. Diese Rolle ist nicht berechtigt, ein Modell in der SageMaker-Modellregistrierung zu genehmigen.

- Entwickler:in / Unternehmen – Diese Rolle wird allen Teammitgliedern zugewiesen, die mit SageMaker Studio arbeiten, darunter Ingenieure, Datenwissenschaftler und häufig der Teamleiter. Diese Rolle verfügt über Berechtigungen zum Öffnen von Studio, zum Schreiben von Code sowie zum Ausführen und Bereitstellen von SageMaker-Pipelines. Wie der technische Leiter hat diese Rolle keine Berechtigung, ein Modell in der Modellregistrierung zu genehmigen.

- Modellgenehmiger – Diese Rolle hat eingeschränkte Berechtigungen zum Anzeigen, Genehmigen und Ablehnen von Modellen in der Modellregistrierung. Der Grund für diese Trennung besteht darin, zu verhindern, dass Benutzer, die Modelle erstellen und trainieren können, ihre eigenen Modelle genehmigen und in eskalierten Umgebungen freigeben.

Für Entwickler und Modellgenehmiger werden separate Studio-Benutzerprofile erstellt. Die Lösung verwendet eine Kombination aus IAM-Richtlinienanweisungen und SageMaker-Benutzerprofil-Tags, sodass Benutzer nur ein Benutzerprofil öffnen dürfen, das ihrem Benutzertyp entspricht. Dadurch wird sichergestellt, dass dem Benutzer die richtige SageMaker-Ausführungs-IAM-Rolle (und damit Berechtigungen) zugewiesen wird, wenn er die Studio-IDE öffnet.

Self-Service-Bereitstellungen mit AWS Service Catalog

Endbenutzer verwenden AWS Service Catalog, um Data-Science-Infrastrukturprodukte wie die folgenden bereitzustellen:

- Eine Studioumgebung

- Studio-Benutzerprofile

- Modellbereitstellungspipelines

- Trainingspipelines

- Inferenzpipelines

- Ein System zur Überwachung und Alarmierung

Endbenutzer stellen diese Produkte direkt über die AWS Service Catalog-Benutzeroberfläche bereit, was bedeutet, dass sie sich weniger auf zentrale Plattformteams verlassen müssen, um Umgebungen bereitzustellen. Dies hat die Zeit, die Benutzer benötigen, um Zugriff auf neue Cloud-Umgebungen zu erhalten, von mehreren Tagen auf nur wenige Stunden erheblich verkürzt, was letztendlich zu einer erheblichen Verbesserung der Time-to-Value geführt hat. Die Verwendung eines gemeinsamen Satzes von AWS Service Catalog-Produkten unterstützt die Konsistenz innerhalb von Projekten im gesamten Unternehmen und senkt die Barriere für Zusammenarbeit und Wiederverwendung.

Da die gesamte Data-Science-Infrastruktur jetzt über einen zentral entwickelten Katalog von Infrastrukturprodukten bereitgestellt wird, wurde darauf geachtet, jedes dieser Produkte unter Berücksichtigung der Sicherheit zu erstellen. Dienste wurden so konfiguriert, dass sie innerhalb kommunizieren Amazon Virtual Private Cloud (Amazon VPC), sodass der Datenverkehr nicht das öffentliche Internet durchquert. Daten werden während der Übertragung und im Ruhezustand verschlüsselt AWS-Schlüsselverwaltungsservice (AWS KMS)-Schlüssel. IAM-Rollen wurden auch so eingerichtet, dass sie dem Prinzip der geringsten Rechte folgen.

Schließlich ist es mit AWS Service Catalog für das Plattformteam einfach, kontinuierlich neue Produkte und Services zu veröffentlichen, sobald sie verfügbar sind oder von Geschäftsanwendungsteams benötigt werden. Diese können die Form neuer Infrastrukturprodukte annehmen, die Endbenutzern beispielsweise die Möglichkeit geben, ihre eigenen bereitzustellen Amazon EMR Cluster oder Updates bestehender Infrastrukturprodukte. Weil AWS Service Catalog die Produktversionierung unterstützt und nutzt AWS CloudFormation Hinter den Kulissen können In-Place-Upgrades verwendet werden, wenn neue Versionen bestehender Produkte veröffentlicht werden. Dadurch können sich die Plattformteams auf die Entwicklung und Verbesserung von Produkten konzentrieren, anstatt komplexe Upgrade-Prozesse zu entwickeln.

Integration mit der bestehenden IaC-Software von NatWest

AWS Service Catalog wird für Self-Service-Data-Science-Infrastrukturbereitstellungen verwendet. Darüber hinaus wird Terraform, das Standard-Infrastructure-as-Code-Tool (IaC) von NatWest, zum Aufbau der Infrastruktur in den AWS-Konten verwendet. Terraform wird von Plattformteams während des anfänglichen Kontoeinrichtungsprozesses verwendet, um erforderliche Infrastrukturressourcen wie VPCs, Sicherheitsgruppen, AWS-Systemmanager Parameter, KMS-Schlüssel und standardmäßige Sicherheitskontrollen. Die Infrastruktur im Hub-Konto, wie z. B. die AWS Service Catalog-Portfolios und die zum Erstellen von Docker-Images verwendeten Ressourcen, werden ebenfalls mit Terraform definiert. Die AWS Service Catalog-Produkte selbst werden jedoch mit standardmäßigen CloudFormation-Vorlagen erstellt.

Verbesserung der Entwicklerproduktivität und Codequalität mit SageMaker-Projekten

SageMaker-Projekte Bieten Sie Entwicklern und Datenwissenschaftlern Zugriff auf Schnellstartprojekte, ohne SageMaker Studio verlassen zu müssen. Mit diesen Schnellstartprojekten können Sie mit nur wenigen Klicks mehrere Infrastrukturressourcen gleichzeitig bereitstellen. Dazu gehören ein Git-Repository, das eine standardisierte Projektvorlage für den ausgewählten Modelltyp enthält, Amazon Simple Storage-Service (Amazon S3) Buckets zum Speichern von Daten, serialisierten Modellen und Artefakten sowie Modelltraining und Inferenz-CodePipeline-Pipelines.

Die Einführung standardisierter Code-Basisarchitekturen und -Tools macht es Data Scientists und Ingenieuren jetzt leicht, zwischen Projekten zu wechseln und sicherzustellen, dass die Codequalität hoch bleibt. Beispielsweise werden Best Practices der Softwareentwicklung wie Linting- und Formatierungsprüfungen (die sowohl als automatisierte Prüfungen als auch als Pre-Commit-Hooks ausgeführt werden), Einheitentests und Abdeckungsberichte als Teil von Schulungspipelines automatisiert und bieten eine Standardisierung über alle Projekte hinweg. Dies hat die Wartbarkeit von ML-Projekten verbessert und wird es einfacher machen, diese Projekte in die Produktion zu überführen.

Modellbereitstellungen automatisieren

Der Modelltrainingsprozess wird mithilfe von SageMaker-Pipelines orchestriert. Nachdem Modelle trainiert wurden, werden sie in der SageMaker-Modellregistrierung gespeichert. Benutzer, denen die Rolle „Modellgenehmiger“ zugewiesen wurde, können die Modellregistrierung öffnen und Informationen zum Trainingsprozess finden, z. B. wann das Modell trainiert wurde, Hyperparameterwerte und Bewertungsmetriken. Diese Informationen helfen dem Benutzer bei der Entscheidung, ob er ein Modell genehmigen oder ablehnen möchte. Das Ablehnen eines Modells verhindert, dass das Modell in einer eskalierten Umgebung bereitgestellt wird, während das Genehmigen eines Modells eine Modellförderungspipeline über CodePipeline auslöst, die das Modell automatisch in das Präproduktions-AWS-Konto kopiert, das für Inferenz-Workload-Tests bereit ist. Nachdem das Team bestätigt hat, dass das Modell in der Vorproduktion ordnungsgemäß funktioniert, wird ein manueller Schritt in derselben Pipeline genehmigt und das Modell wird automatisch in das Produktionskonto kopiert, wo es für Arbeitslasten in der Produktion bereit ist.

Outcomes

Eines der Hauptziele dieses Kooperationsprojekts zwischen NatWest und AWS war es, die Zeit zu verkürzen, die für die Bereitstellung und Bereitstellung von Data-Science-Cloud-Umgebungen und ML-Modellen in der Produktion benötigt wird. Dies wurde erreicht – NatWest kann nun innerhalb weniger Stunden neue, skalierbare und sichere AWS-Umgebungen bereitstellen, im Vergleich zu Tagen oder sogar Wochen. Datenwissenschaftler und -ingenieure sind jetzt in der Lage, die Datenwissenschaftsinfrastruktur mithilfe von AWS Service Catalog selbst bereitzustellen und zu verwalten, wodurch die Abhängigkeit von zentralisierten Plattformteams verringert wird. Darüber hinaus ermöglicht die Verwendung von SageMaker-Projekten den Benutzern, innerhalb von Minuten mit dem Codieren und Trainieren von Modellen zu beginnen, während gleichzeitig standardisierte Projektstrukturen und -werkzeuge bereitgestellt werden.

Da AWS Service Catalog als zentrale Methode zur Bereitstellung von Data-Science-Infrastruktur dient, kann die Plattform in Zukunft problemlos erweitert und aktualisiert werden. Neue AWS-Services können Endbenutzern bei Bedarf schnell angeboten werden, und vorhandene AWS Service Catalog-Produkte können vor Ort aktualisiert werden, um neue Funktionen zu nutzen.

Schließlich bedeutet die Umstellung auf Managed Services auf AWS, dass Rechenressourcen nach Bedarf bereitgestellt und heruntergefahren werden. Dies hat zu Kosteneinsparungen und Flexibilität bei gleichzeitiger Anpassung an das Unternehmen geführt Das Ziel von NatWest, bis 2050 Netto-Null zu sein aufgrund einer geschätzten CO-Reduktion von 75 %2 Emissionen.

Zusammenfassung

Die Einführung einer Cloud-First-Strategie bei der NatWest Group führte zur Schaffung einer robusten AWS-Lösung, die eine große Anzahl von Geschäftsanwendungsteams im gesamten Unternehmen unterstützen kann. Die Verwaltung der Infrastruktur mit AWS Service Catalog hat den Cloud-Onboarding-Prozess erheblich verbessert, indem sichere, konforme und vorab genehmigte Infrastrukturbausteine verwendet werden, die einfach erweitert werden können. Verwaltete SageMaker-Infrastrukturkomponenten haben den Modellentwicklungsprozess verbessert und die Bereitstellung von ML-Projekten beschleunigt.

Um mehr über den Prozess der Erstellung produktionsreifer ML-Modelle bei der NatWest Group zu erfahren, werfen Sie einen Blick auf den Rest dieser vierteiligen Serie über die strategische Zusammenarbeit zwischen der NatWest Group und AWS Professional Services:

- Teil 1 erklärt, wie die NatWest Group mit AWS Professional Services zusammengearbeitet hat, um eine skalierbare, sichere und nachhaltige MLOps-Plattform aufzubauen

- Teil 3 bietet einen Überblick darüber, wie die NatWest Group SageMaker-Dienste nutzt, um überprüfbare, reproduzierbare und erklärbare ML-Modelle zu erstellen

- Teil 4 beschreibt, wie die Data-Science-Teams von NatWest ihre bestehenden Modelle auf SageMaker-Architekturen migrieren

Über die Autoren

Junaid Baba ist DevOps Consultant bei Professionelle AWS-Services Er nutzt seine Erfahrung in den Bereichen Kubernetes, Distributed Computing und AI/MLOps, um die Einführung der Cloud bei Kunden aus der britischen Finanzdienstleistungsbranche zu beschleunigen. Junaid ist seit Juni 2018 bei AWS. Davor arbeitete Junaid mit einer Reihe von Finanz-Start-ups zusammen, die DevOps-Praktiken vorantreiben. Außerhalb der Arbeit interessiert er sich für Trekking, moderne Kunst und Standfotografie.

Junaid Baba ist DevOps Consultant bei Professionelle AWS-Services Er nutzt seine Erfahrung in den Bereichen Kubernetes, Distributed Computing und AI/MLOps, um die Einführung der Cloud bei Kunden aus der britischen Finanzdienstleistungsbranche zu beschleunigen. Junaid ist seit Juni 2018 bei AWS. Davor arbeitete Junaid mit einer Reihe von Finanz-Start-ups zusammen, die DevOps-Praktiken vorantreiben. Außerhalb der Arbeit interessiert er sich für Trekking, moderne Kunst und Standfotografie.

Jordanka Ivanova ist Dateningenieur bei der NatWest Group. Sie hat Erfahrung im Aufbau und der Bereitstellung von Datenlösungen für Unternehmen in der Finanzdienstleistungsbranche. Bevor sie zu NatWest kam, arbeitete Yordanka als technische Beraterin, wo sie Erfahrung in der Nutzung einer Vielzahl von Cloud-Diensten und Open-Source-Technologien sammelte, um Geschäftsergebnisse über mehrere Cloud-Plattformen hinweg zu erzielen. In ihrer Freizeit trainiert Yordanka gerne, reist und spielt Gitarre.

Jordanka Ivanova ist Dateningenieur bei der NatWest Group. Sie hat Erfahrung im Aufbau und der Bereitstellung von Datenlösungen für Unternehmen in der Finanzdienstleistungsbranche. Bevor sie zu NatWest kam, arbeitete Yordanka als technische Beraterin, wo sie Erfahrung in der Nutzung einer Vielzahl von Cloud-Diensten und Open-Source-Technologien sammelte, um Geschäftsergebnisse über mehrere Cloud-Plattformen hinweg zu erzielen. In ihrer Freizeit trainiert Yordanka gerne, reist und spielt Gitarre.

Michael England ist Software Engineer im Data Science and Innovation Team der NatWest Group. Er entwickelt leidenschaftlich Lösungen für die Ausführung umfangreicher Machine-Learning-Workloads in der Cloud. Bevor er zur NatWest Group kam, arbeitete Michael in und leitete Software-Engineering-Teams, die kritische Anwendungen in der Finanzdienstleistungs- und Reisebranche entwickelten. In seiner Freizeit spielt er gerne Gitarre, reist und erkundet mit dem Fahrrad die Landschaft.

Michael England ist Software Engineer im Data Science and Innovation Team der NatWest Group. Er entwickelt leidenschaftlich Lösungen für die Ausführung umfangreicher Machine-Learning-Workloads in der Cloud. Bevor er zur NatWest Group kam, arbeitete Michael in und leitete Software-Engineering-Teams, die kritische Anwendungen in der Finanzdienstleistungs- und Reisebranche entwickelten. In seiner Freizeit spielt er gerne Gitarre, reist und erkundet mit dem Fahrrad die Landschaft.

- Coinsmart. Europas beste Bitcoin- und Krypto-Börse.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. DEN FREIEN ZUGANG.

- CryptoHawk. Altcoin-Radar. Kostenlose Testphase.

- Quelle: https://aws.amazon.com/blogs/machine-learning/part-2-how-natwest-group-built-a-secure-compliant-self-service-mlops-platform-using-aws-service- katalog-und-amazon-sagemaker/

- "

- 100

- Über uns

- beschleunigt

- beschleunigend

- Zugang

- Konto

- über

- Zusatz

- Zusätzliche

- Adoption

- Vorteil

- Alle

- Amazon

- unter

- Betrag

- Beträge

- Analyse

- Analytik

- Anwendung

- Anwendungen

- Ansatz

- genehmigen

- Architektur

- Kunst

- zugewiesen

- Prüfung

- Authentifizierung

- Automatisiert

- Automation

- Automatisierung und Standardisierung

- verfügbar

- AWS

- Bank

- werden

- hinter den Kulissen

- Sein

- Nutzen

- Vorteile

- BESTE

- Best Practices

- bauen

- Building

- Geschäft

- Kohlenstoff

- österreichische Unternehmen

- zentralisierte

- challenges

- Herausforderungen

- Schecks

- Cloud

- Cloud-Plattform

- Cloud-Services

- Code

- Programmierung

- Zusammenarbeit

- Kombination

- gemeinsam

- Unternehmen

- Unternehmen

- verglichen

- Komplex

- Compliance

- konform

- Komponente

- Berechnen

- Computing

- Konfiguration

- Verbindungen

- Berater

- Container

- Behälter

- enthält

- Inhalt

- ständig

- Smartgeräte App

- erstellt

- Erstellen

- Schaffung

- kritischem

- Original

- Kunden

- technische Daten

- Datenanalyse

- Datenwissenschaft

- Datenwissenschaftler

- geliefert

- liefern

- Lieferanten

- Demand

- Anforderungen

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- Implementierungen

- beschrieben

- Designs

- Detail

- Details

- entwickelt

- Entwickler:in / Unternehmen

- Entwickler

- Entwicklung

- Entwicklung

- anders

- schwer

- digital

- Direkt

- verteilt

- Verteiltes rechnen

- Docker

- Tut nicht

- nach unten

- Fahren

- leicht

- effizient

- Bemühungen

- Erarbeiten

- ermöglichen

- Endpunkt

- Ingenieur

- Entwicklung

- Ingenieure

- Unternehmen

- Arbeitsumfeld

- geschätzt

- Auswertung

- entwickelt sich

- Beispiel

- Ausführung

- vorhandenen

- ERFAHRUNGEN

- Merkmal

- Eigenschaften

- Feedback

- Revolution

- Finanzdienstleistungen

- Vorname

- Fixieren

- Flexibilität

- Setzen Sie mit Achtsamkeit

- folgen

- Folgende

- Fußabdruck

- unten stehende Formular

- Unser Ansatz

- Funktionalität

- Zukunft

- Git

- Governance

- Gruppe an

- Gruppen

- Anleitungen

- glücklich

- Hilfe

- hilft

- High

- Ultraschall

- HTTPS

- Identitätsschutz

- Implementierung

- verbessert

- das

- inklusive

- Dazu gehören

- hat

- Branchen

- Energiegewinnung

- Information

- Infrastruktur

- Innovation

- innovativ

- Institution

- integrieren

- integriert

- Interessen

- Schnittstelle

- Internet

- beteiligt

- Probleme

- IT

- Jobs

- Wesentliche

- Tasten

- Wissen

- grosse

- neueste

- führen

- LERNEN

- lernen

- geführt

- Hebelwirkungen

- Nutzung

- Bibliothek

- Limitiert

- Line

- Linking

- aus einer regionalen

- Maschine

- Maschinelles Lernen

- gemacht

- Dur

- MACHT

- verwalten

- verwaltet

- Management

- flächendeckende Gesundheitsprogramme

- Weise

- manuell

- Materie

- Reife

- Bedeutung

- Mitglieder

- Metrik

- Million

- Geist / Bewusstsein

- ML

- Modell

- für

- Überwachung

- Monat

- mehr

- schlauer bewegen

- ziehen um

- mehrere

- Namen

- Vernetzung

- Neue Funktionen

- Neue Plattform

- neue Produkt

- neue Produkte

- Anzahl

- angeboten

- Offline-Bereich.

- Einsteigen

- Online

- XNUMXh geöffnet

- Einkauf & Prozesse

- Optimieren

- Organisation

- Andere

- Gesamt-

- besitzen

- besondere

- Partnerschaft

- leidenschaftlich

- Schnittmuster

- Leistung

- Fotografie

- Pilot

- Plattform

- Plattformen

- spielend

- Politik durchzulesen

- Datenschutzrichtlinien

- Mappe

- Portfolios

- Prinzip

- privat

- Private Schlüssel

- Prozessdefinierung

- anpassen

- Produkt

- Produktion

- PRODUKTIVITÄT

- Produkte

- Professionell

- Profil

- Profil

- Projekt

- Projekte

- Förderung

- die

- bietet

- Bereitstellung

- Öffentlichkeit

- Qualität

- Direkt

- schnell

- Lesebrillen

- Veteran

- Reduzierung

- Regulierungsbehörden

- Beziehung

- Release

- freigegeben

- Mitteilungen

- Vertrauen

- Meldungen

- Quelle

- erfordern

- falls angefordert

- Voraussetzungen:

- Ressourcen

- Downloads

- REST

- Die Ergebnisse

- Überprüfen

- Straße

- Führen Sie

- Laufen

- Skalierbarkeit

- skalierbaren

- Skalieren

- Szenen

- Wissenschaft

- Wissenschaftler

- Wissenschaftler

- Sdk

- Verbindung

- Sicherheitdienst

- ausgewählt

- Modellreihe

- Leistungen

- kompensieren

- Setup

- Teilen

- von Locals geführtes

- signifikant

- Ähnlich

- Einfacher

- So

- Software

- Software IngenieurIn

- Softwareentwicklung

- Lösung

- Lösungen

- verbringen

- Stabilität

- Stapel

- Standard

- Start-ups

- begonnen

- Bundesstaat

- Aussagen

- Status

- storage

- Strategisch

- Strategie

- Studio Adressen

- Support

- Unterstützt

- nachhaltiger

- System

- Systeme und Techniken

- und Aufgaben

- Team

- Technische

- Technologies

- Technologie

- Vorlagen

- Test

- Testen

- Tests

- das Gelenk

- Thema

- deswegen

- Durch

- Zeit

- Werkzeug

- gegenüber

- Tracking

- der Verkehr

- Ausbildung

- Transformieren

- Transformation

- Transit

- reisen

- Reise

- Vertrauen

- ui

- Uk

- Updates

- -

- Nutzer

- Nutzen

- Verwendung

- Vielfalt

- Anzeigen

- Assistent

- Sichtbarkeit

- Webbasiert

- ob

- während

- WHO

- .

- ohne

- Arbeiten

- gearbeitet

- arbeiten,

- ausarbeiten

- Werk

- weltweit wie ausgehandelt und gekauft ausgeführt wird.