Diese dreiteilige Serie demonstriert die Verwendung von Graph Neural Networks (GNNs) und Amazon Neptun um Filmempfehlungen mit dem zu generieren IMDb und Box Office Mojo Movies/TV/OTT lizenzierbares Datenpaket, das eine breite Palette von Unterhaltungsmetadaten bereitstellt, darunter über 1 Milliarde Benutzerbewertungen; Credits für mehr als 11 Millionen Besetzungs- und Crewmitglieder; 9 Millionen Film-, Fernseh- und Unterhaltungstitel; und globale Kassenberichtsdaten aus mehr als 60 Ländern. Viele AWS-Kunden aus den Bereichen Medien und Unterhaltung lizenzieren IMDb-Daten durch AWS-Datenaustausch um das Auffinden von Inhalten zu verbessern und die Kundenbindung und -bindung zu erhöhen.

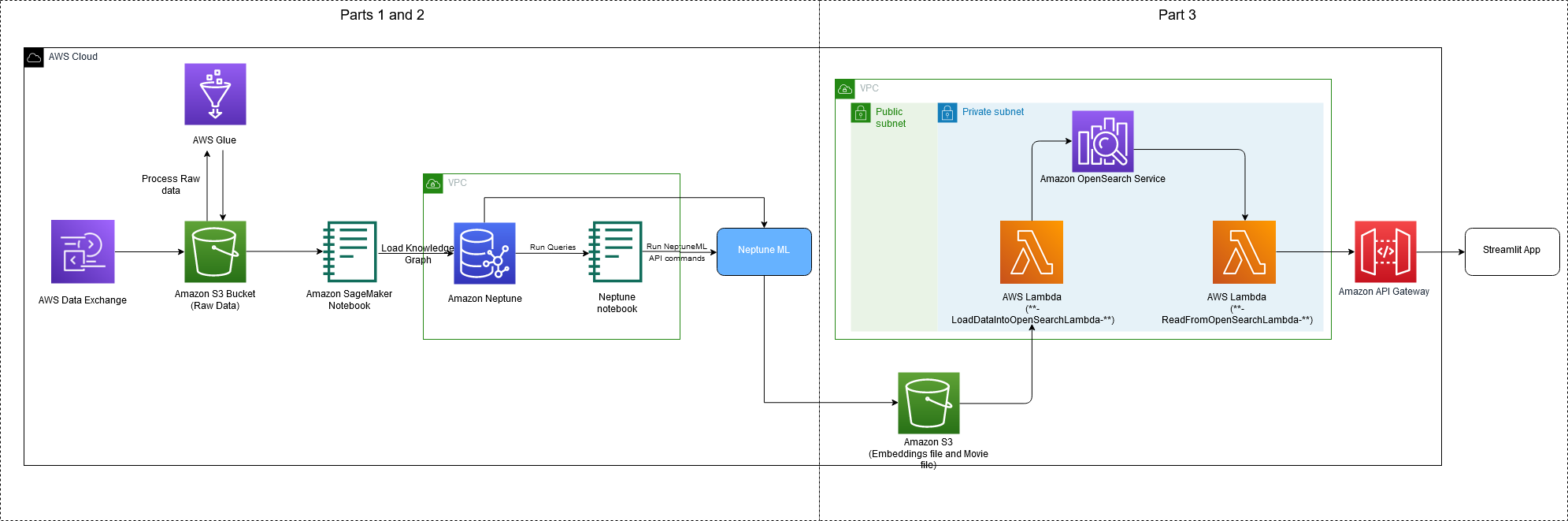

Das folgende Diagramm veranschaulicht die vollständige Architektur, die als Teil dieser Serie implementiert wurde.

In Teil 1diskutierten wir die Anwendungen von GNNs und wie wir unsere IMDb-Daten in einen Knowledge Graph (KG) umwandeln und aufbereiten können. Wir haben die Daten von AWS Data Exchange heruntergeladen und verarbeitet AWS-Kleber KG-Dateien zu generieren. Die KG-Dateien wurden gespeichert in Amazon Simple Storage-Service (Amazon S3) und dann geladen Amazon Neptun.

In Teil 2, wir haben gezeigt, wie man es benutzt Amazon Neptun ML (in Amazon Sage Maker) um die KG zu trainieren und KG-Einbettungen zu erstellen.

In diesem Beitrag führen wir Sie durch die Anwendung unserer trainierten KG-Einbettungen in Amazon S3 auf Anwendungsfälle für die Suche außerhalb des Katalogs Amazon OpenSearch-Dienst und AWS Lambda. Sie stellen auch eine lokale Web-App für ein interaktives Sucherlebnis bereit. Alle in diesem Beitrag verwendeten Ressourcen können mit einer einzigen erstellt werden AWS Cloud-Entwicklungskit (AWS CDK)-Befehl, wie später in diesem Beitrag beschrieben.

Hintergrund

Haben Sie jemals versehentlich nach einem Inhaltstitel gesucht, der auf einer Video-Streaming-Plattform nicht verfügbar war? Wenn ja, werden Sie feststellen, dass Sie anstelle einer leeren Suchergebnisseite eine Liste von Filmen desselben Genres mit Darstellern oder Crewmitgliedern finden. Das ist eine Suche außerhalb des Katalogs!

Suche außerhalb des Katalogs (OOC) ist, wenn Sie eine Suchanfrage eingeben, die keine direkte Übereinstimmung in einem Katalog hat. Dieses Ereignis tritt häufig auf Video-Streaming-Plattformen auf, die ständig eine Vielzahl von Inhalten von mehreren Anbietern und Produktionsfirmen für eine begrenzte Zeit kaufen. Das Fehlen von Relevanz oder Zuordnung des Katalogs eines Streaming-Unternehmens zu großen Wissensdatenbanken von Filmen und Shows kann zu einem unterdurchschnittlichen Sucherlebnis für Kunden führen, die OOC-Inhalte abfragen, wodurch die Interaktionszeit mit der Plattform verkürzt wird. Diese Zuordnung kann durch manuelles Zuordnen häufiger OOC-Abfragen zu Kataloginhalten erfolgen oder mithilfe von maschinellem Lernen (ML) automatisiert werden.

In diesem Beitrag veranschaulichen wir, wie OOC gehandhabt wird, indem wir die Leistungsfähigkeit des IMDb-Datensatzes (der führenden Quelle für globale Unterhaltungsmetadaten) und Wissensgraphen nutzen.

OpenSearch-Dienst ist ein vollständig verwalteter Dienst, der es Ihnen leicht macht, interaktive Protokollanalysen, Echtzeit-Anwendungsüberwachung, Website-Suche und mehr durchzuführen. OpenSearch ist eine von Elasticsearch abgeleitete Open-Source-Suite für verteilte Suche und Analyse. OpenSearch Service bietet die neuesten Versionen von OpenSearch, Unterstützung für 19 Versionen von Elasticsearch (Versionen 1.5 bis 7.10) sowie Visualisierungsfunktionen, die von OpenSearch Dashboards und Kibana (Versionen 1.5 bis 7.10) unterstützt werden. OpenSearch Service hat derzeit Zehntausende aktive Kunden mit Hunderttausenden verwalteten Clustern, die monatlich Billionen von Anfragen verarbeiten. OpenSearch Service bietet eine kNN-Suche, die die Suche in Anwendungsfällen wie Produktempfehlungen, Betrugserkennung und Bildern, Videos und einigen spezifischen semantischen Szenarien wie Dokument- und Abfrageähnlichkeit verbessern kann. Weitere Informationen zu den auf natürlichem Sprachverständnis basierenden Suchfunktionen von OpenSearch Service finden Sie unter Erstellen einer NLU-basierten Suchanwendung mit Amazon SageMaker und der Amazon OpenSearch Service KNN-Funktion.

Lösungsüberblick

In diesem Beitrag stellen wir eine Lösung vor, um OOC-Situationen durch wissensgraphbasierte Einbettungssuche unter Verwendung der k-nächsten Nachbarn (kNN)-Suchfunktionen von OpenSearch Service zu handhaben. Die wichtigsten AWS-Services, die zur Implementierung dieser Lösung verwendet werden, sind OpenSearch Service, SageMaker, Lambda und Amazon S3.

Zur kasse Teil 1 und Teil 2 dieser Reihe, um mehr über das Erstellen von Knowledge Graphs und die GNN-Einbettung mit Amazon Neptune ML zu erfahren.

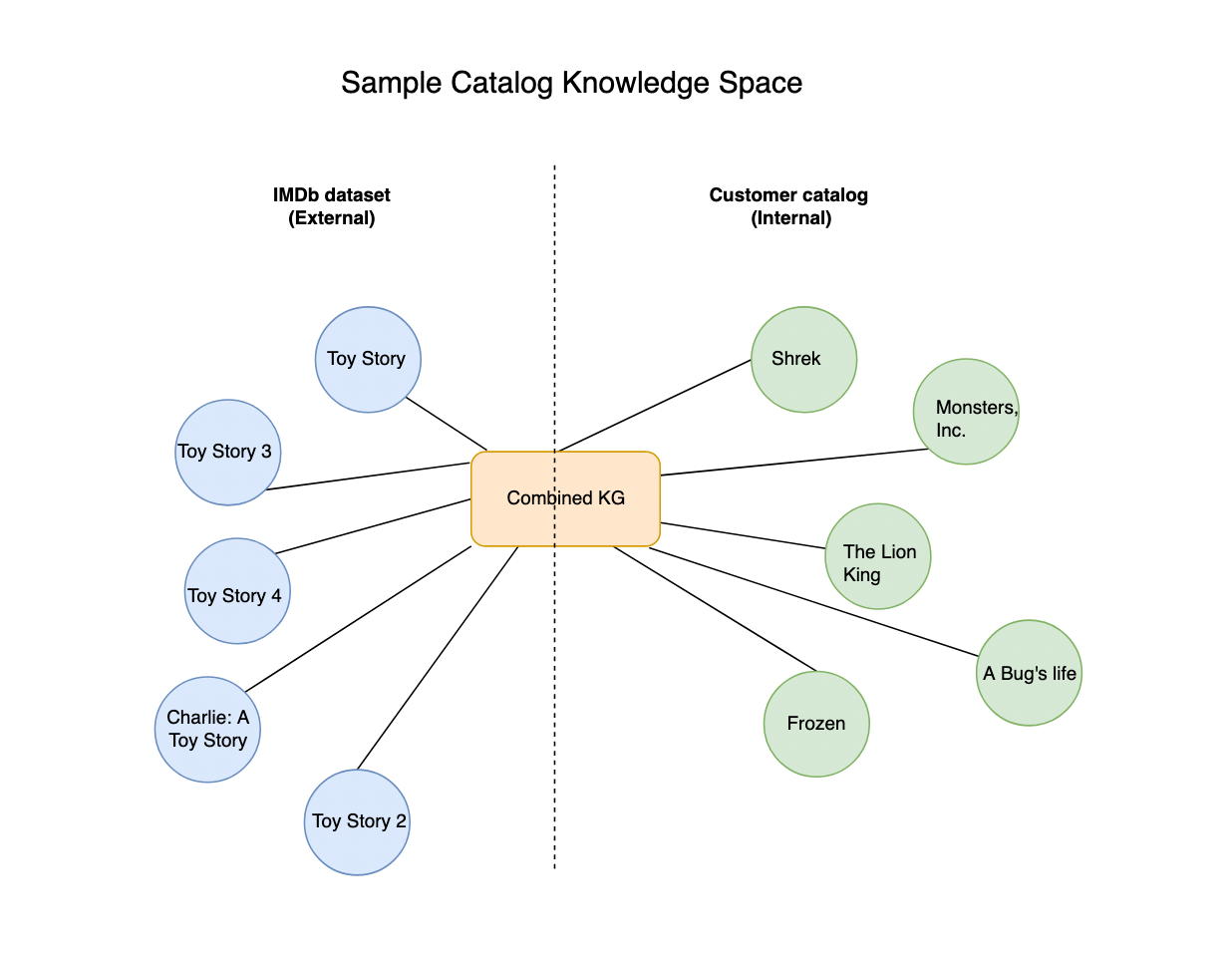

Unsere OOC-Lösung geht davon aus, dass Sie eine kombinierte KG haben, die durch die Fusion einer Streaming-Unternehmens-KG und einer IMDb KG entstanden ist. Dies kann durch einfache Textverarbeitungstechniken erfolgen, die Titel zusammen mit dem Titeltyp (Film, Serie, Dokumentarfilm), Besetzung und Crew abgleichen. Zusätzlich muss dieser gemeinsame Wissensgraph trainiert werden, um Einbettungen von Wissensgraphen durch die in erwähnten Pipelines zu erzeugen Teil 1 und Teil 2. Das folgende Diagramm zeigt eine vereinfachte Darstellung des kombinierten KG.

Um die OOC-Suchfunktion an einem einfachen Beispiel zu demonstrieren, haben wir den IMDb-Wissensgraphen in einen Kundenkatalog und einen Außer-Kunden-Katalog aufgeteilt. Wir markieren die Titel, die „Toy Story“ enthalten, als eine Ressource aus dem Nicht-Kundenkatalog und den Rest des IMDb-Wissensgraphen als Kundenkatalog. In einem Szenario, in dem der Kundenkatalog nicht erweitert oder mit externen Datenbanken zusammengeführt wird, würde eine Suche nach „Toy Story“ mit der OpenSearch-Textsuche jeden Titel zurückgeben, der die Wörter „Toy“ oder „Story“ in seinen Metadaten enthält. Wenn der Kundenkatalog IMDb zugeordnet wäre, wäre es einfacher herauszufinden, dass die Abfrage „Toy Story“ im Katalog nicht existiert und dass die Top-Treffer in IMDb „Toy Story“, „Toy Story 2“, „Toy Story 3“, „Toy Story 4“ und „Charlie: Toy Story“ in absteigender Reihenfolge der Relevanz mit Textübereinstimmung. Um Ergebnisse innerhalb des Katalogs für jede dieser Übereinstimmungen zu erhalten, können wir über den OpenSearch-Dienst fünf ähnlichste Filme in kundenkatalogbasierter kNN-Einbettung (der gemeinsamen KG) generieren.

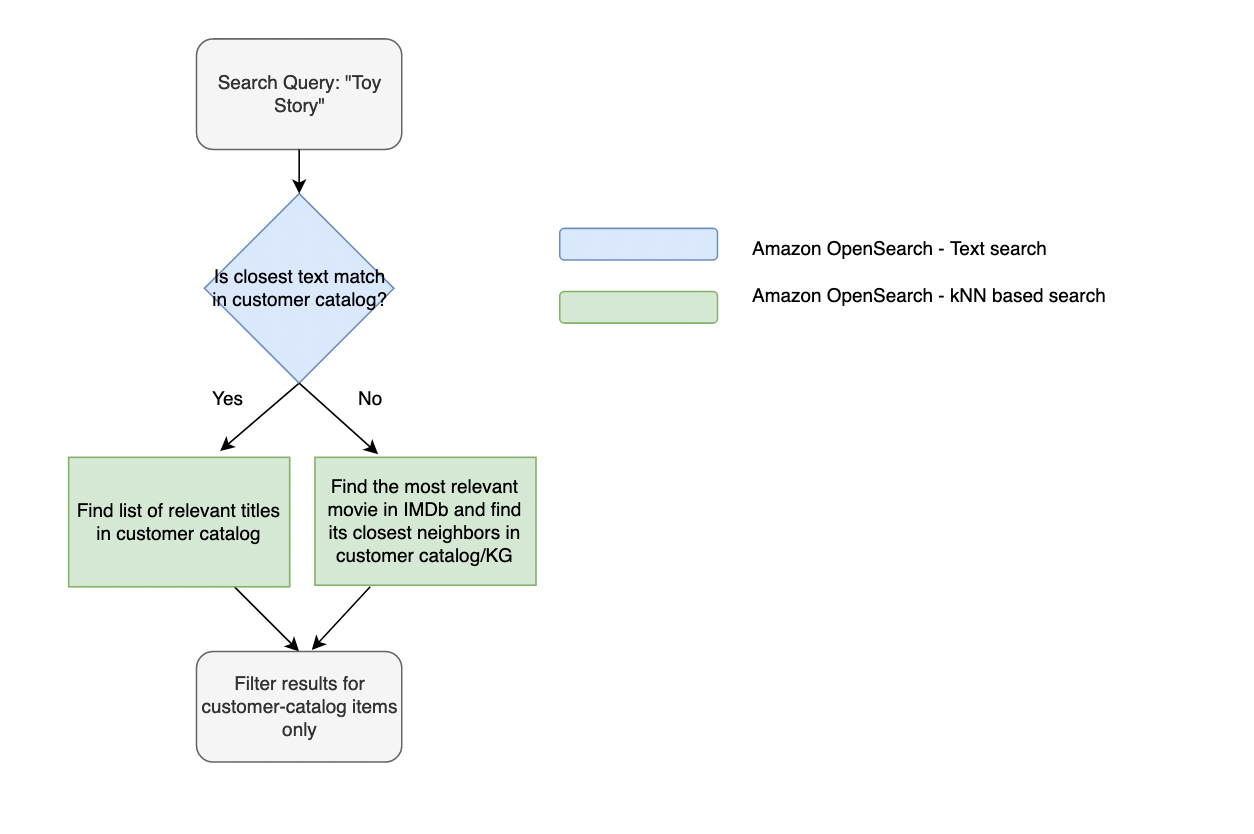

Eine typische OOC-Erfahrung folgt dem in der folgenden Abbildung dargestellten Ablauf.

Das folgende Video zeigt die Top XNUMX (Anzahl der Treffer) OOC-Ergebnisse für die Suchanfrage „Toy Story“ und relevante Übereinstimmungen im Kundenkatalog (Anzahl der Empfehlungen).

Hier wird die Abfrage per Textsuche im OpenSearch Service mit dem Knowledge Graph abgeglichen. Anschließend ordnen wir die Einbettungen der Textübereinstimmung den Kundenkatalogtiteln zu, indem wir den kNN-Index des OpenSearch-Dienstes verwenden. Da die Benutzerabfrage nicht direkt den Knowledge Graph-Entitäten zugeordnet werden kann, verwenden wir einen zweistufigen Ansatz, um zuerst titelbasierte Abfrageähnlichkeiten und dann titelähnliche Elemente mithilfe von Knowledge Graph-Einbettungen zu finden. In den folgenden Abschnitten gehen wir durch den Prozess der Einrichtung eines OpenSearch Service-Clusters, der Erstellung und des Hochladens von Knowledge-Graph-Indizes und der Bereitstellung der Lösung als Webanwendung.

Voraussetzungen:

Um diese Lösung zu implementieren, sollten Sie über eine verfügen AWS-Konto, Vertrautheit mit OpenSearch Service, SageMaker, Lambda und AWS CloudFormation, und die Schritte in abgeschlossen haben Teil 1 und Teil 2 dieser Serie.

Starten Sie Lösungsressourcen

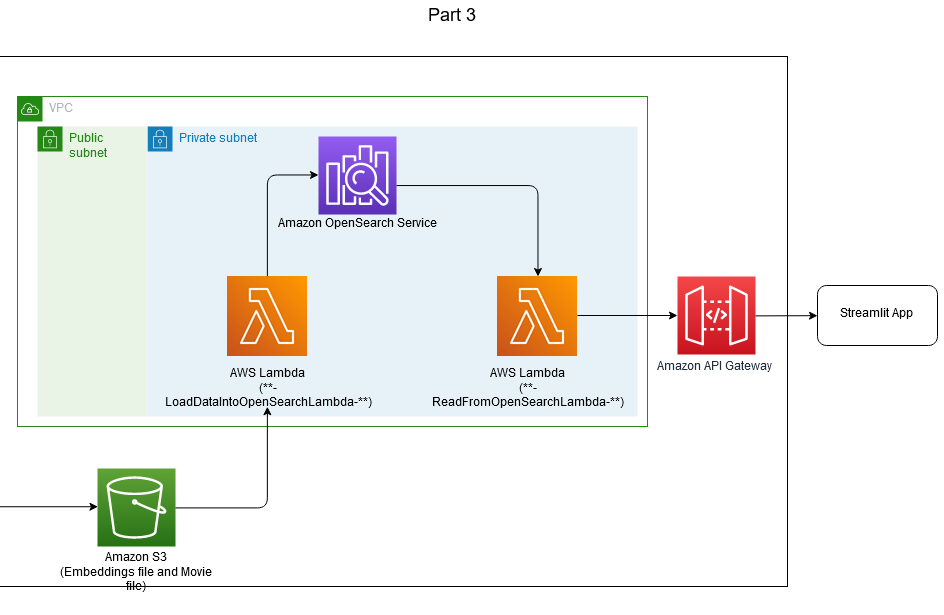

Das folgende Architekturdiagramm zeigt den Out-of-Catalog-Workflow.

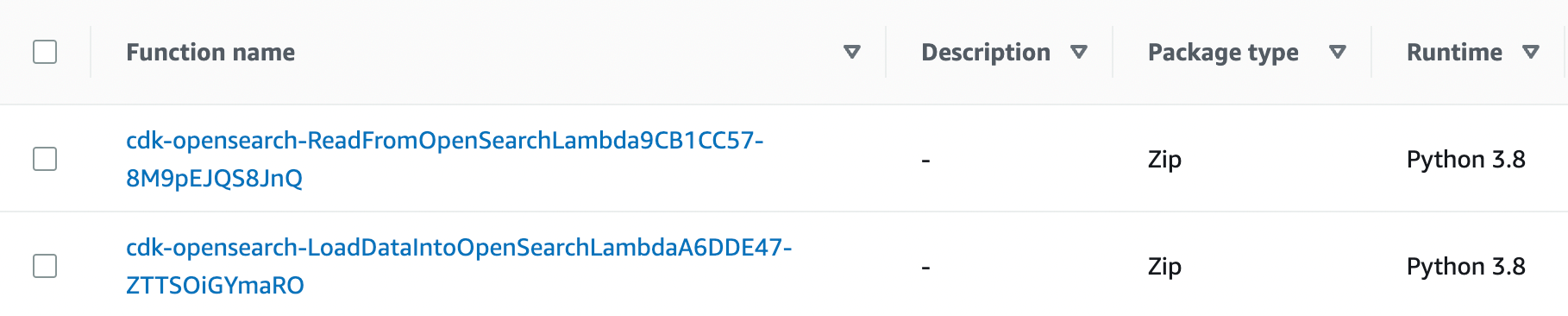

Sie verwenden das AWS Cloud Development Kit (CDK), um die für die OOC-Suchanwendungen erforderlichen Ressourcen bereitzustellen. Der Code zum Starten dieser Ressourcen führt die folgenden Vorgänge aus:

- Erstellt eine VPC für die Ressourcen.

- Erstellt eine OpenSearch-Dienstdomäne für die Suchanwendung.

- Erstellt eine Lambda-Funktion zum Verarbeiten und Laden von Filmmetadaten und Einbettungen in OpenSearch Service-Indizes (

**-ReadFromOpenSearchLambda-**). - Erstellt eine Lambda-Funktion, die die Benutzerabfrage von einer Web-App als Eingabe nimmt und relevante Titel von OpenSearch zurückgibt (

**-LoadDataIntoOpenSearchLambda-**). - Erstellt ein API-Gateway, das eine zusätzliche Sicherheitsebene zwischen der Benutzeroberfläche der Webanwendung und Lambda hinzufügt.

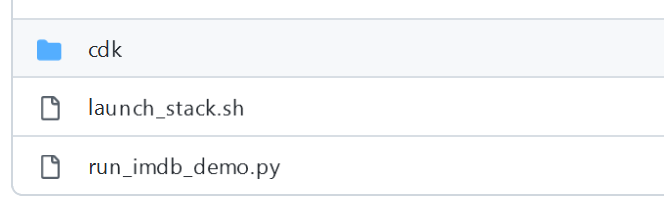

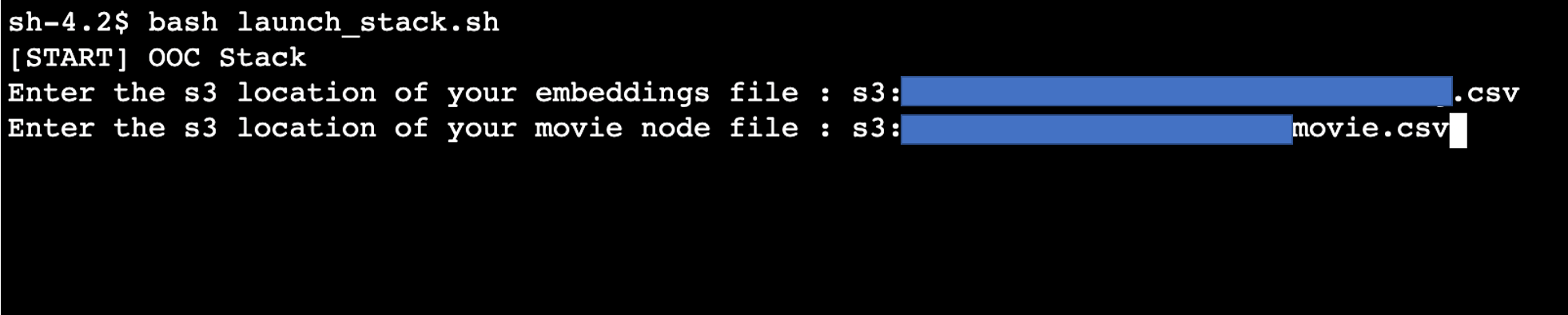

Führen Sie zunächst die folgenden Schritte aus:

- Führen Sie den Code und die Notebooks aus Teil 1 und Teil 2.

- Navigieren Sie zu der

part3-out-of-catalogOrdner im Code-Repository.

- Starten Sie das AWS CDK vom Terminal mit dem Befehl

bash launch_stack.sh. - Stellen Sie die beiden in Teil 3 erstellten S2-Dateipfade als Eingabe bereit:

- Der S3-Pfad zur CSV-Datei mit den Filmeinbettungen.

- Der S3-Pfad zur Filmknotendatei.

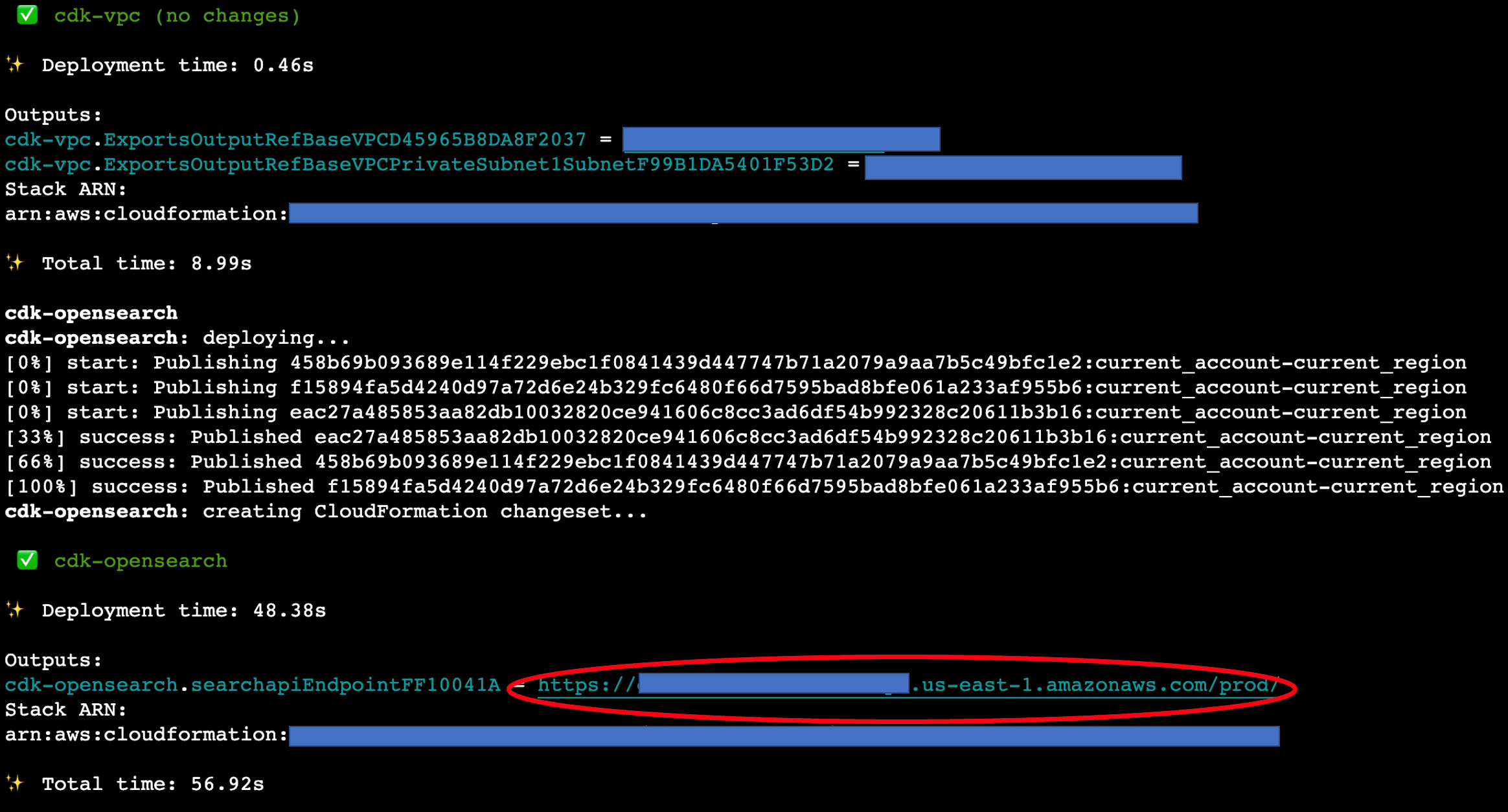

- Warten Sie, bis das Skript alle erforderlichen Ressourcen bereitstellt und die Ausführung beendet.

- Kopieren Sie die API Gateway-URL, die das AWS CDK-Skript ausdruckt, und speichern Sie sie. (Wir verwenden dies später für die Streamlit-App).

Erstellen Sie eine OpenSearch-Dienstdomäne

Zur Veranschaulichung erstellen Sie eine Suchdomäne in einer Availability Zone in einer r6g.large.search-Instance innerhalb einer sicheren VPC und eines Subnetzes. Beachten Sie, dass es am besten wäre, drei Availability Zones mit einer primären und zwei Replikatinstanzen einzurichten.

Erstellen Sie einen OpenSearch Service-Index und laden Sie Daten hoch

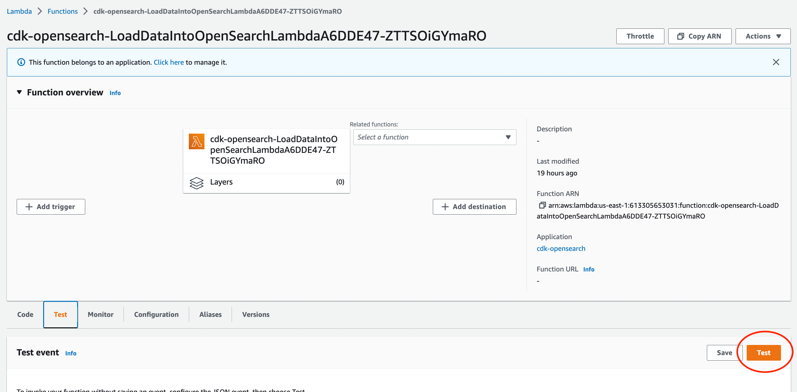

Sie verwenden Lambda-Funktionen (erstellt mit dem AWS CDK-Launch-Stack-Befehl), um die OpenSearch Service-Indizes zu erstellen. Führen Sie die folgenden Schritte aus, um die Indexerstellung zu starten:

- Öffnen Sie auf der Lambda-Konsole die

LoadDataIntoOpenSearchLambdaLambda-Funktion.

- Auf dem Test Tab, wählen Sie Test um Daten zu erstellen und in den Index des OpenSearch-Dienstes aufzunehmen.

Den folgenden Code zu dieser Lambda-Funktion finden Sie in part3-out-of-catalog/cdk/ooc/lambdas/LoadDataIntoOpenSearchLambda/lambda_handler.py:

Die Funktion führt die folgenden Aufgaben aus:

- Lädt die IMDB KG-Filmknotendatei, die die Filmmetadaten und die zugehörigen Einbettungen enthält, aus den S3-Dateipfaden, die an die Stack-Erstellungsdatei übergeben wurden

launch_stack.sh. - Führt die beiden Eingabedateien zusammen, um einen einzelnen Datenrahmen für die Indexerstellung zu erstellen.

- Initialisiert den OpenSearch Service-Client mit der Boto3-Python-Bibliothek.

- Erstellt zwei Indizes für Text (

ooc_text) und kNN-Einbettungssuche (ooc_knn) und lädt Daten aus dem kombinierten Datenrahmen per Bulk-Upload über dieingest_data_into_opsFunktion.

Dieser Datenerfassungsprozess dauert 5–10 Minuten und kann über überwacht werden Amazon CloudWatch meldet sich an Netzwerk Performance Registerkarte der Lambda-Funktion.

Sie erstellen zwei Indizes, um die textbasierte Suche und die einbettungsbasierte kNN-Suche zu aktivieren. Die Textsuche ordnet die Freiformabfrage, die der Benutzer eingibt, den Titeln des Films zu. Die kNN-Einbettungssuche findet die k Filme, die der besten Textübereinstimmung aus dem latenten KG-Raum am nächsten kommen, um sie als Ausgaben zurückzugeben.

Stellen Sie die Lösung als lokale Webanwendung bereit

Nachdem Sie nun über eine funktionierende Textsuche und einen kNN-Index im OpenSearch-Dienst verfügen, können Sie eine ML-gestützte Web-App erstellen.

Wir nutzen die streamlit Python-Paket, um eine Front-End-Illustration für diese Anwendung zu erstellen. Das IMDb-Knowledge-Graph-Blog/part3-out-of-catalog/run_imdb_demo.py Python-Datei in unserer GitHub Repo verfügt über den erforderlichen Code zum Starten einer lokalen Web-App, um diese Funktion zu erkunden.

Führen Sie die folgenden Schritte aus, um den Code auszuführen:

- Installieren Sie das

streamlitundaws_requests_authPython-Paket in Ihrer lokalen virtuellen Python-Umgebung durch für die folgenden Befehle in Ihrem Terminal:

- Ersetzen Sie den Platzhalter für die API Gateway-URL im Code wie folgt durch den vom AWS CDK erstellten:

api = '<ENTER URL OF THE API GATEWAY HERE>/opensearch-lambda?q={query_text}&numMovies={num_movies}&numRecs={num_recs}'

- Starten Sie die Web-App mit dem Befehl

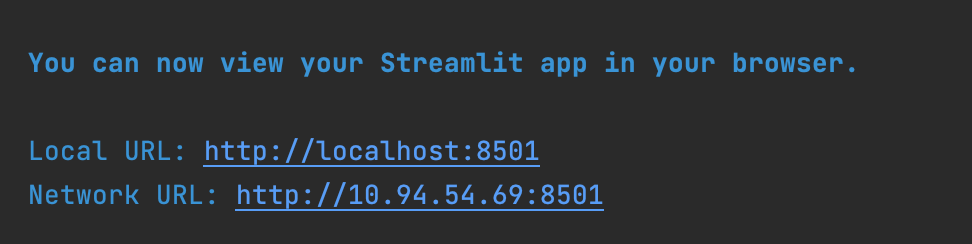

streamlit run run_imdb_demo.pyvon Ihrem Endgerät.

Dieses Skript startet eine Streamlit-Webanwendung, auf die Sie in Ihrem Webbrowser zugreifen können. Die URL der Web-App kann aus der Skriptausgabe abgerufen werden, wie im folgenden Screenshot gezeigt.

Die App akzeptiert neue Suchbegriffe, Trefferzahlen und Empfehlungen. Die Anzahl der Treffer entspricht der Anzahl passender OOC-Titel, die wir aus dem externen (IMDb)-Katalog abrufen sollten. Die Anzahl der Empfehlungen entspricht der Anzahl der nächsten Nachbarn, die wir basierend auf der kNN-Einbettungssuche aus dem Kundenkatalog abrufen sollten. Siehe folgenden Code:

Diese Eingaben (Anfrage, Anzahl der Treffer und Empfehlungen) werden an die weitergegeben **-ReadFromOpenSearchLambda-** Lambda-Funktion, die vom AWS CDK über die API Gateway-Anforderung erstellt wurde. Dies geschieht in der folgenden Funktion:

Die Ausgabeergebnisse der Lambda-Funktion von OpenSearch Service werden an API Gateway übergeben und in der Streamlit-App angezeigt.

Aufräumen

Sie können alle vom AWS CDK erstellten Ressourcen über den Befehl löschen npx cdk destroy –app “python3 appy.py” --all in der gleichen Instanz (innerhalb der cdk Ordner), der zum Starten des Stacks verwendet wurde (siehe folgenden Screenshot).

Zusammenfassung

In diesem Beitrag haben wir Ihnen gezeigt, wie Sie mithilfe von SageMaker und OpenSearch Service eine Lösung für die OOC-Suche mit text- und kNN-basierter Suche erstellen. Sie haben benutzerdefinierte Knowledge Graph-Modelleinbettungen verwendet, um die nächsten Nachbarn in Ihrem Katalog zu denen von IMDb-Titeln zu finden. Sie können jetzt beispielsweise nach „The Rings of Power“, einer von Amazon Prime Video entwickelten Fantasy-Serie, auf anderen Streaming-Plattformen suchen und begründen, wie sie das Suchergebnis hätten optimieren können.

Weitere Informationen zum Codebeispiel in diesem Beitrag finden Sie in der GitHub Repo. Um mehr über die Zusammenarbeit mit dem Amazon ML Solutions Lab zu erfahren, um ähnliche hochmoderne ML-Anwendungen zu entwickeln, siehe Amazon Machine Learning Solutions Lab. Weitere Informationen zur Lizenzierung von IMDb-Datensätzen finden Sie unter Developer.imdb.com.

Über die Autoren

Divya Bhargavi ist Data Scientist und Media and Entertainment Vertical Lead im Amazon ML Solutions Lab, wo sie hochwertige Geschäftsprobleme für AWS-Kunden mithilfe von maschinellem Lernen löst. Sie arbeitet an Bild-/Videoverständnis, Empfehlungssystemen für Wissensgraphen und prädiktiven Werbeanwendungsfällen.

Divya Bhargavi ist Data Scientist und Media and Entertainment Vertical Lead im Amazon ML Solutions Lab, wo sie hochwertige Geschäftsprobleme für AWS-Kunden mithilfe von maschinellem Lernen löst. Sie arbeitet an Bild-/Videoverständnis, Empfehlungssystemen für Wissensgraphen und prädiktiven Werbeanwendungsfällen.

Gaurav Rele ist Data Scientist am Amazon ML Solution Lab, wo er mit AWS-Kunden in verschiedenen Branchen zusammenarbeitet, um die Nutzung von maschinellem Lernen und AWS Cloud-Diensten zur Lösung ihrer geschäftlichen Herausforderungen zu beschleunigen.

Gaurav Rele ist Data Scientist am Amazon ML Solution Lab, wo er mit AWS-Kunden in verschiedenen Branchen zusammenarbeitet, um die Nutzung von maschinellem Lernen und AWS Cloud-Diensten zur Lösung ihrer geschäftlichen Herausforderungen zu beschleunigen.

Matthäus Rhodos ist Data Scientist und arbeite im Amazon ML Solutions Lab. Er ist spezialisiert auf den Aufbau von Pipelines für maschinelles Lernen, die Konzepte wie Natural Language Processing und Computer Vision beinhalten.

Matthäus Rhodos ist Data Scientist und arbeite im Amazon ML Solutions Lab. Er ist spezialisiert auf den Aufbau von Pipelines für maschinelles Lernen, die Konzepte wie Natural Language Processing und Computer Vision beinhalten.

Karan Sindwani ist Data Scientist im Amazon ML Solutions Lab, wo er Deep-Learning-Modelle erstellt und bereitstellt. Er hat sich auf den Bereich Computer Vision spezialisiert. In seiner Freizeit wandert er gerne.

Karan Sindwani ist Data Scientist im Amazon ML Solutions Lab, wo er Deep-Learning-Modelle erstellt und bereitstellt. Er hat sich auf den Bereich Computer Vision spezialisiert. In seiner Freizeit wandert er gerne.

Soji Adeshina ist ein angewandter Wissenschaftler bei AWS, wo er auf Graphen basierende Modelle für neuronale Netzwerke für maschinelles Lernen bei Graphenaufgaben mit Anwendungen für Betrug und Missbrauch, Wissensgraphen, Empfehlungssysteme und Biowissenschaften entwickelt. In seiner Freizeit liest und kocht er gerne.

Soji Adeshina ist ein angewandter Wissenschaftler bei AWS, wo er auf Graphen basierende Modelle für neuronale Netzwerke für maschinelles Lernen bei Graphenaufgaben mit Anwendungen für Betrug und Missbrauch, Wissensgraphen, Empfehlungssysteme und Biowissenschaften entwickelt. In seiner Freizeit liest und kocht er gerne.

Vidya Sagar Ravipati ist Manager im Amazon ML Solutions Lab, wo er seine umfangreiche Erfahrung mit großen verteilten Systemen und seine Leidenschaft für maschinelles Lernen einsetzt, um AWS-Kunden in verschiedenen Branchen dabei zu helfen, ihre KI- und Cloud-Einführung zu beschleunigen.

Vidya Sagar Ravipati ist Manager im Amazon ML Solutions Lab, wo er seine umfangreiche Erfahrung mit großen verteilten Systemen und seine Leidenschaft für maschinelles Lernen einsetzt, um AWS-Kunden in verschiedenen Branchen dabei zu helfen, ihre KI- und Cloud-Einführung zu beschleunigen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/power-recommendations-and-search-using-an-imdb-knowledge-graph-part-3/

- 1

- 10

- 100

- 11

- 116

- 7

- 9

- a

- LiveBuzz

- Missbrauch

- beschleunigen

- Akzeptiert

- Zugriff

- über

- aktiv

- Zusätzliche

- zusätzlich

- Fügt

- Adoption

- Marketings

- AI

- Alle

- Amazon

- Amazon ML-Lösungslabor

- Amazon Neptun

- Amazon Neptun ML

- Amazon OpenSearch-Dienst

- Amazon Sage Maker

- Analytik

- und

- Bienen

- App

- Anwendung

- Anwendungen

- angewandt

- Bewerben

- Ansatz

- Architektur

- Bereich

- damit verbundenen

- Automatisiert

- Verfügbarkeit

- verfügbar

- AWS

- AWS-Datenaustausch

- basierend

- weil

- BESTE

- zwischen

- Milliarde

- Box

- Abendkasse

- Browser

- bauen

- Building

- baut

- Geschäft

- Fähigkeiten

- Fälle

- Katalog

- Herausforderungen

- Auswählen

- Auftraggeber

- Cloud

- Cloud-Einführung

- Cloud-Services

- Cluster

- Code

- Zusammenarbeit

- kombiniert

- Unternehmen

- Unternehmen

- Unternehmen

- abschließen

- Abgeschlossene Verkäufe

- Computer

- Computer Vision

- Konzepte

- Konsul (Console)

- ständig

- enthält

- Inhalt

- entspricht

- könnte

- Ländern

- erstellen

- erstellt

- Erstellen

- Schaffung

- Credits

- Strom

- Zur Zeit

- Original

- Kunde

- Kundenbindung

- Kunden

- technische Daten

- Data Exchange

- Datenwissenschaftler

- Datenbanken

- Datensätze

- tief

- tiefe Lernen

- zeigen

- Synergie

- einsetzen

- Bereitstellen

- setzt ein

- Abgeleitet

- beschrieben

- zerstören

- Entdeckung

- entwickelt

- Entwicklung

- entwickelt

- anders

- Direkt

- Direkt

- Entdeckung

- diskutiert

- verteilt

- verteilte Systeme

- Dokument

- Dokumentarfilm

- Tut nicht

- Domain

- jeder

- einfacher

- ermöglichen

- Engagement

- verbesserte

- Enter

- Tritt ein

- Unterhaltung

- Entitäten

- Arbeitsumfeld

- Event

- ÜBERHAUPT

- Beispiel

- Austausch-

- ERFAHRUNGEN

- ERKUNDEN

- extern

- extra

- zugewandt

- Vertrautheit

- FANTASIE

- Abbildung

- Reichen Sie das

- Mappen

- Finden Sie

- findet

- Vorname

- Fluss

- Folgende

- folgt

- gefunden

- Betrug

- Betrugserkennung

- häufig

- häufig

- für

- voll

- Funktion

- Funktionsumfang

- Funktionalität

- Funktionen

- Tor

- erzeugen

- bekommen

- Global

- Graph

- Graphen

- Griff

- Überschriften

- Hilfe

- Hit

- Treffer

- Ultraschall

- Hilfe

- HTML

- HTTPS

- hunderte

- Image

- implementieren

- umgesetzt

- zu unterstützen,

- in

- Einschließlich

- Erhöhung

- Index

- Indizes

- Indizes

- Energiegewinnung

- Information

- Varianten des Eingangssignals:

- installieren

- Instanz

- beantragen müssen

- Interaktion

- interaktive

- Schnittstelle

- beteiligen

- IT

- Artikel

- Wesentliche

- Wissen

- Wissen Graph

- Labor

- Sprache

- grosse

- großflächig

- neueste

- starten

- startet

- Schicht

- führen

- LERNEN

- lernen

- Hebelwirkungen

- Bibliothek

- Lizenz

- Lizenzierung

- Lebensdauer

- Biowissenschaften

- Limitiert

- Liste

- Belastung

- aus einer regionalen

- Maschine

- Maschinelles Lernen

- MACHT

- verwaltet

- Management

- Manager

- manuell

- viele

- Karte

- Mapping

- Landkarten

- Kennzeichen

- Spiel

- Abstimmung

- Medien

- Mitglieder

- erwähnt

- Verschmelzung

- Metadaten

- Million

- Minuten

- ML

- Modell

- für

- überwacht

- Überwachung

- Monat

- mehr

- Film

- Filme

- mehrere

- Natürliche

- Verarbeitung natürlicher Sprache

- Nachbarschaft

- Neptun

- netzwerkbasiert

- Netzwerke

- Neuronale Netze

- Neu

- Knoten

- Anzahl

- erhalten

- Angebote

- Office

- EINEM

- XNUMXh geöffnet

- Open-Source-

- Einkauf & Prozesse

- optimiert

- Auftrag

- OS

- Andere

- Paket

- Teil

- Bestanden

- Leidenschaft & KREATIVITÄT

- Weg

- Ausführen

- führt

- Platzhalter

- Plattform

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Bitte

- Post

- Werkzeuge

- angetriebene

- Praxis

- Premier

- Danach

- Gegenwart

- primär

- Prime

- Drucke

- Probleme

- Prozessdefinierung

- Verarbeitet

- Verarbeitung

- Produkt

- Produktion

- bietet

- Bereitstellung

- Kauf

- Zwecke

- Python

- Angebot

- Bewertungen

- Lesebrillen

- bereit

- Echtzeit

- Grund

- Software Empfehlungen

- Empfehlungen

- Relevanz

- relevant

- antworten

- Reporting

- Quelle

- Anforderung

- Zugriffe

- falls angefordert

- Ressourcen

- Downloads

- Antwort

- REST

- Folge

- Die Ergebnisse

- Beibehaltung

- Rückkehr

- Rückgabe

- Führen Sie

- Laufen

- sagemaker

- gleich

- Speichern

- Szenarien

- WISSENSCHAFTEN

- Wissenschaftler

- Suche

- Abschnitte

- Verbindung

- Sicherheitdienst

- Modellreihe

- Lösungen

- kompensieren

- Einstellung

- Einstellungen

- sollte

- gezeigt

- Konzerte

- ähnlich

- Ähnlichkeiten

- Einfacher

- vereinfachte

- Single

- Umstände

- Lösung

- Lösungen

- LÖSEN

- Löst

- einige

- Quelle

- Raumfahrt

- spezialisiert

- spezifisch

- gespalten

- Stapel

- Anfang

- begonnen

- State-of-the-art

- Shritte

- Lagerung

- gelagert

- Geschichte

- Streaming

- Subnetz

- so

- Suite

- Support

- Systeme und Techniken

- Nehmen

- nimmt

- und Aufgaben

- Techniken

- Terminal

- Das

- Die Gegend

- das Gelenk

- ihr

- damit

- Tausende

- nach drei

- Durch

- Zeit

- Titel

- Titel

- zu

- Top

- Training

- trainiert

- Transformieren

- Billionen

- tv

- typisch

- für

- Verständnis

- Uploading

- URL

- -

- Mitglied

- Benutzerschnittstelle

- Verwendung

- Vielfalt

- riesig

- Anbieter

- Vertikalen

- Video

- Anzeigen

- Assistent

- Seh-

- Visualisierung

- Netz

- Internetanwendung

- Web-Browser

- Webseite

- welche

- breit

- Große Auswahl

- werden wir

- .

- Word

- Worte

- arbeiten,

- Werk

- würde

- Du

- Ihr

- Zephyrnet

- Zonen