1QC Ware, Palo Alto, USA und Paris, Frankreich

2IRIF, CNRS – Universität Paris, Frankreich

3Indian Institute of Technology Roorkee, Indien

4F. Hoffmann La Roche AG

Findest du dieses Paper interessant oder möchtest du darüber diskutieren? Scite oder hinterlasse einen Kommentar zu SciRate.

Abstrakt

Techniken des maschinellen Quantenlernens wurden als eine Möglichkeit vorgeschlagen, die Leistung in maschinellen Lernanwendungen potenziell zu verbessern.

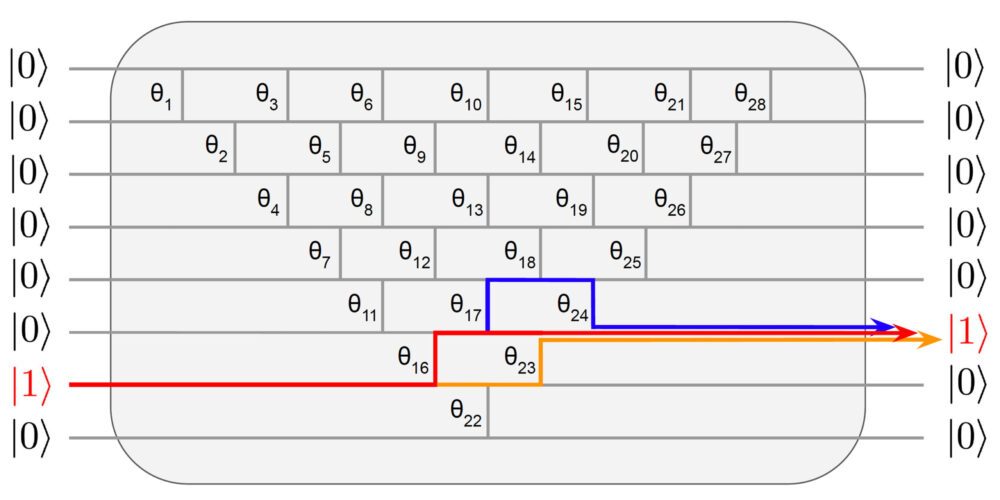

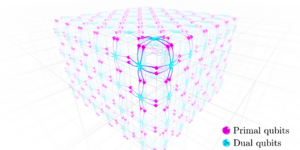

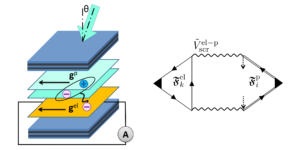

In diesem Artikel stellen wir zwei neue Quantenmethoden für neuronale Netze vor. Das erste ist ein quantenorthogonales neuronales Netzwerk, das auf einer Quantenpyramidenschaltung als Baustein für die Implementierung der orthogonalen Matrixmultiplikation basiert. Wir bieten einen effizienten Weg zum Trainieren solcher orthogonaler neuronaler Netze; neuartige Algorithmen werden sowohl für klassische als auch für Quantenhardware detailliert beschrieben, wobei beide nachweislich asymptotisch besser skalieren als bisher bekannte Trainingsalgorithmen.

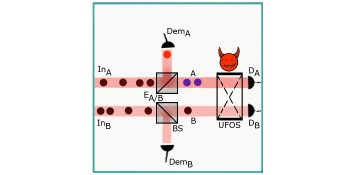

Die zweite Methode sind quantengestützte neuronale Netze, bei denen ein Quantencomputer verwendet wird, um eine innere Produktschätzung für die Inferenz und das Training klassischer neuronaler Netze durchzuführen.

Anschließend stellen wir umfangreiche Experimente vor, die auf medizinische Bildklassifizierungsaufgaben mit aktueller Quantenhardware angewendet werden, wobei wir verschiedene Quantenmethoden mit klassischen Methoden sowohl auf echter Quantenhardware als auch auf Simulatoren vergleichen. Unsere Ergebnisse zeigen, dass Quanten- und klassische neuronale Netze ein ähnliches Maß an Genauigkeit erzeugen, was das Versprechen stützt, dass Quantenmethoden angesichts des Aufkommens besserer Quantenhardware bei der Lösung visueller Aufgaben nützlich sein können.

► BibTeX-Daten

► Referenzen

[1] Aram W. Harrow, Avinatan Chassidim und Seth Lloyd. „Quantenalgorithmus für lineare Gleichungssysteme“. Physical Review Letters 103, 150502 (2009).

https://doi.org/ 10.1103/PhysRevLett.103.150502

[2] Seth Lloyd, Masoud Mohseni und Patrick Rebentrost. „Quantenalgorithmen für überwachtes und unüberwachtes maschinelles Lernen“ (2013).

[3] Seth Lloyd, Masoud Mohseni und Patrick Rebentrost. „Quantenhauptkomponentenanalyse“. Naturphysik 10, 631–633 (2014).

https: / / doi.org/ 10.1038 / nphys3029

[4] Iordanis Kerenidis und Anupam Prakash. „Quantenempfehlungssysteme“. 8. Innovations in Theoretical Computer Science Conference (ITCS 2017) 67, 49:1–49:21 (2017). URL: doi.org/10.48550/arXiv.1603.08675.

https:///doi.org/10.48550/arXiv.1603.08675

[5] Iordanis Kerenidis, Jonas Landman, Alessandro Luongo und Anupam Prakash. „q-means: Ein Quantenalgorithmus für unbeaufsichtigtes maschinelles Lernen“. In Advances in Neural Information Processing Systems 32. Seiten 4136–4146. Curran Associates, Inc. (2019). URL:.

arXiv: 1812.03584

[6] Seth Lloyd, Silvano Garnerone und Paolo Zanardi. „Quantenalgorithmen zur topologischen und geometrischen Analyse von Daten“. Naturkommunikation 7, 1–7 (2016). URL: doi.org/10.1038/ncomms10138.

https: / / doi.org/ 10.1038 / ncomms10138

[7] Edward Farhi und Hartmut Neven. „Klassifizierung mit quantenneuronalen Netzen auf Nahzeitprozessoren“ (2018). URL: doi.org/10.48550/arXiv.1802.06002.

https:///doi.org/10.48550/arXiv.1802.06002

[8] I Kerenidis, J Landman und A Prakash. „Quantenalgorithmen für Deep Convolutional Neural Networks“. ACHTE INTERNATIONALE KONFERENZ ZUM LERNEN VON REPRÄSENTATIONEN ICLR (2019).

https:///doi.org/10.48550/arXiv.1911.01117

[9] J Allcock, CY Hsieh, I Kerenidis und S Zhang. „Quantenalgorithmen für vorwärtsgekoppelte neuronale Netze“. ACM Transactions on Quantum Computing 1 (1), 1-24 (2020).

https: / / doi.org/ 10.1145 / 3411466

[10] Iris Cong, Soonwon Choi und Mikhail D. Lukin. „Quantenfaltungsneuronale Netze“. Naturphysik 15 (2019).

https://doi.org/10.1038/s41567-019-0648-8

[11] Hector Ivan García-Hernandez, Raymundo Torres-Ruiz und Guo-Hua Sun. „Bildklassifizierung durch Quantenmaschinenlernen“ (2020). URL: doi.org/10.48550/arXiv.2011.02831.

https:///doi.org/10.48550/arXiv.2011.02831

[12] Saurabh Kumar, Siddharth Dangwal und Debanjan Bhowmik. „Überwachtes Lernen unter Verwendung eines gekleideten Quantennetzwerks mit „superkomprimierter Codierung“: Algorithmus und quantenhardwarebasierte Implementierung“ (2020). URL: doi.org/10.48550/arXiv.2007.10242.

https:///doi.org/10.48550/arXiv.2007.10242

[13] Kouhei Nakaji und Naoki Yamamoto. „Quantum semi-überwachtes generatives kontradiktorisches Netzwerk für verbesserte Datenklassifizierung“ (2020). URL: doi.org/10.1038/s41598-021-98933-6.

https://doi.org/10.1038/s41598-021-98933-6

[14] William Cappelletti, Rebecca Erbanni und Joaquín Keller. „Polyadischer Quantenklassifikator“ (2020). URL: doi.org/10.48550/arXiv.2007.14044.

https:///doi.org/10.48550/arXiv.2007.14044

[15] Vojtech Havlicek, Antonio D. Córcoles, Kristan Temme, Aram W. Harrow, Abhinav Kandala, Jerry M. Chow und Jay M. Gambetta. „Überwachtes Lernen mit quantenerweiterten Merkmalsräumen“ (2018). URL: doi.org/10.1038/s41586-019-0980-2.

https://doi.org/10.1038/s41586-019-0980-2

[16] Edward Grant, Marcello Benedetti, Shuxiang Cao, Andrew Hallam, Joshua Lockhart, Vid Stojevic, Andrew G. Green und Simone Severini. „Hierarchische Quantenklassifikatoren“ (2018). URL: doi.org/10.1038/s41534-018-0116-9.

https://doi.org/10.1038/s41534-018-0116-9

[17] Bobak Toussi Kiani, Agnes Villanyi und Seth Lloyd. „Quantenmedizinische Bildgebungsalgorithmen“ (2020). URL: doi.org/10.48550/arXiv.2004.02036.

https:///doi.org/10.48550/arXiv.2004.02036

[18] Marco Cerezo, Andrew Arrasmith, Ryan Babbush, Simon C. Benjamin, Suguru Endo, Keisuke Fujii, Jarrod R. McClean, Kosuke Mitarai, Xiao Yuan, Lukasz Cincio, et al. „Variative Quantenalgorithmen“ (2020). URL: doi.org/10.1038/s42254-021-00348-9.

https://doi.org/10.1038/s42254-021-00348-9

[19] Kishor Bharti, Alba Cervera-Lierta, Thi Ha Kyaw, Tobias Haug, Sumner Alperin-Lea, Abhinav Anand, Matthias Degroote, Hermanni Heimonen, Jakob S. Kottmann, Tim Menke, et al. "Rauschende Quantenalgorithmen im mittleren Maßstab". Reviews of Modern Physics 94, 015004 (2022). URL: doi.org/10.1103/RevModPhys.94.015004.

https: / / doi.org/ 10.1103 / RevModPhys.94.015004

[20] Monique Noirhomme-Fraiture und Paula Brito. „Weit über die klassischen Datenmodelle hinaus: Symbolische Datenanalyse“. Statistische Analyse und Data Mining: ASA Data Science Journal 4, 157–170 (2011). URL: doi.org/10.1002/sam.10112.

https:///doi.org/10.1002/sam.10112

[21] Adrián Pérez-Salinas, Alba Cervera-Lierta, Elies Gil-Fuster und José I. Latorre. „Erneutes Hochladen von Daten für einen universellen Quantenklassifikator“. Quantum 4, 226 (2020). URL: doi.org/10.22331/q-2020-02-06-226.

https://doi.org/10.22331/q-2020-02-06-226

[22] Kosuke Mitarai, Makoto Negoro, Masahiro Kitagawa und Keisuke Fujii. „Quantenschaltungslernen“. Physical Review A 98, 032309 (2018).

https: / / doi.org/ 10.1103 / PhysRevA.98.032309

[23] Maria Schuld, Ville Bergholm, Christian Gogolin, Josh Izaac und Nathan Killoran. „Auswertung analytischer Gradienten auf Quantenhardware“. Physical Review A 99, 032331 (2019).

https: / / doi.org/ 10.1103 / PhysRevA.99.032331

[24] Maria Schuld und Francesco Petruccione. „Quantenmodelle als Kernmethoden“. Im maschinellen Lernen mit Quantencomputern. Seiten 217–245. Springer (2021).

[25] Maria Schuld, Ryan Sweke und Johannes Jakob Meyer. "Auswirkung der Datencodierung auf die Ausdruckskraft von Variationsmodellen für Quantenmaschinenlernen". Physical Review A 103, 032430 (2021).

https: / / doi.org/ 10.1103 / PhysRevA.103.032430

[26] Iris Cong, Soonwon Choi und Mikhail D. Lukin. „Quantenfaltungsneuronale Netze“. Naturphysik 15, 1273–1278 (2019).

[27] Jarrod R. McClean, Sergio Boixo, Vadim N. Smelyanskiy, Ryan Babbush und Hartmut Neven. „Karge Plateaus in Trainingslandschaften für quantenneuronale Netze“. Naturkommunikation 9, 1–6 (2018). URL: doi.org/10.1038/s41467-018-07090-4.

https://doi.org/10.1038/s41467-018-07090-4

[28] Carlos Ortiz Marrero, Mária Kieferová und Nathan Wiebe. „Verschränkungsinduzierte karge Plateaus“. PRX Quantum 2, 040316 (2021). URL: doi.org/10.1103/PRXQuantum.2.040316.

https: / / doi.org/ 10.1103 / PRXQuantum.2.040316

[29] Marco Cerezo, Akira Sone, Tyler Volkoff, Lukasz Cincio und Patrick J. Coles. "Kostenfunktionsabhängige unfruchtbare Plateaus in flachen parametrisierten Quantenschaltkreisen". Naturkommunikation 12, 1–12 (2021). URL: doi.org/10.1038/s41467-021-21728-w.

https: / / doi.org/ 10.1038 / s41467-021-21728-w

[30] Kunal Sharma, Marco Cerezo, Lukasz Cincio und Patrick J. Coles. „Trainierbarkeit dissipativer Perzeptron-basierter quantenneuronaler Netze“. Physical Review Letters 128, 180505 (2022). URL: doi.org/10.1103/PhysRevLett.128.180505.

https://doi.org/ 10.1103/PhysRevLett.128.180505

[31] S Johri, S Debnath, A Mocherla, A Singh, A Prakash, J Kim und I Kerenidis. „Klassifizierung des nächsten Schwerpunkts auf einem Quantencomputer mit eingeschlossenen Ionen“ (2021).

[32] Kui Jia, Shuai Li, Yuxin Wen, Tongliang Liu und Dacheng Tao. „Orthogonale tiefe neuronale Netze“. IEEE-Transaktionen zu Musteranalyse und maschineller Intelligenz (2019).

https: / / doi.org/ 10.1109 / TPAMI.2019.2948352

[33] Jiayun Wang, Yubei Chen, Rudrasis Chakraborty und Stella X Yu. „Orthogonale Convolutional Neural Networks“. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. Seiten 11505–11515. (2020).

https:///doi.org/10.1109/CVPR42600.2020.01152

[34] Nitin Bansal, Xiaohan Chen und Zhangyang Wang. „Können wir mehr aus Orthogonalitätsregularisierungen beim Training tiefer Netzwerke gewinnen?“. Fortschritte in neuronalen Informationsverarbeitungssystemen 31 (2018).

https: / / doi.org/ 10.5555 / 3327144.3327339

[35] Xiaohua Zhai, Alexander Kolesnikov, Neil Houlsby und Lucas Beyer. „Skalierende Visionstransformatoren“ (2021).

[36] Iordanis Kerenidis und Anupam Prakash. „Quantenmaschinelles Lernen mit Subraumzuständen“ (2022). URL: doi.org/10.48550/arXiv.2202.00054.

https:///doi.org/10.48550/arXiv.2202.00054

[37] Sergi Ramos-Calderer, Adrián Pérez-Salinas, Diego García-Martín, Carlos Bravo-Prieto, Jorge Cortada, Jordi Planagumà und José I. Latorre. „Quantum Unary Approach to Options Pricing“ (2019).

https: / / doi.org/ 10.1103 / PhysRevA.103.032414

[38] Nikodem Grzesiak, Reinhold Blümel, Kenneth Wright, Kristin M. Beck, Neal C. Pisenti, Ming Li, Vandiver Chaplin, Jason M. Amini, Shantanu Debnath, Jwo-Sy Chen und Yunseong Nam. "Effizientes willkürliches gleichzeitiges Verschränken von Gates auf einem Quantencomputer mit eingeschlossenen Ionen". Nat Commun, 11 (2020).

https://doi.org/10.1038/s41467-020-16790-9

[39] Alexander Zlokapa, Hartmut Neven und Seth Lloyd. „Ein Quantenalgorithmus zum Trainieren breiter und tiefer klassischer neuronaler Netze“ (2021). URL: doi.org/10.48550/arXiv.2107.09200.

https:///doi.org/10.48550/arXiv.2107.09200

[40] Mario Lezcano-Casado und David Martinez-Rubio. "Günstige orthogonale Einschränkungen in neuronalen Netzen: Eine einfache Parametrisierung der orthogonalen und einheitlichen Gruppe". In der Internationalen Konferenz für maschinelles Lernen. Seiten 3794–3803. PMLR (2019). URL: doi.org/10.48550/arXiv.1901.08428.

https:///doi.org/10.48550/arXiv.1901.08428

[41] Moshe Leshno, Vladimir Ya Lin, Allan Pinkus und Shimon Schocken. "Mehrschichtige Feedforward-Netzwerke mit einer nichtpolynomialen Aktivierungsfunktion können sich jeder Funktion annähern". Neuronale Netze 6, 861–867 (1993).

https://doi.org/10.1016/S0893-6080(05)80131-5

[42] Robert Hecht-Nielsen. "Theorie des Backpropagation Neural Network". In Neuronale Netze für die Wahrnehmung. Seiten 65–93. Elsevier (1992).

https:///doi.org/10.1109/IJCNN.1989.118638

[43] Raúl Rojas. „Der Backpropagation-Algorithmus“. In neuronalen Netzen. Seiten 149–182. Springer (1996).

https://doi.org/10.1007/978-3-642-61068-4_7

[44] Jiancheng Yang, Rui Shi und Bingbing Ni. „Medizinischer Klassifikations-Zehnkampf: Ein leichter Automl-Benchmark für die medizinische Bildanalyse“ (2020).

https:///doi.org/10.1109/ISBI48211.2021.9434062

[45] Daniel S. Kermany, Michael Goldbaum und et al. „Erkennung medizinischer Diagnosen und behandelbarer Krankheiten durch bildbasiertes Deep Learning“. Zelle, Bd. 172, Nr. 5, S. 1122 – 1131.e9, (2018).

https:///doi.org/10.1016/j.cell.2018.02.010

[46] Ping Zhang und Bin Sheng. „Deepdr diabetic retinopathy image dataset (deepdrid), „die 2. diabetische Retinopathie – Herausforderung zur Einstufung und Bildqualitätsschätzung““. https:///isbi.deepdr.org/data.html (2020).

https:///isbi.deepdr.org/data.html~

[47] Hyeonwoo Noh, Tackgeun You, Jonghwan Mun und Bohyung Han. "Regulierung tiefer neuronaler Netze durch Rauschen: Seine Interpretation und Optimierung". NeurIPS (2017).

https: / / doi.org/ 10.5555 / 3295222.3295264

[48] Xue-Ying. „Ein Überblick über Overfitting und seine Lösungen“. In Journal of Physics: Konferenzreihe. Band 1168, Seite 022022. IOP Publishing (2019).

https://doi.org/10.1088/1742-6596/1168/2/022022

[49] El Amine Cherrat, Iordanis Kerenidis, Natansh Mathur, Jonas Landman, Martin Strahm und Yun Yvonna Li. „Quantum Vision Transformers“ (2022).

[50] Scott Aaronson. „Lesen Sie das Kleingedruckte“. Naturphysik 11, 291–293 (2015).

https: / / doi.org/ 10.1038 / nphys3272

[51] Michael A. Nielsen. „Neuronale Netze und Deep Learning“. Bestimmungspresse (2015).

Zitiert von

Dieses Papier ist in Quantum unter dem veröffentlicht Creative Commons Namensnennung 4.0 International (CC BY 4.0) Lizenz. Das Copyright verbleibt bei den ursprünglichen Copyright-Inhabern wie den Autoren oder deren Institutionen.