Einleitung

Forscher der künstlichen Intelligenz haben eine Reihe von Erfolgen mit gefeiert Neuronale Netze, Computerprogramme, die grob nachahmen, wie unser Gehirn organisiert ist. Aber trotz des schnellen Fortschritts bleiben neuronale Netze relativ unflexibel und können sich kaum spontan ändern oder an ungewohnte Umstände anpassen.

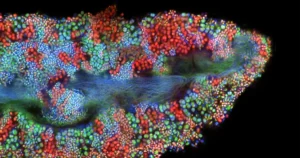

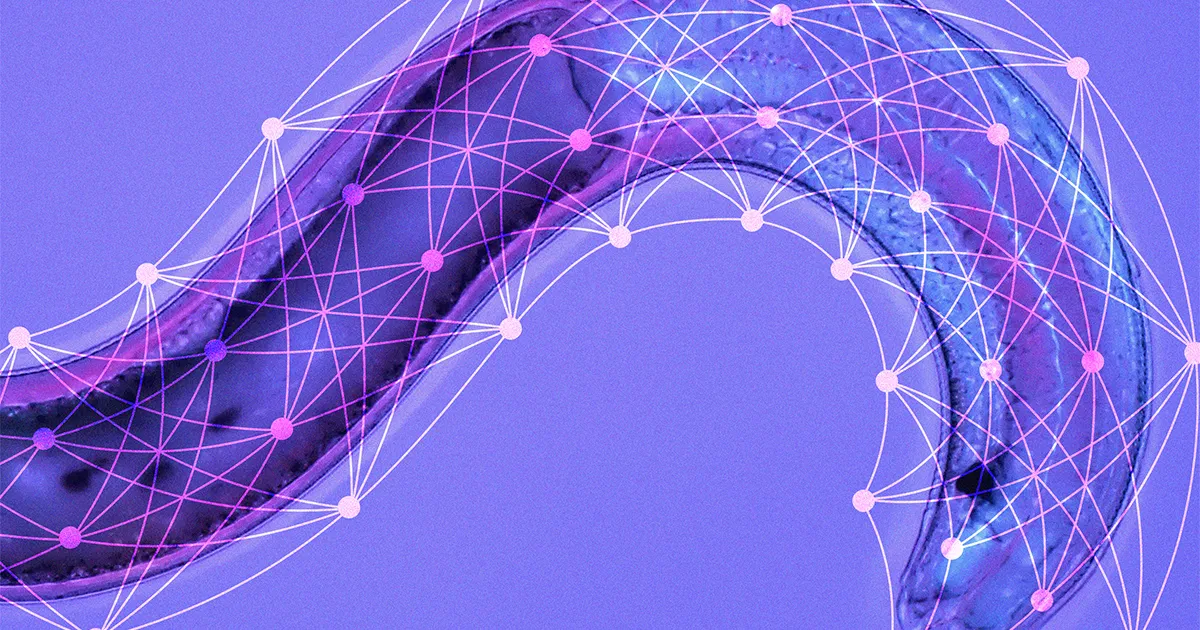

Im Jahr 2020 leiteten zwei Forscher am Massachusetts Institute of Technology ein Team, das einführte eine neue Art von neuronalem Netzwerk basierend auf echter Intelligenz – aber nicht unserer eigenen. Stattdessen ließen sie sich von dem winzigen Spulwurm inspirieren, Caenorhabditis elegans, um sogenannte flüssige neuronale Netze zu produzieren. Nach einem Durchbruch im vergangenen Jahr könnten die neuartigen Netzwerke nun vielseitig genug sein, um ihre traditionellen Gegenstücke für bestimmte Anwendungen zu ersetzen.

Flüssige neuronale Netze bieten „eine elegante und kompakte Alternative“, heißt es Ken Goldberg, ein Robotiker an der University of California, Berkeley. Er fügte hinzu, dass Experimente bereits zeigen, dass diese Netzwerke schneller und genauer laufen können als andere sogenannte zeitkontinuierliche neuronale Netzwerke, die Systeme modellieren, die sich im Laufe der Zeit verändern.

Ramin Hasani und Matthias Lechner, die treibenden Kräfte hinter dem neuen Design, haben das schon vor Jahren erkannt C. elegans könnte ein idealer Organismus sein, um herauszufinden, wie man widerstandsfähige neuronale Netzwerke herstellt, die Überraschungen aufnehmen können. Der millimeterlange Bodenfresser gehört zu den wenigen Kreaturen mit einem vollständig kartierten Nervensystem und ist zu einer Reihe fortgeschrittener Verhaltensweisen fähig: sich bewegen, Nahrung finden, schlafen, sich paaren und sogar aus Erfahrung lernen. „Es lebt in der realen Welt, wo ständig Veränderungen stattfinden, und es kann unter fast allen Bedingungen, denen es ausgesetzt ist, gute Leistungen erbringen“, sagte Lechner.

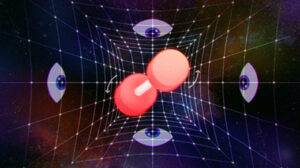

Der Respekt vor dem niederen Wurm führte ihn und Hasani zu ihren neuen flüssigen Netzwerken, in denen jedes Neuron von einer Gleichung gesteuert wird, die sein Verhalten im Laufe der Zeit vorhersagt. Und so wie Neuronen miteinander verbunden sind, hängen diese Gleichungen voneinander ab. Das Netzwerk löst im Wesentlichen dieses gesamte Ensemble verknüpfter Gleichungen und ermöglicht es ihm, den Zustand des Systems zu jedem beliebigen Zeitpunkt zu charakterisieren – eine Abkehr von herkömmlichen neuronalen Netzwerken, die die Ergebnisse nur zu bestimmten Zeitpunkten liefern.

„[Sie] können dir nur nach einer, zwei oder drei Sekunden sagen, was passiert“, sagte Lechner. „Aber ein zeitkontinuierliches Modell wie unseres kann beschreiben, was bei 0.53 Sekunden oder 2.14 Sekunden oder jeder anderen von Ihnen gewählten Zeit vor sich geht.“

Liquid Networks unterscheiden sich auch darin, wie sie Synapsen behandeln, die Verbindungen zwischen künstlichen Neuronen. Die Stärke dieser Verbindungen in einem standardmäßigen neuronalen Netzwerk kann durch eine einzelne Zahl, ihr Gewicht, ausgedrückt werden. In flüssigen Netzwerken ist der Signalaustausch zwischen Neuronen ein probabilistischer Prozess, der von einer „nichtlinearen“ Funktion bestimmt wird, was bedeutet, dass Reaktionen auf Eingaben nicht immer proportional sind. Eine Verdoppelung des Inputs könnte beispielsweise zu einer viel größeren oder kleineren Verschiebung des Outputs führen. Diese eingebaute Variabilität ist der Grund, warum die Netzwerke „flüssig“ genannt werden. Die Art und Weise, wie ein Neuron reagiert, kann abhängig von der Eingabe, die es erhält, variieren.

Einleitung

Während die Algorithmen im Herzen traditioneller Netzwerke während des Trainings festgelegt werden, sind flüssige neuronale Netze anpassungsfähiger, wenn diese Systeme mit Unmengen von Daten gefüttert werden, um die besten Werte für ihre Gewichte zu kalibrieren. „Sie sind in der Lage, ihre zugrunde liegenden Gleichungen basierend auf dem Input, den sie beobachten, zu ändern“, sagte sie Daniela Rus, der Direktor des Computer Science and Artificial Intelligence Laboratory des MIT.

Ein früher Test, um diese Fähigkeit zu demonstrieren, bestand darin, zu versuchen, ein autonomes Auto zu steuern. Ein herkömmliches neuronales Netz könnte die visuellen Daten der Autokamera nur in festen Intervallen auswerten. Das flüssige Netzwerk – bestehend aus 19 Neuronen und 253 Synapsen (was es nach den Maßstäben des maschinellen Lernens winzig macht) – könnte es sein viel reaktionsschneller. „Unser Modell kann häufiger Proben nehmen, zum Beispiel wenn die Straße kurvenreich ist“, sagte Rus, ein Co-Autor dieses und mehrerer anderer Artikel über flüssige Netzwerke.

Das Modell hielt das Auto erfolgreich in der Spur, aber es hatte einen Fehler, sagte Lechner: „Es war wirklich langsam.“ Das Problem ergab sich aus den nichtlinearen Gleichungen, die die Synapsen und Neuronen darstellen – Gleichungen, die normalerweise nicht ohne wiederholte Berechnungen auf einem Computer gelöst werden können, der mehrere Iterationen durchläuft, bevor er schließlich zu einer Lösung zusammenläuft. Diese Aufgabe wird normalerweise an dedizierte Softwarepakete namens Solver delegiert, die auf jede Synapse und jedes Neuron separat angewendet werden müssten.

In einer Papier letztes Jahrenthüllte das Team ein neues flüssiges neuronales Netzwerk, das diesen Engpass umging. Dieses Netzwerk stützte sich auf die gleiche Art von Gleichungen, aber der entscheidende Fortschritt war eine Entdeckung von Hasani, dass diese Gleichungen nicht durch mühsame Computerberechnungen gelöst werden mussten. Stattdessen könnte das Netzwerk mit einer nahezu exakten oder „geschlossenen“ Lösung funktionieren, die im Prinzip mit Bleistift und Papier ausgearbeitet werden könnte. Typischerweise haben diese nichtlinearen Gleichungen keine Lösungen in geschlossener Form, aber Hasani stieß auf eine Näherungslösung, die gut genug war, um sie zu verwenden.

„Eine geschlossene Lösung zu haben bedeutet, dass Sie eine Gleichung haben, für die Sie die Werte für ihre Parameter einsetzen und die grundlegende Mathematik durchführen können, und Sie erhalten eine Antwort“, sagte Rus. „Sie erhalten eine Antwort in einem einzigen Schuss“, anstatt einen Computer herumschleifen zu lassen, bis er entscheidet, dass er nah genug ist. Das spart Rechenzeit und -energie und beschleunigt den Prozess erheblich.

„Ihre Methode schlägt die Konkurrenz um mehrere Größenordnungen, ohne die Genauigkeit zu opfern“, sagte er Sajan Mitra, Informatiker an der University of Illinois, Urbana-Champaign.

Ihre neuesten Netzwerke sind laut Hasani nicht nur schneller, sondern auch ungewöhnlich stabil, was bedeutet, dass das System enorme Eingaben bewältigen kann, ohne drunter und drüber zu gehen. „Der Hauptbeitrag hier ist, dass Stabilität und andere schöne Eigenschaften durch ihre schiere Struktur in diese Systeme eingebrannt werden“, sagte er Sriram Sankaranarayanan, Informatiker an der University of Colorado, Boulder. Flüssige Netzwerke scheinen in dem zu operieren, was er „den Sweet Spot“ nannte: Sie sind komplex genug, um interessante Dinge passieren zu lassen, aber nicht so komplex, dass sie zu chaotischem Verhalten führen.

Derzeit testet die MIT-Gruppe ihr neuestes Netzwerk an einer autonomen Flugdrohne. Obwohl die Drohne darauf trainiert wurde, in einem Wald zu navigieren, haben sie sie in die städtische Umgebung von Cambridge gebracht, um zu sehen, wie sie mit neuartigen Bedingungen umgeht. Lechner nannte die vorläufigen Ergebnisse ermutigend.

Neben der Verfeinerung des aktuellen Modells arbeitet das Team auch daran, die Architektur seines Netzwerks zu verbessern. Der nächste Schritt, so Lechner, „besteht darin, herauszufinden, wie viele oder wie wenige Neuronen wir tatsächlich brauchen, um eine bestimmte Aufgabe zu erfüllen.“ Die Gruppe will auch einen optimalen Weg finden, Neuronen zu verbinden. Derzeit ist jedes Neuron mit jedem anderen Neuron verknüpft, aber so funktioniert es nicht C. elegans, wo synaptische Verbindungen selektiver sind. Durch weitere Untersuchungen des Leitungssystems des Spulwurms hoffen sie herauszufinden, welche Neuronen in ihrem System miteinander gekoppelt werden sollten.

Abgesehen von Anwendungen wie autonomes Fahren und Fliegen scheinen flüssige Netzwerke gut geeignet für die Analyse von Stromnetzen, Finanztransaktionen, Wetter und anderen zeitlich schwankenden Phänomenen. Darüber hinaus, sagte Hasani, kann die neueste Version von Flüssigkeitsnetzwerken verwendet werden, „um Gehirnaktivitätssimulationen in einem Umfang durchzuführen, der zuvor nicht realisierbar war“.

Mitra ist von dieser Möglichkeit besonders fasziniert. „In gewisser Weise ist es poetisch und zeigt, dass diese Forschung den Kreis schließen könnte“, sagte er. „Neuronale Netze entwickeln sich so weit, dass uns die Ideen, die wir der Natur entnommen haben, bald helfen können, die Natur besser zu verstehen.“

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://www.quantamagazine.org/researchers-discover-a-more-flexible-approach-to-machine-learning-20230207/

- 2020

- a

- Fähigkeit

- Fähig

- unterbringen

- Genauigkeit

- genau

- Aktivität

- berührt das Schneidwerkzeug

- hinzugefügt

- Zusatz

- vorantreiben

- advanced

- Nach der

- Algorithmen

- Zulassen

- bereits

- Alternative

- immer

- unter

- Analyse

- analysieren

- und

- beantworten

- Anwendungen

- angewandt

- Ansatz

- Architektur

- um

- künstlich

- künstliche Intelligenz

- versuchen

- Autonom

- basierend

- basic

- Bevor

- hinter

- Sein

- Berkeley

- BESTE

- Besser

- zwischen

- größer

- Boden

- Gehirn

- Gehirnaktivität

- Durchbruch

- eingebaut

- Berechnungen

- Kalifornien

- namens

- Cambridge

- Kamera

- kann keine

- fähig

- Auto

- Gefeiert

- sicher

- Übernehmen

- Ändern

- charakterisieren

- Kreis

- Umstände

- Menu

- Mitverfasser

- Colorados

- Kommen

- Wettbewerb

- Komplex

- Computer

- Computerwissenschaften

- Bedingungen

- Sich zusammenschliessen

- Verbindungen

- Bestehend

- Beitrag

- konventionellen

- konvergierend

- könnte

- gekoppelt

- Strom

- Zur Zeit

- Schnitte

- technische Daten

- Entscheiden

- gewidmet

- Abhängig

- beschreiben

- Design

- Trotz

- Bestimmen

- Entwicklung

- ersinnen

- abweichen

- Direktor

- entdeckt,

- Entdeckung

- Verdoppelung

- Fahren

- Drohne

- im

- jeder

- Früh

- Die elektrische

- ermutigend

- Energie

- enorm

- genug

- Ganz

- Arbeitsumfeld

- Gleichungen

- im Wesentlichen

- Sogar

- schließlich

- Jedes

- Austausch-

- ERFAHRUNGEN

- zum Ausdruck gebracht

- beschleunigt

- Fed

- wenige

- Abbildung

- Revolution

- Suche nach

- fixiert

- Fehler

- flexibel

- Flugkosten

- schwanken

- Nahrung,

- Streitkräfte

- Wald

- häufig

- für

- voller

- voll

- Funktion

- weiter

- bekommen

- GitHub

- ABSICHT

- gegeben

- Goes

- gehen

- gut

- Gruppe an

- Griff

- Griffe

- passieren

- Herz

- Hilfe

- hier

- Hit

- ein Geschenk

- Ultraschall

- Hilfe

- HTTPS

- ideal

- Ideen

- Illinois

- zu unterstützen,

- in

- Varianten des Eingangssignals:

- Inspiration

- Instanz

- beantragen müssen

- Institut

- Intelligenz

- interessant

- eingeführt

- beteiligt

- IT

- Iterationen

- Job

- Wesentliche

- Art

- Labor

- Nachname

- Letztes Jahr

- neueste

- führen

- lernen

- geführt

- Vermietung

- verknüpft

- Links

- Flüssigkeit

- flüssiges Netzwerk

- wenig

- Leben

- Maschine

- Maschinelles Lernen

- Main

- um

- Making

- viele

- Massachusetts

- Massachusetts Institute of Technology

- Mathe

- Bedeutung

- Mittel

- Methode

- MIT

- Modell

- Moment

- Moments

- mehr

- ziehen um

- mehrere

- Natur

- Navigieren

- Need

- Netze

- Netzwerk

- Netzwerke

- neuronale Netzwerk

- Neuronale Netze

- Neuronen

- Neu

- Neueste

- weiter

- Roman

- Anzahl

- beobachten

- bieten

- EINEM

- betreiben

- optimal

- Bestellungen

- Organisiert

- Andere

- besitzen

- Pakete

- Papier

- Papiere

- Parameter

- besondere

- besonders

- Ausführen

- wählen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Points

- Möglichkeit

- Werkzeuge

- sagt voraus,

- Prinzip

- Aufgabenstellung:

- Prozessdefinierung

- produziert

- Programme

- Fortschritt

- immobilien

- Quantamagazin

- schnell

- Angebot

- schnell

- Reagiert

- echt

- realen Welt

- realisiert

- erhält

- verhältnismäßig

- bleiben

- wiederholt

- Darstellen

- Forschungsprojekte

- Forscher

- federnde

- Reagieren

- Die Ergebnisse

- Revealed

- Straße

- rund

- Führen Sie

- opfern

- Said

- gleich

- Skalieren

- Wissenschaft

- Wissenschaftler

- Sekunden

- selektiv

- kompensieren

- mehrere

- verschieben

- sollte

- Vitrine

- Signale

- Single

- langsam

- kleinere

- So

- Software

- Lösung

- Lösungen

- Löst

- speziell

- Spot

- Stabilität

- stabil

- Standard

- Normen

- Bundesstaat

- Schritt

- Stärke

- Struktur

- Es wurden Studien

- Erfolgreich

- Überraschung

- süß

- Synapse

- Synapsen

- System

- Systeme und Techniken

- Aufgabe

- Team

- Technologie

- Test

- Testen

- Das

- Der Staat

- ihr

- nach drei

- Durch

- Zeit

- zu

- gemeinsam

- verfolgen sind

- traditionell

- trainiert

- Ausbildung

- Transaktionen

- behandeln

- typisch

- für

- zugrunde liegen,

- verstehen

- nicht vertraut

- Universität

- University of California

- URBAN

- us

- -

- gewöhnlich

- Werte

- vielseitig

- Version

- Wetter

- webp

- Gewicht

- Was

- welche

- ohne

- gearbeitet

- arbeiten,

- Werk

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- Wurm

- würde

- Jahr

- Jahr

- Du

- Zephyrnet