In diesem Beitrag diskutieren wir Best Practices zur Verbesserung der Leistung Ihrer Computer-Vision-Modelle Benutzerdefinierte Etiketten von Amazon Rekognition. Rekognition Custom Labels ist ein vollständig verwalteter Dienst zum Erstellen benutzerdefinierter Computer-Vision-Modelle für Anwendungsfälle zur Bildklassifizierung und Objekterkennung. Rekognition Custom Labels baut auf den vortrainierten Modellen in auf Amazon-Anerkennung, die bereits mit Millionen von Bildern in vielen Kategorien trainiert wurden. Anstelle von Tausenden von Bildern können Sie mit einem kleinen Satz von Schulungsbildern (ein paar Hundert oder weniger) beginnen, die für Ihren Anwendungsfall spezifisch sind. Rekognition Custom Labels abstrahiert die Komplexität, die mit der Erstellung eines benutzerdefinierten Modells verbunden ist. Es überprüft automatisch die Trainingsdaten, wählt die richtigen ML-Algorithmen aus, wählt den Instanztyp aus, trainiert mehrere Kandidatenmodelle mit verschiedenen Hyperparametereinstellungen und gibt das am besten trainierte Modell aus. Rekognition Custom Labels bietet auch eine benutzerfreundliche Oberfläche von der AWS-Managementkonsole zur Verwaltung des gesamten ML-Workflows, einschließlich der Kennzeichnung von Bildern, dem Trainieren des Modells, dem Bereitstellen des Modells und dem Visualisieren der Testergebnisse.

Es gibt Zeiten, in denen die Genauigkeit eines Modells nicht die beste ist und Sie nicht viele Optionen haben, um die Konfigurationsparameter des Modells anzupassen. Hinter den Kulissen spielen mehrere Faktoren eine Schlüsselrolle, um ein leistungsstarkes Modell zu erstellen, wie z. B. die folgenden:

- Bildwinkel

- Bildauflösung

- Bildseitenverhältnis

- Belichtung

- Klarheit und Lebendigkeit des Hintergrunds

- Farbkontrast

- Beispieldatengröße

Im Folgenden sind die allgemeinen Schritte aufgeführt, die befolgt werden müssen, um ein Rekognition Custom Labels-Modell in Produktionsqualität zu trainieren:

- Überprüfen Sie die Taxonomie – Dies definiert die Liste der Attribute/Elemente, die Sie in einem Bild identifizieren möchten.

- Sammeln Sie relevante Daten – Dies ist der wichtigste Schritt, bei dem Sie relevante Bilder sammeln müssen, die dem ähneln sollten, was Sie in einer Produktionsumgebung sehen würden. Dabei kann es sich um Bilder von Objekten mit unterschiedlichen Hintergründen, Beleuchtungen oder Kamerawinkeln handeln. Anschließend erstellen Sie Trainings- und Testdatensätze, indem Sie die gesammelten Bilder aufteilen. Sie sollten nur reale Bilder als Teil des Testdatensatzes einschließen und keine synthetisch generierten Bilder. Anmerkungen zu den von Ihnen gesammelten Daten sind entscheidend für die Modellleistung. Stellen Sie sicher, dass die Begrenzungsrahmen eng um die Objekte liegen und die Beschriftungen korrekt sind. Wir diskutieren einige Tipps, die Sie beim Erstellen eines geeigneten Datensatzes später in diesem Beitrag berücksichtigen können.

- Überprüfen Sie die Trainingsmetriken – Verwenden Sie die vorherigen Datensätze, um ein Modell zu trainieren, und überprüfen Sie die Trainingsmetriken für F1-Punktzahl, Präzision und Erinnerung. Wir werden später in diesem Beitrag ausführlich darauf eingehen, wie die Trainingsmetriken analysiert werden können.

- Bewerten Sie das trainierte Modell – Verwenden Sie einen Satz unsichtbarer Bilder (die nicht zum Trainieren des Modells verwendet werden) mit bekannten Labels, um die Vorhersagen zu bewerten. Dieser Schritt sollte immer durchgeführt werden, um sicherzustellen, dass das Modell in einer Produktionsumgebung wie erwartet funktioniert.

- Umschulung (optional) – Im Allgemeinen ist das Training eines maschinellen Lernmodells ein iterativer Prozess, um die gewünschten Ergebnisse zu erzielen, ein Computer-Vision-Modell ist nicht anders. Überprüfen Sie die Ergebnisse in Schritt 4, um zu sehen, ob weitere Bilder zu den Trainingsdaten hinzugefügt werden müssen, und wiederholen Sie die obigen Schritte 3 – 5.

In diesem Beitrag konzentrieren wir uns auf die Best Practices rund um das Sammeln relevanter Daten (Schritt 2) und das Auswerten Ihrer trainierten Metriken (Schritt 3), um die Leistung Ihres Modells zu verbessern.

Sammeln Sie relevante Daten

Dies ist die kritischste Phase beim Training eines produktionstauglichen Rekognition Custom Labels-Modells. Insbesondere gibt es zwei Datensätze: Training und Test. Trainingsdaten werden zum Trainieren des Modells verwendet, und Sie müssen sich die Mühe machen, einen geeigneten Trainingssatz zu erstellen. Rekognition Custom Labels-Modelle sind optimiert für F1-Punktzahl auf dem Testdatensatz, um das genaueste Modell für Ihr Projekt auszuwählen. Daher ist es wichtig, einen Testdatensatz zu kuratieren, der der realen Welt ähnelt.

Anzahl der Bilder

Wir empfehlen mindestens 15–20 Bilder pro Etikett. Wenn Sie mehr Bilder mit mehr Variationen haben, die Ihren Anwendungsfall widerspiegeln, wird die Modellleistung verbessert.

Ausgewogener Datensatz

Idealerweise sollte jedes Etikett im Datensatz eine ähnliche Anzahl von Proben haben. Es sollte keine großen Unterschiede in der Anzahl der Bilder pro Etikett geben. Beispielsweise ähnelt ein Datensatz, bei dem die höchste Anzahl von Bildern für ein Etikett 1,000 beträgt, gegenüber 50 Bildern für ein anderes Etikett, einem unausgeglichenen Datensatz. Wir empfehlen, Szenarien mit einem einseitigen Verhältnis von 1:50 zwischen dem Label mit der geringsten Anzahl von Bildern und dem Label mit der höchsten Anzahl von Bildern zu vermeiden.

Unterschiedliche Arten von Bildern

Fügen Sie Bilder in den Trainings- und Testdatensatz ein, die dem ähneln, was Sie in der realen Welt verwenden werden. Wenn Sie beispielsweise Bilder von Wohnzimmern und Schlafzimmern klassifizieren möchten, sollten Sie leere und möblierte Bilder beider Räume einbeziehen.

Das Folgende ist ein Beispielbild eines möblierten Wohnzimmers.

Im Gegensatz dazu ist das Folgende ein Beispiel für ein unmöbliertes Wohnzimmer.

Das Folgende ist ein Beispielbild eines möblierten Schlafzimmers.

Das Folgende ist ein Beispielbild eines unmöblierten Schlafzimmers.

Unterschiedliche Hintergründe

Fügen Sie Bilder mit unterschiedlichen Hintergründen hinzu. Bilder mit natürlichem Kontext können bessere Ergebnisse liefern als ein einfacher Hintergrund.

Das Folgende ist ein Beispielbild des Vorgartens eines Hauses.

Das Folgende ist ein Beispielbild des Vorgartens eines anderen Hauses mit einem anderen Hintergrund.

Unterschiedliche Lichtverhältnisse

Fügen Sie Bilder mit unterschiedlicher Beleuchtung hinzu, damit sie die unterschiedlichen Lichtverhältnisse abdecken, die während der Inferenz auftreten (z. B. mit und ohne Blitz). Sie können auch Bilder mit unterschiedlicher Sättigung, Farbton und Helligkeit einfügen.

Das folgende ist ein Beispielbild einer Blume unter normalem Licht.

Im Gegensatz dazu zeigt das folgende Bild dieselbe Blume unter hellem Licht.

Unterschiedliche Winkel

Fügen Sie Bilder hinzu, die aus verschiedenen Blickwinkeln des Objekts aufgenommen wurden. Dies hilft dem Modell, verschiedene Eigenschaften der Objekte zu lernen.

Die folgenden Bilder zeigen dasselbe Schlafzimmer aus verschiedenen Blickwinkeln.

|

|

Es kann Situationen geben, in denen es nicht möglich ist, Bilder unterschiedlicher Typen aufzunehmen. In diesen Szenarien können synthetische Bilder als Teil des Trainingsdatensatzes generiert werden. Weitere Informationen zu gängigen Bildverbesserungstechniken finden Sie unter Datenerweiterung.

Negative Labels hinzufügen

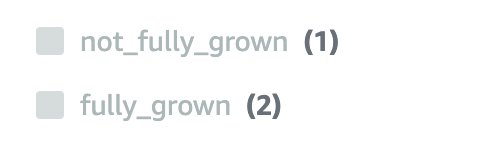

Bei der Bildklassifizierung kann das Hinzufügen negativer Labels helfen, die Modellgenauigkeit zu erhöhen. Sie können beispielsweise ein negatives Label hinzufügen, das mit keinem der erforderlichen Labels übereinstimmt. Das folgende Bild zeigt die verschiedenen Etiketten, die verwendet werden, um ausgewachsene Blumen zu identifizieren.

Hinzufügen des Negativlabels not_fully_grown hilft dem Modell, Merkmale zu lernen, die nicht Teil von sind fully_grown Etikette.

Umgang mit Etikettenverwirrung

Analysieren Sie die Ergebnisse im Testdatensatz, um Muster zu erkennen, die im Trainings- oder Testdatensatz fehlen. Manchmal ist es einfach, solche Muster zu erkennen, indem man die Bilder visuell untersucht. In der folgenden Abbildung kämpft das Modell mit der Entscheidung zwischen einem Hinterhof- und einem Terrassenetikett.

In diesem Szenario kann das Hinzufügen weiterer Bilder zu diesen Beschriftungen im Dataset und auch das Neudefinieren der Beschriftungen, sodass jede Beschriftung unterschiedlich ist, dazu beitragen, die Genauigkeit des Modells zu erhöhen.

Datenerweiterung

Innerhalb von Rekognition Custom Labels führen wir verschiedene Datenerweiterungen für das Modelltraining durch, darunter zufälliges Zuschneiden des Bildes, Farbzittern, zufälliges Gaußsches Rauschen und mehr. Basierend auf Ihren spezifischen Anwendungsfällen kann es auch von Vorteil sein, Ihren Trainingsdaten explizitere Datenerweiterungen hinzuzufügen. Wenn Sie beispielsweise daran interessiert sind, Tiere sowohl in Farb- als auch in Schwarzweißbildern zu erkennen, können Sie möglicherweise eine bessere Genauigkeit erzielen, indem Sie Schwarzweiß- und Farbversionen derselben Bilder zu den Trainingsdaten hinzufügen.

Wir empfehlen keine Erweiterungen für Testdaten, es sei denn, die Erweiterungen spiegeln Ihre Produktionsanwendungsfälle wider.

Überprüfen Sie die Trainingsmetriken

F1-Score, Präzision, Erinnerung und angenommener Schwellenwert sind die Metriken die als Ergebnis des Trainings eines Modells mit Rekognition Custom Labels generiert werden. Die Modelle werden basierend auf dem bereitgestellten Testdatensatz für die beste F1-Punktzahl optimiert. Der angenommene Schwellenwert wird auch basierend auf dem Testdatensatz generiert. Sie können den Schwellenwert basierend auf Ihren Geschäftsanforderungen in Bezug auf Genauigkeit oder Abruf anpassen.

Da die angenommenen Schwellenwerte für das Testdataset festgelegt werden, sollte ein geeignetes Testset den realen Produktionsanwendungsfall widerspiegeln. Wenn der Testdatensatz nicht repräsentativ für den Anwendungsfall ist, sehen Sie möglicherweise künstlich hohe F1-Werte und eine schlechte Modellleistung auf Ihren realen Bildern.

Diese Metriken sind hilfreich, wenn Sie eine anfängliche Bewertung des Modells durchführen. Für ein produktionstaugliches System empfehlen wir, das Modell anhand eines externen Datensatzes (500–1,000 unsichtbare Bilder) zu evaluieren, der für die reale Welt repräsentativ ist. Dies hilft bei der Bewertung, wie das Modell in einem Produktionssystem funktionieren würde, und identifiziert fehlende Muster und korrigiert sie durch erneutes Trainieren des Modells. Wenn Sie eine Diskrepanz zwischen F1-Ergebnissen und externer Bewertung feststellen, empfehlen wir Ihnen zu prüfen, ob Ihre Testdaten den realen Anwendungsfall widerspiegeln.

Zusammenfassung

In diesem Beitrag haben wir Sie durch die Best Practices zur Verbesserung der Rekognition Custom Label-Modelle geführt. Wir empfehlen Ihnen, mehr darüber zu erfahren Erkennung benutzerdefinierter Labels und testen Sie es für Ihre unternehmensspezifischen Datensätze.

Über die Autoren

Amit Gupta ist Senior AI Services Solutions Architect bei AWS. Er setzt sich leidenschaftlich dafür ein, Kunden mit gut durchdachten Lösungen für maschinelles Lernen in großem Umfang zu unterstützen.

Amit Gupta ist Senior AI Services Solutions Architect bei AWS. Er setzt sich leidenschaftlich dafür ein, Kunden mit gut durchdachten Lösungen für maschinelles Lernen in großem Umfang zu unterstützen.

Yogesh Chaturvedi ist Solutions Architect bei AWS mit Schwerpunkt Computer Vision. Er arbeitet mit Kunden zusammen, um ihre geschäftlichen Herausforderungen mithilfe von Cloud-Technologien anzugehen. Außerhalb der Arbeit wandert, reist und schaut er gerne Sport.

Yogesh Chaturvedi ist Solutions Architect bei AWS mit Schwerpunkt Computer Vision. Er arbeitet mit Kunden zusammen, um ihre geschäftlichen Herausforderungen mithilfe von Cloud-Technologien anzugehen. Außerhalb der Arbeit wandert, reist und schaut er gerne Sport.

Ha Yang ist Senior Applied Scientist im Team Amazon Rekognition Custom Labels. Seine Hauptforschungsinteressen sind Objekterkennung und Lernen mit begrenzten Annotationen. Außerhalb der Arbeit schaut Hao gerne Filme, fotografiert und macht Outdoor-Aktivitäten.

Ha Yang ist Senior Applied Scientist im Team Amazon Rekognition Custom Labels. Seine Hauptforschungsinteressen sind Objekterkennung und Lernen mit begrenzten Annotationen. Außerhalb der Arbeit schaut Hao gerne Filme, fotografiert und macht Outdoor-Aktivitäten.

Pashmeen Mistry ist Senior Product Manager für Amazon Rekognition Custom Labels. Außerhalb der Arbeit genießt Pashmeen abenteuerliche Wanderungen, Fotografie und verbringt Zeit mit seiner Familie.

Pashmeen Mistry ist Senior Product Manager für Amazon Rekognition Custom Labels. Außerhalb der Arbeit genießt Pashmeen abenteuerliche Wanderungen, Fotografie und verbringt Zeit mit seiner Familie.

- AI

- Kunst

- KI-Kunstgenerator

- KI-Roboter

- Amazon-Anerkennung

- künstliche Intelligenz

- Zertifizierung für künstliche Intelligenz

- Künstliche Intelligenz im Bankwesen

- Roboter mit künstlicher Intelligenz

- Roboter mit künstlicher Intelligenz

- Software für künstliche Intelligenz

- AWS Maschinelles Lernen

- AWS-Managementkonsole

- Blockchain

- Blockchain-Konferenz ai

- Einfallsreichtum

- dialogorientierte künstliche Intelligenz

- Krypto-Konferenz ai

- Dalls

- tiefe Lernen

- Google Ai

- Mittel (200)

- Maschinelles Lernen

- Plato

- platon ai

- Datenintelligenz von Plato

- Plato-Spiel

- PlatoData

- Platogaming

- Skala ai

- Syntax

- Zephyrnet