Als Stable Diffusion, die KI-Anwendung, die fotorealistische Bilder rendert, vor einigen Wochen ins Rampenlicht rückte, kam ein neues Schlagwort damit auf; Hypernetzwerke.

Nun, Stable Diffusion und Hypernetzwerke sind bereits so miteinander verbunden, dass es unmöglich ist, das eine ohne das andere im selben Absatz zu erwähnen.

„Ich habe stabile Diffusions-Hypernetzwerke mit kleinen Datensätzen trainiert (nein, keine zeitgenössischen Künstler, abgesehen von Ihrem wirklich), um ihm obskure „Stile“ beizubringen, die er nicht wirklich versteht. Es funktioniert genau wie beschrieben, sogar besser als ich selbst gedacht habe“, sagt ein Nutzer auf Twitter.

Ich habe stabile Diffusions-Hypernetzwerke mit kleinen Datensätzen trainiert (nein, keine zeitgenössischen Künstler, abgesehen von Ihrem wirklich), um ihm obskure „Stile“ beizubringen, die er nicht wirklich versteht. Es funktioniert genau so, wie er es beschrieben hat, sogar besser als ich selbst gedacht hatte.

— Maximierer des Bedauerns (@regretmaximizer) 20. Dezember 2022

Dies verkörpert das Hypernetwork-Buzz, das die Internetnutzer in letzter Zeit packt.

In der Informatik ist ein Hypernetzwerk technisch gesehen ein Netzwerk, das Gewichtungen für ein Hauptnetzwerk generiert. Mit anderen Worten, es wird angenommen, dass das Verhalten des Hauptnetzwerks das gleiche wie bei anderen neuronalen Netzwerken ist, da es lernt, einige Roheingaben ihren gewünschten Zielen zuzuordnen, während das Hypernetzwerk eine Reihe von Eingaben nimmt, die Informationen über die Struktur der Gewichte enthalten, und generiert das Gewicht für diese Schicht.

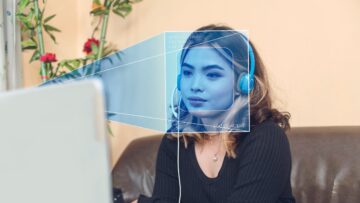

Lesen Sie auch: KI-Technologie, die lebenszerstörende Deep Fake-Bilder erstellt

Wie werden Hypernetzwerke eingesetzt?

Um zu verstehen, was ein Hypernetzwerk ist, gehen wir ein wenig zurück. Wenn Sie Bilder auf Stable Diffusion – dem KI-Tool zum Erstellen digitaler Kunst und Bilder – erstellt haben, sind Sie darauf gestoßen.

Training bezieht sich im Allgemeinen auf einen Prozess, bei dem ein Modell gute Werte für alle Gewichtungen und den Bias aus gekennzeichneten Beispielen lernt (bestimmt).

Erstellen von Bildern auf Stable Diffusion ist kein automatischer Prozess, wie wir bereits erwähnt haben anderswo. Um dorthin zu gelangen, gibt es Prozesse.

Zunächst muss ein KI-Modell lernen, wie man ein Bild von jemandem per Software aus einem 2D- oder 3D-Modell in ein Foto rendert oder synthetisiert. Obwohl das Stable Diffusion-Modell gründlich getestet wurde, weist es einige Trainingseinschränkungen auf, die durch Einbettung und Hypernetwork-Trainingsmethoden korrigiert werden können.

Um die besten Ergebnisse zu erzielen, können Endbenutzer zusätzliche Schulungen durchführen, um die Generierungsausgaben an spezifischere Anwendungsfälle anzupassen. Ein „Einbettungs“-Training umfasst eine Sammlung von vom Benutzer bereitgestellten Bildern und ermöglicht es dem Modell, visuell ähnliche Bilder zu erstellen, wann immer der Name der Einbettung innerhalb einer Generierungsaufforderung verwendet wird.

Einbettungen basieren auf dem von Forschern der Universität Tel Aviv entwickelten Konzept der „textuellen Inversion“, bei dem Vektordarstellungen für bestimmte Token, die vom Textcodierer des Modells verwendet werden, mit neuen Pseudowörtern verknüpft werden. Das Einbetten kann Verzerrungen innerhalb des ursprünglichen Modells reduzieren oder visuelle Stile nachahmen.

Ein „Hypernetzwerk“ hingegen ist ein vortrainiertes neuronales Netzwerk, das auf verschiedene Punkte innerhalb eines größeren neuronalen Netzwerks angewendet wird, und bezieht sich auf die vom NovelAI-Entwickler Kurumuz im Jahr 2021 entwickelte Technik, die ursprünglich für Transformatormodelle zur Textgenerierung gedacht war .

Trainiert bestimmte Künstler

Hypernetzwerke sind enthalten, um die Ergebnisse in eine bestimmte Richtung zu lenken, wodurch Stable Diffusion-basierte Modelle die Kunststile bestimmter Künstler replizieren können. Das Netzwerk hat den Vorteil, dass es auch dann arbeiten kann, wenn der Künstler vom Originalmodell nicht erkannt wird, und das Bild dennoch verarbeitet, indem es wichtige Schlüsselbereiche wie Haare und Augen findet und diese Bereiche dann in einem sekundären latenten Raum ausbessert.

„Die Einbettungsebene in Stable Diffusion ist für die Codierung der Eingaben (z. B. der Texteingabeaufforderung und der Klassenbezeichnungen) in niedrigdimensionale Vektoren verantwortlich. Diese Vektoren helfen dabei, das Diffusionsmodell so zu steuern, dass es Bilder erzeugt, die der Eingabe des Benutzers entsprechen“, erklärt Benny Cheung in seinem Blog.

„Die Hypernetwork-Schicht ist eine Möglichkeit für das System, sein eigenes Wissen zu lernen und darzustellen. Es ermöglicht Stable Diffusion, Bilder basierend auf seinen bisherigen Erfahrungen zu erstellen.“

Während die Einbettungsschicht die Eingaben wie Texteingabeaufforderungen und Klassenbezeichnungen in niedrigdimensionale Vektoren codiert, um das Diffusionsmodell bei der Erstellung von Bildern zu unterstützen, die der Eingabe des Benutzers entsprechen, ist die Hypernetzwerkschicht gewissermaßen eine Möglichkeit für das System, seine eigenen zu lernen und darzustellen Wissen.

Mit anderen Worten, es ermöglicht Stable Diffusion, Bilder basierend auf seinen bisherigen Erfahrungen zu erstellen. In Stable Diffusion ist ein Hypernetzwerk eine zusätzliche Ebene, die verarbeitet wird, nachdem ein Bild durch das Modell gerendert wurde. Das Hypernetzwerk neigt dazu, alle Ergebnisse des Modells auf Ihre Trainingsdaten zu verzerren, wodurch das Modell im Wesentlichen „verändert“ wird.

Speichererhalt

Dies bedeutet im Wesentlichen, dass das Hypernetzwerk für die Speicherung von Bildern verantwortlich ist, die das System zuvor generiert hat. Wenn ein Benutzer eine neue Eingabe macht, kann das System sein bereits vorhandenes Wissen verwenden, um ein genaueres Bild zu erstellen. Als solche ermöglichen Hypernetzwerke dem System, schneller zu lernen und sich im Laufe der Zeit zu verbessern.

Dies hat den Vorteil, dass jedes Bild, das etwas enthält, das Ihre Trainingsdaten beschreibt, wie Ihre Trainingsdaten aussieht.

„Wir haben festgestellt, dass das Training mit Embedding einfacher ist als das Training mit einem Hypernetzwerk, um Selbstporträts zu erstellen. Unser Training hat zu guten Ergebnissen geführt, mit denen wir zufrieden sind“, schrieb Cheung.

Welche Feinabstimmungstechnik verwendest du? So etwas wie Hypernetworks oder Textuelle Inversion?

— Mathias Michel (@m91michel) 21. Dezember 2022

Aber es ist eine Technologie, mit der viele noch feilschen. Hypernetzwerke und KI-Generatoren haben gerade erst begonnen, auf die Bedürfnisse und Wünsche der Benutzer einzugehen. Die Benutzeroberflächen und Eingabeaufforderungstechniken werden sich zweifellos schnell weiterentwickeln und vielleicht sogar überzeugen Google unvorbereitet, wie MetaNews vor kurzem abgedeckt.

- AI

- Kunst

- Bitcoin

- Blockchain

- Blockchain-Konformität

- coinbase

- Einfallsreichtum

- Konsens

- Krypto-Konferenz

- Kryptoabbau

- kryptowährung

- dezentralisiert

- tiefe Fälschungen

- DeFi

- Digitale Assets

- Astraleum

- funktions

- Hypernetzwerke

- Maschinelles Lernen

- MetaNews

- nicht fungibler Token

- Plato

- platon ai

- Datenintelligenz von Plato

- PlatoData

- Platogaming

- Vieleck

- Nachweis der Beteiligung

- stabile Diffusion

- Technologie

- W3

- Zephyrnet