Αυτό είναι ένα guest post που γράφτηκε από κοινού με τον Antony Vance από την Intel.

Οι πελάτες αναζητούν πάντα τρόπους για να βελτιώσουν την απόδοση και τους χρόνους απόκρισης του φόρτου εργασίας συμπερασμάτων μηχανικής εκμάθησης (ML) χωρίς να αυξάνουν το κόστος ανά συναλλαγή και χωρίς να θυσιάζουν την ακρίβεια των αποτελεσμάτων. Ενεργοποίηση φόρτου εργασίας ML Amazon Sage Maker τρέξιμο Amazon Elastic Compute Cloud (Amazon EC2) C6i περιπτώσεις με Της Intel Η ανάπτυξη συμπερασμάτων INT8 μπορεί να συμβάλει στην ενίσχυση της συνολικής απόδοσης έως και τέσσερις φορές ανά δολάριο που δαπανάται, ενώ διατηρεί την απώλεια στην ακρίβεια συμπερασμάτων μικρότερη από 1% σε σύγκριση με το FP32 όταν εφαρμόζεται σε συγκεκριμένους φόρτους εργασίας ML. Όταν πρόκειται για την εκτέλεση των μοντέλων σε ενσωματωμένες συσκευές όπου ο παράγοντας μορφής και το μέγεθος του μοντέλου είναι σημαντικά, η κβαντοποίηση μπορεί να βοηθήσει.

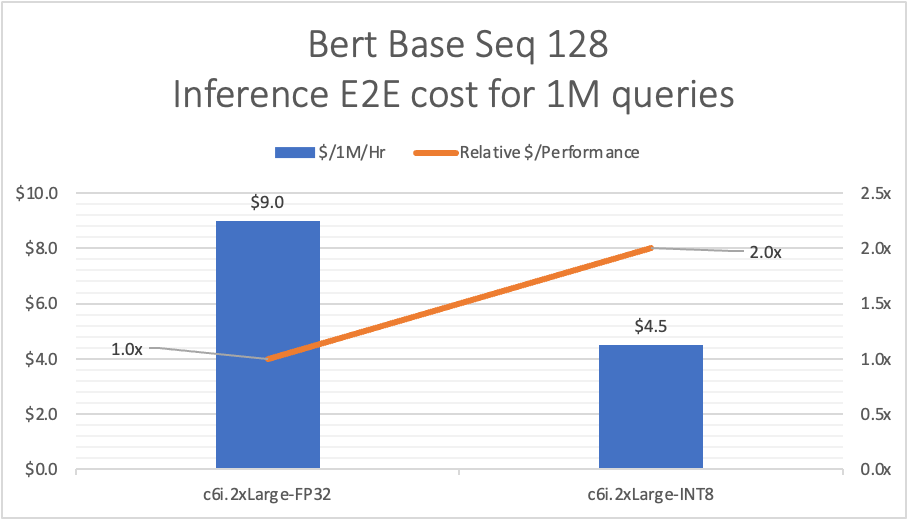

Η κβαντοποίηση είναι μια τεχνική για τη μείωση του υπολογιστικού κόστους και του κόστους μνήμης της εκτέλεσης συμπερασμάτων, αναπαραστώντας τα βάρη και τις ενεργοποιήσεις με τύπους δεδομένων χαμηλής ακρίβειας, όπως ακέραιος αριθμός 8 bit (INT8) αντί της συνηθισμένης κινητής υποδιαστολής 32 bit (FP32). Στο παρακάτω σχήμα παραδείγματος, δείχνουμε την απόδοση συμπερασμάτων INT8 στο C6i για ένα μοντέλο βάσης BERT.

Η βάση BERT βελτιστοποιήθηκε με το SQuAD v1.1, με το PyTorch (v1.11) να είναι το πλαίσιο ML που χρησιμοποιείται με την επέκταση Intel® για PyTorch. Για τη σύγκριση χρησιμοποιήθηκε μέγεθος παρτίδας 1. Τα μεγαλύτερα μεγέθη παρτίδων θα παρέχουν διαφορετικό κόστος ανά 1 εκατομμύριο συμπεράσματα.

Σε αυτήν την ανάρτηση, σας δείχνουμε πώς να δημιουργείτε και να αναπτύσσετε τα συμπεράσματα INT8 με το δικό σας δικό του δοχείο επεξεργασίας για PyTorch. Χρησιμοποιούμε επεκτάσεις Intel για PyTorch για μια αποτελεσματική ροή εργασιών ανάπτυξης INT8.

Επισκόπηση της τεχνολογίας

Στιγμιότυπα EC2 C6i τροφοδοτούνται από επεξεργαστές Intel Xeon Scalable τρίτης γενιάς (ονομάζονται επίσης Ice Lake) με συχνότητα turbo με όλα τα πυρήνα 3.5 GHz.

Στο πλαίσιο της βαθιάς μάθησης, η κυρίαρχη αριθμητική μορφή που χρησιμοποιείται για την έρευνα και την ανάπτυξη ήταν μέχρι στιγμής η κινητή υποδιαστολή 32 bit ή FP32. Ωστόσο, η ανάγκη για μειωμένο εύρος ζώνης και υπολογιστικές απαιτήσεις των μοντέλων βαθιάς μάθησης έχει οδηγήσει την έρευνα στη χρήση αριθμητικών μορφών χαμηλότερης ακρίβειας. Έχει αποδειχθεί ότι τα βάρη και οι ενεργοποιήσεις μπορούν να αναπαρασταθούν χρησιμοποιώντας ακέραιους αριθμούς 8-bit (ή INT8) χωρίς να υποστούν σημαντική απώλεια στην ακρίβεια.

Οι περιπτώσεις EC2 C6i προσφέρουν πολλές νέες δυνατότητες που έχουν ως αποτέλεσμα βελτιώσεις απόδοσης για φόρτους εργασίας AI και ML. Οι περιπτώσεις C6i παρέχουν πλεονεκτήματα απόδοσης σε αναπτύξεις μοντέλων FP32 και INT8. Η εξαγωγή συμπερασμάτων FP32 είναι ενεργοποιημένη με βελτιώσεις AVX-512 και η εξαγωγή συμπερασμάτων INT8 ενεργοποιείται από τις οδηγίες AVX-512 VNNI.

Το C6i είναι πλέον διαθέσιμο στα τελικά σημεία του SageMaker και οι προγραμματιστές θα πρέπει να αναμένουν ότι θα παρέχει υπερδιπλάσιες βελτιώσεις τιμής-απόδοσης για συμπέρασμα INT8 έναντι συμπερασμάτων FP32 και έως και τετραπλάσιες βελτιώσεις απόδοσης σε σύγκριση με το συμπέρασμα FP5 της παρουσίας C32. Ανατρέξτε στο παράρτημα για παράδειγμα λεπτομέρειες και δεδομένα συγκριτικής αξιολόγησης.

Η ανάπτυξη βαθιάς μάθησης στην άκρη για εξαγωγή συμπερασμάτων σε πραγματικό χρόνο είναι το κλειδί σε πολλούς τομείς εφαρμογής. Μειώνει σημαντικά το κόστος επικοινωνίας με το cloud όσον αφορά το εύρος ζώνης του δικτύου, την καθυστέρηση δικτύου και την κατανάλωση ενέργειας. Ωστόσο, οι συσκευές edge έχουν περιορισμένη μνήμη, υπολογιστικούς πόρους και ισχύ. Αυτό σημαίνει ότι ένα δίκτυο βαθιάς εκμάθησης πρέπει να βελτιστοποιηθεί για ενσωματωμένη ανάπτυξη. Η κβαντοποίηση INT8 έχει γίνει μια δημοφιλής προσέγγιση για τέτοιες βελτιστοποιήσεις για πλαίσια ML όπως το TensorFlow και το PyTorch. Το SageMaker σάς παρέχει μια προσέγγιση με το δικό σας κοντέινερ (BYOC) και ενσωματωμένα εργαλεία, ώστε να μπορείτε να εκτελέσετε κβαντοποίηση.

Για περισσότερες πληροφορίες, ανατρέξτε στο Συμπεράσματα και εκπαίδευση σε βάθος μάθησης χαμηλότερης αριθμητικής ακρίβειας.

Επισκόπηση λύσεων

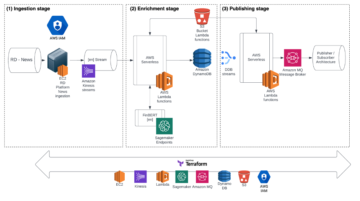

Τα βήματα για την εφαρμογή της λύσης είναι τα εξής:

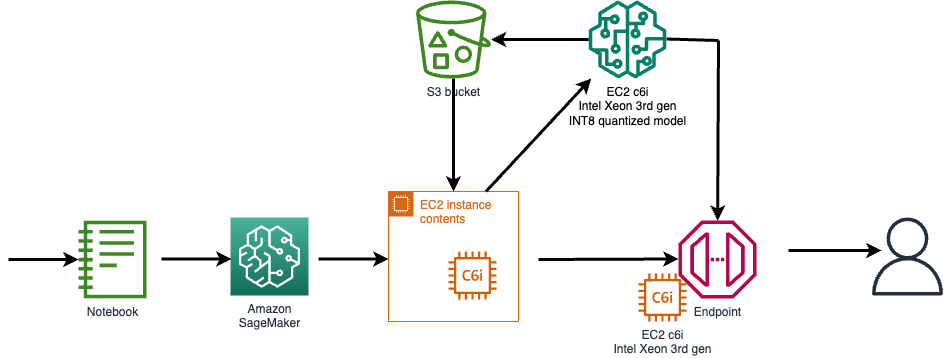

- Παρέχετε ένα στιγμιότυπο EC2 C6i για την κβαντοποίηση και τη δημιουργία του μοντέλου ML.

- Χρησιμοποιήστε τα παρεχόμενα σενάρια Python για κβαντοποίηση.

- Δημιουργήστε μια εικόνα Docker για να αναπτύξετε το μοντέλο στο SageMaker χρησιμοποιώντας την προσέγγιση BYOC.

- Χρησιμοποιήστε ένα Απλή υπηρεσία αποθήκευσης Amazon Κάδος (Amazon S3) για να αντιγράψετε το μοντέλο και τον κωδικό πρόσβασης στο SageMaker.

- Χρήση Μητρώο εμπορευματοκιβωτίων Amazon Elastic (Amazon ECR) για να φιλοξενήσει την εικόνα Docker.

- Χρησιμοποιήστε το Διεπαφή γραμμής εντολών AWS (AWS CLI) για να δημιουργήσετε ένα τελικό σημείο συμπερασμάτων στο SageMaker.

- Εκτελέστε τα παρεχόμενα δοκιμαστικά σενάρια Python για να καλέσετε το τελικό σημείο του SageMaker και για τις εκδόσεις INT8 και FP32.

Αυτή η εγκατάσταση ανάπτυξης συμπερασμάτων χρησιμοποιεί ένα μοντέλο βάσης BERT από το αποθετήριο μετασχηματιστών Hugging Face (csarron/bert-base-uncased-squad-v1).

Προϋποθέσεις

Τα ακόλουθα είναι προαπαιτούμενα για τη δημιουργία της εγκατάστασης ανάπτυξης:

- Ένα τερματικό κελύφους Linux με εγκατεστημένο το AWS CLI

- Ένας λογαριασμός AWS με πρόσβαση στη δημιουργία παρουσίας EC2 (τύπος παρουσίας C6i)

- Πρόσβαση στο SageMaker για ανάπτυξη μοντέλου SageMaker, διαμόρφωση τελικού σημείου, τελικό σημείο

- Διαχείριση ταυτότητας και πρόσβασης AWS (IAM) πρόσβαση για τη διαμόρφωση ενός ρόλου και πολιτικής IAM

- Πρόσβαση στο Amazon ECR

- Πρόσβαση στο SageMaker για τη δημιουργία ενός σημειωματάριου με οδηγίες για την εκκίνηση ενός τελικού σημείου

Δημιουργήστε και αναπτύξτε ένα κβαντισμένο μοντέλο INT8 στο SageMaker

Ανοίξτε ένα στιγμιότυπο EC2 για τη δημιουργία του κβαντισμένου μοντέλου σας και προωθήστε τα τεχνουργήματα του μοντέλου στο Amazon S3. Για ανάπτυξη τελικού σημείου, δημιουργήστε ένα προσαρμοσμένο κοντέινερ με PyTorch και Intel® Extension για PyTorch για να αναπτύξετε το βελτιστοποιημένο μοντέλο INT8. Το κοντέινερ ωθείται στο Amazon ECR και δημιουργείται ένα τελικό σημείο που βασίζεται στο C6i για την εξυπηρέτηση των μοντέλων FP32 και INT8.

Το παρακάτω διάγραμμα απεικονίζει τη ροή υψηλού επιπέδου.

Για πρόσβαση στον κωδικό και την τεκμηρίωση, ανατρέξτε στο GitHub repo.

Παράδειγμα περίπτωσης χρήσης

Το σύνολο δεδομένων Stanford Question Answering (SQuAD) είναι ένα σύνολο δεδομένων με κατανόηση ανάγνωσης που αποτελείται από ερωτήσεις που τίθενται από πλήθος εργαζομένων σε ένα σύνολο άρθρων της Wikipedia, όπου η απάντηση σε κάθε ερώτηση είναι ένα τμήμα κειμένου ή σπιθαμή, από το αντίστοιχο αναγνωστικό απόσπασμα, ή η ερώτηση μπορεί να είναι αναπάντητη.

Το παρακάτω παράδειγμα είναι ένας αλγόριθμος απάντησης ερωτήσεων που χρησιμοποιεί ένα μοντέλο βάσης BERT. Δεδομένου ενός εγγράφου ως εισόδου, το μοντέλο θα απαντήσει σε απλές ερωτήσεις που βασίζονται στη μάθηση και τα συμφραζόμενα από το έγγραφο εισόδου.

Ακολουθεί ένα παράδειγμα εγγράφου εισαγωγής:

Το τροπικό δάσος του Αμαζονίου (πορτογαλικά: Floresta Amazônica ή Amazônia; Ισπανικά: Selva Amazónica, Amazonía ή συνήθως Amazonia; Γαλλικά: Forêt amazonienne; Ολλανδικά: Amazoneregenwoud), επίσης γνωστό στα αγγλικά ως Amazonia ή Amazon Jungle, είναι ένα υγρό πλατύφυλλο δάσος που καλύπτει τα περισσότερα της λεκάνης του Αμαζονίου της Νότιας Αμερικής. Αυτή η λεκάνη περιλαμβάνει 7,000,000 τετραγωνικά χιλιόμετρα (2,700,000 τετραγωνικά μίλια), από τα οποία 5,500,000 τετραγωνικά χιλιόμετρα (2,100,000 τετραγωνικά μίλια) καλύπτονται από το τροπικό δάσος.

Για την ερώτηση "Ποιο όνομα χρησιμοποιείται επίσης για να περιγράψει το τροπικό δάσος του Αμαζονίου στα αγγλικά;" παίρνουμε την απάντηση:

Για την ερώτηση «Πόσα τετραγωνικά χιλιόμετρα τροπικού δάσους καλύπτονται στη λεκάνη;» παίρνουμε την απάντηση:

Κβαντισμός του μοντέλου στο PyTorch

Αυτή η ενότητα παρέχει μια γρήγορη επισκόπηση των βημάτων κβαντοποίησης μοντέλων με επεκτάσεις PyTorch και Intel.

Τα αποσπάσματα κώδικα προέρχονται από ένα παράδειγμα SageMaker.

Ας δούμε αναλυτικά τις αλλαγές για τη συνάρτηση IPEX_quantize στο αρχείο quantize.py.

- Εισαγάγετε επεκτάσεις intel για το PyTorch για βοήθεια με την κβαντοποίηση και τη βελτιστοποίηση και εισαγωγή φακού για χειρισμούς πίνακα:

- Εφαρμόστε βαθμονόμηση μοντέλου για 100 επαναλήψεις. Σε αυτήν την περίπτωση, βαθμονομείτε το μοντέλο με το σύνολο δεδομένων SQuAD:

- Προετοιμάστε εισόδους δειγμάτων:

- Μετατρέψτε το μοντέλο σε μοντέλο INT8 χρησιμοποιώντας την ακόλουθη διαμόρφωση:

- Εκτελέστε δύο επαναλήψεις μπροστινού περάσματος για να ενεργοποιήσετε τις συγχωνεύσεις:

- Ως τελευταίο βήμα, αποθηκεύστε το μοντέλο TorchScript:

εκκαθάριση

Αναφέρομαι στο Repo Github για βήματα για τον καθαρισμό των πόρων AWS που δημιουργήθηκαν.

Συμπέρασμα

Οι νέες περιπτώσεις EC2 C6i σε ένα τελικό σημείο του SageMaker μπορούν να επιταχύνουν την ανάπτυξη συμπερασμάτων έως και 2.5 φορές περισσότερο με την κβαντοποίηση INT8. Η κβαντοποίηση του μοντέλου στο PyTorch είναι δυνατή με μερικά API από τις επεκτάσεις Intel PyTorch. Συνιστάται η κβαντοποίηση του μοντέλου σε περιπτώσεις C6i, έτσι ώστε η ακρίβεια του μοντέλου να διατηρείται στην ανάπτυξη τελικού σημείου. Τα παραδείγματα του SageMaker GitHub repo τώρα παρέχει ένα παράδειγμα αγωγού ανάπτυξης από άκρο σε άκρο για κβαντισμό και φιλοξενία μοντέλων INT8.

Σας ενθαρρύνουμε να δημιουργήσετε ένα νέο μοντέλο ή να μετεγκαταστήσετε ένα υπάρχον μοντέλο χρησιμοποιώντας κβαντισμό INT8 χρησιμοποιώντας τον τύπο παρουσίας EC2 C6i και να δείτε μόνοι σας τα κέρδη απόδοσης.

Ειδοποίηση και αποποιήσεις ευθυνών

Καμία άδεια (ρητή ή σιωπηρή, με estoppel ή με άλλο τρόπο) για δικαιώματα πνευματικής ιδιοκτησίας δεν χορηγείται από αυτό το έγγραφο, με μόνη εξαίρεση ότι ο κωδικός που περιλαμβάνεται σε αυτό το έγγραφο έχει άδεια χρήσης υπό την προϋπόθεση Άδεια ανοιχτού κώδικα BSD Zero-Clause (0BSD)

Παράρτημα

Νέες περιπτώσεις AWS στο SageMaker με υποστήριξη ανάπτυξης INT8

Ο παρακάτω πίνακας παραθέτει παρουσίες SageMaker με και χωρίς DL Boost Υποστήριξη.

| Όνομα παράδειγμα | Κωδικό όνομα Xeon Gen | Το INT8 είναι ενεργοποιημένο; | Ενεργοποίηση DL Boost; |

| ml.c5. xlarge – ml.c5.9xlarge | Skylake/1st | Ναι | Οχι |

| ml.c5.18x μεγέθυνση | Skylake/1st | Ναι | Οχι |

| ml.c6i.1x – 32xlarge | Λίμνη πάγου/3rd | Ναι | Ναι |

Συνοψίζοντας, το INT8 enabled υποστηρίζει τον τύπο δεδομένων και τον υπολογισμό INT8. Το DL Boost ενεργοποιημένο υποστηρίζει το Deep Learning Boost.

Δεδομένα αναφοράς

Ο παρακάτω πίνακας συγκρίνει το κόστος και τη σχετική απόδοση μεταξύ των περιπτώσεων c5 και c6.

Η καθυστέρηση και η απόδοση μετρήθηκαν με 10000 ερωτήματα συμπερασμάτων στα τελικά σημεία του Sage maker.

| E2E Latency of Inference Endpoint and Cost analysis | |||||

| P50(ms) | P90(ms) | Ερωτήματα/Sec | $/1 εκατομμύριο ερωτήματα | Σχετικό $/Απόδοση | |

| C5.2xLarge-FP32 | 76.6 | 125.3 | 11.5 | $10.2 | 1.0x |

| c6i.2xLarge-FP32 | 70 | 110.8 | 13 | $9.0 | 1.1x |

| c6i.2xLarge-INT8 | 35.7 | 48.9 | 25.56 | $4.5 | 2.3x |

Τα μοντέλα INT8 αναμένεται να παρέχουν 2-4 φορές πρακτικές βελτιώσεις απόδοσης με λιγότερο από 1% απώλεια ακρίβειας για τα περισσότερα μοντέλα. Ο παραπάνω πίνακας καλύπτει τον γενικό λανθάνοντα χρόνο (ΒΔ και εφαρμογή επίδειξης)

Ακρίβεια για το μοντέλο βάσης BERT

Ο παρακάτω πίνακας συνοψίζει την ακρίβεια για το μοντέλο INT8 με το σύνολο δεδομένων SQUaD v1.1.

| Μετρικός | FP32 | INT8 |

| Ακριβής αντιστοίχιση | 85.8751 | 85.5061 |

| F1 | 92.0807 | 91.8728 |

Η GitHub repo συνοδεύεται από τα σενάρια για τον έλεγχο της ακρίβειας του συνόλου δεδομένων SQuAD. Αναφέρομαι σε invoke-INT8.py και invoke-FP32.py σενάρια για δοκιμή.

Επέκταση Intel για PyTorch

Η Επέκταση Intel® για PyTorch* (ένα έργο ανοιχτού κώδικα στο GitHub) επεκτείνει το PyTorch με βελτιστοποιήσεις για επιπλέον ενισχύσεις απόδοσης στο υλικό Intel. Οι περισσότερες από τις βελτιστοποιήσεις θα συμπεριληφθούν τελικά στις εκδόσεις PyTorch στο απόθεμα και η πρόθεση της επέκτασης είναι να προσφέρει ενημερωμένες δυνατότητες και βελτιστοποιήσεις για το PyTorch σε υλικό Intel. Παραδείγματα περιλαμβάνουν AVX-512 Vector Neural Network Instructions (AVX512 VNNI) και Intel® Advanced Matrix Extensions (Intel® AMX).

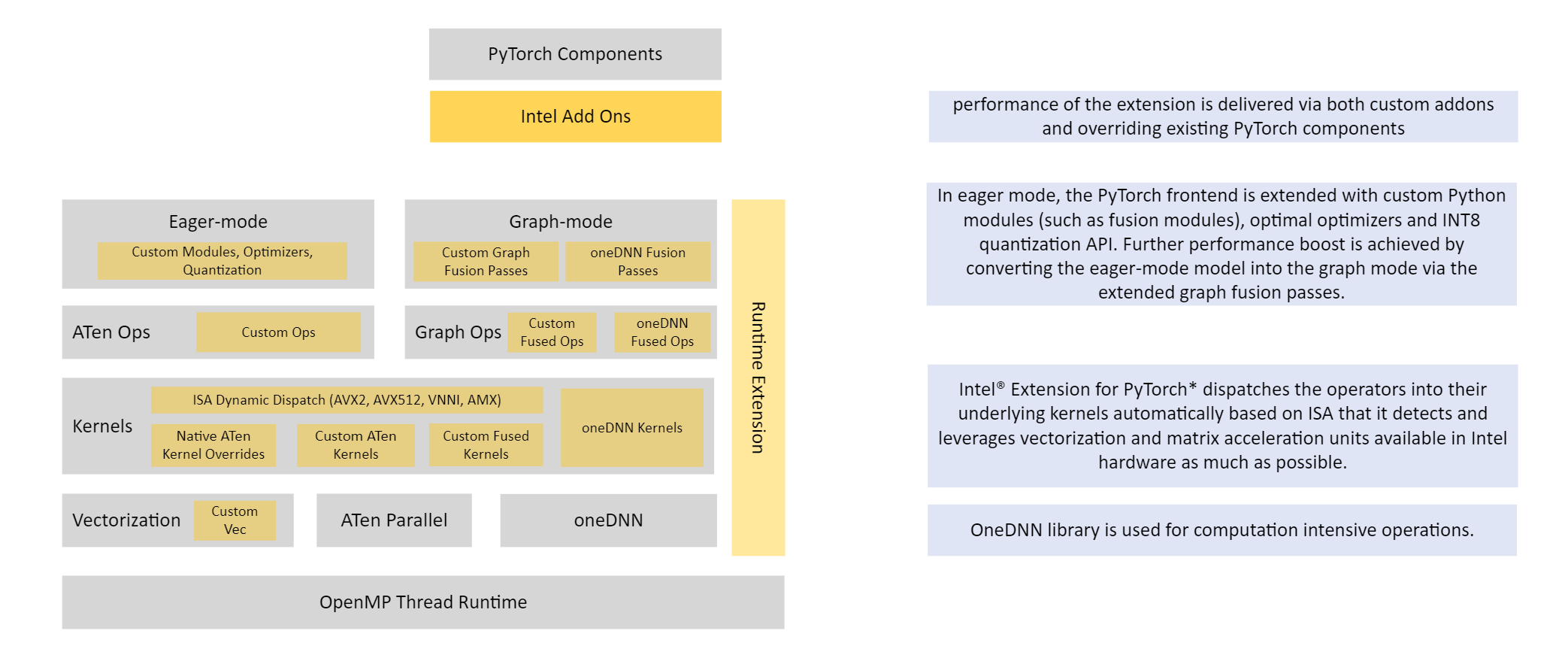

Το παρακάτω σχήμα απεικονίζει την επέκταση Intel για την αρχιτεκτονική PyTorch.

Για πιο λεπτομερείς οδηγίες χρήστη (χαρακτηριστικά, ρύθμιση απόδοσης και άλλα) για την επέκταση Intel® για PyTorch, ανατρέξτε στο Οδηγίες χρήστη Intel® Extension for PyTorch*.

Σχετικά με τους Συγγραφείς

Rohit Chowdary είναι αρχιτέκτονας Sr. Solutions στην ομάδα Strategic Accounts στο AWS.

Rohit Chowdary είναι αρχιτέκτονας Sr. Solutions στην ομάδα Strategic Accounts στο AWS.

Aniruddha Kappagantu είναι Μηχανικός Ανάπτυξης Λογισμικού στην ομάδα AI Platforms στο AWS.

Aniruddha Kappagantu είναι Μηχανικός Ανάπτυξης Λογισμικού στην ομάδα AI Platforms στο AWS.

Άντονι Βανς είναι Αρχιτέκτονας AI στην Intel με 19 χρόνια εμπειρίας στην όραση υπολογιστών, τη μηχανική μάθηση, τη βαθιά μάθηση, το ενσωματωμένο λογισμικό, τη GPU και το FPGA.

Άντονι Βανς είναι Αρχιτέκτονας AI στην Intel με 19 χρόνια εμπειρίας στην όραση υπολογιστών, τη μηχανική μάθηση, τη βαθιά μάθηση, το ενσωματωμένο λογισμικό, τη GPU και το FPGA.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- Platoblockchain. Web3 Metaverse Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- πηγή: https://aws.amazon.com/blogs/machine-learning/accelerate-amazon-sagemaker-inference-with-c6i-intel-based-amazon-ec2-instances/

- :είναι

- $UP

- 000

- 1

- 100

- 11

- 7

- 8

- 9

- a

- πάνω από

- επιταχύνουν

- πρόσβαση

- Λογαριασμός

- Λογαριασμοί

- ακρίβεια

- ενεργοποιήσεις

- προηγμένες

- πλεονεκτήματα

- AI

- αλγόριθμος

- πάντοτε

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Αμερική

- και

- απάντηση

- APIs

- Εφαρμογή

- εφαρμοσμένος

- πλησιάζω

- αρχιτεκτονική

- ΕΙΝΑΙ

- περιοχές

- Παράταξη

- εμπορεύματα

- AS

- At

- διαθέσιμος

- AWS

- εύρος ζώνης

- βασίζονται

- BE

- γίνονται

- είναι

- αναφοράς

- μεταξύ

- ώθηση

- φέρω

- χτίζω

- by

- που ονομάζεται

- CAN

- δυνατότητες

- περίπτωση

- ορισμένες

- Αλλαγές

- έλεγχος

- Backup

- κωδικός

- επικοινωνία

- σύγκριση

- σύγκριση

- υπολογισμός

- Υπολογίστε

- υπολογιστή

- Computer Vision

- χρήση υπολογιστή

- διαμόρφωση

- Αποτελείται από

- κατανάλωση

- Δοχείο

- συμφραζόμενα

- πλαίσια

- Αντίστοιχος

- Κόστος

- Δικαστικά έξοδα

- καλύπτονται

- Καλύμματα

- δημιουργία

- δημιουργήθηκε

- δημιουργία

- δημιουργία

- έθιμο

- ημερομηνία

- βαθύς

- βαθιά μάθηση

- παραδώσει

- κατέδειξε

- παρατάσσω

- ανάπτυξη

- αναπτύξεις

- Συμπληρωματικός

- περιγράφουν

- λεπτομέρεια

- λεπτομερής

- καθέκαστα

- προγραμματιστές

- Ανάπτυξη

- Συσκευές

- διαφορετικές

- Λιμενεργάτης

- έγγραφο

- τεκμηρίωση

- πράξη

- Δολάριο

- οδηγείται

- Ολλανδικά

- άκρη

- Αποτελεσματικός

- ενσωματωμένο

- ενεργοποιήσετε

- ενεργοποιημένη

- περιλαμβάνει

- ενθαρρύνει

- από άκρη σε άκρη

- Τελικό σημείο

- μηχανικός

- Αγγλικά

- τελικά

- Κάθε

- παράδειγμα

- παραδείγματα

- εξαίρεση

- υφιστάμενα

- αναμένω

- αναμένεται

- εμπειρία

- ρητή

- επέκταση

- επεκτάσεις

- επιπλέον

- Πρόσωπο

- Χαρακτηριστικά

- λίγοι

- Εικόνα

- Αρχεία

- επιπλέων

- ροή

- Εξής

- εξής

- Για

- δάσος

- μορφή

- μορφή

- Προς τα εμπρός

- FPGA

- Πλαίσιο

- πλαισίων

- Γαλλικά

- Συχνότητα

- από

- λειτουργία

- κέρδη

- Gen

- παίρνω

- GitHub

- δεδομένου

- δίνει

- Go

- GPU

- χορηγείται

- μεγαλύτερη

- Επισκέπτης

- Κείμενο

- καθοδήγηση

- υλικού

- Έχω

- βοήθεια

- υψηλού επιπέδου

- υψηλότερο

- οικοδεσπότης

- φιλοξενία

- Πως

- Πώς να

- Ωστόσο

- HTML

- http

- HTTPS

- ICE

- Ταυτότητα

- εικόνα

- εφαρμογή

- σιωπηρή

- εισαγωγή

- σημαντικό

- βελτίωση

- βελτίωση

- βελτιώσεις

- in

- περιλαμβάνουν

- περιλαμβάνονται

- αύξηση

- πληροφορίες

- εισαγωγή

- παράδειγμα

- αντί

- οδηγίες

- ενσωματωθεί

- Intel

- διανοούμενος

- πνευματικής ιδιοκτησίας

- Πρόθεση

- IT

- επαναλήψεις

- jpg

- τήρηση

- Κλειδί

- γνωστός

- λίμνη

- Επίθετο

- Αφάνεια

- ξεκινήσει

- μάθηση

- Άδεια

- Άδεια

- Μου αρέσει

- Περιωρισμένος

- γραμμή

- linux

- Λίστες

- κοιτάζοντας

- off

- μηχανή

- μάθηση μηχανής

- κατασκευαστής

- πολοί

- Μήτρα

- μέσα

- Μνήμη

- ενδέχεται να

- μεταναστεύσουν

- εκατομμύριο

- ML

- μοντέλο

- μοντέλα

- περισσότερο

- πλέον

- MS

- όνομα

- Ανάγκη

- δίκτυο

- νευρικό σύστημα

- Νέα

- σημειωματάριο

- of

- προσφορά

- on

- ανοίξτε

- ανοικτού κώδικα

- βελτιστοποίηση

- βελτιστοποιημένη

- OS

- αλλιώς

- φόρμες

- επισκόπηση

- δική

- μονοπάτι

- επίδοση

- αγωγού

- Πλατφόρμες

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- Σημείο

- Δημοφιλής

- Πορτογάλος

- δυνατός

- Θέση

- δύναμη

- τροφοδοτείται

- Πρακτικός

- Ακρίβεια

- προαπαιτούμενα

- μεταποίηση

- επεξεργαστές

- σχέδιο

- περιουσία

- Δικαιώματα ιδιοκτησίας

- παρέχουν

- παρέχεται

- παρέχει

- Σπρώξτε

- πίεσε

- Python

- pytorch

- ερώτηση

- Ερωτήσεις

- Γρήγορα

- Ανάγνωση

- σε πραγματικό χρόνο

- συνιστάται

- μείωση

- Μειωμένος

- μειώνει

- Δελτία

- Αποθήκη

- εκπροσωπούνται

- εκπροσωπούν

- απαιτήσεις

- έρευνα

- Υποστηρικτικό υλικό

- απάντησης

- αποτέλεσμα

- Αποτελέσματα

- δικαιώματα

- Ρόλος

- τρέξιμο

- τρέξιμο

- θυσιάζοντας

- σοφός

- Συμπεράσματα SageMaker

- Αποθήκευση

- επεκτάσιμη

- Εφαρμογές

- Τμήμα

- τμήμα

- εξυπηρετούν

- σειρά

- setup

- κέλυφος

- θα πρέπει να

- δείχνουν

- σημαντικός

- σημαντικά

- Απλούς

- Μέγεθος

- μεγέθη

- So

- μέχρι τώρα

- λογισμικό

- ανάπτυξη λογισμικού

- λύση

- Λύσεις

- Πηγή

- Νότος

- Νότια Αμερική

- Ισπανικά

- πέρασε

- SQ

- πλατεία

- Βήμα

- Βήματα

- στοκ

- χώρος στο δίσκο

- Στρατηγική

- θέμα

- τέτοιος

- συνοψίζω

- παρέχεται

- υποστήριξη

- Υποστηρίζει

- τραπέζι

- tensorflow

- τερματικό

- όροι

- δοκιμή

- Δοκιμές

- ότι

- Η

- τους

- διακίνηση

- φορές

- προς την

- εργαλεία

- δάδα

- συναλλαγή

- μετασχηματιστές

- τύποι

- up-to-ημερομηνία

- χρήση

- Χρήστες

- συνήθως

- όραμα

- τρόπους

- Ποιό

- ενώ

- Wikipedia

- θα

- με

- χωρίς

- χρόνια

- Εσείς

- Σας

- τον εαυτό σας

- zephyrnet