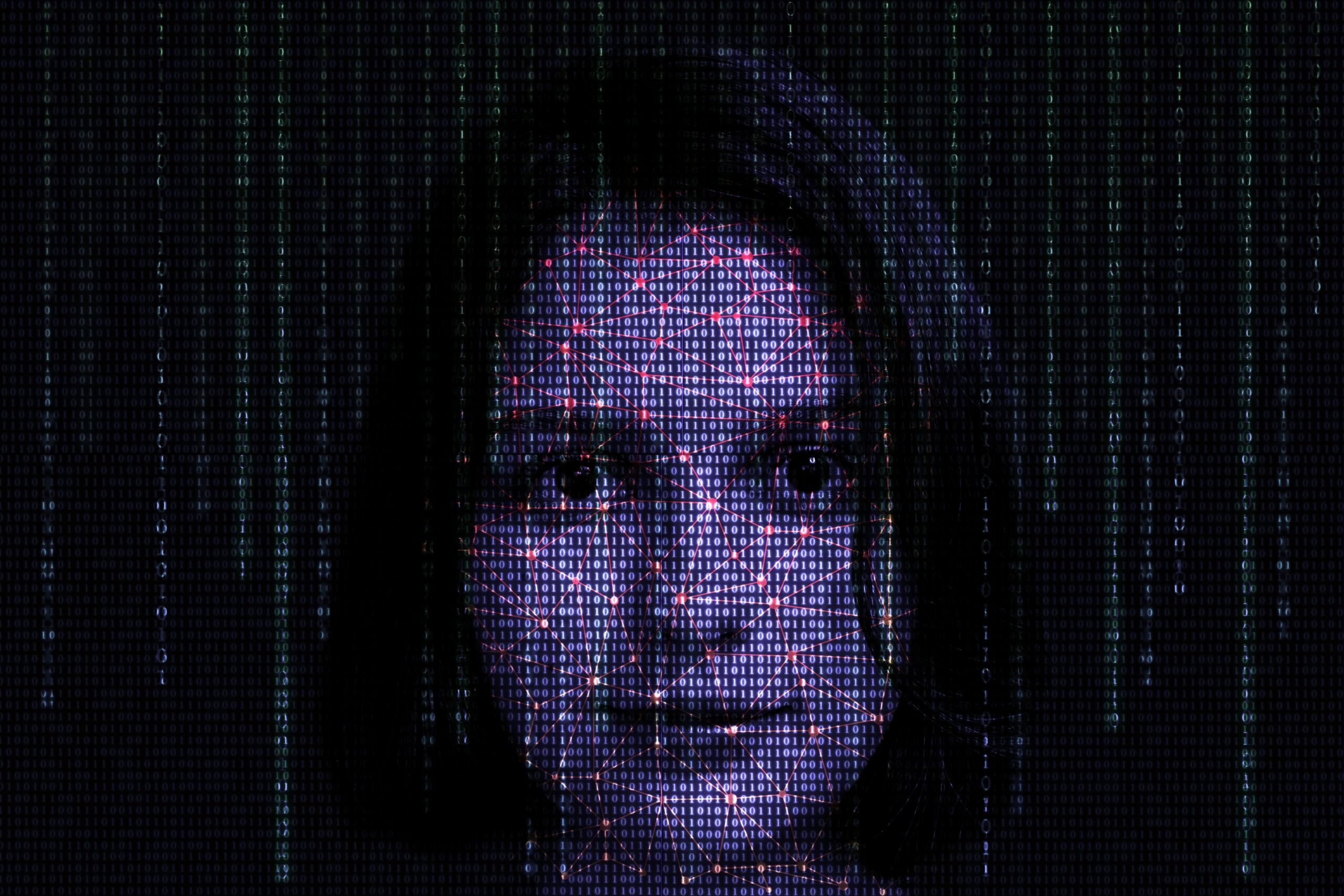

Η τεχνητή νοημοσύνη σηκώνει ξανά το άσχημο κεφάλι της με τους ανθρώπους που «ξεγελιούνται» εύκολα, καθώς μια αυστραλιανή μελέτη δείχνει ότι η τεχνολογία δημιουργεί καυκάσια πρόσωπα πιο αληθινά από τους πραγματικούς ανθρώπους.

Ενώ η τεχνολογία έχει διευκολύνει τον καθένα να είναι καλλιτέχνης, η ίδια τεχνολογία έχει παγίδες που διχάζουν τις απόψεις.

Σύμφωνα με μια μελέτη με επικεφαλής ερευνητές στο Εθνικό Πανεπιστήμιο της Αυστραλίας και που δημοσιεύτηκε στο Psychological Science, οι άνθρωποι πίστευαν ότι τα λευκά πρόσωπα που δημιουργήθηκαν από την τεχνητή νοημοσύνη ήταν ανθρώπινα και πιο αληθινά σε αντίθεση με τα πρόσωπα των πραγματικών ανθρώπων.

Η φυλετική προκατάληψη

Ωστόσο, αυτό ήταν δεν συμβαίνει με τους έγχρωμους εγείροντας φυλετικές ανησυχίες με την τεχνολογία AI. Έκτοτε, η τεχνολογία χαρακτηρίστηκε ως φυλετικά προκατειλημμένη καθώς και φέρουσα προκαταλήψεις διαφόρων μορφών εναντίον ορισμένων ομάδων ανθρώπων.

«Εάν τα λευκά πρόσωπα θεωρούνται σταθερά ως πιο ρεαλιστικά, αυτή η τεχνολογία θα μπορούσε να έχει βαθιές επιπτώσεις για τους έγχρωμους, ενισχύοντας τελικά τις φυλετικές προκαταλήψεις», δήλωσε η Δρ Έιμι Ντάουελ, ανώτερη συγγραφέας της εργασίας.

Ο Δρ Dawel εξήγησε ότι η κραυγαλέα διαφορά μεταξύ των προσώπων που δημιουργούνται από την τεχνητή νοημοσύνη των λευκών και εκείνων των μαύρων ήταν αποτέλεσμα των αλγορίθμων που εκπαιδεύτηκαν δυσανάλογα.

«Αυτό το πρόβλημα είναι ήδη εμφανές στις τρέχουσες τεχνολογίες τεχνητής νοημοσύνης που χρησιμοποιούνται για τη δημιουργία φωτογραφιών με επαγγελματική εμφάνιση.

«Όταν χρησιμοποιείται για έγχρωμους ανθρώπους, το Το AI αλλάζει το δέρμα τους και το χρώμα των ματιών σε αυτά των λευκών ανθρώπων», είπαν οι ερευνητές.

Σε μια ξεχωριστή αλλά σχετική υπόθεση, Αρσενί Ο Alenichev, μεταδιδακτορικός συνεργάτης του Oxford-Johns Hopkins Global Infectious Disease Ethics Collaborative, πειραματιζόταν με μια γεννήτρια εικόνων AI. Όταν ζήτησε μια φωτογραφία ενός μαύρου γιατρού που βοηθάει φτωχά λευκά παιδιά, οι φωτογραφίες απεικόνιζαν πάντα μαύρα παιδιά και λευκούς γιατρούς, παρά τις προδιαγραφές.

Άλλες εικόνες μαύρων επιστημόνων θα το έκαναν έχουν άγρια ζωή σαν καμηλοπαρδάλεις δίπλα τους. Άλλες προσπάθειες έχουν δείξει τρομακτικό και παραμορφωμένο «Εικόνες» μαύρων γυναικών που «χαμογελούν».

Ένα Bloomberg αναφέρουν υποδηλώνει ότι τα μοντέλα AI έχουν επίσης την ικανότητα να διαιωνίζονται στερεότυπα και μπορεί να υποβάλει τους περιθωριοποιημένους σε ανεπιθύμητες καταστάσεις.

Διαβάστε επίσης: Η Σαουδική Αραβία εγκαινιάζει Διεθνές Κέντρο Δεοντολογίας AI

Το κόλπο

Η υποψήφια διδάκτορας του ANU και συν-συγγραφέας της μελέτης, Ελίζαμπεθ Μίλερ, είπε ότι διαπίστωσαν ότι οι περισσότεροι άνθρωποι που συμμετείχαν στην έρευνα ήταν σίγουροι για τις απαντήσεις τους, παρερμηνεύοντας τα πρόσωπα που δημιουργήθηκαν από την τεχνητή νοημοσύνη με αληθινά.

«Αυτό σημαίνει ότι οι άνθρωποι που μπερδεύουν τους απατεώνες τεχνητής νοημοσύνης με πραγματικούς ανθρώπους δεν ξέρουν ότι τους εξαπατούν», είπε.

Σύμφωνα με το The Standard, παρόλο που υπήρχαν κάποιες διαφορές, οι άνθρωποι εξακολουθούσαν να ξεγελούνταν και ο Δρ Dawel έδειξε ότι τα περισσότερα πρόσωπα σε αναλογία ήταν «τυπικά σημάδια ότι η τεχνητή νοημοσύνη είχε δημιουργήσει το πρόσωπο».

Αλλά οι ερωτηθέντες το παρεξήγησαν ως σημάδι ανθρωπιάς.

«Δεν μπορούμε να βασιζόμαστε σε αυτές τις φυσικές ενδείξεις για πολύ. Η τεχνολογία AI προχωρά τόσο γρήγορα που η διαφορά μεταξύ της τεχνητής νοημοσύνης και των ανθρώπινων προσώπων πιθανότατα θα εξαφανιστεί σύντομα», είπε.

Πρόσθεσε ότι αυτό θα μπορούσε να είναι προβληματικό και να έχει τεράστιες συνέπειες όσον αφορά την διαδικτυακή παραπληροφόρηση, deepfakes, και κλοπή ταυτότητας.

Παραπληροφόρηση και απατεώνες

Ο Δρ Dawel πρόσθεσε ότι με αυτήν την έλλειψη διάκρισης μεταξύ ενός προσώπου AI και ενός πραγματικού προσώπου, υπάρχει ανάγκη οι άνθρωποι να είναι προσεκτικοί ή να κινδυνεύουν να εξαπατηθούν από απατεώνες.

«Δεδομένου ότι οι άνθρωποι δεν μπορούν πλέον να ανιχνεύουν πρόσωπα τεχνητής νοημοσύνης, η κοινωνία χρειάζεται εργαλεία που μπορούν να εντοπίσουν με ακρίβεια τους απατεώνες της τεχνητής νοημοσύνης», είπε.

«Η εκπαίδευση των ανθρώπων σχετικά με τον αντιληπτό ρεαλισμό των προσώπων της τεχνητής νοημοσύνης θα μπορούσε να βοηθήσει να γίνει το κοινό κατάλληλα σκεπτικό σχετικά με τις εικόνες που βλέπει στο διαδίκτυο».

Μερικοί ειδικοί στη γενετική τεχνητή νοημοσύνη προβλέψει ότι έως και το 90% του διαδικτυακού περιεχομένου θα μπορούσε να δημιουργηθεί από AI τα επόμενα χρόνια.

Ήδη, με την άνοδο της γενετικής τεχνητής νοημοσύνης και την ικανότητά της να δημιουργεί κείμενο, εικόνες, ήχους και βίντεο, έχει αυξηθεί ο αριθμός των ατόμων που εξαπατήθηκαν να αποκαλύψουν τους αριθμούς της πιστωτικής τους κάρτας.

Οι απατεώνες εξαπατούν επίσης ανυποψίαστους ανθρώπους να στέλνουν χρήματα σε αγνώστους που προσποιούνται ότι είναι μέλη της οικογένειας ή στενοί φίλοι σε προβλήματα και χρειάζονται επείγουσα βοήθεια.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- PlatoHealth. Ευφυΐα βιοτεχνολογίας και κλινικών δοκιμών. Πρόσβαση εδώ.

- πηγή: https://metanews.com/ai-deception-ai-made-caucasian-faces-look-more-real-than-actual-faces/

- :έχει

- :είναι

- 10

- 7

- 8

- a

- ικανότητα

- Σχετικα

- AC

- με ακρίβεια

- πραγματικός

- προστιθέμενη

- προχωρώντας

- πάλι

- κατά

- AI

- Μοντέλα AI

- αλγόριθμοι

- ήδη

- Επίσης

- Αν και

- πάντοτε

- Amy

- an

- και

- απαντήσεις

- κάποιος

- εμφανής

- κατάλληλα

- ΕΙΝΑΙ

- καλλιτέχνης

- AS

- βοηθώντας

- At

- Προσπάθειες

- Αυστραλός

- συγγραφέας

- BE

- ήταν

- είναι

- μεταξύ

- μεροληπτική

- μεροληψίες

- Μαύρη

- Bloomberg

- αλλά

- by

- CAN

- υποψήφιος

- Χωρητικότητα

- κάρτα

- κουβαλάω

- μεταφέρουν

- περίπτωση

- περιπτώσεις

- προσεκτικός

- Κέντρο

- ορισμένες

- Κλεισιμο

- CO

- Συν-Συγγραφέας

- συνεργατική

- χρώμα

- Πιθανά ερωτήματα

- βέβαιος

- με συνέπεια

- περιεχόμενο

- θα μπορούσε να

- δημιουργία

- δημιουργεί

- μονάδες

- πιστωτική κάρτα

- Ρεύμα

- εξαπάτηση

- Παρά

- ανίχνευση

- διαφορά

- διαφορές

- εξαφανίζομαι

- Νόσος

- διάκριση

- διαιρούμενο

- Γιατρός

- Γιατροί

- Μην

- dr

- ευκολότερη

- εύκολα

- δεοντολογία

- Ευρώπη

- Europol

- εμπειρογνώμονες

- εξήγησε

- μάτι

- Πρόσωπο

- πρόσωπα

- οικογένεια

- μέλη της οικογένειας

- σύντροφος

- λίγοι

- Για

- μορφές

- Βρέθηκαν

- απατεώνες

- φίλους

- παράγεται

- γενετική

- Παραγωγική τεχνητή νοημοσύνη

- γεννήτρια

- Παγκόσμιο

- Ομάδα

- είχε

- Έχω

- he

- κεφάλι

- βοήθεια

- hopkins

- HTML

- HTTPS

- τεράστιος

- ανθρώπινος

- Οι άνθρωποι

- προσδιορίσει

- Ταυτότητα

- εικόνα

- εικόνες

- επιπτώσεις

- in

- Αυξάνουν

- υποδεικνύεται

- International

- σε

- IT

- ΤΟΥ

- jpg

- παιδιά

- Ξέρω

- Έλλειψη

- ξεκινάει

- Led

- Μου αρέσει

- Μακριά

- πλέον

- ματιά

- που

- κάνω

- max-width

- Ενδέχεται..

- μέσα

- Μέλη

- Μυλωνάς

- Κακή πληροφορία

- μοντέλα

- χρήματα

- περισσότερο

- πλέον

- πολύ

- εθνικός

- Ανάγκη

- ανάγκες

- επόμενη

- Όχι.

- αριθμοί

- of

- on

- ONE

- αυτά

- διαδικτυακά (online)

- Γνώμη

- αντίθετος

- or

- ΑΛΛΑ

- Χαρτί

- συμμετείχαν

- People

- γινεται αντιληπτο

- phd

- φυσικός

- εικόνα

- Εικόνες

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- φτωχός

- πιθανώς

- Πρόβλημα

- προβληματικός

- βαθύς

- ψυχολογική

- δημόσιο

- δημοσιεύθηκε

- γρήγορα

- αύξηση

- Διάβασε

- πραγματικός

- ρεαλισμός

- ρεαλιστικός

- αφορά

- σχετίζεται με

- βασίζονται

- ερευνητές

- αποτέλεσμα

- αποκαλύπτοντας

- Αύξηση

- Κίνδυνος

- Είπε

- ίδιο

- Επιστήμη

- επιστήμονες

- βλέποντας

- αποστολή

- αρχαιότερος

- ξεχωριστό

- αυτή

- παρουσιάζεται

- Δείχνει

- υπογράψουν

- Σημάδια

- αφού

- καταστάσεων

- δύσπιστος

- So

- Κοινωνία

- μερικοί

- σύντομα

- προδιαγραφές

- πρότυπο

- Ακόμη

- Μελέτη

- θέμα

- Προτείνει

- Έρευνες

- που συμμετείχαν στην έρευνα

- tech

- Τεχνολογίες

- Τεχνολογία

- κείμενο

- από

- ότι

- Η

- κλοπή

- τους

- Τους

- Εκεί.

- Αυτοί

- αυτοί

- αυτό

- εκείνοι

- σκέψη

- προς την

- εργαλεία

- εκπαιδευμένο

- ταλαιπωρία

- τελικά

- πανεπιστήμιο

- επείγων

- μεταχειρισμένος

- διάφορα

- Βίντεο

- ήταν

- ΛΟΙΠΌΝ

- ήταν

- πότε

- άσπρο

- Ο ΟΠΟΊΟΣ

- θα

- με

- Γυναίκες

- θα

- χρόνια

- zephyrnet