Σήμερα, ανακοινώνουμε τη δημόσια διαθεσιμότητα των υπερσύγχρονων προϊόντων της Amazon Alexa Teacher Model με 20 δισεκατομμύρια παραμέτρους (AlexaTM 20B) μέσω Amazon SageMaker JumpStart, ο κόμβος μηχανικής μάθησης του SageMaker. Το AlexaTM 20B είναι ένα πολυγλωσσικό μοντέλο γλώσσας μεγάλης κλίμακας αλληλουχίας σε ακολουθία (seq2seq) που αναπτύχθηκε από την Amazon. Μπορείτε να χρησιμοποιήσετε το AlexaTM 20B για ένα ευρύ φάσμα περιπτώσεων χρήσης του κλάδου, από τη σύνοψη οικονομικών αναφορών έως την απάντηση ερωτήσεων για chatbot εξυπηρέτησης πελατών. Μπορεί να εφαρμοστεί ακόμα και όταν υπάρχουν μόνο λίγα διαθέσιμα παραδείγματα εκπαίδευσης ή ακόμα και καθόλου. AlexaTM 20B υπερέχει 175 δις Μοντέλο GPT-3 σε εργασίες μάθησης μηδενικής λήψης, όπως το SuperGLUE και δείχνει επιδόσεις αιχμής για πολύγλωσσες εργασίες μηδενικής λήψης, όπως το XNLI.

Σε αυτήν την ανάρτηση, παρέχουμε μια επισκόπηση του τρόπου ανάπτυξης και εκτέλεσης συμπερασμάτων με το μοντέλο AlexaTM 20B μέσω προγραμματισμού μέσω των JumpStart API, που είναι διαθέσιμα στο SDK SageMaker Python. Δίνουμε παράδειγμα πώς μπορείτε να χρησιμοποιήσετε αυτό το μοντέλο για να μεταφράσετε μεταξύ πολλών γλωσσών, να συνοψίσετε κείμενο μεγάλης μορφής, να απαντήσετε σε ερωτήσεις με βάση ένα δεδομένο πλαίσιο και να δημιουργήσετε κείμενο που δεν φαίνεται να διακρίνεται από το κείμενο που έχει γραφτεί από ανθρώπους.

AlexaTM 20B και εκμάθηση εντός πλαισίου

Το πρόγραμμα Alexa Teacher Model (AlexaTM) από την Amazon Alexa AI έχει σχεδιαστεί για τη δημιουργία μεγάλης κλίμακας, πολύγλωσσων μοντέλων βαθιάς μάθησης (κυρίως βασισμένα σε Transformer), με στόχο τη βελτίωση της γενίκευσης και του χειρισμού της σπανιότητας δεδομένων για εργασίες κατάντη. Με μεγάλης κλίμακας προ-κατάρτιση, τα μοντέλα δασκάλων μπορούν να γενικεύονται καλά για να μαθαίνουν νέες εργασίες από αραιά δεδομένα και να βοηθούν τους προγραμματιστές να βελτιώσουν την απόδοση σε εργασίες κατάντη. Το AlexaTM 20B έδειξε ανταγωνιστική απόδοση σε σημεία αναφοράς και εργασίες επεξεργασίας κοινής φυσικής γλώσσας (NLP), όπως η αυτόματη μετάφραση, η παραγωγή δεδομένων και η σύνοψη.

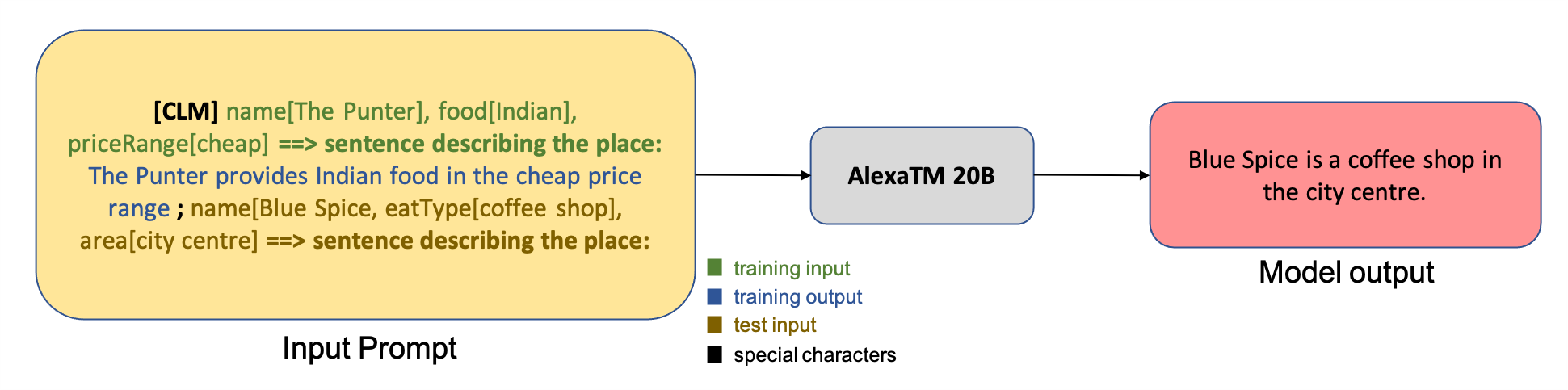

Η χρήση μοντέλων θεμελίωσης όπως το AlexaTM 20B μειώνει την ανάγκη για δαπανηρή προεκπαίδευση μοντέλων και παρέχει ένα σημείο εκκίνησης τελευταίας τεχνολογίας για την ανάπτυξη μοντέλων εργασιών με λιγότερη προσπάθεια και λιγότερα δεδομένα εκπαίδευσης για συγκεκριμένες εργασίες. Μία από τις βασικές ικανότητες των μοντέλων θεμελίωσης είναι ότι μπορούμε να διδάξουμε σε ένα μοντέλο να εκτελεί νέες εργασίες, όπως ερωτήσεις και απαντήσεις σε διαφορετικές γλώσσες, με πολύ μικρές ποσότητες παραδειγμάτων εισαγωγής και δεν απαιτούνται λεπτομέρεια ή ενημερώσεις κλίσης. Αυτό είναι γνωστό ως μάθηση εντός πλαισίου. Με λίγα μόνο παραδείγματα μιας νέας εργασίας που παρέχεται ως πλαίσιο για συμπέρασμα, το μοντέλο AlexaTM 20B μπορεί να μεταφέρει γνώση από ό,τι έχει μάθει κατά τη διάρκεια μεγάλης κλίμακας προεκπαίδευσης, ακόμη και σε διάφορες γλώσσες. Αυτό ονομάζεται μάθηση με λίγα βήματα. Σε ορισμένες περιπτώσεις, το μοντέλο μπορεί να αποδώσει καλά χωρίς καθόλου δεδομένα εκπαίδευσης, με μόνο μια εξήγηση του τι πρέπει να προβλεφθεί. Αυτό ονομάζεται μηδενική εκμάθηση. Για παράδειγμα, ας υποθέσουμε ότι χρησιμοποιούμε το AlexaTM 20B για τη δημιουργία φυσικής γλώσσας μίας λήψης. Η είσοδος που μεταβιβάζεται στο μοντέλο είναι το παράδειγμα εκπαίδευσης με τη μορφή ζευγών χαρακτηριστικών-τιμών, μαζί με την αντίστοιχη αφήγηση κειμένου εξόδου. Το παράδειγμα δοκιμής προσαρτάται στη συνέχεια για να σχηματίσει την πλήρη προτροπή εισαγωγής, όπως φαίνεται στο παρακάτω σχήμα.

Για να μάθετε περισσότερα για το μοντέλο, ρίξτε μια ματιά Το μοντέλο Alexa με παράμετρο 20B θέτει νέα σημάδια στη μάθηση με λίγες λήψεις ή η αρχική χαρτί.

Η χρήση του AlexaTM 20B διατίθεται για μη εμπορική χρήση και καλύπτεται από το Συμφωνία άδειας χρήσης για το μοντέλο εκπαιδευτικού Alexa.

Επισκόπηση λύσεων

Οι ακόλουθες ενότητες παρέχουν μια επίδειξη βήμα προς βήμα σχετικά με τον τρόπο ανάπτυξης του μοντέλου, εκτέλεσης συμπερασμάτων και εκμάθησης εντός του περιβάλλοντος για την επίλυση μαθησιακών εργασιών λίγων βολών.

Σημειώστε ότι η παρακάτω ενότητα περιέχει αποσπάσματα κώδικα. ο πλήρης κωδικός με όλα τα βήματα σε αυτήν την επίδειξη είναι διαθέσιμος στο συνοδευτικό σημειωματάριο: Εκμάθηση σε περιβάλλον με το AlexaTM 20B στο SageMaker JumpStart.

Αναπτύξτε το μοντέλο

Για να χρησιμοποιήσετε ένα μοντέλο μεγάλης γλώσσας στο SageMaker, χρειάζεστε ένα σενάριο εξαγωγής συμπερασμάτων ειδικά για το μοντέλο, το οποίο περιλαμβάνει βήματα όπως φόρτωση μοντέλου, παραλληλοποίηση και άλλα. Πρέπει επίσης να δημιουργήσετε δοκιμές από άκρο σε άκρο για σενάρια, μοντέλα και τους επιθυμητούς τύπους παρουσίας για να επιβεβαιώσετε ότι και τα τρία μπορούν να λειτουργήσουν μαζί. Το JumpStart καταργεί αυτήν την προσπάθεια παρέχοντας έτοιμα προς χρήση σενάρια που έχουν δοκιμαστεί άρτια.

Το SageMaker σάς δίνει τη δυνατότητα να εκτελείτε εκτενώς τα δοχεία Docker για εκπαίδευση και εξαγωγή συμπερασμάτων. Το JumpStart χρησιμοποιεί αυτά τα διαθέσιμα ειδικά πλαίσια SageMaker Deep Learning Containers (DLCs). Ξεκινάμε με την ανάκτηση του βελτιστοποιημένου DLC (deploy_image_uri) χρησιμοποιώντας την model_id. Στη συνέχεια φέρνουμε το model_uri που περιέχει τις παραμέτρους του μοντέλου, μαζί με σενάρια χειρισμού συμπερασμάτων και τυχόν σχετικές εξαρτήσεις. Στη συνέχεια, δημιουργούμε ένα παράδειγμα μοντέλου στο SageMaker και αναπτύξτε το σε ένα τελικό σημείο σε πραγματικό χρόνο. Δείτε τον παρακάτω κώδικα:

Η ανάπτυξη του AlexaTM 20B απαιτεί μια παρουσία που υποστηρίζεται από GPU με τουλάχιστον 50 GB μνήμης CPU και τουλάχιστον 42 GB μνήμης GPU. Το SageMaker παρέχει πολλές τέτοιες περιπτώσεις που υποστηρίζουν την εξαγωγή συμπερασμάτων σε πραγματικό χρόνο. Δοκιμάσαμε αυτό το διάλυμα σε τρεις περιπτώσεις: ml.g4dn.12xlarge, ml.p3.8xlarge, ml.p3.16xlarge. Δείτε τον παρακάτω κώδικα:

Στη συνέχεια, αναπτύσσουμε το μοντέλο σε ένα τελικό σημείο SageMaker σε πραγματικό χρόνο:

Το AlexaTM 20B απαιτεί 40 GB χώρου στο δίσκο στο κοντέινερ συμπερασμάτων. Μια παρουσία ml.g4dn.12xlarge πληροί αυτήν την απαίτηση. Για παράδειγμα τύπους ml.p3.8xlarge και ml.p3.16xlarge, επισυνάπτουμε ένα Κατάστημα Amazon Elastic Block Ένταση (Amazon EBS) για να χειριστείτε το μεγάλο μέγεθος μοντέλου. Ως εκ τούτου, ορίσαμε volume_size = None κατά την ανάπτυξη σε ml.g4dn.12xlarge και volume_size=256 κατά την ανάπτυξη σε ml.p3.8xlarge ή ml.p3.16xlarge.

Η ανάπτυξη του μοντέλου μπορεί να διαρκέσει έως και 10 λεπτά. Αφού αναπτυχθεί το μοντέλο, μπορούμε να λάβουμε προβλέψεις από αυτό σε πραγματικό χρόνο!

Εκτέλεση συμπερασμάτων

Το AlexaTM 20B είναι ένα μοντέλο δημιουργίας κειμένου το οποίο, δεδομένης μιας μερικής ακολουθίας (μια πρόταση ή κομμάτι κειμένου), δημιουργεί το επόμενο σύνολο λέξεων. Το παρακάτω απόσπασμα κώδικα σάς δίνει μια γεύση του τρόπου υποβολής ερωτημάτων στο τελικό σημείο που αναπτύξαμε και ανάλυσης των εξόδων για εργασία αυτόματης συμπλήρωσης. Για να στείλουμε αιτήματα σε ένα αναπτυγμένο μοντέλο, χρησιμοποιούμε ένα λεξικό JSON κωδικοποιημένο σε μορφή UTF-8. Η απόκριση τελικού σημείου είναι ένα αντικείμενο JSON που περιέχει μια λίστα δημιουργημένων κειμένων.

Στη συνέχεια, ρωτάμε το τελικό σημείο και αναλύουμε την απάντηση σε ένα δείγμα κειμένου εισαγωγής:

Το AlexaTM 20B υποστηρίζει επί του παρόντος 10 παραμέτρους δημιουργίας κειμένου κατά την εξαγωγή συμπερασμάτων: max_length, num_return_sequences, num_beams, no_repeat_ngram_size, temperature, early_stopping, do_sample, top_k, top_p, να seed. Για λεπτομερείς πληροφορίες σχετικά με τις έγκυρες τιμές για κάθε παράμετρο και τον αντίκτυπό τους στην έξοδο, δείτε το συνοδευτικό σημειωματάριο: Εκμάθηση σε περιβάλλον με το AlexaTM 20B στο SageMaker JumpStart.

Εκμάθηση εντός πλαισίου

Η εκμάθηση εντός περιβάλλοντος αναφέρεται στα εξής: παρέχουμε στο μοντέλο γλώσσας μια προτροπή, η οποία αποτελείται από εκπαίδευση ζευγών εισόδου-εξόδου που επιδεικνύουν την εργασία. Προσθέτουμε μια δοκιμαστική είσοδο στην προτροπή και επιτρέπουμε στο γλωσσικό μοντέλο να κάνει προβλέψεις εξαρτώντας από την προτροπή και προβλέποντας τα επόμενα διακριτικά ή λέξεις. Αυτή είναι μια εξαιρετικά αποτελεσματική τεχνική για την επίλυση λίγων προβλημάτων εκμάθησης βολής, στην οποία μαθαίνουμε μια εργασία από μερικά δείγματα εκπαίδευσης.

Στη συνέχεια, δείχνουμε πώς μπορείτε να χρησιμοποιήσετε το AlexaTM 20B για πολλές εργασίες 1-shot και zero-shot μέσω της εκμάθησης στο πλαίσιο. Σε αντίθεση με τα προηγούμενα μοντέλα αλληλουχίας σε ακολουθία, το AlexaTM 20B εκπαιδεύτηκε στη μοντελοποίηση αιτιώδους γλώσσας εκτός από την αποθορυβοποίηση, γεγονός που το καθιστά ένα καλό μοντέλο για εκμάθηση εντός του πλαισίου.

Σύνοψη κειμένου 1-πλάνο

Η σύνοψη κειμένου είναι η συντόμευση των δεδομένων και η δημιουργία μιας περίληψης που αντιπροσωπεύει τις πιο σημαντικές πληροφορίες που υπάρχουν στο αρχικό κείμενο. Η σύνοψη κειμένου 1-shot αναφέρεται στο περιβάλλον όπου μαθαίνουμε να συνοψίζουμε το κείμενο με βάση ένα μόνο δείγμα εκπαίδευσης. Ο παρακάτω κώδικας είναι ένα δείγμα σύνοψης κειμένου από το Δεδομένα XSUM:

Χρησιμοποιούμε την ακόλουθη προτροπή για σύνοψη όταν παρέχεται μόνο ένα δείγμα εκπαίδευσης. Το κείμενο που δημιουργείται από το μοντέλο ερμηνεύεται ως η προβλεπόμενη περίληψη του δοκιμαστικού άρθρου.

Η έξοδος έχει ως εξής:

1-shot γενιά φυσικής γλώσσας

Η παραγωγή φυσικής γλώσσας είναι το καθήκον της παραγωγής αφηγήσεων κειμένου με βάση το εισαγόμενο κείμενο. Το παρακάτω δείγμα δείχνει ένα δείγμα εκπαίδευσης από το Δεδομένα E2E:

Χρησιμοποιούμε την ακόλουθη προτροπή για τη δημιουργία φυσικής γλώσσας όταν παρέχεται μόνο ένα δείγμα εκπαίδευσης (1-shot). Το κείμενο που δημιουργείται από το μοντέλο ερμηνεύεται ως η προβλεπόμενη αφήγηση κειμένου για τη δοκιμαστική εισαγωγή (test_inp).

Η έξοδος έχει ως εξής:

Μηχανική μετάφραση 1 βολής

Η μηχανική μετάφραση είναι το έργο της μετάφρασης κειμένου από τη μια γλώσσα στην άλλη. Το παρακάτω παράδειγμα δείχνει ένα δείγμα εκπαίδευσης από το Δεδομένα WMT19 στο οποίο πρέπει να μεταφράσουμε από τα γερμανικά στα αγγλικά:

Χρησιμοποιούμε την ακόλουθη προτροπή για αυτόματη μετάφραση όταν παρέχεται μόνο ένα δείγμα εκπαίδευσης (1-shot). Το κείμενο που δημιουργείται από το μοντέλο ερμηνεύεται ως η μετάφραση της εισόδου δοκιμής (test_inp).

Η έξοδος έχει ως εξής:

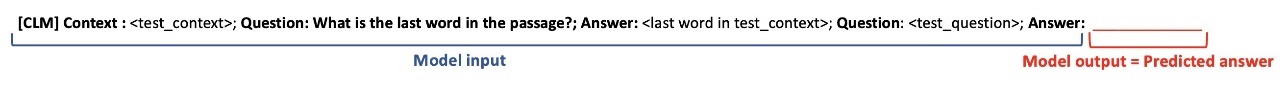

Απάντηση εξαγωγικών ερωτήσεων μηδενικής βολής

Η εξαγωγή απάντησης ερωτήσεων είναι το καθήκον της εύρεσης της απάντησης σε μια ερώτηση από την παράγραφο του περιβάλλοντος. Το παρακάτω είναι ένα παράδειγμα ενός πλαισίου και μιας ερώτησης από το Σύνολο δεδομένων SQuAD v2:

Σημειώστε ότι δεν έχουμε δείγματα εκπαίδευσης για την εργασία μας. Αντίθετα, δημιουργούμε μια εικονική ερώτηση σχετικά με την τελευταία λέξη στην προτροπή , με βάση το test_context (εικονική βολή). Ως εκ τούτου, στην πραγματικότητα απαντάμε σε εξαγωγικές ερωτήσεις μηδενικής βολής.

Χρησιμοποιούμε την ακόλουθη προτροπή για απάντηση εξαγωγικών ερωτήσεων όταν δεν παρέχεται δείγμα εκπαίδευσης. Το κείμενο που δημιουργείται από το μοντέλο ερμηνεύεται ως η απάντηση στην ερώτηση του τεστ.

Η έξοδος έχει ως εξής:

Άμεση Μηχανική

Η άμεση μηχανική μπορεί μερικές φορές να είναι τέχνη. Ακόμη και μικρές αλλαγές στο πρότυπο προτροπής μπορούν να οδηγήσουν σε σημαντικές αλλαγές στην απόδοση του μοντέλου σε μια συγκεκριμένη εργασία. Ακολουθούν μερικές συμβουλές για τη σύνταξη καλών προτύπων προτροπής. Πρώτον, είναι σημαντικό να θυμάστε ότι το μοντέλο εκπαιδεύτηκε για να μάθει τη δομή των πραγματικών προτάσεων (αιτιακή μοντελοποίηση γλώσσας). Ως εκ τούτου, είναι καλύτερο να βεβαιωθείτε ότι το πρότυπο προτροπής είναι γραμματικά και δομικά σωστό στη φυσική γλώσσα. Δεύτερον, αυτό το συγκεκριμένο μοντέλο επωφελείται από εικονικές λήψεις για να του διδάξει τη δομή που αναμένεται στην απάντηση, όπως καταδείχθηκε παραπάνω. Τρίτον, συνιστάται πάντα να εξετάζετε την απόδοση των εργασιών σε μια ποικιλία υποψηφίων προτύπων προτροπής. Promptsource και Φυσικές οδηγίες είναι δύο πλαίσια ανοιχτού κώδικα για την τυποποίηση προτύπων προτροπών και παρέχουν μια ποικιλία παραδειγμάτων προτροπών που χρησιμοποιούνται για υπάρχουσες εργασίες μοντελοποίησης. Επιπλέον, το Παράρτημα Β του Χαρτί AlexaTM 20B παρέχει τα πρότυπα προτροπής που χρησιμοποιούνται για τη δημιουργία των αποτελεσμάτων που παρουσιάζονται στο έγγραφο. Υπάρχει ένα αυξανόμενο υποπεδίο αφιερωμένο στην αυτόματη δημιουργία και εκμάθηση των καλύτερων προτροπών για μια εργασία, συμπεριλαμβανομένων τόσο της φυσικής γλώσσας όσο και των συνεχών προτροπών. Αυτό είναι πέρα από το πεδίο αυτού του σεμιναρίου.

Συμπέρασμα

Σε αυτήν την ανάρτηση, δείξαμε πώς να αναπτύξετε το μοντέλο AlexaTM 20B σε ένα τελικό σημείο του SageMaker και να εκτελέσετε συμπέρασμα. Μπορείτε να χρησιμοποιήσετε το μοντέλο AlexaTM 20B για μάθηση εντός του πλαισίου για μια ποικιλία εργασιών μάθησης με λίγα βήματα. Για να μάθετε περισσότερα σχετικά με το AlexaTM 20B, ανατρέξτε στο Το μοντέλο Alexa με παράμετρο 20B θέτει νέα σημάδια στη μάθηση με λίγες λήψεις ή η αρχική χαρτί.

Οι συγγραφείς θα ήθελαν να αναγνωρίσουν την τεχνική συμβολή των Maciej Rudnicki, Jakub Debski, Ashish Khetan, Anastasiia Dubinina, Vitaliy Korolev, Karl Albertsen, Saleh Soltan και Mariusz Momotko για να γίνει δυνατή αυτή η εκτόξευση.

Σχετικά με το JumpStart

Το JumpStart είναι ο κόμβος μηχανικής εκμάθησης (ML) του Amazon SageMaker που προσφέρει πάνω από 350 προεκπαιδευμένα μοντέλα, ενσωματωμένους αλγόριθμους και προκατασκευασμένα πρότυπα λύσεων για να σας βοηθήσει να ξεκινήσετε γρήγορα με την ML. Το JumpStart φιλοξενεί μοντέλα τελευταίας τεχνολογίας από δημοφιλείς κόμβους μοντέλων όπως το TensorFlow, το PyTorch, το Hugging Face και το MXNet, τα οποία υποστηρίζουν δημοφιλείς εργασίες ML, όπως ανίχνευση αντικειμένων, ταξινόμηση κειμένου και δημιουργία κειμένου. Η ερευνητική κοινότητα ML έχει καταβάλει μεγάλη προσπάθεια για να καταστήσει δημόσια την πλειονότητα των μοντέλων που αναπτύχθηκαν πρόσφατα για χρήση. Το JumpStart στοχεύει να σας βοηθήσει να βρείτε σωστά τα μοντέλα και τους αλγόριθμους ML και να ξεκινήσετε αμέσως τη δημιουργία μοντέλων. Συγκεκριμένα, το JumpStart παρέχει τα ακόλουθα οφέλη:

- Εύκολη πρόσβαση με το UI και το SDK – Μπορείτε να αποκτήσετε πρόσβαση σε μοντέλα και αλγόριθμους στο JumpStart μέσω προγραμματισμού χρησιμοποιώντας το SageMaker Python SDK ή μέσω του JumpStart UI στο Amazon SageMaker Studio. Προς το παρόν, το AlexaTM 20B είναι προσβάσιμο μόνο μέσω του SageMaker Python SDK.

- Ενσωματωμένοι αλγόριθμοι SageMaker – Το JumpStart παρέχει πάνω από 350 ενσωματωμένους αλγόριθμους και προεκπαιδευμένα μοντέλα, μαζί με αντίστοιχα σενάρια εκπαίδευσης (εάν υποστηρίζονται), σενάρια εξαγωγής συμπερασμάτων και παραδείγματα σημειωματάριων. Τα σενάρια βελτιστοποιούνται για κάθε πλαίσιο και εργασία και παρέχουν δυνατότητες όπως υποστήριξη GPU, αυτόματο συντονισμό μοντέλου και σταδιακή εκπαίδευση. Τα σενάρια ελέγχονται επίσης με παρουσίες και δυνατότητες του SageMaker, ώστε να μην αντιμετωπίζετε προβλήματα συμβατότητας.

- Προκατασκευασμένες λύσεις – Το JumpStart παρέχει ένα σύνολο 23 λύσεων για συνήθεις περιπτώσεις χρήσης ML, όπως πρόβλεψη ζήτησης και βιομηχανικές και οικονομικές εφαρμογές, τις οποίες μπορείτε να αναπτύξετε με λίγα μόνο κλικ. Οι λύσεις είναι εφαρμογές ML από άκρο σε άκρο που συνδυάζουν διάφορες υπηρεσίες AWS για να λύσουν μια συγκεκριμένη περίπτωση επιχειρηματικής χρήσης. Χρησιμοποιούν πρότυπα AWS CloudFormation και αρχιτεκτονικές αναφοράς για γρήγορη ανάπτυξη, πράγμα που σημαίνει ότι είναι πλήρως προσαρμόσιμα.

- Υποστήριξη – Το SageMaker παρέχει μια σειρά υποστήριξης, όπως τη διατήρηση ενημερωμένων εκδόσεων όταν κυκλοφορούν νέες δυνατότητες του SageMaker ή οι εκδόσεις του Deep Learning Container και δημιουργία τεκμηρίωσης σχετικά με τον τρόπο χρήσης του περιεχομένου του JumpStart σε περιβάλλον SageMaker.

Για να μάθετε περισσότερα σχετικά με το JumpStart και πώς μπορείτε να χρησιμοποιήσετε προεκπαιδευμένα μοντέλα ανοιχτού κώδικα για μια ποικιλία άλλων εργασιών ML, δείτε τα παρακάτω Βίντεο AWS re:Invent 2020.

Σχετικά με τους Συγγραφείς

Δρ Vivek Madan είναι Εφαρμοσμένος Επιστήμονας με την ομάδα Amazon SageMaker JumpStart. Πήρε το διδακτορικό του από το Πανεπιστήμιο του Ιλινόις στο Urbana-Champaign και ήταν μεταδιδακτορικός ερευνητής στο Georgia Tech. Είναι ενεργός ερευνητής στη μηχανική μάθηση και στο σχεδιασμό αλγορίθμων και έχει δημοσιεύσει εργασίες σε συνέδρια EMNLP, ICLR, COLT, FOCS και SODA.

Δρ Vivek Madan είναι Εφαρμοσμένος Επιστήμονας με την ομάδα Amazon SageMaker JumpStart. Πήρε το διδακτορικό του από το Πανεπιστήμιο του Ιλινόις στο Urbana-Champaign και ήταν μεταδιδακτορικός ερευνητής στο Georgia Tech. Είναι ενεργός ερευνητής στη μηχανική μάθηση και στο σχεδιασμό αλγορίθμων και έχει δημοσιεύσει εργασίες σε συνέδρια EMNLP, ICLR, COLT, FOCS και SODA.

Τζακ Φιτζ Τζέραλντ είναι ανώτερος εφαρμοσμένος επιστήμονας με την Alexa AI, όπου επί του παρόντος εστιάζει στη μοντελοποίηση μεγάλων γλωσσών, στη μοντελοποίηση πολύγλωσσων κειμένων και στις λειτουργίες μηχανικής μάθησης.

Τζακ Φιτζ Τζέραλντ είναι ανώτερος εφαρμοσμένος επιστήμονας με την Alexa AI, όπου επί του παρόντος εστιάζει στη μοντελοποίηση μεγάλων γλωσσών, στη μοντελοποίηση πολύγλωσσων κειμένων και στις λειτουργίες μηχανικής μάθησης.

Τζοάο Μούρα είναι Αρχιτέκτονας Ειδικών Λύσεων AI/ML στο Amazon Web Services. Επικεντρώνεται κυρίως σε περιπτώσεις χρήσης NLP και βοηθά τους πελάτες να βελτιστοποιήσουν την εκπαίδευση και την ανάπτυξη μοντέλων βαθιάς μάθησης. Είναι επίσης ενεργός υποστηρικτής των λύσεων ML χαμηλού κώδικα και του υλικού εξειδικευμένου για ML.

Τζοάο Μούρα είναι Αρχιτέκτονας Ειδικών Λύσεων AI/ML στο Amazon Web Services. Επικεντρώνεται κυρίως σε περιπτώσεις χρήσης NLP και βοηθά τους πελάτες να βελτιστοποιήσουν την εκπαίδευση και την ανάπτυξη μοντέλων βαθιάς μάθησης. Είναι επίσης ενεργός υποστηρικτής των λύσεων ML χαμηλού κώδικα και του υλικού εξειδικευμένου για ML.

Ο Ιούνιος νίκησε είναι διαχειριστής προϊόντων με το SageMaker JumpStart και τους ενσωματωμένους αλγόριθμους. Επικεντρώνεται στο να κάνει τα περιεχόμενα ML εύκολα ανιχνεύσιμα και χρηστικά για τους πελάτες του SageMaker.

Ο Ιούνιος νίκησε είναι διαχειριστής προϊόντων με το SageMaker JumpStart και τους ενσωματωμένους αλγόριθμους. Επικεντρώνεται στο να κάνει τα περιεχόμενα ML εύκολα ανιχνεύσιμα και χρηστικά για τους πελάτες του SageMaker.

Πούλκιτ Καπούρ είναι το κύριο προϊόν για το πρόγραμμα Alexa Teacher Model με Alexa AI, που εστιάζει στη γενικευμένη νοημοσύνη και τις εφαρμογές των πολυτροπικών μοντέλων θεμελίωσης πολλαπλών εργασιών της Alexa.

Πούλκιτ Καπούρ είναι το κύριο προϊόν για το πρόγραμμα Alexa Teacher Model με Alexa AI, που εστιάζει στη γενικευμένη νοημοσύνη και τις εφαρμογές των πολυτροπικών μοντέλων θεμελίωσης πολλαπλών εργασιών της Alexa.

- AI

- αι τέχνη

- ι γεννήτρια τέχνης

- ρομπότ ai

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- τεχνητή νοημοσύνη

- πιστοποίηση τεχνητής νοημοσύνης

- τεχνητή νοημοσύνη στον τραπεζικό τομέα

- ρομπότ τεχνητής νοημοσύνης

- ρομπότ τεχνητής νοημοσύνης

- λογισμικό τεχνητής νοημοσύνης

- Μηχανική εκμάθηση AWS

- blockchain

- συνέδριο blockchain ai

- Coingenius

- συνομιλητική τεχνητή νοημοσύνη

- κρυπτοσυνεδριο αι

- του νταλ

- βαθιά μάθηση

- Θεμελιώδης (100)

- έχεις google

- μάθηση μηχανής

- Πλάτων

- πλάτων αι

- Πληροφορία δεδομένων Plato

- Παιχνίδι Πλάτωνας

- Πλάτωνα δεδομένα

- platogaming

- κλίμακα αι

- σύνταξη

- zephyrnet