Εν συντομία Νέοι κανόνες που εκπονήθηκαν από την Ευρωπαϊκή Ένωση με στόχο τη ρύθμιση της τεχνητής νοημοσύνης θα μπορούσαν να εμποδίσουν τους προγραμματιστές να κυκλοφορήσουν μοντέλα ανοιχτού κώδικα, σύμφωνα με την αμερικανική δεξαμενή σκέψης Brookings.

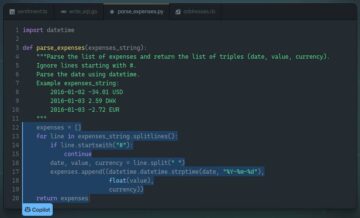

Η προτείνεται Ο νόμος της ΕΕ για την τεχνητή νοημοσύνη, που δεν έχει ακόμη υπογραφεί σε νόμο, ορίζει ότι οι προγραμματιστές ανοιχτού κώδικα πρέπει να διασφαλίζουν ότι το λογισμικό τεχνητής νοημοσύνης τους είναι ακριβές, ασφαλές και διαφανές σχετικά με τον κίνδυνο και τη χρήση δεδομένων σε σαφή τεχνική τεκμηρίωση.

Brookings υποστηρίζει ότι εάν μια ιδιωτική εταιρεία επρόκειτο να αναπτύξει το δημόσιο μοντέλο ή να το χρησιμοποιήσει σε ένα προϊόν και με κάποιο τρόπο αντιμετωπίζει προβλήματα λόγω κάποιων απρόβλεπτων ή μη ελεγχόμενων επιπτώσεων από το μοντέλο, η εταιρεία πιθανότατα θα προσπαθούσε να κατηγορήσει τους προγραμματιστές ανοιχτού κώδικα και να τους μηνύσει .

Μπορεί να αναγκάσει την κοινότητα ανοιχτού κώδικα να σκεφτεί δύο φορές για την κυκλοφορία του κώδικά της και, δυστυχώς, θα σήμαινε ότι η ανάπτυξη της τεχνητής νοημοσύνης θα καθοδηγείται από ιδιωτικές εταιρείες. Ο ιδιόκτητος κώδικας είναι δύσκολο να αναλυθεί και να βασιστεί πάνω του, πράγμα που σημαίνει ότι η καινοτομία θα παρεμποδιστεί.

Ο Oren Etzioni, ο απερχόμενος CEO του Allen Institute of AI, πιστεύει ότι οι προγραμματιστές ανοιχτού κώδικα δεν πρέπει να υπόκεινται στους ίδιους αυστηρούς κανόνες με τους μηχανικούς λογισμικού σε ιδιωτικές εταιρείες.

«Οι προγραμματιστές ανοιχτού κώδικα δεν πρέπει να υπόκεινται στο ίδιο βάρος με εκείνους που αναπτύσσουν εμπορικό λογισμικό. Θα πρέπει πάντα να ισχύει ότι το ελεύθερο λογισμικό μπορεί να παρέχεται «ως έχει» — εξετάστε την περίπτωση ενός μόνο μαθητή που αναπτύσσει μια ικανότητα τεχνητής νοημοσύνης. δεν έχουν την πολυτέλεια να συμμορφωθούν με τους κανονισμούς της ΕΕ και μπορεί να αναγκαστούν να μην διανείμουν το λογισμικό τους, με αποτέλεσμα να έχει ανατριχιαστικό αποτέλεσμα στην ακαδημαϊκή πρόοδο και στην αναπαραγωγιμότητα των επιστημονικών αποτελεσμάτων. είπε TechCrunch.

Τα νέα αποτελέσματα MLPerf για συμπέρασμα έχουν βγει

Τα αποτελέσματα για την ετήσια δοκιμή συμπερασμάτων MLPerf, η οποία μετράει την απόδοση των τσιπ τεχνητής νοημοσύνης από διαφορετικούς προμηθευτές σε πολυάριθμες εργασίες σε διάφορες διαμορφώσεις, ήταν δημοσιεύθηκε αυτή την εβδομάδα.

Σχεδόν 5,300 αποτελέσματα απόδοσης και 2,400 μετρήσεις ισχύος αναφέρθηκαν φέτος για συμπέρασμα στο datacenter και στις συσκευές άκρων. Οι δοκιμές εξετάζουν πόσο γρήγορα ένα σύστημα υλικού μπορεί να εκτελέσει ένα συγκεκριμένο μοντέλο μηχανικής εκμάθησης. Ο ρυθμός συρρίκνωσης δεδομένων αναφέρεται σε υπολογιστικά φύλλα.

Δεν αποτελεί έκπληξη το γεγονός ότι η Nvidia βρίσκεται στην κορυφή της κατάταξης και φέτος. «Στο ντεμπούτο τους στα πρότυπα τεχνητής νοημοσύνης του κλάδου MLPerf, οι GPU της Nvidia H100 Tensor Core σημείωσαν παγκόσμια ρεκόρ σε συμπεράσματα σε όλους τους φόρτους εργασίας, παρέχοντας έως και 4.5 φορές περισσότερη απόδοση από τις GPU προηγούμενης γενιάς», ανέφερε η Nvidia σε μια ανάρτηση ιστολογίου. «Τα αποτελέσματα δείχνουν ότι το Hopper είναι η κορυφαία επιλογή για χρήστες που απαιτούν τη μέγιστη απόδοση σε προηγμένα μοντέλα AI».

Παρόλο που ένας αυξανόμενος αριθμός προμηθευτών συμμετέχει στην πρόκληση MLPerf, μπορεί να είναι δύσκολο να αποκτήσετε μια καλή ιδέα για τον ανταγωνισμό. Δεν υπάρχουν αναφερόμενα αποτελέσματα για τα τσιπ TPU της Google στο κομμάτι του κέντρου δεδομένων φέτος, για παράδειγμα. Η Google, ωστόσο, φαινόταν άσσος Ο προπονητικός διαγωνισμός του MLPerf νωρίτερα φέτος.

Καλλιτέχνες AI ανακαλύπτουν ένα φρικτό πρόσωπο που κρύβεται πίσω από την εικόνα

Ένα viral νήμα στο Twitter που δημοσιεύτηκε από έναν ψηφιακό καλλιτέχνη αποκαλύπτει πόσο περίεργα μοντέλα κειμένου σε εικόνα μπορεί να βρίσκονται κάτω από την επιφάνεια.

Πολλοί χρήστες του Διαδικτύου έχουν βρει χαρά και απελπισία πειραματιζόμενοι με αυτά τα συστήματα για να δημιουργήσουν εικόνες πληκτρολογώντας μηνύματα κειμένου. Υπάρχουν είδη αμυχών για την προσαρμογή των εξόδων των μοντέλων. ένα από αυτά, γνωστό ως "αρνητικό μήνυμα, επιτρέπει στους χρήστες να βρουν την αντίθετη εικόνα από αυτή που περιγράφεται στο μήνυμα.

Όταν ένας καλλιτέχνης, ο οποίος ακούει στο όνομα Supercomposite στο Twitter, βρήκε την αρνητική προτροπή για αυτό που περιέγραφε μια αθώα εικόνα ενός πλαστού λογότυπου, βρήκε κάτι πραγματικά τρομακτικό: Το πρόσωπο αυτού που μοιάζει με στοιχειωμένη γυναίκα. Το Supercomposite ονόμασε αυτή τη γυναίκα που δημιουργήθηκε από AI "Loab" και όταν διασταύρωναν τις εικόνες της με άλλες, κατέληγαν πάντα να μοιάζουν με σκηνή από ταινία τρόμου.

🧵: I discovered this woman, who I call Loab, in April. The AI reproduced her more easily than most celebrities. Her presence is persistent, and she haunts every image she touches. CW: Take a seat. This is a true horror story, and veers sharply macabre. pic.twitter.com/gmUlf6mZtk

— Supercomposite (@supercomposite) September 6, 2022

Supercomposite είπε Ο Καν τυχαίες εικόνες ανθρώπων που δημιουργούνται από AI μπορεί συχνά να εμφανίζονται σε αρνητικά μηνύματα. Η περίεργη συμπεριφορά είναι ακόμα ένα άλλο παράδειγμα από μερικές από τις περίεργες ιδιότητες που μπορεί να έχουν αυτά τα μοντέλα που οι άνθρωποι μόλις αρχίζουν να διερευνούν.

Δεν υπάρχουν αισθητά chatbots εδώ στην Google, λέει ο CEO Sundar Pichai

Ο Sundar Pichai αντέκρουσε τους ισχυρισμούς του πρώην μηχανικού, Blake Lemoine, ότι η Google είχε δημιουργήσει ένα ευαίσθητο chatbot κατά τη διάρκεια της ομιλίας του στη διάσκεψη Code αυτή την εβδομάδα.

Ο Λεμουάν έγινε πρωτοσέλιδο τον Ιούλιο όταν ανακοίνωσε σκέφτηκε ότι το chatbot LaMDA της Google ήταν συνειδητοποιημένο και μπορεί να είχε ψυχή. Ήταν αργότερα τροφοδοτούνται για παραβίαση των πολιτικών απορρήτου της εταιρείας, αφού προσέλαβε δικηγόρο για να συνομιλήσει με τη LaMDA και να αξιολογήσει τα νόμιμα δικαιώματά της, υποστηρίζοντας ότι το μηχάνημα του είχε πει να το κάνει.

Οι περισσότεροι άνθρωποι – συμπεριλαμβανομένου του Διευθύνοντος Συμβούλου της Google – διαφωνούν με τον Lemoine. «Πιστεύω ακόμα ότι υπάρχει πολύς δρόμος. Νιώθω ότι μπαίνω συχνά σε φιλοσοφικές ή μεταφυσικές συζητήσεις σχετικά με το τι είναι συναίσθημα και τι είναι συνείδηση», είπε ο Pichai. σύμφωνα με στο Fortune. «Είμαστε πολύ μακριά από αυτό και μπορεί να μην φτάσουμε ποτέ εκεί», πρόσθεσε.

Για να τονίσει περαιτέρω την άποψή του, παραδέχτηκε ότι ο φωνητικός βοηθός τεχνητής νοημοσύνης της Google μερικές φορές αδυνατεί να κατανοήσει και να ανταποκριθεί κατάλληλα στα αιτήματα. "Τα καλά νέα είναι ότι όποιος μιλάει με το Google Assistant - αν και πιστεύω ότι είναι ο καλύτερος βοηθός για συνομιλία AI - εξακολουθεί να βλέπει πόσο χαλασμένο είναι σε ορισμένες περιπτώσεις", είπε. ®

- AI

- αι τέχνη

- ι γεννήτρια τέχνης

- ρομπότ ai

- τεχνητή νοημοσύνη

- πιστοποίηση τεχνητής νοημοσύνης

- τεχνητή νοημοσύνη στον τραπεζικό τομέα

- ρομπότ τεχνητής νοημοσύνης

- ρομπότ τεχνητής νοημοσύνης

- λογισμικό τεχνητής νοημοσύνης

- blockchain

- συνέδριο blockchain ai

- Coingenius

- συνομιλητική τεχνητή νοημοσύνη

- κρυπτοσυνεδριο αι

- του νταλ

- βαθιά μάθηση

- έχεις google

- μάθηση μηχανής

- Πλάτων

- πλάτων αι

- Πληροφορία δεδομένων Plato

- Παιχνίδι Πλάτωνας

- Πλάτωνα δεδομένα

- platogaming

- κλίμακα αι

- σύνταξη

- Το μητρώο

- zephyrnet