OpenAI Whisper είναι ένα προηγμένο μοντέλο αυτόματης αναγνώρισης ομιλίας (ASR) με άδεια MIT. Η τεχνολογία ASR βρίσκει χρησιμότητα στις υπηρεσίες μεταγραφής, στους φωνητικούς βοηθούς και στη βελτίωση της προσβασιμότητας για άτομα με προβλήματα ακοής. Αυτό το υπερσύγχρονο μοντέλο εκπαιδεύεται σε ένα τεράστιο και ποικίλο σύνολο δεδομένων πολύγλωσσων και εποπτευόμενων πολλαπλών εργασιών δεδομένων που συλλέγονται από τον Ιστό. Η υψηλή ακρίβεια και η προσαρμοστικότητά του το καθιστούν πολύτιμο πλεονέκτημα για ένα ευρύ φάσμα εργασιών που σχετίζονται με τη φωνή.

Στο συνεχώς εξελισσόμενο τοπίο της μηχανικής μάθησης και της τεχνητής νοημοσύνης, Amazon Sage Maker παρέχει ένα ολοκληρωμένο οικοσύστημα. Το SageMaker εξουσιοδοτεί επιστήμονες δεδομένων, προγραμματιστές και οργανισμούς να αναπτύσσουν, να εκπαιδεύουν, να αναπτύσσουν και να διαχειρίζονται μοντέλα μηχανικής μάθησης σε κλίμακα. Προσφέροντας ένα ευρύ φάσμα εργαλείων και δυνατοτήτων, απλοποιεί ολόκληρη τη ροή εργασιών μηχανικής εκμάθησης, από την προεπεξεργασία δεδομένων και την ανάπτυξη μοντέλων έως την αβίαστη ανάπτυξη και παρακολούθηση. Η φιλική προς τον χρήστη διεπαφή του SageMaker το καθιστά μια κεντρική πλατφόρμα για το ξεκλείδωμα του πλήρους δυναμικού της τεχνητής νοημοσύνης, καθιερώνοντάς την ως μια λύση που αλλάζει το παιχνίδι στη σφαίρα της τεχνητής νοημοσύνης.

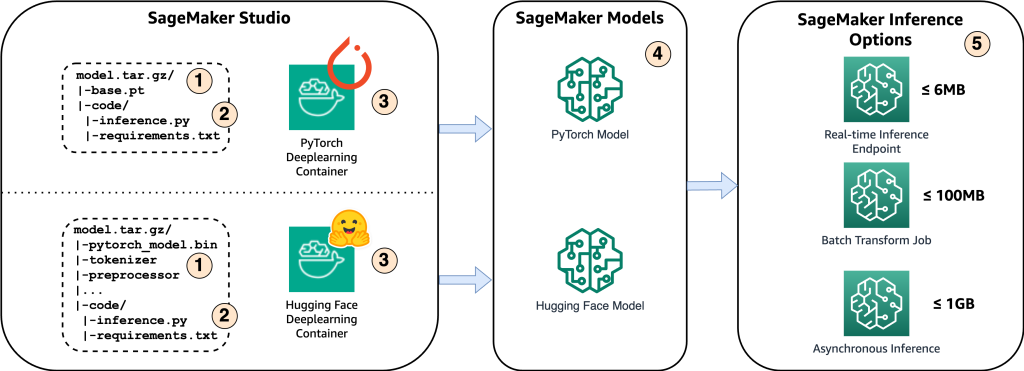

Σε αυτήν την ανάρτηση, ξεκινάμε μια εξερεύνηση των δυνατοτήτων του SageMaker, εστιάζοντας συγκεκριμένα στη φιλοξενία μοντέλων Whisper. Θα βουτήξουμε βαθιά σε δύο μεθόδους για να το κάνουμε αυτό: η μία χρησιμοποιεί το μοντέλο Whisper PyTorch και η άλλη χρησιμοποιώντας την εφαρμογή Hugging Face του μοντέλου Whisper. Επιπλέον, θα διεξαγάγουμε μια εις βάθος εξέταση των επιλογών συμπερασμάτων του SageMaker, συγκρίνοντάς τες μεταξύ παραμέτρων όπως η ταχύτητα, το κόστος, το μέγεθος ωφέλιμου φορτίου και η επεκτασιμότητα. Αυτή η ανάλυση δίνει τη δυνατότητα στους χρήστες να λαμβάνουν τεκμηριωμένες αποφάσεις όταν ενσωματώνουν μοντέλα Whisper στις συγκεκριμένες περιπτώσεις χρήσης και στα συστήματά τους.

Επισκόπηση λύσεων

Το παρακάτω διάγραμμα δείχνει τα κύρια συστατικά αυτής της λύσης.

- Για να φιλοξενήσετε το μοντέλο στο Amazon SageMaker, το πρώτο βήμα είναι να αποθηκεύσετε τα τεχνουργήματα του μοντέλου. Αυτά τα τεχνουργήματα αναφέρονται στα βασικά στοιχεία ενός μοντέλου μηχανικής εκμάθησης που απαιτούνται για διάφορες εφαρμογές, συμπεριλαμβανομένης της ανάπτυξης και της επανεκπαίδευσης. Μπορούν να περιλαμβάνουν παραμέτρους μοντέλου, αρχεία διαμόρφωσης, στοιχεία προεπεξεργασίας, καθώς και μεταδεδομένα, όπως λεπτομέρειες έκδοσης, συγγραφή και τυχόν σημειώσεις που σχετίζονται με την απόδοσή του. Είναι σημαντικό να σημειωθεί ότι τα μοντέλα Whisper για υλοποιήσεις PyTorch και Hugging Face αποτελούνται από διαφορετικά τεχνουργήματα μοντέλων.

- Στη συνέχεια, δημιουργούμε προσαρμοσμένα σενάρια συμπερασμάτων. Μέσα σε αυτά τα σενάρια, ορίζουμε πώς θα πρέπει να φορτωθεί το μοντέλο και καθορίζουμε τη διαδικασία εξαγωγής συμπερασμάτων. Εδώ μπορούμε επίσης να ενσωματώσουμε προσαρμοσμένες παραμέτρους όπως απαιτείται. Επιπλέον, μπορείτε να απαριθμήσετε τα απαιτούμενα πακέτα Python σε α

requirements.txtαρχείο. Κατά την ανάπτυξη του μοντέλου, αυτά τα πακέτα Python εγκαθίστανται αυτόματα στη φάση της προετοιμασίας. - Στη συνέχεια επιλέγουμε είτε τα δοχεία βαθιάς εκμάθησης PyTorch είτε Hugging Face (DLC) που παρέχονται και διατηρούνται από AWS. Αυτά τα κοντέινερ είναι προ-χτισμένες εικόνες Docker με πλαίσια βαθιάς εκμάθησης και άλλα απαραίτητα πακέτα Python. Για περισσότερες πληροφορίες, μπορείτε να το ελέγξετε σύνδεσμος.

- Με τα τεχνουργήματα μοντέλων, προσαρμοσμένα σενάρια συμπερασμάτων και επιλεγμένα DLC, θα δημιουργήσουμε μοντέλα Amazon SageMaker για PyTorch και Hugging Face αντίστοιχα.

- Τέλος, τα μοντέλα μπορούν να αναπτυχθούν στο SageMaker και να χρησιμοποιηθούν με τις ακόλουθες επιλογές: τελικά σημεία συμπερασμάτων σε πραγματικό χρόνο, εργασίες μετασχηματισμού παρτίδας και ασύγχρονα τελικά σημεία συμπερασμάτων. Θα εξετάσουμε αυτές τις επιλογές με περισσότερες λεπτομέρειες αργότερα σε αυτήν την ανάρτηση.

Το παράδειγμα σημειωματάριου και ο κώδικας για αυτήν τη λύση είναι διαθέσιμα σε αυτό Αποθετήριο GitHub.

Εικόνα 1. Επισκόπηση των βασικών στοιχείων λύσης

Walkthrough

Φιλοξενία του μοντέλου Whisper στο Amazon SageMaker

Σε αυτήν την ενότητα, θα εξηγήσουμε τα βήματα για τη φιλοξενία του μοντέλου Whisper στο Amazon SageMaker, χρησιμοποιώντας PyTorch και Hugging Face Frameworks, αντίστοιχα. Για να πειραματιστείτε με αυτήν τη λύση, χρειάζεστε έναν λογαριασμό AWS και πρόσβαση στην υπηρεσία Amazon SageMaker.

Πλαίσιο PyTorch

- Αποθήκευση τεχνουργημάτων μοντέλων

Η πρώτη επιλογή φιλοξενίας του μοντέλου είναι να χρησιμοποιήσετε το Whisper επίσημο πακέτο Python, το οποίο μπορεί να εγκατασταθεί χρησιμοποιώντας pip install openai-whisper. Αυτό το πακέτο παρέχει ένα μοντέλο PyTorch. Κατά την αποθήκευση τεχνουργημάτων μοντέλων στο τοπικό αποθετήριο, το πρώτο βήμα είναι να αποθηκεύσετε τις παραμέτρους του μοντέλου που μπορούν να μάθουν, όπως τα βάρη μοντέλων και οι προκαταλήψεις κάθε επιπέδου στο νευρωνικό δίκτυο, ως αρχείο «pt». Μπορείτε να επιλέξετε από διαφορετικά μεγέθη μοντέλων, συμπεριλαμβανομένων των "μικροσκοπικών", "βασικών", "μικρών", "μεσαίων" και "μεγάλων". Τα μεγαλύτερα μεγέθη μοντέλων προσφέρουν υψηλότερη απόδοση ακρίβειας, αλλά έχουν κόστος μεγαλύτερης καθυστέρησης συμπερασμάτων. Επιπλέον, πρέπει να αποθηκεύσετε το λεξικό κατάστασης μοντέλου και το λεξικό διαστάσεων, τα οποία περιέχουν ένα λεξικό Python που αντιστοιχίζει κάθε επίπεδο ή παράμετρο του μοντέλου PyTorch στις αντίστοιχες παραμέτρους που μπορούν να μάθουν, μαζί με άλλα μεταδεδομένα και προσαρμοσμένες διαμορφώσεις. Ο παρακάτω κώδικας δείχνει πώς να αποθηκεύσετε τα τεχνουργήματα Whisper PyTorch.

- Επιλέξτε DLC

Το επόμενο βήμα είναι να επιλέξετε το προκατασκευασμένο DLC από αυτό σύνδεσμος. Να είστε προσεκτικοί όταν επιλέγετε τη σωστή εικόνα λαμβάνοντας υπόψη τις ακόλουθες ρυθμίσεις: πλαίσιο (PyTorch), έκδοση πλαισίου, εργασία (συμπερασματικά), έκδοση Python και υλικό (δηλαδή GPU). Συνιστάται να χρησιμοποιείτε τις πιο πρόσφατες εκδόσεις για το πλαίσιο και την Python όποτε είναι δυνατόν, καθώς αυτό έχει ως αποτέλεσμα καλύτερη απόδοση και αντιμετώπιση γνωστών προβλημάτων και σφαλμάτων από προηγούμενες εκδόσεις.

- Δημιουργήστε μοντέλα Amazon SageMaker

Στη συνέχεια, χρησιμοποιούμε το SDK SageMaker Python για τη δημιουργία μοντέλων PyTorch. Είναι σημαντικό να θυμάστε να προσθέτετε μεταβλητές περιβάλλοντος κατά τη δημιουργία ενός μοντέλου PyTorch. Από προεπιλογή, το TorchServe μπορεί να επεξεργαστεί μόνο μεγέθη αρχείων έως 6 MB, ανεξάρτητα από τον τύπο συμπερασμάτων που χρησιμοποιείται.

Ο παρακάτω πίνακας δείχνει τις ρυθμίσεις για διαφορετικές εκδόσεις PyTorch:

| Πλαίσιο | Μεταβλητές περιβάλλοντος |

| PyTorch 1.8 (βασισμένο στο TorchServe) | »TS_MAX_REQUEST_SIZE': '100000000'» TS_MAX_RESPONSE_SIZE': '100000000'» TS_DEFAULT_RESPONSE_TIMEOUT': '1000' |

| PyTorch 1.4 (βασισμένο σε MMS) | »MMS_MAX_REQUEST_SIZE': '1000000000'» MMS_MAX_RESPONSE_SIZE': '1000000000'» MMS_DEFAULT_RESPONSE_TIMEOUT': '900' |

- Ορίστε τη μέθοδο φόρτωσης μοντέλου στο inference.py

Στο έθιμο inference.py script, πρώτα ελέγχουμε για τη διαθεσιμότητα μιας GPU με δυνατότητα CUDA. Εάν μια τέτοια GPU είναι διαθέσιμη, τότε εκχωρούμε το 'cuda' συσκευή στο DEVICE μεταβλητός; διαφορετικά, αναθέτουμε το 'cpu' συσκευή. Αυτό το βήμα διασφαλίζει ότι το μοντέλο τοποθετείται στο διαθέσιμο υλικό για αποτελεσματικούς υπολογισμούς. Φορτώνουμε το μοντέλο PyTorch χρησιμοποιώντας το πακέτο Whisper Python.

Πλαίσιο Αγκαλιασμένου προσώπου

- Αποθήκευση τεχνουργημάτων μοντέλων

Η δεύτερη επιλογή είναι να χρησιμοποιήσετε Hugging Face's Whisper εκτέλεση. Το μοντέλο μπορεί να φορτωθεί χρησιμοποιώντας το AutoModelForSpeechSeq2Seq κατηγορία μετασχηματιστών. Οι μαθησιακές παράμετροι αποθηκεύονται σε ένα δυαδικό αρχείο (bin) χρησιμοποιώντας το save_pretrained μέθοδος. Το tokenizer και ο προεπεξεργαστής πρέπει επίσης να αποθηκευτούν χωριστά για να διασφαλιστεί ότι το μοντέλο Hugging Face λειτουργεί σωστά. Εναλλακτικά, μπορείτε να αναπτύξετε ένα μοντέλο στο Amazon SageMaker απευθείας από το Hugging Face Hub ορίζοντας δύο μεταβλητές περιβάλλοντος: HF_MODEL_ID και HF_TASK. Για περισσότερες πληροφορίες, ανατρέξτε σε αυτό ιστοσελίδα.

- Επιλέξτε DLC

Παρόμοια με το πλαίσιο του PyTorch, μπορείτε να επιλέξετε ένα προκατασκευασμένο DLC Hugging Face από το ίδιο σύνδεσμος. Βεβαιωθείτε ότι έχετε επιλέξει ένα DLC που υποστηρίζει τους πιο πρόσφατους μετασχηματιστές Hugging Face και περιλαμβάνει υποστήριξη GPU.

- Δημιουργήστε μοντέλα Amazon SageMaker

Ομοίως, χρησιμοποιούμε το SDK SageMaker Python για να δημιουργήσετε μοντέλα Hugging Face. Το μοντέλο Hugging Face Whisper έχει έναν προεπιλεγμένο περιορισμό όπου μπορεί να επεξεργαστεί μόνο τμήματα ήχου έως και 30 δευτερόλεπτα. Για να αντιμετωπίσετε αυτόν τον περιορισμό, μπορείτε να συμπεριλάβετε το chunk_length_s παράμετρος στη μεταβλητή περιβάλλοντος κατά τη δημιουργία του μοντέλου Hugging Face και αργότερα μεταβιβάστε αυτήν την παράμετρο στο προσαρμοσμένο σενάριο συμπερασμάτων κατά τη φόρτωση του μοντέλου. Τέλος, ορίστε τις μεταβλητές περιβάλλοντος για να αυξήσετε το μέγεθος ωφέλιμου φορτίου και το χρονικό όριο απόκρισης για το κοντέινερ Hugging Face.

| Πλαίσιο | Μεταβλητές περιβάλλοντος |

|

Δοχείο συμπερασμάτων HuggingFace (βάσει MMS) |

»MMS_MAX_REQUEST_SIZE': '2000000000'» MMS_MAX_RESPONSE_SIZE': '2000000000'» MMS_DEFAULT_RESPONSE_TIMEOUT': '900' |

- Ορίστε τη μέθοδο φόρτωσης μοντέλου στο inference.py

Όταν δημιουργούμε προσαρμοσμένο σενάριο συμπερασμάτων για το μοντέλο Hugging Face, χρησιμοποιούμε μια διοχέτευση, που μας επιτρέπει να περάσουμε το chunk_length_s ως παράμετρος. Αυτή η παράμετρος επιτρέπει στο μοντέλο να επεξεργάζεται αποτελεσματικά μεγάλα αρχεία ήχου κατά την εξαγωγή συμπερασμάτων.

Διερεύνηση διαφορετικών επιλογών συμπερασμάτων στο Amazon SageMaker

Τα βήματα για την επιλογή των επιλογών συμπερασμάτων είναι τα ίδια και για τα μοντέλα PyTorch και Hugging Face, επομένως δεν θα κάνουμε διαφοροποίηση μεταξύ τους παρακάτω. Ωστόσο, αξίζει να σημειωθεί ότι, τη στιγμή της συγγραφής αυτής της ανάρτησης, το συμπέρασμα χωρίς διακομιστή Η επιλογή από το SageMaker δεν υποστηρίζει GPU και, ως εκ τούτου, αποκλείουμε αυτήν την επιλογή για αυτήν την περίπτωση χρήσης.

Μπορούμε να αναπτύξουμε το μοντέλο ως τελικό σημείο σε πραγματικό χρόνο, παρέχοντας απαντήσεις σε χιλιοστά του δευτερολέπτου. Ωστόσο, είναι σημαντικό να σημειωθεί ότι αυτή η επιλογή περιορίζεται στην επεξεργασία εισόδων κάτω των 6 MB. Ορίζουμε τον σειριοποιητή ως σειριοποιητή ήχου, ο οποίος είναι υπεύθυνος για τη μετατροπή των δεδομένων εισόδου σε κατάλληλη μορφή για το αναπτυγμένο μοντέλο. Χρησιμοποιούμε μια παρουσία GPU για συμπέρασμα, επιτρέποντας την ταχεία επεξεργασία αρχείων ήχου. Η είσοδος συμπερασμάτων είναι ένα αρχείο ήχου που προέρχεται από το τοπικό αποθετήριο.

Η δεύτερη επιλογή συμπερασμάτων είναι η εργασία μετασχηματισμού παρτίδας, η οποία μπορεί να επεξεργαστεί ωφέλιμα φορτία εισόδου έως και 100 MB. Ωστόσο, αυτή η μέθοδος μπορεί να πάρει μερικά λεπτά καθυστέρησης. Κάθε παρουσία μπορεί να χειριστεί μόνο ένα αίτημα δέσμης κάθε φορά και η έναρξη και ο τερματισμός λειτουργίας του στιγμιότυπου απαιτούν επίσης λίγα λεπτά. Τα αποτελέσματα συμπερασμάτων αποθηκεύονται σε μια υπηρεσία απλής αποθήκευσης Amazon (Amazon S3) κουβά μετά την ολοκλήρωση της εργασίας μετασχηματισμού παρτίδας.

Κατά τη διαμόρφωση του μετασχηματιστή παρτίδας, φροντίστε να συμπεριλάβετε max_payload = 100 για την αποτελεσματική διαχείριση μεγαλύτερων ωφέλιμων φορτίων. Η είσοδος συμπερασμάτων θα πρέπει να είναι η διαδρομή Amazon S3 σε ένα αρχείο ήχου ή έναν φάκελο Amazon S3 Bucket που περιέχει μια λίστα αρχείων ήχου, το καθένα με μέγεθος μικρότερο από 100 MB.

Ο μετασχηματισμός παρτίδας χωρίζει τα αντικείμενα Amazon S3 στην είσοδο με κλειδί και αντιστοιχίζει τα αντικείμενα του Amazon S3 σε παρουσίες. Για παράδειγμα, όταν έχετε πολλά αρχεία ήχου, μια παρουσία μπορεί να επεξεργαστεί το input1.wav και μια άλλη παρουσία μπορεί να επεξεργαστεί το αρχείο με το όνομα input2.wav για να βελτιώσει την επεκτασιμότητα. Ο μετασχηματισμός παρτίδας σάς επιτρέπει να ρυθμίσετε τις παραμέτρους max_concurrent_transforms για να αυξήσετε τον αριθμό των αιτημάτων HTTP που γίνονται σε κάθε μεμονωμένο κοντέινερ μετασχηματιστή. Ωστόσο, είναι σημαντικό να σημειωθεί ότι η τιμή του (max_concurrent_transforms* max_payload) δεν πρέπει να υπερβαίνει τα 100 MB.

Τέλος, το Amazon SageMaker Asynchronous Inference είναι ιδανικό για την ταυτόχρονη επεξεργασία πολλαπλών αιτημάτων, προσφέροντας μέτρια καθυστέρηση και υποστηρίζοντας ωφέλιμα φορτία εισόδου έως και 1 GB. Αυτή η επιλογή παρέχει εξαιρετική επεκτασιμότητα, επιτρέποντας τη διαμόρφωση μιας ομάδας αυτόματης κλιμάκωσης για το τελικό σημείο. Όταν εμφανίζεται ένα κύμα αιτημάτων, κλιμακώνεται αυτόματα για να χειριστεί την κίνηση και μόλις υποβληθούν σε επεξεργασία όλα τα αιτήματα, το τελικό σημείο μειώνεται στο 0 για εξοικονόμηση κόστους.

Χρησιμοποιώντας ασύγχρονη συμπέρασμα, τα αποτελέσματα αποθηκεύονται αυτόματα σε έναν κάδο Amazon S3. Στο AsyncInferenceConfig, μπορείτε να διαμορφώσετε τις ειδοποιήσεις για επιτυχείς ή αποτυχημένες ολοκληρώσεις. Η διαδρομή εισόδου δείχνει σε μια θέση Amazon S3 του αρχείου ήχου. Για περισσότερες λεπτομέρειες, ανατρέξτε στον κωδικό στο GitHub.

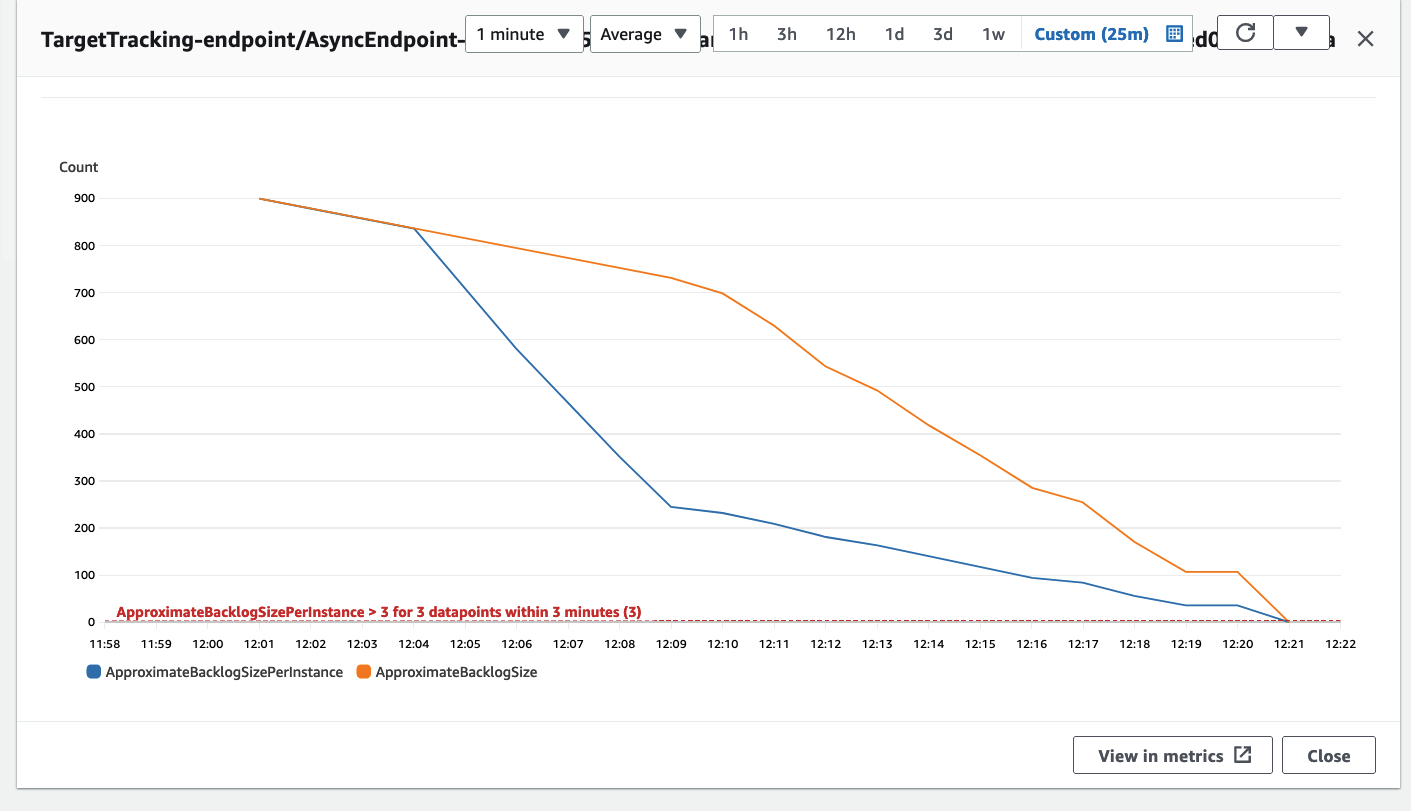

Προαιρετικά: Όπως αναφέρθηκε προηγουμένως, έχουμε την επιλογή να διαμορφώσουμε μια ομάδα αυτόματης κλιμάκωσης για το ασύγχρονο τελικό σημείο συμπερασμάτων, το οποίο της επιτρέπει να χειρίζεται μια ξαφνική αύξηση των αιτημάτων συμπερασμάτων. Ένα παράδειγμα κώδικα παρέχεται σε αυτό Αποθετήριο GitHub. Στο παρακάτω διάγραμμα, μπορείτε να παρατηρήσετε ένα γραμμικό γράφημα που εμφανίζει δύο μετρήσεις από amazoncloudwatch: ApproximateBacklogSize και ApproximateBacklogSizePerInstance. Αρχικά, όταν ενεργοποιήθηκαν 1000 αιτήματα, μόνο μία παρουσία ήταν διαθέσιμη για να χειριστεί το συμπέρασμα. Για τρία λεπτά, το μέγεθος του ανεκτέλετου ξεπερνούσε με συνέπεια τα τρία (σημειώστε ότι αυτοί οι αριθμοί μπορούν να διαμορφωθούν) και η ομάδα αυτόματης κλιμάκωσης ανταποκρίθηκε περιστρέφοντας πρόσθετες παρουσίες για να διαγράψει αποτελεσματικά το ανεκτέλεστο. Αυτό είχε ως αποτέλεσμα τη σημαντική μείωση του ApproximateBacklogSizePerInstance, επιτρέποντας την επεξεργασία των αιτημάτων εκκρεμότητας πολύ πιο γρήγορα από ό,τι κατά την αρχική φάση.

Εικόνα 2. Γράφημα γραμμών που απεικονίζει τις χρονικές αλλαγές στις μετρήσεις του Amazon CloudWatch

Συγκριτική ανάλυση για τις επιλογές συμπερασμάτων

Οι συγκρίσεις για διαφορετικές επιλογές συμπερασμάτων βασίζονται σε κοινές περιπτώσεις χρήσης επεξεργασίας ήχου. Το συμπέρασμα σε πραγματικό χρόνο προσφέρει την ταχύτερη ταχύτητα συμπερασμάτων, αλλά περιορίζει το μέγεθος ωφέλιμου φορτίου στα 6 MB. Αυτός ο τύπος συμπερασμάτων είναι κατάλληλος για συστήματα ηχητικών εντολών, όπου οι χρήστες ελέγχουν ή αλληλεπιδρούν με συσκευές ή λογισμικό χρησιμοποιώντας φωνητικές εντολές ή προφορικές οδηγίες. Οι φωνητικές εντολές είναι συνήθως μικρού μεγέθους και η χαμηλή καθυστέρηση συμπερασμάτων είναι ζωτικής σημασίας για να διασφαλιστεί ότι οι μεταγραφόμενες εντολές μπορούν να ενεργοποιήσουν αμέσως επόμενες ενέργειες. Το Batch Transform είναι ιδανικό για προγραμματισμένες εργασίες εκτός σύνδεσης, όταν το μέγεθος κάθε αρχείου ήχου είναι κάτω από 100 MB και δεν υπάρχει συγκεκριμένη απαίτηση για γρήγορους χρόνους απόκρισης συμπερασμάτων. Το ασύγχρονο συμπέρασμα επιτρέπει μεταφορτώσεις έως και 1 GB και προσφέρει μέτρια καθυστέρηση συμπερασμάτων. Αυτός ο τύπος συμπερασμάτων είναι κατάλληλος για τη μεταγραφή ταινιών, τηλεοπτικών σειρών και εγγεγραμμένων συνεδρίων όπου χρειάζεται επεξεργασία μεγαλύτερων αρχείων ήχου.

Τόσο οι επιλογές συμπερασμάτων σε πραγματικό χρόνο όσο και οι ασύγχρονες επιλογές παρέχουν δυνατότητες αυτόματης κλιμάκωσης, επιτρέποντας στις παρουσίες τελικού σημείου να κλιμακώνονται αυτόματα προς τα πάνω ή προς τα κάτω με βάση τον όγκο των αιτημάτων. Σε περιπτώσεις χωρίς αιτήματα, η αυτόματη κλιμάκωση αφαιρεί περιττές παρουσίες, βοηθώντας σας να αποφύγετε το κόστος που σχετίζεται με παρεχόμενες παρουσίες που δεν χρησιμοποιούνται ενεργά. Ωστόσο, για συμπέρασμα σε πραγματικό χρόνο, πρέπει να διατηρηθεί τουλάχιστον μία επίμονη παρουσία, η οποία θα μπορούσε να οδηγήσει σε υψηλότερο κόστος εάν το τελικό σημείο λειτουργεί συνεχώς. Αντίθετα, το ασύγχρονο συμπέρασμα επιτρέπει τη μείωση του όγκου του στιγμιότυπου στο 0 όταν δεν χρησιμοποιείται. Κατά τη διαμόρφωση μιας εργασίας μετασχηματισμού παρτίδας, είναι δυνατή η χρήση πολλαπλών παρουσιών για την επεξεργασία της εργασίας και η προσαρμογή των max_concurrent_transforms για να επιτραπεί σε μία παρουσία να χειρίζεται πολλαπλά αιτήματα. Επομένως, και οι τρεις επιλογές συμπερασμάτων προσφέρουν μεγάλη επεκτασιμότητα.

Καθαρισμό

Μόλις ολοκληρώσετε τη χρήση της λύσης, βεβαιωθείτε ότι έχετε αφαιρέσει τα τελικά σημεία του SageMaker για να αποφύγετε την επιβάρυνση επιπλέον κόστους. Μπορείτε να χρησιμοποιήσετε τον παρεχόμενο κώδικα για να διαγράψετε τελικά σημεία συμπερασμάτων σε πραγματικό χρόνο και ασύγχρονα, αντίστοιχα.

Συμπέρασμα

Σε αυτήν την ανάρτηση, σας δείξαμε πώς η ανάπτυξη μοντέλων μηχανικής εκμάθησης για επεξεργασία ήχου έχει γίνει όλο και πιο απαραίτητη σε διάφορους κλάδους. Λαμβάνοντας ως παράδειγμα το μοντέλο Whisper, δείξαμε πώς να φιλοξενούμε μοντέλα ASR ανοιχτού κώδικα στο Amazon SageMaker χρησιμοποιώντας προσεγγίσεις PyTorch ή Hugging Face. Η εξερεύνηση περιλάμβανε διάφορες επιλογές συμπερασμάτων στο Amazon SageMaker, προσφέροντας πληροφορίες για τον αποτελεσματικό χειρισμό δεδομένων ήχου, την πραγματοποίηση προβλέψεων και την αποτελεσματική διαχείριση του κόστους. Αυτή η ανάρτηση στοχεύει να παρέχει γνώσεις σε ερευνητές, προγραμματιστές και επιστήμονες δεδομένων που ενδιαφέρονται να αξιοποιήσουν το μοντέλο Whisper για εργασίες που σχετίζονται με τον ήχο και να λαμβάνουν τεκμηριωμένες αποφάσεις σχετικά με στρατηγικές συμπερασμάτων.

Για πιο λεπτομερείς πληροφορίες σχετικά με την ανάπτυξη μοντέλων στο SageMaker, ανατρέξτε σε αυτό Οδηγός προγραμματιστή. Επιπλέον, το μοντέλο Whisper μπορεί να αναπτυχθεί χρησιμοποιώντας το SageMaker JumpStart. Για περισσότερες λεπτομέρειες, παρακαλούμε ελέγξτε το Τα μοντέλα Whisper για αυτόματη αναγνώριση ομιλίας είναι πλέον διαθέσιμα στο Amazon SageMaker JumpStart Θέση.

Μη διστάσετε να δείτε το σημειωματάριο και τον κώδικα για αυτό το έργο GitHub και μοιραστείτε το σχόλιό σας μαζί μας.

Σχετικά με το Συγγραφέας

Ying Hou, PhD, είναι Αρχιτέκτονας Μηχανικής Μάθησης Πρωτότυπων στην AWS. Οι κύριοι τομείς ενδιαφέροντός της περιλαμβάνουν το Deep Learning, με έμφαση στο GenAI, το Computer Vision, το NLP και την πρόβλεψη δεδομένων χρονοσειρών. Στον ελεύθερο χρόνο της, απολαμβάνει να περνά ποιοτικές στιγμές με την οικογένειά της, να βυθίζεται σε μυθιστορήματα και να κάνει πεζοπορία στα εθνικά πάρκα του Ηνωμένου Βασιλείου.

Ying Hou, PhD, είναι Αρχιτέκτονας Μηχανικής Μάθησης Πρωτότυπων στην AWS. Οι κύριοι τομείς ενδιαφέροντός της περιλαμβάνουν το Deep Learning, με έμφαση στο GenAI, το Computer Vision, το NLP και την πρόβλεψη δεδομένων χρονοσειρών. Στον ελεύθερο χρόνο της, απολαμβάνει να περνά ποιοτικές στιγμές με την οικογένειά της, να βυθίζεται σε μυθιστορήματα και να κάνει πεζοπορία στα εθνικά πάρκα του Ηνωμένου Βασιλείου.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- PlatoHealth. Ευφυΐα βιοτεχνολογίας και κλινικών δοκιμών. Πρόσβαση εδώ.

- πηγή: https://aws.amazon.com/blogs/machine-learning/host-the-whisper-model-on-amazon-sagemaker-exploring-inference-options/

- :έχει

- :είναι

- :δεν

- :που

- $UP

- 1

- 10

- 100

- 12

- 14

- 140

- 16

- 19

- 30

- 32

- 7

- 8

- 900

- a

- επιτάχυνση

- πρόσβαση

- προσιτότητα

- Λογαριασμός

- ακρίβεια

- απέναντι

- ενεργειών

- δραστήρια

- προσθέτω

- Πρόσθετος

- Επιπλέον

- διεύθυνση

- προηγμένες

- AI

- στόχοι

- Όλα

- Επιτρέποντας

- επιτρέπει

- κατά μήκος

- Επίσης

- Amazon

- Amazon Sage Maker

- Amazon υπηρεσίες Web

- an

- ανάλυση

- και

- Άλλος

- κάθε

- εφαρμογές

- προσεγγίσεις

- ΕΙΝΑΙ

- περιοχές

- Παράταξη

- τεχνητός

- τεχνητή νοημοσύνη

- AS

- προσόν

- βοηθούς

- συσχετισμένη

- At

- ήχου

- Συγγραφή

- Αυτόματο

- αυτομάτως

- διαθεσιμότητα

- διαθέσιμος

- αποφύγετε

- AWS

- βάση

- βασίζονται

- BE

- γίνονται

- παρακάτω

- Καλύτερα

- μεταξύ

- μεροληψίες

- BIN

- και οι δύο

- σφάλματα

- αλλά

- by

- CAN

- δυνατότητες

- ικανός

- προσεκτικός

- περιπτώσεις

- Αλλαγές

- Διάγραμμα

- έλεγχος

- Επιλέξτε

- επιλέγοντας

- τάξη

- καθαρός

- κωδικός

- Ελάτε

- σχόλιο

- Κοινός

- συγκρίνοντας

- συγκρίσεις

- Ολοκληρώθηκε το

- ολοκλήρωση

- εξαρτήματα

- περιεκτικός

- υπολογισμός

- υπολογιστή

- Computer Vision

- Διεξαγωγή

- συνέδρια

- διαμόρφωση

- έχει ρυθμιστεί

- Διαμόρφωση

- θεωρώντας

- με συνέπεια

- περιέχουν

- Δοχείο

- Εμπορευματοκιβώτια

- συνεχώς

- αντίθεση

- έλεγχος

- μετατροπή

- διορθώσει

- Αντίστοιχος

- Κόστος

- Δικαστικά έξοδα

- θα μπορούσε να

- δημιουργία

- δημιουργία

- κρίσιμος

- έθιμο

- ημερομηνία

- αποφάσεις

- μείωση

- βαθύς

- βαθιά μάθηση

- Προεπιλογή

- ορίζεται

- κατέδειξε

- παρατάσσω

- αναπτυχθεί

- ανάπτυξη

- ανάπτυξη

- λεπτομέρεια

- λεπτομερής

- καθέκαστα

- ανάπτυξη

- προγραμματιστές

- Ανάπτυξη

- συσκευή

- Συσκευές

- διαφορετικές

- διαφοροποιούν

- Διάσταση

- κατευθείαν

- εμφάνιση

- κατάδυση

- διάφορα

- Λιμενεργάτης

- Όχι

- πράξη

- κάτω

- κατά την διάρκεια

- e

- κάθε

- Νωρίτερα

- οικοσύστημα

- αποτελεσματικά

- αποτελεσματικός

- αποτελεσματικά

- ΧΩΡΙΣ κοπο

- είτε

- αλλιώς

- επιβιβάζομαι

- εξουσιοδοτεί

- ενεργοποιήσετε

- δίνει τη δυνατότητα

- ενεργοποίηση

- περικυκλώ

- καλύπτονται

- Τελικό σημείο

- ενίσχυση

- ενίσχυση

- εξασφαλίζω

- εξασφαλίζει

- Ολόκληρος

- Περιβάλλον

- ουσιώδης

- δημιουργία

- παράδειγμα

- υπερβαίνω

- υπέρβαση

- έξοχος

- πείραμα

- Εξηγήστε

- εξερεύνηση

- Εξερευνώντας

- Πρόσωπο

- Απέτυχε

- ψευδής

- οικογένεια

- FAST

- γρηγορότερα

- ταχύτερα

- λίγοι

- Αρχεία

- Αρχεία

- ευρήματα

- Όνομα

- Συγκέντρωση

- εστιάζοντας

- Εξής

- Για

- μορφή

- Πλαίσιο

- πλαισίων

- Δωρεάν

- από

- πλήρη

- GPU

- GPU

- εξαιρετική

- Group

- λαβή

- Χειρισμός

- υλικού

- Έχω

- ακοή

- βοήθεια

- αυτήν

- Ψηλά

- υψηλότερο

- οικοδεσπότης

- φιλοξενία

- Πως

- Πώς να

- Ωστόσο

- HTML

- http

- HTTPS

- Hub

- Πρόσωπο αγκαλιάς

- i

- ιδανικό

- if

- εικονογραφώντας

- εικόνα

- εικόνες

- εκτέλεση

- υλοποιήσεις

- εισαγωγή

- σημαντικό

- in

- σε βάθος

- περιλαμβάνουν

- περιλαμβάνει

- Συμπεριλαμβανομένου

- ενσωματώνω

- Αυξάνουν

- όλο και περισσότερο

- ατομικές

- άτομα

- βιομηχανίες

- πληροφορίες

- ενημερώνεται

- αρχικός

- αρχικά

- μύηση

- εισαγωγή

- είσοδοι

- ιδέες

- εγκαθιστώ

- εγκατασταθεί

- παράδειγμα

- οδηγίες

- Ενσωμάτωση

- Νοημοσύνη

- αλληλεπιδρούν

- τόκος

- ενδιαφερόμενος

- περιβάλλον λειτουργίας

- σε

- θέματα

- IT

- ΤΟΥ

- Δουλειά

- Θέσεις εργασίας

- jpg

- Κλειδί

- γνώση

- γνωστός

- τοπίο

- μεγαλύτερος

- εν τέλει

- Αφάνεια

- αργότερα

- αργότερο

- στρώμα

- οδηγήσει

- μάθηση

- ελάχιστα

- μόχλευσης

- Άδεια

- περιορισμός

- Περιωρισμένος

- γραμμή

- Λιστα

- φορτίο

- φόρτωση

- τοπικός

- τοποθεσία

- Μακριά

- πλέον

- Χαμηλός

- μηχανή

- μάθηση μηχανής

- που

- Κυρίως

- κάνω

- ΚΑΝΕΙ

- Κατασκευή

- διαχείριση

- διαχείριση

- χάρτες

- Ενδέχεται..

- που αναφέρθηκαν

- Μεταδεδομένα

- μέθοδος

- μέθοδοι

- Metrics

- ενδέχεται να

- χιλιοστά του δευτερολέπτου

- Λεπτ.

- MIT

- ML

- μοντέλο

- μοντέλα

- μέτριος

- Στιγμές

- παρακολούθηση

- περισσότερο

- Κινηματογράφος

- πολύ

- πολλαπλούς

- πρέπει

- Ονομάστηκε

- εθνικός

- απαραίτητος

- Ανάγκη

- που απαιτούνται

- δίκτυο

- νευρικός

- νευρικό σύστημα

- επόμενη

- nlp

- Όχι.

- σημείωση

- σημειωματάριο

- Notes

- κοινοποίηση

- κοινοποιήσεις

- σημειώνοντας

- τώρα

- αριθμός

- αριθμοί

- αντικείμενο

- αντικειμένων

- παρατηρούμε

- of

- προσφορά

- προσφορά

- προσφορές

- επίσημος ανώτερος υπάλληλος

- offline

- on

- μια φορά

- ONE

- αποκλειστικά

- ανοικτού κώδικα

- λειτουργεί

- Επιλογή

- Επιλογές

- or

- τάξη

- οργανώσεις

- OS

- ΑΛΛΑ

- αλλιώς

- έξω

- επισκόπηση

- πακέτο

- Packages

- παράμετρος

- παράμετροι

- passieren

- μονοπάτι

- Εκτελέστε

- επίδοση

- φάση

- αγωγού

- πιλοτικές

- πλατφόρμες

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- σας παρακαλούμε

- σημεία

- δυνατός

- Θέση

- δυναμικού

- πρόβλεψη

- Προβλέψεις

- πρόληψη

- προηγούμενος

- πρωταρχικός

- διαδικασια μας

- Επεξεργασμένο

- μεταποίηση

- Επεξεργαστής

- σχέδιο

- δεόντως

- προτυποποίηση

- παρέχουν

- παρέχεται

- παρέχει

- χορήγηση

- Python

- pytorch

- ποιότητα

- σειρά

- σε πραγματικό χρόνο

- βασίλειο

- αναγνώριση

- συνιστάται

- καταγράφονται

- Μειωμένος

- παραπέμπω

- Ανεξάρτητα

- σχετίζεται με

- Δελτία

- θυμάμαι

- αφαιρέστε

- Αφαιρεί

- Αποθήκη

- ζητήσει

- αιτήματα

- απαιτούν

- απαιτείται

- απαίτηση

- ερευνητές

- αντίστοιχα

- απάντησης

- απαντήσεις

- υπεύθυνος

- αποτέλεσμα

- Αποτελέσματα

- απόδοση

- σοφός

- ίδιο

- Αποθήκευση

- αποθηκεύονται

- οικονομία

- Απεριόριστες δυνατότητες

- Κλίμακα

- Ζυγός

- προγραμματιστεί

- επιστήμονες

- γραφή

- Εφαρμογές

- Δεύτερος

- δευτερόλεπτα

- Τμήμα

- τμήματα

- επιλέξτε

- επιλέγονται

- επιλογή

- Σειρές

- υπηρεσία

- Υπηρεσίες

- σειρά

- τον καθορισμό

- ρυθμίσεις

- Κοινοποίηση

- αυτή

- θα πρέπει να

- έδειξε

- Δείχνει

- κλείσιμο

- σημαντικός

- Απλούς

- απλοποιεί

- Μέγεθος

- μεγέθη

- small

- μικρότερος

- So

- λογισμικό

- λύση

- συγκεκριμένες

- ειδικά

- καθορίζεται

- ομιλία

- Αναγνώριση ομιλίας

- ταχύτητα

- Δαπάνες

- ομιλείται

- Εκκίνηση

- Κατάσταση

- state-of-the-art

- Βήμα

- Βήματα

- χώρος στο δίσκο

- στρατηγικές

- μεταγενέστερος

- επιτυχής

- τέτοιος

- αιφνίδιος

- κατάλληλος

- υποστήριξη

- Στήριξη

- Υποστηρίζει

- βέβαιος

- ανακύπτει

- συστήματα

- τραπέζι

- Πάρτε

- λήψη

- Έργο

- εργασίες

- Τεχνολογία

- από

- ότι

- Η

- το Ηνωμένο Βασίλειο

- τους

- Τους

- τότε

- Εκεί.

- επομένως

- Αυτοί

- αυτοί

- αυτό

- τρία

- ώρα

- Χρονική σειρά

- φορές

- προς την

- εργαλεία

- δάδα

- ΚΙΝΗΣΗ στους ΔΡΟΜΟΥΣ

- Τρένο

- εκπαιδευμένο

- Μεταμορφώστε

- μετασχηματιστής

- μετασχηματιστές

- ενεργοποιούν

- ενεργοποιήθηκε

- tv

- δύο

- τύπος

- συνήθως

- Uk

- υπό

- ξεκλειδώματος

- περιττός

- επάνω σε

- us

- χρήση

- μεταχειρισμένος

- φιλική προς το χρήστη

- Χρήστες

- χρησιμοποιώντας

- χρησιμότητα

- χρησιμοποιώ

- αξιοποιώντας

- Πολύτιμος

- αξία

- μεταβλητή

- διάφορα

- Σταθερή

- εκδοχή

- εκδόσεις

- όραμα

- Φωνή

- τόμος

- περιμένετε

- θέλω

- ήταν

- we

- ιστός

- διαδικτυακές υπηρεσίες

- ΛΟΙΠΌΝ

- ήταν

- πότε

- οποτεδήποτε

- Ποιό

- Whisper - Ακουστικά

- ευρύς

- Ευρύ φάσμα

- με

- εντός

- ροής εργασίας

- λειτουργεί

- αξία

- γραφή

- Εσείς

- Σας

- zephyrnet