ZOO Digital παρέχει υπηρεσίες τοπικής προσαρμογής και πολυμέσων από άκρο σε άκρο για την προσαρμογή του πρωτότυπου περιεχομένου τηλεόρασης και ταινιών σε διαφορετικές γλώσσες, περιοχές και πολιτισμούς. Διευκολύνει την παγκοσμιοποίηση για τους καλύτερους δημιουργούς περιεχομένου στον κόσμο. Έμπιστος από τα μεγαλύτερα ονόματα της ψυχαγωγίας, το ZOO Digital παρέχει υψηλής ποιότητας υπηρεσίες τοπικής προσαρμογής και πολυμέσων σε κλίμακα, όπως μεταγλώττιση, υποτιτλισμό, σενάριο και συμμόρφωση.

Οι τυπικές ροές εργασίας τοπικής προσαρμογής απαιτούν χειροκίνητη diarization ηχείων, όπου μια ροή ήχου τμηματοποιείται με βάση την ταυτότητα του ηχείου. Αυτή η χρονοβόρα διαδικασία πρέπει να ολοκληρωθεί πριν το περιεχόμενο μπορεί να μεταγλωττιστεί σε άλλη γλώσσα. Με τις μη αυτόματες μεθόδους, ένα επεισόδιο διάρκειας 30 λεπτών μπορεί να διαρκέσει από 1 έως 3 ώρες για να εντοπιστεί. Μέσω της αυτοματοποίησης, η ZOO Digital στοχεύει να επιτύχει εντοπισμό σε λιγότερο από 30 λεπτά.

Σε αυτήν την ανάρτηση, συζητάμε την ανάπτυξη κλιμακούμενων μοντέλων μηχανικής εκμάθησης (ML) για την ημερολογιακή χρήση περιεχομένου πολυμέσων Amazon Sage Maker, με έμφαση στο WhisperX μοντέλο.

Ιστορικό

Το όραμα της ZOO Digital είναι να παρέχει ταχύτερη αλλαγή τοπικού περιεχομένου. Αυτός ο στόχος περιορίζεται από τη χειρωνακτική εντατική φύση της άσκησης που επιδεινώνεται από το μικρό εργατικό δυναμικό των ειδικευμένων ατόμων που μπορούν να τοποποιήσουν το περιεχόμενο χειροκίνητα. Το ZOO Digital συνεργάζεται με περισσότερους από 11,000 ελεύθερους επαγγελματίες και τοπικοποίησε πάνω από 600 εκατομμύρια λέξεις μόνο το 2022. Ωστόσο, η προσφορά ειδικευμένων ατόμων ξεπερνιέται από την αυξανόμενη ζήτηση για περιεχόμενο, που απαιτεί αυτοματοποίηση για να βοηθήσει στις ροές εργασιών τοπικής προσαρμογής.

Με στόχο την επιτάχυνση της τοπικής προσαρμογής των ροών εργασίας περιεχομένου μέσω της μηχανικής εκμάθησης, η ZOO Digital δέσμευσε το AWS Prototyping, ένα επενδυτικό πρόγραμμα της AWS για την από κοινού δημιουργία φόρτου εργασίας με πελάτες. Η δέσμευση επικεντρώθηκε στην παροχή μιας λειτουργικής λύσης για τη διαδικασία τοπικής προσαρμογής, παρέχοντας παράλληλα πρακτική εκπαίδευση σε προγραμματιστές ZOO Digital στο SageMaker, Μεταγραφή Amazon, να Amazon Μετάφραση.

Πρόκληση πελάτη

Μετά τη μεταγραφή ενός τίτλου (μιας ταινίας ή ενός επεισοδίου μιας τηλεοπτικής σειράς), οι ομιλητές πρέπει να αντιστοιχιστούν σε κάθε τμήμα της ομιλίας, ώστε να μπορούν να αντιστοιχιστούν σωστά στους καλλιτέχνες φωνής που καλούνται να παίξουν τους χαρακτήρες. Αυτή η διαδικασία ονομάζεται diarization ομιλητών. Η ZOO Digital αντιμετωπίζει την πρόκληση της ημερολογιακής παραγωγής περιεχομένου σε κλίμακα ενώ είναι οικονομικά βιώσιμη.

Επισκόπηση λύσεων

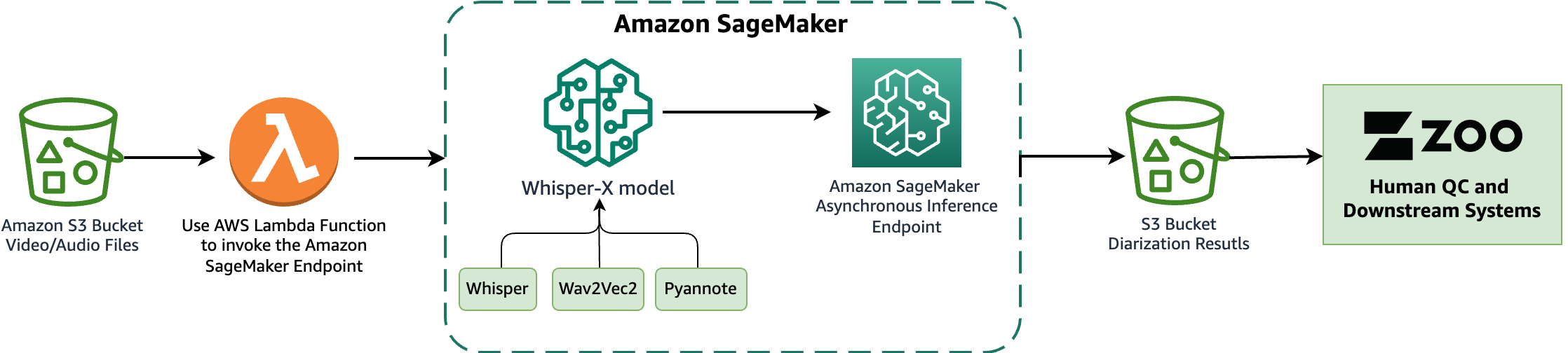

Σε αυτό το πρωτότυπο, αποθηκεύσαμε τα αρχικά αρχεία πολυμέσων σε ένα καθορισμένο Απλή υπηρεσία αποθήκευσης Amazon (Amazon S3) κάδος. Αυτός ο κάδος S3 διαμορφώθηκε για να εκπέμπει ένα συμβάν όταν εντοπίζονται νέα αρχεία μέσα σε αυτόν, ενεργοποιώντας ένα AWS Lambda λειτουργία. Για οδηγίες σχετικά με τη διαμόρφωση αυτής της σκανδάλης, ανατρέξτε στον οδηγό Χρησιμοποιώντας μια σκανδάλη Amazon S3 για την κλήση μιας συνάρτησης Lambda. Στη συνέχεια, η συνάρτηση Lambda επικαλέστηκε το τελικό σημείο του SageMaker για συμπέρασμα χρησιμοποιώντας το Πελάτης Boto3 SageMaker Runtime.

Η WhisperX μοντέλο, με βάση Ο Whisper του OpenAI, εκτελεί μεταγραφές και ημερολογίες για στοιχεία μέσων. Είναι χτισμένο πάνω στο Ταχύτερος Ψίθυρος εκ νέου υλοποίηση, προσφέροντας έως και τέσσερις φορές ταχύτερη μεταγραφή με βελτιωμένη στοίχιση χρονικής σήμανσης σε επίπεδο λέξης σε σύγκριση με το Whisper. Επιπρόσθετα, εισάγει τη ρύθμιση ηχείων, που δεν υπάρχει στο αρχικό μοντέλο Whisper. Το WhisperX χρησιμοποιεί το μοντέλο Whisper για μεταγραφές, το Wav2Vec2 μοντέλο για τη βελτίωση της ευθυγράμμισης χρονικών σφραγίδων (διασφάλιση συγχρονισμού του μεταγραμμένου κειμένου με ηχητικές χρονικές σημάνσεις) και πυανότο μοντέλο για diarization. FFmpeg χρησιμοποιείται για τη φόρτωση ήχου από μέσα πηγής, υποστηρίζοντας διάφορα μορφές πολυμέσων. Η διαφανής και αρθρωτή αρχιτεκτονική του μοντέλου επιτρέπει ευελιξία, επειδή κάθε στοιχείο του μοντέλου μπορεί να αντικατασταθεί όπως απαιτείται στο μέλλον. Ωστόσο, είναι σημαντικό να σημειωθεί ότι το WhisperX δεν διαθέτει πλήρεις δυνατότητες διαχείρισης και δεν είναι προϊόν σε επίπεδο επιχείρησης. Χωρίς συντήρηση και υποστήριξη, ενδέχεται να μην είναι κατάλληλο για ανάπτυξη παραγωγής.

Σε αυτήν τη συνεργασία, αναπτύξαμε και αξιολογήσαμε το WhisperX στο SageMaker, χρησιμοποιώντας ένα ασύγχρονο τελικό σημείο συμπερασμάτων για να φιλοξενήσει το μοντέλο. Τα ασύγχρονα τελικά σημεία του SageMaker υποστηρίζουν μεγέθη μεταφόρτωσης έως και 1 GB και ενσωματώνουν λειτουργίες αυτόματης κλιμάκωσης που μετριάζουν αποτελεσματικά τις αυξήσεις της κυκλοφορίας και εξοικονομούν κόστος σε περιόδους εκτός αιχμής. Τα ασύγχρονα τελικά σημεία είναι ιδιαίτερα κατάλληλα για την επεξεργασία μεγάλων αρχείων, όπως ταινίες και τηλεοπτικές σειρές στην περίπτωση χρήσης μας.

Το παρακάτω διάγραμμα απεικονίζει τα βασικά στοιχεία των πειραμάτων που πραγματοποιήσαμε σε αυτή τη συνεργασία.

Στις επόμενες ενότητες, εμβαθύνουμε στις λεπτομέρειες της ανάπτυξης του μοντέλου WhisperX στο SageMaker και αξιολογούμε την απόδοση της διάκρισης.

Κατεβάστε το μοντέλο και τα στοιχεία του

Το WhisperX είναι ένα σύστημα που περιλαμβάνει πολλαπλά μοντέλα για μεταγραφή, αναγκαστική ευθυγράμμιση και διάκριση. Για ομαλή λειτουργία του SageMaker χωρίς την ανάγκη ανάκτησης τεχνουργημάτων μοντέλων κατά τη διάρκεια της εξαγωγής συμπερασμάτων, είναι απαραίτητο να κάνετε εκ των προτέρων λήψη όλων των τεχνουργημάτων μοντέλων. Αυτά τα τεχνουργήματα στη συνέχεια φορτώνονται στο κοντέινερ σερβιρίσματος SageMaker κατά την εκκίνηση. Επειδή αυτά τα μοντέλα δεν είναι άμεσα προσβάσιμα, προσφέρουμε περιγραφές και δείγμα κώδικα από την πηγή WhisperX, παρέχοντας οδηγίες σχετικά με τη λήψη του μοντέλου και των στοιχείων του.

Το WhisperX χρησιμοποιεί έξι μοντέλα:

Τα περισσότερα από αυτά τα μοντέλα μπορούν να ληφθούν από Αγκαλιάζοντας το πρόσωπο χρησιμοποιώντας τη βιβλιοθήκη huggingface_hub. Χρησιμοποιούμε τα παρακάτω download_hf_model() λειτουργία για την ανάκτηση αυτών των τεχνουργημάτων μοντέλων. Απαιτείται ένα διακριτικό πρόσβασης από το Hugging Face, το οποίο δημιουργήθηκε μετά την αποδοχή των συμφωνιών χρήστη για τα ακόλουθα μοντέλα pyannote:

import huggingface_hub

import yaml

import torchaudio

import urllib.request

import os CONTAINER_MODEL_DIR = "/opt/ml/model"

WHISPERX_MODEL = "guillaumekln/faster-whisper-large-v2"

VAD_MODEL_URL = "https://whisperx.s3.eu-west-2.amazonaws.com/model_weights/segmentation/0b5b3216d60a2d32fc086b47ea8c67589aaeb26b7e07fcbe620d6d0b83e209ea/pytorch_model.bin"

WAV2VEC2_MODEL = "WAV2VEC2_ASR_BASE_960H"

DIARIZATION_MODEL = "pyannote/speaker-diarization" def download_hf_model(model_name: str, hf_token: str, local_model_dir: str) -> str: """ Fetches the provided model from HuggingFace and returns the subdirectory it is downloaded to :param model_name: HuggingFace model name (and an optional version, appended with @[version]) :param hf_token: HuggingFace access token authorized to access the requested model :param local_model_dir: The local directory to download the model to :return: The subdirectory within local_modeL_dir that the model is downloaded to """ model_subdir = model_name.split('@')[0] huggingface_hub.snapshot_download(model_subdir, token=hf_token, local_dir=f"{local_model_dir}/{model_subdir}", local_dir_use_symlinks=False) return model_subdir

Το μοντέλο VAD έχει ληφθεί από το Amazon S3 και το μοντέλο Wav2Vec2 ανακτάται από τη μονάδα torchaudio.pipelines. Με βάση τον παρακάτω κώδικα, μπορούμε να ανακτήσουμε όλα τα τεχνουργήματα των μοντέλων, συμπεριλαμβανομένων αυτών από το Hugging Face, και να τα αποθηκεύσουμε στον καθορισμένο τοπικό κατάλογο μοντέλων:

def fetch_models(hf_token: str, local_model_dir="./models"): """ Fetches all required models to run WhisperX locally without downloading models every time :param hf_token: A huggingface access token to download the models :param local_model_dir: The directory to download the models to """ # Fetch Faster Whisper's Large V2 model from HuggingFace download_hf_model(model_name=WHISPERX_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Fetch WhisperX's VAD Segmentation model from S3 vad_model_dir = "whisperx/vad" if not os.path.exists(f"{local_model_dir}/{vad_model_dir}"): os.makedirs(f"{local_model_dir}/{vad_model_dir}") urllib.request.urlretrieve(VAD_MODEL_URL, f"{local_model_dir}/{vad_model_dir}/pytorch_model.bin") # Fetch the Wav2Vec2 alignment model torchaudio.pipelines.__dict__[WAV2VEC2_MODEL].get_model(dl_kwargs={"model_dir": f"{local_model_dir}/wav2vec2/"}) # Fetch pyannote's Speaker Diarization model from HuggingFace download_hf_model(model_name=DIARIZATION_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Read in the Speaker Diarization model config to fetch models and update with their local paths with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'r') as file: diarization_config = yaml.safe_load(file) embedding_model = diarization_config['pipeline']['params']['embedding'] embedding_model_dir = download_hf_model(model_name=embedding_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['embedding'] = f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}" segmentation_model = diarization_config['pipeline']['params']['segmentation'] segmentation_model_dir = download_hf_model(model_name=segmentation_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['segmentation'] = f"{CONTAINER_MODEL_DIR}/{segmentation_model_dir}/pytorch_model.bin" with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'w') as file: yaml.safe_dump(diarization_config, file) # Read in the Speaker Embedding model config to update it with its local path speechbrain_hyperparams_path = f"{local_model_dir}/{embedding_model_dir}/hyperparams.yaml" with open(speechbrain_hyperparams_path, 'r') as file: speechbrain_hyperparams = file.read() speechbrain_hyperparams = speechbrain_hyperparams.replace(embedding_model_dir, f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}") with open(speechbrain_hyperparams_path, 'w') as file: file.write(speechbrain_hyperparams)

Επιλέξτε το κατάλληλο AWS Deep Learning Container για την εξυπηρέτηση του μοντέλου

Αφού αποθηκευτούν τα τεχνουργήματα του μοντέλου χρησιμοποιώντας το προηγούμενο δείγμα κώδικα, μπορείτε να επιλέξετε προκατασκευασμένο Εμπορευματοκιβώτια βαθιάς μάθησης AWS (DLC) από τα παρακάτω GitHub repo. Όταν επιλέγετε την εικόνα Docker, λάβετε υπόψη τις ακόλουθες ρυθμίσεις: πλαίσιο (Hugging Face), εργασία (συμπεράσματα), έκδοση Python και υλικό (για παράδειγμα, GPU). Συνιστούμε να χρησιμοποιήσετε την παρακάτω εικόνα: 763104351884.dkr.ecr.[REGION].amazonaws.com/huggingface-pytorch-inference:2.0.0-transformers4.28.1-gpu-py310-cu118-ubuntu20.04 Αυτή η εικόνα έχει όλα τα απαραίτητα πακέτα συστήματος προεγκατεστημένα, όπως το ffmpeg. Θυμηθείτε να αντικαταστήσετε το [REGION] με την περιοχή AWS που χρησιμοποιείτε.

Για άλλα απαιτούμενα πακέτα Python, δημιουργήστε ένα requirements.txt αρχείο με μια λίστα πακέτων και τις εκδόσεις τους. Αυτά τα πακέτα θα εγκατασταθούν όταν δημιουργηθεί το AWS DLC. Τα ακόλουθα είναι τα πρόσθετα πακέτα που απαιτούνται για τη φιλοξενία του μοντέλου WhisperX στο SageMaker:

Δημιουργήστε ένα σενάριο συμπερασμάτων για να φορτώσετε τα μοντέλα και να εκτελέσετε το συμπέρασμα

Στη συνέχεια, δημιουργούμε ένα έθιμο inference.py σενάριο για να περιγράψει πώς το μοντέλο WhisperX και τα στοιχεία του φορτώνονται στο κοντέινερ και πώς πρέπει να εκτελεστεί η διαδικασία εξαγωγής συμπερασμάτων. Το σενάριο περιέχει δύο λειτουργίες: model_fn και transform_fn. ο model_fn Η λειτουργία καλείται για να φορτώσει τα μοντέλα από τις αντίστοιχες θέσεις τους. Στη συνέχεια, αυτά τα μοντέλα περνούν στο transform_fn λειτουργία κατά τη διάρκεια της εξαγωγής συμπερασμάτων, όπου εκτελούνται οι διαδικασίες μεταγραφής, ευθυγράμμισης και διάκρισης. Το παρακάτω είναι ένα δείγμα κώδικα για inference.py:

import io

import json

import logging

import tempfile

import time import torch

import whisperx DEVICE = 'cuda' if torch.cuda.is_available() else 'cpu' def model_fn(model_dir: str) -> dict: """ Deserialize and return the models """ logging.info("Loading WhisperX model") model = whisperx.load_model(whisper_arch=f"{model_dir}/guillaumekln/faster-whisper-large-v2", device=DEVICE, language="en", compute_type="float16", vad_options={'model_fp': f"{model_dir}/whisperx/vad/pytorch_model.bin"}) logging.info("Loading alignment model") align_model, metadata = whisperx.load_align_model(language_code="en", device=DEVICE, model_name="WAV2VEC2_ASR_BASE_960H", model_dir=f"{model_dir}/wav2vec2") logging.info("Loading diarization model") diarization_model = whisperx.DiarizationPipeline(model_name=f"{model_dir}/pyannote/speaker-diarization/config.yaml", device=DEVICE) return { 'model': model, 'align_model': align_model, 'metadata': metadata, 'diarization_model': diarization_model } def transform_fn(model: dict, request_body: bytes, request_content_type: str, response_content_type="application/json") -> (str, str): """ Load in audio from the request, transcribe and diarize, and return JSON output """ # Start a timer so that we can log how long inference takes start_time = time.time() # Unpack the models whisperx_model = model['model'] align_model = model['align_model'] metadata = model['metadata'] diarization_model = model['diarization_model'] # Load the media file (the request_body as bytes) into a temporary file, then use WhisperX to load the audio from it logging.info("Loading audio") with io.BytesIO(request_body) as file: tfile = tempfile.NamedTemporaryFile(delete=False) tfile.write(file.read()) audio = whisperx.load_audio(tfile.name) # Run transcription logging.info("Transcribing audio") result = whisperx_model.transcribe(audio, batch_size=16) # Align the outputs for better timings logging.info("Aligning outputs") result = whisperx.align(result["segments"], align_model, metadata, audio, DEVICE, return_char_alignments=False) # Run diarization logging.info("Running diarization") diarize_segments = diarization_model(audio) result = whisperx.assign_word_speakers(diarize_segments, result) # Calculate the time it took to perform the transcription and diarization end_time = time.time() elapsed_time = end_time - start_time logging.info(f"Transcription and Diarization took {int(elapsed_time)} seconds") # Return the results to be stored in S3 return json.dumps(result), response_content_type

Μέσα στον κατάλογο του μοντέλου, παράλληλα με το requirements.txt αρχείο, εξασφαλίστε την παρουσία του inference.py σε έναν υποκατάλογο κώδικα. ο models κατάλογος πρέπει να μοιάζει με τον ακόλουθο:

Δημιουργήστε ένα tarball με τα μοντέλα

Αφού δημιουργήσετε τα μοντέλα και τους καταλόγους κώδικα, μπορείτε να χρησιμοποιήσετε τις ακόλουθες γραμμές εντολών για να συμπιέσετε το μοντέλο σε ένα tarball (αρχείο .tar.gz) και να το ανεβάσετε στο Amazon S3. Τη στιγμή της γραφής, χρησιμοποιώντας το μοντέλο Large V2 με πιο γρήγορους ψιθύρους, το προκύπτον tarball που αντιπροσωπεύει το μοντέλο SageMaker έχει μέγεθος 3 GB. Για περισσότερες πληροφορίες, ανατρέξτε στο Μοντέλα φιλοξενίας μοντέλων στο Amazon SageMaker, Μέρος 2: Ξεκινώντας με την ανάπτυξη μοντέλων σε πραγματικό χρόνο στο SageMaker.

Δημιουργήστε ένα μοντέλο SageMaker και αναπτύξτε ένα τελικό σημείο με έναν ασύγχρονο προγνωστικό

Τώρα μπορείτε να δημιουργήσετε το μοντέλο SageMaker, τη διαμόρφωση τελικού σημείου και το ασύγχρονο τελικό σημείο με AsyncPredictor χρησιμοποιώντας το μοντέλο tarball που δημιουργήθηκε στο προηγούμενο βήμα. Για οδηγίες, ανατρέξτε στο Δημιουργήστε ένα ασύγχρονο τελικό σημείο συμπερασμάτων.

Αξιολογήστε την απόδοση της διάκρισης

Για να αξιολογήσουμε την απόδοση του μοντέλου WhisperX σε διάφορα σενάρια, επιλέξαμε τρία επεισόδια το καθένα από δύο αγγλικούς τίτλους: έναν τίτλο δράματος που αποτελείται από επεισόδια 30 λεπτών και έναν τίτλο ντοκιμαντέρ που αποτελείται από επεισόδια 45 λεπτών. Χρησιμοποιήσαμε την εργαλειοθήκη μετρήσεων της pyannote, pyannote.μετρικά, για να υπολογίσετε το Ποσοστό σφαλμάτων diarization (DER). Στην αξιολόγηση, οι χειροκίνητες μεταγραφές και τα ημερολογιακά αντίγραφα που παρείχε η ZOO χρησίμευσαν ως βασική αλήθεια.

Ορίσαμε το DER ως εξής:

Σύνολο είναι η διάρκεια του βίντεο της αλήθειας εδάφους. FA (Εσφαλμένος συναγερμός) είναι το μήκος των τμημάτων που θεωρούνται ως ομιλία στις προβλέψεις, αλλά όχι ως αληθής βάση. Δεσποινίδα είναι το μήκος των τμημάτων που θεωρούνται ως ομιλία στη βασική αλήθεια, αλλά όχι στην πρόβλεψη. Λάθος, Που ονομάζεται επίσης Σύγχυση, είναι το μήκος των τμημάτων που έχουν εκχωρηθεί σε διαφορετικούς ομιλητές στην πρόβλεψη και την αλήθεια. Όλες οι μονάδες μετρώνται σε δευτερόλεπτα. Οι τυπικές τιμές για το DER μπορεί να ποικίλλουν ανάλογα με τη συγκεκριμένη εφαρμογή, το σύνολο δεδομένων και την ποιότητα του συστήματος μέτρησης. Σημειώστε ότι το DER μπορεί να είναι μεγαλύτερο από 1.0. Ένα χαμηλότερο DER είναι καλύτερο.

Για να μπορέσετε να υπολογίσετε το DER για ένα κομμάτι μέσου, απαιτείται μια διαίρεση αλήθειας εδάφους, καθώς και τα μεταγραφόμενα και ημερολογιακά αποτελέσματα WhisperX. Αυτά πρέπει να αναλυθούν και να οδηγήσουν σε λίστες πλειάδων που περιέχουν μια ετικέτα ηχείου, ώρα έναρξης τμήματος ομιλίας και ώρα λήξης τμήματος ομιλίας για κάθε τμήμα ομιλίας στο μέσο. Οι ετικέτες των ηχείων δεν χρειάζεται να ταιριάζουν μεταξύ των ενδείξεων WhisperX και βασικής αλήθειας. Τα αποτελέσματα βασίζονται κυρίως στον χρόνο των τμημάτων. Το pyannote.metrics λαμβάνει αυτές τις πλειάδες διαλογισμών βασικής αλήθειας και διαλογισμών εξόδου (αναφέρεται στην τεκμηρίωση pyannote.metrics ως αναφορά και υπόθεση) για τον υπολογισμό του DER. Ο παρακάτω πίνακας συνοψίζει τα αποτελέσματά μας.

| Τύπος βίντεο | DER | Σωστός | Δεσποινίδα | Λάθος | Λάθος συναγερμός |

| Δράμα | 0.738 | 44.80% | 21.80% | 33.30% | 18.70% |

| Ντοκυμαντέρ | 1.29 | 94.50% | 5.30% | 0.20% | 123.40% |

| Μέτρια | 0.901 | 71.40% | 13.50% | 15.10% | 61.50% |

Αυτά τα αποτελέσματα αποκαλύπτουν μια σημαντική διαφορά απόδοσης μεταξύ των τίτλων δράματος και ντοκιμαντέρ, με το μοντέλο να επιτυγχάνει σημαντικά καλύτερα αποτελέσματα (χρησιμοποιώντας το DER ως συγκεντρωτική μέτρηση) για τα επεισόδια του δράματος σε σύγκριση με τον τίτλο του ντοκιμαντέρ. Μια πιο προσεκτική ανάλυση των τίτλων παρέχει πληροφορίες για πιθανούς παράγοντες που συμβάλλουν σε αυτό το χάσμα απόδοσης. Ένας βασικός παράγοντας θα μπορούσε να είναι η συχνή παρουσία μουσικής υπόκρουσης που επικαλύπτεται με ομιλία στον τίτλο του ντοκιμαντέρ. Αν και η προεπεξεργασία μέσων για τη βελτίωση της ακρίβειας της διάκρισης, όπως η αφαίρεση του θορύβου περιβάλλοντος για την απομόνωση της ομιλίας, ήταν πέρα από το πεδίο αυτού του πρωτοτύπου, ανοίγει δρόμους για μελλοντικές εργασίες που θα μπορούσαν ενδεχομένως να βελτιώσουν την απόδοση του WhisperX.

Συμπέρασμα

Σε αυτήν την ανάρτηση, εξερευνήσαμε τη συνεργατική συνεργασία μεταξύ της AWS και της ZOO Digital, χρησιμοποιώντας τεχνικές μηχανικής εκμάθησης με το SageMaker και το μοντέλο WhisperX για τη βελτίωση της ροής εργασιών diarization. Η ομάδα AWS έπαιξε καθοριστικό ρόλο βοηθώντας το ZOO στη δημιουργία πρωτοτύπων, την αξιολόγηση και την κατανόηση της αποτελεσματικής ανάπτυξης προσαρμοσμένων μοντέλων ML, ειδικά σχεδιασμένων για diarization. Αυτό περιελάμβανε την ενσωμάτωση αυτόματης κλιμάκωσης για επεκτασιμότητα χρησιμοποιώντας το SageMaker.

Η αξιοποίηση της τεχνητής νοημοσύνης για diarization θα οδηγήσει σε σημαντική εξοικονόμηση κόστους και χρόνου κατά τη δημιουργία τοπικού περιεχομένου για το ZOO. Βοηθώντας τους μεταγραφείς να δημιουργούν και να αναγνωρίζουν γρήγορα και με ακρίβεια ηχεία, αυτή η τεχνολογία αντιμετωπίζει την παραδοσιακά χρονοβόρα και επιρρεπή σε σφάλματα φύση της εργασίας. Η συμβατική διαδικασία συχνά περιλαμβάνει πολλαπλά περάσματα μέσω του βίντεο και πρόσθετα βήματα ποιοτικού ελέγχου για την ελαχιστοποίηση των σφαλμάτων. Η υιοθέτηση της τεχνητής νοημοσύνης για τη μέτρηση επιτρέπει μια πιο στοχευμένη και αποτελεσματική προσέγγιση, αυξάνοντας έτσι την παραγωγικότητα σε συντομότερο χρονικό διάστημα.

Περιγράψαμε βασικά βήματα για την ανάπτυξη του μοντέλου WhisperX στο ασύγχρονο τελικό σημείο του SageMaker και σας ενθαρρύνουμε να το δοκιμάσετε μόνοι σας χρησιμοποιώντας τον παρεχόμενο κώδικα. Για περισσότερες πληροφορίες σχετικά με τις υπηρεσίες και την τεχνολογία του ZOO Digital, επισκεφτείτε Επίσημος ιστότοπος της ZOO Digital. Για λεπτομέρειες σχετικά με την ανάπτυξη του μοντέλου OpenAI Whisper στο SageMaker και διάφορες επιλογές συμπερασμάτων, ανατρέξτε στο Φιλοξενήστε το μοντέλο Whisper στο Amazon SageMaker: εξερευνώντας τις επιλογές συμπερασμάτων. Μη διστάσετε να μοιραστείτε τις σκέψεις σας στα σχόλια.

Σχετικά με τους Συγγραφείς

Ying Hou, PhD, είναι Αρχιτέκτονας Μηχανικής Μάθησης Πρωτότυπων στην AWS. Οι κύριοι τομείς ενδιαφέροντός της περιλαμβάνουν το Deep Learning, με έμφαση στο GenAI, το Computer Vision, το NLP και την πρόβλεψη δεδομένων χρονοσειρών. Στον ελεύθερο χρόνο της, απολαμβάνει να περνά ποιοτικές στιγμές με την οικογένειά της, να βυθίζεται σε μυθιστορήματα και να κάνει πεζοπορία στα εθνικά πάρκα του Ηνωμένου Βασιλείου.

Ying Hou, PhD, είναι Αρχιτέκτονας Μηχανικής Μάθησης Πρωτότυπων στην AWS. Οι κύριοι τομείς ενδιαφέροντός της περιλαμβάνουν το Deep Learning, με έμφαση στο GenAI, το Computer Vision, το NLP και την πρόβλεψη δεδομένων χρονοσειρών. Στον ελεύθερο χρόνο της, απολαμβάνει να περνά ποιοτικές στιγμές με την οικογένειά της, να βυθίζεται σε μυθιστορήματα και να κάνει πεζοπορία στα εθνικά πάρκα του Ηνωμένου Βασιλείου.

Ίθαν Κάμπερλαντ είναι Μηχανικός Έρευνας AI στο ZOO Digital, όπου εργάζεται στη χρήση της τεχνητής νοημοσύνης και της μηχανικής μάθησης ως βοηθητικές τεχνολογίες για τη βελτίωση των ροών εργασίας στην ομιλία, τη γλώσσα και την τοπική προσαρμογή. Έχει ένα υπόβαθρο στη μηχανική λογισμικού και την έρευνα στον τομέα της ασφάλειας και της αστυνόμευσης, εστιάζοντας στην εξαγωγή δομημένων πληροφοριών από τον Ιστό και στη μόχλευση μοντέλων ML ανοιχτού κώδικα για την ανάλυση και τον εμπλουτισμό των συλλεγόμενων δεδομένων.

Ίθαν Κάμπερλαντ είναι Μηχανικός Έρευνας AI στο ZOO Digital, όπου εργάζεται στη χρήση της τεχνητής νοημοσύνης και της μηχανικής μάθησης ως βοηθητικές τεχνολογίες για τη βελτίωση των ροών εργασίας στην ομιλία, τη γλώσσα και την τοπική προσαρμογή. Έχει ένα υπόβαθρο στη μηχανική λογισμικού και την έρευνα στον τομέα της ασφάλειας και της αστυνόμευσης, εστιάζοντας στην εξαγωγή δομημένων πληροφοριών από τον Ιστό και στη μόχλευση μοντέλων ML ανοιχτού κώδικα για την ανάλυση και τον εμπλουτισμό των συλλεγόμενων δεδομένων.

Gaurav Kaila ηγείται της ομάδας AWS Prototyping για το Ηνωμένο Βασίλειο και την Ιρλανδία. Η ομάδα του συνεργάζεται με πελάτες σε διάφορους κλάδους για να ιδεολογήσει και να συν-ανάπτυξη κρίσιμους φόρτους εργασίας για τις επιχειρήσεις με εντολή να επιταχύνει την υιοθέτηση των υπηρεσιών AWS.

Gaurav Kaila ηγείται της ομάδας AWS Prototyping για το Ηνωμένο Βασίλειο και την Ιρλανδία. Η ομάδα του συνεργάζεται με πελάτες σε διάφορους κλάδους για να ιδεολογήσει και να συν-ανάπτυξη κρίσιμους φόρτους εργασίας για τις επιχειρήσεις με εντολή να επιταχύνει την υιοθέτηση των υπηρεσιών AWS.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- PlatoHealth. Ευφυΐα βιοτεχνολογίας και κλινικών δοκιμών. Πρόσβαση εδώ.

- πηγή: https://aws.amazon.com/blogs/machine-learning/streamline-diarization-using-ai-as-an-assistive-technology-zoo-digitals-story/

- :έχει

- :είναι

- :δεν

- :που

- $UP

- 000

- 1

- 10

- 100

- 11

- 140

- 2022

- 220

- 28

- 30

- 350

- 600

- 7

- 8

- a

- Ικανός

- επιταχύνουν

- την αποδοχή

- πρόσβαση

- προσιτός

- ακρίβεια

- Κατορθώνω

- την επίτευξη

- απέναντι

- προσαρμόσει

- Πρόσθετος

- Επιπλέον

- διευθύνσεις

- Υιοθεσία

- Μετά το

- σύνολο

- συμφωνίες

- AI

- ai έρευνα

- στοχεύουν

- στόχοι

- τρομάζω

- ευθυγράμμιση

- ευθυγράμμιση

- ευθυγραμμία

- Όλα

- επιτρέπει

- alone

- κατά μήκος της πλευράς

- Επίσης

- Αν και

- Amazon

- Amazon Sage Maker

- Amazon υπηρεσίες Web

- an

- Ανάλυση

- ανάλυση

- και

- Άλλος

- Εφαρμογή

- πλησιάζω

- κατάλληλος

- αρχιτεκτονική

- ΕΙΝΑΙ

- περιοχές

- Καλλιτέχνες

- AS

- εκτιμώ

- Ενεργητικό

- ανατεθεί

- βοηθήσει

- βοηθώντας

- At

- ήχου

- εξουσιοδοτημένο

- αυτόματη

- Αυτοματοποίηση

- λεωφόρους

- AWS

- φόντο

- βασίζονται

- BE

- επειδή

- ήταν

- πριν

- είναι

- ΚΑΛΎΤΕΡΟΣ

- Καλύτερα

- μεταξύ

- Πέρα

- Μεγαλύτερη

- BIN

- και οι δύο

- χτισμένο

- επιχείρηση

- αλλά

- by

- υπολογίσει

- που ονομάζεται

- CAN

- περίπτωση

- πρόκληση

- χαρακτήρες

- Επιλέξτε

- πιο κοντά

- κωδικός

- συνεργασία

- συνεργατική

- σχόλια

- σύγκριση

- Ολοκληρώθηκε το

- Συμμόρφωση

- συστατικό

- εξαρτήματα

- σύνθετα

- υπολογιστή

- Computer Vision

- διενεργούνται

- έχει ρυθμιστεί

- Διαμόρφωση

- Εξετάστε

- θεωρούνται

- Αποτελείται από

- Δοχείο

- Περιέχει

- περιεχόμενο

- δημιουργούς περιεχομένου

- συμβάλλοντας

- έλεγχος

- συμβατικός

- πυρήνας

- σωστά

- Κόστος

- Δικαστικά έξοδα

- θα μπορούσε να

- δημιουργία

- δημιουργήθηκε

- δημιουργία

- δημιουργούς

- κρίσιμης

- πολιτισμών

- έθιμο

- Πελάτες

- ημερομηνία

- βαθύς

- βαθιά μάθηση

- ορίζεται

- παράδοση

- παραδίδει

- σκάβω

- Ζήτηση

- Σε συνάρτηση

- παρατάσσω

- αναπτυχθεί

- ανάπτυξη

- ανάπτυξη

- σχεδιασμένα

- καθέκαστα

- εντοπιστεί

- προγραμματιστές

- συσκευή

- διάγραμμα

- DICT

- διαφορά

- διαφορετικές

- ψηφιακό

- Ψηφιακά

- κατευθείαν

- Κατάλογοι

- κατάλογο

- συζητήσουν

- διάφορα

- Λιμενεργάτης

- ντοκυμαντέρ

- τεκμηρίωση

- τομέα

- Μην

- κατεβάσετε

- κατέβασμα

- Δράμα

- μεταγλωττισμένο

- κατά την διάρκεια

- κάθε

- ευκολότερη

- Αποτελεσματικός

- αποτελεσματικός

- αποτελεσματικά

- στοιχεία

- αλλιώς

- ενσωμάτωση

- απασχολώντας

- δίνει τη δυνατότητα

- περικυκλώ

- ενθαρρύνει

- τέλος

- από άκρη σε άκρη

- Τελικό σημείο

- ασχολούνται

- δέσμευση

- μηχανικός

- Μηχανική

- Αγγλικά

- ενίσχυση

- εμπλουτισμός

- εξασφαλίζω

- εξασφαλίζοντας

- σε επίπεδο επιχειρήσεων

- Ψυχαγωγία

- επεισόδιο

- σφάλμα

- λάθη

- ουσιώδης

- αξιολογήσει

- αξιολόγηση

- αξιολογώντας

- εκτίμηση

- Συμβάν

- Κάθε

- παράδειγμα

- Άσκηση

- πειράματα

- Εξερευνήθηκε

- Εξερευνώντας

- Πρόσωπο

- πρόσωπα

- παράγοντας

- παράγοντες

- ψευδής

- οικογένεια

- γρηγορότερα

- Χαρακτηριστικά

- αισθάνομαι

- Ανακτήθηκε

- Αρχεία

- Αρχεία

- Ευελιξία

- Συγκέντρωση

- επικεντρώθηκε

- εστιάζοντας

- Εξής

- εξής

- Για

- αναγκάζεται

- τέσσερα

- Πλαίσιο

- Δωρεάν

- συχνάζω

- από

- πλήρη

- λειτουργία

- λειτουργικός

- λειτουργίες

- περαιτέρω

- μελλοντικός

- χάσμα

- γεναί

- παράγεται

- παραγωγής

- να πάρει

- GitHub

- παγκοσμιοποίηση

- γκολ

- GPU

- Έδαφος

- hands-on

- υλικού

- he

- αυτήν

- υψηλής ποιότητας

- του

- οικοδεσπότης

- φιλοξενία

- ΩΡΕΣ

- Πως

- Ωστόσο

- HTML

- http

- HTTPS

- Πρόσωπο αγκαλιάς

- προσδιορισμό

- Ταυτότητα

- if

- απεικονίζει

- εικόνα

- εισαγωγή

- βελτίωση

- βελτιωθεί

- in

- περιλαμβάνονται

- περιλαμβάνει

- Συμπεριλαμβανομένου

- ενσωματώνω

- ενσωματώνοντας

- αύξηση

- βιομηχανίες

- πληροφορίες

- μύηση

- ιδέες

- εγκατασταθεί

- οδηγίες

- τόκος

- σε

- Εισάγει

- επένδυση

- επικαλείται

- περιλαμβάνει

- Ιρλανδία

- IT

- ΤΟΥ

- jpg

- json

- Κλειδί

- παράγοντας κλειδί

- επιγραφή

- Ετικέτες

- Γλώσσα

- Γλώσσες

- large

- μεγαλύτερος

- οδηγήσει

- Οδηγεί

- μάθηση

- Μήκος

- μόχλευσης

- Βιβλιοθήκη

- γραμμές

- Λιστα

- Λίστες

- φορτίο

- φόρτωση

- τοπικός

- Τοπική Προσαρμογή

- τοπικά

- θέσεις

- κούτσουρο

- ξύλευση

- Μακριά

- χαμηλότερα

- μηχανή

- μάθηση μηχανής

- συντήρηση

- ΚΑΝΕΙ

- διαχείριση

- Εντολή

- Ταχύτητες

- χειροκίνητα

- Ταίριασμα

- Ενδέχεται..

- Εικόνες / Βίντεο

- Μεταδεδομένα

- μέθοδοι

- μετρικός

- Metrics

- εκατομμύριο

- ελαχιστοποίηση

- Λεπτ.

- Μετριάζω

- ML

- μοντέλο

- μοντέλα

- σπονδυλωτή

- Μονάδα μέτρησης

- Στιγμές

- περισσότερο

- ως επί το πλείστον

- ταινία

- Κινηματογράφος

- πολλαπλούς

- Μουσική

- πρέπει

- όνομα

- ονόματα

- εθνικός

- Φύση

- απαραίτητος

- Ανάγκη

- που απαιτούνται

- Νέα

- nlp

- Θόρυβος

- ιδιαίτερα

- σημείωση

- λαμβάνεται

- of

- προσφορά

- προσφορά

- επίσημος ανώτερος υπάλληλος

- συχνά

- on

- ONE

- ανοικτού κώδικα

- OpenAI

- ανοίγει

- λειτουργία

- Επιλογές

- or

- πρωτότυπο

- OS

- ΑΛΛΑ

- δικός μας

- έξω

- περίγραμμα

- σκιαγραφείται

- παραγωγή

- εξόδους

- επί

- Packages

- μέρος

- ιδιαίτερα

- Συνεταιρισμός

- πέρασε

- περάσματα

- μονοπάτι

- μονοπάτια

- πρότυπα

- People

- Εκτελέστε

- επίδοση

- εκτελούνται

- εκτελεί

- κομμάτι

- αγωγού

- πιλοτικές

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- Δοκιμάστε να παίξετε

- έπαιξε

- αστυνομία

- Θέση

- δυναμικού

- ενδεχομένως

- προηγείται

- ακριβώς

- πρόβλεψη

- Προβλέψεις

- παρουσία

- παρόν

- προηγούμενος

- πρωταρχικός

- διαδικασια μας

- Διεργασίες

- μεταποίηση

- Προϊόν

- παραγωγή

- παραγωγικότητα

- Πρόγραμμα

- πρωτότυπο

- προτυποποίηση

- παρέχουν

- παρέχεται

- παρέχει

- χορήγηση

- Python

- ποιότητα

- R

- Τιμή

- Διάβασε

- πραγματικός

- σε πραγματικό χρόνο

- συνιστώ

- παραπέμπω

- αναφέρεται

- περιοχή

- περιοχές

- θυμάμαι

- αφαίρεση

- αντικαθιστώ

- εκπροσωπούν

- ζητήσει

- απαιτούν

- απαιτείται

- απαιτήσεις

- έρευνα

- εκείνοι

- αποτέλεσμα

- με αποτέλεσμα

- Αποτελέσματα

- απόδοση

- Επιστροφές

- αποκαλύπτω

- Ρόλος

- τρέξιμο

- τρέξιμο

- runtime

- s

- σοφός

- δείγμα

- Αποθήκευση

- αποθηκεύονται

- Οικονομίες

- Απεριόριστες δυνατότητες

- επεκτάσιμη

- Κλίμακα

- απολέπιση

- σενάρια

- έκταση

- γραφή

- δευτερόλεπτα

- τμήματα

- ασφάλεια

- τμήμα

- κατάτμηση

- τμήματα

- επιλέγονται

- επιλογή

- Σειρές

- σερβίρεται

- Υπηρεσίες

- εξυπηρετούν

- ρυθμίσεις

- Κοινοποίηση

- αυτή

- θα πρέπει να

- σημαντικός

- Απλούς

- ΕΞΙ

- Μέγεθος

- μεγέθη

- έμπειρος

- small

- εξομαλύνουν

- So

- λογισμικό

- τεχνολογία λογισμικού

- λύση

- Πηγή

- Ομιλητής

- Ηχεία

- συγκεκριμένες

- ειδικά

- καθορίζεται

- ομιλία

- Δαπάνες

- αιχμές

- Εκκίνηση

- ξεκίνησε

- Βήμα

- Βήματα

- χώρος στο δίσκο

- αποθηκεύονται

- Ιστορία

- μετάδοση

- εξορθολογισμό

- δομημένος

- Ακολούθως

- ουσιώδης

- τέτοιος

- κατάλληλος

- προμήθεια

- υποστήριξη

- Στήριξη

- άλλαξαν

- ταχέως

- συγχρονισμός

- σύστημα

- τραπέζι

- Πάρτε

- παίρνει

- στοχευμένες

- Έργο

- τεχνικές

- Τεχνολογίες

- Τεχνολογία

- προσωρινή

- κείμενο

- από

- ότι

- Η

- Το μέλλον

- το Ηνωμένο Βασίλειο

- τους

- Τους

- τότε

- εκ τούτου

- Αυτοί

- αυτοί

- αυτό

- εκείνοι

- τρία

- Μέσω

- ώρα

- Χρονική σειρά

- χρονοβόρος

- χρονοδιάγραμμα

- φορές

- timestamp

- χρονισματα

- Τίτλος

- τίτλους

- προς την

- ένδειξη

- πήρε

- εργαλειοθήκη

- δάδα

- παραδοσιακά

- ΚΙΝΗΣΗ στους ΔΡΟΜΟΥΣ

- Εκπαίδευση

- διαφανής

- ενεργοποιούν

- ενεργοποίηση

- Έμπιστος

- Αλήθεια

- προσπαθώ

- φροντιστήριο

- tv

- δύο

- τυπικός

- Uk

- υπό

- κατά τη διάρκεια της 30

- κατανόηση

- μονάδες

- Ενημέρωση

- επάνω σε

- χρήση

- περίπτωση χρήσης

- μεταχειρισμένος

- Χρήστες

- χρησιμοποιεί

- χρησιμοποιώντας

- χρησιμοποιούνται

- χρησιμοποιεί

- Αξίες

- διάφορα

- ποικίλλω

- εκδοχή

- εκδόσεις

- βιώσιμος

- Βίντεο

- όραμα

- Επίσκεψη

- Φωνή

- W

- ήταν

- we

- ιστός

- διαδικτυακές υπηρεσίες

- ΛΟΙΠΌΝ

- πότε

- ενώ

- Whisper - Ακουστικά

- θα

- με

- εντός

- χωρίς

- λόγια

- Εργασία

- ροής εργασίας

- ροές εργασίας

- Εργατικό δυναμικό

- λειτουργεί

- του κόσμου

- γραφή

- γιαμ

- Εσείς

- Σας

- τον εαυτό σας

- zephyrnet

- ΖΩΟΛΟΓΙΚΟΣ ΚΗΠΟΣ