En esta publicación, mostramos cómo configurar una nueva función de autenticación basada en OAuth para usar Copo de nieve in Wrangler de datos de Amazon SageMaker. Snowflake es una plataforma de datos en la nube que proporciona soluciones de datos para el almacenamiento de datos para la ciencia de datos. copo de nieve es un Socio de AWS con múltiples acreditaciones de AWS, incluidas las competencias de AWS en aprendizaje automático (ML), comercio minorista y datos y análisis.

Data Wrangler simplifica la preparación de datos y el proceso de ingeniería de características, reduciendo el tiempo que toma de semanas a minutos al proporcionar una interfaz visual única para que los científicos de datos seleccionen y limpien datos, creen características y automaticen la preparación de datos en flujos de trabajo de ML sin escribir ningún código. Puede importar datos de varias fuentes de datos, como Servicio de almacenamiento simple de Amazon (Amazon S3), Atenea amazónica, Desplazamiento al rojo de Amazon, EMR de Amazony copo de nieve. Con esta nueva característica, puede usar su propio proveedor de identidad (IdP) como Okta, Azure ADo Federación de ping para conectarse a Snowflake a través de Data Wrangler.

Resumen de la solución

En las siguientes secciones, proporcionamos los pasos para que un administrador configure IdP, Snowflake y Studio. También detallamos los pasos que los científicos de datos pueden seguir para configurar el flujo de datos, analizar la calidad de los datos y agregar transformaciones de datos. Finalmente, mostramos cómo exportar el flujo de datos y entrenar un modelo usando Piloto automático SageMaker.

Requisitos previos

Para este tutorial, debe tener los siguientes requisitos previos:

- Para admin:

- Un usuario de Snowflake con permisos para crear integraciones de almacenamiento e integraciones de seguridad en Snowflake.

- Una cuenta de AWS con permisos para crear Gestión de identidades y accesos de AWS (IAM) políticas y funciones.

- Acceso y permisos para configurar IDP para registrar la aplicación Data Wrangler y configurar el servidor de autorización o API.

- Para el científico de datos:

Configuración del administrador

En lugar de que sus usuarios ingresen directamente sus credenciales de Snowflake en Data Wrangler, puede hacer que usen un IdP para acceder a Snowflake.

Se requieren los siguientes pasos para habilitar el acceso OAuth de Data Wrangler a Snowflake:

- Configure el proveedor de identidad.

- Configurar copo de nieve.

- Configurar SageMaker Studio.

Configurar el proveedor de identidad

Para configurar su IdP, debe registrar la aplicación Data Wrangler y configurar su servidor de autorización o API.

Registrar la aplicación Data Wrangler dentro del IdP

Consulte la siguiente documentación para los IdP que admite Data Wrangler:

Utilice la documentación proporcionada por su IdP para registrar su aplicación Data Wrangler. La información y los procedimientos de esta sección lo ayudarán a comprender cómo utilizar correctamente la documentación proporcionada por su IdP.

Las personalizaciones específicas además de los pasos en las guías respectivas se mencionan en las subsecciones.

- Seleccione la configuración que inicia el proceso de registro de Data Wrangler como una aplicación.

- Proporcione a los usuarios dentro del IdP acceso a Data Wrangler.

- Habilite la autenticación de cliente de OAuth almacenando las credenciales del cliente como un secreto de Secrets Manager.

- Especifique una URL de redireccionamiento usando el siguiente formato:

https://domain-ID.studio.AWS Region.sagemaker.aws/jupyter/default/lab.

Está especificando el ID de dominio de SageMaker y la región de AWS que está utilizando para ejecutar Data Wrangler. Debe registrar una URL para cada dominio y región donde está ejecutando Data Wrangler. Los usuarios de un dominio y una región que no tengan URL de redirección configuradas para ellos no podrán autenticarse con el IdP para acceder a la conexión de Snowflake.

- Asegúrese de que el código de autorización y los tipos de concesión de token de actualización estén permitidos para su aplicación Data Wrangler.

Configure el servidor de autorización o API dentro del IdP

Dentro de su IdP, debe configurar un servidor de autorización o una interfaz de programación de aplicaciones (API). Para cada usuario, el servidor de autorización o la API envía tokens a Data Wrangler con Snowflake como audiencia.

Snowflake utiliza el concepto de

También soy miembro del cuerpo docente de World Extreme Medicine (WEM) y embajadora europea de igualdad para The Transformational Travel Council (TTC).

En mi tiempo libre, soy una incansable aventurera, escaladora, patrona de día, buceadora y defensora de la igualdad de género en el deporte y la aventura.

En XNUMX, fundé Almas Libres, una ONG nacida para involucrar, educar y empoderar a mujeres y niñas a través del deporte urbano, la cultura y la tecnología. que son distintos de los roles de IAM utilizados en AWS. Debe configurar el IdP para usar CUALQUIER rol para usar el rol predeterminado asociado con la cuenta de Snowflake. Por ejemplo, si un usuario tiene systems administrator como función predeterminada en su perfil de Snowflake, la conexión de Data Wrangler a Snowflake utiliza systems administrator como el papel.

Utilice el siguiente procedimiento para configurar el servidor de autorización o API dentro de su IdP:

- Desde su IdP, comience el proceso de configuración del servidor o API.

- Configure el servidor de autorización para usar el código de autorización y actualizar los tipos de concesión de token.

- Especifique la vida útil del token de acceso.

- Establezca el tiempo de espera de inactividad del token de actualización.

El tiempo de espera de inactividad es el tiempo que caduca el token de actualización si no se usa. Si está programando trabajos en Data Wrangler, le recomendamos que haga que el tiempo de inactividad sea mayor que la frecuencia del trabajo de procesamiento. De lo contrario, algunos trabajos de procesamiento pueden fallar porque el token de actualización caducó antes de que pudieran ejecutarse. Cuando el token de actualización caduca, el usuario debe volver a autenticarse accediendo a la conexión que ha realizado con Snowflake a través de Data Wrangler.

Tenga en cuenta que Data Wrangler no admite tokens de actualización rotativos. El uso de tokens de actualización rotativos puede provocar fallas de acceso o que los usuarios necesiten iniciar sesión con frecuencia.

Si el token de actualización caduca, sus usuarios deben volver a autenticarse accediendo a la conexión que establecieron con Snowflake a través de Data Wrangler.

- Especificar

session:role-anycomo el nuevo alcance.

Para Azure AD, también debe especificar un identificador único para el ámbito.

Una vez que haya configurado el proveedor de OAuth, proporcione a Data Wrangler la información que necesita para conectarse al proveedor. Puede usar la documentación de su IdP para obtener valores para los siguientes campos:

- URL del token – La URL del token que el IdP envía a Data Wrangler

- URL de autorización – La URL del servidor de autorización del IdP

- ID de cliente – El ID del IdP

- Secreto del cliente – El secreto que solo reconoce el servidor de autorización o API

- Alcance de OAuth – Esto es solo para Azure AD

Configurar copo de nieve

Para configurar Snowflake, complete las instrucciones en Importar datos de Snowflake.

Utilice la documentación de Snowflake para su IdP para configurar una integración de OAuth externa en Snowflake. Ver la sección anterior Registrar la aplicación Data Wrangler dentro del IdP para obtener más información sobre cómo configurar una integración OAuth externa.

Cuando esté configurando la integración de seguridad en Snowflake, asegúrese de activar external_oauth_any_role_mode.

Configurar SageMaker Studio

Almacene los campos y valores en un secreto de Secrets Manager y agréguelo a la configuración del ciclo de vida de Studio que está utilizando para Data Wrangler. Una configuración del ciclo de vida es un script de shell que carga automáticamente las credenciales almacenadas en el secreto cuando el usuario inicia sesión en Studio. Para obtener información sobre la creación de secretos, consulte Mueva secretos codificados a AWS Secrets Manager. Para obtener información sobre el uso de las configuraciones del ciclo de vida en Studio, consulte Usar configuraciones de ciclo de vida con Amazon SageMaker Studio.

Crear un secreto para las credenciales de Snowflake

Para crear su secreto para las credenciales de Snowflake, complete los siguientes pasos:

- En la consola de Secrets Manager, elija Almacenar un nuevo secreto.

- tipo secreto, seleccione Otro tipo de secreto.

- Especifique los detalles de su secreto como pares clave-valor.

Los nombres de clave requieren letras minúsculas debido a la distinción entre mayúsculas y minúsculas. Data Wrangler da una advertencia si ingresa alguno de estos incorrectamente. Ingrese los valores secretos como pares clave-valor Clave/valor si lo desea, o use el Texto sin formato .

El siguiente es el formato del secreto utilizado para Okta. Si está utilizando Azure AD, debe agregar el datasource_oauth_scope campo.

- Actualice los valores anteriores con su elección de IdP y la información recopilada después del registro de la aplicación.

- Elige Siguiente.

- Nombre secreto, agrega el prefijo

AmazonSageMaker(por ejemplo, nuestro secreto esAmazonSageMaker-DataWranglerSnowflakeCreds). - En Etiquetas sección, agregue una etiqueta con la clave

SageMakery valortrue. - Elige Siguiente.

- El resto de los campos son opcionales; escoger Siguiente hasta que tengas la opción de elegir Tienda para almacenar el secreto.

Después de almacenar el secreto, volverá a la consola de Secrets Manager.

- Elija el secreto que acaba de crear, luego recupere el ARN secreto.

- Guárdelo en su editor de texto preferido para usarlo más tarde cuando cree la fuente de datos de Data Wrangler.

Crear una configuración de ciclo de vida de Studio

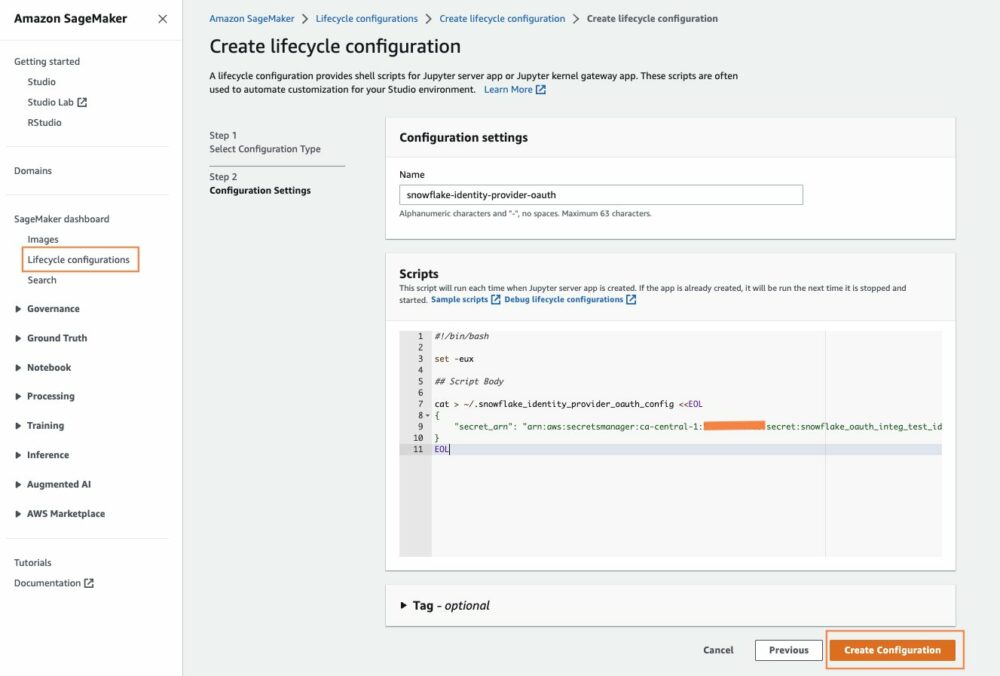

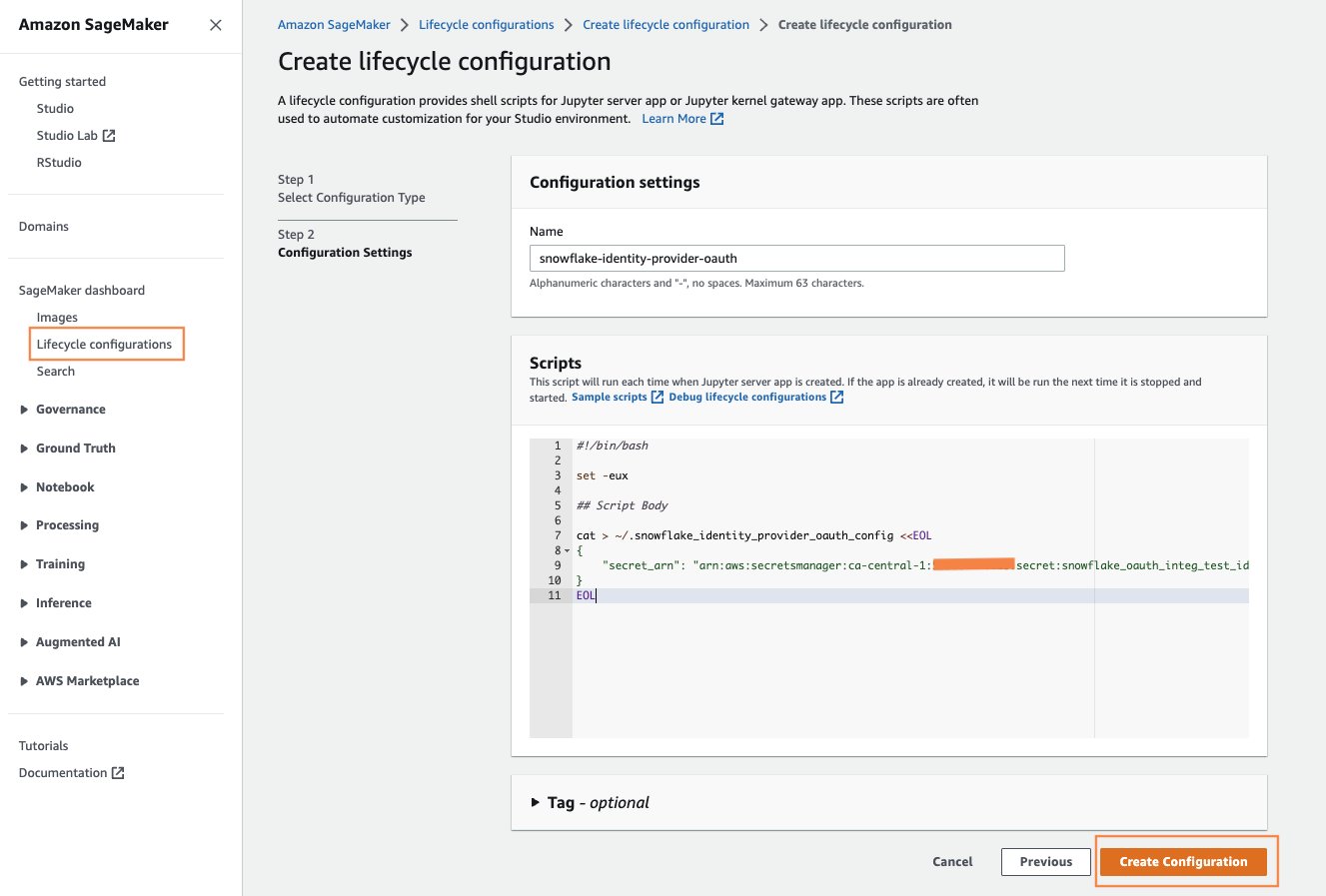

Para crear una configuración de ciclo de vida en Studio, complete los siguientes pasos:

- En la consola de SageMaker, elija Configuraciones de ciclo de vida en el panel de navegación.

- Elige Crear configuración.

- Elige Aplicación de servidor Jupyter.

- Cree una nueva configuración de ciclo de vida o agregue una existente con el siguiente contenido:

La configuración crea un archivo con el nombre ".snowflake_identity_provider_oauth_config", que contiene el secreto en la carpeta de inicio del usuario.

- Elige Crear configuración.

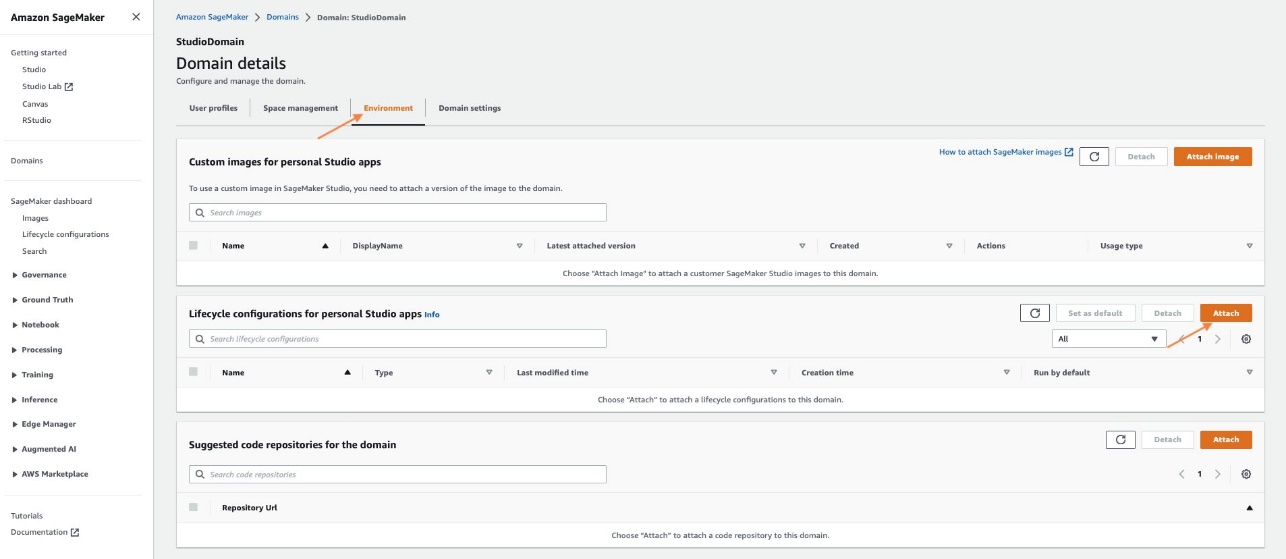

Establecer la configuración de ciclo de vida predeterminada

Complete los siguientes pasos para establecer la configuración del ciclo de vida que acaba de crear como predeterminada:

- En la consola de SageMaker, elija dominios en el panel de navegación.

- Elija el dominio de Studio que usará para este ejemplo.

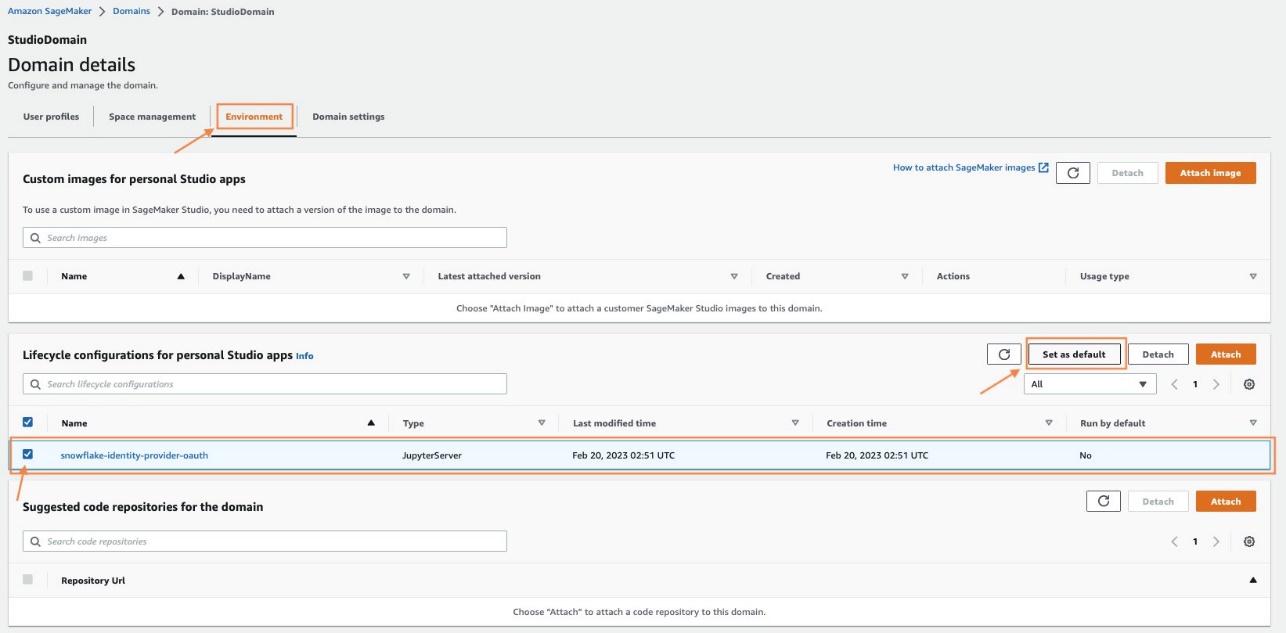

- En Entorno pestaña, en el Configuraciones de ciclo de vida para aplicaciones personales de Studio sección, elija Adjuntar.

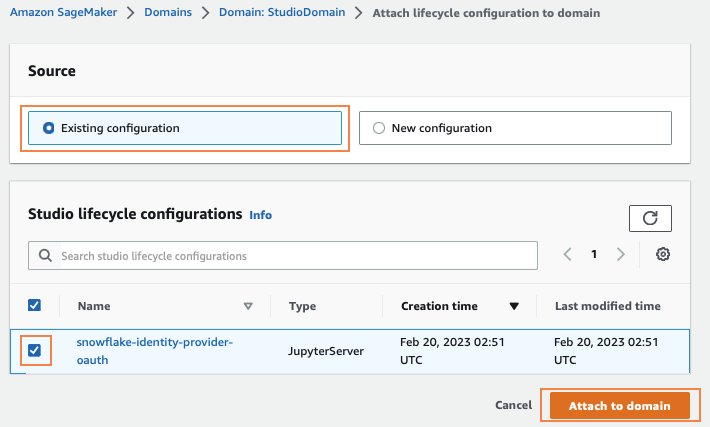

- Fuente, seleccione Configuración existente.

- Seleccione la configuración que acaba de realizar y, a continuación, elija Adjuntar al dominio.

- Seleccione la nueva configuración y elija Establecer como predeterminado, A continuación, elija Establecer como predeterminado de nuevo en el mensaje emergente.

Su nueva configuración ahora debería estar visible en Configuraciones de ciclo de vida para aplicaciones personales de Studio por defecto.

- Cierre la aplicación Studio y vuelva a iniciarla para que los cambios surtan efecto.

Experiencia del científico de datos

En esta sección, cubrimos cómo los científicos de datos pueden conectarse a Snowflake como fuente de datos en Data Wrangler y preparar datos para ML.

Crea un nuevo flujo de datos

Para crear su flujo de datos, complete los siguientes pasos:

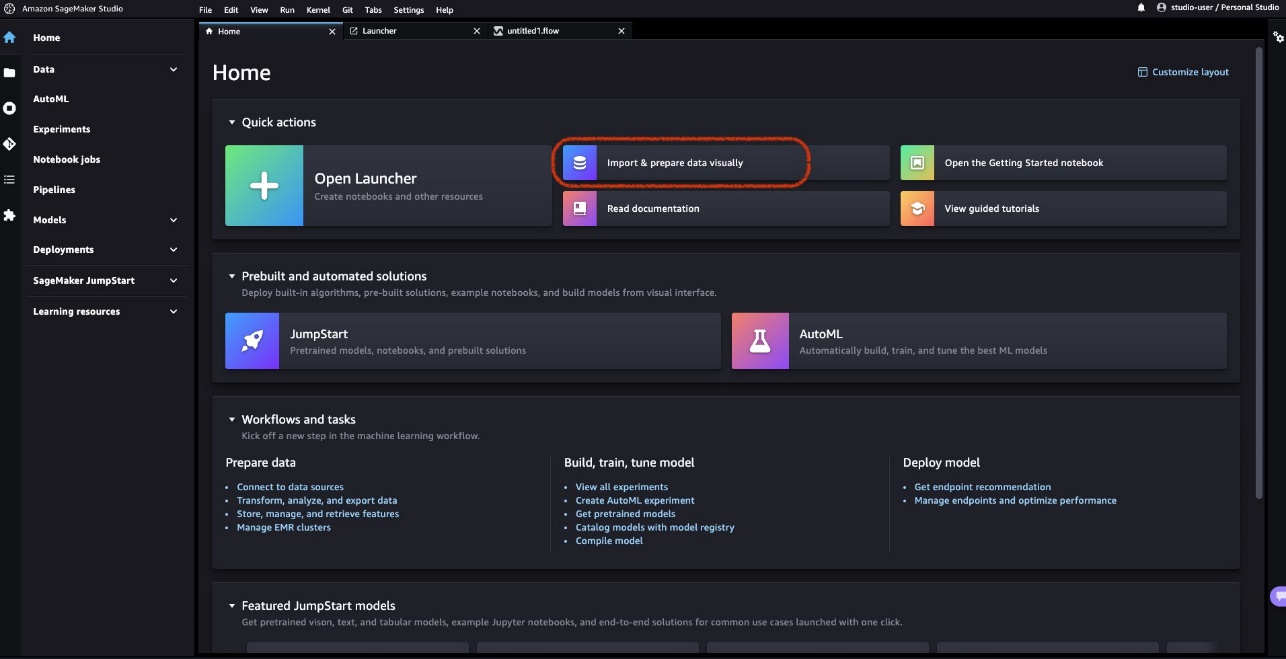

- En la consola de SageMaker, elija Estudio Amazon SageMaker en el panel de navegación.

- Elige Open Studio.

- en el estudio Inicio página, elige Importe y prepare datos visualmente. Alternativamente, en el Archive desplegable, elija Nuevo, A continuación, elija Flujo de administrador de datos de SageMaker.

La creación de un nuevo flujo puede tardar unos minutos.

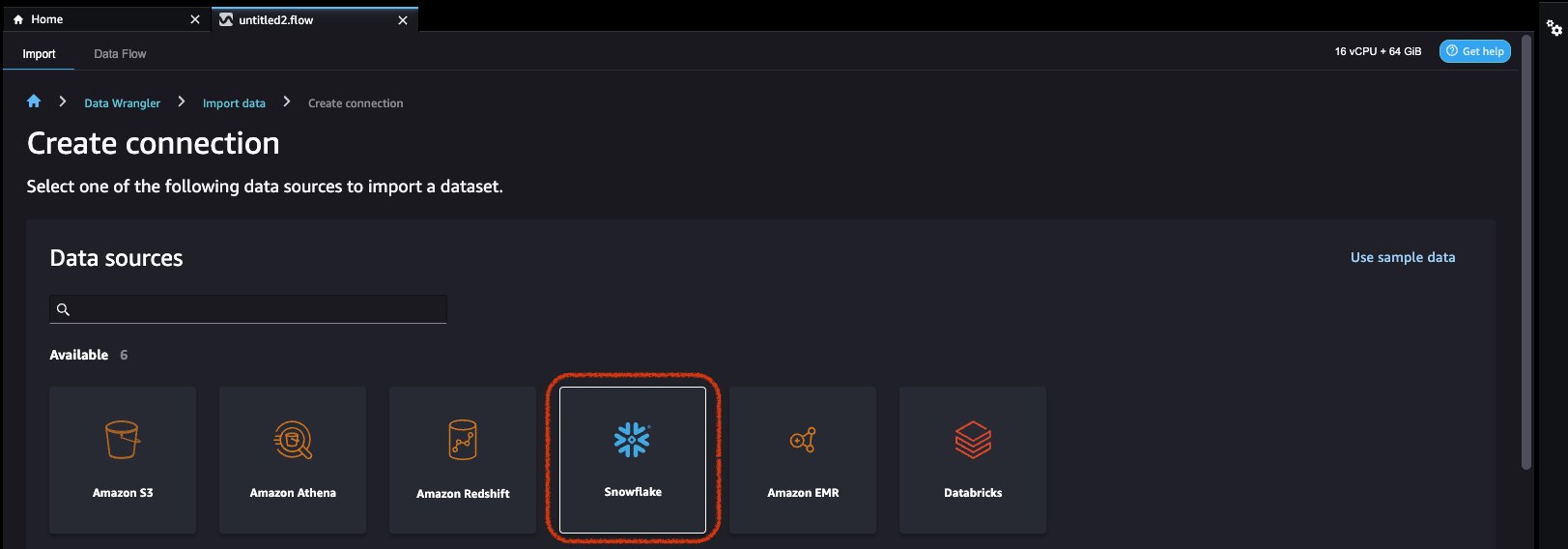

- En Importar fechas página, elige Crear conexión.

- Elige Copo de nieve de la lista de fuentes de datos.

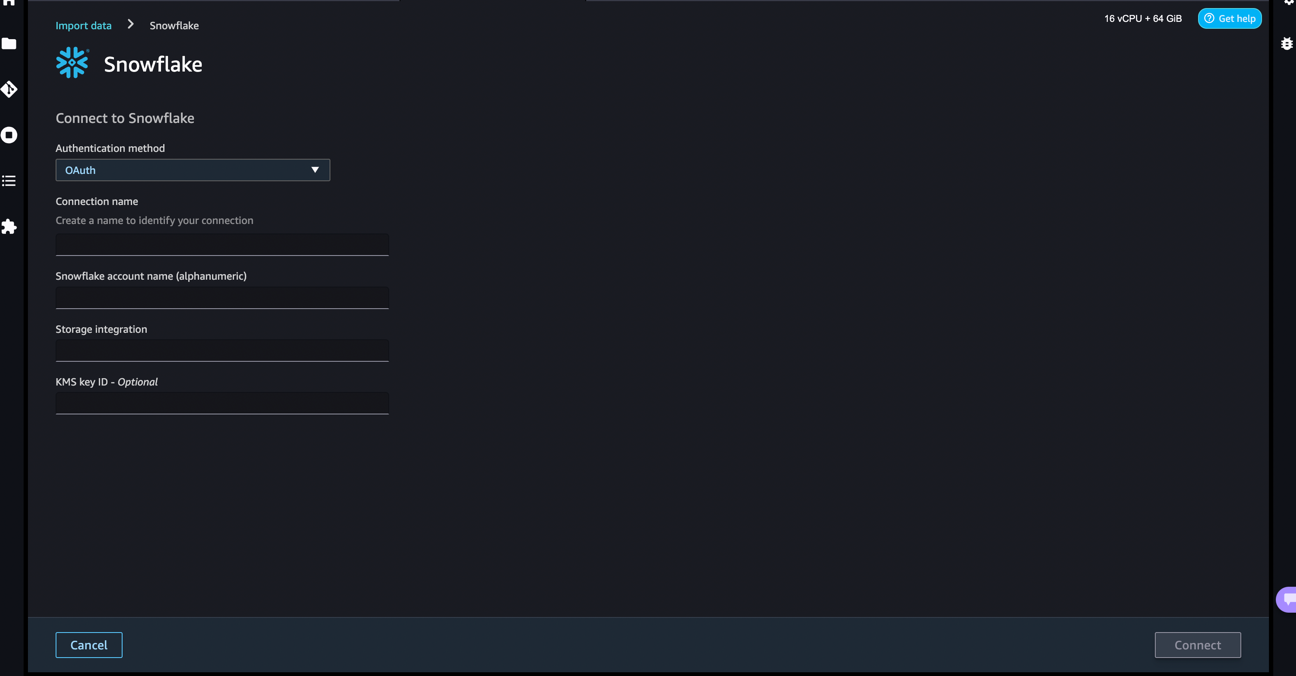

- Método de autentificación, escoger OAuth.

Si no ve OAuth, verifique los pasos de configuración del ciclo de vida anteriores.

- Ingrese los detalles para Nombre de cuenta de copo de nieve y Integración de almacenamiento.

- Ingrese un nombre de conexión y elija Contacto.

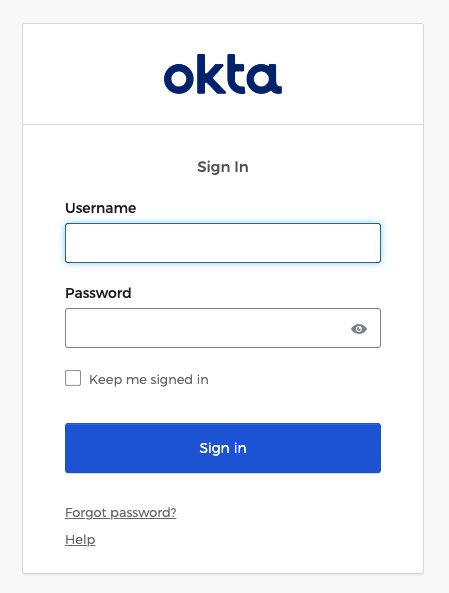

Se le redirige a una página de autenticación de IdP. Para este ejemplo, estamos usando Okta.

- Ingrese su nombre de usuario y contraseña, luego elija Iniciar Sesión.

Después de que la autenticación sea exitosa, se le redirigirá a la página de flujo de datos de Studio.

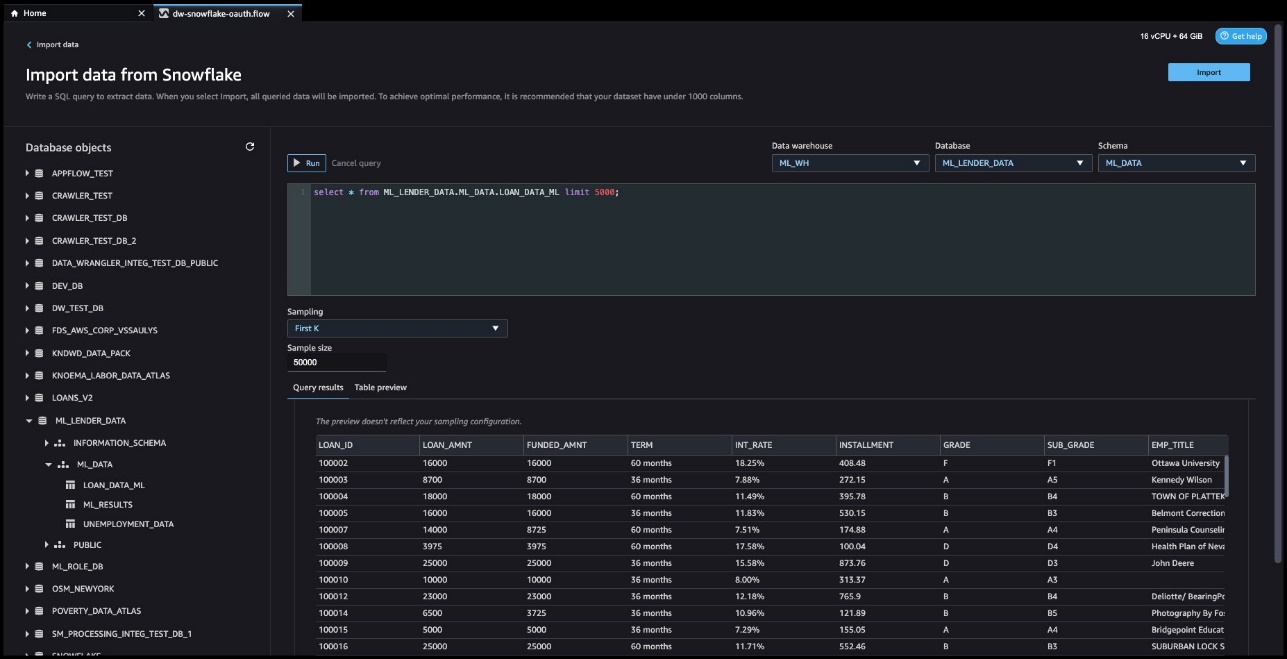

- En Importar datos de Snowflake página, explore los objetos de la base de datos o ejecute una consulta para los datos de destino.

- En el editor de consultas, ingrese una consulta y obtenga una vista previa de los resultados.

En el siguiente ejemplo, cargamos Datos de préstamos y recuperar todas las columnas de 5,000 filas.

- Elige Importa.

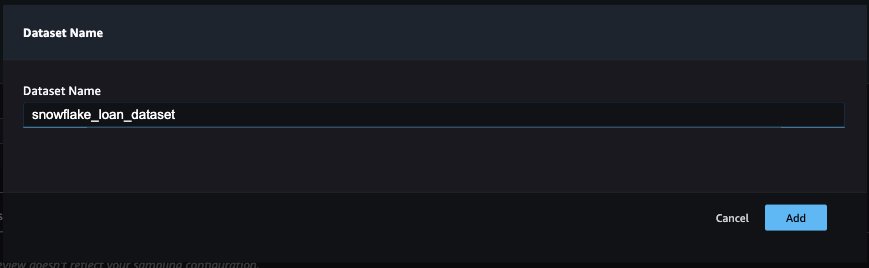

- Ingrese un nombre de conjunto de datos (para esta publicación, usamos

snowflake_loan_dataset) y elige Añada.

Eres redirigido a Preparar página, donde puede agregar transformaciones y análisis a los datos.

Data Wrangler facilita la ingesta de datos y la realización de tareas de preparación de datos, como el análisis exploratorio de datos, la selección de características y la ingeniería de características. Solo hemos cubierto algunas de las capacidades de Data Wrangler en esta publicación sobre preparación de datos; puede usar Data Wrangler para un análisis de datos más avanzado, como la importancia de las características, la fuga de objetivos y la explicabilidad del modelo mediante una interfaz de usuario fácil e intuitiva.

Analizar la calidad de los datos

Ingrese al Informe de información y calidad de datos para realizar un análisis de los datos que ha importado a Data Wrangler. Data Wrangler crea el informe a partir de los datos muestreados.

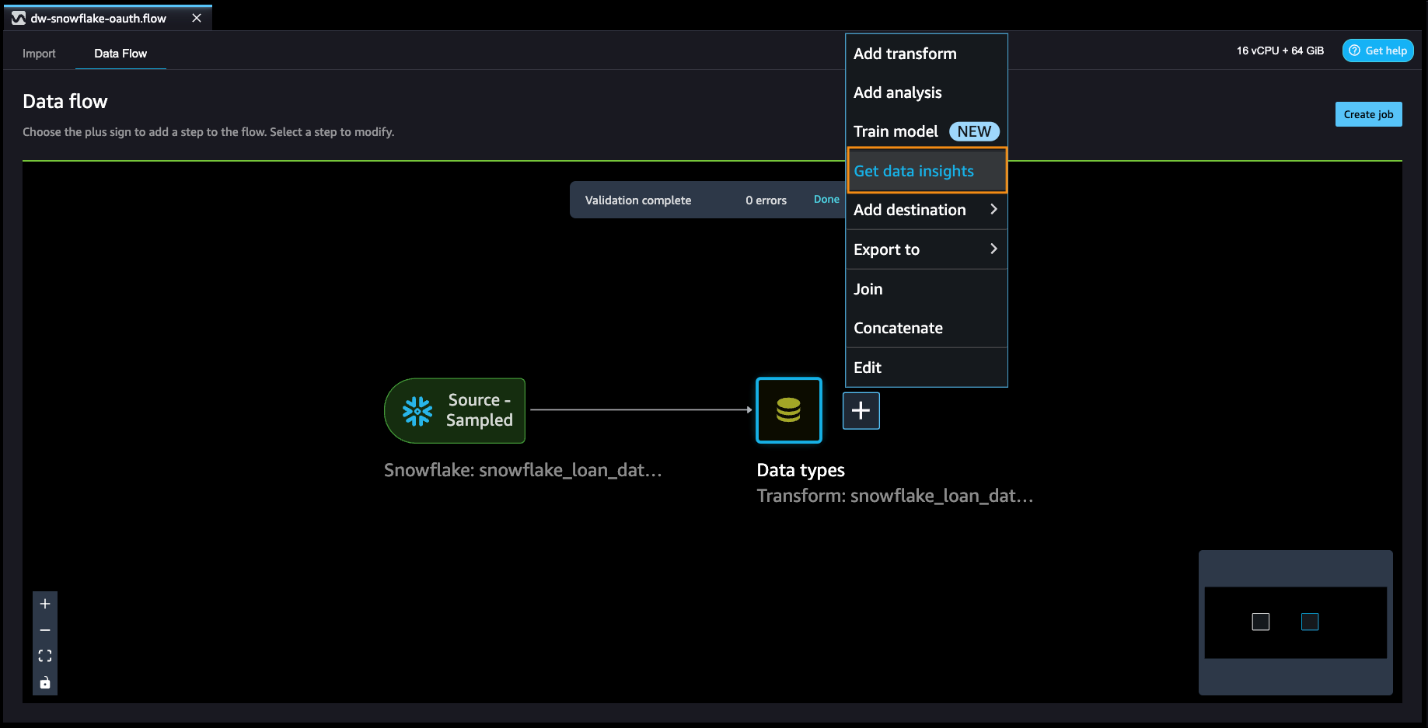

- En la página de flujo de Data Wrangler, elija el signo más junto a Tipos de datos, A continuación, elija Obtener información de datos.

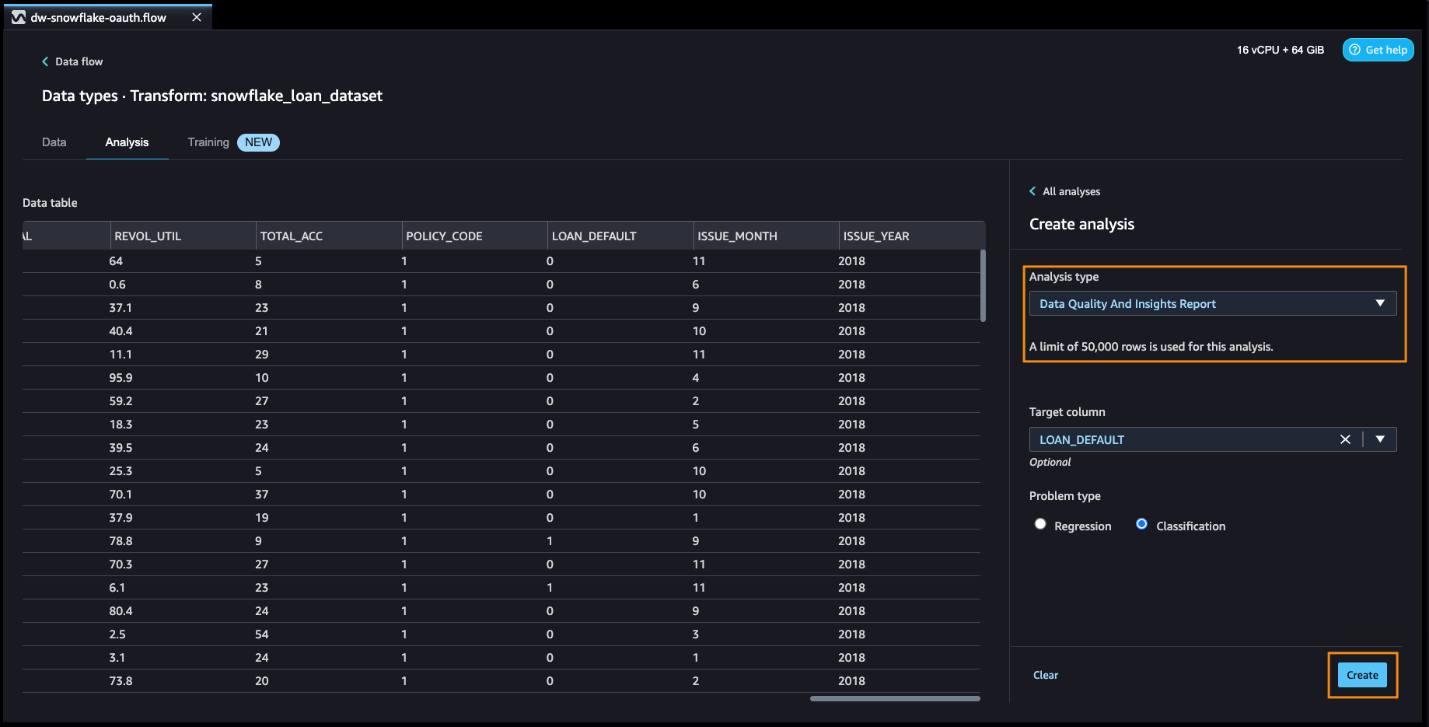

- Elige Informe de información y calidad de datos para Tipo de análisis.

- columna de destino, elija su columna de destino.

- Tipo de problema, seleccione Clasificación.

- Elige Crear.

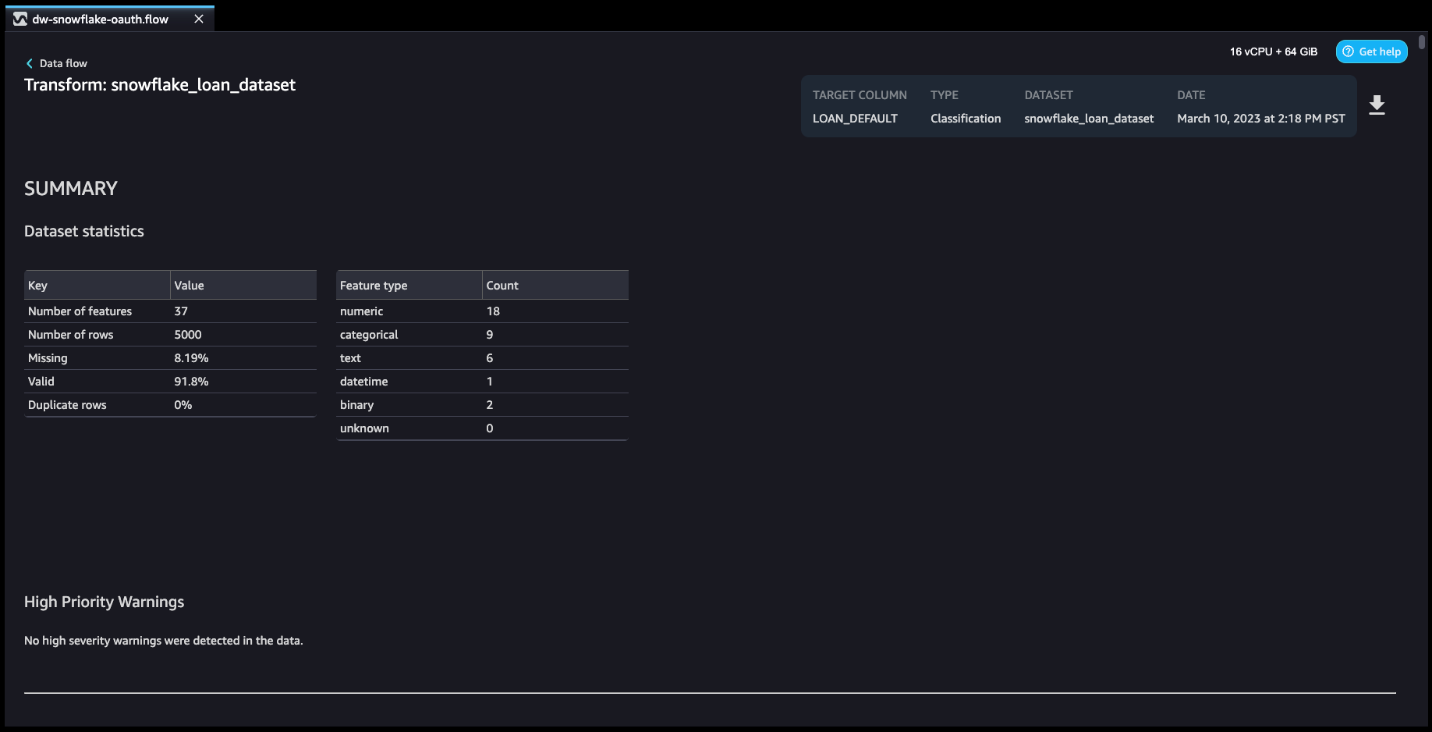

El informe de perspectivas tiene un breve resumen de los datos, que incluye información general, como valores faltantes, valores no válidos, tipos de características, recuentos de valores atípicos y más. Puede descargar el informe o verlo en línea.

Agregar transformaciones a los datos

Data Wrangler tiene más de 300 transformaciones integradas. En esta sección, usamos algunas de estas transformaciones para preparar el conjunto de datos para un modelo de AA.

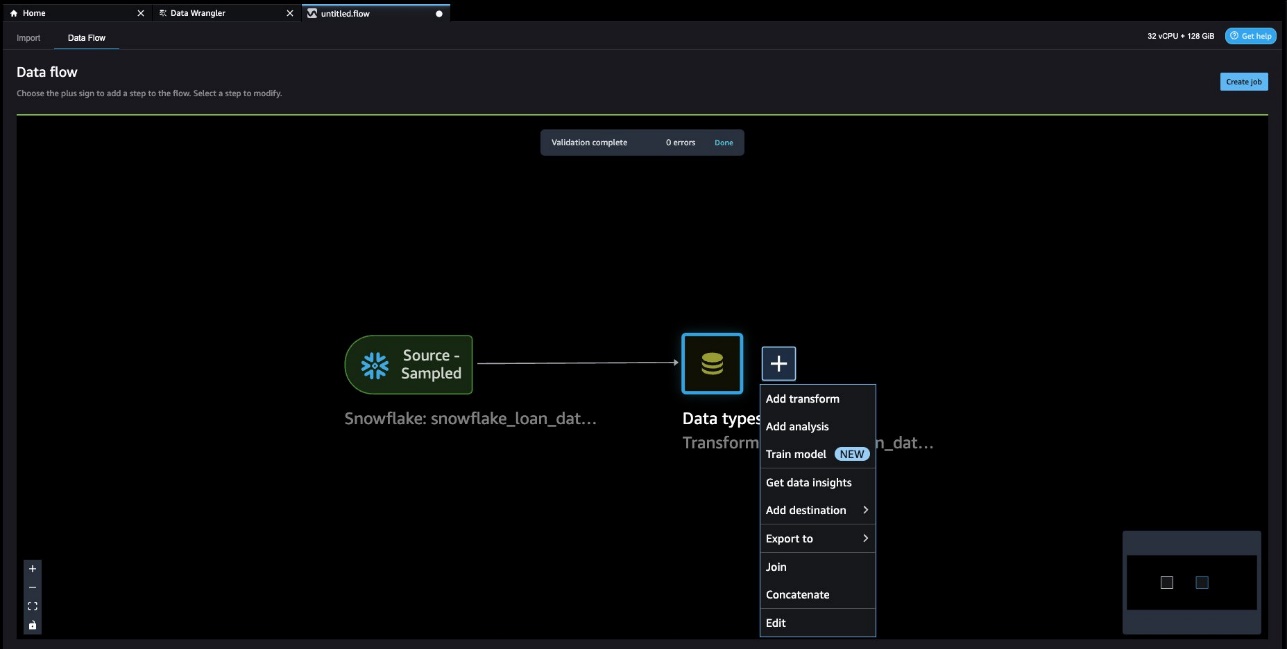

- En la página de flujo de Data Wrangler, elija el signo más, luego elija Agregar transformación.

Si está siguiendo los pasos de la publicación, se le dirigirá aquí automáticamente después de agregar su conjunto de datos.

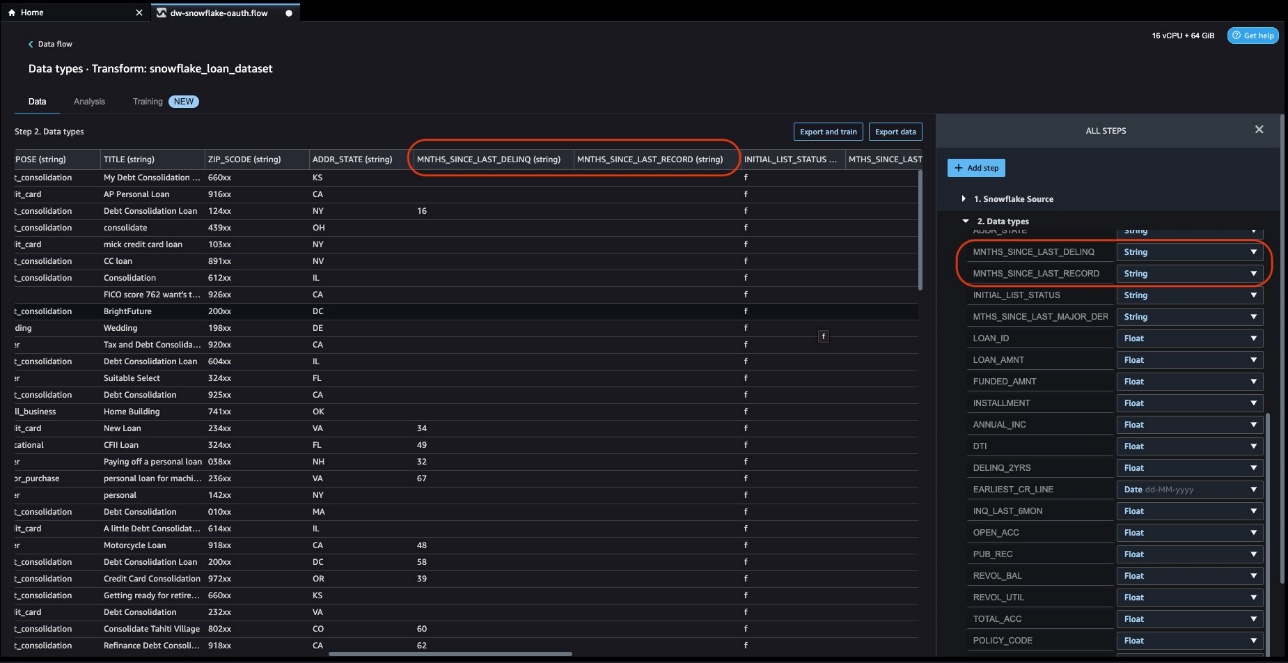

- Verifique y modifique el tipo de datos de las columnas.

Mirando a través de las columnas, identificamos que MNTHS_SINCE_LAST_DELINQ y MNTHS_SINCE_LAST_RECORD lo más probable es que se represente como un tipo de número en lugar de una cadena.

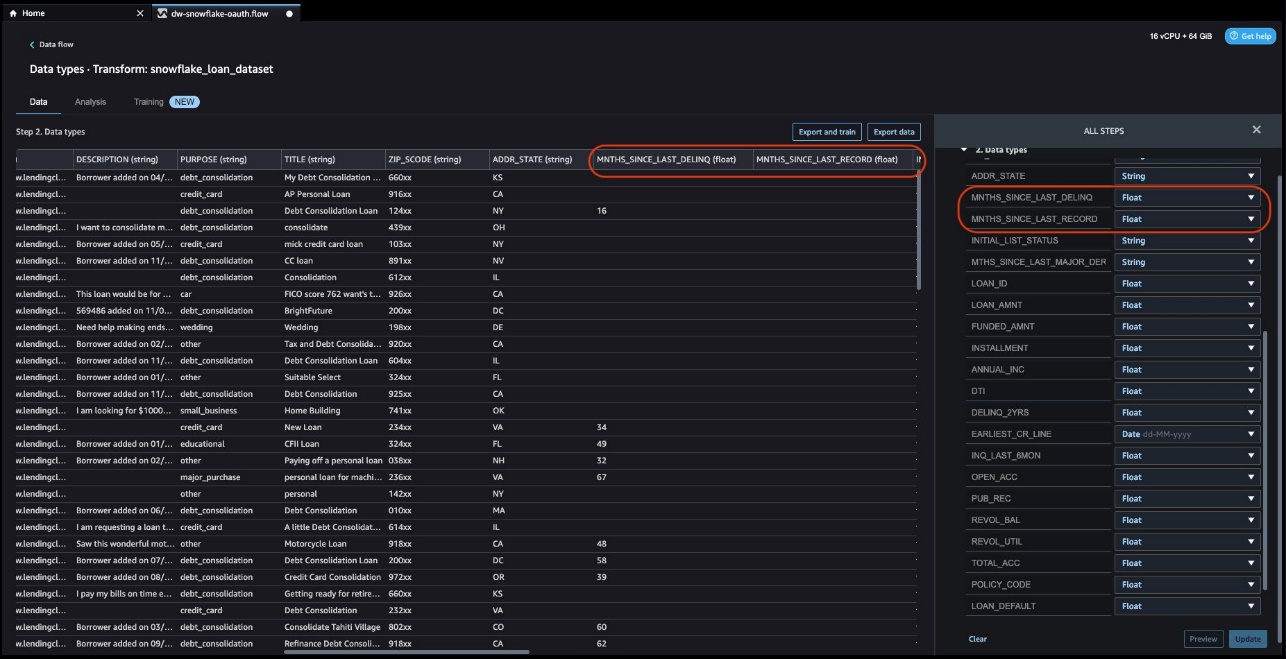

- Después de aplicar los cambios y agregar el paso, puede verificar que el tipo de datos de la columna se cambie a flotante.

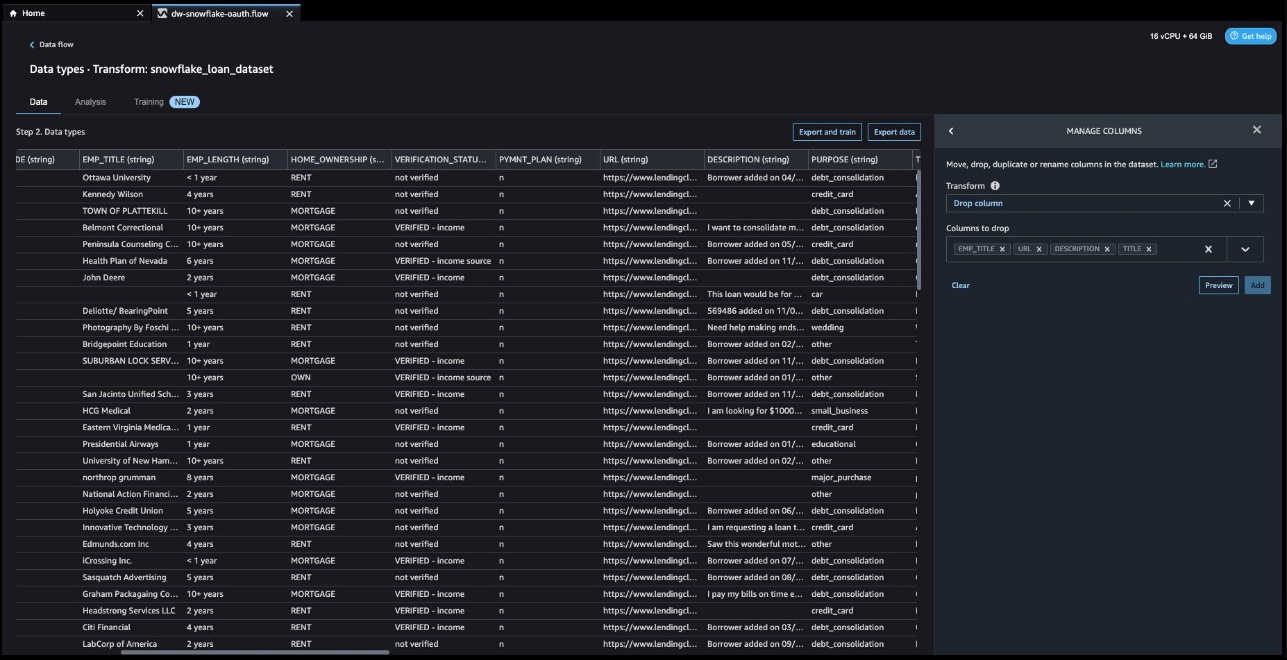

Mirando a través de los datos, podemos ver que los campos EMP_TITLE, URL, DESCRIPTIONy TITLE probablemente no proporcionará valor a nuestro modelo en nuestro caso de uso, por lo que podemos descartarlos.

- Elige Añadir paso, A continuación, elija Administrar columnas.

- Transformar, escoger Columna de caída.

- Columna para soltar, especificar

EMP_TITLE,URL,DESCRIPTIONyTITLE. - Elige Vista previa y Añada.

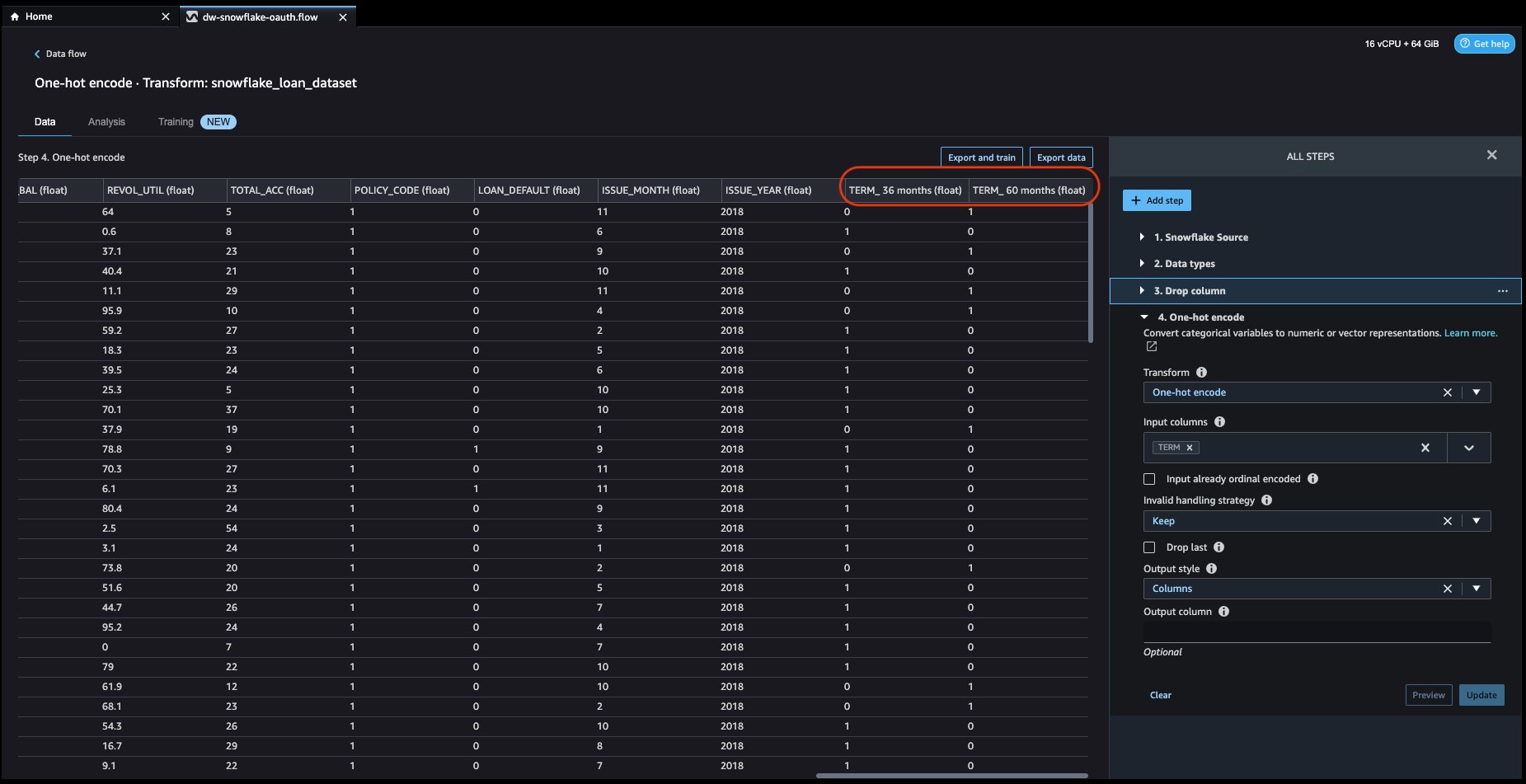

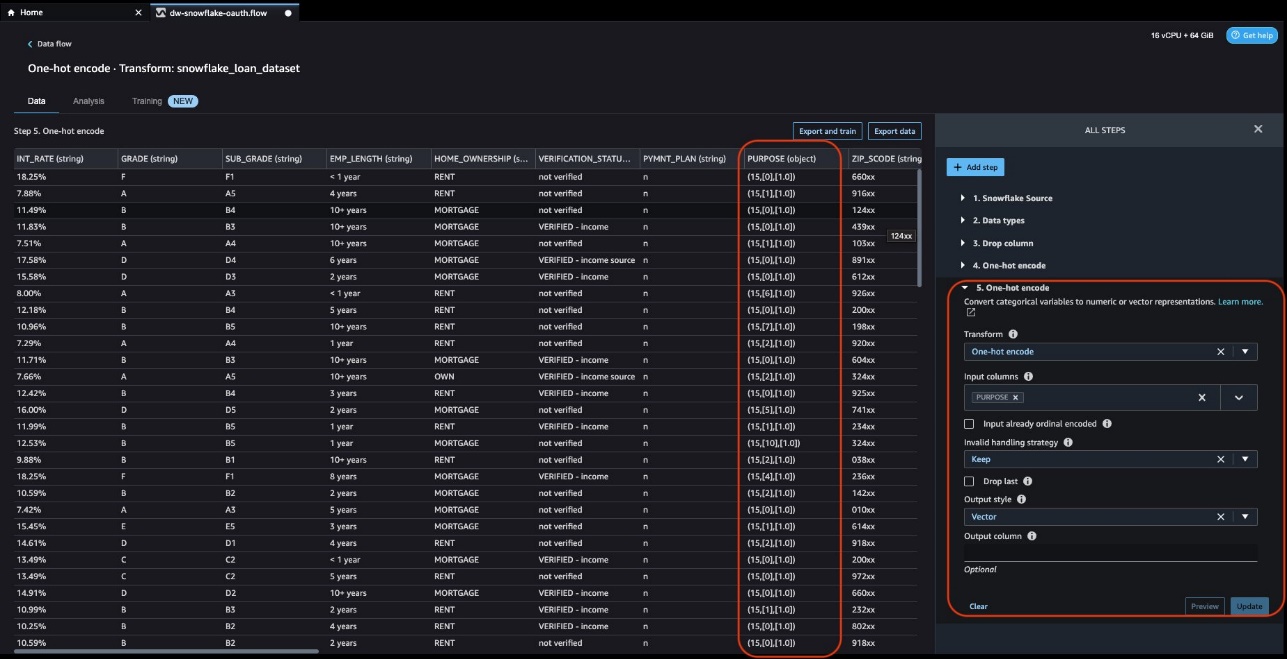

A continuación, queremos buscar datos categóricos en nuestro conjunto de datos. Data Wrangler tiene una funcionalidad incorporada para codificar datos categóricos usando codificaciones ordinales y one-hot. Al observar nuestro conjunto de datos, podemos ver que el TERM, HOME_OWNERSHIPy PURPOSE todas las columnas parecen ser de naturaleza categórica.

- Agregue otro paso y elija Codificar categórico.

- Transformar, escoger Codificación one-hot.

- Columna de entrada, escoger

TERM. - Estilo de salida, escoger Columnas.

- Deje todas las demás configuraciones como predeterminadas, luego elija Vista previa y Añada.

La HOME_OWNERSHIP columna tiene cuatro valores posibles: RENT, MORTGAGE, OWN, y otra.

- Repita los pasos anteriores para aplicar un enfoque de codificación one-hot en estos valores.

Por último, el PURPOSE columna tiene varios valores posibles. Para estos datos, también usamos un enfoque de codificación one-hot, pero establecemos la salida en un vector en lugar de columnas.

- Transformar, escoger Codificación one-hot.

- Columna de entrada, escoger

PURPOSE. - Estilo de salida, escoger vector.

- Columna de salida, llamamos a esta columna

PURPOSE_VCTR.

Esto mantiene el original PURPOSE columna, si decidimos usarla más tarde.

- Deje todas las demás configuraciones como predeterminadas, luego elija Vista previa y Añada.

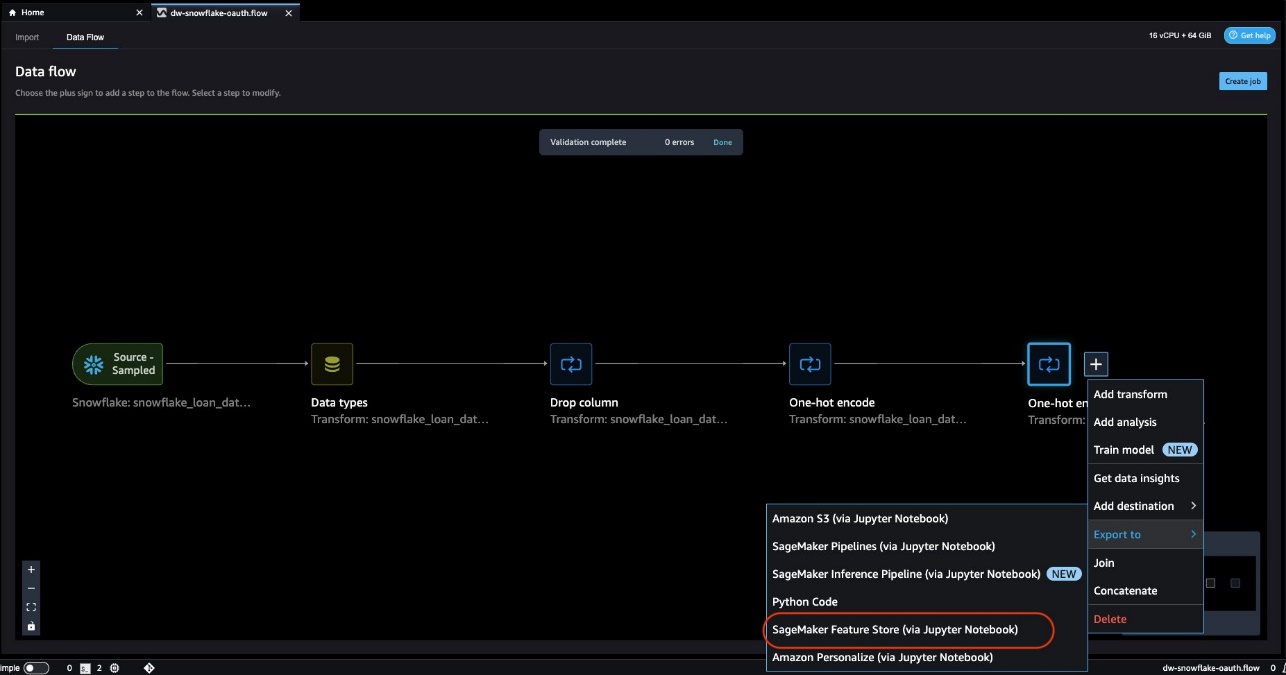

Exportar el flujo de datos

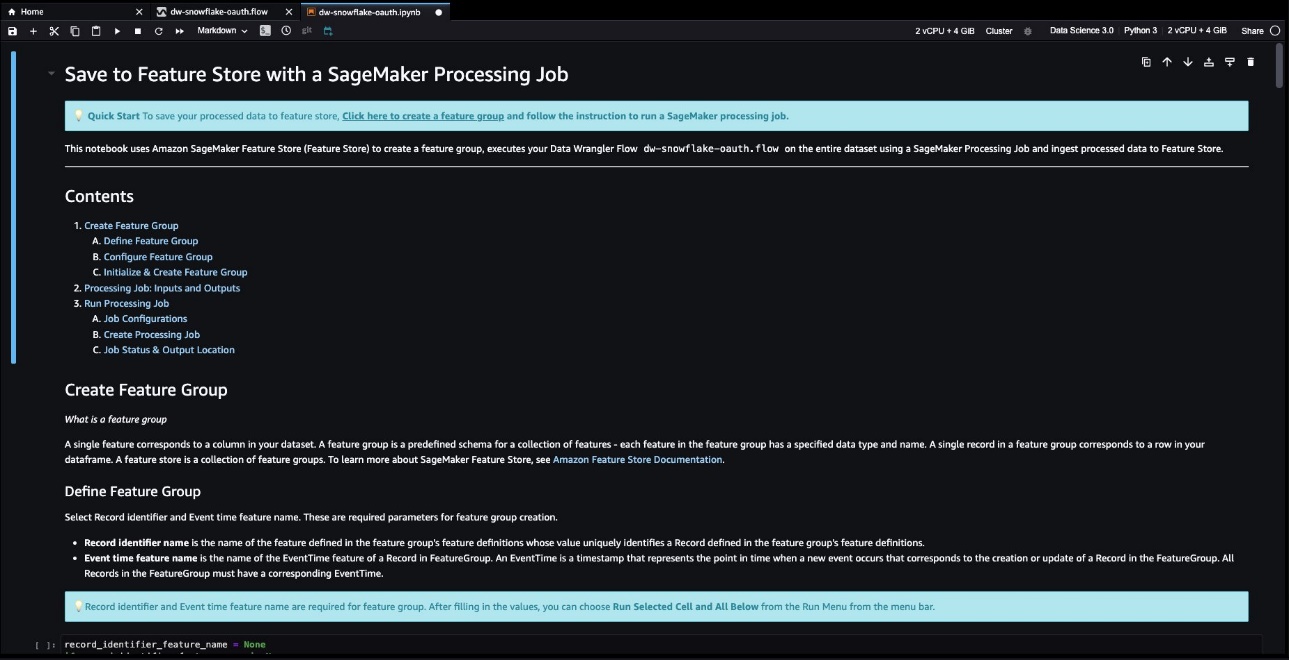

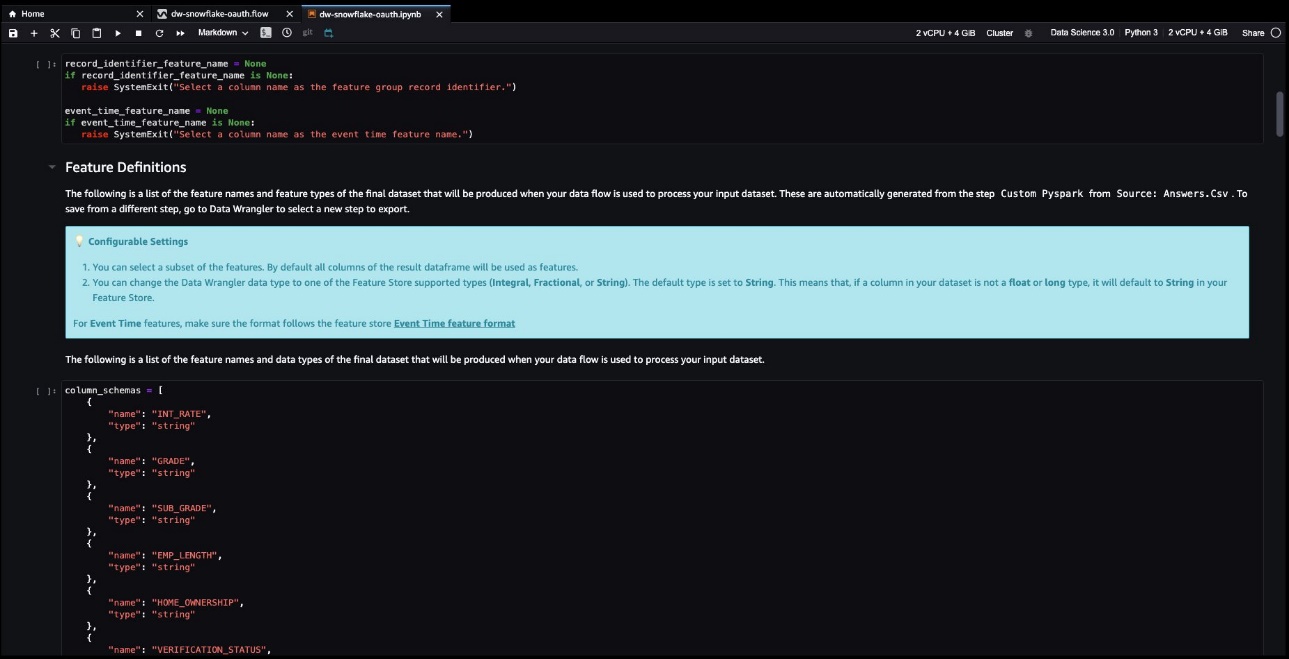

Finalmente, exportamos todo este flujo de datos a una tienda de funciones con un trabajo de procesamiento de SageMaker, que crea un cuaderno Jupyter con el código rellenado previamente.

- En la página de flujo de datos, elija el signo más y Exportar a.

- Elija dónde exportar. Para nuestro caso de uso, elegimos Tienda de funciones de SageMaker.

El cuaderno exportado ahora está listo para ejecutarse.

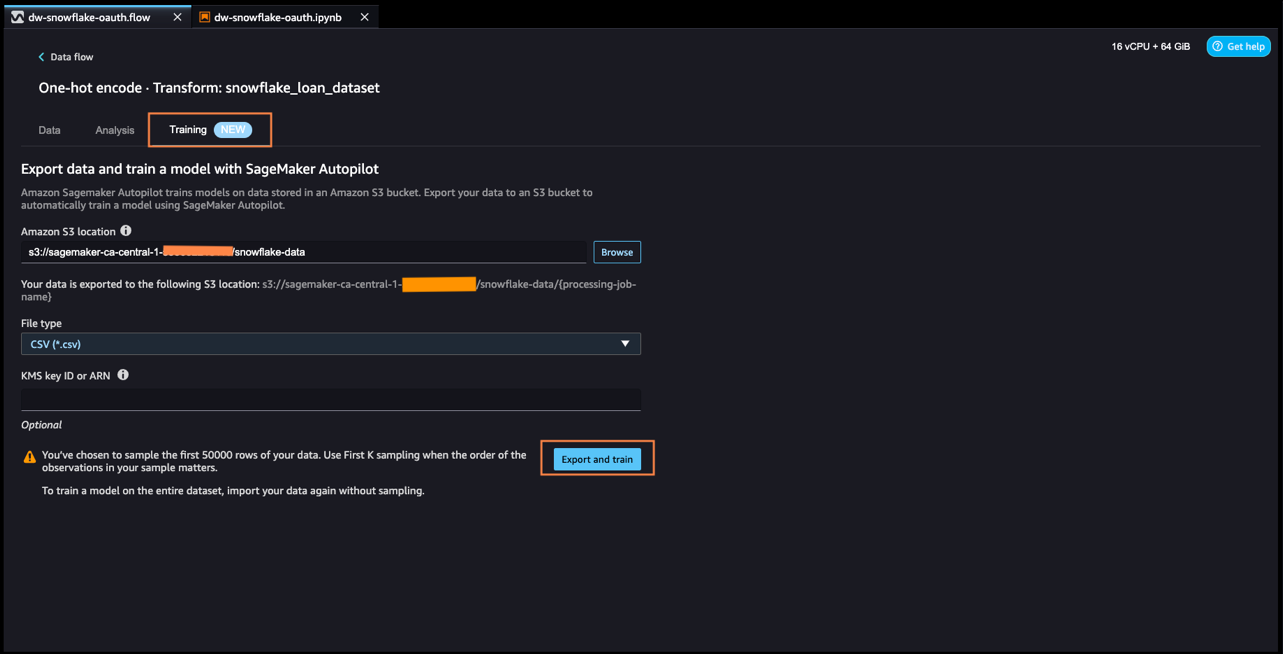

Exporte datos y entrene un modelo con Autopilot

Ahora podemos entrenar el modelo usando Piloto automático Amazon SageMaker.

- En la página de flujo de datos, elija el Formación .

- Ubicación de Amazon S3, ingrese una ubicación para guardar los datos.

- Elige Exportar y entrenar.

- Especifique la configuración en el Objetivo y características, Método de entrenamiento, Configuración de implementación y avanzaday Revisar y crear .

- Elige Crear experimento para encontrar el mejor modelo para su problema.

Limpiar

Si su trabajo con Data Wrangler está completo, cierre su instancia de Data Wrangler para evitar incurrir en tarifas adicionales.

Conclusión

En esta publicación, demostramos cómo conectar Data Wrangler a Snowflake usando OAuth, transformar y analizar un conjunto de datos y finalmente exportarlo al flujo de datos para que pueda usarse en un cuaderno Jupyter. En particular, creamos una canalización para la preparación de datos sin tener que escribir ningún código.

Para comenzar con Data Wrangler, consulte Prepare datos de AA con Amazon SageMaker Data Wrangler.

Sobre los autores

Ajjay Govindaram es arquitecto sénior de soluciones en AWS. Trabaja con clientes estratégicos que usan AI/ML para resolver problemas comerciales complejos. Su experiencia radica en brindar dirección técnica y asistencia en el diseño para implementaciones de aplicaciones de IA/ML de modestas a grandes escalas. Su conocimiento abarca desde arquitectura de aplicaciones hasta big data, análisis y aprendizaje automático. Le gusta escuchar música mientras descansa, experimentar el aire libre y pasar tiempo con sus seres queridos.

Ajjay Govindaram es arquitecto sénior de soluciones en AWS. Trabaja con clientes estratégicos que usan AI/ML para resolver problemas comerciales complejos. Su experiencia radica en brindar dirección técnica y asistencia en el diseño para implementaciones de aplicaciones de IA/ML de modestas a grandes escalas. Su conocimiento abarca desde arquitectura de aplicaciones hasta big data, análisis y aprendizaje automático. Le gusta escuchar música mientras descansa, experimentar el aire libre y pasar tiempo con sus seres queridos.

Bosco Alburquerque es arquitecto sénior de soluciones de socios en AWS y tiene más de 20 años de experiencia trabajando con productos de análisis y bases de datos de proveedores de bases de datos empresariales y proveedores de la nube. Ha ayudado a grandes empresas de tecnología a diseñar soluciones de análisis de datos y ha dirigido equipos de ingeniería en el diseño e implementación de plataformas de análisis de datos y productos de datos.

Bosco Alburquerque es arquitecto sénior de soluciones de socios en AWS y tiene más de 20 años de experiencia trabajando con productos de análisis y bases de datos de proveedores de bases de datos empresariales y proveedores de la nube. Ha ayudado a grandes empresas de tecnología a diseñar soluciones de análisis de datos y ha dirigido equipos de ingeniería en el diseño e implementación de plataformas de análisis de datos y productos de datos.

mate marzillo es ingeniero de ventas socio sénior en Snowflake. Tiene 10 años de experiencia en roles de ciencia de datos y aprendizaje automático tanto en consultoría como con organizaciones de la industria. Matt tiene experiencia en el desarrollo y la implementación de modelos de IA y ML en muchas organizaciones diferentes en áreas como marketing, ventas, operaciones, clínica y finanzas, además de asesorar en funciones consultivas.

mate marzillo es ingeniero de ventas socio sénior en Snowflake. Tiene 10 años de experiencia en roles de ciencia de datos y aprendizaje automático tanto en consultoría como con organizaciones de la industria. Matt tiene experiencia en el desarrollo y la implementación de modelos de IA y ML en muchas organizaciones diferentes en áreas como marketing, ventas, operaciones, clínica y finanzas, además de asesorar en funciones consultivas.

Huong Nguyen es líder de producto para Amazon SageMaker Data Wrangler en AWS. Tiene 15 años de experiencia en la creación de productos basados en datos y obsesionados con el cliente para espacios empresariales y de consumo. En su tiempo libre, disfruta de los audiolibros, la jardinería, el senderismo y pasar tiempo con su familia y amigos.

Huong Nguyen es líder de producto para Amazon SageMaker Data Wrangler en AWS. Tiene 15 años de experiencia en la creación de productos basados en datos y obsesionados con el cliente para espacios empresariales y de consumo. En su tiempo libre, disfruta de los audiolibros, la jardinería, el senderismo y pasar tiempo con su familia y amigos.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- Platoblockchain. Inteligencia del Metaverso Web3. Conocimiento amplificado. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/access-snowflake-data-using-oauth-based-authentication-in-amazon-sagemaker-data-wrangler/

- :es

- $ UP

- 000

- 10

- 100

- 15 años

- 20 años

- 7

- 8

- 9

- a

- Poder

- Nuestra Empresa

- de la máquina

- Acceso a los datos

- el acceso

- Mi Cuenta

- a través de

- Ad

- adición

- Adicionales

- Admin

- avanzar

- avanzado

- del asesoramiento

- Después

- AI

- AI / ML

- Todos

- Amazon

- Amazon SageMaker

- Wrangler de datos de Amazon SageMaker

- Analiza

- análisis

- Analytics

- analizar

- el análisis de

- y

- Otra

- abejas

- applicación

- Aparecer

- Aplicación

- Aplicá

- La aplicación de

- enfoque

- aplicaciones

- arquitectura

- somos

- áreas

- AS

- Ayuda

- asociado

- At

- adjuntar

- las ventas

- audio

- autenticar

- Autenticación

- autorización

- automatizado

- automáticamente

- AWS

- Azure

- BE

- porque

- antes

- comenzar

- MEJOR

- Big

- Big Data

- cuerpo

- Libros

- incorporado

- by

- llamar al

- , que son

- PUEDEN

- capacidades

- case

- CAT

- Cambios

- manera?

- Elige

- cliente

- Clínico

- Soluciones

- código

- Columna

- Columnas

- Empresas

- completar

- integraciones

- concepto

- Configuración

- Contacto

- Conectándote

- conexión

- Consola

- consultoría

- consumidor

- contenido

- podría

- Protectora

- cubierto

- Para crear

- creado

- crea

- Creamos

- Referencias

- Clientes

- datos

- análisis de los datos

- Data Analytics

- Plataforma de datos

- Preparación de datos

- Ciencia de los datos

- científico de datos

- basada en datos

- Base de datos

- decidir

- Predeterminado

- demostrado

- Desplegando

- Despliegues

- Diseño

- diseño

- detalle

- detalles

- el desarrollo

- una experiencia diferente

- dirección

- directamente

- distinto

- documentación

- No

- dominio

- No

- DE INSCRIPCIÓN

- descargar

- Soltar

- cada una

- editor

- efecto

- ya sea

- habilitar

- ingeniero

- Ingeniería

- Participar

- Empresa

- Entorno

- ejemplo

- existente

- experience

- experimentando

- Análisis exploratorio de datos

- exportar

- externo

- FALLO

- familia

- Feature

- Caracteristicas

- Costes

- pocos

- campo

- Terrenos

- Archive

- Finalmente

- financiar

- Encuentre

- Flotador

- de tus señales

- siguiendo

- formato

- Frecuencia

- frecuentemente

- amigos

- Desde

- a la fatiga

- General

- obtener

- da

- conceder

- mayor

- Guías

- Tienen

- es

- ayuda

- ayudado

- esta página

- Inicio

- Cómo

- Como Hacer

- HTML

- http

- HTTPS

- ID

- identificador

- Identifique

- Identidad

- Idle

- implementación

- importar

- importancia

- in

- incluye

- Incluye

- incorrectamente

- energético

- información

- Las opciones de entrada

- penetración

- Insights

- Instrucciones

- integración

- integraciones

- Interfaz

- intuitivo

- involucra

- IT

- Trabajos

- Empleo

- jpg

- Clave

- especialistas

- large

- Gran escala

- líder

- aprendizaje

- LED

- se encuentra

- ciclo de vida

- momentos involvidables

- como

- que otros

- Lista

- Escucha Activa

- carga

- cargas

- Ubicación

- Mira

- mirando

- ser querido

- máquina

- máquina de aprendizaje

- hecho

- para lograr

- HACE

- Realizar

- gerente

- muchos

- Marketing

- mensaje

- podría

- Min

- que falta

- ML

- modelo

- modelos

- modificar

- más,

- MEJOR DE TU

- múltiples

- Música

- nombre

- nombres

- Naturaleza

- Navegación

- ¿ Necesita ayuda

- necesidad

- Nuevo

- Next

- notablemente

- cuaderno

- número

- juramento

- objetos

- of

- OCTA

- on

- ONE

- en línea

- Operaciones

- Optión

- para las fiestas.

- reconocida por

- Otro

- de otra manera

- al exterior

- salida

- EL DESARROLLADOR

- página

- pares

- cristal

- Socio

- Contraseña

- Realizar

- permisos

- con

- industrial

- plataforma

- Plataformas

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- más

- políticas

- ventanas emergentes

- posible

- Publicación

- preferido

- Preparar

- requisitos previos

- Vista previa

- anterior

- Problema

- problemas

- procedimientos

- tratamiento

- Producto

- Productos

- Mi Perfil

- Programación

- correctamente

- proporcionar

- previsto

- proveedor

- los proveedores

- proporciona un

- proporcionando

- calidad

- más bien

- ready

- recomiendan

- reorientar

- la reducción de

- región

- registrarte

- registrarse

- Registro

- relanzar

- reporte

- representado

- exigir

- aquellos

- RESTO

- resultado

- Resultados

- el comercio minorista

- Función

- También soy miembro del cuerpo docente de World Extreme Medicine (WEM) y embajadora europea de igualdad para The Transformational Travel Council (TTC). En mi tiempo libre, soy una incansable aventurera, escaladora, patrona de día, buceadora y defensora de la igualdad de género en el deporte y la aventura. En XNUMX, fundé Almas Libres, una ONG nacida para involucrar, educar y empoderar a mujeres y niñas a través del deporte urbano, la cultura y la tecnología.

- Ejecutar

- correr

- sabio

- ventas

- programación

- Ciencia:

- Científico

- los científicos

- alcance

- Secreto

- Sección

- (secciones)

- EN LINEA

- selección

- mayor

- Sensibilidad

- set

- pólipo

- ajustes

- Varios

- Cáscara

- tienes

- Mostrar

- firmar

- sencillos

- soltero

- So

- Soluciones

- RESOLVER

- algo

- Fuente

- Fuentes

- espacios

- Gastos

- fundó

- comienza

- paso

- pasos

- STORAGE

- tienda

- almacenados

- almacenamiento

- Estratégico

- Cordón

- estudio

- exitosos

- tal

- RESUMEN

- SOPORTE

- soportes

- ETIQUETA

- ¡Prepárate!

- toma

- Target

- afectados

- tareas

- equipos

- Técnico

- Tecnología

- empresas tecnológicas

- esa

- La

- la información

- su

- Les

- Estas

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- a

- ficha

- Tokens

- Entrenar

- Transformar

- transformaciones

- transformadora

- tipos

- bajo

- entender

- único

- Actualizar

- Enlance

- utilizan el

- caso de uso

- Usuario

- Interfaz de usuario

- usuarios

- propuesta de

- Valores

- vendedores

- verificar

- vía

- Ver

- visibles

- tutorial

- advertencia

- Semanas

- WELL

- que

- mientras

- QUIENES

- todo

- seguirá

- dentro de

- sin

- Actividades:

- flujos de trabajo

- trabajando

- funciona

- escribir

- la escritura

- años

- Usted

- tú

- zephyrnet