La creación de canales de aprendizaje automático (ML) escalables y eficientes es crucial para optimizar el desarrollo, la implementación y la gestión de modelos de ML. En esta publicación, presentamos un marco para automatizar la creación de un gráfico acíclico dirigido (DAG) para Canalizaciones de Amazon SageMaker Basado en archivos de configuración simples. El código marco y ejemplos Los métodos presentados aquí solo cubren los canales de capacitación de modelos, pero también se pueden extender fácilmente a los canales de inferencia por lotes.

Este marco dinámico utiliza archivos de configuración para organizar los pasos de preprocesamiento, capacitación, evaluación y registro para casos de uso de modelo único y multimodelo basados en scripts de Python definidos por el usuario, necesidades de infraestructura (incluidos Nube privada virtual de Amazon (Amazon VPC) subredes y grupos de seguridad, Gestión de identidades y accesos de AWS (IAM) roles, Servicio de administración de claves de AWS (AWS KMS), registro de contenedores y tipos de instancia), entrada y salida Servicio de almacenamiento simple de Amazon (Amazon S3) rutas y etiquetas de recursos. Los archivos de configuración (YAML y JSON) permiten a los profesionales de ML especificar código indiferenciado para orquestar canales de capacitación utilizando sintaxis declarativa. Esto permite a los científicos de datos crear e iterar rápidamente modelos de ML, y permite a los ingenieros de ML ejecutar canales de ML de integración continua y entrega continua (CI/CD) más rápidamente, lo que reduce el tiempo de producción de los modelos.

Resumen de la solución

El código marco propuesto comienza leyendo los archivos de configuración. Luego crea dinámicamente un DAG de SageMaker Pipelines basado en los pasos declarados en los archivos de configuración y las interacciones y dependencias entre los pasos. Este marco de orquestación atiende casos de uso tanto de modelo único como de modelo múltiple, y proporciona un flujo fluido de datos y procesos. Los siguientes son los beneficios clave de esta solución:

- Automatización – Todo el flujo de trabajo de ML, desde el preprocesamiento de datos hasta el registro de modelos, se organiza sin intervención manual. Esto reduce el tiempo y el esfuerzo necesarios para la experimentación y puesta en funcionamiento del modelo.

- Reproducibilidad – Con un archivo de configuración predefinido, los científicos de datos y los ingenieros de ML pueden reproducir todo el flujo de trabajo, logrando resultados consistentes en múltiples ejecuciones y entornos.

- Escalabilidad – Amazon SageMaker se utiliza en todo el proceso, lo que permite a los profesionales del aprendizaje automático procesar grandes conjuntos de datos y entrenar modelos complejos sin problemas de infraestructura.

- Flexibilidad – El marco es flexible y puede adaptarse a una amplia gama de casos de uso de ML, marcos de ML (como XGBoost y TensorFlow), entrenamiento multimodelo y entrenamiento de múltiples pasos. Cada paso del DAG de capacitación se puede personalizar a través del archivo de configuración.

- Modelo de gobernanza - El Registro de modelos de Amazon SageMaker La integración permite realizar un seguimiento de las versiones de los modelos y, por lo tanto, promoverlas a producción con confianza.

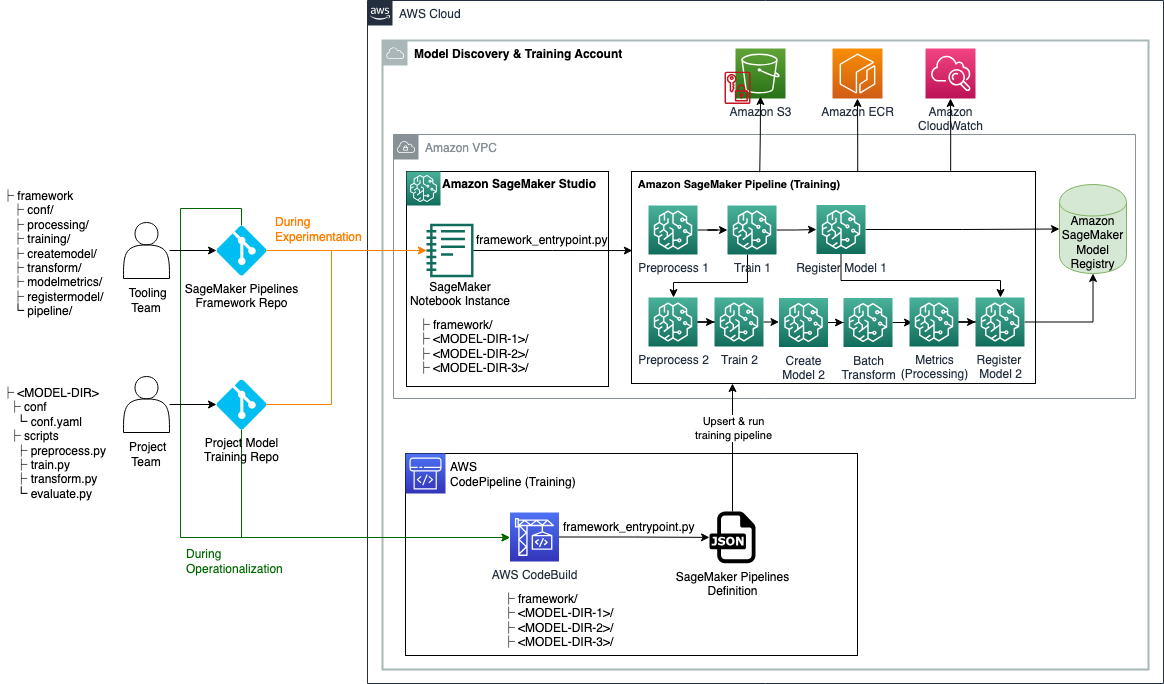

El siguiente diagrama de arquitectura muestra cómo puede utilizar el marco propuesto durante la experimentación y la puesta en funcionamiento de los modelos de ML. Durante la experimentación, puede clonar el repositorio de código de marco proporcionado en esta publicación y los repositorios de código fuente específicos de su proyecto en Estudio Amazon SageMakery configure su entorno virtual (detallado más adelante en esta publicación). Luego puede iterar sobre scripts de preprocesamiento, capacitación y evaluación, así como opciones de configuración. Para crear y ejecutar un DAG de entrenamiento de SageMaker Pipelines, puede llamar al punto de entrada del marco, que leerá todos los archivos de configuración, creará los pasos necesarios y los organizará según el orden de pasos y las dependencias especificadas.

Durante la puesta en funcionamiento, la canalización de CI clona el repositorio de código del marco y los repositorios de capacitación específicos del proyecto en un Construcción de código AWS trabajo, donde se llama al script de punto de entrada del marco para crear o actualizar el DAG de entrenamiento de SageMaker Pipelines y luego ejecutarlo.

Estructura del repositorio

El Repositorio GitHub contiene los siguientes directorios y archivos:

- /marco/conf/ – Este directorio contiene un archivo de configuración que se utiliza para establecer variables comunes en todas las unidades de modelado, como subredes, grupos de seguridad y funciones de IAM en tiempo de ejecución. Una unidad de modelado es una secuencia de hasta seis pasos para entrenar un modelo de ML.

- /framework/createmodel/ – Este directorio contiene un script de Python que crea un modelo de SageMaker objeto basado en artefactos modelo de un Paso de capacitación de SageMaker Pipelines. El objeto modelo se utiliza posteriormente en un Transformación por lotes de SageMaker trabajo para evaluar el rendimiento del modelo en un conjunto de prueba.

- /framework/modelmetrics/ – Este directorio contiene un script de Python que crea un Procesamiento de Amazon SageMaker trabajo para generar un informe JSON de métricas de modelo para un modelo entrenado basado en los resultados de un trabajo de transformación por lotes de SageMaker realizado en datos de prueba.

- /marco/canalización/ – Este directorio contiene scripts de Python que utilizan clases de Python definidas en otros directorios del marco para crear o actualizar un DAG de SageMaker Pipelines en función de las configuraciones especificadas. Pipeline_service.py utiliza el script model_unit.py para crear una o más unidades de modelado. Cada unidad de modelado es una secuencia de hasta seis pasos para entrenar un modelo de ML: procesar, entrenar, crear modelo, transformar, métricas y registrar modelo. Las configuraciones para cada unidad de modelado deben especificarse en el repositorio respectivo del modelo. pipeline_service.py también establece dependencias entre los pasos de SageMaker Pipelines (cómo se secuencian o encadenan los pasos dentro y entre las unidades de modelado) según la sección sagemakerPipeline, que debe definirse en el archivo de configuración de uno de los repositorios de modelos (el modelo ancla). Esto le permite anular las dependencias predeterminadas inferidas por SageMaker Pipelines. Analizaremos la estructura del archivo de configuración más adelante en esta publicación.

- /marco/procesamiento/ – Este directorio contiene una secuencia de comandos de Python que crea un trabajo de procesamiento de SageMaker basado en la imagen de Docker especificada y la secuencia de comandos del punto de entrada.

- /framework/registermodel/ – Este directorio contiene un script de Python para registrar un modelo entrenado junto con sus métricas calculadas en SageMaker Model Registry.

- /marco/formación/ – Este directorio contiene un script de Python que crea un trabajo de capacitación de SageMaker.

- /marco/transformar/ – Este directorio contiene un script de Python que crea un trabajo de transformación por lotes de SageMaker. En el contexto del entrenamiento de modelos, esto se utiliza para calcular la métrica de rendimiento de un modelo entrenado en datos de prueba.

- /marco/utilidades/ – Este directorio contiene secuencias de comandos de utilidad para leer y unir archivos de configuración, así como para iniciar sesión.

- /framework_entrypoint.py – Este archivo es el punto de entrada del código marco. Llama a una función definida en el directorio /framework/pipeline/ para crear o actualizar un DAG de SageMaker Pipelines y ejecutarlo.

- /ejemplos/ – Este directorio contiene varios ejemplos de cómo puede utilizar este marco de automatización para crear DAG de capacitación simples y complejos.

- /env.env – Este archivo le permite configurar variables comunes como subredes, grupos de seguridad y funciones de IAM como variables de entorno.

- /requisitos.txt – Este archivo especifica las bibliotecas de Python necesarias para el código del marco.

Requisitos previos

Debe tener los siguientes requisitos previos antes de implementar esta solución:

- Una cuenta de AWS

- Estudio SageMaker

- Un rol de SageMaker con permisos de lectura/escritura de Amazon S3 y permisos de cifrado/descifrado de AWS KMS

- Un depósito de S3 para almacenar datos, scripts y artefactos de modelo

- Opcionalmente, el Interfaz de línea de comandos de AWS (CLI de AWS)

- Python3 (Python 3.7 o superior) y los siguientes paquetes de Python:

- boto3

- sabio

- PyYAML

- Paquetes de Python adicionales utilizados en sus scripts personalizados

Implementar la solución

Complete los siguientes pasos para implementar la solución:

- Organice su repositorio de capacitación modelo de acuerdo con la siguiente estructura:

- Clona el código del marco y el código fuente de tu modelo de los repositorios de Git:

-

- Clon

dynamic-sagemaker-pipelines-frameworkrepositorio en un directorio de capacitación. En el siguiente código, asumimos que el directorio de capacitación se llamaaws-train: - Clona el código fuente del modelo en el mismo directorio. Para el entrenamiento con varios modelos, repita este paso para tantos modelos como necesite entrenar.

- Clon

Para la capacitación de un solo modelo, su directorio debería verse como el siguiente:

Para la capacitación multimodelo, su directorio debería verse como el siguiente:

- Configure las siguientes variables de entorno. Los asteriscos indican variables de entorno necesarias; el resto son opcionales.

| Variable ambiental | Descripción |

SMP_ACCOUNTID* |

Cuenta de AWS donde se ejecuta la canalización de SageMaker |

SMP_REGION* |

Región de AWS donde se ejecuta la canalización de SageMaker |

SMP_S3BUCKETNAME* |

Nombre del depósito S3 |

SMP_ROLE* |

Rol de SageMaker |

SMP_MODEL_CONFIGPATH* |

Ruta relativa de los archivos de configuración de un solo modelo o de varios modelos |

SMP_SUBNETS |

ID de subred para la configuración de red de SageMaker |

SMP_SECURITYGROUPS |

ID de grupo de seguridad para la configuración de red de SageMaker |

Para casos de uso de un solo modelo, SMP_MODEL_CONFIGPATH se mostrarán <MODEL-DIR>/conf/conf.yaml. Para casos de uso de múltiples modelos, SMP_MODEL_CONFIGPATH se mostrarán */conf/conf.yaml, que le permite encontrar todos conf.yaml archivos usando el módulo glob de Python y combinarlos para formar un archivo de configuración global. Durante la experimentación (pruebas locales), puede especificar variables de entorno dentro del archivo env.env y luego exportarlas ejecutando el siguiente comando en su terminal:

Tenga en cuenta que los valores de las variables de entorno en env.env debe colocarse entre comillas (por ejemplo, SMP_REGION="us-east-1"). Durante la puesta en funcionamiento, estas variables de entorno deben ser establecidas por la canalización de CI.

- Cree y active un entorno virtual ejecutando los siguientes comandos:

- Instale los paquetes de Python necesarios ejecutando el siguiente comando:

- Edite el entrenamiento de su modelo

conf.yamlarchivos. Discutimos la estructura del archivo de configuración en la siguiente sección. - Desde la terminal, llame al punto de entrada del marco para crear o actualizar y ejecutar el DAG de entrenamiento de SageMaker Pipeline:

- Ver y depurar las canalizaciones de SageMaker ejecutadas en el Pipelines pestaña de la interfaz de usuario de SageMaker Studio.

Estructura del archivo de configuración

Hay dos tipos de archivos de configuración en la solución propuesta: configuración del marco y configuración del modelo. En esta sección, describimos cada uno en detalle.

Configuración del marco

El /framework/conf/conf.yaml El archivo establece las variables que son comunes en todas las unidades de modelado. Esto incluye SMP_S3BUCKETNAME, SMP_ROLE, SMP_MODEL_CONFIGPATH, SMP_SUBNETS, SMP_SECURITYGROUPSy SMP_MODELNAME. Consulte el Paso 3 de las instrucciones de implementación para obtener descripciones de estas variables y cómo configurarlas mediante variables de entorno.

Configuración del modelo

Para cada modelo en el proyecto, debemos especificar lo siguiente en el <MODEL-DIR>/conf/conf.yaml archivo (los asteriscos indican las secciones requeridas; el resto son opcionales):

- /conf/modelos* – En esta sección puede configurar una o más unidades de modelado. Cuando se ejecuta el código del marco, leerá automáticamente todos los archivos de configuración durante el tiempo de ejecución y los agregará al árbol de configuración. Teóricamente, puedes especificar todas las unidades de modelado en el mismo

conf.yamlarchivo, pero se recomienda especificar la configuración de cada unidad de modelado en su respectivo directorio o repositorio Git para minimizar errores. Las unidades son las siguientes:- {nombre del modelo}* – El nombre del modelo.

- directorio_fuente* - Una común

source_dirruta a utilizar para todos los pasos dentro de la unidad de modelado. - preprocesar – Esta sección especifica los parámetros de preprocesamiento.

- tren* – Esta sección especifica los parámetros del trabajo de capacitación.

- transformar* – Esta sección especifica los parámetros del trabajo de SageMaker Transform para realizar predicciones sobre los datos de prueba.

- evaluar – Esta sección especifica los parámetros del trabajo de procesamiento de SageMaker para generar un informe JSON de métricas del modelo para el modelo entrenado.

- registro* – Esta sección especifica los parámetros para registrar el modelo entrenado en SageMaker Model Registry.

- /conf/sagemakerPipeline* – Esta sección define el flujo de SageMaker Pipelines, incluidas las dependencias entre los pasos. Para casos de uso de un solo modelo, esta sección se define al final del archivo de configuración. Para casos de uso de múltiples modelos, el

sagemakerPipelineLa sección solo necesita ser definida en el archivo de configuración de uno de los modelos (cualquiera de los modelos). Nos referimos a este modelo como el modelo de ancla. Los parámetros son los siguientes:- Nombre de la canalización* – Nombre de la canalización de SageMaker.

- modelos* – Lista anidada de unidades de modelado:

- {nombre del modelo}* – Identificador de modelo, que debe coincidir con un identificador {model-name} en la sección /conf/models.

- pasos* –

- nombre_paso* – Nombre del paso que se mostrará en SageMaker Pipelines DAG.

- clase_paso* – (Unión[Procesamiento, Entrenamiento, CreateModel, Transform, Metrics, RegisterModel])

- tipo_paso* – Este parámetro solo es necesario para los pasos de preprocesamiento, para los cuales debe configurarse en preprocesamiento. Esto es necesario para distinguir los pasos de preproceso y evaluación, los cuales tienen un

step_classde Procesamiento. - habilitar_cache – ([Unión[Verdadero, Falso]]). Esto indica si se debe habilitar Almacenamiento en caché de canalizaciones de SageMaker para este paso.

- cadena_entrada_fuente_paso – ([lista[nombre_paso]]). Puede utilizar esto para configurar las salidas de canal de otro paso como entrada para este paso.

- prefijo_adicional_entrada_cadena – Esto sólo está permitido para los pasos de la Transformación.

step_class, y se puede utilizar junto conchain_input_source_stepparámetro para identificar el archivo que debe usarse como entrada para el paso de transformación.

- pasos* –

- {nombre del modelo}* – Identificador de modelo, que debe coincidir con un identificador {model-name} en la sección /conf/models.

- dependencias – Esta sección especifica la secuencia en la que se deben ejecutar los pasos de SageMaker Pipelines. Hemos adaptado la notación Apache Airflow para esta sección (por ejemplo,

{step_name} >> {step_name}). Si esta sección se deja en blanco, las dependencias explícitas especificadas por elchain_input_source_stepLos parámetros o las dependencias implícitas definen el flujo DAG de SageMaker Pipelines.

Tenga en cuenta que recomendamos tener un paso de capacitación por unidad de modelado. Si se definen varios pasos de entrenamiento para una unidad de modelado, los pasos siguientes toman implícitamente el último paso de entrenamiento para crear el objeto del modelo, calcular métricas y registrar el modelo. Si necesita entrenar varios modelos, se recomienda crear varias unidades de modelado.

Ejemplos

En esta sección, demostramos tres ejemplos de DAG de entrenamiento de modelos de ML creados utilizando el marco presentado.

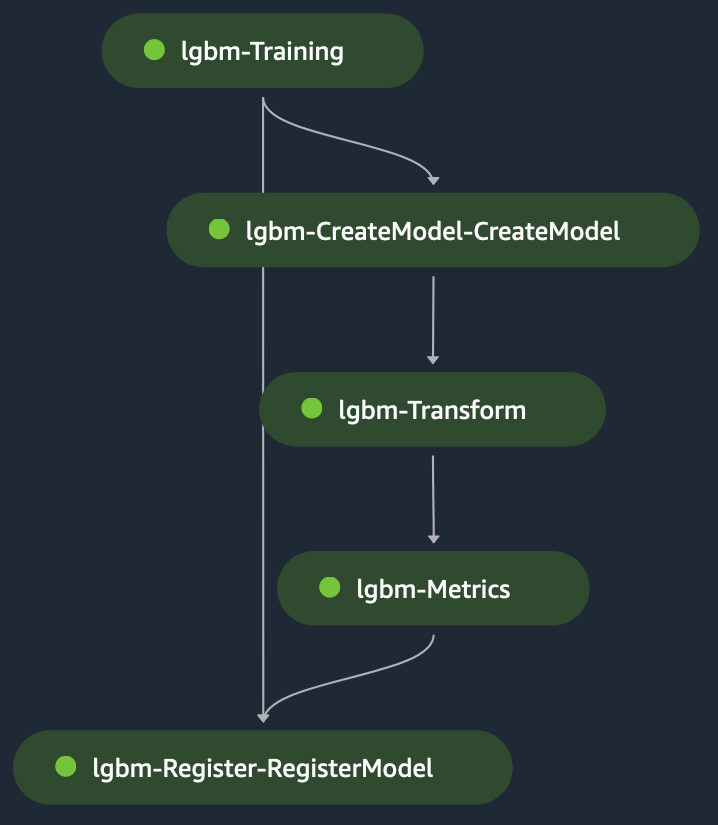

Entrenamiento de modelo único: LightGBM

Este es un ejemplo de modelo único para un caso de uso de clasificación donde usamos LightGBM en modo script en SageMaker. datos consta de variables categóricas y numéricas para predecir la etiqueta binaria Ingresos (para predecir si el sujeto realiza una compra o no). El script de preprocesamiento se utiliza para modelar los datos para entrenamiento y prueba y luego ponlo en escena en un cubo S3. Las rutas S3 luego se proporcionan al paso de entrenamiento en el archivo de configuración.

Cuando se ejecuta el paso de entrenamiento, SageMaker carga el archivo en el contenedor en /opt/ml/input/data/{channelName}/, accesible a través de la variable de entorno SM_CHANNEL_{channelName} en el contenedornombredelcanal= 'entrenamiento' o 'prueba').Los guion de entrenamiento hace lo siguiente:

- Cargue los archivos localmente desde las rutas del contenedor local usando el Carga numérica módulo.

- Establezca hiperparámetros para el algoritmo de entrenamiento.

- Guarde el modelo entrenado en la ruta del contenedor local

/opt/ml/model/.

SageMaker toma el contenido de /opt/ml/model/ para crear un archivo tar que se utiliza para implementar el modelo en SageMaker para su alojamiento.

El paso de transformación toma como entrada la etapa archivo de prueba como entrada y el modelo entrenado para hacer predicciones sobre el modelo entrenado. La salida del paso de transformación es encadenado al paso de métricas para evaluar el modelo frente a las verdad fundamental, que se proporciona explícitamente al paso de métricas. Finalmente, la salida del paso de métricas se encadena implícitamente al paso de registro para registrar el modelo en SageMaker Model Registry con información sobre el rendimiento del modelo producido en el paso de métricas. La siguiente figura muestra una representación visual del DAG de entrenamiento. Puede consultar los scripts y el archivo de configuración para este ejemplo en el Repositorio GitHub.

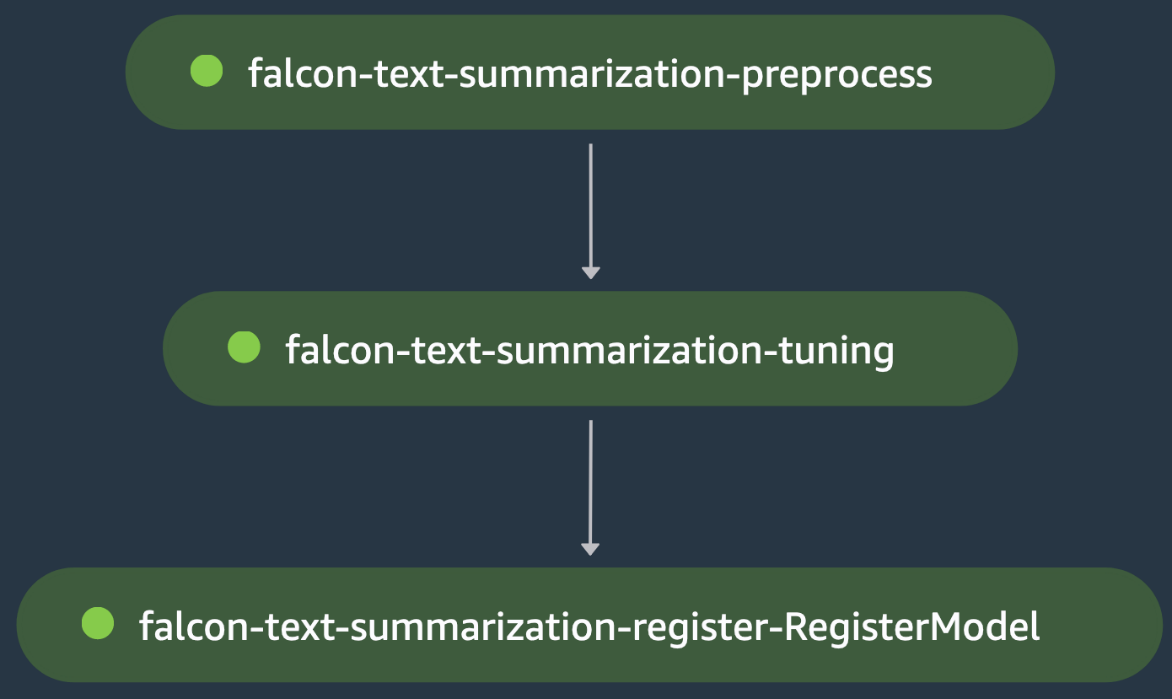

Formación de modelo único: ajuste de LLM

Este es otro ejemplo de entrenamiento de modelo único, donde organizamos el ajuste fino de un modelo de lenguaje grande (LLM) Falcon-40B de Hugging Face Hub para un caso de uso de resumen de texto. El script de preprocesamiento carga el Samsum conjunto de datos de Hugging Face, carga el tokenizador para el modelo y procesa las divisiones de datos de entrenamiento/prueba para ajustar el modelo en los datos de este dominio en el paso de preproceso de resumen de texto de falcon.

La salida es encadenado al paso de ajuste de resumen de texto de halcón, donde el guion de entrenamiento carga el Falcon-40B LLM desde Hugging Face Hub y comienza el ajuste fino acelerado usando lora en el tren dividido. El modelo se evalúa en el mismo paso después del ajuste fino, que porteros la pérdida de evaluación falla en el paso de ajuste de resumen de texto de falcon, lo que hace que la canalización de SageMaker se detenga antes de que pueda registrar el modelo ajustado. De lo contrario, el paso falcon-text-summarization-tuning se ejecuta correctamente y el modelo se registra en el Registro de modelos de SageMaker. La siguiente figura muestra una representación visual del DAG de ajuste fino de LLM. Los scripts y el archivo de configuración para este ejemplo están disponibles en el Repositorio GitHub.

Entrenamiento multimodelo

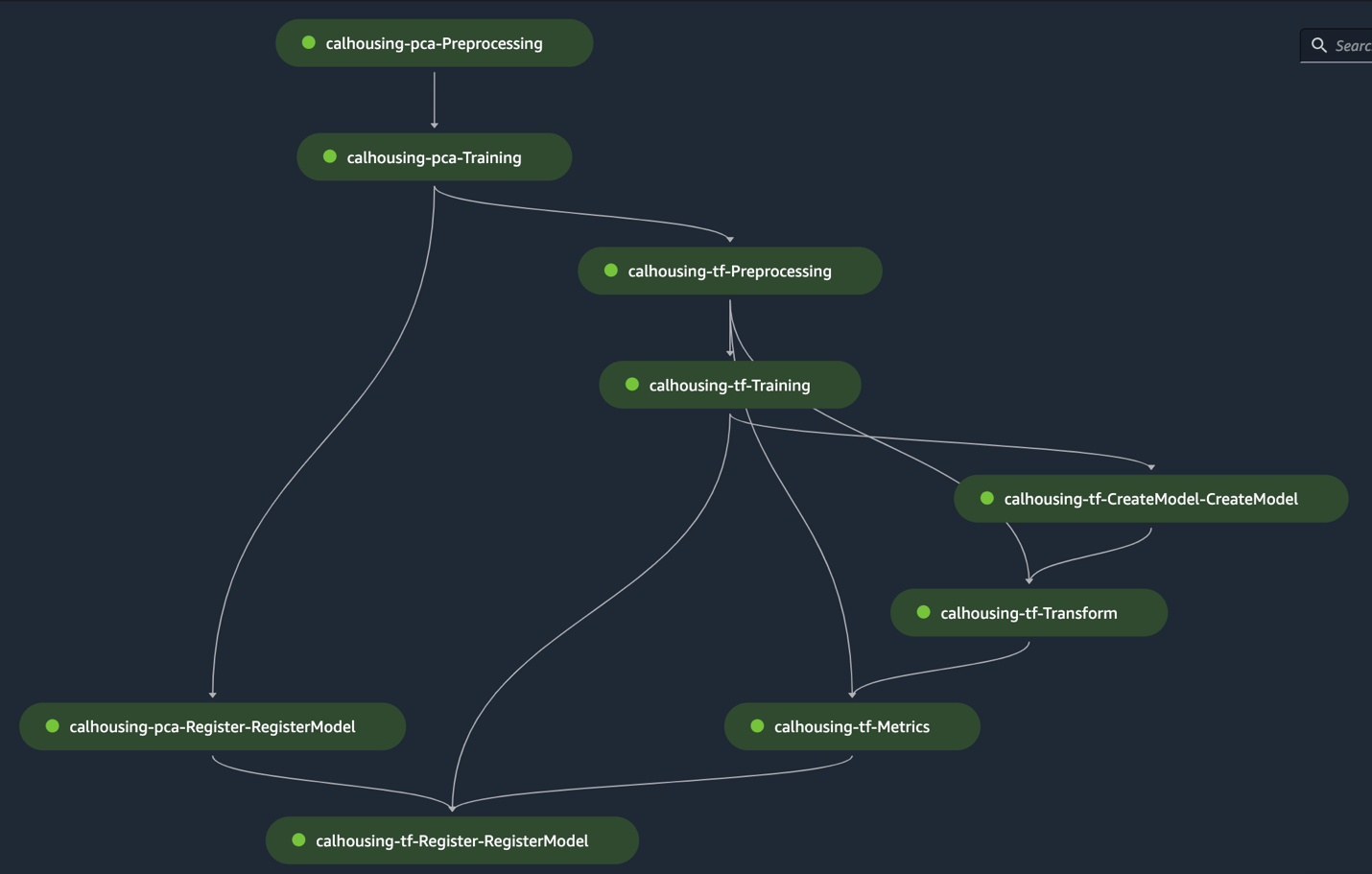

Este es un ejemplo de entrenamiento multimodelo en el que se entrena un modelo de análisis de componentes principales (PCA) para la reducción de dimensionalidad y un modelo de perceptrón multicapa de TensorFlow para Predicción del precio de la vivienda en California. El paso de preprocesamiento del modelo TensorFlow utiliza un modelo PCA entrenado para reducir la dimensionalidad de sus datos de entrenamiento. Agregamos una dependencia en la configuración para garantizar que el modelo TensorFlow se registre después del registro del modelo PCA. La siguiente figura muestra una representación visual del ejemplo de DAG de entrenamiento multimodelo. Los scripts y archivos de configuración para este ejemplo están disponibles en el Repositorio GitHub.

Limpiar

Complete los siguientes pasos para limpiar sus recursos:

- Utilice la CLI de AWS para lista y remove cualquier canalización restante creada por los scripts de Python.

- Opcionalmente, elimine otros recursos de AWS, como el depósito de S3 o el rol de IAM creado fuera de SageMaker Pipelines.

Conclusión

En esta publicación, presentamos un marco para automatizar la creación de DAG de SageMaker Pipelines basado en archivos de configuración. El marco propuesto ofrece una solución con visión de futuro al desafío de orquestar cargas de trabajo de aprendizaje automático complejas. Al utilizar un archivo de configuración, SageMaker Pipelines brinda la flexibilidad de crear una orquestación con un código mínimo, de modo que pueda optimizar el proceso de creación y administración de canalizaciones de modelo único y multimodelo. Este enfoque no solo ahorra tiempo y recursos, sino que también promueve las mejores prácticas de MLOps, lo que contribuye al éxito general de las iniciativas de ML. Para obtener más información sobre los detalles de implementación, revise la Repositorio GitHub.

Acerca de los autores

Luis Felipe Yépez Barrios, es ingeniero de aprendizaje automático en AWS Professional Services, enfocado en sistemas distribuidos escalables y herramientas de automatización para acelerar la innovación científica en el campo del aprendizaje automático (ML). Además, ayuda a los clientes empresariales a optimizar sus soluciones de aprendizaje automático a través de los servicios de AWS.

Luis Felipe Yépez Barrios, es ingeniero de aprendizaje automático en AWS Professional Services, enfocado en sistemas distribuidos escalables y herramientas de automatización para acelerar la innovación científica en el campo del aprendizaje automático (ML). Además, ayuda a los clientes empresariales a optimizar sus soluciones de aprendizaje automático a través de los servicios de AWS.

Jinzhao Feng, es ingeniero de aprendizaje automático en AWS Professional Services. Se centra en diseñar e implementar soluciones de canalización de aprendizaje automático clásico y IA generativa a gran escala. Está especializado en FMOps, LLMOps y formación distribuida.

Jinzhao Feng, es ingeniero de aprendizaje automático en AWS Professional Services. Se centra en diseñar e implementar soluciones de canalización de aprendizaje automático clásico y IA generativa a gran escala. Está especializado en FMOps, LLMOps y formación distribuida.

Asnani duro, es ingeniero de aprendizaje automático en AWS. Su experiencia es en ciencia de datos aplicada con un enfoque en la operacionalización de cargas de trabajo de aprendizaje automático en la nube a escala.

Asnani duro, es ingeniero de aprendizaje automático en AWS. Su experiencia es en ciencia de datos aplicada con un enfoque en la operacionalización de cargas de trabajo de aprendizaje automático en la nube a escala.

hasan shojaei, es un científico de datos senior en AWS Professional Services, donde ayuda a clientes de diferentes industrias a resolver sus desafíos comerciales mediante el uso de big data, aprendizaje automático y tecnologías de nube. Antes de ocupar este puesto, Hasan dirigió múltiples iniciativas para desarrollar novedosas técnicas de modelado basadas en la física y en datos para las principales empresas energéticas. Fuera del trabajo, a Hasan le apasionan los libros, el senderismo, la fotografía y la historia.

hasan shojaei, es un científico de datos senior en AWS Professional Services, donde ayuda a clientes de diferentes industrias a resolver sus desafíos comerciales mediante el uso de big data, aprendizaje automático y tecnologías de nube. Antes de ocupar este puesto, Hasan dirigió múltiples iniciativas para desarrollar novedosas técnicas de modelado basadas en la física y en datos para las principales empresas energéticas. Fuera del trabajo, a Hasan le apasionan los libros, el senderismo, la fotografía y la historia.

Alec Jenab, es un ingeniero de aprendizaje automático que se especializa en desarrollar y poner en funcionamiento soluciones de aprendizaje automático a escala para clientes empresariales. A Alec le apasiona llevar soluciones innovadoras al mercado, especialmente en áreas donde el aprendizaje automático puede mejorar significativamente la experiencia del usuario final. Fuera del trabajo, le gusta jugar baloncesto, hacer snowboard y descubrir tesoros escondidos en San Francisco.

Alec Jenab, es un ingeniero de aprendizaje automático que se especializa en desarrollar y poner en funcionamiento soluciones de aprendizaje automático a escala para clientes empresariales. A Alec le apasiona llevar soluciones innovadoras al mercado, especialmente en áreas donde el aprendizaje automático puede mejorar significativamente la experiencia del usuario final. Fuera del trabajo, le gusta jugar baloncesto, hacer snowboard y descubrir tesoros escondidos en San Francisco.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/automate-amazon-sagemaker-pipelines-dag-creation/

- :es

- :no

- :dónde

- $ UP

- 120

- 160

- 7

- 8

- 9

- a

- Poder

- Nuestra Empresa

- acelerado

- de la máquina

- accesible

- acomodar

- Conforme

- Mi Cuenta

- el logro de

- a través de

- activar

- acíclico

- add

- Después

- en contra

- AI

- algoritmo

- Todos

- permitir

- permitido

- permite

- a lo largo de

- también

- Amazon

- Amazon SageMaker

- Canalizaciones de Amazon SageMaker

- Amazon Web Services

- entre

- an

- análisis

- Comercial

- y

- Otra

- cualquier

- APACHE

- aplicada

- enfoque

- arquitectura

- somos

- áreas

- AS

- asistencias

- asumir

- At

- automatizado

- automáticamente

- automatizar

- Automatización

- Hoy Disponibles

- AWS

- Servicios profesionales de AWS

- fondo

- basado

- Baloncesto

- BE

- antes

- beneficios

- MEJOR

- y las mejores prácticas

- Big

- Big Data

- Libros

- ambas

- Trayendo

- build

- pero

- by

- calcular

- calculado

- llamar al

- , que son

- Calls

- PUEDEN

- case

- cases

- abastece

- causas

- encadenado

- Reto

- retos

- Channel

- opciones

- privadas

- clasificación

- limpia

- Cli

- clientes

- Soluciones

- código

- combinar

- Algunos

- Empresas

- integraciones

- componente

- Inquietudes

- confianza

- Configuración

- conjunción

- consistente

- consiste

- Envase

- Contenedores

- contiene

- contenido

- contexto

- continuo

- contribuyendo

- Protectora

- Para crear

- creado

- crea

- Creamos

- creación

- crucial

- personalizado

- Clientes

- se adaptan

- DÍA

- datos

- Ciencia de los datos

- científico de datos

- basada en datos

- conjuntos de datos

- declaró

- Predeterminado

- definir

- se define

- Define

- entrega

- demostrar

- dependencias

- Dependencia

- desplegar

- Desplegando

- despliegue

- describir

- detalle

- detallado

- detalles

- desarrollar

- el desarrollo

- Desarrollo

- diagrama

- una experiencia diferente

- que dirigieron

- directorios

- directorio

- descubrir

- discutir

- aquí

- distinguir

- distribuidos

- sistemas distribuidos

- entrenamiento distribuido

- Docker

- sí

- dominio

- durante

- lugar de trabajo dinámico

- dinamicamente

- cada una

- eficiente

- esfuerzo

- empodera

- habilitar

- permite

- permitiendo

- final

- energía

- ingeniero

- certificados

- garantizar

- Empresa

- Todo

- entrada

- Entorno

- ambientes

- Errores

- especialmente

- evaluar

- evaluado

- evaluación

- evaluación

- Cada

- ejemplo

- ejemplos

- acelerar

- experience

- explícitamente

- exportar

- extendido

- Cara

- FALLO

- false

- más rápida

- campo

- Figura

- Archive

- archivos

- Finalmente

- Encuentre

- Flexibilidad

- flexible

- de tus señales

- Focus

- centrado

- se centra

- siguiendo

- siguiente

- formulario

- Mirando hacia adelante

- Marco conceptual

- marcos

- Francisco

- Desde

- función

- Además

- la generación de

- generativo

- IA generativa

- Git

- Buscar

- gobierno

- gráfica

- mayor

- Grupo procesos

- Grupo

- Tienen

- es

- he

- ayuda

- esta página

- Oculto

- su

- historia

- hosting

- viviendas

- Cómo

- Como Hacer

- HTML

- http

- HTTPS

- Bujes

- identificador

- Identidad

- ids

- if

- imagen

- implementación

- implementación

- mejorar

- in

- En otra

- incluye

- Incluye

- indicar

- Indica

- industrias

- inferido

- información

- EN LA MINA

- iniciativas

- Innovation

- originales

- Las opciones de entrada

- dentro

- instalar

- ejemplo

- Instrucciones

- integración

- interacciones

- intervención

- dentro

- IT

- SUS

- Trabajos

- unión

- jpg

- json

- Clave

- claves

- Label

- idioma

- large

- Apellido

- luego

- aprendizaje

- LED

- izquierda

- bibliotecas

- como

- línea

- Lista

- LLM

- carga

- cargas

- local

- localmente

- registro

- Mira

- parece

- de

- máquina

- máquina de aprendizaje

- para lograr

- HACE

- Realizar

- Management

- administrar

- manual

- muchos

- Mercado

- Match

- métrico

- Métrica

- mínimo

- minimizar

- ML

- MLOps

- Moda

- modelo

- modelado

- modelos

- Módulo

- más,

- múltiples

- nombre

- necesario

- ¿ Necesita ayuda

- red

- Next

- no

- novela

- objeto

- of

- Ofertas

- on

- ONE

- , solamente

- optimizando

- or

- orquestado

- orquestando

- orquestación

- Otro

- de otra manera

- salida

- salidas

- afuera

- total

- anular

- paquetes

- parámetro

- parámetros

- apasionado

- camino

- caminos

- para

- actuación

- realizado

- fotografía

- industrial

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- jugando

- punto

- Publicación

- prácticas

- predefinido

- predecir

- Predicciones

- requisitos previos

- presente

- presentó

- precio

- Director de la escuela

- Anterior

- privada

- en costes

- tratamiento

- producido

- Producción

- Profesional

- proyecto

- promueve

- Promoción

- propuesto

- previsto

- proporciona un

- comprar

- Python

- con rapidez

- distancia

- Leer

- fácilmente

- Reading

- recomiendan

- recomendado

- reducir

- reduce

- reducción

- remitir

- región

- registrarte

- registrado

- registrarse

- Registro

- registro

- restante

- repetir

- reporte

- repositorio

- representación

- Requisitos

- Requisitos

- Recurso

- Recursos

- aquellos

- RESTO

- Resultados

- ingresos

- una estrategia SEO para aparecer en las búsquedas de Google.

- Función

- También soy miembro del cuerpo docente de World Extreme Medicine (WEM) y embajadora europea de igualdad para The Transformational Travel Council (TTC). En mi tiempo libre, soy una incansable aventurera, escaladora, patrona de día, buceadora y defensora de la igualdad de género en el deporte y la aventura. En XNUMX, fundé Almas Libres, una ONG nacida para involucrar, educar y empoderar a mujeres y niñas a través del deporte urbano, la cultura y la tecnología.

- Ejecutar

- correr

- corre

- tiempo de ejecución

- sabio

- Tuberías de SageMaker

- mismo

- San

- San Francisco

- escalable

- Escala

- Ciencia:

- científico

- Científico

- los científicos

- guión

- guiones

- Sección

- (secciones)

- EN LINEA

- Secuencia

- Servicios

- set

- Sets

- Varios

- tienes

- Shows

- sencillos

- SEIS

- sencillo.

- So

- a medida

- Soluciones

- RESOLVER

- Fuente

- código fuente

- especializado

- se especializa

- especificado

- dividido

- escisiones

- comienza

- paso

- pasos

- Detener

- STORAGE

- almacenamiento

- aerodinamizar

- racionalización

- estructura

- estudio

- sujeto

- subredes

- posterior

- comercial

- Con éxito

- tal

- suministrada

- sintaxis

- Todas las funciones a su disposición

- ¡Prepárate!

- toma

- técnicas

- Tecnologías

- tensorflow

- terminal

- test

- Pruebas

- texto

- esa

- El

- El registro

- su

- Les

- luego

- por lo tanto

- Estas

- así

- Tres

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- a lo largo de

- equipo

- a

- parte superior

- Seguimiento

- Entrenar

- entrenado

- Formación

- Transformar

- árbol

- verdadero

- dos

- tipos

- ui

- bajo

- unidad

- unidades que

- Actualizar

- utilizan el

- caso de uso

- usado

- Usuario

- experiencia como usuario

- usos

- usando

- utilidad

- Valores

- variable

- versiones

- vía

- Virtual

- visual

- we

- web

- servicios web

- WELL

- cuando

- sean

- que

- QUIENES

- amplio

- Amplia gama

- seguirá

- dentro de

- sin

- Actividades:

- flujo de trabajo

- XGBoost

- yaml

- Usted

- tú

- zephyrnet