IA generativa Las aplicaciones impulsadas por modelos fundamentales (FM) están habilitando organizaciones con un valor comercial significativo en experiencia del cliente, productividad, optimización de procesos e innovaciones. Sin embargo, la adopción de estos FM implica abordar algunos desafíos clave, incluida la calidad de los resultados, la privacidad de los datos, la seguridad, la integración con los datos de la organización, el costo y las habilidades para cumplir.

En esta publicación, exploramos diferentes enfoques que puede adoptar al crear aplicaciones que utilizan IA generativa. Con el rápido avance de los FM, es un momento emocionante para aprovechar su poder, pero también es crucial comprender cómo utilizarlos adecuadamente para lograr resultados comerciales. Proporcionamos una descripción general de los enfoques clave de IA generativa, incluida la ingeniería rápida, la generación aumentada de recuperación (RAG) y la personalización de modelos. Al aplicar estos enfoques, analizamos consideraciones clave sobre posibles alucinaciones, la integración con datos empresariales, la calidad de los resultados y el costo. Al final, tendrá pautas sólidas y un diagrama de flujo útil para determinar el mejor método para desarrollar sus propias aplicaciones basadas en FM, basadas en ejemplos de la vida real. Ya sea que cree un chatbot o una herramienta de resumen, puede diseñar potentes FM que se adapten a sus necesidades.

IA generativa con AWS

El surgimiento de los FM está creando oportunidades y desafíos para las organizaciones que buscan utilizar estas tecnologías. Un desafío clave es garantizar resultados coherentes y de alta calidad que se alineen con las necesidades del negocio, en lugar de alucinaciones o información falsa. Las organizaciones también deben gestionar cuidadosamente los riesgos de seguridad y privacidad de los datos que surgen del procesamiento de datos propietarios con FM. Las habilidades necesarias para integrar, personalizar y validar adecuadamente los FM dentro de los sistemas y datos existentes son escasas. Crear grandes modelos de lenguaje (LLM) desde cero o personalizar modelos previamente entrenados requiere importantes recursos informáticos, científicos de datos expertos y meses de trabajo de ingeniería. El costo computacional por sí solo puede ascender fácilmente a millones de dólares para entrenar modelos con cientos de miles de millones de parámetros en conjuntos de datos masivos utilizando miles de GPU o TPU. Más allá del hardware, la limpieza y el procesamiento de datos, el diseño de arquitectura de modelos, el ajuste de hiperparámetros y el desarrollo de canales de capacitación exigen habilidades especializadas de aprendizaje automático (ML). El proceso de extremo a extremo es complejo, requiere mucho tiempo y resulta prohibitivamente costoso para la mayoría de las organizaciones sin la infraestructura y la inversión en talento necesarias. Las organizaciones que no abordan adecuadamente estos riesgos pueden enfrentar impactos negativos en la reputación de su marca, la confianza de los clientes, las operaciones y los ingresos.

lecho rocoso del amazonas es un servicio totalmente administrado que ofrece una selección de modelos básicos (FM) de alto rendimiento de empresas líderes en inteligencia artificial como AI21 Labs, Anthropic, Cohere, Meta, Mistral AI, Stability AI y Amazon a través de una única API. Con la experiencia sin servidor de Amazon Bedrock, puede comenzar rápidamente, personalizar de forma privada los FM con sus propios datos e integrarlos e implementarlos en sus aplicaciones utilizando herramientas de AWS sin tener que administrar ninguna infraestructura. Amazon Bedrock es elegible para HIPAA y puede utilizar Amazon Bedrock de conformidad con el RGPD. Con Amazon Bedrock, su contenido no se utiliza para mejorar los modelos base y no se comparte con proveedores de modelos externos. Sus datos en Amazon Bedrock siempre están cifrados en tránsito y en reposo y, opcionalmente, puede cifrar los recursos utilizando sus propias claves. Puedes usar Enlace privado de AWS con Amazon Bedrock para establecer conectividad privada entre sus FM y su VPC sin exponer su tráfico a Internet. Con Bases de conocimiento para Amazon Bedrock, puede brindar a los FM y agentes información contextual de las fuentes de datos privadas de su empresa para que RAG brinde respuestas más relevantes, precisas y personalizadas. Puede personalizar de forma privada los FM con sus propios datos a través de una interfaz visual sin escribir ningún código. Como servicio totalmente administrado, Amazon Bedrock ofrece una experiencia de desarrollador sencilla para trabajar con una amplia gama de FM de alto rendimiento.

Lanzado en 2017, Amazon SageMaker es un servicio totalmente administrado que simplifica la creación, el entrenamiento y la implementación de modelos de aprendizaje automático. Cada vez más clientes están creando sus propios FM utilizando SageMaker, incluidos Stability AI, AI21 Labs, Hugging Face, Perplexity AI, Hippocratic AI, LG AI Research y Technology Innovation Institute. Para ayudarle a empezar rápidamente, JumpStart de Amazon SageMaker ofrece un centro de aprendizaje automático donde puede explorar, entrenar e implementar una amplia selección de FM públicos, como los modelos Mistral, los modelos LightOn, RedPajama, Mosiac MPT-7B, FLAN-T5/UL2, GPT-J-6B/Neox-20B. y Bloom/BloomZ, utilizando herramientas SageMaker especialmente diseñadas, como experimentos y canalizaciones.

Enfoques comunes de IA generativa

En esta sección, analizamos enfoques comunes para implementar soluciones efectivas de IA generativa. Exploramos técnicas populares de ingeniería rápida que le permiten lograr tareas más complejas e interesantes con FM. También analizamos cómo técnicas como RAG y la personalización de modelos pueden mejorar aún más las capacidades de los FM y superar desafíos como datos limitados y limitaciones computacionales. Con la técnica adecuada, puede crear soluciones de IA generativa potentes e impactantes.

Ingeniería rápida

La ingeniería de avisos es la práctica de diseñar cuidadosamente avisos para aprovechar de manera eficiente las capacidades de los FM. Implica el uso de indicaciones, que son breves fragmentos de texto que guían al modelo para generar respuestas más precisas y relevantes. Con una ingeniería rápida, puede mejorar el rendimiento de los FM y hacerlos más efectivos para una variedad de aplicaciones. En esta sección, exploramos técnicas como las indicaciones de disparo cero y de pocos disparos, que adaptan rápidamente los FM a nuevas tareas con solo unos pocos ejemplos, y las indicaciones de cadena de pensamiento, que descomponen el razonamiento complejo en pasos intermedios. Estos métodos demuestran cómo la ingeniería rápida puede hacer que los FM sean más efectivos en tareas complejas sin necesidad de volver a entrenar el modelo.

Indicación de disparo cero

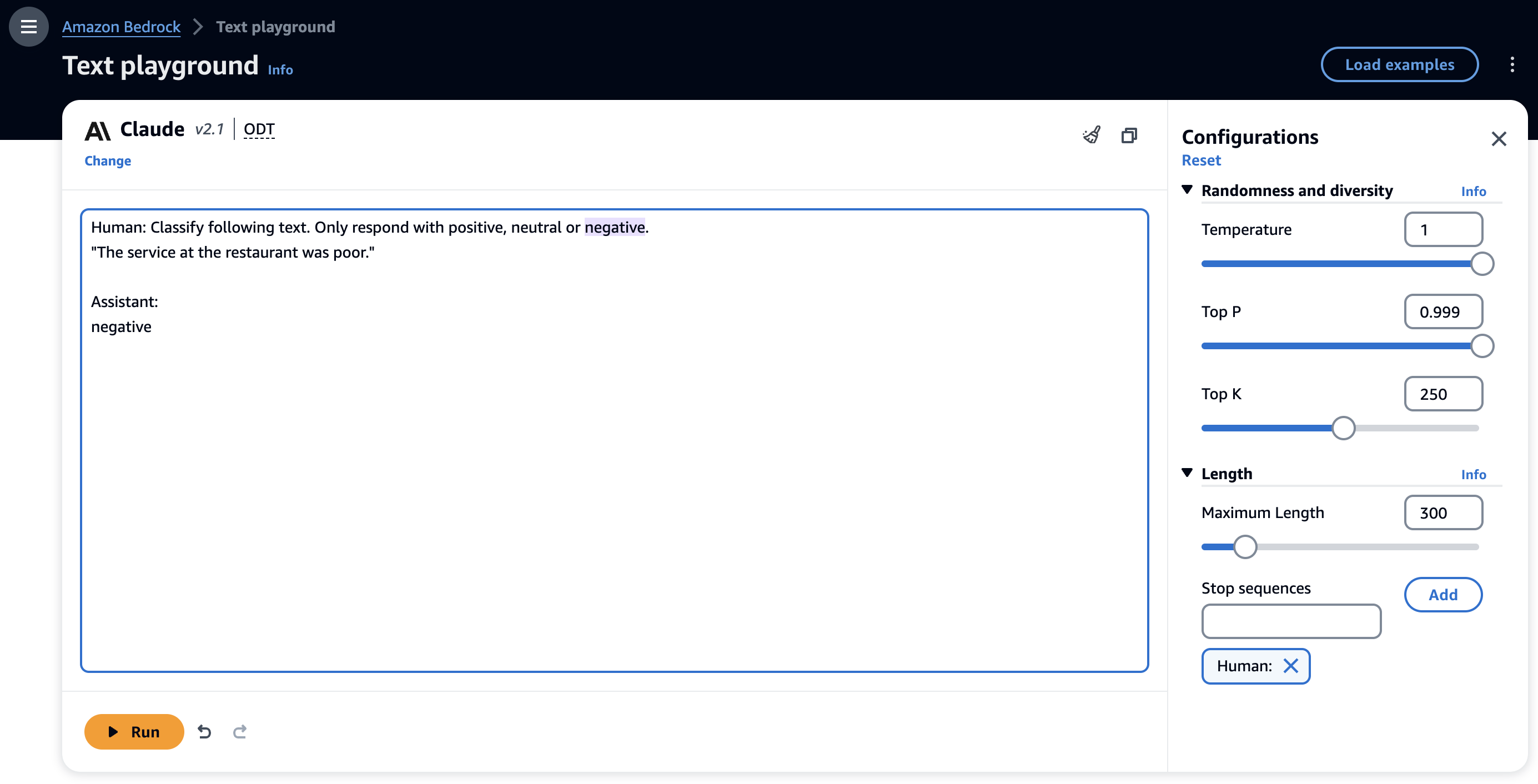

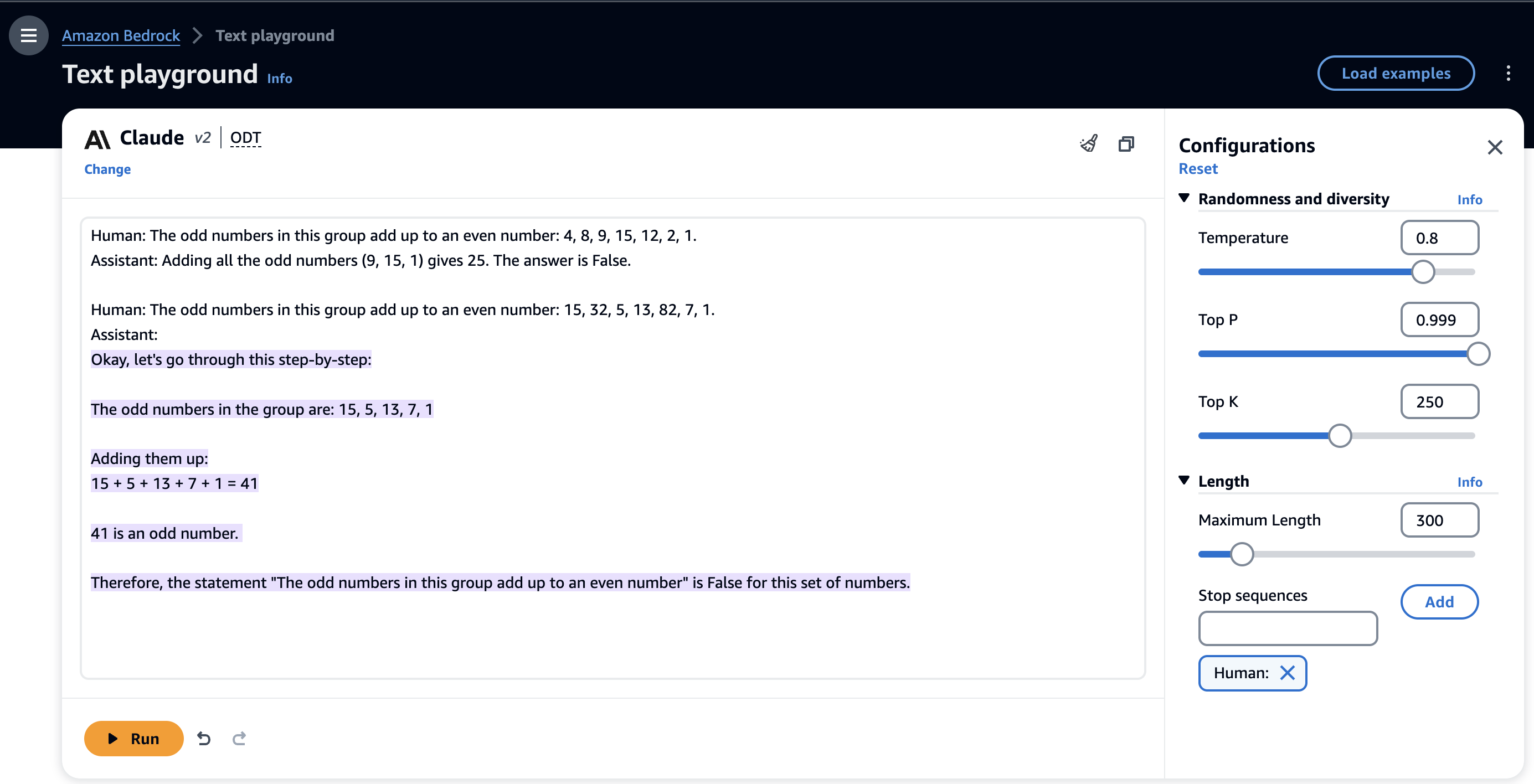

Una técnica de aviso de disparo cero requiere que los FM generen una respuesta sin proporcionar ningún ejemplo explícito del comportamiento deseado, basándose únicamente en su entrenamiento previo. La siguiente captura de pantalla muestra un ejemplo de un mensaje de disparo cero con el modelo Anthropic Claude 2.1 en la consola de Amazon Bedrock.

En estas instrucciones, no proporcionamos ningún ejemplo. Sin embargo, el modelo puede comprender la tarea y generar resultados adecuados. Las indicaciones de disparo cero son la técnica de indicación más sencilla para empezar a la hora de evaluar un FM para su caso de uso. Sin embargo, aunque los FM son notables por sus indicaciones de disparo cero, es posible que no siempre produzcan resultados precisos o deseados para tareas más complejas. Cuando las indicaciones de disparo cero se quedan cortas, se recomienda proporcionar algunos ejemplos en el mensaje (indicaciones de pocos disparos).

Indicaciones de pocos disparos

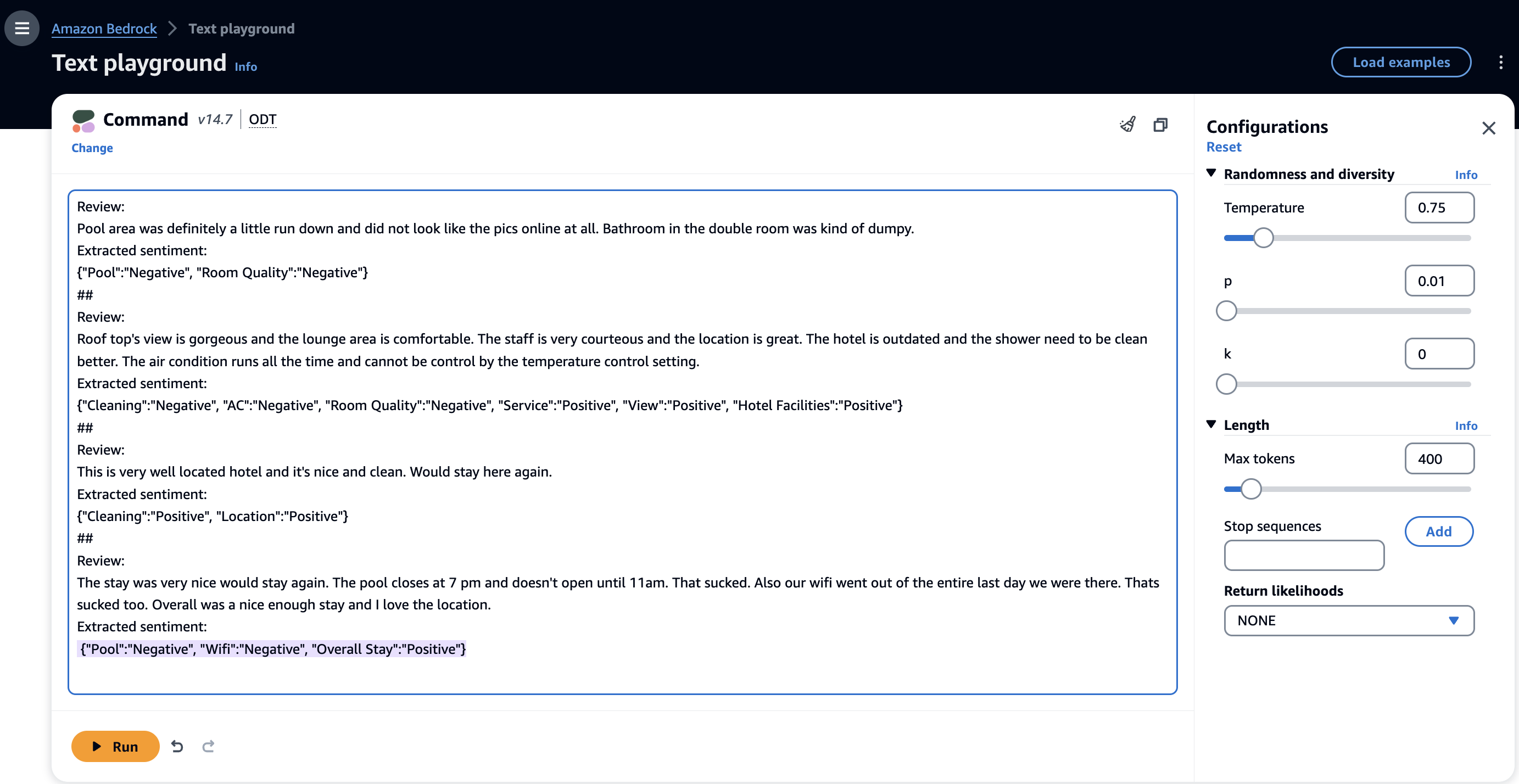

La técnica de indicaciones de pocas tomas permite a los FM aprender en contexto a partir de los ejemplos de las indicaciones y realizar la tarea con mayor precisión. Con solo unos pocos ejemplos, puede adaptar rápidamente los FM a nuevas tareas sin grandes conjuntos de entrenamiento y guiarlos hacia el comportamiento deseado. El siguiente es un ejemplo de un mensaje de algunos disparos con el modelo Cohere Command en la consola de Amazon Bedrock.

En el ejemplo anterior, el FM pudo identificar entidades a partir del texto de entrada (reseñas) y extraer los sentimientos asociados. Las indicaciones breves son una forma eficaz de abordar tareas complejas al proporcionar algunos ejemplos de pares de entrada y salida. Para tareas sencillas, puede dar un ejemplo (1 disparo), mientras que para tareas más difíciles, debe proporcionar de tres (3 disparos) a cinco (5 disparos). Min y col. (2022) publicaron hallazgos sobre el aprendizaje en contexto que puede mejorar el rendimiento de la técnica de indicaciones de pocos disparos. Puede utilizar indicaciones breves para una variedad de tareas, como análisis de sentimientos, reconocimiento de entidades, respuesta a preguntas, traducción y generación de código.

Incitación a la cadena de pensamientos

A pesar de su potencial, las indicaciones breves tienen limitaciones, especialmente cuando se trata de tareas de razonamiento complejas (como tareas aritméticas o lógicas). Estas tareas requieren dividir el problema en pasos y luego resolverlo. Wei y col. (2022) introdujo la técnica de estimulación de la cadena de pensamiento (CoT) para resolver problemas de razonamiento complejos a través de pasos de razonamiento intermedios. Puede combinar CoT con indicaciones breves para mejorar los resultados en tareas complejas. El siguiente es un ejemplo de una tarea de razonamiento que utiliza indicaciones CoT de pocos disparos con el modelo Anthropic Claude 2 en la consola de Amazon Bedrock.

Kojima y cols. (2022) introdujo una idea de CoT de disparo cero mediante el uso de capacidades de disparo cero sin explotar de los FM. Su investigación indica que la CoT de disparo cero, utilizando la misma plantilla de un solo mensaje, supera significativamente el rendimiento de FM de disparo cero en diversas tareas de razonamiento de referencia. Puede utilizar indicaciones CoT de disparo cero para tareas de razonamiento simples agregando "Pensemos paso a paso" a la indicación original.

Reaccionar

Las indicaciones de CoT pueden mejorar las capacidades de razonamiento de los FM, pero aún dependen del conocimiento interno del modelo y no consideran ninguna base de conocimiento o entorno externo para recopilar más información, lo que puede conducir a problemas como alucinaciones. El enfoque ReAct (razonamiento y acción) aborda esta brecha ampliando CoT y permitiendo el razonamiento dinámico utilizando un entorno externo (como Wikipedia).

moderna

Los FM tienen la capacidad de comprender preguntas y proporcionar respuestas utilizando sus conocimientos previamente capacitados. Sin embargo, carecen de la capacidad para responder a consultas que requieran acceso a datos privados de una organización o de la capacidad de realizar tareas de forma autónoma. RAG y los agentes son métodos para conectar estas aplicaciones generativas impulsadas por IA a conjuntos de datos empresariales, permitiéndoles dar respuestas que tengan en cuenta la información organizacional y permitir ejecutar acciones basadas en solicitudes.

Recuperación Generación Aumentada

La recuperación de generación aumentada (RAG) le permite personalizar las respuestas de un modelo cuando desea que el modelo considere nuevos conocimientos o información actualizada. Cuando sus datos cambian con frecuencia, como el inventario o los precios, no es práctico ajustar y actualizar el modelo mientras atiende las consultas de los usuarios. Para equipar al FM con información patentada actualizada, las organizaciones recurren a RAG, una técnica que implica obtener datos de fuentes de datos de la empresa y enriquecer el mensaje con esos datos para ofrecer respuestas más relevantes y precisas.

Existen varios casos de uso en los que RAG puede ayudar a mejorar el rendimiento de FM:

- Respuesta a la pregunta – Los modelos RAG ayudan a las aplicaciones de respuesta a preguntas a localizar e integrar información de documentos o fuentes de conocimiento para generar respuestas de alta calidad. Por ejemplo, una aplicación de respuesta a preguntas podría recuperar pasajes sobre un tema antes de generar una respuesta resumida.

- Chatbots y agentes conversacionales – RAG permite a los chatbots acceder a información relevante de grandes fuentes de conocimiento externas. Esto hace que las respuestas del chatbot sean más informadas y naturales.

- Ayuda de escritura – RAG puede sugerir contenido, hechos y temas de conversación relevantes para ayudarle a redactar documentos como artículos, informes y correos electrónicos de manera más eficiente. La información recuperada proporciona contexto e ideas útiles.

- Resumen – RAG puede encontrar documentos fuente relevantes, pasajes o hechos para aumentar la comprensión de un tema por parte de un modelo de resumen, permitiéndole generar mejores resúmenes.

- Escritura creativa y narración – RAG puede extraer ideas de trama, personajes, escenarios y elementos creativos de historias existentes para inspirar modelos de generación de historias de IA. Esto hace que el resultado sea más interesante y fundamentado.

- Traducción – RAG puede encontrar ejemplos de cómo se traducen determinadas frases entre idiomas. Esto proporciona contexto al modelo de traducción, mejorando la traducción de frases ambiguas.

- Personalización – En chatbots y aplicaciones de recomendación, RAG puede extraer contexto personal como conversaciones pasadas, información de perfil y preferencias para hacer que las respuestas sean más personalizadas y relevantes.

Existen varias ventajas al utilizar un marco RAG:

- Alucinaciones reducidas – Recuperar información relevante ayuda a fundamentar el texto generado en hechos y conocimiento del mundo real, en lugar de texto alucinante. Esto promueve respuestas más precisas, objetivas y confiables.

- Cobertura – La recuperación permite que un FM cubra una gama más amplia de temas y escenarios más allá de sus datos de entrenamiento al extraer información externa. Esto ayuda a abordar problemas de cobertura limitada.

- Eficiencia – La recuperación permite que el modelo centre su generación en la información más relevante, en lugar de generar todo desde cero. Esto mejora la eficiencia y permite utilizar contextos más amplios.

- Safety – Recuperar la información de fuentes de datos requeridas y permitidas puede mejorar la gobernanza y el control sobre la generación de contenido dañino e inexacto. Esto apoya una adopción más segura.

- Escalabilidad – La indexación y la recuperación de corpus grandes permiten que el enfoque se escale mejor en comparación con el uso del corpus completo durante la generación. Esto le permite adoptar FM en entornos con recursos más limitados.

RAG produce resultados de calidad, debido al aumento del contexto específico del caso de uso directamente desde los almacenes de datos vectorizados. En comparación con la ingeniería rápida, produce resultados enormemente mejorados con posibilidades enormemente bajas de sufrir alucinaciones. Puede crear aplicaciones basadas en RAG en los datos de su empresa utilizando amazona kendra. RAG tiene mayor complejidad que la ingeniería rápida porque es necesario tener habilidades de codificación y arquitectura para implementar esta solución. Sin embargo, Knowledge Bases for Amazon Bedrock proporciona una experiencia RAG totalmente administrada y la forma más sencilla de comenzar con RAG en Amazon Bedrock. Knowledge Bases para Amazon Bedrock automatiza el flujo de trabajo de RAG de un extremo a otro, incluida la ingesta, la recuperación y el aumento rápido, eliminando la necesidad de escribir código personalizado para integrar fuentes de datos y administrar consultas. La gestión del contexto de la sesión está integrada para que su aplicación pueda admitir conversaciones de varios turnos. Las respuestas de la base de conocimientos vienen con citas de fuentes para mejorar la transparencia y minimizar las alucinaciones. La forma más sencilla de crear un asistente impulsado por IA generativa es mediante el uso Amazonas Q, que tiene un sistema RAG incorporado.

RAG tiene el mayor grado de flexibilidad cuando se trata de cambios en la arquitectura. Puede cambiar el modelo de incrustación, el almacén de vectores y el FM de forma independiente con un impacto mínimo a moderado en otros componentes. Para obtener más información sobre el enfoque RAG con Servicio Amazon OpenSearch y Amazon Bedrock, consulte Cree flujos de trabajo RAG escalables y sin servidor con un motor vectorial para los modelos Amazon OpenSearch Serverless y Amazon Bedrock Claude. Para obtener información sobre cómo implementar RAG con Amazon Kendra, consulte Aprovechar el poder de los datos empresariales con IA generativa: conocimientos de Amazon Kendra, LangChain y grandes modelos lingüísticos.

Agentes

Los FM pueden comprender y responder consultas basándose en sus conocimientos previamente capacitados. Sin embargo, no pueden completar ninguna tarea del mundo real, como reservar un vuelo o procesar una orden de compra, por sí solos. Esto se debe a que dichas tareas requieren datos y flujos de trabajo específicos de la organización que normalmente necesitan una programación personalizada. Marcos como LangChain y ciertos FM, como los modelos Claude, proporcionan capacidades de llamada de funciones para interactuar con API y herramientas. Sin embargo, Agentes de Amazon Bedrock, una capacidad de IA nueva y totalmente administrada de AWS, tiene como objetivo hacer que sea más sencillo para los desarrolladores crear aplicaciones utilizando FM de próxima generación. Con solo unos pocos clics, puede dividir automáticamente las tareas y generar la lógica de orquestación necesaria, sin necesidad de codificación manual. Los agentes pueden conectarse de forma segura a las bases de datos de la empresa a través de API, ingerir y estructurar los datos para el consumo de la máquina y aumentarlos con detalles contextuales para producir respuestas más precisas y cumplir con las solicitudes. Debido a que maneja la integración y la infraestructura, Agents for Amazon Bedrock le permite aprovechar completamente la IA generativa para casos de uso empresarial. Los desarrolladores ahora pueden centrarse en sus aplicaciones principales en lugar de en la plomería rutinaria. El procesamiento de datos automatizado y las llamadas API también permiten a FM brindar respuestas actualizadas y personalizadas y realizar tareas reales utilizando conocimiento patentado.

Personalización del modelo

Los modelos Foundation son extremadamente capaces y permiten algunas aplicaciones excelentes, pero lo que ayudará a impulsar su negocio es la IA generativa que sabe qué es importante para sus clientes, sus productos y su empresa. Y eso sólo es posible cuando potencias los modelos con tus datos. Los datos son la clave para pasar de aplicaciones genéricas a aplicaciones de IA generativas personalizadas que crean valor real para sus clientes y su negocio.

En esta sección, analizamos diferentes técnicas y beneficios de personalizar sus FM. Cubrimos cómo la personalización del modelo implica capacitación adicional y cambiar los pesos del modelo para mejorar su rendimiento.

Sintonia FINA

El ajuste es el proceso de tomar un FM previamente entrenado, como Llama 2, y entrenarlo aún más en una tarea posterior con un conjunto de datos específico para esa tarea. El modelo previamente entrenado proporciona conocimiento lingüístico general y el ajuste le permite especializarse y mejorar el rendimiento en una tarea particular como clasificación de texto, respuesta a preguntas o generación de texto. Con el ajuste fino, proporciona conjuntos de datos etiquetados (que están anotados con contexto adicional) para entrenar el modelo en tareas específicas. Luego puede adaptar los parámetros del modelo para la tarea específica según su contexto empresarial.

Puede implementar el ajuste fino en FM con JumpStart de Amazon SageMaker y Roca Amazónica. Para obtener más detalles, consulte Implemente y ajuste modelos básicos en Amazon SageMaker JumpStart con dos líneas de código y Personalice modelos en Amazon Bedrock con sus propios datos mediante ajustes y capacitación previa continua..

Entrenamiento previo continuo

La capacitación previa continua en Amazon Bedrock le permite enseñar a un modelo previamente entrenado con datos adicionales similares a sus datos originales. Permite que el modelo obtenga un conocimiento lingüístico más general en lugar de centrarse en una sola aplicación. Con un entrenamiento previo continuo, puede utilizar sus conjuntos de datos sin etiquetar, o datos sin procesar, para mejorar la precisión del modelo básico para su dominio mediante el ajuste de los parámetros del modelo. Por ejemplo, una empresa de atención médica puede continuar entrenando previamente su modelo utilizando revistas médicas, artículos y trabajos de investigación para adquirir más conocimientos sobre la terminología de la industria. Para obtener más detalles, consulte Experiencia de desarrollador de Amazon Bedrock.

Beneficios de la personalización del modelo

La personalización del modelo tiene varias ventajas y puede ayudar a las organizaciones con lo siguiente:

- Adaptación específica de dominio – Puede utilizar un FM de propósito general y luego entrenarlo aún más con datos de un dominio específico (como biomédico, legal o financiero). Esto adapta el modelo al vocabulario, estilo, etc. de ese dominio.

- Ajuste fino específico de la tarea – Puede tomar un FM previamente entrenado y ajustarlo con datos para una tarea específica (como análisis de sentimientos o respuesta a preguntas). Esto especializa el modelo para esa tarea en particular.

- Personalización – Puede personalizar un FM según los datos de un individuo (correos electrónicos, mensajes de texto, documentos que haya escrito) para adaptar el modelo a su estilo único. Esto puede permitir aplicaciones más personalizadas.

- Ajuste de idiomas de bajos recursos – Puede volver a entrenar solo las capas superiores de un FM multilingüe en un idioma de bajos recursos para adaptarlo mejor a ese idioma.

- Arreglando fallas – Si se descubren ciertos comportamientos no deseados en un modelo, la personalización de los datos apropiados puede ayudar a actualizar el modelo para reducir esos defectos.

La personalización del modelo ayuda a superar los siguientes desafíos de adopción de FM:

- Adaptación a nuevos dominios y tareas – Los FM previamente capacitados en corpus de texto generales a menudo necesitan ser ajustados en datos de tareas específicas para que funcionen bien en aplicaciones posteriores. El ajuste fino adapta el modelo a nuevos dominios o tareas en las que no se entrenó originalmente.

- Superar el sesgo – Los FM pueden presentar sesgos respecto de sus datos de entrenamiento originales. Personalizar un modelo con datos nuevos puede reducir los sesgos no deseados en los resultados del modelo.

- Mejora de la eficiencia computacional – Los FM previamente entrenados suelen ser muy grandes y costosos desde el punto de vista computacional. La personalización del modelo puede permitir reducir el tamaño del modelo eliminando parámetros sin importancia, lo que hace que la implementación sea más factible.

- Manejo de datos de destino limitados – En algunos casos, hay datos limitados del mundo real disponibles para la tarea objetivo. La personalización del modelo utiliza los pesos previamente entrenados aprendidos en conjuntos de datos más grandes para superar esta escasez de datos.

- Mejorar el desempeño de la tarea – El ajuste fino casi siempre mejora el rendimiento en las tareas específicas en comparación con el uso de pesas originales previamente entrenadas. Esta optimización del modelo para su uso previsto le permite implementar FM con éxito en aplicaciones reales.

La personalización del modelo tiene mayor complejidad que la ingeniería rápida y RAG porque el peso y los parámetros del modelo se cambian mediante scripts de ajuste, lo que requiere ciencia de datos y experiencia en ML. Sin embargo, Amazon Bedrock lo hace sencillo brindándole una experiencia administrada para personalizar modelos con sintonia FINA or pre-entrenamiento continuo. La personalización del modelo proporciona resultados muy precisos con una calidad comparable a la de RAG. Debido a que está actualizando las ponderaciones del modelo en datos específicos del dominio, el modelo produce respuestas más contextuales. En comparación con RAG, la calidad puede ser ligeramente mejor según el caso de uso. Por lo tanto, es importante realizar un análisis de compensación entre las dos técnicas. Potencialmente, puede implementar RAG con un modelo personalizado.

Reciclaje o formación desde cero

Crear su propio modelo básico de IA en lugar de utilizar únicamente modelos públicos previamente entrenados permite un mayor control, un rendimiento mejorado y una personalización según los casos de uso y los datos específicos de su organización. Invertir en la creación de un FM personalizado puede proporcionar una mejor adaptabilidad, actualizaciones y control sobre las capacidades. La capacitación distribuida permite la escalabilidad necesaria para entrenar FM muy grandes en conjuntos de datos masivos en muchas máquinas. Esta paralelización hace viables modelos con cientos de miles de millones de parámetros entrenados en billones de tokens. Los modelos más grandes tienen mayor capacidad de aprender y generalizar.

El entrenamiento desde cero puede producir resultados de alta calidad porque el modelo se entrena con datos de casos de uso específicos desde cero, las posibilidades de alucinaciones son raras y la precisión del resultado puede estar entre las más altas. Sin embargo, si su conjunto de datos evoluciona constantemente, aún puede tener problemas de alucinaciones. La formación desde cero tiene la mayor complejidad y coste de implementación. Requiere el mayor esfuerzo porque requiere recopilar una gran cantidad de datos, curarlos y procesarlos, y capacitar a un FM bastante grande, lo que requiere experiencia profunda en ciencia de datos y aprendizaje automático. Este enfoque requiere mucho tiempo (normalmente puede llevar semanas o meses).

Debería considerar capacitar a un FM desde cero cuando ninguno de los otros enfoques funcione para usted y tenga la capacidad de crear un FM con una gran cantidad de datos tokenizados bien seleccionados, un presupuesto sofisticado y un equipo de expertos en ML altamente capacitados. . AWS proporciona la infraestructura en la nube más avanzada para capacitar y ejecutar LLM y otros FM con tecnología de GPU y el chip de capacitación de aprendizaje automático especialmente diseñado. tren de AWSy acelerador de inferencia ML, Inferencia de AWS. Para obtener más detalles sobre la capacitación de LLM en SageMaker, consulte Entrenamiento de modelos de idiomas grandes en Amazon SageMaker: Mejores prácticas y HiperPod SageMaker.

Seleccionar el enfoque correcto para desarrollar aplicaciones de IA generativa

Al desarrollar aplicaciones de IA generativa, las organizaciones deben considerar cuidadosamente varios factores clave antes de seleccionar el modelo más adecuado para satisfacer sus necesidades. Se deben considerar una variedad de aspectos, como el costo (para garantizar que el modelo seleccionado se alinee con las restricciones presupuestarias), la calidad (para ofrecer resultados coherentes y objetivamente precisos), la integración perfecta con las plataformas y flujos de trabajo empresariales actuales, y la reducción de las alucinaciones o la generación de información falsa. . Con muchas opciones disponibles, tomarse el tiempo para evaluar minuciosamente estos aspectos ayudará a las organizaciones a elegir el modelo de IA generativa que mejor se adapte a sus necesidades y prioridades específicas. Debe examinar detenidamente los siguientes factores:

- Integración con sistemas empresariales. – Para que los FM sean realmente útiles en un contexto empresarial, deben integrarse e interoperar con los sistemas y flujos de trabajo empresariales existentes. Esto podría implicar acceder a datos de bases de datos, planificación de recursos empresariales (ERP) y gestión de relaciones con los clientes (CRM), así como desencadenar acciones y flujos de trabajo. Sin una integración adecuada, el FM corre el riesgo de convertirse en una herramienta aislada. Los sistemas empresariales como ERP contienen datos comerciales clave (clientes, productos, pedidos). El FM debe estar conectado a estos sistemas para utilizar datos empresariales en lugar de trabajar con su propio gráfico de conocimiento, que puede ser inexacto o estar desactualizado. Esto garantiza precisión y una única fuente de verdad.

- Alucinaciones – Las alucinaciones ocurren cuando una aplicación de IA genera información falsa que parece objetiva. Estos deben abordarse cuidadosamente antes de que los FM se adopten ampliamente. Por ejemplo, un chatbot médico diseñado para brindar sugerencias de diagnóstico podría alucinar detalles sobre los síntomas o el historial médico de un paciente, lo que lo llevaría a proponer un diagnóstico inexacto. Prevenir alucinaciones dañinas como estas a través de soluciones técnicas y la curación de conjuntos de datos será fundamental para garantizar que se pueda confiar en estos FM para aplicaciones sensibles como la atención médica, las finanzas y el ámbito legal. Las implementaciones deberán acompañarse de pruebas exhaustivas y transparencia sobre los datos de entrenamiento de un FM y las fallas restantes.

- Habilidades y recursos – La adopción exitosa de FM dependerá en gran medida de contar con las habilidades y recursos adecuados para utilizar la tecnología de manera efectiva. Las organizaciones necesitan empleados con sólidas habilidades técnicas para implementar, personalizar y mantener adecuadamente los FM para satisfacer sus necesidades específicas. También requieren amplios recursos computacionales, como hardware avanzado y capacidades de computación en la nube, para ejecutar FM complejos. Por ejemplo, un equipo de marketing que desee utilizar un FM para generar textos publicitarios y publicaciones en redes sociales necesita ingenieros capacitados para integrar el sistema, creativos para proporcionar indicaciones y evaluar la calidad de los resultados, y suficiente potencia de computación en la nube para implementar el modelo de manera rentable. Invertir en el desarrollo de experiencia e infraestructura técnica permitirá a las organizaciones obtener un valor comercial real al aplicar FM.

- Calidad de salida – La calidad del resultado producido por los FM será fundamental para determinar su adopción y uso, particularmente en aplicaciones orientadas al consumidor como los chatbots. Si los chatbots impulsados por FM brindan respuestas inexactas, absurdas o inapropiadas, los usuarios rápidamente se frustrarán y dejarán de interactuar con ellos. Por lo tanto, las empresas que deseen implementar chatbots deben probar rigurosamente los FM que los impulsan para garantizar que generen constantemente respuestas de alta calidad que sean útiles, relevantes y apropiadas para brindar una buena experiencia de usuario. La calidad de los resultados abarca factores como la relevancia, la precisión, la coherencia y la idoneidad, todos los cuales contribuyen a la satisfacción general del usuario y harán o desharán la adopción de FM como los utilizados para los chatbots.

- Cost – La alta potencia computacional necesaria para entrenar y ejecutar grandes modelos de IA, como los FM, puede generar costos sustanciales. Muchas organizaciones pueden carecer de los recursos financieros o la infraestructura de nube necesarios para utilizar modelos tan masivos. Además, integrar y personalizar FM para casos de uso específicos agrega costos de ingeniería. Los considerables gastos necesarios para utilizar FM podrían disuadir su adopción generalizada, especialmente entre empresas más pequeñas y nuevas empresas con presupuestos limitados. Evaluar el potencial retorno de la inversión y sopesar los costos versus los beneficios de los FM es fundamental para las organizaciones que consideran su aplicación y utilidad. La rentabilidad probablemente será un factor decisivo a la hora de determinar si estos modelos potentes pero que requieren muchos recursos pueden implementarse de manera viable y cómo hacerlo.

Decisión de diseño

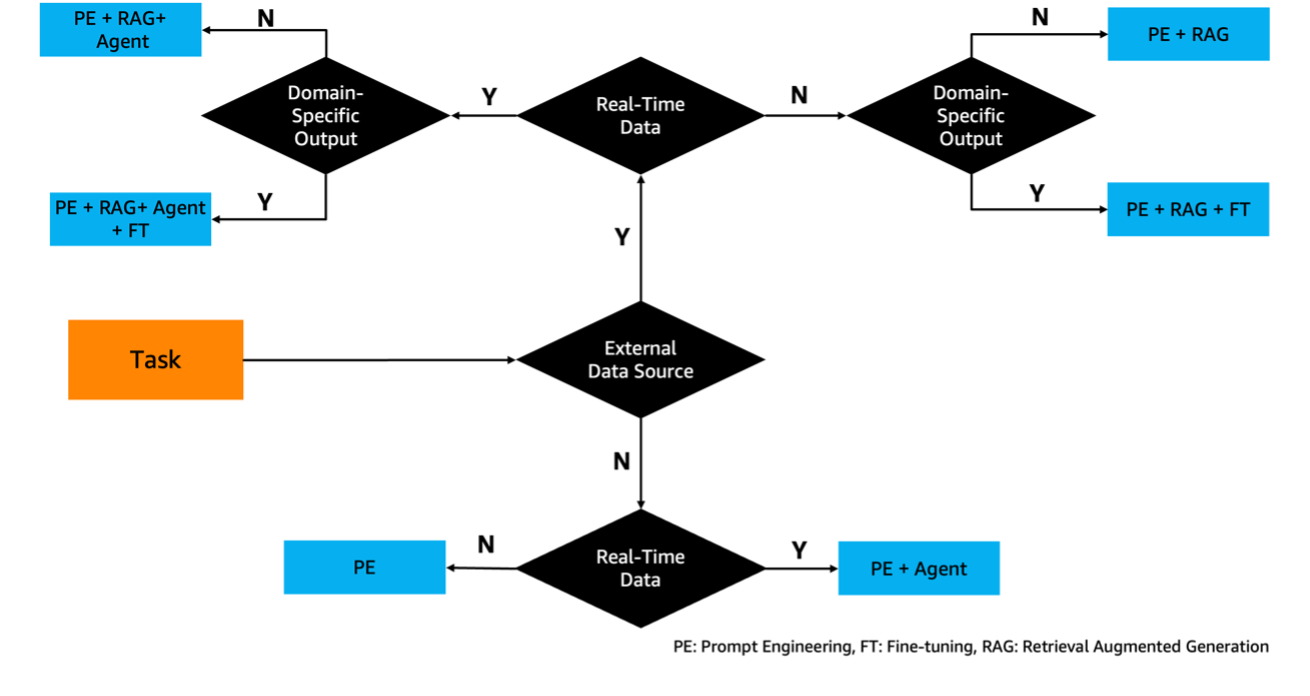

Como cubrimos en esta publicación, actualmente hay disponibles muchas técnicas de IA diferentes, como ingeniería rápida, RAG y personalización de modelos. Esta amplia gama de opciones dificulta que las empresas determinen el enfoque óptimo para su caso de uso particular. La selección del conjunto de técnicas adecuado depende de varios factores, incluido el acceso a fuentes de datos externas, fuentes de datos en tiempo real y la especificidad del dominio de la aplicación prevista. Para ayudar a identificar la técnica más adecuada según el caso de uso y las consideraciones involucradas, analizamos el siguiente diagrama de flujo, que describe recomendaciones para hacer coincidir necesidades y limitaciones específicas con métodos apropiados.

Para obtener una comprensión clara, repasemos el diagrama de flujo de decisiones de diseño utilizando algunos ejemplos ilustrativos:

- Búsqueda empresarial – Un empleado busca solicitar una licencia de su organización. Para brindar una respuesta alineada con las políticas de recursos humanos de la organización, el FM necesita más contexto más allá de sus propios conocimientos y capacidades. Específicamente, el FM requiere acceso a fuentes de datos externas que proporcionen directrices y políticas de recursos humanos relevantes. Dado este escenario de una solicitud de un empleado que requiere consultar datos externos específicos del dominio, el enfoque recomendado según el diagrama de flujo es la ingeniería rápida con RAG. El GAR ayudará a proporcionar los datos relevantes de las fuentes de datos externas como contexto para el FM.

- Búsqueda empresarial con resultados específicos de la organización – Suponga que tiene dibujos de ingeniería y desea extraer de ellos la lista de materiales, formateando el resultado de acuerdo con los estándares de la industria. Para hacer esto, puede utilizar una técnica que combine ingeniería rápida con RAG y un modelo de lenguaje ajustado. El modelo ajustado sería entrenado para producir listas de materiales cuando se le dieran dibujos de ingeniería como entrada. RAG ayuda a encontrar los dibujos de ingeniería más relevantes de las fuentes de datos de la organización para alimentarlos en el contexto del FM. En general, este enfoque extrae listas de materiales de los dibujos de ingeniería y estructura la salida de manera adecuada para el dominio de la ingeniería.

- Busqueda general – Imagina que quieres encontrar la identidad del trigésimo presidente de los Estados Unidos. Podría utilizar ingeniería rápida para obtener la respuesta de FM. Debido a que estos modelos se basan en muchas fuentes de datos, a menudo pueden proporcionar respuestas precisas a preguntas fácticas como ésta.

- Búsqueda general con eventos recientes – Si desea determinar el precio actual de las acciones de Amazon, puede utilizar el método de ingeniería rápida con un agente. El agente proporcionará al FM el precio de las acciones más reciente para que pueda generar la respuesta objetiva.

Conclusión

La IA generativa ofrece un enorme potencial para que las organizaciones impulsen la innovación y aumenten la productividad en una variedad de aplicaciones. Sin embargo, para adoptar con éxito estas tecnologías emergentes de IA es necesario abordar consideraciones clave en torno a la integración, la calidad de los resultados, las habilidades, los costos y los riesgos potenciales, como alucinaciones nocivas o vulnerabilidades de seguridad. Las organizaciones deben adoptar un enfoque sistemático para evaluar los requisitos y limitaciones de sus casos de uso para determinar las técnicas más apropiadas para adaptar y aplicar los FM. Como se destaca en esta publicación, la ingeniería rápida, el RAG y los métodos eficientes de personalización de modelos tienen cada uno sus propias fortalezas y debilidades que se adaptan a diferentes escenarios. Al mapear las necesidades comerciales con las capacidades de IA utilizando un marco estructurado, las organizaciones pueden superar los obstáculos para la implementación y comenzar a obtener beneficios de los FM, al mismo tiempo que construyen barreras para gestionar los riesgos. Con una planificación cuidadosa basada en ejemplos del mundo real, las empresas de todos los sectores pueden desbloquear un valor inmenso de esta nueva ola de IA generativa. Aprender acerca IA generativa en AWS.

Acerca de los autores

jay rao es arquitecto principal de soluciones en AWS. Se centra en tecnologías de IA/ML con un gran interés en IA generativa y visión por computadora. En AWS, le gusta brindar orientación técnica y estratégica a los clientes y ayudarlos a diseñar e implementar soluciones que impulsen los resultados comerciales. Es autor de libros (Computer Vision en AWS), publica regularmente blogs y ejemplos de códigos y ha impartido charlas en conferencias tecnológicas como AWS re:Invent.

jay rao es arquitecto principal de soluciones en AWS. Se centra en tecnologías de IA/ML con un gran interés en IA generativa y visión por computadora. En AWS, le gusta brindar orientación técnica y estratégica a los clientes y ayudarlos a diseñar e implementar soluciones que impulsen los resultados comerciales. Es autor de libros (Computer Vision en AWS), publica regularmente blogs y ejemplos de códigos y ha impartido charlas en conferencias tecnológicas como AWS re:Invent.

Babu Kariyaden Parambath es especialista sénior en IA/ML en AWS. En AWS, le gusta trabajar con los clientes para ayudarlos a identificar el caso de uso empresarial adecuado con valor empresarial y resolverlo utilizando las soluciones y servicios de IA/ML de AWS. Antes de unirse a AWS, Babu era un evangelista de la IA con 20 años de experiencia en diversos sectores en la entrega de valor empresarial impulsado por la IA para los clientes.

Babu Kariyaden Parambath es especialista sénior en IA/ML en AWS. En AWS, le gusta trabajar con los clientes para ayudarlos a identificar el caso de uso empresarial adecuado con valor empresarial y resolverlo utilizando las soluciones y servicios de IA/ML de AWS. Antes de unirse a AWS, Babu era un evangelista de la IA con 20 años de experiencia en diversos sectores en la entrega de valor empresarial impulsado por la IA para los clientes.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/best-practices-to-build-generative-ai-applications-on-aws/

- :posee

- :es

- :no

- :dónde

- 1

- 100

- 116

- 20

- 20 años

- 2017

- 2022

- 30

- 7

- a

- capacidad

- Poder

- Nuestra Empresa

- acelerador

- de la máquina

- el acceso

- acompañar

- Conforme

- Mi Cuenta

- la exactitud

- preciso

- precisamente

- Lograr

- a través de

- interino

- acciones

- real

- adaptar

- adaptaciónes

- adaptación

- se adapta

- la adición de

- Adicionales

- Adicionalmente

- dirección

- dirigido

- direcciones

- direccionamiento

- Añade

- adecuadamente

- adoptar

- adoptado

- Adopción

- Adopción

- avanzado

- avance

- ventajas

- Publicidad

- Agente

- agentes

- AI

- Modelos AI

- ai investigación

- Alimentado por IA

- AI / ML

- Ayudar

- paquete de capacitación DWoVH

- AL

- alinear

- alineado

- Alinea

- Todos

- permitir

- Permitir

- permite

- casi

- solo

- también

- Aunque

- hacerlo

- Amazon

- amazona kendra

- Amazon SageMaker

- JumpStart de Amazon SageMaker

- Amazon Web Services

- entre

- entre

- cantidad

- an

- análisis

- y

- e infraestructura

- https://www.youtube.com/watch?v=xB-eutXNUMXJtA&feature=youtu.be

- responder

- respuestas

- Antrópico

- cualquier

- abejas

- API

- applicación

- aparece

- Aplicación

- aplicaciones

- La aplicación de

- enfoque

- enfoques

- adecuado

- adecuadamente

- arquitectura

- somos

- surgir

- en torno a

- AS

- aspectos

- evaluar

- Legal

- asociado

- At

- aumentar

- aumentado

- autor

- Confirmación de Viaje

- automatiza

- automáticamente

- autónomamente

- Hoy Disponibles

- AWS

- AWS re: Invent

- bases

- basado

- BE

- porque

- a las que has recomendado

- antes

- comenzar

- comportamiento

- comportamientos

- "Ser"

- beneficios

- MEJOR

- y las mejores prácticas

- mejores

- entre

- Más allá de

- los prejuicios

- Bill

- miles de millones

- Billetes

- biomédica

- Blogs

- primer libro

- Booking

- empujón

- ambas

- marca

- Descanso

- Ruptura

- rompe

- general

- más amplio

- presupuesto

- Presupuestos

- build

- Construir la

- construido

- incorporado

- negocios

- pero

- by

- llamar

- PUEDEN

- Puede conseguir

- capacidades

- capacidad

- capaz

- Capacidad

- estudiar cuidadosamente

- llevar

- case

- cases

- a ciertos

- Reto

- retos

- desafiante

- posibilidades

- el cambio

- cambiado

- Cambios

- cambio

- personajes

- Tabla

- chatterbot

- Chatbots

- chip

- manera?

- opciones

- Elige

- clasificación

- Limpieza

- limpiar

- de cerca

- Soluciones

- la computación en nube

- infraestructura de nube

- código

- Codificación

- COHERENTE

- El cobro

- combinar

- combina

- cómo

- proviene

- Algunos

- Empresas

- compañía

- De la empresa

- comparable

- en comparación con

- completar

- integraciones

- complejidad

- compliance

- componentes

- comprender

- computational

- potencia de cálculo

- computacionalmente

- Calcular

- computadora

- Visión por computador

- informática

- potencia de cálculo

- Conducir

- conferencias

- Contacto

- conectado

- Conectividad

- Considerar

- considerable

- consideraciones

- considerado

- en vista de

- consecuentemente

- Consola

- constantemente

- restricciones

- consumo

- que no contengo

- contenido

- Generación de contenido

- contexto

- contextos

- contextual

- continue

- continuado

- contribuir

- control

- conversacional

- conversaciones

- copia

- Core

- Cost

- Precio

- podría

- Protectora

- cobertura

- cubierto

- Para crear

- Creamos

- Estudio

- creativos

- crítico

- CRM

- crucial

- comisariado

- curaduría

- Current

- En la actualidad

- personalizado

- cliente

- experiencia del cliente

- Clientes

- personalización

- personalizan

- se adaptan

- datos

- privacidad de datos

- Privacidad y seguridad de datos

- proceso de datos

- Ciencia de los datos

- bases de datos

- conjuntos de datos

- tratar

- Decidir

- Koops

- profundo

- Grado

- entregamos

- liberado

- entregar

- Demanda

- demostrar

- depender

- Dependiente

- depende

- desplegar

- desplegado

- despliegue

- Despliegues

- Diseño

- diseñado

- diseño

- deseado

- detalles

- Determinar

- determinar

- desarrollar

- Developer

- desarrolladores

- el desarrollo

- Desarrollo

- diagnóstico

- una experiencia diferente

- difícil

- directamente

- descubierto CRISPR

- discutir

- distribuidos

- entrenamiento distribuido

- diverso

- do

- documentos

- No

- dólares

- dominio

- dominios

- DE INSCRIPCIÓN

- Dibujos

- el lado de la transmisión

- impulsados

- dos

- durante

- lugar de trabajo dinámico

- E & T

- cada una

- pasan fácilmente

- Eficaz

- de manera eficaz

- eficiencia

- eficiente

- eficiente.

- esfuerzo

- elementos

- elegible

- eliminando

- correo

- incrustación

- aparición

- emergentes

- Nuestros

- personas

- empoderamiento

- habilitar

- permite

- permitiendo

- engloba

- cifrar

- cifrado

- final

- de extremo a extremo

- interactuando

- Motor

- Ingeniería

- certificados

- mejorar

- enriquecedor

- garantizar

- asegura

- asegurando que

- Empresa

- entidades

- entidad

- Entorno

- ambientes

- equipar

- ERP

- especialmente

- establecer

- evaluar

- evaluación

- Evangelista

- Cada

- todo

- evolución

- examinar

- ejemplo

- ejemplos

- emocionante

- exhibir

- existente

- gastos

- costoso

- experience

- experimentos

- experto

- Experiencia

- expertos

- explorar

- extensión

- externo

- extraerlos

- Extractos

- extremadamente

- Cara

- factor

- factores importantes

- hechos

- FALLO

- bastante

- Otoño

- false

- factible

- pocos

- financiar

- financiero

- Encuentre

- Los resultados

- Digital XNUMXk

- defectos

- Flexibilidad

- vuelo

- de tus señales

- Focus

- se centra

- siguiendo

- Fundación

- Fundacional

- Marco conceptual

- marcos

- frecuentemente

- Desde

- frustrado

- Cumplir

- ser completados

- completamente

- promover

- Obtén

- brecha

- reunir

- RGPD

- General

- propósito general

- generar

- generado

- genera

- la generación de

- generación de AHSS

- generativo

- IA generativa

- obtener

- Donar

- dado

- Go

- candidato

- gobierno

- GPU

- gráfica

- maravillosa

- mayor

- Polo a Tierra

- conectado a tierra

- guía

- guía

- orientaciones

- Manijas

- Materiales

- perjudicial

- aprovechar

- Tienen

- es

- he

- la salud

- fuertemente

- ayuda

- serviciales

- ayudando

- ayuda

- Alta

- alto rendimiento

- alta calidad

- más alto

- más alto

- el grado más alto

- Destacado

- altamente

- historia

- Cómo

- Como Hacer

- Sin embargo

- hr

- HTML

- HTTPS

- Bujes

- Cientos

- Obstáculos

- Ajuste de hiperparámetros

- idea

- ideas

- Identifique

- identificar

- Identidad

- if

- imagen

- inmenso

- Impacto

- impactante

- Impactos

- implementar

- implementación

- importante

- mejorar

- mejorado

- mejora

- la mejora de

- in

- incorrecto

- Incluye

- independientemente

- Indica

- energético

- estándares de la industria

- información

- EN LA MINA

- Innovation

- innovaciones

- Las opciones de entrada

- Insights

- inspiren

- Innovadora

- Instrucciones

- integrar

- Integración

- integración

- Destinado a

- interactuar

- intereses

- interesante

- Interfaz

- interno

- Internet

- interoperar

- dentro

- Introducido

- inventario

- metas de

- inversión extranjera

- involucrar

- involucra

- implica

- aislado

- cuestiones

- IT

- SUS

- unión

- solo

- Keen

- Clave

- claves

- especialistas

- Conocimiento Gráfico

- sabe

- labs

- Falta

- idioma

- Idiomas

- large

- mayores

- ponedoras

- Lead

- líder

- APRENDE:

- aprendido

- aprendizaje

- Abandonar

- Legal

- Permíteme

- LG

- como

- que otros

- limitaciones

- Limitada

- líneas

- Llama

- lógica

- lógico

- mirando

- Baja

- máquina

- máquina de aprendizaje

- Máquinas

- mantener

- para lograr

- HACE

- Realizar

- gestionan

- gestionado

- Management

- manual

- muchos

- cartografía

- Marketing

- masivo

- macizamente

- pareo

- materiales

- Puede..

- Medios

- servicios

- Conoce a

- Meta

- Método

- métodos

- podría

- millones

- minimizar

- ML

- modelo

- modelos

- meses

- más,

- MEJOR DE TU

- emocionante

- debe

- Natural

- necesario

- ¿ Necesita ayuda

- necesidad

- negativas

- Nuevo

- próxima generación

- Ninguna

- ahora

- of

- off

- Ofertas

- a menudo

- on

- ONE

- , solamente

- Operaciones

- Del Mañana

- óptimo

- optimización

- Opciones

- or

- orquestación

- solicite

- en pedidos de venta.

- organización

- organizativo

- para las fiestas.

- reconocida por

- originalmente

- Otro

- salir

- resultados

- anticuado

- contornos

- Supera

- salida

- salidas

- Más de

- total

- Superar

- visión de conjunto

- EL DESARROLLADOR

- pares

- papeles

- parámetros

- particular

- particularmente

- pasajes

- pasado

- Realizar

- actuación

- actuaciones

- con

- Personalizado

- frases

- piezas

- industrial

- planificar

- Plataformas

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- parcela

- puntos

- políticas

- Popular

- posible

- Publicación

- Artículos

- posible

- la posibilidad

- industria

- alimentado

- poderoso

- Metodología

- prácticas

- anterior

- preferencias

- presidente

- la prevención

- previamente

- precio

- cotización

- Director de la escuela

- Anterior

- política de privacidad

- Privacidad y Seguridad

- privada

- Problema

- problemas

- tratamiento

- producir

- producido

- produce

- productividad

- Productos

- Mi Perfil

- Programación

- promueve

- ideas

- apropiado

- correctamente

- ofrece

- propietario

- proporcionar

- los proveedores

- proporciona un

- proporcionando

- público

- publicado

- Publica

- tracción

- comprar

- orden de compra

- calidad

- consultas

- pregunta

- Preguntas

- con rapidez

- trapo

- distancia

- rápido

- rápidamente

- RARO

- más bien

- Crudo

- RE

- Reaccionar

- real

- valor real

- mundo real

- en tiempo real

- datos en tiempo real

- realización

- reciente

- reconocimiento

- Recomendación

- recomendaciones

- recomendado

- reducir

- la reducción de

- remitir

- regularmente

- relación

- la relevancia

- confiando

- restante

- relevantes

- Informes

- reputación

- solicita

- solicitudes

- exigir

- Requisitos

- Requisitos

- requiere

- requisito

- la investigación

- Recurso

- muchos recursos

- Recursos

- Responder

- respuesta

- respuestas

- RESTO

- Resultados

- recuperación

- volvemos

- ingresos

- Reseñas

- Derecho

- riesgos

- rutina

- Ejecutar

- correr

- Safer

- sabio

- mismo

- satisfacción

- Escalabilidad

- escalable

- Escala

- Escasez

- guión

- escenarios

- Ciencia:

- los científicos

- rayar

- guiones

- sin costura

- Buscar

- Sección

- segura

- EN LINEA

- los riesgos de seguridad

- seleccionado

- seleccionar

- selección

- mayor

- sensible

- sentimiento

- sentimientos

- Sin servidor

- sirve

- de coches

- Servicios

- servicio

- Sesión

- set

- Sets

- ajustes

- Varios

- Forma

- compartido

- En Corto

- tienes

- Shows

- importante

- significativamente

- similares

- sencillos

- soltero

- experto

- habilidades

- menores

- So

- Social

- redes sociales

- Publicaciones en redes sociales

- únicamente

- sólido

- a medida

- Soluciones

- RESOLVER

- Resolver

- algo

- sofisticado

- Fuente

- Fuentes

- especialista

- especializarse

- especializado

- se especializa

- soluciones y

- específicamente

- especificidad

- Estabilidad

- stand

- estándares de salud

- comienzo

- fundó

- Startups

- Zonas

- paso

- pasos

- Sin embargo

- en stock

- Detener

- tienda

- tiendas

- Historias

- Historia

- sencillo

- Estratégico

- fortalezas

- fuerte

- estructura

- estructurado

- estructuras

- papa

- sustancial

- exitosos

- Con éxito

- tal

- suficiente

- sugieren

- siguiente

- adecuado

- Sobrealimentar

- suministro

- SOPORTE

- soportes

- seguro

- Síntomas

- te

- Todas las funciones a su disposición

- entrada

- adaptado

- ¡Prepárate!

- toma

- Talent

- hablar

- Discursos

- Pulsa para buscar

- Target

- Tarea

- tareas

- equipo

- tecnología

- Técnico

- habilidades técnicas

- la técnica

- técnicas

- Tecnologías

- Tecnología

- Innovación Tecnológica

- plantilla

- terminología

- test

- Pruebas

- texto

- Clasificación de texto

- que

- esa

- El

- la información

- su

- Les

- luego

- Ahí.

- por lo tanto

- Estas

- ellos

- pensar

- terceros.

- así

- completo

- a fondo

- aquellos

- miles

- Tres

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- prolongado

- a

- tokenized

- Tokens

- del IRS

- parte superior

- tema

- Temas

- hacia

- tráfico

- Entrenar

- entrenado

- Formación

- tránsito

- Traducción

- Transparencia

- tremendo

- desencadenando

- billones

- verdaderamente

- Confía en

- de confianza

- digno de confianza

- verdad

- sintonización

- GIRO

- pellizcar

- dos

- típicamente

- incapaz

- entender

- comprensión

- único

- United

- Estados Unidos

- desbloquear

- no explotado

- no deseado

- hasta a la fecha

- Actualizar

- actualizado

- actualización

- actualizaciones

- utilizan el

- caso de uso

- usado

- eficiente

- Usuario

- experiencia como usuario

- usuarios

- usos

- usando

- utilidad

- VALIDAR

- propuesta de

- variedad

- diversos

- Vasto

- vastamente

- muy

- vía

- visión

- visual

- vs

- Vulnerabilidades

- caminar

- quieres

- falto

- fue

- Trenzado

- Camino..

- we

- debilidades

- web

- servicios web

- Semanas

- pesó

- peso

- WELL

- ¿

- cuando

- mientras

- sean

- que

- mientras

- amplio

- Amplia gama

- extensamente

- extendido

- Wikipedia

- seguirá

- dentro de

- sin

- Actividades:

- flujo de trabajo

- flujos de trabajo

- trabajando

- se

- escribir

- la escritura

- escrito

- años

- Rendimiento

- Usted

- tú

- zephyrnet