La detección de fraude es un problema importante que tiene aplicaciones en servicios financieros, redes sociales, comercio electrónico, juegos y otras industrias. Esta publicación presenta una implementación de una solución de detección de fraude utilizando el modelo de red convolucional de gráficos relacionales (RGCN) para predecir la probabilidad de que una transacción sea fraudulenta a través de los modos de inferencia transductiva e inductiva. Puede implementar nuestra implementación en un Amazon SageMaker endpoint como una solución de detección de fraude en tiempo real, sin necesidad de orquestación ni almacenamiento de gráficos externos, lo que reduce significativamente el costo de implementación del modelo.

Las empresas que buscan un servicio de IA de AWS totalmente administrado para la detección de fraudes también pueden utilizar Detector de fraudes de Amazon, que puede usar para identificar pagos en línea sospechosos, detectar fraudes de cuentas nuevas, prevenir el abuso del programa de prueba y lealtad, o mejorar la detección de apropiación de cuentas.

Resumen de la solución

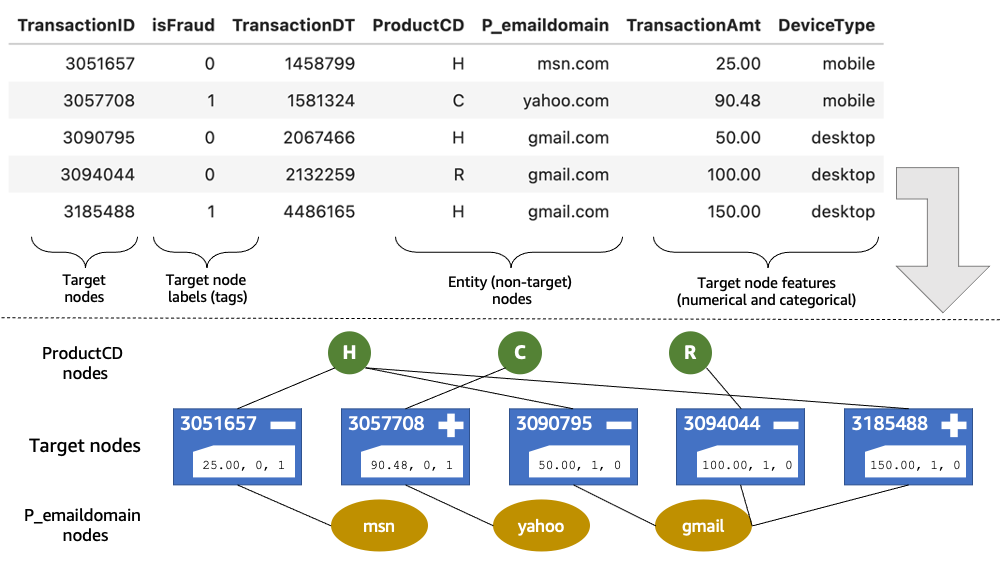

El siguiente diagrama describe una red ejemplar de transacciones financieras que incluye diferentes tipos de información. Cada transacción contiene información como identificadores de dispositivos, ID de Wi-Fi, direcciones IP, ubicaciones físicas, números de teléfono y más. Representamos los conjuntos de datos de transacciones a través de un gráfico heterogéneo que contiene diferentes tipos de nodos y aristas. Luego, el problema de detección de fraude se maneja como una tarea de clasificación de nodos en este grafo heterogéneo.

Las redes neuronales gráficas (GNN) se han mostrado muy prometedoras para abordar los problemas de detección de fraudes, superando los métodos de aprendizaje supervisado populares, como los árboles de decisión potenciados por gradientes o las redes de alimentación hacia adelante totalmente conectadas en conjuntos de datos de evaluación comparativa. En una configuración típica de detección de fraude, durante la fase de entrenamiento, se entrena un modelo GNN en un conjunto de transacciones etiquetadas. Cada transacción de entrenamiento se proporciona con una etiqueta binaria que indica si es fraudulenta. Este modelo entrenado se puede usar para detectar transacciones fraudulentas entre un conjunto de transacciones no etiquetadas durante la fase de inferencia. Existen dos modos diferentes de inferencia: inferencia transductiva versus inferencia inductiva (que discutiremos más adelante en esta publicación).

Los modelos basados en GNN, como RGCN, pueden aprovechar la información topológica, combinando la estructura gráfica y las características de los nodos y los bordes para aprender una representación significativa que distinga las transacciones maliciosas de las transacciones legítimas. RGCN puede aprender efectivamente a representar diferentes tipos de nodos y bordes (relaciones) a través de incrustaciones de gráficos heterogéneos. En el diagrama anterior, cada transacción se modela como un nodo de destino y varias entidades asociadas con cada transacción se modelan como tipos de nodos que no son de destino, como ProductCD y P_emaildomain. Los nodos de destino tienen características numéricas y categóricas asignadas, mientras que otros tipos de nodos no tienen características. El modelo RGCN aprende una incrustación para cada tipo de nodo no objetivo. Para la incrustación de un nodo de destino, se usa una operación convolucional para calcular su incrustación utilizando sus características e incrustaciones de vecindad. En el resto de la publicación, usamos los términos GNN y RGCN indistintamente.

Vale la pena señalar que las estrategias alternativas, como tratar las entidades que no son de destino como características y codificarlas en caliente, a menudo serían inviables debido a las grandes cardinalidades de estas entidades. Por el contrario, codificarlos como entidades gráficas permite que el modelo GNN aproveche la topología implícita en las relaciones de entidad. Por ejemplo, las transacciones que comparten un número de teléfono con transacciones fraudulentas conocidas también tienen más probabilidades de ser fraudulentas.

La representación gráfica empleada por las GNN genera cierta complejidad en su implementación. Esto es especialmente cierto para aplicaciones como la detección de fraudes, en las que la representación gráfica puede aumentar durante la inferencia con nodos recién agregados que corresponden a entidades desconocidas durante el entrenamiento del modelo. Este escenario de inferencia se suele denominar modo inductivo. A diferencia de, modo transductivo es un escenario que asume que la representación gráfica construida durante el entrenamiento del modelo no cambiará durante la inferencia. Los modelos GNN a menudo se evalúan en modo transductivo mediante la construcción de representaciones gráficas a partir de un conjunto combinado de ejemplos de entrenamiento y prueba, mientras se enmascaran las etiquetas de prueba durante la retropropagación. Esto garantiza que la representación del gráfico sea estática y que el modelo GNN no requiera la implementación de operaciones para extender el gráfico con nuevos nodos durante la inferencia. Desafortunadamente, no se puede asumir la representación gráfica estática cuando se detectan transacciones fraudulentas en un entorno del mundo real. Por lo tanto, se requiere compatibilidad con la inferencia inductiva al implementar modelos GNN para la detección de fraudes en entornos de producción.

Además, la detección de transacciones fraudulentas en tiempo real es crucial, especialmente en casos comerciales donde solo hay una posibilidad de detener las actividades ilegales. Por ejemplo, los usuarios fraudulentos pueden comportarse maliciosamente solo una vez con una cuenta y nunca volver a usar la misma cuenta. La inferencia en tiempo real en modelos GNN introduce una complejidad adicional a la implementación. A menudo es necesario implementar operaciones de extracción de subgráficos para admitir la inferencia en tiempo real. La operación de extracción de subgráficos es necesaria para reducir la latencia de inferencia cuando la representación del gráfico es grande y realizar inferencias en todo el gráfico se vuelve prohibitivamente costoso. Un algoritmo para la inferencia inductiva en tiempo real con un modelo RGCN se ejecuta de la siguiente manera:

- Dado un lote de transacciones y un modelo RGCN entrenado, extienda la representación gráfica con entidades del lote.

- Asigne vectores de incrustación de nuevos nodos no objetivo con el vector de incrustación medio de su respectivo tipo de nodo.

- Extraer un subgrafo inducido por k-salir del vecindario de los nodos de destino del lote.

- Realice inferencias en el subgráfico y devuelva puntajes de predicción para los nodos de destino del lote.

- Limpie la representación del gráfico eliminando los nodos recién agregados (este paso garantiza que el requisito de memoria para la inferencia del modelo se mantenga constante).

La contribución clave de esta publicación es presentar un modelo RGCN que implementa el algoritmo de inferencia inductiva en tiempo real. Puede implementar nuestra implementación de RGCN en un terminal de SageMaker como una solución de detección de fraude en tiempo real. Nuestra solución no requiere orquestación ni almacenamiento de gráficos externos, y reduce significativamente el costo de implementación del modelo RGCN para tareas de detección de fraude. El modelo también implementa el modo de inferencia transductivo, lo que nos permite realizar experimentos para comparar el rendimiento del modelo en los modos inductivo y transductivo. Se puede acceder al código del modelo y cuadernos con experimentos desde el Ejemplos de repositorio de GitHub de AWS.

Esta publicación se basa en la publicación Cree una solución de detección de fraudes en tiempo real basada en GNN con Amazon SageMaker, Amazon Neptune y Deep Graph Library. La publicación anterior creó una solución de detección de fraude en tiempo real basada en RGCN usando SageMaker, Amazonas Neptuno, y la Biblioteca de gráficos profundos (DGL). La solución anterior usaba una base de datos Neptune como almacenamiento de gráficos externo, requerido AWS Lambda para orquestación para inferencia en tiempo real, y solo incluía experimentos en modo transductivo.

El modelo RGCN presentado en esta publicación implementa todas las operaciones del algoritmo de inferencia inductiva en tiempo real utilizando solo el DGL como dependencia y no requiere almacenamiento de gráficos externo ni orquestación para la implementación.

Primero evaluamos el rendimiento del modelo RGCN en modos transductivos e inductivos en un conjunto de datos de referencia. Como era de esperar, el rendimiento del modelo en modo inductivo es ligeramente inferior al del modo transductivo. También estudiamos el efecto del hiperparámetro k sobre el rendimiento del modelo. El hiperparámetro k controla el número de saltos realizados para extraer un subgráfico en el Paso 3 del algoritmo de inferencia en tiempo real. Valores más altos de k producirá subgráficos más grandes y puede conducir a un mejor rendimiento de inferencia a expensas de una mayor latencia. Como tal, también llevamos a cabo experimentos de sincronización para evaluar la viabilidad del modelo RGCN para una aplicación en tiempo real.

Conjunto de datos

Usamos la Conjunto de datos de fraude IEEE-CIS, el mismo conjunto de datos que se utilizó en el anterior post. El conjunto de datos contiene más de 590,000 XNUMX registros de transacciones que tienen una etiqueta de fraude binario (la isFraud columna). Los datos se dividen en dos tablas: transacción e identidad. Sin embargo, no todos los registros de transacciones tienen información de identidad correspondiente. Unimos las dos mesas en el TransactionID columna, lo que nos deja con un total de 144,233 registros de transacciones. Ordenamos la tabla por marca de tiempo de la transacción (la TransactionDT columna) y crear una división porcentual 80/20 por tiempo, produciendo 115,386 y 28,847 transacciones para entrenamiento y prueba, respectivamente.

Para obtener más detalles sobre el conjunto de datos y cómo formatearlo para que se adapte a los requisitos de entrada del DGL, consulte Detección de fraude en redes heterogéneas con Amazon SageMaker y Deep Graph Library.

Construcción de grafos

Usamos la TransactionID columna para generar nodos de destino. Usamos las siguientes columnas para generar 11 tipos de nodos no objetivo:

card1acard6ProductCDaddr1yaddr2P_emaildomainyR_emaildomain

Usamos 38 columnas como características categóricas de los nodos de destino:

M1aM9DeviceTypeyDeviceInfoid_12aid_38

Usamos 382 columnas como características numéricas de los nodos de destino:

TransactionAmtdist1ydist2id_01aid_11C1aC14D1aD15V1aV339

Nuestro gráfico construido a partir de las transacciones de entrenamiento contiene 217,935 2,653,878 nodos y XNUMX XNUMX XNUMX aristas.

Hiperparámetros

Otros parámetros se establecen para que coincidan con los parámetros informados en el anterior post. El siguiente fragmento ilustra el entrenamiento del modelo RGCN en modos transductivo e inductivo:

Modo inductivo vs. transductivo

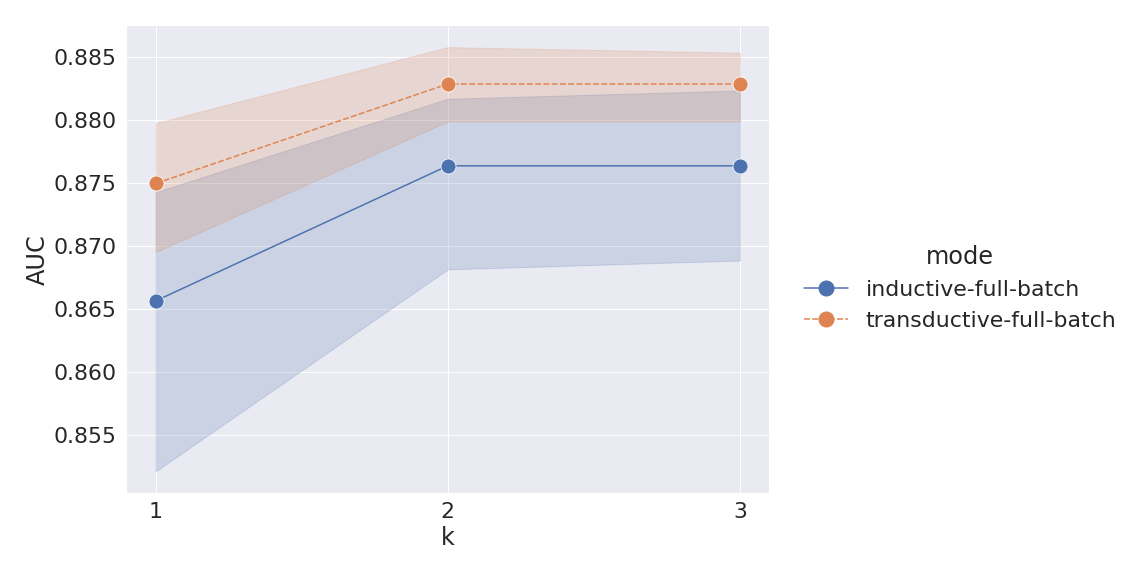

Realizamos cinco ensayos para modo inductivo y cinco ensayos para modo transductivo. Para cada ensayo, entrenamos un modelo RGCN y lo guardamos en disco, obteniendo 10 modelos. Evaluamos cada modelo en ejemplos de prueba mientras aumentamos el número de saltos (parámetro k) utilizado para extraer un subgrafo para inferencia, estableciendo k a 1, 2 y 3. Predecimos en todos los ejemplos de prueba a la vez y calculamos la puntuación ROC AUC para cada prueba. La siguiente gráfica muestra la media y los intervalos de confianza del 95 % de las puntuaciones de AUC.

Podemos ver que el rendimiento en modo transductivo es ligeramente mayor que en modo inductivo. Para k=2, las puntuaciones medias de AUC para los modos inductivo y transductivo son 0.876 y 0.883, respectivamente. Esto es de esperar porque el modelo RGCN puede aprender incrustaciones de todos los nodos de entidad en modo transductivo, incluidos los del conjunto de prueba. Por el contrario, el modo inductivo solo permite que el modelo aprenda incrustaciones de nodos de entidad que están presentes en los ejemplos de entrenamiento y, por lo tanto, algunos nodos deben llenarse con la media durante la inferencia. Al mismo tiempo, la caída de rendimiento entre los modos transductivo e inductivo no es significativa, e incluso en modo inductivo, el modelo RGCN logra un buen rendimiento con un AUC de 0.876. También observamos que el rendimiento del modelo no mejora para valores de k>2. Esto implica que establecer k=2 extraería un subgráfico suficientemente grande durante la inferencia, lo que daría como resultado un rendimiento óptimo. Esta observación también es confirmada por nuestro próximo experimento.

También vale la pena señalar que, para el modo transductivo, el AUC de nuestro modelo de 0.883 es más alto que el AUC correspondiente de 0.870 informado en el anterior post. Usamos más columnas como características numéricas y categóricas de los nodos de destino, lo que puede explicar la puntuación de AUC más alta. También notamos que los experimentos en la publicación anterior solo realizaron una sola prueba.

Inferencia en un lote pequeño

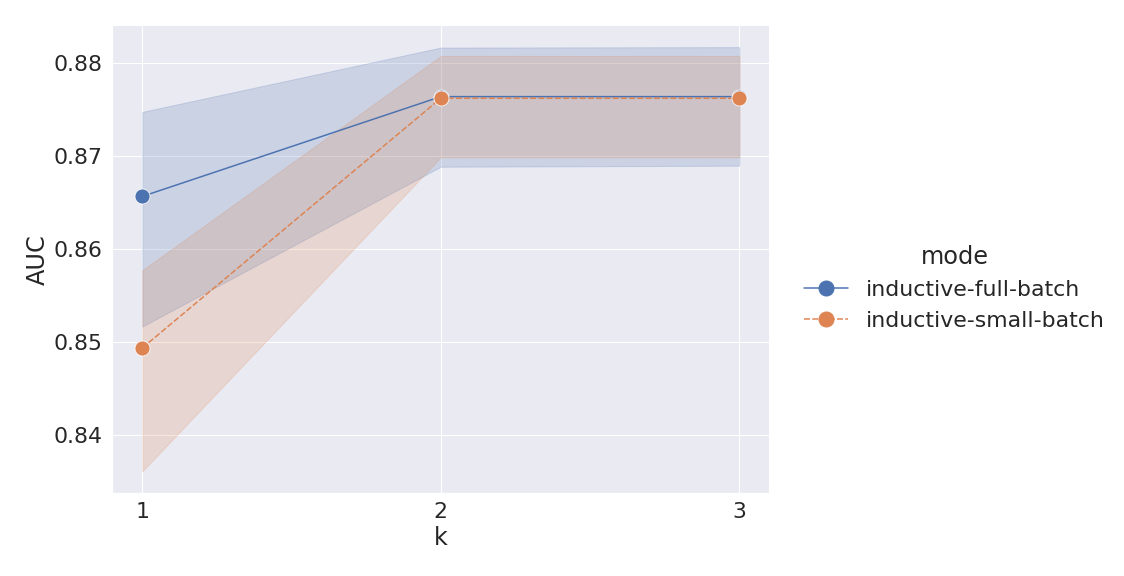

Para este experimento, evaluamos el modelo RGCN en un entorno de inferencia de lotes pequeños. Usamos cinco modelos que fueron entrenados en modo inductivo en el experimento anterior. Comparamos el rendimiento de estos modelos al predecir en dos entornos: inferencia de lotes completos y pequeños. Para la inferencia de lotes completos, predecimos en todo el conjunto de prueba, como se hizo en el experimento anterior. Para la inferencia de lotes pequeños, predecimos en lotes pequeños dividiendo el conjunto de prueba en 28 lotes de igual tamaño con aproximadamente 1,000 transacciones en cada lote. Calculamos las puntuaciones de AUC para ambos entornos usando diferentes valores de k. El siguiente gráfico muestra la media y los intervalos de confianza del 95 % para la configuración de inferencia de lotes pequeños y completos.

Observamos que el rendimiento para la inferencia de lotes pequeños cuando k=1 es menor que para el lote completo. Sin embargo, el rendimiento de la inferencia de lotes pequeños coincide con el lote completo cuando k>1. Esto se puede atribuir a que se extraen subgráficos mucho más pequeños para lotes pequeños. Confirmamos esto comparando los tamaños de los subgráficos con el tamaño del gráfico completo construido a partir de las transacciones de entrenamiento. Comparamos tamaños de gráficos en términos de número de nodos. Para k=1, el tamaño medio del subgráfico para la inferencia de lotes pequeños es inferior al 2 % del gráfico de entrenamiento. Y para la inferencia de lotes completos cuando k=1, el tamaño del subgráfico es 22%. Cuando k=2, los tamaños de los subgráficos para la inferencia de lotes pequeños y completos son 54 % y 64 %, respectivamente. Finalmente, los tamaños de los subgráficos para ambas configuraciones de inferencia alcanzan el 100% para k=3. En otras palabras, cuando k>1, el subgrafo para un lote pequeño se vuelve lo suficientemente grande, lo que permite que la inferencia de lotes pequeños alcance el mismo rendimiento que la inferencia de lotes completos.

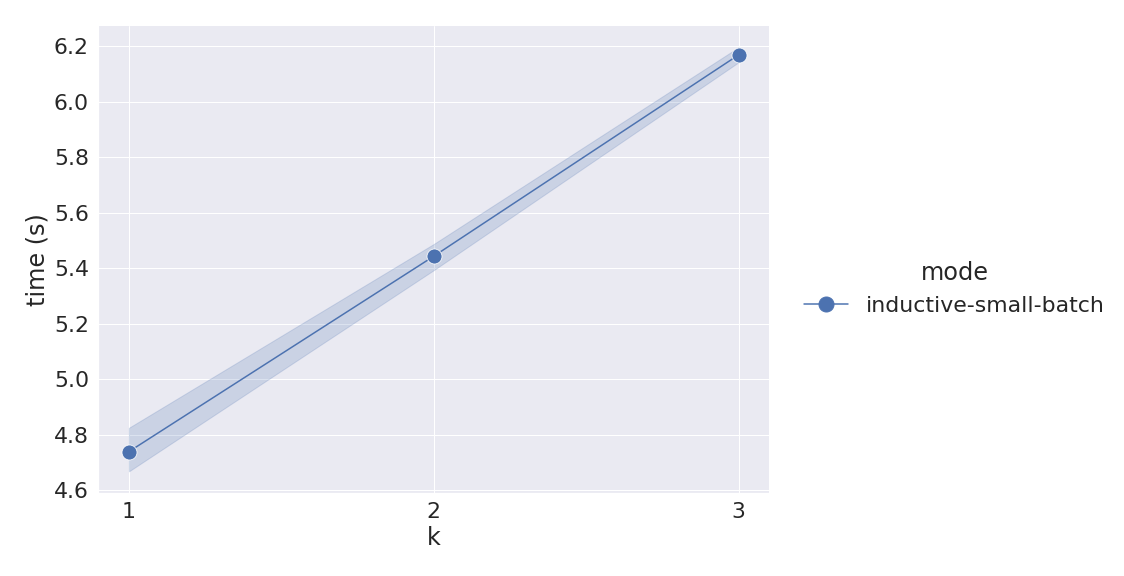

También registramos la latencia de predicción para cada lote. Realizamos nuestros experimentos en una instancia ml.r5.12xlarge, pero puede usar una instancia más pequeña con 64 G de memoria para ejecutar los mismos experimentos. El siguiente gráfico muestra la media y los intervalos de confianza del 95 % de las latencias de predicción de lotes pequeños para diferentes valores de k.

La latencia incluye los cinco pasos del algoritmo de inferencia inductiva en tiempo real. Vemos que cuando k=2, la predicción de 1,030 transacciones lleva 5.4 segundos en promedio, lo que da como resultado un rendimiento de 190 transacciones por segundo. Esto confirma que la implementación del modelo RGCN es adecuada para la detección de fraude en tiempo real. También notamos que el anterior post no proporcionó valores duros de latencia para su implementación.

Conclusión

El modelo RGCN lanzado con esta publicación implementa el algoritmo para la inferencia inductiva en tiempo real y no requiere orquestación ni almacenamiento de gráficos externos. El parámetro k en el paso 3 del algoritmo especifica el número de saltos realizados para extraer el subgráfico para la inferencia y da como resultado un compromiso entre la precisión del modelo y la latencia de predicción. usamos el Conjunto de datos de fraude IEEE-CIS en nuestros experimentos, y empíricamente validado que el valor óptimo del parámetro k para este conjunto de datos es 2, logrando una puntuación AUC de 0.876 y una latencia de predicción de menos de 6 segundos por cada 1,000 transacciones.

Esta publicación proporcionó un proceso paso a paso para capacitar y evaluar un modelo RGCN para la detección de fraude en tiempo real. La clase de modelo incluida implementa métodos para todo el ciclo de vida del modelo, incluidos los métodos de serialización y deserialización. Esto permite que el modelo se utilice para la detección de fraudes en tiempo real. Puede entrenar el modelo como un estimador PyTorch SageMaker y luego implementarlo en un punto final de SageMaker usando lo siguiente cuaderno como plantilla. El punto final puede predecir el fraude en pequeños lotes de transacciones sin procesar en tiempo real. También puedes usar Recomendador de inferencia de Amazon SageMaker para seleccionar el mejor tipo de instancia y configuración para el punto final de inferencia en función de sus cargas de trabajo.

Para obtener más información sobre este tema y su implementación, lo alentamos a que explore y pruebe nuestros scripts por su cuenta. Puede acceder a los cuadernos y al código de clase de modelo relacionado desde el Ejemplos de repositorio de GitHub de AWS.

Acerca de los autores

Dmitri Bespalov es científico aplicado sénior en el laboratorio de soluciones de aprendizaje automático de Amazon, donde ayuda a los clientes de AWS de diferentes industrias a acelerar su adopción de la inteligencia artificial y la nube.

Dmitri Bespalov es científico aplicado sénior en el laboratorio de soluciones de aprendizaje automático de Amazon, donde ayuda a los clientes de AWS de diferentes industrias a acelerar su adopción de la inteligencia artificial y la nube.

marca ryan es científico aplicado en el laboratorio de soluciones de aprendizaje automático de Amazon. Tiene experiencia específica en la aplicación del aprendizaje automático a problemas en el cuidado de la salud y las ciencias de la vida. En su tiempo libre, le gusta leer historia y ciencia ficción.

marca ryan es científico aplicado en el laboratorio de soluciones de aprendizaje automático de Amazon. Tiene experiencia específica en la aplicación del aprendizaje automático a problemas en el cuidado de la salud y las ciencias de la vida. En su tiempo libre, le gusta leer historia y ciencia ficción.

yanjun qi es gerente sénior de ciencias aplicadas en Amazon Machine Learning Solution Lab. Ella innova y aplica el aprendizaje automático para ayudar a los clientes de AWS a acelerar su adopción de la inteligencia artificial y la nube.

yanjun qi es gerente sénior de ciencias aplicadas en Amazon Machine Learning Solution Lab. Ella innova y aplica el aprendizaje automático para ayudar a los clientes de AWS a acelerar su adopción de la inteligencia artificial y la nube.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- Platoblockchain. Inteligencia del Metaverso Web3. Conocimiento amplificado. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/build-a-gnn-based-real-time-fraud-detection-solution-using-the-deep-graph-library-without-using-external-graph-storage/

- 000

- 1

- 10

- 100

- 11

- 2%

- 28

- 7

- 95%

- a

- Poder

- Nuestra Empresa

- abuso

- acelerar

- de la máquina

- visitada

- Mi Cuenta

- la exactitud

- Logra

- el logro de

- a través de

- actividades

- adicional

- adición

- Adicionales

- direcciones

- Adopción

- Ventaja

- AI

- algoritmo

- Todos

- permite

- alternativa

- Amazon

- Aprendizaje automático de Amazon

- Amazonas Neptuno

- Amazon SageMaker

- entre

- y

- Aplicación

- aplicaciones

- aplicada

- La aplicación de

- aproximadamente

- Formación

- asigna

- asociado

- ficticio

- aumentado

- promedio

- AWS

- basado

- porque

- se convierte en

- "Ser"

- evaluación comparativa

- MEJOR

- mejores

- entre

- marca

- build

- construye

- construido

- llevar

- cases

- oportunidad

- el cambio

- clase

- clasificación

- Soluciones

- adopción en la nube

- código

- Columna

- Columnas

- combinado

- combinar

- comparar

- comparar

- complejidad

- Calcular

- Conducir

- confianza

- Configuración

- Confirmar

- Confirmado

- conectado

- constante

- construcción

- construcción

- contiene

- contraste

- contribución

- controles

- Correspondiente

- Cost

- Para crear

- crea

- crucial

- Clientes

- datos

- Base de datos

- conjuntos de datos

- Koops

- profundo

- Predeterminado

- se define

- Dependencia

- desplegar

- Desplegando

- despliegue

- detalles

- Detección

- dispositivo

- dgl

- HIZO

- una experiencia diferente

- discutir

- No

- Soltar

- durante

- cada una

- comercio electrónico

- efecto

- de manera eficaz

- permite

- permitiendo

- fomentar

- Punto final

- asegura

- Todo

- entidades

- entidad

- ambientes

- especialmente

- evaluar

- evaluado

- evaluación

- Incluso

- Cada

- ejemplo

- ejemplos

- esperado

- costoso

- experience

- experimento

- Explicar

- explorar

- ampliar

- externo

- extraerlos

- Caracteristicas

- Ficción

- Finalmente

- financiero

- servicios financieros

- Nombre

- siguiendo

- siguiente

- formato

- fraude

- detección de fraude

- fraudulento

- Gratis

- Desde

- ser completados

- completamente

- juego de azar

- generar

- obtener

- GitHub

- candidato

- gráfica

- maravillosa

- Difícil

- la salud

- ayuda

- ayuda

- más alto

- historia

- Cómo

- Como Hacer

- Sin embargo

- HTML

- HTTPS

- Identifique

- Identidad

- ilegal

- implementar

- implementación

- implementación

- implementos

- importar

- importante

- mejorar

- in

- En otra

- incluido

- incluye

- Incluye

- creciente

- industrias

- información

- Las opciones de entrada

- ejemplo

- Introducido

- Presenta

- IP

- Direcciones IP

- IT

- únete

- Clave

- conocido

- el lab

- Label

- Etiquetas

- large

- mayores

- Estado latente

- Lead

- APRENDE:

- aprendizaje

- Biblioteca

- Vida

- Ciencias de la vida

- ciclo de vida

- que otros

- carga

- Ubicaciones

- mirando

- Lealtad

- Programa de fidelidad

- máquina

- máquina de aprendizaje

- gerente

- Match

- significativo

- Medios

- Salud Cerebral

- métodos

- ML

- Moda

- modelo

- modelos

- los modos

- más,

- necesario

- Neptuno

- del sistema,

- telecomunicaciones

- redes neuronales

- Nuevo

- Next

- nodo

- nodos

- número

- números

- observar

- obtención

- ONE

- en línea

- pagos en línea

- Inteligente

- Operaciones

- óptimo

- orquestación

- Otro

- superando

- EL DESARROLLADOR

- Los pandas

- parámetro

- parámetros

- pasado

- pagos

- porcentaje

- Realizar

- actuación

- realizar

- fase

- teléfono

- los libros físicos

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- Popular

- Publicación

- predecir

- predecir

- predicción

- presente

- regalos

- evitar

- anterior

- Anterior

- Problema

- problemas

- producir

- Producción

- Programa

- PROMETEMOS

- proporcionar

- previsto

- piñón

- Qi

- Crudo

- en comunicarse

- Reading

- real

- mundo real

- en tiempo real

- grabar

- archivos

- reducir

- reduce

- la reducción de

- referido

- relacionado

- relaciones

- Relaciones

- liberado

- la eliminación de

- reportado

- representar

- representación

- exigir

- Requisitos

- requisito

- aquellos

- RESTO

- resultante

- Resultados

- volvemos

- Ejecutar

- Ryan

- sabio

- Inferencia de SageMaker

- mismo

- Guardar

- guión

- Ciencia:

- Ciencia ficción

- CIENCIAS

- Científico

- guiones

- Segundo

- segundos

- mayor

- de coches

- Servicios

- set

- pólipo

- ajustes

- Configure

- Varios

- Compartir

- mostrado

- Shows

- importante

- significativamente

- soltero

- Tamaño

- tamaños

- chica

- menores

- So

- Social

- redes sociales

- a medida

- Soluciones

- algo

- soluciones y

- velocidad

- dividido

- escisiones

- paso

- pasos

- parada

- STORAGE

- estrategias

- estructura

- ESTUDIO

- subgrafo

- subgrafos

- tal

- siguiente

- adecuado

- SOPORTE

- suspicaz

- mesa

- ¡Prepárate!

- toma de posesión

- toma

- Target

- Tarea

- tareas

- plantilla

- términos

- test

- Pruebas

- La

- La gráfica

- su

- de este modo

- por lo tanto

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- rendimiento

- equipo

- fecha y hora

- sincronización

- a

- demasiado

- tema

- Total

- Entrenar

- entrenado

- Formación

- transaccional

- Transacciones

- tratar

- Los árboles

- juicio

- ensayos

- verdadero

- tipos

- principiante

- us

- utilizan el

- usuarios

- generalmente

- validado

- propuesta de

- Valores

- vía

- que

- mientras

- Wi-fi

- seguirá

- sin

- palabras

- valor

- se

- Usted

- tú

- zephyrnet